Sécurité et gouvernance de l’entreprise pour Azure Machine Learning

Dans cet article, vous allez découvrir les fonctionnalités de sécurité et de gouvernance qui sont disponibles pour Azure Machine Learning. Ces fonctionnalités sont utiles pour les administrateurs, les ingénieurs DevOps et les ingénieurs MLOps qui souhaitent créer une configuration sécurisée conforme aux stratégies de votre entreprise.

Azure Machine Learning et la plateforme Azure vous permettent d’effectuer les opérations suivantes :

- Limiter l’accès aux ressources et aux opérations par compte d’utilisateur ou par groupe

- Limiter les communications réseau entrantes et sortantes.

- Chiffrer des données en transit et au repos.

- Analyser les vulnérabilités.

- Appliquer et auditer des stratégies de configuration.

Limiter l'accès aux ressources et aux opérations

Microsoft Entra ID est le fournisseur de services d’identité pour Azure Machine Learning. Vous pouvez vous en servir pour créer et gérer des objets de sécurité (utilisateur, groupe, principal de service et identité managée) qui sont utilisés pour s’authentifier auprès des ressources Azure. L’authentification multifacteur (MFA) est prise en charge si Microsoft Entra ID est configuré pour l’utiliser.

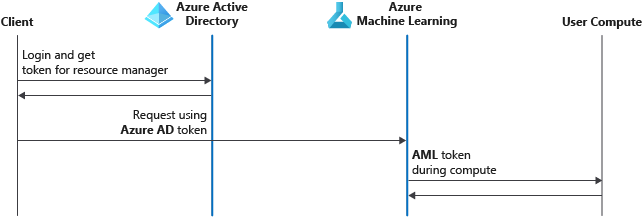

Voici le processus d’authentification pour Azure Machine Learning via MFA dans Microsoft Entra ID :

- Le client se connecte à Microsoft Entra ID et obtient un jeton Azure Resource Manager.

- Le client présente le jeton à Azure Resource Manager et à Azure Machine Learning.

- Azure Machine Learning fournit un jeton de Machine Learning service à la cible de calcul utilisateur (par exemple, cluster de calcul ou calcul serverless Machine Learning). La cible de calcul utilisateur se sert de ce jeton pour rappeler Machine Learning service une fois le travail terminé. L’étendue se limite à l’espace de travail.

Chaque espace de travail est associé à une identité managée attribuée par le système qui porte le même nom que l’espace de travail. Cette identité managée est utilisée pour accéder de façon sécurisée aux ressources dont se sert l’espace de travail. Elle dispose des autorisations de contrôle d’accès en fonction du rôle (RBAC) Azure suivantes sur les ressources associées :

| Ressource | Autorisations |

|---|---|

| Espace de travail | Contributeur |

| Compte de stockage | Contributeur aux données Blob du stockage |

| Coffre de clés | Accès à l’ensemble des clés, secrets et certificats |

| Registre de conteneurs | Contributeur |

| Groupe de ressources contenant l’espace de travail | Contributeur |

L’identité managée affectée par le système est utilisée pour l’authentification de service à service interne entre Azure Machine Learning et d’autres ressources Azure. Les utilisateurs ne peuvent pas accéder au jeton d’identité et ne peuvent pas l’utiliser pour accéder à ces ressources. Ils ont accès aux ressources uniquement par le biais des API de contrôle et de plan de données Azure Machine Learning, s’ils disposent d’autorisations RBAC suffisantes.

Nous déconseillons aux administrateurs de révoquer l’accès de l’identité managée aux ressources mentionnées dans le tableau précédent. Vous pouvez restaurer l’accès par une opération de resynchronisation des clés.

Remarque

Si votre espace de travail Azure Machine Learning contient des cibles de calcul (par exemple, cluster de calcul, instance de calcul ou instance Azure Kubernetes Service [AKS]) qui ont été créées avant le 14 mai 2021, vous avez probablement un compte Microsoft Entra supplémentaire. dont le nom commence par Microsoft-AzureML-Support-App-. Ce compte dispose d’un accès de niveau Contributeur à votre abonnement pour chacune des régions de l’espace de travail.

Si votre espace de travail n’a aucune instance AKS attachée, vous pouvez sans risque supprimer ce compte Microsoft Entra.

Si votre espace de travail a un cluster AKS attaché et qu’il a été créé avant le 14 mai 2021, ne supprimez pas ce compte Microsoft Entra. Dans ce cas de figure, vous devez supprimer et recréer le cluster AKS pour pouvoir supprimer le compte Microsoft Entra.

Vous pouvez provisionner l’espace de travail pour utiliser une identité managée affectée par l’utilisateur, puis accorder les rôles supplémentaires d’identité managée. Par exemple, vous pourriez accorder un rôle pour accéder à votre propre instance Azure Container Registry pour les images Docker de base.

Vous pouvez également configurer des identités managées pour pouvoir les utiliser avec un cluster de calcul Azure Machine Learning. Cette identité managée est indépendante de celle de l’espace de travail. Avec un cluster de calcul, l’identité managée permet d’accéder à des ressources telles que des magasins de données sécurisés auxquels l’utilisateur exécutant le travail d’entraînement n’a probablement pas accès. Pour plus d’informations, consultez Contrôle d’accès avec des identités managées.

Conseil

Il existe des exceptions à l’utilisation de Microsoft Entra ID et d’Azure RBAC dans Azure Machine Learning :

- Vous pouvez éventuellement activer l’accès SSH (Secure Shell) à des ressources de calcul, telles qu’une instance de calcul et un cluster de calcul Azure Machine Learning. L’accès SSH est basé sur des paires de clés publiques/privées, et non sur Microsoft Entra ID. Le contrôle d’accès en fonction du rôle (RBAC) Azure ne régit pas l’accès SSH.

- Vous pouvez vous authentifier auprès des modèles déployés en tant que points de terminaison en utilisant une authentification basée sur des clés ou des jetons. Les clés sont des chaînes statiques, tandis que les jetons sont récupérés via un objet de sécurité Microsoft Entra. Pour plus d’informations, consultez Authentifier les clients pour les points de terminaison en ligne.

Pour plus d’informations, consultez les articles suivants :

- Configurer l’authentification pour des ressources et workflows Azure Machine Learning

- Gérer l'accès à un espace de travail Azure Machine Learning

- Utiliser des magasins de données

- Utiliser des secrets d’informations d'identification d’authentification dans des travaux Azure Machine Learning

- Configurer l’authentification entre Azure Machine Learning et d’autres services

Fournir une sécurité et une isolation réseau

Pour restreindre l’accès réseau aux ressources Azure Machine Learning, vous pouvez utiliser un réseau virtuel managé Azure Machine Learning ou une instance Réseau virtuel Azure. L’utilisation d’un réseau virtuel réduit la surface d’attaque de votre solution, ainsi que les risques d’exfiltration de données.

Vous n’êtes pas obligé de choisir l’une ou l’autre. Par exemple, vous pouvez utiliser un réseau virtuel managé Azure Machine Learning pour aider à sécuriser les ressources de calcul managées et une instance Réseau virtuel Azure pour vos ressources non managées ou pour aider à sécuriser l’accès client à l’espace de travail.

Réseau virtuel managé Azure Machine Learning : fournit une solution complètement managée qui vous permet d’avoir un isolement réseau pour votre espace de travail et vos ressources de calcul managées. Vous pouvez utiliser des points de terminaison privés pour aider à sécuriser la communication avec d’autres services Azure et vous pouvez restreindre la communication sortante. Utilisez un réseau virtuel managé pour aider à sécuriser les ressources de calcul managées suivantes :

- Calcul serverless (y compris Spark serverless)

- Cluster de calcul

- Instance de calcul

- Point de terminaison en ligne managé

- Point de terminaison en ligne par lot

Pour plus d’informations, consultez Isolation de réseau virtuel managé pour un espace de travail.

Instance Réseau virtuel Azure : propose une offre de réseau virtuel plus personnalisable. Toutefois, vous êtes responsable de la configuration et de la gestion. Vous devrez probablement utiliser des groupes de sécurité réseau, des routes définies par l’utilisateur ou un pare-feu pour restreindre la communication sortante.

Pour plus d’informations, consultez les articles suivants :

- Sécuriser les ressources d’espace de travail Azure Machine Learning à l’aide de réseaux virtuels

- Sécuriser un espace de travail Azure Machine Learning à l’aide de réseaux virtuels

- Sécuriser un environnement d’entraînement Azure Machine Learning à l’aide de réseaux virtuels

- Sécuriser un environnement d’inférence Azure Machine Learning à l’aide de réseaux virtuels

- Utiliser Azure Machine Learning Studio dans un réseau virtuel Azure

- Utiliser votre espace de travail avec un serveur DNS personnalisé

- Configurer le trafic réseau entrant et sortant

Chiffrer les données

Azure Machine Learning utilise diverses ressources de calcul et magasins de données sur la plateforme Azure. Pour en savoir plus sur la façon dont chacune de ces ressources prend en charge le chiffrement de données au repos et en transit, consultez l’article Chiffrement des données avec Azure Machine Learning.

Empêcher l’exfiltration de données

Azure Machine Learning possède plusieurs dépendances réseau entrantes et sortantes. Certaines de ces dépendances peuvent représenter un risque d’exfiltration de données par des agents malveillants au sein de votre organisation. Ces risques sont associés aux exigences de trafic sortant vers Stockage Azure, Azure Front Door et Azure Monitor. Pour obtenir des recommandations sur l’atténuation de ce risque, consultez Prévention de l’exfiltration de données Azure Machine Learning.

Analyser les vulnérabilités

Microsoft Defender pour le cloud fournit une gestion unifiée de la sécurité et une protection avancée contre les menaces dans les charges de travail cloud hybrides. Pour Azure Machine Learning, vous devez activer l’analyse de votre ressource Azure Container Registry et de vos ressources AKS. Pour plus d’informations, consultez Introduction à Microsoft Defender pour les registres de conteneurs et Introduction à Microsoft Defender pour Kubernetes.

Auditer et gérer la conformité

Azure Policy est un outil de gouvernance qui vous aide à vous assurer que les ressources Azure sont conformes à vos stratégies. Vous pouvez définir des stratégies pour autoriser ou appliquer des configurations spécifiques, par exemple si votre espace de travail Azure Machine Learning utilise un point de terminaison privé.

Pour plus d’informations sur Azure Policy, consultez la documentation relative à Azure Policy. Pour plus d’informations sur les stratégies spécifiques à Azure Machine Learning, consultez Auditer et gérer Azure Machine Learning.

Étapes suivantes

- Meilleures pratiques en lien avec Azure Machine Learning pour la sécurité de l’entreprise

- Utiliser Azure Machine Learning avec un pare-feu Azure

- Utiliser Azure Machine Learning avec un réseau virtuel Azure

- Chiffrer les données au repos ou en transit

- Générer une API de recommandation en temps réel sur Azure