Notes de publication Azure Media Services v3

Avertissement

Azure Media Services sera mis hors service le 30 juin 2024. Pour plus d’informations, consultez le Guide de mise hors service AMS.

Pour vous informer des développements les plus récents, cet article détaille les thèmes suivants :

- Versions les plus récentes

- Problèmes connus

- Résolution des bogues

- Fonctionnalités dépréciées

Juin 2023

Azure Media Services sera mis hors service à compter du 30 juin 2023. Consultez le guide de mise hors service d’Azure Media Services.

Mars 2023

Azure Media Indexer est mis hors service. Il est remplacé par le mode De base De Media Services v3 AudioAnalyzerPreset.

Février 2023

Notes de publication pour février bientôt.

Janvier 2023

Métadonnées chronotés

Les métadonnées chronométriques sont des données personnalisées insérées dans un flux en direct. Les données et leur horodatage d’insertion sont conservés dans le flux multimédia lui-même. Cela permet aux clients l’exécution du flux vidéo d’obtenir les mêmes métadonnées personnalisées exactement en même temps par rapport au flux vidéo. Avec les métadonnées chronotés, vous pouvez :

- Ajoutez des éléments d’interactivité au flux en direct, par exemple un sondage.

- Ajoutez des informations relatives au contenu vidéo, telles que des haut-parleurs, des liens de produits, des statistiques des joueurs sportifs, etc.

- Ajoutez des métadonnées sur la vidéo, telles que l’emplacement GPS, l’heure, etc.

Pour plus d’informations, consultez Métadonnées chronotés avec Azure Media Services et Guide pratique pour signaler des métadonnées chronotés avec Azure Media Services. Vous pouvez l’essayer avec Stackblitz.

Séparation du débit binaire

La décision de séparation et de résolution du débit de transmission ContentAwareEncoding a été améliorée dans la version de ce mois-ci.

ContentAwareEncoding peut être utilisé avec PresetConfigurations pour répondre à vos besoins spécifiques pour des performances optimales de streaming et d’encodage.

Pour une meilleure séparation du débit, la complexité estimée de l’encodage d’essai a été utilisée pour estimer la vitesse de transmission de la couche supérieure, la vitesse de transmission de la couche inférieure et le nombre total de couches. Une fois que la vitesse de transmission de la couche supérieure, la vitesse de transmission de la couche inférieure et le nombre de couches sont déterminées, les débits des couches intermédiaires sont calculés en fonction du taux de transmission pair entre les couches voisines. Il est presque uniformément séparé par vitesse de transmission dans ce cas.

Lorsqu’il s’agit de la résolution, la couche inférieure est le main problème. La résolution de couche inférieure peut être configurée via PresetConfigurations. La logique modifiée détermine la résolution de la couche inférieure en fonction de la complexité estimée de l’encodage d’essai si vous ne le configurez pas. Elle détermine également la vitesse de transmission de la couche inférieure si elle est définie par les utilisateurs via PresetConfigurations. La décision de résolution a essayé d’utiliser des résolutions supérieures à 180P pour la couche inférieure afin d’obtenir une meilleure qualité visuelle.

Cette version améliore également l’algorithme d’estimation de la complexité du contenu. L’algorithme d’origine est conservateur et génère des débits plus élevés que nécessaire. Avec l’estimation modifiée, les débits de sortie sont généralement plus bas qu’auparavant. En d’autres termes, vous pouvez désormais économiser plus d’argent en termes de bande passante réseau et de coûts de stockage.

Exemples de SDK .NET pour le dernier kit de développement logiciel (SDK) client Azure.ResourceManager.Media

Le Kit de développement logiciel (SDK) client Azure.ResourceManager.Media mis à jour (également appelé « track 2 » SDK .NET) est disponible dans Nuget Azure.ResourceManager.Media. Tous les exemples ont été mis à jour dans la branche main de notre référentiel d’exemples pour .NET sur github vers la dernière version de ce Kit de développement logiciel (SDK) client. Azure-Samples/media-services-v3-dotnet. Les projets contenus dans ce référentiel montrent comment implémenter différents scénarios Azure Media Services à l’aide de la version v3. (github.com).

Modifications apportées à l’interface Assets dans le Portail Azure

Vous verrez une expérience utilisateur améliorée dans le panneau Ressources du Portail Azure. Vous pouvez maintenant afficher les pistes et les fichiers dans la ressource. Vous pouvez également charger, mettre à jour ou supprimer des pistes audio et de texte dans une ressource.

Décembre 2022

Media Services prend désormais en charge IPv6 pour diffuser du contenu multimédia vers des événements en direct, diffuser du contenu à partir de points de terminaison de streaming et lors de la remise de clés de contenu. Pour activer IPv6 pour les points de terminaison de streaming et les événements en direct, la liste d’adresses IP autorisées pour la ressource doit inclure au moins une adresse IPv6 ou une plage IPv6. Lorsque la prise en charge du CDN est activée pour un point de terminaison de streaming, la prise en charge IPv6 dépend de la configuration du CDN.

Pour plus d’informations sur l’utilisation d’IPv6 avec Media Services, consultez Événements en direct Media Services et Restreindre l’accès à la licence DRM et à la remise de clés AES à l’aide de listes d’autorisation IP.

Novembre 2022

Media Services supprime désormais le rendu audio de la sélection de variantes HLS par défaut pour empêcher le client de revenir à l’audio uniquement dans une situation de réseau médiocre.

Pour modifier le comportement, vous pouvez utiliser la balise [audio-only=true] URL pour écrire un rendu audio dans la playlist HLS Variant.

Par exemple :

http://host/locator/asset.ism/manifest(format=m3u8-aapl,audio-only=true)

Cela est dû à un changement dans les instructions de création HLS qui indiquent désormais « Vous NE DEVEZ avoir aucune variante audio uniquement répertoriée dans la playlist Multivariant ».

Septembre 2022

Version de l’API : Mise à jour de l’API REST ARM 2022-08-01

Une version mise à jour de l’API REST ARM pour Azure Media Services a été publiée. La version 2022-08-01 est désormais la dernière version stable en production. Les définitions d’API REST les plus récentes sont disponibles dans le dossier des spécifications REST pour Media Services sur GitHub.

Mises à jour à l’API 2022-08-01 :

- L’entité LiveOutput introduit une nouvelle propriété nullable rewindWindowLength pour contrôler la longueur de la fenêtre pouvant être recherchée pendant Live pour l’encodage et passer les événements en direct. Cette propriété n’est pas utilisée une fois Que LiveOutput s’arrête. La VOD archivée aura un contenu complet avec archiveWindowLength d’origine. Lorsque la propriété est définie sur null, un événement en direct à faible latence (LowLatencyV2) utilise la valeur par défaut de 30 minutes ; un événement en direct standard ne l’utilise pas.

- Ajout de la prise en charge du niveau de sécurité PlayReady SL3000 dans les stratégies de clé de contenu

- API de pistes de ressources étendues pour prendre en charge les pistes audio (pour la liaison tardive de l’audio descriptif ou plusieurs langues)

- Ajout de la prise en charge de la clé claire de chiffrement commun MPEG avec les modes « cenc » et « cbcs » dans les stratégies de streaming

Nouvelles versions du client sdk disponibles pour Javascript, Python, Go

Le nouveau SDK client Python v10.1.0 est disponible sur PyPI : azure-mgmt-media

Le nouveau SDK client Javascript v13 est disponible sur npm : Azure Media client library for JavaScript - @azure/arm-mediaservices

Le nouveau kit SDK client GO v 3.1.0 est disponible - package armmediaservices

Prise en charge des licences PlayReady Security Level 3000 (SL3000)

Les fonctionnalités de protection du contenu et de distribution de licences PlayReady DRM de Media Services prennent désormais en charge PlayReady SL3000. Le niveau de sécurité est une propriété d’un client PlayReady, et chaque licence remise à un client a une propriété indiquant le niveau de sécurité minimal requis par un client pour autoriser la liaison à cette licence. Le niveau de sécurité 3000 est fourni pour les appareils renforcés avec la sécurité la plus élevée consommant la plus haute qualité de contenu commercial. Cette mise à jour vous permet de configurer des stratégies de clé de contenu pour remettre des licences PlayReady SL3000 via les serveurs de licences de remise de clés Media Services. Pour plus d’informations sur les niveaux de sécurité PlayReady, consultez l’article Utilisation du niveau de sécurité dans une licence.

- Si vous ajoutez un SL3000 PlayReady ContentKeyPolicyOption à une stratégie de clé de contenu, cette stratégie ne peut contenir que des options PlayReady SL3000 ou Widevine L1 supplémentaires.

- SL3000 nécessite que vous utilisiez une autre clé pour l’audio ou que vous utilisiez l’audio non chiffré. Le niveau de sécurité audio doit être limité à SL2000 ou inférieur.

- La lecture SL3000 ne fonctionne pas dans Azure Media Player (AMP) à ce stade. Testez dans un lecteur tiers (par exemple, Shaka Player) ou un appareil qui prend en charge la lecture SL3000.

Exemple de stratégie de clé de contenu :

{

"properties": {

"options": [

{

"name": "PlayReadyOption",

"configuration": {

"@odata.type": "#Microsoft.Media.ContentKeyPolicyPlayReadyConfiguration",

"licenses": [

{

"playRight": {

"digitalVideoOnlyContentRestriction": false,

"imageConstraintForAnalogComponentVideoRestriction": false,

"imageConstraintForAnalogComputerMonitorRestriction": false,

"allowPassingVideoContentToUnknownOutput": "NotAllowed"

},

"licenseType": "NonPersistent",

"contentKeyLocation": {

"@odata.type": "#Microsoft.Media.ContentKeyPolicyPlayReadyContentEncryptionKeyFromHeader"

},

"contentType": "Unspecified",

"securityLevel": "SL3000"

}

]

},

"restriction": {

"@odata.type": "#Microsoft.Media.ContentKeyPolicyOpenRestriction"

}

}

]

}

}

**Exemple de stratégie de diffusion en continu utilisant une stratégie de clé de contenu SL3000 pour la vidéo et une stratégie de clé de contenu SL2000 pour les pistes audio : **

{

"properties": {

"defaultContentKeyPolicyName": "sl3000_content_key_policy",

"commonEncryptionCenc": {

"enabledProtocols": {

"download": false,

"dash": true,

"hls": false,

"smoothStreaming": true

},

"contentKeys": {

"defaultKey": {

"label": "cencDefaultKey"

},

"keyToTrackMappings": [

{

"label": "audiokey",

"policyName" : "sl2000_content_key_policy",

"tracks": [

{

"trackSelections": [

{

"property": "FourCC",

"operation": "Equal",

"value": "mp4a"

}

]

}

]

}

]

},

"drm": {

"playReady": {}

}

}

}

}

Pour plus d’informations sur l’utilisation des modèles de licence PlayReady, consultez l’article Modèles de licence PlayReady Media Services

Ajouter des pistes audio pour l’audio descriptif ou plusieurs langues avec la nouvelle API Asset Tracks

La nouvelle API Asset Tracks vous permet de lier en retard un nombre quelconque de pistes audio à une ressource existante et de les rendre disponibles pour l’empaquetage dynamique dans HLS et DASH. L’API prend en charge la définition de métadonnées pour spécifier la langue ou les caractéristiques de contenu afin de spécifier l'« audio descriptif » afin d’améliorer l’accessibilité du contenu.

Pour obtenir la liste complète des fonctionnalités de l’API Tracks, consultez l’article API Pistes Media Services

Prise en charge de la clé claire de chiffrement commun MPEG avec chiffrement CENC et CBCS

Clear Key Encryption est une fonctionnalité de la norme MPEG Common Encryption (CENC) et est prise en charge par les extensions EME (Encrypted Media Extensions) HTML5 disponibles dans de nombreux navigateurs modernes. Les modes de chiffrement Clear Key AES-128 à l’aide des modes de chiffrement « cenc » ou « cbcs » peuvent être définis dans vos stratégies de diffusion en continu pour vous permettre d’atteindre la plus grande gamme d’appareils sur Apple, web et Android.

Cette fonctionnalité vous permet de prendre en charge la norme Common Encryption sans utiliser de système DRM et d’atteindre le plus grand nombre de joueurs. Avec la prise en charge du chiffrement clear key à l’aide des modes de chiffrement « cenc » ou « cbcs », vous pouvez désormais distribuer du contenu sécurisé sans DRM aux lecteurs qui prennent en charge l’un des modes de chiffrement autorisés dans le standard. Cela vous permet de fournir du contenu chiffré aux lecteurs clients tels que Google Shaka Player (v 4.0.0+), Dash.js (v 4.5+), Bitmovin, Theo Player et Android ExoPlayer (v 2.18.1+) à l’aide du chiffrement « cenc ».

Pour plus d’informations sur l’utilisation des fonctionnalités de protection de contenu de Media Services, consultez l’article Protection du contenu avec chiffrement dynamique et distribution de clés

Fenêtre de rembobinage et fenêtre d’archivage sur les sorties en direct

RewindWindowLength peut être défini sur Les sorties en direct pour contrôler la fenêtre pouvant être cherchée sur le lecteur client pendant la diffusion en direct. Cela permet au client de contrôler la quantité de temps visible dans le lecteur pour la recherche dans le flux en direct. Ce paramètre permet également de réduire la taille du manifeste remis au client sur le réseau pendant la diffusion en direct, ce qui peut aboutir à une expérience de streaming en direct plus efficace et réduire l’utilisation de la mémoire sur le client.

Une fois votre flux terminé, vous pouvez accéder au fichier archivé dans la ressource définie par la propriété archiveWindowLength sur la sortie dynamique. Cela vous permet désormais de définir une durée d’archivage différente de la durée précédente de la « fenêtre glissante DVR » qui est visible par le lecteur. Cela est très utile lorsque vous souhaitez diffuser en continu avec une très petite fenêtre de décalage temporel dans le lecteur, mais que vous souhaitez archiver l’événement en direct entier dans la ressource de sortie.

Vous pouvez définir rewindWindowLength sur une valeur minimale de 60 secondes. La valeur par défaut est de 30 minutes si vous activez un événement en direct avec l’option « LowLatencyV2 ». Sinon, il n’existe aucune valeur par défaut. Si rewindWindowLength n’est pas défini et que l’événement en direct n’est pas défini pour utiliser l’option « LowLatencyV2 », aucune valeur par défaut n’est définie par le serveur et la fenêtre pouvant être cherchée pendant la lecture en direct est la même valeur que l’archiveWindowLength. Dans ce cas, si archiveWindowLength est défini sur une très grande durée, le lecteur peut être affecté par d’autres problèmes de mise en mémoire tampon pendant la lecture en mode en direct en raison de la taille de manifeste plus élevée que le téléchargement vers le lecteur pour l’analyse.

Pour plus d’informations, consultez l’article Utiliser le décalage temporel et les sorties en direct pour créer une lecture vidéo à la demande

Nouvelle région : Chine Nord 3 est désormais en disponibilité générale

Les clients en Chine peuvent désormais accéder à Azure Media Services dans la région Chine Nord 3, en plus des 4 régions existantes qui sont déjà ga (Chine Est, Chine Est 2, Chine Nord, Chine Nord 2). Pour plus d’informations, consultez le tableau disponibilité par région par fonctionnalité .

Mise hors service d’Azure Media Redactor, Video Analyzer et Face Detector le 14 septembre 2023

Comme le décrivent les normes d’IA responsable de Microsoft, Microsoft s’engage à l’équité, à la confidentialité, à la sécurité et à la transparence en ce qui concerne les systèmes IA. Pour mieux aligner nos produits sur cette nouvelle norme et la stratégie d’accès limité pour d’autres produits Microsoft, Azure Media Services mettra hors service les fonctionnalités suivantes le 14 septembre 2023 :

- Azure Media Redactor (RESTv2)

- Préréglage de Face Detector

- Préréglage de Video Analyzer

Après le 14 septembre 2023, toutes les applications que vous avez développées à l’aide d’Azure Media Redactor, de la présélection Détecteur de visages ou de la présélection Video Analyzer commenceront à rencontrer des erreurs ou des soumissions de travaux ayant échoué.

Action requise

Le redactor multimédia Azure (RESTv2) et la présélection détecteur de visages seront mis hors service et ne seront pas remplacés pour l’instant. Si vous souhaitez plutôt détecter des personnes dans une vidéo, nous vous recommandons de mettre à jour vos applications pour utiliser les API Video Indexer pour détecter les personnes observées et faire correspondre les personnes observées aux visages et envoyer une demande d’accès au programme Accès limité pour ces fonctionnalités.

Si vous utilisez actuellement la présélection Video Analyzer, nous vous recommandons de mettre à jour vos applications pour utiliser les API Video Indexer pour l’analyse vidéo, qui offrent une gamme étendue de fonctionnalités.

Plus d’informations

Si vous avez des questions, posez-les aux experts de la communauté dans Microsoft Q&A. Si vous avez un plan de support et que vous avez besoin d’aide technique, créez une demande de support dans le Portail Azure.

Août 2022

Nouvel exemple d’API Pistes dans Node.js/Typescript pour ajouter des pistes de sous-titre et de légende à n’importe quelle ressource

Un nouvel exemple illustrant la liaison tardive d’un fichier de sous-titre ou de légende WebVTT ou TTML est désormais disponible dans l’exemple de projet Node.js. Voir l’exemple Ajouter un sous-titre ou une légende WebVTT/IMSC1/TTML à une ressource existante

Cet exemple montre comment ajouter un certain nombre de pistes de texte à une ressource et les empaqueter en tant que profil texte TTML/IMSC1 dans DASH et HLS. L’API vous permet également de définir des caractéristiques spécifiques du manifeste HLS, telles que la piste de légende par défaut, de définir la propriété « Forced », ainsi que de contrôler la valeur « Caractéristiques » de la piste de texte HLS par spécification Apple HLS.

L’API prend actuellement en charge le chargement du format de fichier .vtt ou .ttml vers une ressource existante. Les nouvelles pistes inscrites auprès de l’API Pistes s’affichent immédiatement dans les manifestes DASH et HLS en tant que pistes de texte MP4 de profil IMSC1.

Juin 2022

Débits audio personnalisés pris en charge dans les présélections d’encodage en direct personnalisées

Vous pouvez désormais demander une présélection d’encodage en direct personnalisée qui prend en charge plusieurs sorties à débit audio. Pour l’audio, dans une présélection en direct, vous pouvez désormais personnaliser avec les débits audio AAC discrets suivants (96k, 112k, 128k, 160k, 192k, 224k, 256k, 320k, 384k, 448k, 512k). Spécifiez également que vous demandez une présélection personnalisée dans le ticket de support.

Les présélections personnalisées peuvent désormais contenir plusieurs débits audio discrets dans la même présélection d’encodage en direct. Cela est utile pour les marchés qui nécessitent une piste audio à débit inférieur sur les réseaux mobiles. Par exemple, une présélection en direct personnalisée qui peut générer simultanément des pistes audio AAC 96k et 128k. Le lecteur peut ensuite filtrer ou sélectionner la piste appropriée, ou un filtre dynamique peut être appliqué pour offrir un manifeste 96k uniquement ou un manifeste 128k uniquement lors de la publication d’un localisateur de streaming (ou activé à l’aide du paramètre de requête « filter={filterName} » sur l’URL du localisateur de streaming).

Mise à l’échelle automatique

Vous pouvez désormais mettre à l’échelle automatiquement les points de terminaison de streaming Premium dans votre compte Media Services en fonction des métriques disponibles pour le point de terminaison de streaming ou des métriques pour les entités associées. Une combinaison de ces métriques peut être utilisée pour créer la règle de mise à l’échelle automatique. Pour plus d’informations, consultez Mise à l’échelle automatique des points de terminaison de streaming Media Services. Notez que la mise à l’échelle automatique peut encore prendre du temps et n’est pas instantanée. Veillez donc à laisser suffisamment de temps pour que les ressources puissent se mettre à l’échelle et se déployer dans vos conceptions d’architecture. Les points de terminaison de streaming prennent le temps de se lancer. Il est donc recommandé d’utiliser des points de déclencheur de valeur inférieure pour l’utilisation du processeur et la sortie de bande passante réseau pour déclencher un scale-up.

Mai 2022

Prise en charge de la décoration de manifeste HLS 708 et 608 sous-titrage

Les flux en direct qui sont ingérés avec des légendes 608/708 incorporées dans le flux élémentaire sont désormais correctement attribués dans le manifeste HLS à l’aide de la balise EXT-X-MEDIA avec un TYPE=CLOSED-CAPTIONS. Cela est conforme à la section 4.3.4.4.1 de la RFC-8216.

Par exemple, un flux en direct avec des sous-titres 608 et 708 s’affiche dans le manifeste HLS :

#EXT-X-MEDIA:TYPE=CLOSED-CAPTIONS,GROUP-ID="cc",NAME="CEA708_CC",DEFAULT=YES,INSTREAM-ID="SERVICE1"

#EXT-X-MEDIA:TYPE=CLOSED-CAPTIONS,GROUP-ID="cc",NAME="CEA608_CC",INSTREAM-ID="CC1"

Avril 2022

Transcriptions en direct

La transcription en direct est désormais en disponibilité générale et prend en charge toutes les langues disponibles dans l’API de reconnaissance vocale. La liste complète des langues est disponible dans l’article Régions et langues de transcription en direct

HLS à faible latence (LL-HLS)

HLS à faible latence (LL-HLS) est désormais disponible dans l’API et dans le portail Azure. Pour activer LL-HLS, utilisez l’option de flux « LowLatencyV2 » lors de la création d’un flux en direct. Consultez l’exemple Node.js pour savoir comment créer un événement d’encodage en direct HLS à faible latence. Dans le portail Azure, sélectionnez la nouvelle option « Latence faible » lors de la création d’un événement en direct. La nouvelle fonctionnalité LL-HLS peut fournir une latence réduite dans la plage de 4 à 7 secondes lors de l’utilisation d’un framework de lecteur qui prend en charge le protocole LL-HLS. HLS à faible latence est disponible uniquement sur les canaux de transcodage en direct et n’est pas encore disponible pour les événements en direct en mode « pass-through ».

Mars 2022

SDK .NET version 6.0.0

Le SDK .NET version 6.0.0 est désormais disponible sur Nuget. Microsoft.Azure.Management.Media

Ce SDK prend en charge la nouvelle version stable 2021-11-01 de la spécification OpenAPI REST AMS.

Pour effectuer l’installation à l’aide du Gestionnaire de package :

Install-Package Microsoft.Azure.Management.Media -Version 6.0.0

Pour effectuer l’installation à l’aide de l’interface CLI .Net

dotnet add package Microsoft.Azure.Management.Media --version 6.0.0

Les changements apportée au SDK 6.0.0 sont notamment les suivants :

- Ajout de la nouvelle API de pistes sous l’actif multimédia pour gérer les pistes disponibles dans l’actif multimédia.

- Ajout du profil d’encodage Main10 pour l’encodage H265.

- Exposition de RateControlMode pour l’encodage H264, activant 2 nouveaux modes de contrôle de débit :CBR (vitesse de transmission constante) et CRF (facteur de transmission constante).

- Ajout de la propriété « skus » au point de terminaison de streaming pour indiquer le type de point de terminaison de streaming et sa mise à l’échelle. Cela permet la configuration d’une mise à l’échelle manuelle ou automatique d’unités de streaming dans un point de terminaison de streaming.

- Ajout de l’option de flux « LowLatencyV2 » sur l’événement en direct à utiliser pour le streaming en direct à faible latence à l’aide du format HLS à faible latence (LL-HLS) d’Apple

Nouveau contenu Docs : Diffuser en streaming une réunion Microsoft Teams

Il est facile de relayer votre diffusion de réunion à partir de Microsoft Teams avec un événement en direct Media Services. Placez facilement votre réunion Teams en direct sur un site web public, ou utilisez DRM pour protéger votre flux. Capturez et enregistrez le flux en tant qu’actif multimédia VOD à utiliser avec la plateforme d’encodage Media Services. Consultez Diffuser en streaming une réunion Microsoft Teams.

Effectuer une liaison tardive de pistes de légendes et de sous-titres sur des actifs multimédias avec la nouvelle API des pistes

Une nouvelle API des pistes sur les actifs multimédias vous permet de lister les pistes disponibles à l’intérieur d’un actif multimédia. Cela vous permet de détecter les pistes audio, vidéo et de texte disponibles stockées dans un actif multimédia. L’API des pistes vous permet d’effectuer une liaison tardive de fichiers de légendes et de sous-titres dans le profil texte IMSC1 et au format WebVTT à vos ressources de streaming. Dans le passé, les clients devaient modifier le fichier .ism dans le compte de stockage d’objets blob pour ajouter de nouvelles pistes à liaison tardive à leurs ressources. Cela remplace cette tâche manuelle et fournit une route du SDK pris en charge pour permettre l’ajout de fichiers de sous-titres et de légendes à liaison tardive.

Pour obtenir des détails techniques sur la nouvelle API des pistes, consultez la version 2021-11-01 de la spécification OpenAPI REST AMS ici.

Une liste de base d’exemples de pistes est fournie en Javascript pour chacune. Des exemples et des documents supplémentaires seront bientôt fournis pour chaque SDK.

Décembre 2021

Mise à jour du SDK JavaScript version 10.0.0

Le SDK JavaScript est maintenant mis à jour pour prendre en charge la dernière version 2021-06-01 de l’API REST. Ce nouveau SDK JavaScript isomorphe offre une meilleure prise en charge des promesses et la possibilité de s’authentifier avec la bibliothèque @azure/identity pour être utilisé avec des applications Azure AD, une identité managée et plus encore.

Pour télécharger le package le plus récent, consultez le package NPM @azure/arm-media-services.

Un ensemble mis à jour et développé d’exemples Node.js et TypeScript pour le nouveau package JavaScript est disponible dans GitHub. https://github.com/Azure-Samples/media-services-v3-node-tutorials

Langues Hébreu, Persan et Portugais (Portugal) maintenant disponibles dans la présélection de l’analyseur audio/vidéo pour les transcriptions

L’hébreu, le persan et le portugais (Portugal) (le modèle actuel est en portugais brésilien) sont désormais disponibles dans la présélection de l’analyseur audio et vidéo

Les nouveaux codes de langue BCP-47 pris en charge sont : he-IL, fa-IR et pt-PT.

Nouvelle région : La région Suède Centre est désormais en disponibilité générale

Media Services est désormais généralement disponible dans la région Suède Centre. Il existe actuellement des limitations de fonctionnalités dans la région, et nous attendons que quelques services de dépendance arrivent également dans la région. Vérifiez le graphique de disponibilité régionale des fonctionnalités pour déterminer le moment de leur arrivée.

Nouvel événement de pulsation d’archive de canal d’événements en direct

Un nouvel événement qui effectue le suivi de l’état et de l’intégrité de l’archive d’événement en direct a été ajouté. Pour plus d’informations sur ce nouvel événement, consultez LiveEventChannelArchiveHeartbeatEvent dans les Schémas Event Grid pour les événements Media Services.

Septembre 2021

Nouvelle référence SKU d’événement en direct pass-through de base

La nouvelle référence d’événement SKU en direct pass-through de base permet aux clients de créer des événements en direct à un prix inférieur. Elle est similaire aux événements en direct pass-through standard, mais avec des limites de bande passante d’entrée inférieures, moins de sorties dynamiques autorisées, des limites de longueur de fenêtre DVR différentes et aucun accès à la transcription en direct. Pour plus d’informations, consultez Comparaison des types d’événements en direct.

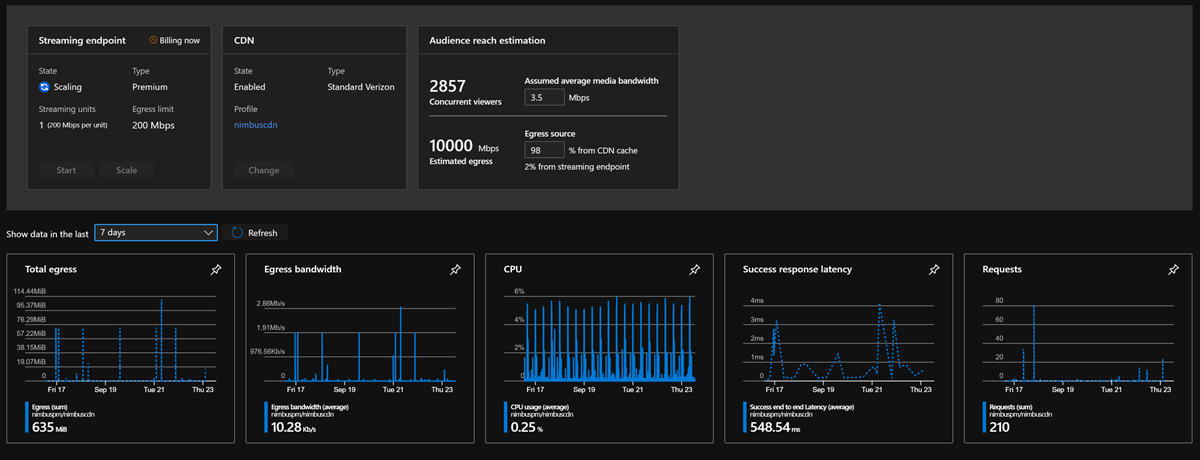

Amélioration de la gestion de la mise à l’échelle et de la supervision d’un point de terminaison de streaming dans le portail

La page du portail relative aux points de terminaison de streaming vous permet désormais de gérer facilement votre capacité de sortie et d’estimer la portée de votre audience avec ou sans CDN configuré. Changez le débit binaire de livraison et le taux attendu de correspondance dans le cache CDN pour obtenir des estimations rapides de la taille de votre audience et déterminer si vous devez effectuer un scale-up vers des points de terminaison de streaming Premium supplémentaires.

La page du portail relative aux points de terminaison de streaming montre désormais les métriques de processeur, de sortie et de latence

Vous pouvez désormais visualiser de bout en bout les métriques relatives à la charge des processeurs, à la bande passante de sortie et à la latence sur les points de terminaison de streaming correspondants dans le portail Azure. Vous pouvez créer des alertes de supervision basées sur les métriques de processeur, de sortie ou de latence directement dans le portail à l’aide de la puissance d’Azure Monitor.

Prise en charge des identités managées affectées par l’utilisateur pour les comptes Media Services

Avec les identités managées affectées par l’utilisateur, les clients peuvent désormais améliorer la sécurité de leurs comptes de stockage et des coffres de clés associés. L’accès au compte de stockage du client et aux coffres de clés est limité à l’identité managée affectée par l’utilisateur. Vous avez un contrôle total sur la durée de vie des identités managées affectées par l’utilisateur. Ainsi, vous pouvez facilement révoquer l’accès du compte Media Services à un compte de stockage spécifique, selon les besoins.

La page des comptes de stockage Media Services du portail prend désormais en charge UAMI et SAMI

Vous pouvez désormais attribuer et gérer des identités managées affectées par l’utilisateur (UAMI) ou des identités managées affectées par le système (SAMI) à vos comptes de stockage directement dans le portail Azure pour Media Services.

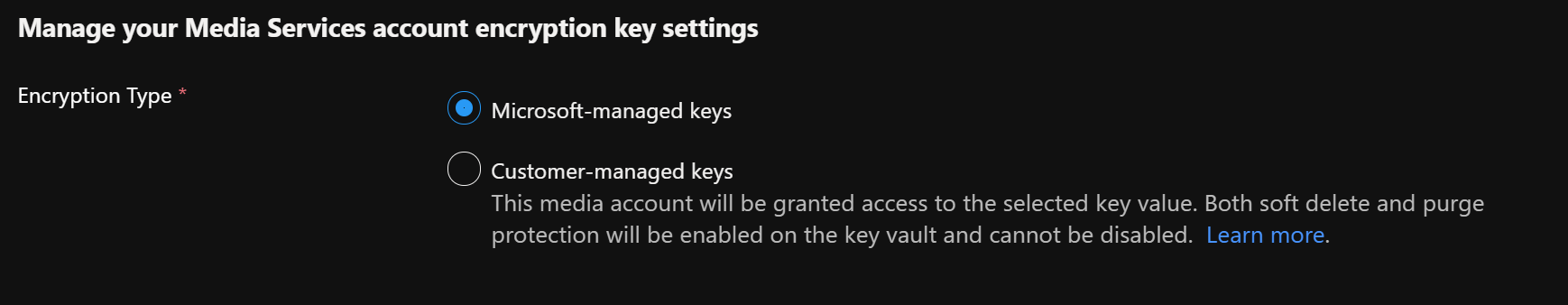

La page Bring Your Own Key prend maintenant en charge UAMI et SAMI.

La page du portail de gestion des clés de Media Services prend désormais en charge la configuration et la gestion des identités managées affectées par l’utilisateur (UAMI) ou des identités managées affectées par le système (SAMI).

Prise en charge des points de terminaison privés pour Media Services

Vous pouvez désormais restreindre l’accès public à vos événements en direct, à vos points de terminaison de streaming ainsi qu’au point de terminaison de services de remise de clés pour la protection du contenu et la gestion des droits numériques (DRM). Il vous suffit de créer un point de terminaison privé pour chacun des services. Cela limite l’accès public à chacun de ces services. Seul le trafic provenant du réseau virtuel (VNet) configuré dans le point de terminaison privé peut atteindre ces points de terminaison.

Liste d'adresses IP autorisées pour le service de clés

Vous pouvez désormais autoriser certaines adresses IP publiques à accéder au service de remise de clés pour la gestion DRM et la protection du contenu. Les points de terminaison d’événements en direct et les points de terminaison de streaming prennent déjà en charge la configuration des listes d'adresses IP autorisées dans leurs pages respectives.

Désormais, vous disposez également d’un indicateur de fonctionnalité au niveau du compte pour autoriser/bloquer l’accès Internet public à votre compte Media Services.

Juillet 2021

SDK .NET (Microsoft.Azure.Management.Media) version 5.0.0 disponible dans NuGet

La version 5.0.0 du kit de développement logiciel (SDK) Microsoft.Azure.Management.Media est désormais disponible sur NuGet. Cette version est générée pour fonctionner avec la version stable 2021-06-01 de l’API REST ARM.

Pour plus d’informations sur les changements apportés à la version 4.0.0, consultez le journal des modifications.

Changements apportés à la version 5.0.0 du kit SDK .NET

- Le compte Media Services prend désormais en charge les identités managées affectées par le système et l’utilisateur.

- Ajout de l’option PublicNetworkAccess aux comptes Media Services. Cette option peut être utilisée avec la fonctionnalité Private Link pour autoriser uniquement l’accès à partir de réseaux privés, et bloquer l’accès à partir de réseaux publics.

- Basic passthrough : ajout d’un nouveau type d’événement en direct. Les événements en direct « Basic Pass-through » ont des fonctionnalités similaires aux événements en direct pass-through standard avec certaines restrictions d’entrée et de sortie, et sont proposés à un prix réduit.

- PresetConfigurations : vous permet de personnaliser les paramètres de sortie et les vitesses de transmission minimale et maximale utilisées pour les présélections d’encodage sensible au contenu. Cela permet d’estimer et de planifier plus précisément la facturation lors de l’utilisation de l’encodage sensible au contenu via des résolutions et des numéros de piste de sortie avec contraintes.

Dernières modifications dans la version 5.0.0 du kit de développement logiciel (SDK) .NET

- ApiErrorException a été remplacé par ErrorResponseException à des fins de cohérence avec tous les autres kits de développement logiciel (SDK) Azure. Le corps de l’exception n’a pas été modifié.

- Tous les appels qui retournent l’erreur « 404 Not Found » lèvent maintenant l’exception ErrorResponseException au lieu de retourner une valeur null. Ce changement a été apporté par souci de cohérence avec les autres kits SDK Azure

- Le constructeur Media Services inclut un nouveau paramètre PublicNetworkAccess facultatif après le paramètre KeyDelivery.

- La propriété de type dans MediaServiceIdentity est passée du ManagedIdentityType enum à chaîne pour permettre la prise en charge de plusieurs types séparés par des virgules. Les chaînes valides sont SystemAssigned ou UserAssigned.

Juin 2021

Propriétés supplémentaires de pulsation d’ingestion d’événements en direct pour des diagnostics améliorés

Des propriétés supplémentaires de pulsation d’ingestion d’événements en direct ont été ajoutées au message Event Grid. Cela comprend les nouveaux champs suivants destinés à faciliter le diagnostic des problèmes lors de l’ingestion en direct. ingestDriftValue est utile dans les scénarios où vous devez surveiller la latence du réseau à partir de l’encodeur d’ingestion source qui effectue un push dans l’événement en direct. Si cette valeur est trop éloignée, cela peut indiquer que la latence du réseau est trop élevée pour offrir un événement de streaming en direct réussi.

Pour plus d’informations, consultez Schéma LiveEventIngestHeartbeat.

La prise en charge des liaisons privées est désormais en disponibilité générale

La prise en charge de l’utilisation de Media Services avec des liaisons privées est désormais en disponibilité générale dans toutes les régions Azure, y compris les clouds Azure Government.

Azure Private Link vous permet d’accéder aux services Azure PaaS ainsi qu’aux services de partenaires ou de clients hébergés par Azure sur un point de terminaison privé dans votre réseau virtuel.

Le trafic entre votre réseau virtuel et le service transite par le réseau principal de Microsoft, éliminant ainsi toute exposition à l’Internet public.

Pour plus d’informations sur l’utilisation de Media Services avec des points de terminaison privés, consultez Créer un compte Media Services et un compte de stockage avec un point de terminaison privé

Nouvelle région : la région USA Ouest 3 est ga

La région USA Ouest 3 est désormais en disponibilité générale et peut être utilisée par les clients lors de la création de nouveaux comptes Media Services.

La remise de clés prend en charge les restrictions de liste d’adresses IP autorisées

Les comptes Media Services peuvent désormais être configurés avec des restrictions de liste d’adresses IP autorisées sur la remise de clés. Le nouveau paramètre de liste d’autorisation est disponible sur la ressource de compte Media Services via le SDK, ainsi que dans le portail et l’interface CLI. Il permet aux opérateurs de limiter la remise de licences DRM et de clés de contenu AES-128 à des plages IPv4 spécifiques.

Cette fonctionnalité peut également être utilisée pour désactiver la remise de licences DRM ou de clés AES-128 sur l’Internet public et restreindre la remise à un point de terminaison de type réseau privé.

Pour plus d’informations, consultez Restreindre l’accès à la licence DRM et à la distribution de clé AES à l’aide de listes d’adresses IP autorisées.

Nouveaux exemples pour Python et Node.js (avec TypeScript)

Des exemples mis à jour pour Node.js qui utilisent la prise en charge la plus récente de TypeScript dans le Kit de développement logiciel (SDK) Azure.

| Exemple | Description |

|---|---|

| Vidéo en flux continu | Exemple de base de streaming en direct. AVERTISSEMENT : Veillez à vérifier que toutes les ressources sont nettoyées et qu’elles ne sont plus facturées dans le portail lors du streaming en direct |

| Télécharger et diffuser en continu HLS et DASH | Exemple de base pour le chargement d’un fichier local ou l’encodage à partir d’une URL source. L’exemple montre comment utiliser le SDK de stockage pour télécharger du contenu et comment diffuser en streaming sur un lecteur |

| Télécharger et diffuser en continu HLS et DASH avec PlayReady et Widevine DRM | Illustre comment encoder et diffuser en streaming à l’aide de Widevine et PlayReady DRM |

Nouvel exemple Python montrant comment utiliser Azure Functions et Event Grid pour déclencher la présélection Rédaction de face.

Mai 2021

Prise en charge par défaut des Zones de disponibilité dans Media Services

Media Services prend maintenant en charge les Zones de disponibilité, qui offrent des emplacements isolés des défaillances au sein de la même région Azure. Les comptes Media Services sont à présent redondants interzones par défaut. Aucune configuration ni aucun paramètre ne sont requis. Cela s’applique uniquement aux régions offrant une prise en charge des Zones de disponibilité.

Mars 2021

Prise en charge de nouvelles langues ajoutée à la présélection AudioAnalyzer

D’autres langues pour la transcription vidéo et le sous-titrage sont désormais disponibles dans la présélection AudioAnalyzer (en modes De base et Standard).

- Anglais (Australie), 'en-AU'

- Français (Canada), 'fr-CA'

- Arabe standard moderne (Bahreïn), 'ar-BH'

- Arabe (Égypte), 'ar-EG'

- Arabe (Irak), 'ar-IQ'

- Arabe (Israël), 'ar-IL'

- Arabe (Jordanie), 'ar-JO'

- Arabe (Koweït), 'ar-KW'

- Arabe (Liban), 'ar-LB'

- Arabe (Oman), 'ar-OM'

- Arabe (Qatar), 'ar-QA'

- Arabe (Arabie saoudite), 'ar-SA'

- Danois, 'da-DK'

- Norvégien, 'nb-NO'

- Suédois, 'sv-SE'

- Finnois, 'fi-FI'

- Thaï, 'th-TH'

- Turc, 'tr-TR'

Consultez les dernières langues disponibles dans l'article Analyser des fichiers vidéo et audio.

Février 2021

Prise en charge de l’encodage HEVC dans l’encodeur standard

L’encodeur standard prend désormais en charge l’encodage 8 bits HEVC (H.265). Le contenu HEVC peut être fourni et empaqueté via l’empaqueteur dynamique à l’aide du format 'hev1'.

Un nouvel encodage .NET personnalisé avec l’exemple HEVC est disponible dans le dépôt GitHub media-services-v3-dotnet. En plus de l’encodage personnalisé, les nouvelles présélections d’encodage HEVC intégrées suivantes sont désormais disponibles :

- H265ContentAwareEncoding

- H265AdaptiveStreaming

- H265SingleBitrate720P

- H265SingleBitrate1080p

- H265SingleBitrate4K

Les clients qui utilisaient précédemment HEVC dans l’encodeur Premium de l’API v2 doivent effectuer une migration pour utiliser la nouvelle prise en charge de l’encodage HEVC dans l’encodeur standard.

Annonce de l’abandon de l’API et des SDK Azure Media Services v2

Mise à jour requise des kits SDK et de l’API REST Azure Media Services vers v3 d’ici le 29 février 2024

Étant donné que la version 3 des kits SDK clients pour .NET et Java, et de l’API REST Azure Media Services offre plus de fonctionnalités que la version 2, nous allons abandonner la version 2 de l’API REST Azure Media Services et des kits SDK clients pour .NET et Java.

Nous vous encourageons à anticiper cette transition pour bénéficier des meilleures fonctionnalités de la version 3 de l’API REST Azure Media Services et des kits SDK clients pour .NET et Java. La version 3 offre les avantages suivants :

- Prise en charge des événements en direct 24 h/24, 7 j/7

- API REST ARM, SDK clients pour .NET core, Node.js, Python, Java, Go et Ruby.

- Clés gérées par le client, intégration du stockage approuvé, prise en charge des liaisons privées et plus encore

Dans le cadre de la mise à jour vers les kits SDK et l’API v3, les unités réservées multimédias (MRU) ne sont plus nécessaires pour les comptes Media Services, car le système effectue automatiquement un scale-up et un scale-down en fonction de la charge. Pour plus d’informations, consultez les conseils sur la migration des unités réservées multimédias.

Dépréciation d’AMS en tant que serveur de remise de licence autonome (mode local hybride) dans la migration v2 vers v3

L’API v3 ne prend plus en charge l’utilisation des services de distribution de clés en tant que fonctionnalité autonome pour la protection du contenu où le service de distribution de clés peut être utilisé afin de fournir une licence pour le contenu diffusé en continu ou remis par le biais d’autres serveurs d’origine tierce. Cela signifie qu’AMS ne prend plus en charge les scénarios de distribution de clés uniquement dans l’API v3 et vous oblige à diffuser en continu à partir des services d’origine AMS à l’aide de l’empaquetage et du chiffrement dynamiques lors de la livraison avec v3.

Le contenu existant qui a été chiffré avec l’API v2 et qui est distribué dans un modèle « hybride » continuera de fonctionner (les clés seront toujours récupérables sur le plan de données), mais la gestion de ces clés (mises à jour et modifications) via le plan de gestion v2 ou le plan de gestion v3 ne fonctionnera plus après le 29 février 2024.

Notes

Tous les nouveaux contenus distribués à l’aide de la version v3 prennent uniquement en charge la protection du contenu et la diffusion en continu à partir d’AMS et ne prennent plus en charge le mode « hybride ». Le plan de données continuera de distribuer des clés et des licences existantes créées dans v2, mais ne prendra plus en charge la gestion ou les mises à jour via l’API v2 ou v3.

Action requise

Pour limiter les perturbations au niveau de vos charges de travail, consultez le guide de migration pour faire passer votre code de la version 2 de l’API et des SDK à la version 3 avant le 29 février 2024. Après le 29 février 2024, Azure Media Services n’acceptera plus le trafic sur l’API REST version 2, l’API de gestion de compte ARM version 2015-10-01 ou à partir des SDK clients .NET version 2. Cela inclut tous les SDK clients open source tiers pouvant appeler l’API version 2.

Consultez l’annonce officielle sur les mises à jour Azure.

Prise en charge de l’encodeur standard pour les fonctionnalités de l’API v2

En plus de la nouvelle prise en charge de l’encodage HEVC (H.265), les fonctionnalités suivantes sont désormais disponibles dans la version 2020-05-01 (ou ultérieure) de l’API d’encodage.

- La combinaison de plusieurs fichiers d’entrée est désormais possible à l’aide de la nouvelle prise en charge de JobInputClip.

- Un exemple est disponible pour .NET, montrant comment combiner deux ressources.

- La sélection de la piste audio permet aux clients de sélectionner et de mapper des pistes audio entrantes et de les acheminer vers la sortie pour l’encodage

- Consultez l'API REST OpenAPI pour plus d’informations sur AudioTrackDescriptor et la sélection de pistes

- Sélection de pistes pour l’encodage : permet aux clients de choisir des pistes à partir d’un fichier source ABR ou d’une archive en direct comportant plusieurs pistes de débit binaire. Très utile pour générer des fichiers MP4 à partir de fichiers d’archive d’événements en direct.

- Voir VideoTrackDescriptor

- Fonctionnalités d’édition des visages (flou) ajoutées à FaceDetector

Nouvelles versions du Kit de développement logiciel (SDK) client pour la version 2020-05-01 de l’API Azure Media Services

Les nouvelles versions du Kit de développement logiciel (SDK) client pour toutes les langues disponibles sont désormais intégrées aux fonctionnalités ci-dessus. Effectuez une mise à jour vers les Kits de développement logiciel (SDK) clients les plus récents dans vos bases de code à l’aide de votre gestionnaire de package.

- Package du Kit de développement logiciel (SDK) .NET 3.0.4

- Node.js TypeScript version 8.1.0

- Python azure-mgmt-media 3.1.0

- Java SDK 1.0.0-beta.2

Nouvelles fonctionnalités de sécurité disponibles dans la version 2020-05-01 de l’API Azure Media Services

Clés gérées par le client : les clés de contenu et autres données stockées dans les comptes créés avec l’API de version « 2020-05-01 » sont chiffrées à l’aide d’une clé de compte. Les clients peuvent fournir une clé pour chiffrer la clé de compte.

Stockage approuvé : Media Services peut être configuré pour accéder à Stockage Azure à l’aide d’une identité managée associée au compte Media Services. Lorsque les comptes de stockage sont accessibles à l’aide d’une identité managée, les clients peuvent configurer des listes de contrôle d’accès réseau plus restrictives sur le compte de stockage, sans bloquer les scénarios Media Services.

Identités managées : Les clients peuvent autoriser l’attribution d’une identité managée affectée par le système pour un compte Media Services afin de fournir un accès aux coffres de clés (pour les clés gérées par le client) et aux comptes de stockage (pour le stockage approuvé).

Exemples Node.js TypeScript mis à jour à l’aide du Kit de développement logiciel (SDK) isomorphe pour JavaScript

Les exemples Node.js ont été mis à jour pour utiliser la dernière version du Kit de développement logiciel (SDK) isomorphe. Les exemples montrent désormais l’utilisation de TypeScript. En outre, un nouvel exemple de streaming en direct a été ajouté pour Node.js/TypeScript.

Consultez les exemples les plus récents dans le dépôt GitHub media-services-v3-node-tutorials .

Nouveau mode de mise en attente en direct pour prendre en charge un démarrage plus rapide à partir d’un état actif

Les événements en direct prennent désormais en charge un mode de facturation à moindre coût pour la « mise en attente ». Cela permet aux clients de pré-allouer des événements en direct à un coût inférieur pour la création de « pools chauds ». Les clients peuvent ensuite utiliser les événements en direct en attente pour passer à l’état d’exécution plus rapidement qu’à partir d’un démarrage à froid. Cela réduit considérablement le temps de démarrage du canal et permet une allocation rapide du pool chaud des machines fonctionnant sous un mode de tarification inférieur. Consultez ici les dernières informations sur la tarification. Pour plus d’informations sur l’état de mise en attente et les autres états des événements en direct, consultez l’article États et facturation des événements en direct.

Décembre 2020

Disponibilité régionale

Azure Media Services est désormais disponible dans la région Norvège Est sur le Portail Azure. RESTv2 n’existe pas dans cette région.

Octobre 2020

Analyse audio De base

La présélection de l’analyse audio comprend désormais un niveau de tarification en mode De base. Le nouveau mode De base de l’analyseur audio offre une option plus économique pour extraire la transcription vocale et mettre en forme les légendes et les sous-titres de sortie. Ce mode effectue une transcription de la parole en texte et la génération d’un fichier de sous-titres/CC au format VTT. La sortie de ce mode comprend un fichier JSON Insights incluant uniquement les mots clés, la transcription et les informations relatives au minutage. La détection automatique de la langue et la diarisation de l’orateur ne sont pas incluses dans ce mode. Consultez la liste des langues prises en charge.

Les clients utilisant Indexer v1 et Indexer v2 doivent migrer vers la présélection de l’analyse audio De base.

Pour plus d’informations sur le mode De base de l’analyseur audio, consultez Analyse des fichiers vidéo et audio.

Événements en direct

Les mises à jour de la plupart des propriétés sont désormais autorisées lorsque les événements en direct sont arrêtés. En outre, les utilisateurs sont autorisés à spécifier un préfixe pour le nom d’hôte statique des URL d’entrée et d’aperçu de l’événement en direct. VanityUrl est désormais appelé useStaticHostName pour mieux refléter l’objectif de la propriété.

Les événements en direct disposent désormais d’un état En attente. Consultez Événements en direct et sorties en direct dans Media Services.

Un événement en direct prend en charge la réception de différentes proportions d’entrée. Le mode Extension permet aux clients de spécifier le comportement d’extension de la sortie.

L’encodage en direct permet désormais de générer des fragments de fréquence d’images clés fixes entre 0,5 à 20 secondes.

Comptes

Avertissement

Si vous créez un compte Media Services avec la version d’API du 5 janvier 2020, il ne fonctionnera pas avec RESTv2.

Août 2020

Chiffrement dynamique

La prise en charge du chiffrement PIFF 1.1 (PlayReady Protected Interoperable File Format) hérité est désormais disponible dans le Packager dynamique. Cela offre la prise en charge des jeux Smart TV hérités de Samsung et LG qui implémentaient les premières ébauches de la norme CENC (Common Encryption) publiées par Microsoft. Le format PIFF 1.1 est également connu comme le format de chiffrement précédemment pris en charge par la bibliothèque de client Silverlight. Aujourd’hui, le seul scénario de cas d’usage pour ce format de chiffrement est le ciblage du marché Smart TV hérité où il reste un nombre non négligeable de Smart TV dans certaines régions qui prennent uniquement en charge Smooth Streaming avec le chiffrement PIFF 1.1.

Pour utiliser la nouvelle prise en charge du chiffrement PIFF 1.1, remplacez la valeur de chiffrement par « piff » dans le chemin d’URL du localisateur de streaming. Pour plus d’informations, consultez la vue d’ensemble de la protection du contenu. Par exemple : https://amsv3account-usw22.streaming.media.azure.net/00000000-0000-0000-0000-000000000000/ignite.ism/manifest(encryption=piff)|

Notes

La prise en charge de PIFF 1.1 est fournie en tant que solution de compatibilité descendante pour les Smart TV (Samsung, LG) qui implémentaient la version « Silverlight » précoce de la norme CENC. Vous devez utiliser le format PIFF uniquement là où il est nécessaire pour la prise en charge des Smart TV Samsung ou LG livrées entre 2009 et 2015 qui prenaient en charge la version PIFF 1.1 du chiffrement PlayReady.

Juillet 2020

Transcriptions en direct

Les transcriptions en direct prennent désormais en charge 19 langues et 8 régions.

Haute disponibilité

Nous avons publié une vue d’ensemble et un exemple pour la Haute disponibilité avec Media Services et VOD (vidéo à la demande).

Juin 2020

Publication en préversion de Live Video Analytics sur IoT Edge

La préversion de Live Video Analytics sur IoT Edge est devenue publique.

Live Video Analytics sur IoT Edge est une extension de la famille Media Services. Elle vous permet d’analyser la vidéo en direct avec des modèles AI de votre choix sur vos propres appareils périphériques, et éventuellement de capturer et d’enregistrer cette vidéo. Vous pouvez désormais créer des applications avec une analytique vidéo en temps réel à la périphérie, sans vous soucier de la complexité liée à la création et à l’exploitation d’un pipeline vidéo en direct.

Mai 2020

Nouvelles régions : Germay Nord, Allemagne Centre-Ouest, Suisse Nord et Suisse Ouest sont désormais ga

Azure Media Services est généralement disponible dans les régions suivantes : « Allemagne Nord », « Allemagne Centre-Ouest », « Suisse Nord » et « Suisse Ouest ». Les clients peuvent déployer Azure Media Services dans ces régions à l’aide du Portail Azure.

Avril 2020

Améliorations de la documentation

La documentation relative au Lecteur multimédia Azure a été migrée vers la documentation Azure.

Janvier 2020

Améliorations apportées aux processeurs multimédias

- Amélioration de la prise en charge des sources entrelacées dans l’analyse vidéo : ces contenus sont désormais désentrelacés correctement avant d’être envoyés aux moteurs d’inférence.

- Lors de la génération de miniatures avec le mode « optimal », l’encodeur effectue désormais une recherche au-delà de 30 secondes pour sélectionner une image qui n’est pas monochrome.

Mises à jour Azure Government Cloud

Media Services est proposé en disponibilité générale dans les régions Azure Government suivantes : USGov Arizona et USGov Texas.

Décembre 2019

Ajout de la prise en charge du CDN pour les en-têtes Origin-Assist Prefetch pour le streaming à la demande et en direct ; disponible pour les clients disposant d’un contrat direct avec le CDN Akamai. La fonctionnalité Origin-Assist CDN-Prefetch implique les échanges d’en-têtes HTTP suivants entre le CDN Akamai et l’origine Azure Media Services :

| En-tête HTTP | Valeurs | Expéditeur | Destinataire | Objectif |

|---|---|---|---|---|

| CDN-Origin-Assist-Prefetch-Enabled | 1 (par défaut) ou 0 | CDN | Origine | Pour indiquer que la prérécupération est activée pour le CDN |

| CDN-Origin-Assist-Prefetch-Path | Exemple : Fragments(video=1400000000,format=mpd-time-cmaf) |

Origine | CDN | Pour fournir le chemin de prérécupération du CDN |

| CDN-Origin-Assist-Prefetch-Request | 1 (demande de prérécupération) ou 0 (demande normale) | CDN | Origine | Pour indiquer que la demande du CDN est une prérécupération |

Pour voir une partie de l’échange d’en-têtes en action, vous pouvez essayer les étapes suivantes :

- Utilisez curl pour émettre une requête destinée à l’origine Media Services pour un segment ou un fragment audio ou vidéo. Veillez à ajouter l’en-tête CDN-Origin-Assist-Prefetch-Enabled : 1 dans la requête.

- Dans la réponse, vous devez voir l’en-tête CDN-Origin-Assist-Prefetch-Path avec un chemin relatif comme valeur.

Novembre 2019

Transcription en direct (préversion)

La transcription en direct est désormais en préversion publique et peut être utilisée dans la région USA Ouest 2.

La transcription en direct est conçue pour fonctionner avec les événements en direct comme une fonctionnalité complémentaire. Elle est prise en charge à la fois pour les événements directs et les événements en direct avec un encodage Standard ou Premium. Lorsque cette fonctionnalité est activée, le service utilise la fonctionnalité de reconnaissance vocale de Cognitive Services pour transcrire les paroles du fichier audio entrant en texte. Ce texte, accompagné de fichiers vidéo et audio dans les protocoles MPEG-DASH et HLS, est ensuite mis à disposition pour diffusion. La facturation est basée sur un nouveau compteur complémentaire qui est un coût supplémentaire à l’événement en direct lorsqu’il est dans l’état « En cours d’exécution ». Pour plus d’informations sur la transcription en direct et la facturation, consultez Transcription en direct

Notes

Actuellement, la transcription en direct est disponible uniquement en tant que fonctionnalité d’évaluation dans la région USA Ouest 2. Pour l’instant, elle prend seulement en charge la transcription en texte des Mots parlés en anglais (en-us).

Protection du contenu

La fonctionnalité Prévention de la relecture de jeton publiée dans des régions limitées en septembre est désormais disponible dans toutes les régions. Les clients de Media Services peuvent maintenant définir une limite au nombre de fois où le même jeton peut être utilisé pour demander une clé ou une licence. Pour plus d’informations, consultez Prévention de la relecture de jeton.

Nouveaux encodeurs live partenaires recommandés

Ajout de la prise en charge des nouveaux encodeurs partenaires recommandés ci-dessous pour le streaming en direct RTMP :

Améliorations de l’encodage des fichiers

- Un nouvel encodage prédéfini sensible au contenu est maintenant disponible. Il produit un ensemble de fichiers MP4 alignés sur le groupe d’images à l’aide de l’encodage sensible au contenu. Lorsque du contenu est entré, le service effectue une analyse initiale légère du contenu d’entrée. Il utilise ces résultats pour déterminer le nombre optimal de couches, le débit approprié et les paramètres de résolution pour la remise par diffusion en continu adaptative. Ce préréglage est efficace pour les vidéos de faible ou moyenne complexité, où les fichiers de sortie sont à des vitesses de transmission inférieures, mais à une qualité qui offre toujours une bonne expérience aux utilisateurs. La sortie contiendra des fichiers MP4 avec vidéo et audio entrelacées. Pour plus d’informations, consultez les spécifications d’API ouverte.

- Amélioration des performances et du multithreading pour le redimensionnement dans Standard Encoder. Dans des conditions spécifiques, le client doit voir une augmentation des performances du codage VOD de 5 à 40 %. Le contenu à faible complexité encodé en plusieurs vitesses de transmission dispose des meilleures améliorations de performances.

- L’encodage standard gère maintenant une cadence GOP régulière pour les contenus à fréquence d’images variable (VFR) lors d’un encodage VOD en cas d’utilisation du paramètre GOP basé sur le temps. Cela signifie qu’un client soumettant un contenu de fréquence d’images mixte variant entre 15 et 30 images par seconde, par exemple, doit maintenant voir les distances GOP normales calculées sur la sortie vers des fichiers MP4 de streaming à débit adaptatif. Cela permet d’améliorer la possibilité de basculer entre les pistes en cas de diffusion sur TLS ou DASH.

- Amélioration de la synchronisation AV pour un contenu source avec une fréquence d’images variable (VFR)

Azure Video Indexer, Video Analytics

- Les images clés extraites à l’aide de la présélection VideoAnalyzer sont désormais dans la résolution d’origine de la vidéo au lieu d’être redimensionnées. L’extraction d’images clés en haute résolution vous donne des images avec la qualité d’origine et vous permet d’utiliser les modèles d’intelligence artificielle basés sur une image fournis par les services Vision par ordinateur et Custom Vision de Microsoft pour obtenir encore plus d’informations à partir de votre vidéo.

Septembre 2019

Media Services v3

Encodage linéaire en direct des événements en direct

Media Services v3 annonce la préversion de 24 heures x 365 jours d’encodage linéaire en direct des événements en direct.

Media Services v2

Dépréciation des processeurs multimédias

Nous annonçons la dépréciation d’Azure Media Indexer et d’Azure Media Indexer 2 Preview. Pour connaître les dates de mise hors service, consultez l’article consacré aux composants hérités. Azure Video Indexer remplace ces processeurs multimédias hérités.

Pour plus d’informations, consultez Migrer depuis Azure Media Indexer et Azure Media Indexer 2 vers Azure Media Services Video Indexer.

Août 2019

Media Services v3

La paire régionale d’Afrique du Sud est ouverte pour Media Services

Media Services est maintenant disponible dans les régions Afrique du Sud Nord et Afrique du Sud Ouest.

Pour plus d’informations, consultez Clouds et régions dans lesquels Media Services v3 est présent.

Media Services v2

Dépréciation des processeurs multimédias

Nous annonçons la dépréciation des processeurs multimédias Windows Azure Media Encoder (WAME) et Azure Media Encoder (AME), qui sont en phase de mise hors service. Pour connaître les dates de mise hors service, consultez l’article consacré aux composants hérités.

Pour plus d'informations, consultez Migration de WAME vers Media Encoder Standard et Migration d'AME vers Media Encoder Standard.

Juillet 2019

Protection du contenu

Lors du streaming de contenu protégé par une restriction de jeton, les utilisateurs finaux doivent obtenir un jeton envoyé dans le cadre de la requête de remise de clé. La fonctionnalité de prévention de relecture de jeton permet aux clients de Media Services de limiter le nombre de fois qu’un même jeton peut être utilisé pour demander une clé ou une licence. Pour plus d’informations, consultez Prévention de la relecture de jeton.

Depuis juillet, la fonctionnalité d’évaluation était uniquement disponible dans les régions USA Centre et USA Centre-Ouest.

Juin 2019

Sous-découpage de vidéos

Vous pouvez désormais découper ou sous-découper une vidéo lors de son encodage à l’aide d’un travail.

Cette fonctionnalité peut être utilisée avec n’importe quelle transformation qui est générée en utilisant les présélections BuiltInStandardEncoderPreset ou StandardEncoderPreset.

Mai 2019

Prise en charge Azure Monitor pour les journaux de diagnostic et métriques Media Services

Vous pouvez désormais utiliser Azure Monitor pour afficher les données de télémétrie émises par Media Services.

- Utilisez les journaux de diagnostic Azure Monitor pour surveiller les requêtes envoyées par le point de terminaison de remise des clés Media Services.

- Surveillez les métriques émises par les points de terminaison de streaming Media Services.

Pour plus d’informations, consultez Superviser Media Services.

Prise en charge de plusieurs pistes audio dans l’empaquetage dynamique

L’empaquetage dynamique prend en charge plusieurs pistes audio pour la sortie HLS (version 4 ou ultérieure) pour le streaming des actifs multimédias qui ont plusieurs pistes audio avec plusieurs langues et codecs.

La paire régionale de Corée est ouverte pour Media Services

Media Services est maintenant disponible dans les régions Corée Centre et Corée Sud.

Pour plus d’informations, consultez Clouds et régions dans lesquels Media Services v3 est présent.

Optimisation des performances

Ajout de mises à jour incluant l’amélioration des performances Media Services.

- La taille maximale du fichier pris en charge pour le traitement a été mise à jour. Consultez Quotas et limites.

- Améliorations des vitesses d’encodage.

Avril 2019

Nouvelles présélections

- FaceDetectorPreset a été ajouté aux présélections d’analyseur intégrées.

Mars 2019

L’empaquetage dynamique prend désormais en charge Dolby Atmos. Pour plus d’informations, consultez Codecs audio pris en charge par l’empaquetage dynamique.

Vous pouvez désormais spécifier une liste de filtres de comptes ou d’actifs, qui s’applique à votre localisateur de streaming. Pour plus d’informations, consultez Associer des filtres avec le localisateur de streaming.

Février 2019

Media Services v3 est désormais pris en charge dans les clouds nationaux Azure. Toutes les fonctionnalités ne sont pas encore disponibles dans tous les clouds. Pour en savoir plus, consultez Clouds et régions dans lesquels Azure Media Services v3 existe.

L'événement Microsoft.Media.JobOutputProgress a été ajouté aux schémas Azure Event Grid de Media Services.

Janvier 2019

Fichiers Media Encoder Standard et MPI

En cas d'encodage avec Media Encoder Standard pour produire des fichiers MP4, un nouveau fichier .mpi est généré et ajouté à la ressource de sortie. Ce fichier MPI est destiné à améliorer les performances pour les scénarios d’empaquetage dynamique et de diffusion en continu.

Vous ne devez ni modifier ni supprimer le fichier MPI, ni dépendre de l'existence (ou non) d'un tel fichier dans votre service.

Décembre 2018

Les mises à jour de la version mise à la disposition générale de l'API V3 incluent :

- Les propriétés PresentationTimeRange ne sont plus « obligatoires » pour AssetFilters et AccountFilters.

- Les options de requête $top et $skip de Jobs et Transforms ont été supprimées et $orderby a été ajouté. Lors de l'ajout de la nouvelle fonctionnalité de commande, il a été découvert que les options $top et $skip avaient déjà été accidentellement exposées, même si elles n'avaient pas été implémentées.

- L'extensibilité de l'énumération a été réactivée. Cette fonctionnalité a été activée dans les préversions du kit de développement logiciel (SDK), puis accidentellement désactivée dans la version mise à la disposition générale.

- Deux stratégies de diffusion en continu prédéfinies ont été renommées. SecureStreaming s'appelle désormais MultiDrmCencStreaming. SecureStreamingWithFairPlay s'appelle désormais Predefined_MultiDrmStreaming.

Novembre 2018

Le module CLI 2.0 est désormais disponible pour Azure Media Services v3 GA – v 2.0.50.

Nouvelles commandes

- az ams account

- az ams account-filter

- az ams asset

- az ams asset-filter

- az ams content-key-policy

- az ams job

- az ams live-event

- az ams live-output

- az ams streaming-endpoint

- az ams streaming-locator

- az ams account mru : permet de gérer les unités réservées Multimédia.

Nouvelles fonctionnalités et dernières modifications

Commandes des éléments multimédia

- Les arguments

--storage-accountet--containeront été ajoutés. - Les valeurs par défaut pour le délai d’expiration (présent + 23h) et les autorisations (lecture) dans la commande

az ams asset get-sas-urlont été ajoutées.

Commandes des tâches

- Les arguments

--correlation-dataet--labelont été ajoutés. --output-asset-namesa été renommé en--output-assets. Il accepte désormais une liste de ressources séparée par des espaces au format « assetName=label ». Une ressource sans étiquette peut être envoyée comme ceci : « assetName= ».

Commandes du localisateur de diffusion en continu

- La commande de base

az ams streaming locatora été remplacée paraz ams streaming-locator. - Les arguments

--streaming-locator-idet--alternative-media-id supportont été ajoutés. - L'argument

--content-keys argumenta été mis à jour. --content-policy-namea été renommé en--content-key-policy-name.

Commandes des stratégies de diffusion en continu

- La commande de base

az ams streaming policya été remplacée paraz ams streaming-policy. - La prise en charge des paramètres de chiffrement dans

az ams streaming-policy createa été ajoutée.

Commandes de transformation

- L'argument

--preset-namesa été remplacé par--preset. À présent vous ne pouvez définir qu’une sortie/présélection à la fois (pour en ajouter d’autres, vous devez exécuteraz ams transform output add). En outre, vous pouvez définir StandardEncoderPreset de façon personnalisée en transmettant le chemin à votre JSON personnalisé. az ams transform output removedésormais possible en transmettant le chemin de l’index pour le supprimer.- Les arguments

--relative-priority, --on-error, --audio-language and --insights-to-extractont été ajoutés dans les commandesaz ams transform createetaz ams transform output add.

Octobre 2018 - Mise à la disposition générale

Cette section décrit les mises à jour d’octobre d’Azure Media Services (AMS).

Version en disponibilité générale de REST v3

La version en disponibilité générale de REST v3 contient davantage d’API pour les filtres de manifeste de niveau En direct, Compte/Élément multimédia, ainsi qu’une prise en charge de DRM.

Gestion des ressources Azure

La prise en charge de la gestion des ressources Azure permet l’unification des API de gestion et des opérations (désormais tout se trouve à un même emplacement).

À partir de cette version, vous pouvez utiliser des modèles Resource Manager pour créer des événements en direct.

Amélioration des opérations sur les éléments multimédias

Voici les améliorations qui ont été apportées :

- Ingestion à partir d’URL HTTP(s) ou d’URL SAP de Stockage Blob Azure.

- Spécification des noms de conteneurs personnalisés pour les éléments multimédias.

- Meilleure prise en charge de la sortie pour créer des flux de travail personnalisés avec Azure Functions.

Nouvel objet Transform

Le nouvel objet Transform simplifie le modèle d’encodage. Le nouvel objet facilite la création et le partage de modèles et de préréglages Resource Manager d’encodage.

Authentification Azure Active Directory et Azure RBAC

Azure AD Authentication et le contrôle d’accès en fonction du rôle (Azure RBAC) permettent les transformations sécurisées, les événements en direct, les stratégies de clé de contenu ou les éléments multimédias par rôle ou utilisateurs dans Azure AD.

Kits de développement logiciel (SDK) client

Langages pris en charge dans Media Services v3 : .NET Core, Java, Node.js, Ruby, TypeScript, Python, Go.

Mises à jour de l’encodage en direct

Voici les mises à jour de l’encodage en direct qui ont été apportées :

Nouveau mode de faible latence pour le direct (10 secondes de bout en bout).

Prise en charge améliorée de RTMP (stabilité accrue et meilleure prise en charge de l’encodeur source).

Ingestion sécurisée RTMPS.

Quand vous créez un événement en direct, vous obtenez maintenant 4 URL d’ingestion. Les 4 URL d’ingestion sont presque identiques, ont le même jeton de streaming (AppId) ; seule la partie du numéro de port est différente. Il existe deux URL principales et de secours pour RTMPS.

Prise en charge d’un transcodage de 24 heures.

Prise en charge améliorée de la signalisation des annonces dans RTMP via SCTE35.

Prise en charge améliorée d’Event Grid

Voici les améliorations de la prise en charge d’Event Grid que vous pouvez constater :

- Intégration d’Azure EventGrid pour un développement facilité avec Logic Apps et Azure Functions.

- Abonnement aux événements Encodage, Canaux live, etc.

Prise en charge de CMAF

Prise en charge du chiffrement CMAF et « cbcs » pour les lecteurs Apple HLS (iOS 11+) et MPEG-DASH qui prennent en charge CMAF.

Video Indexer

La version en disponibilité générale de l’indexeur vidéo a été annoncée en août. Pour être au fait des dernières informations concernant les fonctionnalités actuellement prises en charge, consultez Qu’est-ce que Video Indexer.

Modifications planifiées

Azure CLI 2.0

Le module Azure CLI 2.0 qui inclut des opérations sur toutes les fonctionnalités (dont En direct, Stratégies de clé de contenu, Filtres de comptes/éléments multimédias, Stratégies de streaming) sera bientôt disponible.

Problèmes connus

Seuls les clients qui utilisaient la préversion de l’API pour les filtres d’éléments multimédias ou de comptes sont concernés par le problème suivant.

Si vous avez créé des filtres d’éléments multimédias ou de comptes entre le 28/09 et le 12/10 avec l’interface CLI ou les API Media Services v3, vous devez supprimer tous les filtres d’éléments multimédias et de comptes et les recréer en raison d’un conflit de version.

Mai 2018 - Préversion

Kit de développement logiciel (SDK) .NET

Les fonctionnalités suivantes sont présentes dans le Kit de développement logiciel (SDK) .NET :

- StreamingLocators pour la publication et la diffusion en continu de contenu sur les appareils de l’utilisateur final

- StreamingPolicies et ContentKeyPolicies pour configurer la distribution de clés et la protection du contenu (DRM) lors de la remise de contenu.

- LiveEvents et LiveOutputs pour configurer l’ingestion et l’archivage de contenu en continu en direct.

- Éléments multimédias pour stocker et publier du contenu multimédia dans le stockage Azure.

- StreamingEndpoints pour configurer et mettre à l’échelle l’empaquetage dynamique, le chiffrement et la diffusion en continu du contenu multimédia en direct et à la demande.

Problèmes connus

- Quand vous soumettez un travail, vous pouvez spécifier l’ingestion de votre vidéo source à l’aide d’URL HTTPS, d’URL SAP ou de chemins de fichiers situés dans le stockage Blob Azure. Actuellement, Media Services v3 ne prend pas en charge l’encodage de transfert mémorisé en bloc sur les URL HTTPS.

Poser des questions, envoyer des commentaires, obtenir des mises à jour

Découvrez l’article Communauté Azure Media Services pour découvrir les différentes façons dont vous pouvez poser des questions, faire des commentaires et obtenir des mises à jour sur Media Services.

Voir aussi

Conseils de migration pour le passage de Media Services v2 à Media Services v3