Azure의 Red Hat Enterprise Linux에서 Pacemaker 설정

이 문서에서는 RHEL(Red Hat Enterprise Server)에서 기본 Pacemaker 클러스터를 구성하는 방법을 설명합니다. 지침에는 RHEL 7, RHEL 8 및 RHEL 9가 포함됩니다.

필수 조건

다음 SAP Note 및 문서를 먼저 읽어 보세요.

- SAP Note 1928533, 다음 항목을 포함합니다.

- SAP 소프트웨어 배포에 지원되는 Azure VM(Virtual Machines) 크기 목록입니다.

- Azure VM 크기에 대한 중요한 용량 정보.

- 지원되는 SAP 소프트웨어 및 OS(운영 체제)와 데이터베이스 조합.

- Microsoft Azure에서 Windows 및 Linux에 필요한 SAP 커널 버전.

- SAP Note 2015553는 Azure에서 SAP을 지원하는 SAP 소프트웨어 배포에 대한 필수 구성 요소를 나열합니다.

- SAP Note 2002167에서는 Red Hat Enterprise Linux용 OS 설정을 권장합니다.

- SAP Note 3108316에서는 Red Hat Enterprise Linux 9.x에 대한 OS 설정을 권장합니다.

- SAP Note 2009879에는 Red Hat Enterprise Linux용 SAP HANA 지침이 있습니다.

- SAP Note 3108302에는 Red Hat Enterprise Linux 9.x용 SAP HANA 지침이 있습니다.

- SAP Note 2178632는 Azure에서 SAP에 대해 보고된 모든 모니터링 메트릭에 대한 자세한 정보를 포함하고 있습니다.

- SAP Note 2191498는 Azure에서 Linux에 필요한 SAP Host Agent 버전을 포함하고 있습니다.

- SAP Note 2243692는 Azure에서 Linux의 SAP 라이선스에 대한 정보를 포함하고 있습니다.

- SAP Note 1999351에는 SAP용 Azure 고급 모니터링 확장에 대한 추가 문제 해결 정보가 있습니다.

- SAP Community WIKI는 Linux에 필요한 모든 SAP Note를 포함하고 있습니다.

- Linux에서 SAP용 Azure Virtual Machines 계획 및 구현

- Linux에서 SAP용 Azure Virtual Machines 배포(이 문서)

- Linux에서 SAP용 Azure Virtual Machines DBMS 배포

- Pacemaker 클러스터의 SAP HANA 시스템 복제

- 일반 RHEL 설명서:

- Azure 특정 RHEL 설명서:

- RHEL 고가용성 클러스터용 지원 정책 - Microsoft Azure Virtual Machines(클러스터 멤버)

- Installing and Configuring a Red Hat Enterprise Linux 7.4 (and later) High-Availability Cluster on Microsoft Azure(Microsoft Azure에서 Red Hat Enterprise Linux 7.4 이상 고가용성 클러스터 설치 및 구성)

- RHEL 8 - 고가용성 및 클러스터 채택 시 고려 사항

- RHEL 7.6의 Pacemaker에서 독립 실행형 큐에 넣기 서버 2(ENSA2)를 사용하여 SAP S/4HANA ASCS/ERS 구성

- Azure의 SAP 제품용 RHEL

클러스터 설치

참고 항목

Red Hat은 소프트웨어 에뮬레이션 감시 기능을 지원하지 않습니다. Red Hat은 클라우드 플랫폼에서 SBD를 지원하지 않습니다. 자세한 내용은 RHEL 고가용성 클러스터 지원 정책 - sbd 및 Fence_sbd를 참조하세요.

Azure의 Pacemaker RHEL 클러스터에 지원되는 유일한 펜싱 메커니즘은 Azure 펜스 에이전트입니다.

다음 항목에는 접두사가 붙습니다.

- [A]: 모든 노드에 적용 가능

- [1]: 노드 1에만 적용 가능

- [2]: 노드 2에만 적용 가능

RHEL 7과 RHEL 8/RHEL 9 사이의 명령 또는 구성의 차이점이 문서에 나와 있습니다.

[A] 등록 이 단계는 선택 사항입니다. RHEL SAP HA 지원 이미지를 사용하는 경우 이 단계가 필요하지 않습니다.

예를 들어, RHEL 7에 배포하는 경우 VM을 등록하고 RHEL 7용 리포지토리가 포함된 풀에 연결합니다.

sudo subscription-manager register # List the available pools sudo subscription-manager list --available --matches '*SAP*' sudo subscription-manager attach --pool=<pool id>Azure Marketplace 종량제 RHEL 이미지에 풀을 연결하면 RHEL 사용량에 대해 사실상 이중 요금이 청구됩니다. 종량제 이미지에 대해 한 번, 연결한 풀의 RHEL 권한에 대해 한 번 요금이 청구됩니다. 이러한 상황을 완화하기 위해 Azure는 이제 자체 구독 가져오기 RHEL 이미지를 제공합니다. 자세한 내용은 Azure의 Red Hat Enterprise Linux Bring-Your-Own-Subscription 이미지를 참조하세요.

[A] SAP 리포지토리에 RHEL 사용 이 단계는 선택 사항입니다. RHEL SAP HA 지원 이미지를 사용하는 경우 이 단계가 필요하지 않습니다.

RHEL 7에 필수 패키지를 설치하려면 다음 리포지토리를 사용하도록 설정합니다.

sudo subscription-manager repos --disable "*" sudo subscription-manager repos --enable=rhel-7-server-rpms sudo subscription-manager repos --enable=rhel-ha-for-rhel-7-server-rpms sudo subscription-manager repos --enable=rhel-sap-for-rhel-7-server-rpms sudo subscription-manager repos --enable=rhel-ha-for-rhel-7-server-eus-rpms[A] RHEL HA 추가 기능을 설치합니다.

sudo yum install -y pcs pacemaker fence-agents-azure-arm nmap-ncatImportant

리소스 중지가 실패하거나 클러스터 노드가 더 이상 서로 통신할 수 없는 경우 고객이 더 빠른 장애 조치(failover) 시간의 이점을 활용할 수 있도록 다음 버전의 Azure 펜스 에이전트(또는 그 이상)를 사용하는 것이 좋습니다.

RHEL 7.7 이상은 사용할 수 있는 최신 버전의 Fence-에이전트 패키지를 사용합니다.

RHEL 7.6: fence-agents-4.2.1-11.el7_6.8

RHEL 7.5: fence-agents-4.0.11-86.el7_5.8

RHEL 7.4: fence-agents-4.0.11-66.el7_4.12

자세한 내용은 RHEL 고가용성 클러스터 멤버로 실행되는 Azure VM이 펜싱되는 데 시간이 너무 오래 걸리거나 VM이 종료되기 전에 펜싱이 실패함/시간 초과됨을 참조하세요.

Important

펜스 에이전트의 서비스 주체 이름 대신 Azure 리소스에 대한 관리 ID를 사용하려는 고객에게는 다음 버전의 Azure 펜스 에이전트(또는 그 이상)를 권장합니다.

RHEL 8.4: fence-agents-4.2.1-54.el8.

RHEL 8.2: fence-agents-4.2.1-41.el8_2.4

RHEL 8.1: fence-agents-4.2.1-30.el8_1.4

RHEL 7.9: fence-agents-4.2.1-41.el7_9.4.

Important

RHEL 9에서는 Azure 펜스 에이전트 관련 문제를 방지하기 위해 다음 패키지 버전(또는 그 이상)을 권장합니다.

fence-agents-4.10.0-20.el9_0.7

fence-agents-common-4.10.0-20.el9_0.6

ha-cloud-support-4.10.0-20.el9_0.6.x86_64.rpm

Azure Fence 에이전트의 버전을 확인합니다. 필요한 경우 최소 필수 버전 이상으로 업데이트합니다.

# Check the version of the Azure Fence Agent sudo yum info fence-agents-azure-armImportant

Azure 펜스 에이전트를 업데이트해야 하고 사용자 지정 역할을 사용하는 경우 powerOff 작업을 포함하도록 사용자 지정 역할을 업데이트해야 합니다. 자세한 내용은 펜스 에이전트에 대한 사용자 지정 역할 만들기를 참조하세요.

RHEL 9에 배포하는 경우 클라우드 배포용 리소스 에이전트도 설치합니다.

sudo yum install -y resource-agents-cloud[A] 호스트 이름 확인을 설정합니다.

DNS 서버를 사용하거나 모든 노드의

/etc/hosts파일을 수정할 수 있습니다. 다음 예제에서는/etc/hosts파일을 사용하는 방법을 보여 줍니다. 다음 명령에서 IP 주소와 호스트 이름을 바꿉니다.Important

클러스터 구성에서 호스트 이름을 사용하는 경우 신뢰할 수 있는 호스트 이름 확인이 중요합니다. 이름을 사용할 수 없으면 클러스터 통신이 실패하여 클러스터 장애 조치(failover)가 지연될 수 있습니다.

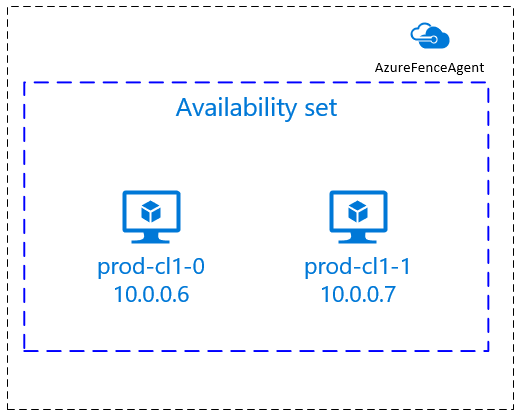

/etc/hosts를 사용하면 클러스터가 DNS로부터 독립되며 이는 단일 실패 지점이 될 수도 있다는 이점이 있습니다.sudo vi /etc/hosts/etc/hosts에 다음 줄을 삽입합니다. 사용자 환경에 맞게 IP 주소와 호스트 이름을 변경합니다.# IP address of the first cluster node 10.0.0.6 prod-cl1-0 # IP address of the second cluster node 10.0.0.7 prod-cl1-1[A]

hacluster암호를 동일한 암호로 변경합니다.sudo passwd hacluster[A] Pacemaker의 방화벽 규칙을 추가합니다.

클러스터 노드 간의 모든 클러스터 통신에 다음 방화벽 규칙을 추가합니다.

sudo firewall-cmd --add-service=high-availability --permanent sudo firewall-cmd --add-service=high-availability[A] 기본 클러스터 서비스를 사용하도록 설정합니다.

다음 명령을 실행하여 Pacemaker 서비스를 사용하도록 설정하고 시작합니다.

sudo systemctl start pcsd.service sudo systemctl enable pcsd.service[1] Pacemaker 클러스터를 만듭니다.

다음 명령을 실행하여 노드를 인증하고 클러스터를 만듭니다. 메모리 보존 유지 관리를 허용하도록 토큰을 30000으로 설정합니다. 자세한 내용은 Linux에 대한 이 문서를 참조하세요.

RHEL 7.x에서 클러스터를 빌드하는 경우 다음 명령을 사용합니다.

sudo pcs cluster auth prod-cl1-0 prod-cl1-1 -u hacluster sudo pcs cluster setup --name nw1-azr prod-cl1-0 prod-cl1-1 --token 30000 sudo pcs cluster start --allRHEL 8.x/RHEL 9.x에 클러스터를 빌드하는 경우 다음 명령을 사용합니다.

sudo pcs host auth prod-cl1-0 prod-cl1-1 -u hacluster sudo pcs cluster setup nw1-azr prod-cl1-0 prod-cl1-1 totem token=30000 sudo pcs cluster start --all다음 명령을 실행하여 클러스터 상태를 확인합니다.

# Run the following command until the status of both nodes is online sudo pcs status # Cluster name: nw1-azr # WARNING: no stonith devices and stonith-enabled is not false # Stack: corosync # Current DC: prod-cl1-1 (version 1.1.18-11.el7_5.3-2b07d5c5a9) - partition with quorum # Last updated: Fri Aug 17 09:18:24 2018 # Last change: Fri Aug 17 09:17:46 2018 by hacluster via crmd on prod-cl1-1 # # 2 nodes configured # 0 resources configured # # Online: [ prod-cl1-0 prod-cl1-1 ] # # No resources # # Daemon Status: # corosync: active/disabled # pacemaker: active/disabled # pcsd: active/enabled[A] 예상 투표를 설정합니다.

# Check the quorum votes pcs quorum status # If the quorum votes are not set to 2, execute the next command sudo pcs quorum expected-votes 2팁

다중 노드 클러스터, 즉 3개 이상의 노드가 있는 클러스터를 빌드하는 경우 응답을 2로 설정하지 마세요.

[1] 동시 Fence 작업을 허용합니다.

sudo pcs property set concurrent-fencing=true

펜싱 디바이스 만들기

펜싱 디바이스는 Azure 리소스에 대한 관리 ID 또는 서비스 주체를 사용하여 Azure에 대해 권한을 부여합니다.

관리 ID(MSI)를 만들려면 클러스터의 각 VM에 대해 시스템 할당 관리 ID를 만듭니다. 시스템 할당 관리 ID가 이미 있는 경우 해당 ID가 사용됩니다. 지금은 Pacemaker에서 사용자 할당 관리 ID를 사용하지 마세요. 관리 ID를 기반으로 하는 차단 디바이스는 RHEL 7.9 및 RHEL 8.x/RHEL 9.x에서 지원됩니다.

[1] 펜스 에이전트에 대한 사용자 지정 역할 만들기

관리 ID와 서비스 주체 모두 기본적으로 Azure 리소스에 액세스할 수 있는 권한이 없습니다. 클러스터의 모든 VM을 시작하고 중지(전원 끄기)하려면 관리 ID 또는 서비스 주체 권한을 부여해야 합니다. 사용자 지정 역할을 아직 만들지 않은 경우 PowerShell 또는 Azure CLI를 사용하여 만들 수 있습니다.

입력 파일에 다음 콘텐츠를 사용합니다. 콘텐츠를 구독에 맞게 조정해야 합니다. 즉, xxxxxxxx-xxxx-xxxx-xxxx-xxxxxxxxxxxx 및 yyyyyyyy-yyyy-yyyy-yyyy-yyyyyyyyyyyy를 구독 ID로 바꿔야 합니다. 구독이 하나만 있는 경우 AssignableScopes에서 두 번째 항목을 제거합니다.

{

"Name": "Linux Fence Agent Role",

"description": "Allows to power-off and start virtual machines",

"assignableScopes": [

"/subscriptions/xxxxxxxx-xxxx-xxxx-xxxx-xxxxxxxxxxxx",

"/subscriptions/yyyyyyyy-yyyy-yyyy-yyyy-yyyyyyyyyyyy"

],

"actions": [

"Microsoft.Compute/*/read",

"Microsoft.Compute/virtualMachines/powerOff/action",

"Microsoft.Compute/virtualMachines/start/action"

],

"notActions": [],

"dataActions": [],

"notDataActions": []

}

[A] 사용자 지정 역할 할당

관리 ID 또는 서비스 주체를 사용합니다.

마지막 섹션에서 만들어진 사용자 지정 역할 Linux Fence Agent Role을 클러스터 VM의 각 관리 ID에 할당합니다. 각 VM 시스템 할당 관리 ID에는 모든 클러스터 VM의 리소스에 할당된 역할이 필요합니다. 자세한 내용은 Azure Portal을 사용하여 리소스에 대한 관리 ID 액세스 할당을 참조하세요. 각 VM의 관리 ID 역할 할당에 모든 클러스터 VM이 포함되어 있는지 확인합니다.

Important

관리 ID를 사용한 승인의 할당 및 제거는 유효할 때까지 지연될 수 있습니다.

[1] 펜싱 디바이스 만들기

VM에 대한 권한을 편집한 후 클러스터에서 펜싱 디바이스를 구성할 수 있습니다.

sudo pcs property set stonith-timeout=900

참고 항목

RHEL 호스트 이름과 Azure VM 이름이 동일하지 않은 경우 명령에 만pcmk_host_map 옵션이 필요합니다. hostname:vm-name 형식으로 매핑을 지정합니다.

명령에서 굵은 섹션을 참조하세요. 자세한 내용은 pcmk_host_map에서 펜싱 디바이스에 대한 노드 매핑을 지정할 때 사용해야 하는 형식을 참조하세요.

RHEL 7.x의 경우, 다음 명령을 사용하여 Fence 디바이스를 구성합니다.

sudo pcs stonith create rsc_st_azure fence_azure_arm msi=true resourceGroup="resource group" \

subscriptionId="subscription id" pcmk_host_map="prod-cl1-0:prod-cl1-0-vm-name;prod-cl1-1:prod-cl1-1-vm-name" \

power_timeout=240 pcmk_reboot_timeout=900 pcmk_monitor_timeout=120 pcmk_monitor_retries=4 pcmk_action_limit=3 pcmk_delay_max=15 \

op monitor interval=3600

RHEL 8.x/9.x의 경우, 다음 명령을 사용하여 Fence 디바이스를 구성합니다.

# Run following command if you are setting up fence agent on (two-node cluster and pacemaker version greater than 2.0.4-6.el8) OR (HANA scale out)

sudo pcs stonith create rsc_st_azure fence_azure_arm msi=true resourceGroup="resource group" \

subscriptionId="subscription id" pcmk_host_map="prod-cl1-0:prod-cl1-0-vm-name;prod-cl1-1:prod-cl1-1-vm-name" \

power_timeout=240 pcmk_reboot_timeout=900 pcmk_monitor_timeout=120 pcmk_monitor_retries=4 pcmk_action_limit=3 \

op monitor interval=3600

# Run following command if you are setting up fence agent on (two-node cluster and pacemaker version less than 2.0.4-6.el8)

sudo pcs stonith create rsc_st_azure fence_azure_arm msi=true resourceGroup="resource group" \

subscriptionId="subscription id" pcmk_host_map="prod-cl1-0:prod-cl1-0-vm-name;prod-cl1-1:prod-cl1-1-vm-name" \

power_timeout=240 pcmk_reboot_timeout=900 pcmk_monitor_timeout=120 pcmk_monitor_retries=4 pcmk_action_limit=3 pcmk_delay_max=15 \

op monitor interval=3600

서비스 주체 구성에 따라 펜싱 디바이스를 사용하는 경우 Azure 펜싱을 사용하여 Pacemaker 클러스터용 SPN에서 MSI로 변경을 읽고 관리 ID 구성으로 변환하는 방법을 알아봅니다.

팁

- 2노드 Pacemaker 클러스터 내에서 펜스 경합을 방지하려면

priority-fencing-delay클러스터 속성을 구성하면 됩니다. 이 속성은 분할 브레인 시나리오가 발생할 때 총 리소스 우선 순위가 더 높은 노드를 펜싱하는 데 더 많은 지연을 발생합니다. 자세한 내용은 Pacemaker가 가장 적은 실행 중인 리소스로 클러스터 노드를 펜스할 수 있나요?를 참조하세요. priority-fencing-delay속성은 Pacemaker 버전 2.0.4-6.el8 이상 및 2노드 클러스터에 적용 가능합니다.priority-fencing-delay클러스터 속성을 구성하는 경우pcmk_delay_max속성을 설정할 필요가 없습니다. 하지만 Pacemaker 버전이 2.0.4-6.el8 미만인 경우에는pcmk_delay_max속성을 설정해야 합니다.priority-fencing-delay클러스터 속성을 설정하는 방법에 대한 지침은 해당 SAP ASCS/ERS 및 SAP HANA 수직 스케일 업 HA 문서를 참조하세요.

모니터링 및 펜싱 작업이 역직렬화됩니다. 결과적으로 더 오래 실행되는 모니터링 작업과 동시 펜싱 이벤트가 있는 경우 모니터링 작업이 이미 실행 중이므로 클러스터 장애 조치(failover)에 지연이 없습니다.

[1] 펜싱 디바이스를 사용하도록 설정

sudo pcs property set stonith-enabled=true

팁

Azure 펜스 에이전트에는 공용 엔드포인트에 대한 아웃바운드 연결이 필요합니다. 가능한 솔루션에 대한 자세한 내용은 표준 ILB를 사용하는 VM의 공용 엔드포인트 연결을 참조하세요.

Azure 예약된 이벤트에 대해 Pacemaker 구성

Azure는 예약된 이벤트를 제공합니다. 예약된 이벤트는 메타데이터 서비스를 통해 전송되며 애플리케이션이 해당 이벤트를 준비할 시간을 허용합니다.

Pacemaker 리소스 에이전트 azure-events-az는 예약된 Azure 이벤트를 모니터링합니다. 이벤트가 검색되고 리소스 에이전트가 다른 클러스터 노드를 사용할 수 있다고 판단하면 클러스터 상태 특성을 설정합니다.

노드에 대해 클러스터 상태 특성이 설정되면 위치 제약 조건이 트리거되고 이름이 health-로 시작하지 않는 모든 리소스가 예약된 이벤트와 함께 노드에서 멀리 마이그레이션됩니다. 영향을 받는 클러스터 노드에서 실행 중인 클러스터 리소스가 없어지면 예약된 이벤트가 승인되고 다시 시작과 같은 작업을 실행할 수 있습니다.

[A]

azure-events-az에이전트용 패키지가 이미 설치되어 있고 최신 상태인지 확인합니다.RHEL 8.x: sudo dnf info resource-agents RHEL 9.x: sudo dnf info resource-agents-cloud필요한 최소 버전:

- RHEL 8.4:

resource-agents-4.1.1-90.13 - RHEL 8.6:

resource-agents-4.9.0-16.9 - RHEL 8.8:

resource-agents-4.9.0-40.1 - RHEL 9.0:

resource-agents-cloud-4.10.0-9.6 - RHEL 9.2 이상:

resource-agents-cloud-4.10.0-34.1

- RHEL 8.4:

[1] Pacemaker에서 리소스를 구성합니다.

#Place the cluster in maintenance mode sudo pcs property set maintenance-mode=true[1] Pacemaker 클러스터 상태 노드 전략 및 제약 조건을 설정합니다.

sudo pcs property set node-health-strategy=custom sudo pcs constraint location 'regexp%!health-.*' \ rule score-attribute='#health-azure' \ defined '#uname'Important

다음 단계에 설명된 리소스 외에

health-로 시작하는 클러스터의 다른 리소스를 정의하지 마세요.[1] 클러스터 특성의 초기 값을 설정합니다. 각 클러스터 노드에 대해 실행하고 주요 제조업체 VM을 포함한 스케일 아웃 환경에 대해 실행합니다.

sudo crm_attribute --node prod-cl1-0 --name '#health-azure' --update 0 sudo crm_attribute --node prod-cl1-1 --name '#health-azure' --update 0[1] Pacemaker에서 리소스를 구성합니다. 리소스가

health-azure로 시작하는지 확인합니다.sudo pcs resource create health-azure-events \ ocf:heartbeat:azure-events-az op monitor interval=10s sudo pcs resource clone health-azure-events allow-unhealthy-nodes=truePacemaker 클러스터의 유지 관리 모드를 해제합니다.

sudo pcs property set maintenance-mode=false사용하도록 설정 중에 오류를 지우고 모든 클러스터 노드에서

health-azure-events리소스가 성공적으로 시작되었는지 확인합니다.sudo pcs resource cleanup예약된 이벤트에 대한 최초 쿼리 실행은 최대 2분 정도 걸릴 수 있습니다. 예약된 이벤트를 사용한 Pacemaker 테스트는 클러스터 VM에 대해 다시 부팅 또는 다시 배포 작업을 사용할 수 있습니다. 자세한 정보는 예약된 이벤트를 참조하세요.

선택적 펜싱 구성

팁

이 섹션은 특수 펜싱 디바이스 fence_kdump를 구성하려는 경우에만 적용 가능합니다.

VM 내에서 진단 정보를 수집해야 하는 경우, 펜스 에이전트 fence_kdump를 기반으로 다른 펜싱 디바이스를 구성하는 것이 유용할 수 있습니다. fence_kdump 에이전트는 노드가 kdump 크래시 복구에 들어갔다는 것을 감지하고 다른 펜싱 메서드가 호출되기 전에 크래시 복구 서비스가 완료되도록 허용할 수 있습니다. Azure VM을 사용하는 경우 fence_kdump는 Azure 펜스 에이전트와 같은 기존 펜스 메커니즘을 바꾸지 않습니다.

Important

fence_kdump가 첫 번째 수준 펜싱 디바이스로 구성된 경우 펜싱 작업이 지연되고 애플리케이션 리소스 장애 조치(failover)가 각각 지연됩니다.

크래시 덤프가 성공적으로 검색되면 크래시 복구 서비스가 완료될 때까지 펜싱이 지연됩니다. 실패한 노드에 연결할 수 없거나 응답하지 않는 경우 펜싱은 결정된 시간, 구성된 반복 횟수 및 fence_kdump 시간 제한에 따라 지연됩니다. 자세한 내용은 Red Hat Pacemaker 클러스터에서 Fence_kdump를 구성하려면 어떻게 해야 하나요?를 참조하세요.

제안된 fence_kdump 시간 제한을 특정 환경에 맞게 조정해야 할 수도 있습니다.

VM 내에서 진단을 수집하는 데 필요한 경우에만 fence_kdump 펜싱을 구성하고 항상 Azure 펜스 에이전트와 같은 기존 펜싱 방법과 함께 구성하는 것이 좋습니다.

다음 Red Hat 기술 자료 문서에는 fence_kdump 펜싱 구성에 대한 중요한 정보가 포함되어 있습니다.

- Red Hat Pacemaker 클러스터에서 fence_kdump를 구성하려면 어떻게 할까요?를 참조하세요.

- Pacemaker를 사용하여 RHEL 클러스터에서 펜싱 수준을 구성/관리하는 방법을 참조하세요.

- 2.0.14보다 오래된 kexec-tools를 사용하는 RHEL 6 또는 7 HA 클러스터에서 "X초 후 시간 제한"로 인해 fence_kdump가 실패함을 참조하세요.

- 기본 시간 제한을 변경하는 방법에 대한 자세한 내용은 RHEL 6, 7, 8 HA 추가 기능에서 사용하도록 kdump를 구성하려면 어떻게 할까요?을 참조하세요.

fence_kdump를 사용할 때 장애 조치(failover) 지연을 줄이는 방법에 대한 자세한 내용은 fence_kdump 구성을 추가할 때 예상되는 장애 조치(failover) 지연을 줄일 수 있나요?를 참조하세요.

다음 선택적 단계를 실행하여 Azure 펜스 에이전트 구성 외에도 첫 번째 수준 펜싱 구성으로 fence_kdump를 추가합니다.

[A]

kdump가 활성 상태이고 구성되어 있는지 확인합니다.systemctl is-active kdump # Expected result # active[A]

fence_kdump펜스 에이전트를 설치합니다.yum install fence-agents-kdump[1] 클러스터에

fence_kdump펜싱 디바이스를 만듭니다.pcs stonith create rsc_st_kdump fence_kdump pcmk_reboot_action="off" pcmk_host_list="prod-cl1-0 prod-cl1-1" timeout=30[1]

fence_kdump펜싱 메커니즘이 먼저 사용되도록 펜싱 수준을 구성합니다.pcs stonith create rsc_st_kdump fence_kdump pcmk_reboot_action="off" pcmk_host_list="prod-cl1-0 prod-cl1-1" pcs stonith level add 1 prod-cl1-0 rsc_st_kdump pcs stonith level add 1 prod-cl1-1 rsc_st_kdump pcs stonith level add 2 prod-cl1-0 rsc_st_azure pcs stonith level add 2 prod-cl1-1 rsc_st_azure # Check the fencing level configuration pcs stonith level # Example output # Target: prod-cl1-0 # Level 1 - rsc_st_kdump # Level 2 - rsc_st_azure # Target: prod-cl1-1 # Level 1 - rsc_st_kdump # Level 2 - rsc_st_azure[A] 방화벽을 통해

fence_kdump에 필요한 포트를 허용합니다.firewall-cmd --add-port=7410/udp firewall-cmd --add-port=7410/udp --permanent[A]

initramfs이미지 파일에fence_kdump및hosts파일이 포함되어 있는지 확인합니다. 자세한 내용은 Red Hat Pacemaker 클러스터에서 Fence_kdump를 구성하려면 어떻게 해야 하나요?를 참조하세요.lsinitrd /boot/initramfs-$(uname -r)kdump.img | egrep "fence|hosts" # Example output # -rw-r--r-- 1 root root 208 Jun 7 21:42 etc/hosts # -rwxr-xr-x 1 root root 15560 Jun 17 14:59 usr/libexec/fence_kdump_send[A]

/etc/kdump.conf에서fence_kdump_nodes구성을 수행하여 일부kexec-tools버전에 대한 시간 제한에 따른fence_kdump실패를 방지합니다. 자세한 내용은 fence_kdump_nodes가 kexec-tools 버전 2.0.15 이상으로 지정되지 않은 경우 fence_kdump 시간 초과 및 2.0.14 이전의 kexec-tools 버전이 있는 RHEL 6 또는 7 고가용성 클러스터에서 "X초 후 시간 제한"으로 fence_kdump 실패를 참조하세요. 두 노드 클러스터에 대한 구성 예가 여기에 나와 있습니다./etc/kdump.conf를 변경한 후에는 kdump 이미지를 다시 생성해야 합니다. 다시 생성하려면kdump서비스를 다시 시작합니다.vi /etc/kdump.conf # On node prod-cl1-0 make sure the following line is added fence_kdump_nodes prod-cl1-1 # On node prod-cl1-1 make sure the following line is added fence_kdump_nodes prod-cl1-0 # Restart the service on each node systemctl restart kdump노드를 충돌시켜 구성을 테스트합니다. 자세한 내용은 Red Hat Pacemaker 클러스터에서 Fence_kdump를 구성하려면 어떻게 해야 하나요?를 참조하세요.

Important

클러스터가 이미 생산적으로 사용되고 있는 경우 노드 크래시가 애플리케이션에 영향을 미치므로 이에 따라 테스트를 계획합니다.

echo c > /proc/sysrq-trigger

다음 단계

- SAP용 Azure Virtual Machines 계획 및 구현을 참조하세요.

- SAP용 Azure Virtual Machines 배포 참조

- SAP용 Azure Virtual Machines DBMS 배포를 참조하세요.

- Azure VM에서 HA를 설정하고 SAP HANA 재해 복구를 계획하는 방법을 알아보려면 Azure Virtual Machines에서 SAP HANA의 고가용성을 참조하세요.