Stündliches Kopieren und Transformieren von Daten mit dynamischen Parametern

GILT FÜR: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Tipp

Testen Sie Data Factory in Microsoft Fabric, eine All-in-One-Analyselösung für Unternehmen. Microsoft Fabric deckt alle Aufgaben ab, von der Datenverschiebung bis hin zu Data Science, Echtzeitanalysen, Business Intelligence und Berichterstellung. Erfahren Sie, wie Sie kostenlos eine neue Testversion starten!

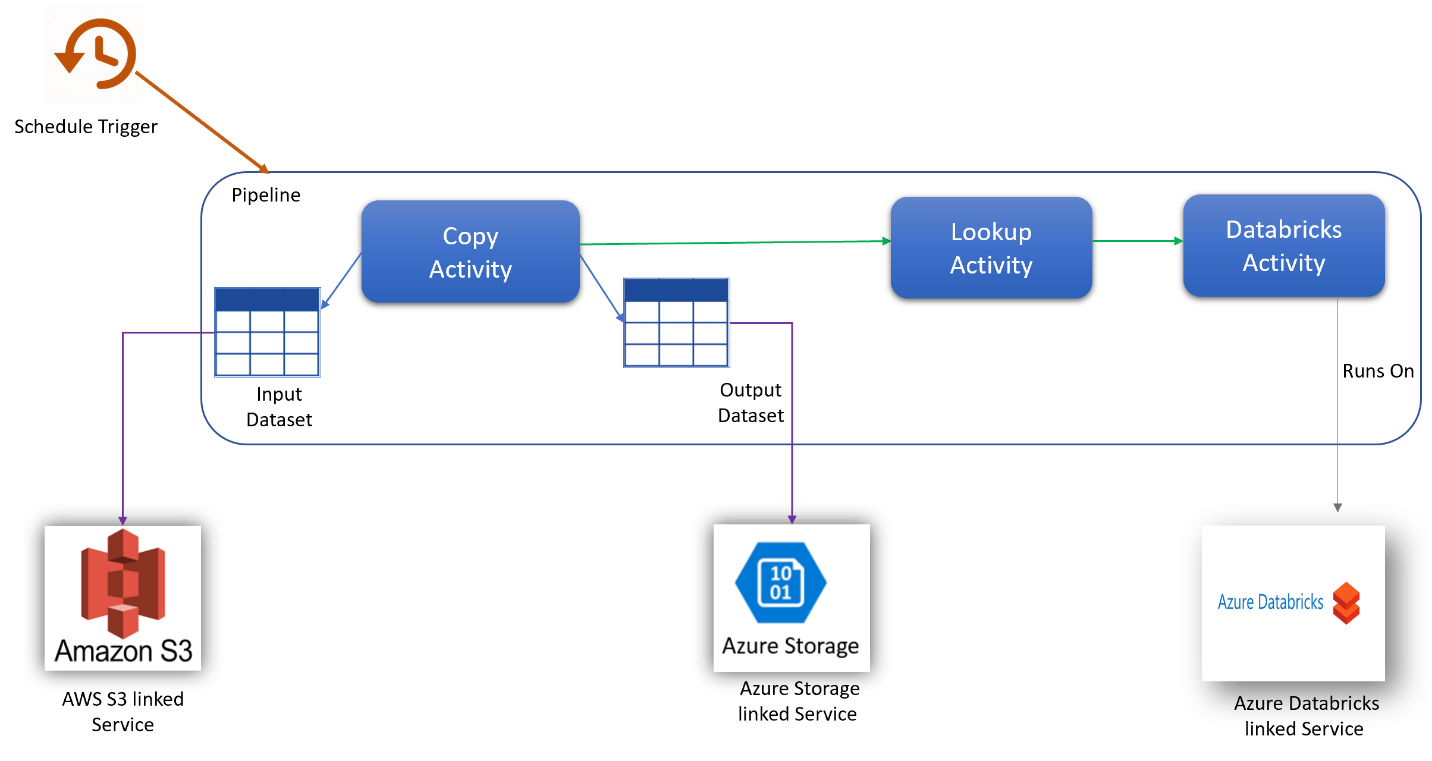

In diesem Szenario möchten Sie über 8 Stunden am Tag und 30 Tage lang stündlich Daten aus AWS S3 in Azure Blob Storage kopieren und die Daten mit Azure Databricks transformieren (mit dynamischen Parametern im Skript).

Die in diesem Beispiel verwendeten Preise sind hypothetisch und stellen nicht die tatsächlichen genauen Preise dar. Lese-/Schreib- und Überwachungskosten werden nicht gezeigt, da sie in der Regel vernachlässigbar sind und sich nicht auf die Gesamtkosten auswirken. Aktivitätsausführungen werden bei den Schätzungen des Preisrechners zudem auf die nächsten 1000 gerundet.

Für spezifischere Szenarien und zur Einschätzung Ihrer zukünftigen Kosten für die Nutzung des Diensts können Sie den Azure-Preisrechner verwenden.

Konfiguration

Um dieses Szenario zu realisieren, müssen Sie eine Pipeline mit folgenden Elementen erstellen:

- Eine Kopieraktivität mit einem Eingabedataset für die aus AWS S3 kopierten Daten und ein Ausgabedataset für die Daten in Azure Storage.

- Eine Suchaktivität zur dynamischen Übergabe von Parametern an das Skript für die Transformation.

- Eine Azure Databricks-Aktivität für die Datentransformation.

- Ein Zeitplantrigger, der die Pipeline stündlich über acht Stunden am Tag ausführt. Wenn Sie eine Pipeline ausführen möchten, können Sie sie entweder sofort auslösen oder planen. Zusätzlich zur Pipeline selbst zählt jede Triggerinstanz als einzelne Aktivitätsausführung.

Kostenschätzung

| Vorgänge | Typen und Einheiten |

|---|---|

| Ausführen der Pipeline | Vier Aktivitätsausführungen pro Ausführung (eine für die Triggerausführung, drei für die Aktivitätsausführungen) = 960 Aktivitätsausführungen, aufgerundet, da der Rechner nur Inkremente von 1000 zulässt. |

| Annahme für das Kopieren der Daten: DIU-Stunden pro Ausführung = 10 Min | 10 Stunden \ 60 Min. * Azure Integration Runtime (Standard-DIU-Einstellung = 4) Weitere Informationen zu Datenintegrationseinheiten und Optimieren der Kopierleistung finden Sie in diesem Artikel. |

| Ausführen der Lookup-Aktivität, Annahme: Pipelineaktivitätszeit pro Ausführung = 1 Min. | 1 Min. / 60 Min. Ausführung der Pipelineaktivität |

| Ausführen der Databricks-Aktivität, Annahme: externe Ausführungszeit pro Ausführung = 10 Min. | 10 Min. / 60 Min. Ausführung der externen Pipelineaktivität |

Preisbeispiel: Beispiel für Preisrechner

Preis für gesamtes Szenario für 30 Tage: 41,03 USD

Zugehöriger Inhalt

- Preisbeispiel: Stündliches Kopieren von Daten aus AWS S3 in Azure Blob Storage für 30 Tage

- Preisbeispiel: Stündliches Kopieren und Transformieren von Daten mit Azure Databricks für 30 Tage

- Preisbeispiel: Ausführen von SSIS-Paketen auf Azure-SSIS Integration Runtime

- Preisbeispiel: Verwenden der Debugfunktion des Zuordnungsdatenflusses für einen normalen Arbeitstag

- Preisbeispiel: Transformieren von Daten im Blob-Speicher mit Zuordnungsdatenflüssen

- Preisbeispiel: Datenintegration in einem verwalteten Azure Data Factory-VNET

- Preisbeispiel: Abrufen von Deltadaten aus SAP ECC über SAP CDC in Zuordnungsdatenflüsse

Feedback

Bald verfügbar: Im Laufe des Jahres 2024 werden wir GitHub-Tickets als Feedbackmechanismus für Inhalte auslaufen lassen und es durch ein neues Feedbacksystem ersetzen. Weitere Informationen finden Sie unter: https://aka.ms/ContentUserFeedback.

Einreichen und Feedback anzeigen für