Lösungsmöglichkeiten

Dieser Artikel ist ein Lösungsvorschlag. Wenn Sie möchten, dass wir diesen Artikel um weitere Informationen ergänzen, z. B. potenzielle Anwendungsfälle, alternative Dienste, Überlegungen zur Implementierung oder Preisempfehlungen, lassen Sie es uns über Feedback auf GitHub wissen.

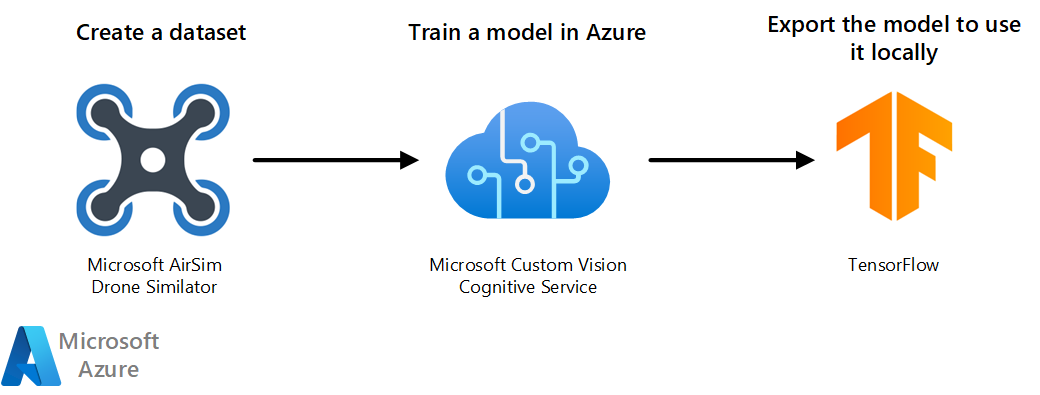

Diese Architektur verwendet Custom Vision zum Klassifizieren von Bildern, die von einer simulierten Drohne erstellt wurden. Sie bietet eine Möglichkeit, KI mit dem Internet der Dinge (Internet of Things, IoT) zu kombinieren. Azure Custom Vision kann auch für Objekterkennungszwecke verwendet werden.

Aufbau

Laden Sie eine Visio-Datei dieser Architektur herunter.

Workflow

- Verwenden Sie die 3D-gerenderte Umgebung von AirSim, um Bilder mit der Drohne zu aufzunehmen. Verwenden Sie diese Bilder als Trainingsdataset.

- Importieren Sie das Dataset in ein Custom Vision-Projekt, und versehen Sie es mit Tags. Der Cognitive Services-Dienst trainiert und testet das Modell.

- Exportieren Sie das Modell in das TensorFlow-Format, damit Sie es lokal verwenden können.

- Das Modell kann auch in einem Container oder auf mobilen Geräten bereitgestellt werden.

Komponenten

Microsoft AirSim-Drohnensimulator

Der Microsoft AirSim-Drohnensimulator wurde mit der Unreal Engine erstellt. Bei dem Simulator handelt es sich um eine plattformübergreifende Open-Source-Software, die entwickelt wurde, um die Forschung im Bereich der künstlichen Intelligenz zu unterstützen. In dieser Architektur erstellt der Simulator das zum Trainieren des Modells verwendete Dataset mit Bildern.

Azure Custom Vision

Azure Custom Vision ist Teil von Azure Cognitive Services. In dieser Architektur erstellt Custom Vision ein Bildklassifizierungsmodell.

TensorFlow

TensorFlow ist eine Open-Source-Plattform für maschinelles Lernen (ML). Es handelt sich dabei um ein Tool, das Sie beim Entwickeln und Trainieren von ML-Modellen unterstützt. Wenn Sie Ihr Modell in das TensorFlow-Format exportieren, erhalten Sie eine Protokollpufferdatei mit dem Custom Vision-Modell, die Sie lokal in Ihrem Skript verwenden können.

Szenariodetails

Azure Cognitive Services bieten viele Möglichkeiten für KI-Lösungen (künstliche Intelligenz). Eine davon ist die API Azure Custom Vision, mit der Sie Bildklassifizierungen erstellen, bereitstellen und verbessern können. Diese Architektur verwendet Custom Vision zum Klassifizieren von Bildern, die von einer simulierten Drohne erstellt wurden. Sie bietet eine Möglichkeit, KI mit dem Internet der Dinge (Internet of Things, IoT) zu kombinieren. Azure Custom Vision kann auch für Objekterkennungszwecke verwendet werden.

Mögliche Anwendungsfälle

Diese Lösung eignet sich ideal für die Rettungs-, Simulations-, Robotik-, Flugzeug-, Raumfahrt- und Luftfahrtindustrie.

Das Search and Rescue Lab von Microsoft zeigt einen hypothetischen Anwendungsfall für Custom Vision. In diesem Lab fliegen Sie mit einer in Microsoft AirSim simulierten Drohne durch eine 3D-gerenderte Umgebung. Mit dieser Drohne nehmen Sie simulierte Bilder von den Tieren in dieser Umgebung auf. Nach dem Erstellen eines Datasets mit Bildern verwenden Sie dieses zum Trainieren eines Custom Vision-Klassifizierungsmodells. Versehen Sie hierfür die Bilder mit Tags mit den Namen der Tiere. Wenn Sie noch mal mit der Drohne fliegen, nehmen Sie neue Bilder von den Tieren auf. Diese Lösung erkennt jeweils die Namen der Tiere auf den neuen Bildern.

Bei einer praktischen Umsetzung dieses Labs wird die in Microsoft AirSim simulierte Drohne durch eine echte Drohne ersetzt. Wenn ein Haustier verloren geht, stellt dessen Besitzer dem Custom Vision-Modelltrainer Bilder von diesem Haustier zur Verfügung. Wie bei der Simulation werden die Bilder zum Trainieren des Modells verwendet, damit das Haustier erkannt wird. Anschließend sucht der Drohnenpilot ein Gebiet ab, in dem sich das verlorene Haustier möglicherweise befindet. Wenn die Drohne dabei Tiere entdeckt, kann sie mit ihrer Kamera Bilder aufnehmen und ermitteln, ob es sich um das verlorene Haustier handelt.

Bereitstellen dieses Szenarios

Führen Sie die im GitHub-Repository für das Search and Rescue Lab beschriebenen Schritte aus, um diese Referenzarchitektur bereitzustellen.

Beitragende

Dieser Artikel wird von Microsoft gepflegt. Er wurde ursprünglich von folgenden Mitwirkenden geschrieben:

Hauptautoren:

- Jose Contreras | Principal Software Engineer

Nächste Schritte

- Erfahren Sie mehr über Microsoft AirSim.

- Erfahren Sie mehr über den Cognitive Services-Dienst Azure Custom Vision.

- Erfahren Sie mehr über Azure Cognitive Services.

Verwandte Ressourcen

Hier finden Sie weitere Azure Architecture Center-Artikel: