Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

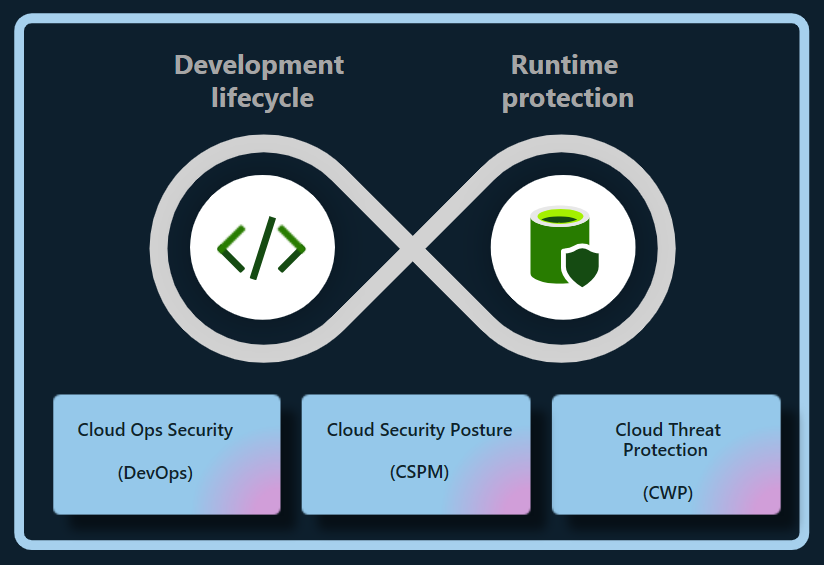

Der CsPM-Plan (Defender Cloud Security Posture Management) in Microsoft Defender für Cloud sichert unternehmensbasierte, multicloud- oder hybride Cloudumgebungen. Diese Umgebungen umfassen Azure, Amazon Web Services (AWS) und Google Cloud Platform (GCP) Vertex AI. Der Defender CSPM-Plan sichert generative KI-Anwendungen und KI-Agenten (Vorschau) über den gesamten Lebenszyklus hinweg.

Defender for Cloud reduziert das Risiko Cloud-übergreifender KI-Workloads durch:

- Entdecken Sie die generative AI Bill of Materials (AI BOM), die Anwendungskomponenten, Daten und KI-Artefakte von Code zu Cloud umfasst.

- Stärken des generativen Sicherheitsstatus von KI-Anwendungen mit integrierten Empfehlungen und durch Erkunden und Beheben von Sicherheitsrisiken.

- Verwenden der Angriffspfadanalyse, um Risiken zu identifizieren und zu beheben.

Wichtig

So aktivieren Sie die Funktionen für die Verwaltung des KI-Sicherheitsstatus für ein AWS-Konto, für das bereits Folgendes gilt:

- Es ist mit Ihrem Azure-Konto verbunden.

- Defender CSPM ist für das Konto aktiviert.

- Der Berechtigungstyp ist auf Zugriff mit den geringsten Rechten festgelegt.

Sie müssen die Berechtigungen für diesen Connector neu konfigurieren, um die relevanten Berechtigungen mithilfe der folgenden Schritte zu aktivieren:

- Wechseln Sie im Azure-Portal zur Seite "Umgebungseinstellungen", und wählen Sie den entsprechenden AWS-Connector aus.

- Wählen Sie Zugriff konfigurieren aus.

- Stellen Sie sicher, dass der Berechtigungstyp auf Zugriff mit den geringsten Rechten festgelegt ist.

- Führen Sie die Schritte 7 bis 11 aus, um die Konfiguration abzuschließen.

Entdecken von generativen KI-Apps

Defender for Cloud entdeckt KI-Workloads und identifiziert Details zur KI-Stückliste Ihrer Organisation. Diese Sichtbarkeit ermöglicht es Ihnen, Sicherheitsrisiken zu identifizieren und zu beheben und generative KI-Anwendungen vor potenziellen Bedrohungen zu schützen.

Defender for Cloud entdeckt automatisch und kontinuierlich bereitgestellte KI-Workloads in den folgenden Diensten:

- Azure OpenAI-Dienst

- Azure AI-Gießerei

- Azure Machine Learning

- Amazon Bedrock

- Google Vertex AI

Defender for Cloud kann auch Sicherheitsrisiken innerhalb von Abhängigkeiten generativer KI-Bibliotheken wie TensorFlow, PyTorch und Langchain entdecken, indem Quellcode auf Fehlkonfigurationen von Infrastructure-als-Code (IaC) und Containerimages auf Sicherheitsrisiken überprüft werden. Das regelmäßige Aktualisieren oder Patchen der Bibliotheken kann Exploits verhindern, generative KI-Anwendungen schützen und ihre Integrität beibehalten.

Mit diesen Features bietet Defender for Cloud vollständige Sichtbarkeit von KI-Workloads von Code bis Cloud.

Entdecken von KI-Agents (Vorschau)

Defender for Cloud ermittelt AI-Agent-Workloads und identifiziert Details zur KI-BOM Ihrer Organisation. Diese Sichtbarkeit ermöglicht es Ihnen, Sicherheitsrisiken zu identifizieren und zu beheben und generative KI-Agent-Anwendungen vor potenziellen Bedrohungen zu schützen.

Wichtig

Dieses Feature befindet sich derzeit in der Vorschau und ist ohne zusätzliche Kosten in Ihrem Microsoft Defender für CSPM enthalten. Die Lizenzanforderungen können sich ändern, wenn die Funktion allgemein verfügbar ist. Wenn eine Änderung der Preise auftritt, wird das Feature automatisch deaktiviert, und Sie erhalten eine Benachrichtigung. Um das Feature weiterhin zu verwenden, benötigen Sie möglicherweise eine neue Lizenz, um das Feature erneut zu aktivieren.

Defender für Cloud ermittelt automatisch und kontinuierlich bereitgestellte KI-Agents in den folgenden Diensten:

- Azure Foundry AI Agents (erfordert Zugriff auf Defender for Cloud mit aktiviertem Defender CSPM-Plan)

- Copilot Studio AI Agents (erfordert eine Microsoft Defender for Cloud Apps-Lizenz )

Wenn Sie den Defender CSPM-Plan für Ihr Azure-Abonnement aktivieren, erkennt das Portal automatisch KI-Agents, die mit Azure AI Foundry bereitgestellt werden, und füllt den KI-Bestand mit der Liste der ermittelten KI-Agents auf.

Hinweis

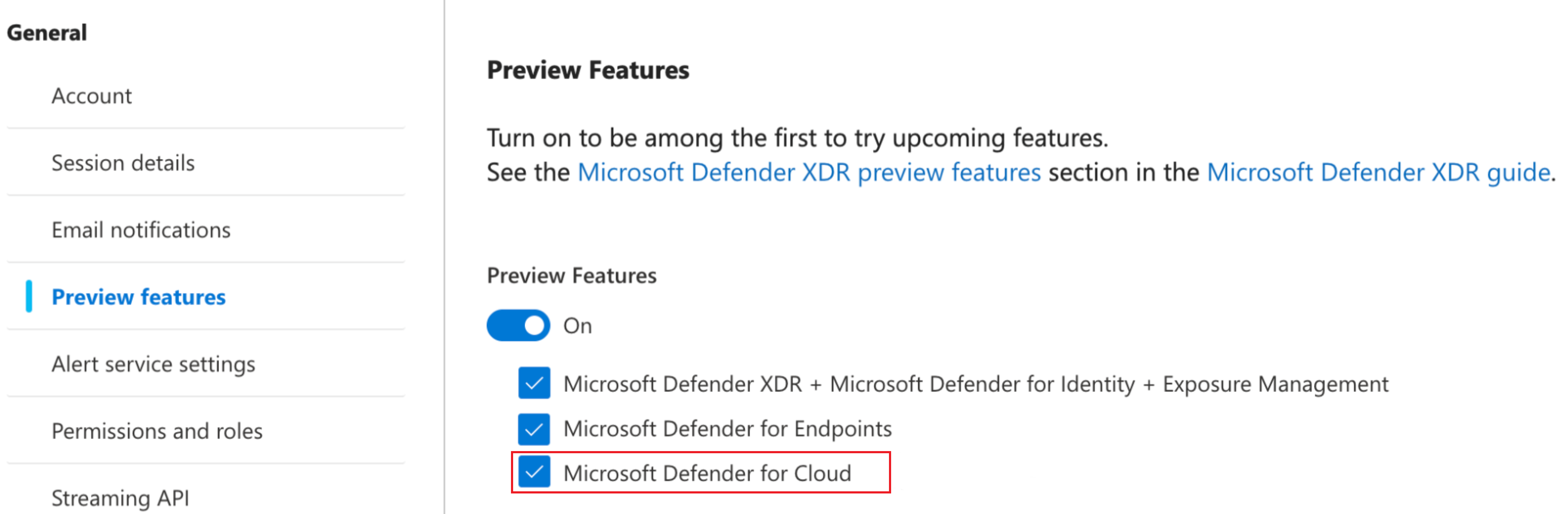

Um Vorschaufeatures im Defender-Portal anzuzeigen, müssen Sie Microsoft Defender für Cloud-Vorschaufeatures im Defender-Portal aktivieren.

Erfahren Sie, wie Sie Ihre KI-Agents schützen (Vorschau).

Reduzieren von Risiken für generative KI-Apps

Defender CSPM bietet kontextbezogene Erkenntnisse für den KI-Sicherheitsstatus Ihrer Organisation. Sie können Risiken in Ihren KI-Workloads reduzieren, indem Sie Sicherheitsempfehlungen und Angriffspfadanalyse verwenden.

Erkunden von Risiken mithilfe von Empfehlungen

Defender for Cloud bewertet KI-Workloads. Es gibt Empfehlungen zu Identitäts-, Datensicherheits- und Internetexposition, um kritische Sicherheitsprobleme zu identifizieren und zu priorisieren.

Erkennen von IaC-Fehlkonfigurationen

DevOps-Sicherheit erkennt IaC-Fehlkonfigurationen, die generative KI-Anwendungen Sicherheitsrisiken aussetzen können, wie z. B. übermäßig exponierte Zugriffssteuerungen oder versehentlich öffentlich zugängliche Dienste. Diese Fehlkonfigurationen könnten zu Datenschutzverletzungen, unbefugtem Zugriff und Complianceproblemen führen, insbesondere bei der Handhabung strenger Datenschutzbestimmungen.

Defender für Cloud bewertet Ihre generative KI-Apps-Konfiguration und bietet Sicherheitsempfehlungen zur Verbesserung Ihres KI-Sicherheitsstatus.

Beheben Sie erkannte Fehlkonfigurationen frühzeitig im Entwicklungszyklus, um komplexere Probleme zu einem späteren Zeitpunkt zu vermeiden.

Zu den aktuellen IaC AI-Sicherheitsüberprüfungen gehören:

- Verwenden privater Endpunkte für den Azure KI-Dienst

- Einschränken von Azure KI-Dienstendpunkten

- Verwenden der verwalteten Identität für Azure KI-Dienstkonten

- Verwenden der identitätsbasierten Authentifizierung für Azure KI-Dienstkonten

Untersuchen von Risiken mit der Angriffspfadanalyse

Die Analyse des Angriffspfads erkennt und verringert Risiken für KI-Workloads. Daten könnten möglicherweise freigegeben werden, während KI-Modelle an spezifische Daten angepasst und ein vortrainiertes Modell an einen bestimmten Datensatz abgestimmt wird, damit seine Leistung im Zusammenhang mit einer verwandten Aufgabe verbessert wird.

Durch die kontinuierliche Überwachung von KI-Workloads kann die Analyse des Angriffspfads Schwachstellen und potenzielle Sicherheitsrisiken identifizieren und mit Empfehlungen nachverfolgen. Darüber hinaus erstreckt es sich auf Fälle, in denen die Daten und Computeressourcen über Azure, AWS und GCP verteilt sind.