Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

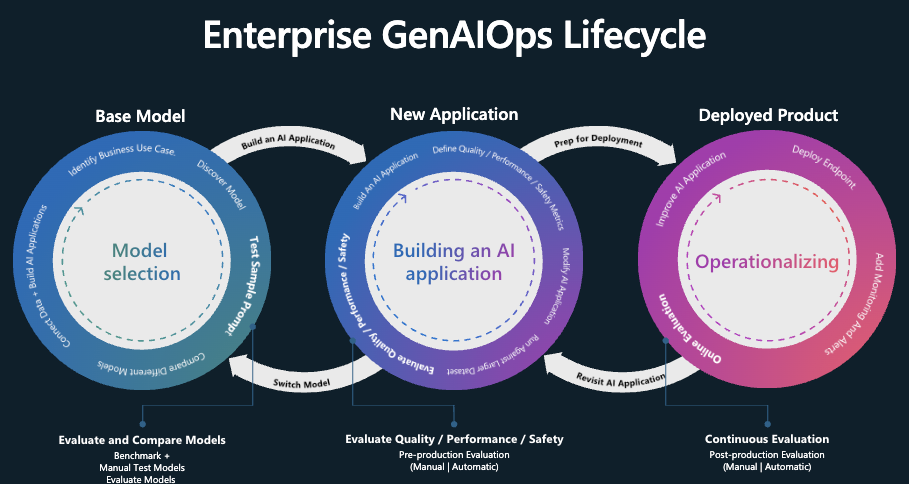

Der Lebenszyklus von KI-Anwendungen erfordert robuste Bewertungsrahmen, um sicherzustellen, dass KI-Systeme genaue, relevante und zuverlässige Ergebnisse liefern. Ohne strenge Bewertung riskieren KI-Systeme, Antworten zu erzeugen, die ungenau, inkonsistent, schlecht geerdet oder potenziell schädlich sind. Observability ermöglicht Es Teams, sowohl die Qualität als auch die Sicherheit von KI-Ausgaben während des gesamten Entwicklungslebenszyklus zu messen und zu verbessern – von der Modellauswahl bis hin zur Produktionsüberwachung.

Was ist Beobachtbarkeit?

KI-Observability bezieht sich auf die Fähigkeit, KI-Systeme während des gesamten Lebenszyklus zu überwachen, zu verstehen und Fehler zu beheben. Sie können in CI/CD-Pipelines automatisierte Qualitätsgates integrieren, nachverfolgen und auswerten sowie Signale wie Auswertungsmetriken, Protokolle, Ablaufverfolgungen und Modellausgaben erfassen, um Einblicke in Leistung, Qualität, Sicherheit und Betriebszustand zu erhalten.

Grundlegende Überwachungsfunktionen

Microsoft Foundry bietet drei Kernfunktionen, die zusammenarbeiten, um umfassende Observierbarkeit über den GESAMTEN AI-Anwendungslebenszyklus hinweg zu gewährleisten:

Bewertung

Evaluatoren messen die Qualität, Sicherheit und Zuverlässigkeit von KI-Reaktionen während der gesamten Entwicklung. Microsoft Foundry bietet integrierte Bewerter, einschließlich allgemeiner Qualitätsmetriken (Kohärenz, Flüssigkeit), RAG-spezifischer Metriken (Fundierung, Relevanz), Sicherheit und Schutz (Hass/Unfairness, Gewalt, geschütztes Material) und agentspezifischer Metriken (Genauigkeit der Werkzeugaufrufe, Aufgabenerfüllung), unter anderem. Sie können auch benutzerdefinierte Bewerter erstellen, die auf Ihre domänenspezifischen Anforderungen zugeschnitten sind.

Eine vollständige Liste der integrierten Bewerter finden Sie in der Referenz zu integrierten Evaluatoren.

Überwachung

Die Produktionsüberwachung stellt sicher, dass Ihre bereitgestellten KI-Anwendungen Qualität und Leistung unter realen Bedingungen erhalten. In Azure Monitor Application Insights integriert, bietet Microsoft Foundry Echtzeit-Dashboards zur Nachverfolgung betrieblicher Metriken, Tokenverbrauch, Latenz, Fehlerraten und Qualitätsbewertungen. Sie können Warnungen einrichten, wenn Ausgaben Qualitätsgrenzen nicht erreichen oder schädliche Inhalte erzeugen. Dies ermöglicht eine schnelle Problembehebung.

Ausführliche Informationen zum Einrichten der Produktionsüberwachung finden Sie im Dashboard "Monitor-Agents".

Ablaufverfolgung

Die verteilte Ablaufverfolgung erfasst den Ausführungsfluss von KI-Anwendungen und bietet Einblicke in LLM-Aufrufe, Toolaufrufe, Agententscheidungen und Dienstübergreifende Abhängigkeiten. Die Ablaufverfolgung, basierend auf OpenTelemetry-Standards und integriert mit Azure Monitor Application Insights, ermöglicht das Debuggen komplexer Agent-Verhaltensweisen, das Identifizieren von Leistungsengpässen und das Verständnis von mehrstufigen Argumentationsketten. Microsoft Foundry unterstützt die Ablaufverfolgung für beliebte Frameworks wie LangChain, LangGraph, das OpenAI Agents SDK und das Microsoft Agent Framework.

Anleitungen zur Implementierung von Tracing finden Sie in der Übersicht über den Trace-Agent.

Was sind Bewerter?

Bewertungen sind spezielle Tools, die die Qualität, Sicherheit und Zuverlässigkeit von KI-Antworten während des gesamten Entwicklungslebenszyklus messen.

Eine vollständige Liste der integrierten Bewerter finden Sie in der Referenz zu integrierten Evaluatoren.

Evaluatoren werden in jede Phase des KI-Lebenszyklus integriert, um Zuverlässigkeit, Sicherheit und Effektivität sicherzustellen.

Die drei Phasen der KI-Anwendungslebenszyklus-Bewertung

Basismodellauswahl

Wählen Sie das richtige Foundation-Modell aus, indem Sie Qualität, Aufgabenleistung, ethische Überlegungen und Sicherheitsprofile in verschiedenen Modellen vergleichen.

Verfügbare Tools: Microsoft Foundry Benchmark zum Vergleichen von Modellen auf öffentlichen Datasets oder eigenen Daten sowie das Azure AI Evaluation SDK für das Testen spezifischer Modellendpunkte.

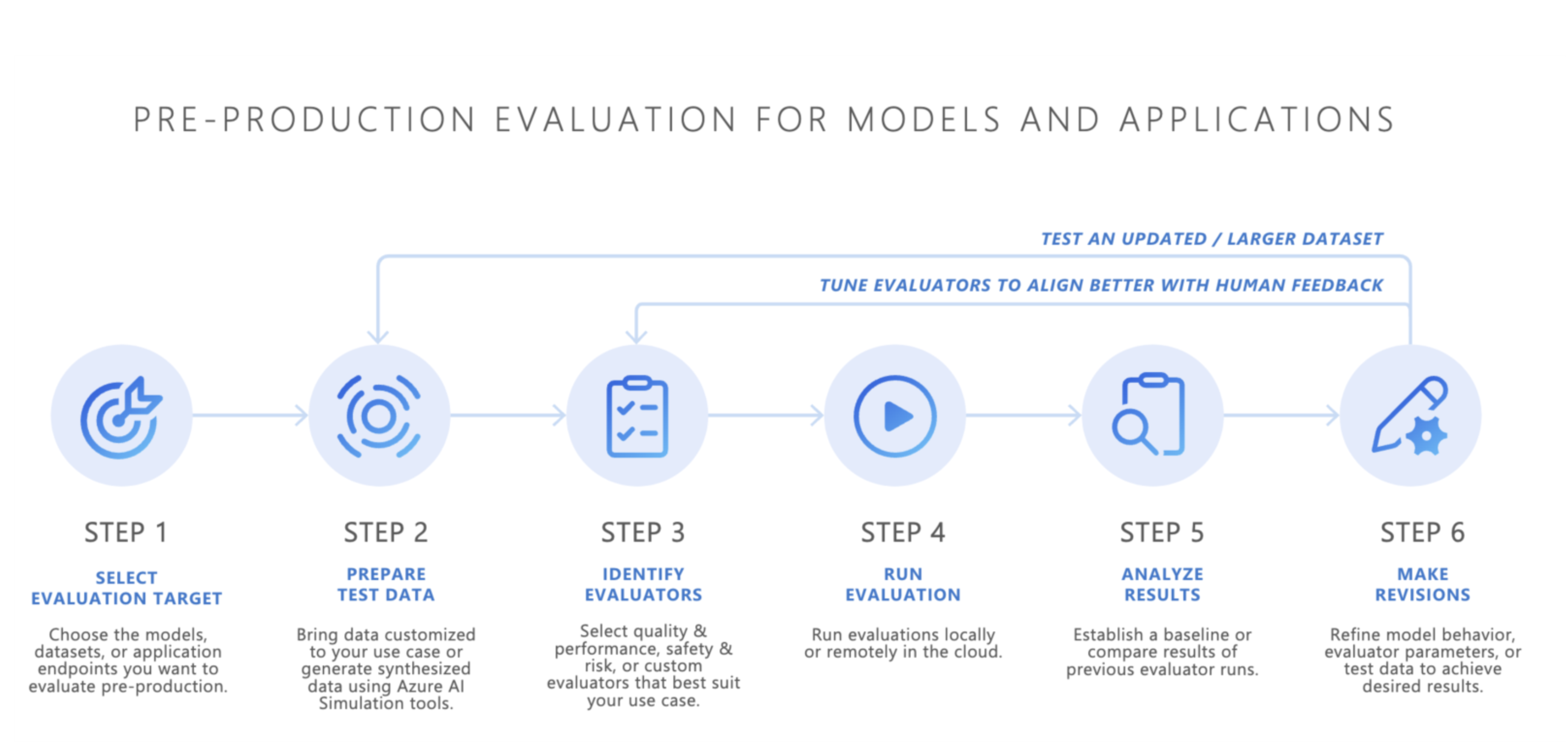

Vorproduktionsbewertung

Vor der Bereitstellung stellen gründliche Tests sicher, dass Ihr KI-Agent oder Ihre Anwendung produktionsbereit ist. In dieser Phase werden die Leistung durch Auswertungsdatensätze überprüft, Randfälle identifiziert, die Zuverlässigkeit bewertet und wichtige Metriken wie Aufgabeneinhaltung, Bodenständigkeit, Relevanz und Sicherheit ermittelt. Informationen zum Erstellen von produktionsreifen Agents mit mehrteiligen Unterhaltungen, Tool-Aufrufen und Zustandsverwaltung finden Sie unter Foundry Agent Service.

Bewertungstools und -ansätze:

Bringen Sie Ihre eigenen Daten mit: Bewerten Sie KI-Anwendungen mit Ihren eigenen Daten mit Qualität, Sicherheit oder benutzerdefinierten Bewertern. Verwenden Sie den Assistenten für die Auswertung des Foundry-Portals oder das Foundry SDK , und zeigen Sie Ergebnisse im Foundry-Portal an.

AI red teaming agent: Der AI Red Teaming Agent simuliert komplexe Angriffe mithilfe des PyRIT-Frameworks von Microsoft, um Sicherheits- und Verwundbarkeiten vor der Bereitstellung zu identifizieren. Am besten geeignet für Mensch-in-Schleife-Prozesse.

Überwachung nach der Produktion

Nach der Bereitstellung sorgt die kontinuierliche Überwachung dafür, dass Ihre KI-Anwendung unter realen Bedingungen die Qualität aufrecht erhält:

- Operative Metriken: Regelmäßige Messung wichtiger KI-Agent-Betriebsmetriken

- Kontinuierliche Bewertung: Qualitäts- und Sicherheitsbewertung des Produktionsverkehrs mit einer Stichprobenrate

- Geplante Auswertung: Geplante Qualitäts- und Sicherheitsbewertung mithilfe von Testdatensätzen zur Erkennung von Systemabweichungen

- Geplantes Red Teaming: Geplante adversarielle Tests zur Untersuchung von Sicherheits- und Schutzrisiken

- Azure Monitor Warnungen: Benachrichtigungen, wenn Die Ausgabe Qualitätsschwellenwerte überschreitet oder schädliche Inhalte erzeugt

Integriert in Azure Monitor Application Insights bietet das Foundry Observability-Dashboard Echtzeiteinblicke in Leistungs-, Sicherheits- und Qualitätsmetriken, wodurch eine schnelle Problemlösung ermöglicht und die Benutzervertrauensstellung beibehalten wird.

Kurzübersicht zur Bewertung

| Zweck | Prozess | Parameter, Anleitungen und Beispiele |

|---|---|---|

| Wie richtet man die Ablaufverfolgung ein? | Konfigurieren des verteilten Tracing |

Ablaufverfolgungsübersicht Trace mit dem Agents SDK |

| Wofür bewerten Sie? | Identifizieren oder Erstellen relevanter Bewerter |

Integrierte Evaluatoren Benutzerdefinierte Bewerter Python SDK-Beispiele C#-SDK-Beispiele |

| Welche Daten sollten Sie verwenden? | Hochladen oder Generieren relevanter Datasets | Auswählen oder Erstellen eines Datasets |

| Wie kann ich Auswertungen durchführen? | Auswertung ausführen |

Ausführungen von Agent-Auswertungen Remote-Cloud-Ausführung |

| Wie hat meine Modell-/KI-Anwendung ausgeführt? | Analysieren von Ergebnissen |

Anzeigen von Auswertungsergebnissen Clusteranalyse |

| Wie kann ich verbessern? | Analysieren von Ergebnissen und Optimieren von Agents | Analysieren Von Auswertungsfehlern mit Clusteranalyse. Optimieren Sie Agenten, und bewerten Sie sie erneut. Überprüfen Sie die Auswertungsergebnisse. |

Unterstützung von Regionen, Preisbeschränkungen und Unterstützung für virtuelle Netzwerke

Um zu erfahren, welche Regionen KI-unterstützte Bewertungen unterstützen, die Rategrenzwerte, die für Auswertungsläufe gelten, und wie Sie die Unterstützung des virtuellen Netzwerks für die Netzwerkisolation konfigurieren, siehe Regionsunterstützung, Ratelimits und Unterstützung für virtuelle Netzwerke für die Auswertung.

Preise

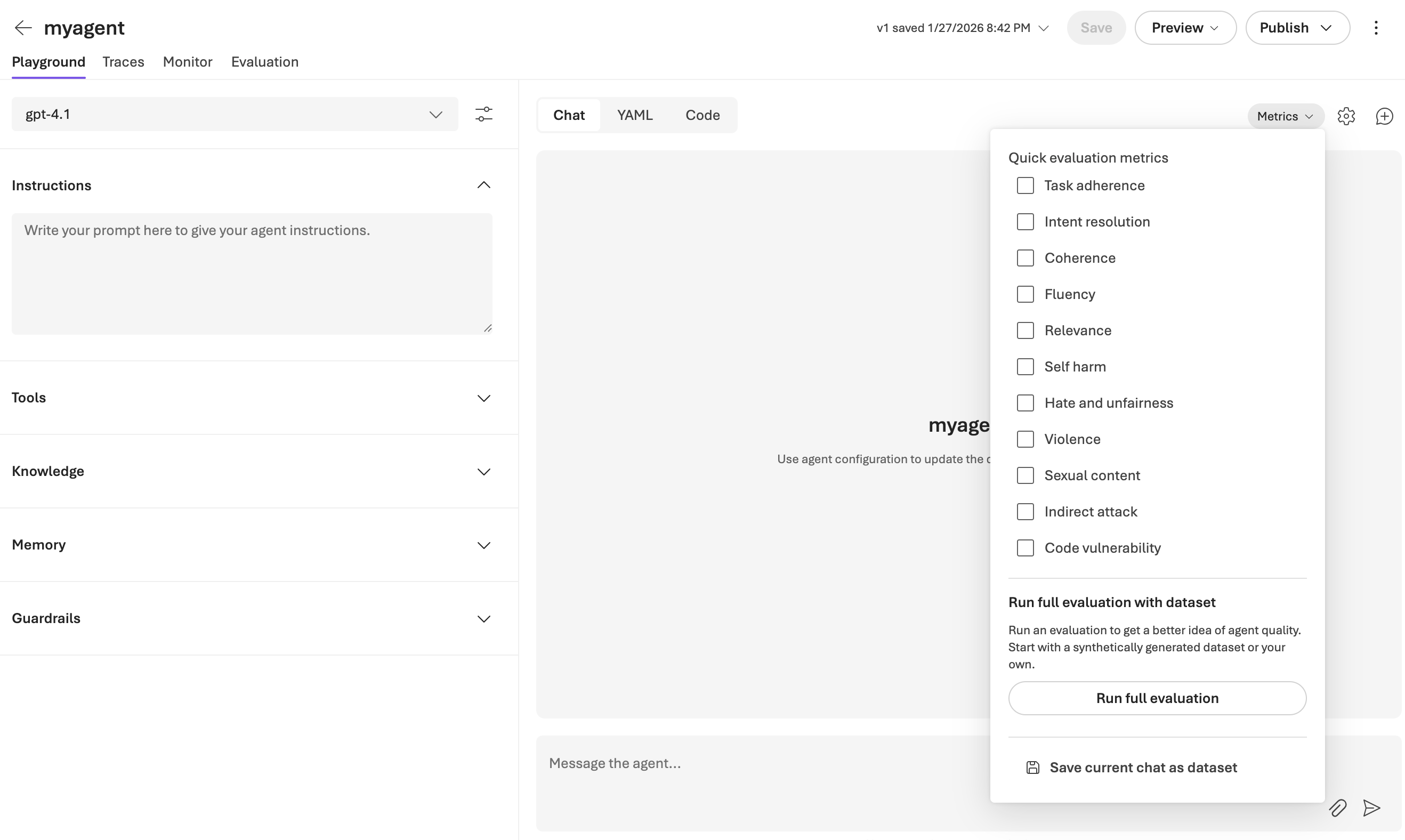

Funktionen zur Beobachtung wie z. B. Risiko- und Sicherheitsbewertungen und Bewertungen im Agent-Playground werden nach Verbrauch abgerechnet, wie in der Azure-Preisübersicht aufgeführt.

Wichtig

Auswertungen im Agents-Playground sind für alle Foundry-Projekte standardmäßig aktiviert und sind in verbrauchsbasierte Abrechnung enthalten. Wenn Sie die Bewertungen von Playground deaktivieren möchten, wählen Sie die Metriken oben rechts im Agent Playground aus, und heben Sie die Auswahl aller Bewerter auf.