Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Diese Techniken werden für Rechenmodelle wie gpt-5 und O-Serie Modelle nicht empfohlen.

Schnelles Bauen kann schwierig sein. In der Praxis wirkt die Eingabeaufforderung, um dem Modell zu helfen, die gewünschte Aufgabe abzuschließen, aber es ist eher eine Kunst als eine Wissenschaft, die oft Erfahrung und Intuition erfordert, um eine erfolgreiche Aufforderung zu erstellen. Das Ziel dieses Artikels ist es, Ihnen bei den ersten Schritten mit diesem Lernprozess zu helfen. In diesem Artikel wird versucht, allgemeine Konzepte und Muster zu erfassen, die für alle GPT-Modelle gelten. Es ist jedoch wichtig zu verstehen, dass sich jedes Modell anders verhält, sodass die Erkenntnisse möglicherweise nicht gleich auf alle Modelle angewendet werden.

Hinweis

Aktuelle API-Anleitungen und Beispiele finden Sie unter Responses API und Azure OpenAI in Microsoft Foundry Models API reference.

Grundlagen

In diesem Abschnitt werden die grundlegenden Konzepte und Elemente von GPT-Eingabeaufforderungen behandelt.

Textaufforderungen sind die Interaktion von Benutzern mit GPT-Modellen. Wie bei allen generativen Sprachmodellen versuchen GPT-Modelle, die nächste Reihe von Wörtern zu erzeugen, die höchstwahrscheinlich aus dem vorherigen Text folgen. Es ist so, als ob wir sagen , was ist das erste, das in Ihren Sinn kommt, wenn ich sage <prompt>? Die folgenden Beispiele veranschaulichen dieses Verhalten. Angesichts der ersten Worte berühmter Inhalte ist das Modell in der Lage, den Text genau fortzusetzen.

| Aufforderung | Abschluss |

|---|---|

| Vor vier und sieben Jahren haben wir | Väter brachten auf diesem Kontinent eine neue Nation hervor, gegründet in Freiheit und dem Grundsatz gewidmet, dass alle Menschen gleich geschaffen sind. […] |

| "Nennen Sie mich Ismael." | "Vor einigen Jahren – es spielt keine Rolle, wie lange genau – da ich wenig oder kein Geld in meinem Geldbeutel hatte und es nichts Besonderes an Land gab, das mich interessierte, dachte ich, ich würde ein wenig segeln und den wässrigen Teil der Welt sehen." |

Wenn Sie komplexere Eingabeaufforderungen entwickeln, ist es hilfreich, dieses grundlegende Verhalten im Auge zu behalten. Unabhängig von der bereitgestellten Aufforderung reagiert das Modell einfach mit dem wahrscheinlichsten Ergebnis, basierend auf seinen Schulungsdaten und -zielen. Wenn Sie eine Frage in Ihrer Eingabeaufforderung stellen, folgt das Modell nicht einem separaten F&A-Codepfad, sondern scheint die Frage zu beantworten, da eine Antwort die wahrscheinlichste Art der Antwort für die angegebene Frage als Eingabe ist.

Promptkomponenten

Wenn Sie die Completion-API verwenden und es zwischen den verschiedenen Teilen der Eingabeaufforderung keine Unterscheidung gibt, kann es dennoch hilfreich sein, die zugrunde liegenden Komponenten der Eingabeaufforderung zu identifizieren. Mit der Chat-Vervollständigungs-API gibt es unterschiedliche Abschnitte der Eingabeaufforderung, die in Form eines Arrays von Wörterbüchern mit zugehörigen Rollen an die API gesendet werden: System, Benutzer und Assistent. Dieser Leitfaden konzentriert sich im Allgemeinen darauf, wie Sie über die Erstellung von Aufforderungen nachdenken, anstatt präskriptive Anleitungen bereitzustellen, die für eine API für eine andere spezifisch sind.

Es ist auch wichtig zu verstehen, dass es zwar andere gültige Möglichkeiten geben könnte, Eingaben zu analysieren, aber das Ziel dieser Aufschlüsselung ist es, eine relativ einfache Möglichkeit zum Nachdenken über die Konstruktion von Eingaben zu bieten. Bei der Fertigstellungs-API sind alle Komponenten optional, aber mindestens eine muss vorhanden sein, und die meisten Eingabeaufforderungen enthalten mehr als eine Komponente. Es kann auch ein grauer Bereich zwischen Komponenten geben. Die unten dargestellte Reihenfolge entspricht ungefähr der Verwendung der einzelnen Komponenten von den meisten bis zu den geringsten Komponenten.

Anweisungen

Anweisungen sind wahrscheinlich die am häufigsten verwendete Eingabeaufforderungskomponente. Anweisungen sind einfach das: Anweisungen für das Modell, was zu tun ist. Obwohl sie einfach im Konzept sind, können sie in der Praxis komplex sein. In der folgenden Tabelle wird dies veranschaulicht, indem sowohl einfache als auch komplexere Anweisungen in zwei verschiedenen Formen dargestellt werden.

| Anweisungstyp | Aufforderung | Abschluss |

|---|---|---|

| Einfache Anweisungen | Schreiben Sie eine Einführung für einen wöchentlichen Newsletter. | Willkommen bei unserem wöchentlichen Newsletter. In dieser Woche haben wir einen besonderen Fokus auf Produktivität. Wir teilen Tipps und Tricks dazu, wie Sie in allen Bereichen Ihres Lebens produktiv sein können. Wir hoffen, dass Sie Spaß haben und teilen Sie sich bitte mit Ihren Freunden! |

| Komplexe Anweisungen | Schreiben Sie eine Einführung für einen wöchentlichen Newsletter für mein Unternehmen namens Contoso. Es sollte die große Mitarbeiterversammlung erwähnen, die wir letzte Woche hatten, und das Team für ihre harte Arbeit in den schwierigen vergangenen Monaten zu bedanken. | Willkommen beim wöchentlichen Newsletter von Contoso! Wir hatten letzte Woche eine großartige Gesamtmitarbeiterbesprechung und ich möchte dem Team für all ihre harte Arbeit in den letzten herausfordernden Monaten danken. Wir freuen uns auf eine vielversprechende Zukunft und ich bin zuversichtlich, dass wir mit dem Engagement und der Hingabe unseres Teams großartige Dinge erreichen werden. Vielen Dank, dass Sie Teil unseres Teams sind und ich freue mich darauf, in den kommenden Wochen und Monaten mit Ihnen zusammenzuarbeiten. Mit freundlichen Grüßen, [Ihr Name]. |

| Komplexe Anweisungen | Schreiben Sie eine Einführung für einen wöchentlichen Newsletter, einschließlich der folgenden: - "Mein Unternehmen" heißt "contoso". - Ein überschwänglicher Gruß - Vielen Dank an das Team für ihre harte Arbeit über ein paar harte Monate - Positive Aussichten für das kommende Quartal - Vom SLT signiert |

Hallo Contoso-Team! Ich wollte mir einen Moment Zeit nehmen, um Ihnen für all Ihre harte Arbeit in den vergangenen Monaten zu danken. Es war ein hartes Paar Monate, aber Du hast alle zusammengezogen und einen erstaunlichen Job gemacht. Ich bin wirklich stolz auf Sie alle. Wenn ich auf das nächste Quartal vorausschaue, fühle ich mich wirklich positiv. Ich denke, wir werden einige großartige Dinge erreichen. Vielen Dank, das Senior Leadership Team. |

Primärer Inhalt

Primärer Inhalt bezieht sich auf eine Art von Text, der vom Modell verarbeitet oder transformiert wird. Primärer Inhalt wird in der Regel in Verbindung mit Anweisungen verwendet. Ein einfaches Beispiel wäre eine Sprachübersetzung. Im folgenden Beispiel wird der englische Text als primärer Inhalt betrachtet, während "Übersetzen in Französisch:" eine Anweisung ist.

| Aufforderung | Abschluss |

|---|---|

| Können Sie mir bitte mitteilen, wie Sie zum Museum gelangen? Übersetzen in Französisch: |

Pouvez-vous s'il vous plaît me dire comment aller au musée? |

Primärer Inhalt kann auch viel länger sein. Im folgenden Beispiel ist der Hauptinhalt der Einführungsabschnitt des Wikipedia-Eintrags zur Zeitkomplexität, der fast 300 Wörter lang ist. Dieser Inhalt wird in unserer Tabelle gekürzt, um die Anzeige zu erleichtern.

| Aufforderung | Abschluss |

|---|---|

| In der Informatik ist die Zeitkomplexität die Rechenkomplexität, die die Computerzeit beschreibt, die zum Ausführen eines Algorithmus benötigt wird. Die Zeitkomplexität wird häufig geschätzt durch [...] Fassen Sie den vorherigen Text in einigen Sätzen zusammen: |

Die Zeitkomplexität ist ein Maß dafür, wie lange ein Algorithmus ausgeführt werden muss. Es wird in der Regel als Funktion der Größe der Eingabe ausgedrückt. Die am häufigsten verwendete Maßnahme ist die Zeitkomplexität im schlimmsten Fall, bei der die maximal benötigte Zeit für Eingaben einer bestimmten Größe bestimmt wird. |

In der Informatik ist die Zeitkomplexität die Rechenkomplexität, die die Computerzeit beschreibt, die zum Ausführen eines Algorithmus benötigt wird. Die Zeitkomplexität wird häufig geschätzt durch [...]TL;DR (Zu lange nicht gelesen) |

Die Zeitkomplexität eines Algorithmus ist die Zeit, die zum Ausführen eines Algorithmus benötigt wird. Die Zeitkomplexität wird häufig geschätzt, indem die Anzahl der elementaren Vorgänge gezählt wird, die vom Algorithmus ausgeführt werden, wobei vorausgesetzt wird, dass jeder elementare Vorgang eine feste Zeit für die Ausführung benötigt. Die Zeitkomplexität wird in der Regel als Funktion der Größe der Eingabe ausgedrückt. |

GPT-Modelle können auch primäre Inhalte verarbeiten, die strukturiert sind. Im folgenden Beispiel wird ein TSV über Biere in Belgien (abgekürzt für die Anzeige in diesem Artikel) als Teil der Eingabeaufforderung an das Modell übergeben. Es ist in der Lage, den Inhalt richtig zu interpretieren und Fragen zu den Daten zu beantworten.

| Aufforderung | Abschluss |

|---|---|

Belgian Beer Brands Beer name Beer style color ABV Brewery"Chimay Gold: ""Doree""" trappist pale ale gold 4.80% Chimay Brewery (official trappist)"Chimay Blue: ""Grande Reserve""" trappist dark ale dark 9.00%[…] Anhand der obigen Tabelle, wie viele Biere haben einen Alkoholgehalt von weniger als 6%? |

Es gibt 10 Biere in der Tabelle, die weniger als 6% ABV sind. |

Beispiele

Erfolgreiche Eingabeaufforderungen verlassen sich häufig auf die Praxis des "One-Shot"- oder "Few-Shot"-Lernens. Dies bezieht sich auf die Einbeziehung eines oder mehrerer Beispiele für das gewünschte Verhalten des Modells, in der Regel durch Einschließen von Eingabe- und Ausgabepaaren. Dies ist kein Lernen in dem Sinne, dass das Modell dauerhaft verändert wird, sondern dass die Beispiele das Modell besser darauf konditionieren, nur für die aktuelle Ableitung wie gewünscht zu reagieren. Die Verwendung von Eingabeaufforderungen ohne Beispiele wird manchmal als "Zero-Shot"-Lernen bezeichnet. Beachten Sie, dass mit der Chat-Vervollständigungs-API einige Lernbeispiele in der Regel dem Nachrichtenarray in Form von Beispiel-Benutzer-/Assistenteninteraktionen nach der anfänglichen Systemnachricht hinzugefügt werden.

| Lerntyp | Aufforderung | Abschluss |

|---|---|---|

| Nullschuss | Schlagzeile: Coach zuversichtlich, dass Verletzung die Warriors nicht entgleisen lässt Thema: |

Der Trainer ist zuversichtlich, dass die Verletzung die Saison der Warriors nicht entgleisen wird. Das Team konzentriert sich immer noch auf ihre Ziele und dass sie weiterhin hart arbeiten werden, um sie zu erreichen. |

| Wenige Aufnahmen | Schlagzeile: Correa von den Twins will Opt-Out nutzen und die freie Agentur testen Thema: Baseball Überschrift: Katar-Weltmeisterschaft wird Ausnüchterungszonen haben Thema: Fußball Schlagzeile: Yates: Fantasy-Football-Informationen für Woche 6 Thema: Fußball Schlagzeile: Coach zuversichtlich, dass Verletzung die Warriors nicht entgleisen lässt Thema: |

Basketball |

Im obigen Beispiel wird die Nützlichkeit des Few-Shot-Lernens veranschaulicht. Ohne die Beispiele scheint das Modell beim gewünschten Verhalten zu erraten, während in den Beispielen sauber gezeigt wird, wie das Modell funktioniert. Dies zeigt auch die Leistungsfähigkeit des Modells, es kann die Kategorie der gewünschten Bezeichnung, auch ohne eine "Basketball"-Bezeichnung in den Beispielen ableiten.

Hinweis

Cues fungieren als "Sprungstart" für die Ausgabe des Modells und helfen dabei, das Modell auf die gewünschte Ausgabe zu leiten. Häufig ist es ein Präfix, auf dem das Modell aufbauen kann. Im folgenden Beispiel zeigen wir den Hinweis, der die Geschichte lenkt, um wichtige Elemente einzubinden. Hinweise werden häufig zusammen mit Anweisungen verwendet, aber nicht immer. In den folgenden Beispielen wird das Modell verwendet, um eine lange Ankündigungs-E-Mail zusammenzufassen. Ein Signal wird in einem Fall verwendet, um die Ausgabe des Modells zu fokussieren, und im anderen, um ein bestimmtes Ausgabeformat (Aufzählungszeichen) vorzuschlagen.

Im Kontext der Anweisungen für die Chat-Vervollständigungs-API nimmt die Systemnachricht die Form an, und few-shot-Beispiele werden durch eine Reihe von Beispielinteraktionen zwischen Benutzer und Assistent dargestellt, um das Modell vorzubereiten.

| Anzahl der Signale | Aufforderung | Abschluss |

|---|---|---|

| 0 | Leistungsüberprüfungen sind eine Kernkomponente unseres Leistungs- und Entwicklungsansatzes bei Contoso. […] Fassen Sie die oben genannte E-Mail-Nachricht zusammen: |

Zweck dieser E-Mail ist es, Mitarbeiter über kürzlich vorgenommene Änderungen an der Leistungsüberprüfungserfahrung zu informieren, die Teil des Leistungs- und Entwicklungsansatzes von Contoso ist. Zu den Änderungen gehören eine verbesserte Struktur, ein Upgrade der In-Tool-Benutzeroberfläche und fokussierte Eingabeaufforderungen. Darüber hinaus gibt es jetzt einen optionalen Abschnitt "Conversation Starters", in dem Mitarbeiter Themen kennzeichnen können, die sie mit ihren Vorgesetzten besprechen möchten. |

| 1 | Leistungsüberprüfungen sind eine Kernkomponente unseres Leistungs- und Entwicklungsansatzes bei Contoso. […] Fassen Sie die oben genannte E-Mail-Nachricht zusammen: Die zentrale Erkenntnis der Nachricht ist |

dass Contoso die Leistungsprüfung verbessert, indem sie sich stärker auf die Wichtigsten Prioritäten, Erwartungen und Auswirkungen konzentriert. Darüber hinaus aktualisieren sie die In-Tool-Benutzeroberfläche mit Tipps, Ressourcen und Anleitungen. Schließlich fügen sie Anleitungen zum Aktivieren unternehmensweiter Kernprioritäten hinzu. |

| 2 | Leistungsüberprüfungen sind eine Kernkomponente unseres Leistungs- und Entwicklungsansatzes bei Contoso. […] Fassen Sie die oben genannte E-Mail-Nachricht zusammen: Wichtige Punkte: • |

Contoso führt Änderungen an der Erfahrung mit Leistungsüberprüfungen basierend auf dem Feedback von Mitarbeitern ein. • Die Änderungen umfassen einen neuen Fokus auf Kernprioritäten, Erwartungen und Auswirkungen; eine aktualisierte Benutzeroberfläche; und neue Leitlinien zu unternehmensweiten Kernprioritäten. • Leistungsüberprüfungen sind eine Zeit, um die bisherige Leistung und das Lernen zu reflektieren sowie zukünftige Prioritäten und Wachstumschancen zu planen. • Mitarbeiter und Vorgesetzte sollten vor der Leistungsüberprüfungsbesprechung Kommentare schreiben. • Es sollte mindestens zwei Leistungsüberprüfungen pro Jahr geben. • Die Zeitinvestitionen für jede Überprüfung sollten ungefähr gleich bleiben. |

Unterstützende Inhalte

Unterstützende Inhalte sind Informationen, die das Modell nutzen kann, um die Ausgabe auf irgendeine Weise zu beeinflussen. Es unterscheidet sich von primärem Inhalt darin, dass es sich nicht um das Hauptziel der Aufgabe handelt, sondern in der Regel zusammen mit primären Inhalten verwendet wird. Häufige Beispiele sind kontextbezogene Informationen wie das aktuelle Datum, der Name des Benutzers, Benutzereinstellungen usw. Im folgenden Beispiel werden unterstützende Inhalte verwendet, um eine Reihe geplanter Workshops für den Benutzer zu organisieren. Ohne die unterstützenden wichtigen Themen listet das Modell einfach die Workshops auf (abgeschnitten für die Anzeige), wenn das Modell über meine wichtigen Themen informiert ist, kann es die Besprechungen korrekt gruppieren.

| Unterstützende Inhalte | Aufforderung | Abschluss |

|---|---|---|

| Ohne | Workshopliste: Titelbeschreibung Kickoff für den Planungsworkshop Bitte nehmen Sie teil, um unseren Workshop zu starten! Hören Sie von unseren Führungskräften über gruppenübergreifende Prioritäten und Erkenntnisse für das kommende Jahr. Die Einladung zu dieser Veranstaltung wurde bereits an alle in [...] Fassen Sie die obigen Workshops zusammen, gruppiert nach Thema: |

Workshopliste: Einleitungsveranstaltung zum Planungsworkshop -Planungsworkshop Abschluss - Core MeetUp - Kundengesteuerte Perspektiven -Auswirkungen und Wichtige Fokusbereiche Bewährte Methoden -Beschleunigung der App-Einführung [...] |

| Mit | Workshopliste: Titelbeschreibung Kickoff für den Planungsworkshop Bitte nehmen Sie teil, um unseren Workshop zu starten! Hören Sie von unseren Führungskräften über gruppenübergreifende Prioritäten und Erkenntnisse für das kommende Jahr. Die Einladung zu dieser Veranstaltung wurde bereits an alle in [...] Meine wichtigen Themen: Prompt Engineering, Suche, GPT-Modelle Fassen Sie die oben aufgeführten Workshops zusammen, gruppiert nach meinen wichtigen Themen: |

1. Prompt-Entwicklung: - Neue Tipps für das Prompt-Engineering Die Kunst des Prompt-Engineering 2. Suche: -Einführung in die Vektorsuche mit Einbettung 3. GPT-Modelle: - Einführung in GPT-4 - GPT-35-Turbo eingehend. |

Szenariospezifische Anleitungen

Die in diesem Abschnitt beschriebenen Techniken zeigen Ihnen Strategien zur Erhöhung der Genauigkeit und Verankerung von Antworten, die Sie mit einem großen Sprachmodell (LLM) generieren. Es ist jedoch wichtig zu beachten, dass Sie auch dann, wenn Sie prompt engineering effektiv verwenden, die Antworten, die die Modelle generieren, überprüfen müssen. Da eine sorgfältig gestaltete Eingabeaufforderung für ein bestimmtes Szenario gut funktioniert hat, bedeutet dies nicht unbedingt, dass sie breiter auf bestimmte Anwendungsfälle verallgemeinert wird. Das Verständnis der Grenzen von LLMs ist ebenso wichtig wie das Verständnis, wie sie ihre Stärken nutzen können.

Dieses Handbuch befasst sich nicht mit den Mechanismen hinter der Nachrichtenstruktur für Chatabschlusse. Wenn Sie nicht mit der programmgesteuerten Interaktion mit Chatabschlussmodellen vertraut sind, empfehlen wir, zuerst unsere Anleitung zur Chatabschluss-API zu lesen.

Hinweis

Alle Beispiele in diesem Abschnitt des Leitfadens wurden auf ein Basis-GPT-4-Modell in Englisch getestet. Einige Techniken können unterschiedliche Ergebnisse mit neueren Modellen wie gpt-4.1 und gpt-4.5 produzieren. Wenn Sie eine lokalisierte Version dieses Artikels in einer anderen Sprache lesen, stellen diese Antworten eine lokalisierte Übersetzung der englischen Ergebnisse dar. Wenn Sie mehr über mögliche Einschränkungen erfahren möchten, je nachdem, welche Sprache Sie verwenden, um ein Modell einzufordern, lesen Sie unseren Hinweis zur Verantwortlichen KI-Transparenz.

Wenig aufgenommenes Lernen

Eine gängige Methode zum Anpassen von Sprachmodellen an neue Aufgaben ist die Verwendung von wenigen Lernvorgängen. In wenigen Schritten wird eine Reihe von Schulungsbeispielen als Teil der Aufforderung bereitgestellt, dem Modell zusätzlichen Kontext zu geben.

Bei Verwendung der Chat-Vervollständigungs-API kann eine Reihe von Nachrichten zwischen dem Benutzer und dem Assistenten (geschrieben im neuen Eingabeaufforderungsformat) als Beispiele für wenige Lerninhalte dienen. Diese Beispiele können verwendet werden, um das Modell zu primieren, um auf eine bestimmte Weise zu reagieren, bestimmte Verhaltensweisen zu emulieren und Antworten auf häufig gestellte Fragen zu erstellen.

| Systemnachricht | Few-Shot-Beispiele |

|---|---|

| Assistent ist ein intelligenter Chatbot, der benutzern dabei hilft, ihre steuerbezogenen Fragen zu beantworten. Anweisungen - Beantworten Sie nur Fragen im Zusammenhang mit Steuern. - Wenn Sie sich bei einer Antwort nicht sicher sind, können Sie "Ich weiß es nicht" oder "Ich bin nicht sicher" sagen und den Benutzern empfehlen, die IRS-Website zu besuchen, um weitere Informationen zu erhalten. |

Benutzer : "Wann muss ich meine Steuern einreichen?" Assistent - "Im Jahr 2023 müssen Sie Ihre Steuern bis zum 18. April einreichen. Das Datum fällt nach der üblichen 15. April-Frist, da der 15. April 2023 auf einen Samstag fällt. Weitere Informationen finden Sie unter https://www.irs.gov/filing/individuals/when-to-file " Benutzer - "Wie kann ich den Status meiner Steuererstattung überprüfen?" Assistent - "Sie können den Status Ihrer Steuererstattung durch Besuch https://www.irs.gov/refunds überprüfen" |

Die Tabelle oben beschreibt die grundlegende Eingabeaufforderungsstruktur. Für eine ausführliche Erklärung des genauen Eingabeaufforderungsformats sollten Sie den Leitfaden für Chat-Abschlüsse konsultieren.

Szenarien ohne Chat

Während die Chat-Vervollständigungs-API darauf optimiert ist, mit mehrstufigen Unterhaltungen zu arbeiten, kann sie auch in anderen Szenarien außerhalb des Chat-Dialogs verwendet werden. Für ein Szenario zur Stimmungsanalyse können Sie beispielsweise die folgende Eingabeaufforderung verwenden:

| Systemnachricht | Benutzer | Assistent |

|---|---|---|

| Sie sind ein Assistent, der die Stimmung aus Sprachdaten analysiert. Benutzer fügen eine Textzeichenfolge ein, und Sie antworten mit einer Bewertung der Antwort des Sprechers. Rate auf einer Skala von 1-10 (10 ist am höchsten). Erklären Sie, warum diese Bewertung erteilt wurde. | Hallo, danke, dass Sie die Contoso Apotheke anrufen. Mit wem spreche ich heute? Ich verstehe Ihre Frustration, Mary. Können Sie mir sagen, was genau Sie zu erreichen versuchen? OK, natürlich, gerne überprüfe ich das für Sie. Einen Moment bitte. Ich sehe hier, dass Sie eine generische Form von Lipitor eingenommen haben, stimmt das? OK, also ich sehe, dass Ihr Arzt Ihnen diese Medikamente tatsächlich im Jahr 2021 abgesetzt hat. OK, ja, ich überprüfe das gerne für Sie, da es manchmal eine Lücke im System gibt und es einfach nicht gemeldet wird. Lassen Sie mich einen Blick darauf werfen, einen Moment bitte. Ich sehe hier, dass Ihr Arzt Ihnen diese Medikamente von 2012 bis 2021 verschrieben hat. OK, laut den neuesten Datensätzen aus der Arztpraxis sind Sie jetzt auf einem anderen Medikament, Metformin. Möchten Sie, dass wir dieses Rezept für Sie ausfüllen, damit Sie es abholen können, in einer Dosierung von 500 Milligramm? Sie sind sehr willkommen, Mary. Teilen Sie uns bitte mit, ob es etwas anderes gibt, das wir heute für Sie tun können. | Stimmungsbewertung: 8 Der Sprecher in diesem Text scheint höflich, hilfreich und geduldig zu sein, während er die Bedenken des Kunden anspricht. Sie nehmen sich zeit, um die Informationen zu überprüfen, klare Erklärungen bereitzustellen und Unterstützung anzubieten. Die Bewertung ist jedoch keine 10, da es in einigen Teilen der Unterhaltung noch einen Hinweis auf Unsicherheit gibt, was dem Kunden möglicherweise nicht vollständiges Vertrauen vermittelt. |

Beginnen Sie mit klaren Anweisungen

Die Sequenzinformationen werden in der Aufforderung angezeigt. Dies liegt daran, dass GPT-Stilmodelle auf eine bestimmte Weise erstellt werden, die definiert, wie sie die Eingabe verarbeiten. Unsere Forschung legt nahe, dass es hilfreich sein kann, dem Modell die Aufgabe am Anfang der Eingabeaufforderung zu nennen, die es ausführen soll, bevor man zusätzliche kontextbezogene Informationen oder Beispiele bereitstellt, um qualitativ hochwertige Ausgaben zu erzeugen.

Hinweis

Obwohl das Folgen dieser Technik im Allgemeinen weiterhin empfohlen wird, zeigten unsere Tests im Gegensatz zu früheren Modellversionen (GPT-3 und früher), dass die Modellantwort mit ChatGPT- und GPT-4-Modellen unabhängig davon, ob die Technik verwendet wird, identisch war. In diesem Beispiel sehen wir, dass die Aussage "Mehrere Quellen… "Ausbruch" am Anfang oder Ende des Prompts hat keine Änderung der finalen Modellantwort verursacht.

| Systemnachricht | Benutzer | Assistent |

|---|---|---|

| Sie sind ein KI-Assistent, der Personen hilft, Informationen zu finden. | Ihre Aufgabe besteht darin, zu überprüfen, ob die Anweisung "Mehrere Quellen erwähnen eine Chance eines anderen großen Ausbruchs" durch ein bestimmtes Zitat aus den folgenden Codeausschnitten unterstützt wird. --- SNIPPETS [1] 14 Prozent Wahrscheinlichkeit, dass ein Megabeben Seattle trifft, sagen Experten. SEATTLE - Es gibt eine Wahrscheinlichkeit von 14 Prozent, dass ein Erdbeben der Größenordnung 9 Cascadia in den nächsten 50 Jahren Seattle treffen kann, schätzt der U.S. Geological Survey. "Leider können wir nicht... [2] Erdbebenexperten legen die neuesten Aussichten für Seattles "Really Big One" fest "Wir sagen, dass es in den nächsten 50 Jahren ungefähr eine 14% Chance auf ein weiteres Erdbeben der Größenordnung 9 gibt", sagte ein Geophysiker an der University of Washington... --- Wird die Aussage "Mehrere Quellen erwähnen eine Chance auf einen anderen großen Ausbruch" direkt impliziert oder von den Codeausschnitten angegeben? |

Nein, die Aussage wird nicht direkt impliziert oder in den Codeausschnitten genannt. Die Textausschnitte erwähnen eine Chance auf ein "Mega-Erdbeben" und ein "Magnitude-9-Erdbeben in der Cascadia-Subduktionszone" in den nächsten 50 Jahren in Seattle, erwähnen aber keine Chance auf einen anderen großen Ausbruch. |

Wiederholen Sie die Anweisungen am Ende

Modelle können anfällig für Reency-Bias sein, was in diesem Zusammenhang bedeutet, dass Informationen am Ende der Eingabeaufforderung möglicherweise erheblicher Einfluss auf die Ausgabe haben als Informationen am Anfang der Eingabeaufforderung. Daher lohnt es sich, die Anweisungen am Ende der Eingabeaufforderung zu wiederholen und die Auswirkungen auf die generierte Antwort zu bewerten.

Die Ausgabe vorbereiten

Dies bezieht sich auf das Einschließen einiger Wörter oder Ausdrücke am Ende der Eingabeaufforderung, um eine Modellantwort zu erhalten, die dem gewünschten Formular folgt. Wenn Sie beispielsweise einen Hinweis wie “Here’s a bulleted list of key points:\n- ” verwenden, kann dies helfen, sicherzustellen, dass die Ausgabe als Liste mit Aufzählungszeichen formatiert ist.

| Systemnachricht | Benutzer | Assistent |

|---|---|---|

| Sie sind ein KI-Assistent, der Personen hilft, Informationen zu finden. Antworten Sie mit so wenigen Wörtern wie möglich. | John Smith ist verheiratet mit Lucy Smith. Sie haben fünf Kinder, und er arbeitet als Softwareingenieur bei Microsoft. Welche Suchabfragen sollte ich tun, um dies zu überprüfen? ## Eine mögliche Suchabfrage ist: | "John Smith heiratete Lucy Smith fünf Kinder Softwaretechniker Microsoft" |

In der obigen Eingabeaufforderung bereitet der Text One possible search query is: das Modell darauf vor, eine einzige Ausgabe zu erzeugen. Ohne diesen Hinweis erzeugt das Modell mehrere Suchabfragen als Ergebnisse.

Hinzufügen einer klaren Syntax

Verwenden Sie eine klare Syntax für ihre Eingabeaufforderung, um Absichten zu kommunizieren und die Analyse von Ausgaben zu vereinfachen.

Im folgenden Beispiel wurden Trennzeichen (--- in diesem Fall) zwischen verschiedenen Informationsquellen oder Schritten hinzugefügt. Dies ermöglicht die Verwendung von --- als Stoppbedingung für die Generierung. Darüber hinaus werden Abschnittsüberschriften oder spezielle Variablen in Großbuchstaben dargestellt, um sie zu unterscheiden.

| Systemnachricht | Benutzer | Assistent |

|---|---|---|

| Sie sind ein KI-Assistent, der Personen hilft, Informationen zu finden. | Sie lesen einen Absatz und stellen dann Abfragen an eine Suchmaschine aus, um ihn zu überprüfen. Erläutern Sie auch die Abfragen. --- ABSATZ John Smith ist verheiratet mit Lucy Smith. Sie haben fünf Kinder, und er arbeitet als Softwareingenieur bei Microsoft. Welche Suchabfragen sollte ich tun, um dies zu überprüfen? --- ABFRAGEN |

1. "John Smith Microsoft" - Um zu überprüfen, ob John Smith tatsächlich bei Microsoft beschäftigt ist. 2. "John Smith Lucy Smith" - Um zu überprüfen, ob John Smith mit Lucy Smith verheiratet ist. 3. "John Smith Children" - Um zu überprüfen, ob John Smith fünf Kinder hat. |

Wenn Sie nicht sicher sind, welche Syntax sie verwenden soll, sollten Sie Markdown oder XML verwenden. Die Modelle wurden auf einem großen Webinhalt in XML und Markdown trainiert, was bessere Ergebnisse liefern kann.

Aufschlüsseln des Vorgangs

Große Sprachmodelle (LLMs) führen häufig besser aus, wenn die Aufgabe in kleinere Schritte unterteilt wird. Beispielsweise kann in der Suchabfrageaufforderung, auf die zuvor verwiesen wird, die Eingabeaufforderung umstrukturiert werden, sodass das Modell zuerst angewiesen wird, relevante Fakten zu extrahieren, und dann angewiesen, Suchabfragen zu generieren, die verwendet werden können, um diese Fakten zu überprüfen.

| Systemnachricht | Benutzer | Assistent |

|---|---|---|

| Sie sind ein KI-Assistent, der Personen hilft, Informationen zu finden. | Sie lesen einen Absatz und stellen dann Abfragen an eine Suchmaschine aus, um ihn zu überprüfen. --- ABSATZ John Smith ist verheiratet mit Lucy Smith. Sie haben fünf Kinder, und er arbeitet als Softwareingenieur bei Microsoft. Welche Suchabfragen sollte ich tun, um dies zu überprüfen? --- Jetzt extrahieren Sie faktenbezogene Ansprüche und stellen Abfragen zur Faktenüberprüfung aus. Verwenden Sie beim Ausgeben einer Abfrage die Funktion SEARCH("abfrage") FAKTENANSPRÜCHE |

1. John Smith ist verheiratet mit Lucy Smith 2. Sie haben fünf Kinder 3. Er arbeitet als Softwareingenieur bei Microsoft ABFRAGEN SEARCH("John Smith heiratete Lucy Smith") SEARCH("John Smith Familiengröße") SEARCH("John Smith Microsoft Softwaretechniker") |

Beachten Sie die Verwendung einer klaren Syntax, um die Abschnitte zu unterscheiden und die Ausgabe zu primieren. In diesem einfachen Beispiel ist das Aufteilen der Aufgabe von 1 bis zwei Schritten nicht sehr dramatisch, aber wenn Sie versuchen, dies für einen größeren Textabschnitt mit vielen faktenbezogenen Ansprüchen zu tun, kann das Aufteilen der Aufgabe einen erheblichen Unterschied ausmachen.

Nutzung von Handlungsmöglichkeiten

Manchmal können wir das Modell veranlassen, eine Affordanz zu verwenden, anstatt sich auf seine eigenen Parameter für Informationen und Antworten zu verlassen. Die Suche kann z. B. eine Möglichkeit sein, um gefälschte Antworten zu vermeiden und aktuelle Informationen zu erhalten.

Eine einfache Möglichkeit, eine Affordanz zu verwenden, besteht darin, die Generierung zu stoppen, sobald die Affordanzen vom Modell generiert werden, und die Ergebnisse wieder in die Eingabeaufforderung einzufügen. Nachfolgend finden Sie ein Beispiel dafür, was der Nachverfolgungsaufruf nach den oben genannten SEARCH-Aufrufen sein könnte. Beachten Sie, wie wir die Suchergebnisse in die Eingabeaufforderung eingefügt und die vorherigen SEARCH-Aufrufe ersetzt haben.

| Systemnachricht | Benutzer | Assistent |

|---|---|---|

| Sie sind ein KI-Assistent, der Personen hilft, Informationen zu finden. | Sie lesen einen Absatz, extrahieren Faktenansprüche und verwenden dann Suchmaschinenergebnisse, um sie zu überprüfen --- ABSATZ John Smith ist verheiratet mit Lucy Smith. Sie haben fünf Kinder, und er arbeitet als Softwareingenieur bei Microsoft. Welche Suchabfragen sollte ich tun, um dies zu überprüfen? --- FAKTENANSPRÜCHE - John Smith ist verheiratet mit Lucy Smith - John und Lucy haben fünf Kinder - John arbeitet als Softwareingenieur bei Microsoft --- Hier sind verschiedene Suchabfragen, die zur Recherche der oben genannten Ansprüche ausgestellt wurden: SUCHABFRAGEN - John Smith verheiratet mit Lucy Smith - John Smith Anzahl der Kinder - John Smith, Software-Engineer, Microsoft --- Hier sind Codeausschnitte der Suchergebnisse: SNIPPETS: [1] … John Smiths Hochzeit war am 25. September 2012 ... [2] … John Smith wurde von seiner Frau Lucy zu einer Party begleitet. [3]John wurde von seinen beiden Töchtern und drei Söhnen zum Fußballspiel begleitet. [4] … Nach 10 Jahren bei Microsoft gründete Smith sein eigenes Startup Tailspin Toys [5] John M ist der Stadtschmied, und er heiratete Fiona. Sie haben eine Tochter namens Lucy --- Überprüfen Sie anhand der Textausschnitte jede der oben genannten Tatsachenbehauptungen: |

- John Smith ist verheiratet mit Lucy Smith: Bestätigt. Codeausschnitt [1] und [2] erwähnen John Smiths Frau als Lucy. - John und Lucy haben fünf Kinder: Bestätigt. Codeausschnitt [3] erwähnt, dass John von seinen beiden Töchtern und drei Söhnen begleitet wurde. - John arbeitet als Softwareingenieur bei Microsoft: Teilweise bestätigt. Codeausschnitt [4] erwähnt, dass John 10 Jahre bei Microsoft verbracht hat, aber es gibt nicht explizit an, dass er derzeit dort arbeitet. Weitere Untersuchungen könnten erforderlich sein, um seinen aktuellen Beschäftigungsstatus zu bestätigen. |

Kette der Gedankenaufforderung

Wichtig

Diese Technik gilt nur für Nicht-Reasoning-Modelle. Das Extrahieren der Modellbegründung durch andere Methoden als den Zusammenfassungsparameter der Begründung wird nicht unterstützt, könnte gegen die Richtlinie für zulässige Verwendung verstoßen und zu Drosselung oder Aussetzung führen, wenn dies erkannt wird.

Dies ist eine Variante der Aufgabe in kleinere Schritte zu unterteilen-Technik. Anstatt eine Aufgabe in kleinere Schritte aufzuteilen, wird in diesem Ansatz die Modellantwort angewiesen, schrittweise fortzufahren und alle beteiligten Schritte darzustellen. Dadurch wird die Möglichkeit der Ungenauigkeit von Ergebnissen reduziert und die Bewertung der Modellantwort vereinfacht.

| Systemnachricht | Benutzer | Assistent |

|---|---|---|

| Sie sind ein KI-Assistent, der Personen hilft, Informationen zu finden. | Wer war der am meisten dekorierte (maximale Medaillen) Einzelsportler in den Olympischen Spielen, die in Sydney stattfanden? Führen Sie einen schrittweisen Ansatz in Ihrer Antwort aus, zitieren Sie Quellen, und geben Sie Argumente, bevor Sie die endgültige Antwort im folgenden Format freigeben: ANTWORT lautet: <name> |

Schritt 1: Bestimmen Sie das Jahr der Olympischen Spiele in Sydney. Die Olympischen Spiele in Sydney fanden im Jahr 2000 statt. Schritt 2: Finden Sie eine Liste einzelner Athleten, die mehrere Medaillen in den Olympischen Spielen 2000 in Sydney gewonnen haben. Laut der offiziellen Website der Olympischen Spiele gab es mehrere Einzelsportler, die mehrere Medaillen in den Olympischen Spielen 2000 in Sydney gewannen. Einige der bemerkenswerten Namen sind: • Ian Thorpe (Australien) - 3 Gold, 2 Silber, 0 Bronze • Pieter van den Hoogenband (Niederlande) - 2 Gold, 0 Silber, 2 Bronze • Lenny Krayzelburg (USA) - 3 Gold, 0 Silber, 0 Bronze • Inge de Bruijn (Niederlande) - 3 Gold, 1 Silber, 0 Bronze Schritt 3: Bestimmen Sie den Sportler mit den meisten Medaillen. Nachdem wir die Liste der einzelnen Athleten überprüft haben, die mehrere Medaillen in den Olympischen Spielen 2000 in Sydney gewonnen haben, können wir sehen, dass der Sportler mit den meisten Medaillen Ian Thorpe aus Australien ist, der insgesamt 5 Medaillen gewann (3 Gold und 2 Silber). Deshalb lautet die ANTWORT: Ian Thorpe. |

Angeben der Ausgabestruktur

Wenn Sie Ihre Eingabeaufforderung verwenden, um die Struktur der Ausgabe anzugeben, kann sich dies erheblich auf die Art und Qualität der Ergebnisse auswirken. Manchmal sind Systemnachrichteneingaben als "nur echte Fakten schreiben" oder "Keine Informationen erstellen" möglicherweise keine angemessenen Gegenmaßnahmen. Stattdessen kann die Aufforderung zur Modellantwort, auch Zitate einzubeziehen, dazu beitragen, die Prävalenz falscher Antworten zu verringern.

Wenn Sie das Modell anweisen, das Quellmaterial bei Äußerungen zu zitieren, sind diese Aussagen viel eher fundiert. Wenn Sie nach Zitaten fragen, muss das Modell jedes Mal zwei Fehler ausführen, wenn eine Antwort generiert wird: Der erste Fehler ist die erstellte Antwort, und das zweite ist das schlechte Zitat. Beachten Sie, dass je näher das Zitat am unterstützten Text ist, desto weniger weit im Voraus das Modell die Zitation antizipieren muss. Dies deutet darauf hin, dass Inlinezitationen wirksamere Maßnahmen gegen die Erzeugung falscher Inhalte sind als Zitationen am Ende des Inhalts.

Wenn Sie das Modell bitten, faktenbezogene Aussagen aus einem Absatz zu extrahieren, kann es zusammengesetzte Aussagen wie "X macht Y UND Z" extrahieren, was möglicherweise schwerer zu überprüfen ist. Dies kann vermieden werden, indem eine Ausgabestruktur angegeben wird, z. B. (Entität1, Beziehung, Entität2).

In diesem Beispiel wird die Verwendung von Zitaten veranschaulicht und die Modellantwort an eine definierte Struktur angepasst.

| Systemnachricht | Benutzer | Assistent |

|---|---|---|

| Sie sind ein KI-Assistent, der Personen hilft, Informationen zu finden | Führen Sie die verschiedenen Verhaltensweisen des Kundensupportmitarbeiters in der folgenden Unterhaltung auf. --- Hallo, danke, dass Sie die Contoso Apotheke anrufen. Mit wem spreche ich heute? Ich verstehe Ihre Frustration, Mary. Können Sie mir sagen, was genau Sie zu erreichen versuchen? OK, natürlich, gerne überprüfe ich das für Sie. Einen Moment bitte. Ich sehe hier, dass Sie eine generische Form von Lipitor eingenommen haben, stimmt das? OK, also ich sehe, dass Ihr Arzt Ihnen diese Medikamente tatsächlich im Jahr 2021 abgesetzt hat. OK, ja, ich überprüfe das gerne für Sie, da es manchmal eine Lücke im System gibt und es einfach nicht gemeldet wird. Lassen Sie mich einen Blick darauf werfen, einen Moment bitte. Ich sehe hier, dass Ihr Arzt Ihnen diese Medikamente von 2012 bis 2021 verschrieben hat. OK, laut den neuesten Datensätzen aus der Arztpraxis sind Sie jetzt auf einem anderen Medikament, Metformin. Möchten Sie, dass wir dieses Rezept für Sie ausfüllen, damit Sie es abholen können, in einer Dosierung von 500 Milligramm? Sie sind sehr willkommen, Mary. Teilen Sie uns bitte mit, ob es etwas anderes gibt, das wir heute für Sie tun können. --- Wie war die Antwort des Kundensupportmitarbeiters? Klassifizieren und Auflisten der verschiedenen Verhaltensweisen und Zitieren des Grunds hinter der Klassifizierung unter Verwendung des Formats BEHAVIOR("Reason") |

1. Höfliches Grußverhalten("Agent startet die Unterhaltung mit einer höflichen Begrüßung und fragt nach dem Namen des Anrufers"). 2. Empathisches VERHALTEN("Agent erkennt Marys Frustration an und versucht, ihre Sorge zu verstehen") 3. Aufmerksames VERHALTEN("Agent lauscht auf das Problem des Kunden und fordert weitere Details") 4. Proaktives VERHALTEN("Agent bietet an, das Problem für den Kunden zu überprüfen") 5. Informatives VERHALTEN("Agent liefert die relevanten Informationen zum Verschreibungsverlauf des Kunden") 6. Gründliches VERHALTEN("Agent prüft alle möglichen Lücken im System und liefert eine vollständige Antwort") 7. Bestätigendes VERHALTEN("Agent bestätigt das aktuelle Medikament mit dem Kunden") 8. Lösungsorientiertes VERHALTEN("Agent bietet an, das neue Rezept für den Kunden auszufüllen") 9. Höfliches VERHALTEN("Agent danke dem Kunden und bietet bei Bedarf weitere Unterstützung") |

| Systemnachricht | Benutzer | Assistent |

|---|---|---|

| Sie sind ein KI-Assistent, der Personen hilft, Informationen zu finden. | Gruppieren Sie die folgenden Schlagzeilen in Themenkategorien basierend auf Mustern, die im Text zu sehen sind. Erwähnen Sie auch die Gründe für die Definition dieser Kategorien. Ausgabeformat: { "TOPIC_NAME": "", "SCHLAGZEILEN": [], "REASONING": "Begründung" } Überschriften für Eingabenachrichten: "Von Büchern zu Präsentationen innerhalb von 10 Sekunden mit AR + ML" 2. "Demo von 1993 eines 32-jährigen Yann LeCun, der das weltweit erste Konvolutionale Netzwerk für Texterkennung vorstellt"3. "First Order Motion Model angewendet, um Gemälde zu animieren" 4. "Robinhood und andere Broker sperren buchstäblich den Kauf von $GME, $NOK, $BB, $AMC; Verkäufe zulassen" 5. "Die Aktie von United Airlines ist im vorbörslichen Handel um über 5% gefallen." Ausgabe: |

{ "KÜNSTLICHE_INTELLIGENZ": { "SCHLAGZEILEN": [ Von Büchern zu Präsentationen in 10 Sekunden mit AR + ML. Demo aus dem Jahr 1993 von einem 32-Jährigen Yann LeCun zeigt das weltweit erste konvolutionale Netzwerk zur Texterkennung."First Order Motion Model angewendet, um Gemälde zu animieren" ], "REASONING": "Diese Schlagzeilen beziehen sich auf künstliche Intelligenz, maschinelles Lernen und ihre Anwendungen in verschiedenen Bereichen." }, "FINANCIAL_MARKETS": { "SCHLAGZEILEN": [ "Robinhood und andere Makler blockieren buchstäblich den Kauf von $GME, $NOK, $BB, $AMC; Verkauf zulassen", Die Aktien von United Airlines sind im vorbörslichen Handel um über 5% gefallen. "Vor einem Jahr lag der Bitcoin-Preis bei fast 20.000 Dollar." ], "BEGRÜNDUNG": "Diese Schlagzeilen beziehen sich auf Finanzmärkte, Aktien, Kryptowährungen und Handelsplattformen." } } |

Temperatur und Top_p Parameter

Durch Ändern des Temperaturparameters wird die Ausgabe des Modells geändert. Der Temperaturparameter kann zwischen 0 und 2 festgelegt werden. Ein höherer Wert, z. B. 0,7, macht die Ausgabe zufälliger und erzeugt unterschiedliche Antworten, während ein niedrigerer Wert wie folgt aussieht. 0.2, macht die Ausgabe fokussierter und konkreter. Eine fiktive Geschichte könnte mit einer höheren Temperatur erzeugt werden. Um ein rechtliches Dokument zu erstellen, wird empfohlen, eine viel niedrigere Temperatur zu verwenden. Top_probability ist ein anderer Parameter und ähnelt der Temperatur, da sie auch die Zufallsart der Modellantwort steuert, aber dies auf andere Weise. Die allgemeine Empfehlung besteht darin, einen dieser beiden Parameter gleichzeitig zu ändern, nicht beide.

Bereitstellung eines grundlegenden Kontexts

Eine der effektivsten Möglichkeiten, zuverlässige Antworten zu liefern, besteht darin, dem Modell Daten zu geben, um daraus Antworten abzuleiten (Basisdaten). Wenn Ihr Anwendungsfall auf aktuelle, zuverlässige Informationen angewiesen ist und kein rein kreatives Szenario darstellt, empfehlen wir dringend die Bereitstellung von Grundlagendaten. Je näher Sie Ihr Quellmaterial an die endgültige Form der gewünschten Antwort bringen können, desto weniger Arbeit muss das Modell leisten, was zu weniger Fehlern führt. Hier ist ein Beispiel, bei dem dem System ein Blog zur Beschreibung der Freigabe von GPT-4 in Azure OpenAI in den Microsoft Foundry-Modellen bereitgestellt wird, und es aufgefordert wird, einige seiner frühen Kunden zu benennen.

| Systemnachricht | Benutzer | Assistent |

|---|---|---|

| Sie sind ein KI-Assistent, der Personen hilft, Informationen zu finden. Sie erhalten Antworten exklusiv aus dem folgenden Text und Sie antworten in 100 Wörtern oder weniger. Bei Microsoft entdecken wir ständig neue Möglichkeiten, Kreativität zu entfesseln, Produktivität zu steigern und Fähigkeiten weiterzuentwickeln, damit mehr Menschen von der Nutzung von KI profitieren können. Dies ermöglicht es unseren Kunden, ... … dadurch wird die Wahrscheinlichkeit verringert, dass das Modell eine schädliche Reaktion erzeugt." 1 Antworten Sie in 100 Wörtern oder weniger. Verwenden Sie aufzählungen, wo immer möglich. |

Wer sind einige der frühen Kunden der Azure OpenAI GPT-4 Modelle? | Hier sind einige der frühen Kunden der Azure OpenAI GPT-4 Modelle: - Epic Healthcare: Sie planen, GPT-4 zu verwenden, um Ärzten und Pflegekräften zu helfen, weniger Zeit für die Dateneingabe und Untersuchung zu verbringen. - Coursera: Sie verwenden Azure OpenAI mit GPT-4, um eine neue KI-basierte Lernerfahrung auf ihrer Plattform zu schaffen. - Coca-Cola: Sie nutzen Azure OpenAI, um einen Wissenshub aufzubauen und die multimodalen Funktionen von GPT-4 für Marketing, Werbung, Öffentlichkeitsarbeit und Kundenbeziehungen zu nutzen. - Andere Unternehmen aller Größen verwenden Azure KI, um Die Kundenerfahrungen zu verbessern, langfristige Inhalte zusammenzufassen, Software zu schreiben und Risiken zu reduzieren, indem sie die richtigen Steuerdaten vorhersagen. |

1 Text aus Azure OpenAI GPT-4 launch blog.

Bewährte Methoden

- Seien Sie spezifisch. Lassen Sie so wenig Spielraum für Interpretationen wie möglich. Beschränken Sie den Betriebsraum.

- Beschreibend sein. Verwenden Sie Analogien.

- Doppelt nach unten. Manchmal müssen Sie sich dem Modell gegenüber wiederholen. Geben Sie Anweisungen vor und nach Ihrem primären Inhalt, verwenden Sie eine Anweisung und einen Hinweis usw.

- Bestellung ist wichtig. Die Reihenfolge, in der Sie dem Modell Informationen präsentieren, kann sich auf die Ausgabe auswirken. Unabhängig davon, ob Sie Anweisungen vor Ihren Inhalten ("Zusammenfassen der folgenden...") oder nach ("Zusammenfassung der obigen...") eingeben, kann ein Unterschied bei der Ausgabe auftreten. Selbst die Reihenfolge von wenigen Beispielen kann wichtig sein. Dies wird als Reency-Bias bezeichnet.

- Geben Sie dem Modell ein "Out". Es kann manchmal hilfreich sein, dem Modell einen alternativen Pfad zuzuweisen, wenn die zugewiesene Aufgabe nicht abgeschlossen werden kann. Wenn Sie beispielsweise eine Frage über einen Text stellen, können Sie etwas wie "Antworten mit "Nicht gefunden" einschließen, wenn die Antwort nicht vorhanden ist. Dies kann dazu beitragen, dass das Modell keine falschen Antworten generiert.

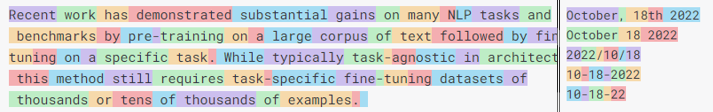

Raumeffizienz

Während die Eingabegröße bei jeder neuen Generation von GPT-Modellen zunimmt, gibt es weiterhin Szenarien, die mehr Daten bereitstellen, als das Modell verarbeiten kann. GPT-Modelle teilen Wörter in "Token" auf. Während häufige mehrsilbige Wörter oft in einem einzigen Token zusammengefasst werden, werden weniger häufige Wörter in einzelne Token zerlegt. Token können manchmal kontra intuitiv sein, wie im folgenden Beispiel gezeigt, in dem Tokengrenzen für verschiedene Datumsformate veranschaulicht werden. In diesem Fall ist es platzsparender, den gesamten Monat auszuschreiben, als ein vollständig numerisches Datum zu verwenden.

Angesichts dieses begrenzten Platzes ist es wichtig, es so effizient wie möglich zu verwenden.

- Tabellen – Wie in den Beispielen im vorherigen Abschnitt gezeigt, können GPT-Modelle tabellenformatierte Daten ganz einfach verstehen. Dies kann eine effiziente Möglichkeit sein, Daten einzuschließen, anstatt jedem Feld einen Namen (z. B. mit JSON) voranzugehen.

- Leerraum – Aufeinander folgende Leerzeichen werden als separate Token behandelt, was eine einfache Möglichkeit sein kann, Platz zu verschwenden. Leerzeichen vor einem Wort werden dagegen in der Regel als Teil desselben Tokens wie das Wort behandelt. Achten Sie sorgfältig auf die Verwendung von Leerzeichen und verwenden Sie keine Interpunktion, wenn ein Leerzeichen allein ausreicht.