Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Führen Sie die Tabellenwartung für Delta-Tabellen aus, um sie im Laufe der Zeit fehlerfrei zu halten, indem Sie kleine Dateien komprimieren, Leseoptimierungen anwenden und veraltete Dateien entfernen, auf die nicht mehr verwiesen wird.

Sie können Wartung entweder als Ad-hoc-Vorgang im Fabric-Portal (Lakehouse-Tabelle MaintenanceAktion) oder als geplanter und orchestrierter Prozess mithilfe von Notizbüchern, pipelines oder REST-API ausführen. Fabric Data Factory-Pipelines umfassen eine eigene Lakehouse-Wartungsaktivität (Vorschau), die OPTIMIZE (mit optionaler V-Order) und VACUUM auf Lakehouse Delta-Tabellen als Teil geplanter Pipeline-Workflows ausführen kann. Dieser Artikel konzentriert sich auf den Ad-hoc-Portalworkflow.

Anleitungen zur arbeitsübergreifenden Wartung, einschließlich Empfehlungen für SQL-Analyseendpunkt, Power BI Direct Lake und Data Warehouse Verbraucher, finden Sie unter Cross-Workload-Tabellenwartung und -optimierung. Für code-first Wartungsmuster, siehe Delta Lake-Tabellenoptimierung und V-Order und Verwalten Sie das Lakehouse mit der Microsoft Fabric REST-API.

Führen Sie die Tabellenwartung aus dem Lakehouse aus

Die Tabellenwartung im Lakehouse-System gilt ausschließlich für Delta-Tabellen. Ältere Hive-Tabellen, die Formate wie Parquet, ORC, AVRO oder CSV verwenden, werden nicht unterstützt.

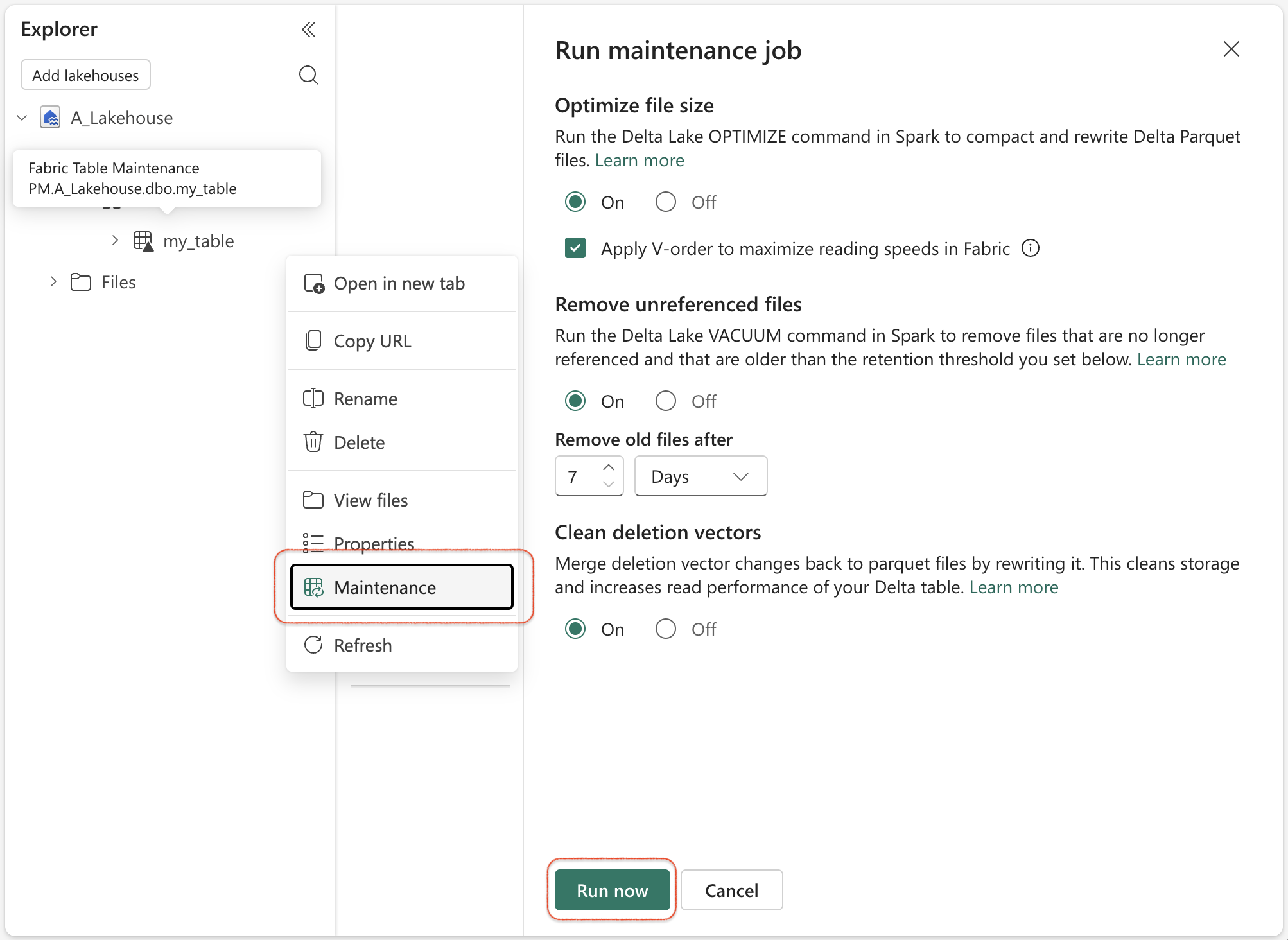

Wählen Sie im Dialogfeld "Wartungsbefehle ausführen " Optionen basierend auf Ihrem Ziel aus.

Führen Sie in der Regel Wartungsarbeiten nach größeren Datenimporten oder Aktualisierungsaktivitäten durch, oder wenn Sie viele kleine Dateien und verlangsamte Lesevorgänge beobachten.

Hinweis

Orchestrieren mit Pipelines: Verwenden Sie für wiederkehrende Wartungsaufträge die Lakehouse-Wartungsaktivität (Vorschau) in Fabric Data Factory-Pipelines. Sie macht dieselben Optionen (OPTIMIZE mit optionaler V-Reihenfolge, VAKUUM) verfügbar und lässt sich in andere Pipelineschritte durch Abhängigkeiten, Trigger und Parameter integrieren, sodass Sie die Wartung mit Datenladevorgängen verketten und eine Aktualisierungs-SQL-Endpunktaktivität in derselben Pipeline nachverfolgen können.

Navigieren Sie von Ihrem Microsoft Fabric Konto zum gewünschten Lakehouse.

Klicken Sie im Lakehouse Explorer unter Tabellen mit der rechten Maustaste auf die Zieltabelle (oder verwenden Sie das Dreipunktmenü).

Wählen Sie den Menüeintrag „Wartung“ aus.

Wählen Sie im Dialogfeld "Wartungsbefehle ausführen " die Wartungsoptionen aus:

Wählen Sie die Option Ein, um kleine Parquet-Dateien in größere Dateien zusammenzufassen, für effizientere Lesevorgänge.

Wenn aktiviert ist, können Sie auch das Kontrollkästchen "V-Reihenfolge übernehmen " aktivieren. Wenn Sie diese Option auswählen, wendet Fabric die V-Reihenfolge (optimierte Sortierung, Codierung und Komprimierung) als Teil der Optimierung an.

Hinweis

V-Order hat etwa 15% Auswirkungen auf durchschnittliche Schreibzeiten. Sie kann auch bis zu 50% mehr Komprimierung bereitstellen.

Wählen Sie die Option "Ein " aus, um den Befehl "Delta Lake

VACUUM" auszuführen und nicht referenzierte Dateien zu entfernen, die älter als Ihr Aufbewahrungsschwellenwert sind. Informationen zu Aufbewahrungsverhalten und Sicherheitsdetails finden Sie unter Vakuumaufbewahrungseinstellungen.Wählen Sie die Option „Ein“, um Transaktionen in Parquet-Dateien zusammenzuführen und die zusätzlichen Löschvektordateien zu entfernen, Speicher freizugeben und Tabellenlesevorgänge zu optimieren.

Wählen Sie Jetzt ausführen aus, um den Tabellenwartungsauftrag auszuführen.

Nachverfolgen der Auftragsausführung an einer der folgenden Stellen:

- Benachrichtigungsbereich (Glockensymbol im Fabric-Portalheader) für sofortigen Ausführungsstatus.

-

Überwachungshub (wählen Sie im linken Navigationsbereich Monitor) aus, um vollständige Auftragsdetails anzuzeigen. Suchen Sie nach Aktivitäten, deren Name

TableMaintenanceenthält, für vom Portal initiierte Ausführungen. Um die Fabric Data Factory-Pipelines zu warten, suchen Sie den Pipeline-Lauf in der Ansicht Monitoring hub > Pipelines und filtern Sie nach dem Namen der Lakehouse-Maintenance-Aktivität.

Nachdem Sie die Wartung ausgeführt haben, wird der Erfolg als abgeschlossene Tabellenwartungsaktivität in Benachrichtigungen und als erfolgreicher TableMaintenance Eintrag im Monitoring Hub angezeigt.

Weitere Informationen zur Überwachung von Hubnavigation und -filtern finden Sie unter Verwenden des Monitoring Hubs.

Vakuumhaltungeinstellungen

Mit dem VACUUM Befehl werden Dateien entfernt, auf die nicht mehr vom Delta-Protokoll verwiesen wird und die älter als Der Aufbewahrungsschwellenwert sind. Der Standardmäßige Aufbewahrungsschwellenwert beträgt sieben Tage.

Die Verwendung eines kürzeren Aufbewahrungsintervalls kann den Delta-Zeitreiseverlauf reduzieren und sich auf gleichzeitige Leser oder Autoren auswirken. Fabric-Portal- und API-Wartungsanforderungen schlagen standardmäßig für Aufbewahrungsintervalle unter sieben Tagen fehl.

Wenn Sie ein Aufbewahrungsintervall von weniger als sieben Tagen verwenden müssen, setzen Sie spark.databricks.delta.retentionDurationCheck.enabled auf false in den Spark-Eigenschaften der Fabric-Umgebung, die von den Spark-Workloads Ihres Arbeitsbereichs genutzt wird. Informationen zum Konfigurieren und Anfügen von Umgebungen finden Sie unter Erstellen, Konfigurieren und Verwenden einer Umgebung in Fabric - und Spark-Computekonfigurationseinstellungen in Fabric-Umgebungen.