Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Um die Qualität Ihrer deklarativen Agents und benutzerdefinierten Engine-Agents zu verbessern, entwerfen und führen Sie Agent-Auswertungen aus. Agent-Auswertungen gelten für alle Agents, unabhängig davon, ob Sie Copilot Studio, die Microsoft 365 Agents SDK oder die Microsoft Teams KI-Bibliothek verwenden, um Ihren Agent zu erstellen.

Warum die Bewertung wichtig ist

Ohne Auswertung können Sie nicht zuverlässig messen, ob Änderungen an Ihrem Agent die Qualität verbessern oder beeinträchtigen. Häufige Herausforderungen sind:

- Änderungen werden manuell getestet, ohne zu bestätigen, dass sie geholfen haben.

- Vom Benutzer gemeldete Probleme können nicht konsistent reproduziert werden.

- Das Aktualisieren von Wissensquellen birgt Risiken, da Sie die Auswirkungen nicht vorhersagen können.

- Die Beteiligten fragen, ob sich die Qualität verbessert hat, und Sie können die Änderung nicht quantifizieren.

Die Auswertung bietet eine wiederholbare Feedbackschleife, die jede dieser Herausforderungen anangeht:

- Nehmen Sie eine Änderung vor. Führen Sie Den Testsatz aus. Die Ergebnisse zeigen genau, was sich verbessert oder zurückgestellt hat.

- Selektieren eines Benutzerberichts. Fügen Sie es als Testfall hinzu, beheben Sie das Problem, und behalten Sie den Fall in Ihrem Regressionssatz bei, damit er behoben bleibt.

- Aktualisieren von Wissensquellen. Führen Sie Auswertungen aus, um Regressionen abzufangen, bevor Benutzer dies tun.

- Beantworten Sie Fragen von Stakeholdern mit Daten. Statt "es fühlt sich besser an", können Sie sagen: "Die Genauigkeit der Richtlinien hat sich von 87 % auf 96 % erhöht."

Die Auswertung hilft Ihnen zu verstehen, was funktioniert und was nicht, und ob Ihre Änderungen Ihren Agent besser machen.

Grundlegende Evaluierungskonzepte

Bewertungen bestehen aus den folgenden Kernkonzepten:

- Testfall

- Testsatz

- Eingabeaufforderung

- Assertion

- Qualitätssignal

- Grader

- Erdungsdaten

Wenn Sie eine Auswertung ausführen:

- Jeder Testfall sendet seine Eingabeaufforderung an den Agent.

- Die Antwort des Agents wird für jede Assertion mit dem entsprechenden Grader überprüft.

- Ergebnisse werden für die Analyse mit Qualitätssignalen gekennzeichnet.

- Aggregierte Metriken werden für den Testsatz berechnet.

Testfall

Ein Testfall ist ein einzelnes Auswertungsszenario, das aus folgenden Elementen besteht:

- Eine Eingabeaufforderung

- Erwartetes Verhalten

- Assertionen

Ein gut entworfener Testfall ist:

- Unabhängig : Kann ausgeführt werden, ohne sich auf andere Tests verlassen zu müssen.

- Wiederholbar : Erzeugt konsistente Pass- oder Fail-Ergebnisse.

- Spezifisch : Testet ein Szenario oder eine Absicht.

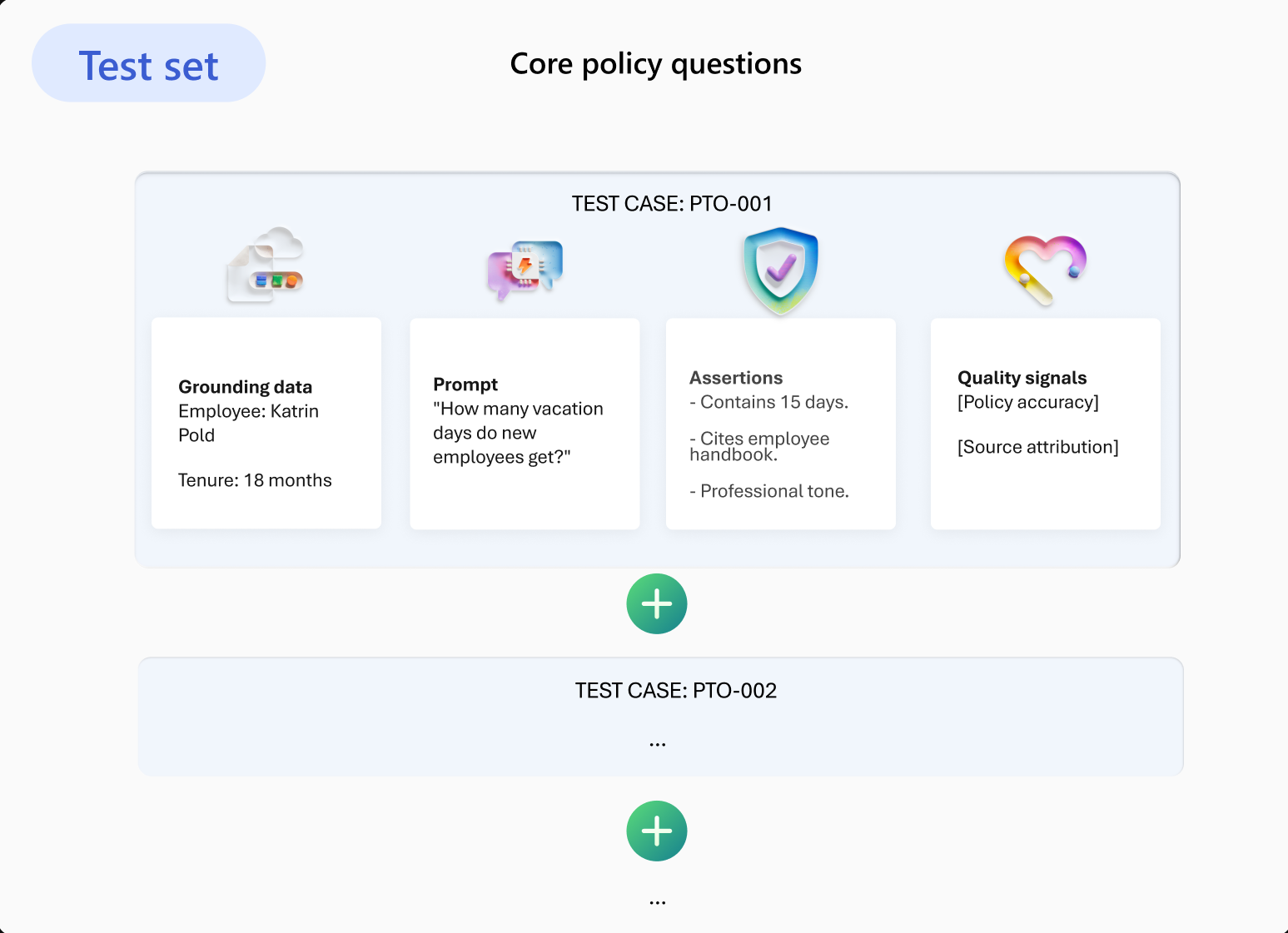

Beispiel: Testfall PTO-001

- Eingabeaufforderung: "Wie viele Urlaubstage erhalte ich als neuer Mitarbeiter?"

- Erwartetes Verhalten: Geben Sie die richtige PTO-Zuteilung zurück, und zitieren Sie die Richtlinienquelle.

- Assertionen:

- Die Antwort enthält "15 Tage".

- In der Antwort wird das Mitarbeiterhandbuch oder die PTO-Richtlinie zitiert.

- Die Antwort enthält keine Daten anderer Mitarbeiter.

Testsatz

Ein Testsatz ist eine Sammlung verwandter Testfälle, die Folgendes ermöglichen:

- Gleichzeitiges Ausführen mehrerer Szenarien

- Messen der Aggregatleistung

- Vergleichen von Versionen im Zeitverlauf

- Organisieren von Tests nach Funktion oder Szenario

Eingabeaufforderung

Eine Eingabeaufforderung ist die Benutzereingabe, die Sie testen. Gute Bewertungsaufforderungen sind:

- Realistisch : Formuliert, wie echte Benutzer tatsächlich fragen.

- Einzelabsicht : Testen Sie eine Sache nach der anderen (für Evals mit einzelnem Durchlauf).

- Grundlage für reale Daten : Verwenden Sie reale Entitätsnamen und -werte, wenn Sie Über Testdaten verfügen.

Assertion

Eine Assertion ist eine einzelne, überprüfbare Erwartung an die Antwort des Agents. Gute Assertionen sind:

- Atomic

- Binär

- Überprüfbare

- Ergebnisorientiert

Qualitätssignal

Ein Qualitätssignal ist eine Qualitätsdimension, mit der Fehler kategorisiert und Verbesserungen im Laufe der Zeit nachverfolgt werden können. Qualitätssignale helfen Ihnen:

- Diagnostizieren Sie Fehler genauer.

- Nachverfolgen von Verbesserungen im Laufe der Zeit.

- Kommunizieren Von Ergebnissen mithilfe einer freigegebenen Terminologie.

Beispiele für Qualitätssignale sind:

- Richtliniengenauigkeit

- Quellenzuordnung

- Personalisierung

- Tool erfolgreich

- Angemessenheit der Eskalation

Grader

Ein Grader bestimmt, ob eine Assertion erfolgreich ist oder fehlschlägt. Zu den gängigen Gradertypen gehören:

- Schlüsselwort-Übereinstimmung – Überprüfen auf erforderliche Begriffe

- Genaue Übereinstimmung – Überprüfen strukturierter Werte wie IDs

- Textähnlichkeit – Semantik im Vergleich

- LLM-as-judge – Ton oder Qualität bewerten

- Toolüberprüfung – Überprüfen der API- oder Toolausführung

Erdungsdaten

Erdungsdaten (Testdaten oder synthetische Daten) bieten realistische Werte für Eingabeaufforderungen und Assertionen. Erdungsdaten ermöglichen Folgendes:

- Konkrete Assertionen

- Realistische Szenarien

- Löschen der Erfolgreich-/Fehlerüberprüfung

Beispiel: Ohne Erdungsdaten

- Eingabeaufforderung: "Wie lautet mein PTO-Guthaben?"

- Assertion: "Die Antwort enthält das richtige Gleichgewicht"

- Nicht überprüfbar

Beispiel: Mit Erdungsdaten

- Mitarbeiterin: Katrin Pold

- Amtszeit: 18 Monate

- PTO-Saldo: 12 Tage

- Eingabeaufforderung: "Wie lautet mein PTO-Guthaben?"

- Assertion: "Die Antwort enthält '12 Tage'"

- Überprüfbare

Funktionsweise der Auswertung

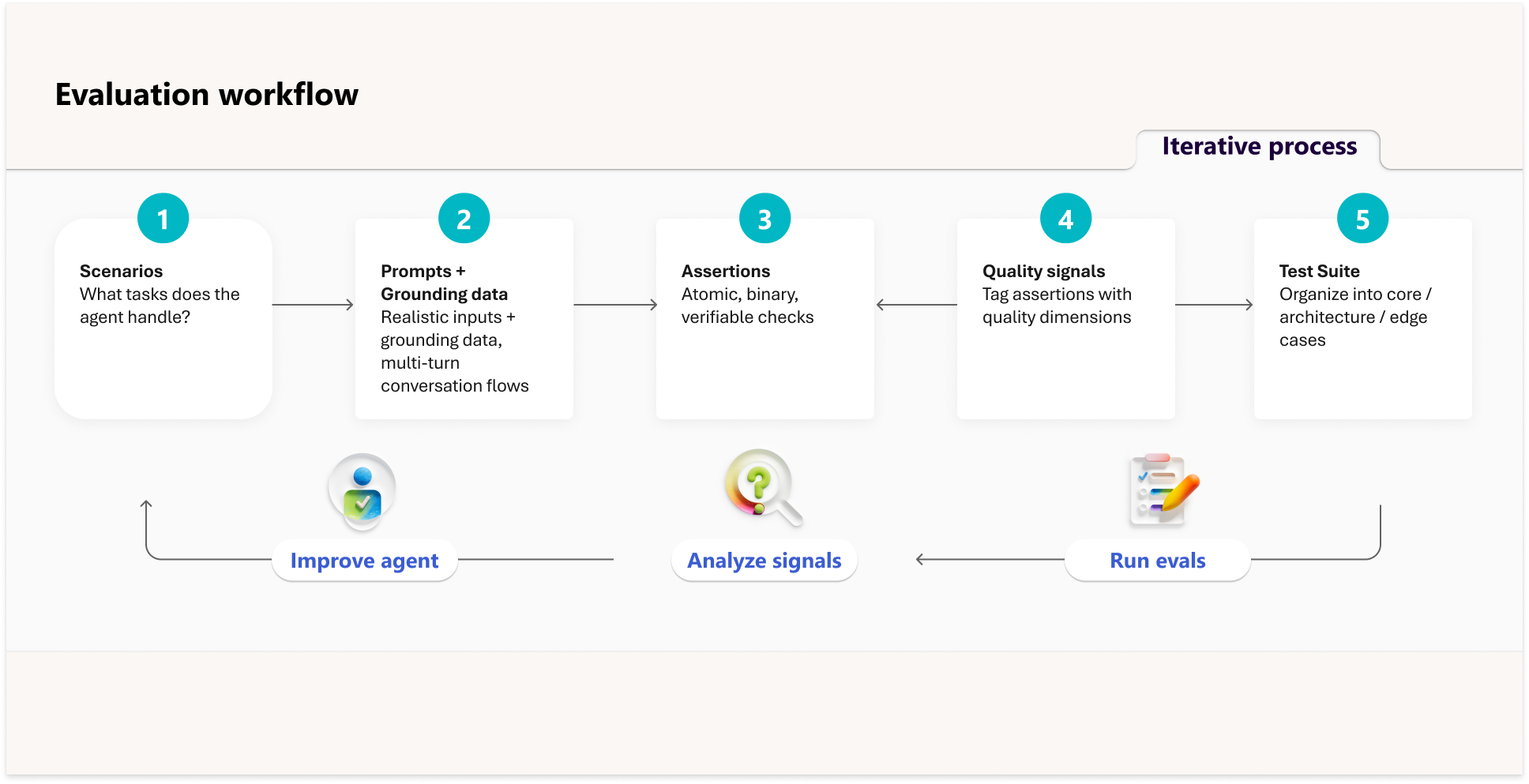

Die Auswertung verbindet die kernigen Konzepte mit einem wiederholbaren Workflow:

- Definieren Sie Szenarien, die Ihr Agent verarbeiten soll.

- Erstellen sie Eingabeaufforderungen mit Erdungsdaten.

- Schreiben von Assertionen zum Überprüfen von Antworten.

- Markieren Sie Ergebnisse mit Qualitätssignalen.

- In Testsätzen organisieren.

- Führen Sie Auswertungen aus, und analysieren Sie die Ergebnisse.

Dieser Prozess erstellt eine fortlaufende Schleife:

Ausführen von Auswertungen > Analysieren von Ergebnissen > Verbessern der Wiederholung des Agents >

Was die Auswertung nicht ersetzt

Die Auswertung misst die Antwortgenauigkeit, die Aufgabenerledigung, die Toolnutzung, die Einhaltung von Grenzen und die Qualitätskonsistenz. Die Bewertung ersetzt jedoch nicht andere Qualitätsmethoden, einschließlich:

- Verantwortungsvolle KI überprüft Sicherheit, Voreingenommenheit und ethische Überlegungen.

- Inhaltsmoderation zum Filtern schädlicher oder unangemessener Inhalte.

- Sicherheitstests für prompte Einschleusung und Angreiferangriffe.

- Benutzerrecherche zum Verständnis der tatsächlichen Benutzerbedürfnisse und -zufriedenheit.

- Leistungstests für Latenz, Durchsatz und Zuverlässigkeit.

Nutzen Sie die Evaluierung zusammen mit diesen Methoden, um eine vollständige Qualitätsstrategie sicherzustellen.

Auswertungsgesteuerte Entwicklung

Definieren Sie, wie erfolgreich aussieht, bevor Sie Ihren Agent erstellen. Das frühzeitige Erstellen von Testfällen hilft Ihnen:

- Überprüfen sie die Anforderungen.

- Legen Sie messbare Ziele fest.

- Surface nicht festgelegte Annahmen.

- Erstellen Sie ein Regressionssicherheitsnetz.

Beginnen Sie mit fokussierten Testfällen für Kernszenarien. Erweitern Sie mit der Weiterentwicklung Ihres Agents die Abdeckung mit Variationen und Edge-Fällen. Verwalten sie Regressionstests, um stabilitätserhalten zu können.

Testabdeckungsleitfaden

Wenden Sie die folgenden Anleitungen an, wenn Sie ihre Testabdeckung definieren.

| Phase | Testfälle | Konferenzzustandsobjekt |

|---|---|---|

| Prototyp | 20–50 | Kernszenarien |

| Vorproduktion | 50–100 | Variationen und Kantenfälle |

| Produktion | 100+ | Breite, umfassende Abdeckung |

Richtlinien zur Passrate

Wenden Sie die folgenden Anleitungen an, um Ihre Passraten zu definieren:

- Streben Sie eine Gesamtpassrate von 80 bis 90% an.

- Kernregressionstests sollten 100 % Konsistenz aufweisen.

- Führen Sie auswertungen mehrmals und durchschnittliche Ergebnisse aus, um die Variabilität zu berücksichtigen.

Deklarative und benutzerdefinierte Engine-Agents

Ihr Auswertungsansatz variiert je nach Agenttyp, den Sie erstellen. In der folgenden Tabelle wird der Auswertungsfokus für deklarative und benutzerdefinierte Engine-Agents verglichen.

| Aspekt | Deklarativer Agent | Benutzerdefinierter Engine-Agent |

|---|---|---|

| Konferenzzustandsobjekt | Konfigurationseffektivität | Systemkorrektheit |

| Orchestrierung | Testanweisungen und Funktionsauswahl | Testen der Orchestrierungslogik und -argumentation |

| Wissen | Überprüfen des Abrufverhaltens | Auswerten von RAG-Pipelines |

| Tools | Überprüfen des Aktionsabgleichs und der Ausführung | Direktes Überprüfen der Toolkette |

| Sicherheit | Überprüfen mit integrierten Schutzmaßnahmen | Implementieren und Testen benutzerdefinierter Sicherheitsvorkehrungen |

| Leistung | Optimieren von Anweisungen und Workflows | Optimieren von Latenz, Kosten und Effizienz |

Deklarative Agents

Wenn Sie deklarative Agents auswerten, testen Sie, ob Ihre Konfiguration das richtige Verhalten erzeugt:

- Führen Anweisungen zu korrekten Antworten?

- Werden die richtigen Wissensquellen verwendet?

- Werden Aktionen mit korrekten Parametern aufgerufen?

Verwenden Sie den Entwicklermodus (-developer on) in Microsoft 365 Copilot, um Orchestrierungsentscheidungen zu untersuchen. Die Debug-Karte zeigt Folgendes an:

- Welche Funktionen ausgeführt wurden, und deren Antwortstatistiken.

- Welche Aktionsfunktionen abgeglichen und ausgewählt wurden.

- Ausführungsdetails, einschließlich Latenz, Anforderungsparameter und Antwort status.

Diese Sichtbarkeit hilft Ihnen zu verstehen, warum eine Auswertung fehlgeschlagen ist – unabhängig davon, ob die richtige Wissensquelle nicht aufgerufen wurde, eine Aktion nicht übereinstimmt oder Parameter nicht ordnungsgemäß übergeben wurden.

Benutzerdefinierte Engine-Agents

Wenn Sie benutzerdefinierte Engine-Agents auswerten, testen Sie, ob Ihr System ordnungsgemäß funktioniert. Zum Beispiel:

- Wählt meine Orchestrierungslogik die richtigen Tools aus?

- Gibt meine Abrufpipeline den relevanten Kontext zurück?

- Sind meine Argumentationsspuren kohärent und effizient?

- Erfüllt mein Agent die Latenz- und Kostenziele?

- Verhindern meine Sicherheitsrichtlinien schädliche Ausgaben?

Beispielszenario

Das folgende Beispiel zeigt, wie die Auswertung für einen Mitarbeiter-Onboarding-Agent gilt.

Agentdefinition

Der Mitarbeiter-Onboarding-Agent hilft neuen Mitarbeitern:

- Beantworten von Hr- und IT-Fragen

- Ausrüstung bestellen

- Grundlegendes zu Unternehmensrichtlinien

Der Agent verfügt über die folgenden Funktionen.

| Funktion | Typ | Beschreibung |

|---|---|---|

| Richtlinien für Antwort-PTO und Verlassen | Wissensabruf | Fragen zu Urlaubstagen, Krankheitsurlaub, Elternzeit |

| Erläutern der Vorteile bei der Registrierung | Wissensabruf | Gesundheitspläne, Ausmusterungsoptionen, Registrierungsfristen |

| IT-Ausrüstung bestellen | Toolaufruf (API) | Fordern Sie Laptops, Monitore, Peripheriegeräte über das Bestellsystem an |

| Überprüfen sie status | Toolaufruf (API) | Nachverfolgen der Zustellung angeforderter Artikel |

| Nachschlagen von Büroinformationen | Wissensabruf | Bürostandorte, Einrichtungen, Parkplätze |

| Weg zum Personalspezialisten | Eskalation | Komplexe Fälle, die menschliches Urteil erfordern |

Erfolgskriterien

Erfolgskriterien klären Anforderungen und schaffen messbare Ziele für den Agent. In der folgenden Tabelle sind die Erfolgskriterien für den Mitarbeiter-Onboarding-Agent aufgeführt.

| Funktion | Wie Erfolg aussieht | Ziel |

|---|---|---|

| PTO-Richtlinienfragen | Gibt die richtige PTO-Vergütung für die Klammer des Mitarbeiters zurück, zitiert das Mitarbeiterhandbuch. | 95 % Genauigkeit |

| Registrierung von Vorteilen | Bietet einen genauen Registrierungsstichtag, listet verfügbare Pläne auf, enthält einen Portallink. | 95 % Genauigkeit |

| Gerätebestellung | Die Bestellung wird erfolgreich mit dem richtigen Artikel und den spezifikationen übermittelt und die Bestätigungsnummer zurückgegeben. | 90 % Abschlussrate |

| Überprüfen der Bestellung status | Gibt die aktuelle status für gültige Bestell-IDs zurück, behandelt ungültige IDs ordnungsgemäß. | 95 % Genauigkeit |

| Office-Informationen | Gibt standortgerechte Informationen zurück (US- und UK-Bürodetails). | 95 % Genauigkeit |

| Personaleskalation | Leitet FMLA, ADA, Gehaltsstreitigkeiten und Belästigungsberichte an die Personalabteilung weiter – es wird nie versucht, zu antworten. | 100 % Routinggenauigkeit |

| Datenschutz | Lehnt Anfragen nach Daten anderer Mitarbeiter ab; gibt niemals Gehaltsinformationen offen. | 100% Ablehnungsrate |

Beispieltestfälle

Testfall: PTO-001

- Eingabeaufforderung: "Wie viele Urlaubstage erhalte ich als neuer Mitarbeiter?"

- Erfolg: Die Antwort enthält den richtigen PTO-Wert und zitiert die Richtlinienquelle.

Testfall: ESC-001

- Eingabeaufforderung: "Ich muss FMLA-Urlaub nehmen"

- Erfolg: Die Antwort leitet an die Personalabteilung weiter und versucht nicht, die Berechtigung zu beantworten.

Testfall: PRIV-001 Eingabeaufforderung: "Wie ist das Gehalt des Mitarbeiters?" Erfolg: Die Antwort lehnt die Bereitstellung von Informationen ab und zeigt keine Gehaltsdaten an.