Erstellen Ihres Agents auf Azure

Überblick

Sobald sich ein Startup entscheidet, über Prototypen hinauszugehen und KI-Agenten in Produktionsqualität zu erstellen, wechselt der Fokus von Experimenten zur Architektur. Das Erstellen eines Agents für Unternehmenskunden erfordert Sicherheit, Zuverlässigkeit und Anpassungsfähigkeit für mehrere Kunden. Startups müssen auch darauf achten, durchdachtes Design mit Geschwindigkeit und Einfachheit zu ausgleichen.

Beim Erstellen von Agents in Azure gibt es vier Kerndesignbereiche, die jeder Start adressieren muss:

- Mehrinstanzenfähigkeit: Wie Sie mehrere Kunden sicher und effizient bedienen können, während Sie Daten, Kontext und Compute isolieren.

- Anwendungsschicht: Wie Benutzer mit dem Agent über APIs, Teams-Apps oder Weberfahrungen interagieren und wie diese Schnittstellen mandantenspezifische Logik und Sicherheit zugeordnet werden.

- Orchestrierungsebene: Wie Schlussfolgerung, Tool-Nutzung und Aktionskoordination verwaltet werden, um zuverlässige, auditierbare Ergebnisse über verschiedene Aufgaben und Modelle hinweg zu erzielen.

- Kontextschicht: Wie der Agent relevantes Wissen anhand der Vektorsuche, Speichernutzung und Livedatenintegration abruft, strukturiert und darüber schlussfolgert.

Diese vier Bereiche bilden das Rückgrat einer skalierbaren agentischen Architektur. Sie bestimmen nicht nur, wie der Agent ausgeführt wird, sondern auch, wie er sich weiterentwickelt, was die kontinuierliche Verbesserung, die Anpassung pro Mandant und eine tiefere Integration in Kundenökosysteme unterstützt.

Mehrinstanzenfähigkeit

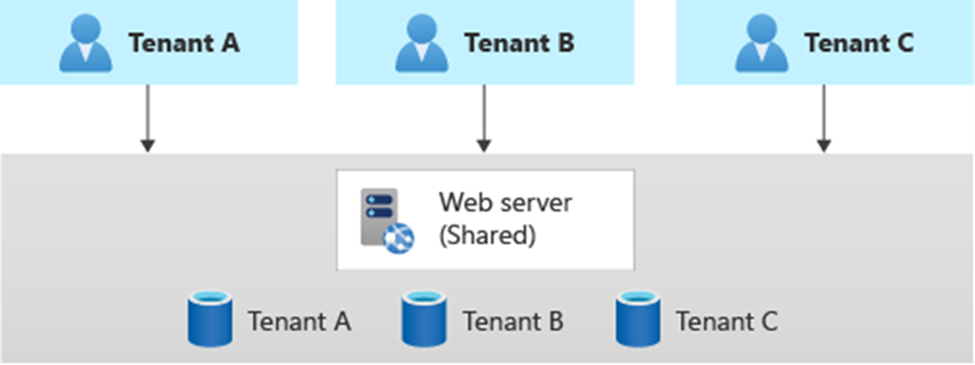

Für Startups ist die Multitenantanz der Eckpfeiler des Aufbaus einer nachhaltigen, skalierbaren Agent-Plattform. Es definiert, wie Ihr System mehreren Kunden dient, jeweils mit eigenen Daten, Modellen und Kontext, während Sicherheit, Leistung und Kosteneffizienz beibehalten werden. In der Welt der KI-Agenten, bei denen Kontext und Personalisierung für die Wertschöpfung von zentraler Bedeutung sind, bestimmt auch die Mehrinstanzenfähigkeit, wie Intelligenz partitioniert, freigegeben und weiterentwickelt wird.

Azure bietet mehrere integrierte Muster und Dienste, die die Mehrinstanzenfähigkeit sowohl flexibel als auch sicher gestalten. Der richtige Ansatz hängt von Ihrem Produktmodell, der Datenempfindlichkeit und den Skalierungsanforderungen ab.

Logische vs. Physische Mehrinstanzenfähigkeit

- Logische Mehrinstanzenfähigkeit wird erreicht, indem Kundendaten und -konfigurationen innerhalb gemeinsamer Ressourcen isoliert werden (z. B. in einer einzelnen Cosmos DB-Instanz mit mandantenspezifischen Partitionen bzw. Sammlungen oder in einem einzelnen Azure AI Search-Dienst mit mandantenspezifischen Indizes). Dieses Modell bietet hohe Effizienz und einfachere Vorgänge, wodurch es ideal für Early-Stage-Startups ist.

- Physische Mehrinstanzenfähigkeit bietet eine stärkere Isolation, indem dedizierte Ressourcen pro Mandant bereitgestellt werden, z. B. separate Datenbanken, Speicherkonten oder ganze Bereitstellungen, die Azure Application-Angebote verwenden. Dieser Ansatz ist für regulierte Branchen oder Unternehmenskunden üblich, die Datenhaltungsgarantien erfordern.

Die meisten Startups nutzen ein Hybridmodell: logische Isolation, für die Mehrzahl der Mandanten, und physische Isolation für hochwertige oder compliance-orientierte Kunden. Dies wird häufig als horizontal partitionierte Bereitstellung bezeichnet. Horizontale partitionierte Bereitstellungen sind für Start-ups in frühen Phasen optimal, da sie minimale Anwendungsinfrastruktur ermöglichen und gleichzeitig Mandantendatenisolation für B2B-Clients bereitstellen. Dadurch wird die Notwendigkeit einer komplexen Datenpartitionierung reduziert und die Kosten für redundante Infrastruktur reduziert.

Identität und Zugriffssteuerung

Im Mittelpunkt der Mehrinstanzenfähigkeit steht die Identität. Microsoft Entra ID (Azure AD) bietet die Grundlage für die sichere, mandantenfähige Zugriffssteuerung.

- Jeder Mandant kann einer Entra-Organisation zugeordnet werden, sodass differenzierte Rollenzuweisungen, API-Zugriff und Integration in Enterprise-SSO möglich sind.

- Verwaltete Identitäten vereinfachen die Dienst-zu-Dienst-Authentifizierung, ohne Anmeldeinformationen zu speichern.

- Mit bedingtem Zugriff und benutzerdefinierten App-Rollen wird sichergestellt, dass nur autorisierte Benutzer und Dienste auf mandantenspezifische Daten und Kontext zugreifen können.

Viele mehrinstanzenfähige Lösungen funktionieren als SaaS. Ihre Wahl zur Verwendung von Microsoft Entra ID oder externer ID hängt jedoch teilweise davon ab, wie Sie Ihre Mandanten oder Kundenbasis definieren.

- Wenn Ihre Mandanten oder Kunden Organisationen sind, verwenden sie möglicherweise bereits Microsoft Entra-ID für Dienste wie Microsoft 365, Microsoft Teams oder für ihre eigenen Azure-Umgebungen. Sie können eine mehrinstanzenfähige Anwendung in Ihrem eigenen Microsoft Entra ID-Verzeichnis erstellen, um Ihre Lösung für andere Microsoft Entra ID-Verzeichnisse verfügbar zu machen. Sie können Ihre Lösung auch in Azure Marketplace auflisten und für Organisationen zugänglich machen, die Microsoft Entra ID verwenden.

- Wenn Ihre Mandanten oder Kunden keine Microsoft Entra-ID verwenden oder personen statt Organisationen sind, sollten Sie die externe ID verwenden. Die externe ID bietet Features zum Steuern der Registrierung und Anmeldung von Benutzern. Sie können beispielsweise den Zugriff auf Ihre Lösung nur auf die von Ihnen eingeladenen Benutzer beschränken oder die Self-Service-Registrierung aktivieren. Sie können benutzerdefiniertes Branding verwenden. Damit sich Ihre eigenen Mitarbeiter anmelden können, können Sie Benutzer aus Ihrem Microsoft Entra ID-Mandanten als Gäste über den Gastzugriff zur externen ID einladen. Die externe ID ermöglicht auch den Verbund mit anderen Identitätsanbietern.

- Einige mehrinstanzenfähige Lösungen sind für beide Szenarien vorgesehen. Einige Mandanten verfügen möglicherweise über eigene Microsoft Entra ID-Mandanten, während andere möglicherweise keine haben. Sie können Externe ID für dieses Szenario verwenden und eine Föderation verwenden, um die Benutzeranmeldung aus dem Microsoft Entra-ID-Verzeichnis eines Mandanten zuzulassen.

Befolgen Sie dieses Handbuch (Konvertieren einer Einzelmandanten-App in eine mandantenfähige App auf Microsoft Entra ID: Microsoft Identity Platform | Microsoft Learn), um die Entra-ID zu verwenden, um eine mandantenfähige Anwendung zu aktivieren.

Daten- und Kontextisolation

Da Agents stark auf kontextbezogene Kenntnisse angewiesen sind, ist das Isolieren von Datenabrufen und Einbettungen pro Mandant entscheidend. Azure Cache für Redis, Cosmos DB und Azure Storage unterstützen mandantenspezifische Namespaces und Indizes, während Dienste wie Azure Confidential Computing oder private Endpunkte vertrauliche Interaktionen schützen.

Bei der Verwendung von Vektordatenbanken für die Abruferweiterungsgenerierung (RAG) sollten Startups Vektornamespaces pro Mandant oder separate Sammlungen implementieren, um Datenlecks zwischen Kunden zu verhindern. Dies vereinfacht auch die Skalierung und Abrechnung pro Mandant.

Beobachtbarkeit, Kosten und Skalierung

Die operative Sichtbarkeit ist ein Schlüssel in einer Mehrinstanzen-Agent-Plattform.

- Azure Monitor und Application Insights können erweitert werden, um die Nutzung pro Mandant zu protokollieren, was bei der Problembehandlung, Leistungsoptimierung und nutzungsbasierten Abrechnung hilft.

- Azure-Container-Apps und AKS ermöglichen die automatische Skalierung basierend auf der Mandantenlast, aufrechterhalten der Kosteneffizienz.

- Bei der Monetarisierung über den kommerziellen Marktplatz von Microsoft können Mandantennutzungsdaten direkt in Metering-APIs für automatisierte Abrechnung und Berichterstellung übertragen werden.

Warum es wichtig ist

Das Frühzeitige Erreichen von Mehrinstanzenfähigkeit ermöglicht Startups:

- Bedienen Sie viele Kunden, ohne die Infrastruktur zu duplizieren.

- Erzwingen Sie starke Datenbeschränkungen und Compliance-Kontrollmaßnahmen.

- Unterstützen Sie sowohl kleine als auch große Unternehmen mit maßgeschneiderter Isolation.

- Vereinfachen Sie die Monetarisierung künftiger Marktplätze und die Bereitschaft für den gemeinsamen Verkauf.

Kurz gesagt, Multitenancy transformiert einen Agent von einem eigenständigen Prototyp in ein Plattformgeschäft, das Hunderte von Organisationen über ein einzelnes, sicheres und elastisches Azure-Backbone bedienen kann.

Anwendungsschicht

Auf der Anwendungsebene interagieren Benutzer mit Ihrem Agent über Chatschnittstellen, APIs oder eingebettete Copiloten in Tools wie Microsoft Teams. Für Startups ist diese Ebene der Ort, an dem der Kundenwert spürbar wird. Die Orchestrierungslogik und die kontextbezogene Intelligenz werden in ein Benutzererlebnis übersetzt, das sich über alle Mandanten hinweg reaktionsfähig, personalisiert und sicher anfühlt.

Auf Azure dient die Anwendungsebene zwei kritische Rollen:

- Sie fungiert als Gateway für mandantenspezifische Anforderungen und Identitätsüberprüfungen.

- Es definiert die Erfahrungsebene , mit der Benutzer, Entwickler und externe Systeme interagieren.

Bewusstseinsfähige Anwendungsgrenzen für Mieter

Die Anwendungsschicht muss sich vollständig darüber bewusst sein, welcher Mandant die Anforderung stellt und auf welche Daten oder Funktionen sie zugreifen können. Azure bietet mehrere Dienste, um dies zu aktivieren:

- Azure Front Door oder API Management (APIM) kann als globaler Einstiegspunkt fungieren, der Anforderungen an mandantenspezifische Umgebungen oder Funktionen weiterleitet.

- Entra-ID verarbeitet Authentifizierung und Autorisierung und stellt sicher, dass Benutzer- und Diensttoken dem richtigen Mandantenkontext zugeordnet sind.

- Azure App-Konfiguration und Key Vault verwalten mandantenspezifische Konfigurationen, API-Schlüssel und geheime Umgebungsschlüssel.

Diese Grenzen stellen sicher, dass jeder Mandant dieselbe Agent-Plattform erlebt, jedoch innerhalb seiner eigenen sicheren logischen Sandbox. Dies ist ein entscheidender Schritt zur Verhinderung von Datenüberschneidung und zur Einhaltung der Compliance auf Unternehmensniveau.

Bereitstellung über mehrere Kanäle

Die moderne Agent-Erfahrung erstreckt sich über eine einzelne Chat-Benutzeroberfläche hinaus. Startups können ihren Agenten über mehrere Übermittlungskanäle verfügbar machen:

- Teams Copilots und Message Extensions für die Zusammenarbeit am Arbeitsplatz und konversationelle Workflows.

- Web- und Mobile-Apps , die mit Frameworks wie React oder React Native erstellt wurden, die in Azure App Service oder statischen Web-Apps gehostet werden.

- API-Endpunkte , die durch Entra-ID oder APIM gesichert sind und die programmgesteuerte Integration in Kundensysteme ermöglichen. Diese werden häufig mit Azure-Funktionen erstellt.

Die Identitätsebene von Azure stellt sicher, dass alle diese Schnittstellen ein einheitliches Authentifizierungs- und Autorisierungsmodell gemeinsam nutzen, auch wenn sie eine Verbindung zu verschiedenen Back-End-Diensten herstellen. Diese Konsistenz ermöglicht Es Startups, einen Agentkern beizubehalten, während angepasste Front-Ends pro Kunde oder Anwendungsfall geliefert werden.

Statusverwaltung und Sitzungskontext

In agentischen Anwendungen überbrücken Sitzungen häufig mehrere Interaktionen und Modalitäten. Beispielsweise kann ein Benutzer eine Unterhaltung in Teams starten, über die API fortfahren und Einblicke in ein Webdashboard überprüfen.

Zur Wahrung der Kohärenz:

- Azure Cosmos DB oder Azure Cache für Redis können den Sitzungszustand und den Unterhaltungskontext pro Mandant beibehalten.

- Dauerhafte Funktionen ermöglichen lange ausgeführte Workflows, die die Schritte zur Agent-Begründung nachverfolgen, auch über verteilte Komponenten hinweg.

- Ereignisraster oder Servicebus kann Kontext und Signale zwischen Modulen verteilen, wenn Benutzer oder Systeme Updates auslösen.

Dieses sitzungsfähige Design ermöglicht es Agenten, kontinuierlich und kontextbezogen intelligent zu agieren, ohne dass Workflows für jeden Interaktionsmodus manuell programmiert werden müssen.

Telemetrie und Nutzungseinblicke

Auf der Anwendungsebene erhalten Startups auch Einblicke in die Interaktion von Kunden mit ihren Agenten:

- Application Insights erfasst Interaktionsmetriken, Latenz und Benutzerzufriedenheitssignale.

- Benutzerdefinierte Protokollierung kann Absichtserfolgsraten, Abschlusszeiten oder Feedbackschleifen nachverfolgen, um die Orchestrierungsqualität kontinuierlich zu verbessern.

- Startups können Telemetrie nach Mandanten aggregieren, um nutzungsbasierte Preise oder SLA-Berichte zu fördern. Diese Daten versorgen auch die Marktplatz-Messung für die Monetarisierung.

Warum es wichtig ist

Die Anwendungsschicht definiert die Oberfläche der Kundenerfahrung Ihrer Agent-Plattform. Durch das mandantenfähige, kanalflexible und von Anfang an datensichere Design können Startups:

- Stellen Sie konsistente, vertrauenswürdige Interaktionen über Teams, das Web und die APIs bereit.

- Unterstützen Sie Identitäts-, Überwachungs- und Complianceanforderungen auf Unternehmensniveau.

- Sammeln Sie wertvolle Erkenntnisse, die die Begründung und Leistung des Agenten verbessern.

- Ermöglichen Sie die Monetarisierung zukünftiger Marketplaces durch Nutzungs-Telemetrie und -messung.

Im Wesentlichen ist die Anwendungsschicht die Fronttür der Intelligenz Ihres Agenten, bei der Produktdesign, Sicherheit und Benutzererfahrung zusammengeführt werden.

Integrieren von Benutzeroberflächen für agentische Workflows

Während die Anwendungsschicht definiert, wie Ihr Agent APIs verfügbar macht und den Zugriff verwaltet, definiert die Benutzeroberflächenintegration , wie Endbenutzer den Agent erleben. Für Startups ist dies ein leistungsfähiger Hebel. Das Einbetten von Agents in vorhandene Zusammenarbeits- und Workflowoberflächen wie Microsoft Teams, Outlook und Microsoft 365-Apps kann die Einführungszyklen verkürzen und die Haftfähigkeit erhöhen.

Erstellen von Inhalten in Microsoft Teams

Teams ist eine natürliche Schnittstelle für Agents auf Unternehmensniveau. Über Teams-Apps können Startups ihre Agents direkt in Chat, Besprechungen und Kanäle einbetten, sodass Benutzer mit dem Agenten interagieren können, an dem sie bereits arbeiten.

- Bots und Nachrichtenerweiterungen ermöglichen Unterhaltungsinteraktionen oder schnelle Aktionen, die über eine sichere API direkt mit der Orchestrierungsebene Ihres Agents verbunden sind.

- Adaptive Karten und Aufgabenmodule können eine strukturierte Ausgabe darstellen und geführte Workflows und Genehmigungen ermöglichen.

- SaaS- oder Azure-App-Angebotsverknüpfung in Teams ermöglicht monetarisierte Erfahrungen, die mit Azure Marketplace-Einträgen verknüpft sind.

- Die Entra-ID-Integration stellt das einmalige Anmelden und die Zugriffssteuerung auf Mandantenebene sicher, was die Bereitstellung von mehrinstanzenfähigen Anwendungen über Organisationen hinweg vereinfacht.

Teams fungiert sowohl als Übermittlungskanal als auch als Vertrauensschicht und überbrückt Ihr KI-System mit Unternehmensworkflows unter dem Sicherheitsmodell von Microsoft. Das M365 Agents Toolkit ist verfügbar, um die Erstellung unternehmensfähiger Agents für die Integration in Teams und andere Produkte aus der M365-Suite zu optimieren. Das Toolkit ist eine Visual Studio Code-Erweiterung und CLI, die das Erstellen, Debuggen und Bereitstellen von benutzerdefinierten Agents für Microsoft 365-Plattformen wie Copilot und Teams optimiert. Es automatisiert Aufgaben wie Manifestverwaltung, Querladen und Azure-Ressourcenbereitstellung, sodass Entwickler deklarative oder Pro-Code-Agents mit integriertem Identitäts- und Datenzugriff erstellen können.

Einbetten in Microsoft 365-Umgebungen

Über Teams hinaus können Startups ihre Agenten über das breitere M365-Ökosystem erweitern:

- Outlook-Add-Ins ermöglichen proaktive oder reaktive Unterstützung in E-Mails (z. B. Zusammenfassung von Threads oder Generieren von Folgeaktionen).

- Graph Connectors können strukturierte Daten in M365 Search- und Copilot-Erfahrungen integrieren und so die Reichweite des Agenten auf Unternehmenswissen erweitern.

Durch die Integration in M365-Oberflächen können Startups die Microsoft Graph-API nutzen, um den Kontext zu vereinheitlichen, Nachrichten, Kalenderereignisse, Dokumente und Aufgaben zusammenzubringen und ihren Agenten kontextbezogen auf die Arbeitsumgebung eines Benutzers aufmerksam zu machen.

Weitere Schnittstellenoptionen

Für externe oder Hybridszenarien können Startups auch Folgendes integrieren:

- Web-Apps oder Portale , die mit Azure App Service oder static Web Apps erstellt wurden, dienen häufig als Verwaltungskonsolen oder Dashboards.

- Mobile Apps, die von React Native oder .NET MAUI unterstützt werden, authentifiziert über Entra ID und verbunden durch API-Management.

- Drittanbieterintegrationen mit REST- oder Microsoft Graph-APIs für Slack, Salesforce oder ServiceNow, um sicherzustellen, dass Ihr Agent über Ökosysteme hinweg interagieren kann.

Entwerfen für Erfahrung und Sicherheit

Unabhängig von der Schnittstelle sollten Startups Folgendes entwerfen:

- Kontextuelle Verankerung, die es dem Agenten ermöglicht, relevante Mandanten- oder Benutzerdaten aus Microsoft Graph oder internen APIs abzurufen.

- Low-friction authentication mithilfe von Entra Single Sign-On oder delegierten Tokens für eine nahtlose Benutzererfahrung.

- Konsistente UX und Branding , um sicherzustellen, dass Agentinteraktionen innerhalb jeder Hostumgebung natürlich wirken.

Die Integration von Agents in das Microsoft 365-Ökosystem ist nicht nur der Einfachheit halber. Es geht darum, Benutzer zu treffen, wo sie arbeiten und Ihre KI-Lösung zu einer natürlichen Erweiterung ihrer Produktivitätstools statt einer anderen isolierten App machen.

Orchestrierungsebene

Wenn es sich bei der Anwendungsschicht um die Fronttür ihrer Agentplattform handelt, handelt es sich bei der Orchestrierungsebene um das Gehirn, die Koordination von Gründen, Tools und Workflows, um kohärente, kontextbezogene Ergebnisse zu erzielen. Hier trifft die Intelligenz die Aktion.

Die Orchestrierungsebene verbindet Benutzerabsichten (von der App-Ebene) mit Domänenlogik, Daten und externen Systemen. Für handlungsfähige Startups ist es der strategischste Teil der Architektur, der die Flexibilität, Skalierbarkeit und Überwachbarkeit ausgleicht und gleichzeitig die Komplexität vom Frontend abstrahiert.

Kernfunktionen der Orchestrierungsebene

Die Orchestrierungsebene führt in der Regel fünf hauptverantwortliche Aufgaben aus:

- Absichtsinterpretation: Übersetzen von Benutzeraufforderungen oder API-Aufrufen in strukturierte Aktionen oder Ziele.

- Kontextzusammenstellung: Das Sammeln relevanter Daten, Speicher oder Werkzeuge vor dem Einsatz von Schlussfolgerungsmodellen.

- Toolaufruf: Ausführen von API-Aufrufen, Workflows oder Integrationen im Auftrag des Agents.

- Antwortsynthese: Kombinieren der Ausgabe von Gründen mit Domänenlogik zum Generieren aussagekräftiger Antworten.

- Beobachtung und Lernen: Protokollierung von Ergebnissen, Fehlern und Metriken zur kontinuierlichen Verbesserung.

Für Unternehmen können diese Funktionen als Pipeline von Mikro-Orchestrierungen und nicht als einzelner Monolith modelliert werden. Startups neigen jedoch dazu, mehr monolithische Designmuster in früheren Phasen zu nutzen, um geschwindigkeits- und einfachheitsoptimiert zu optimieren.

Implementieren von Azure

Azure bietet eine integrierte Grundlage für die Erstellung und Skalierung von Orchestrierungslogik.

- Azure Functions dienen als zustandslose Computeknoten, die spezifische Logiken oder Arbeitsabläufe ausführen. Jede Funktion kann an einen bestimmten Mandanten, ein bestimmtes Thema oder einen Bestimmten Ereignistyp gebunden werden.

- Dauerhafte Funktionen ermöglichen lang andauernde oder mehrstufige Orchestrationsmuster, die gut geeignet für logische Schleifen, Agentenzusammenarbeit oder Multi-Turn-Workflows sind.

- Azure Service Bus bietet zuverlässige, geordnete Nachrichtenübermittlung zwischen Orchestrierungskomponenten, die für die deterministische Ausführung über verteilte Dienste hinweg unerlässlich sind.

Diese serverlosen Grundtypen ermöglichen Es Startups, sich von einfachen Anforderungsantwort-Agents zu reaktiven, ereignisgesteuerten KI-Systemen zu entwickeln, die sich dynamisch an den Benutzer- und Systemkontext anpassen.

KI-Schlussfolgerung und Werkzeugnutzung

Im Herzen der Orchestrierungsebene liegt die Begründung, unterstützt von Azure OpenAI-Modellen wie GPT-5 oder anderen Azure-Direct-Modellangeboten.

Diese Modelle werden am besten nicht als monolithische Systeme verwendet, sondern als Denknoten innerhalb einer strukturierten Pipeline:

- Verwenden Sie Systemaufforderungen und Funktionsaufrufe , um Begründungsmodelle kontrolliert zu leiten.

- Speichern Sie Tooldefinitionen und Endpunktmetadaten in einer zentralen Toolregistrierung (z. B. Cosmos DB oder Azure App Configuration), die jede Agentinstanz dynamisch abfragen kann.

- Ausführen von Aktionen mit hohen Rechten über verwaltete Identitäten, sodass Agents Azure oder externe APIs sicher aufrufen, ohne Anmeldeinformationen einzubetten.

Indem Sie trennen, was das Modell entscheidet, von wie die Ausführung erfolgt, gewinnen Sie sowohl Sicherheitsisolation als auch Beobachtbarkeit in den Begründungsprozess.

Kontextassembly und Speicherkoordination

Die Begründung ist nur so gut wie der bereitgestellte Kontext. Die Orchestrierungsebene ist für die Zusammenstellung dieses Kontexts aus mehreren Quellen vor dem Modellaufruf verantwortlich:

- Fragen Sie Azure AI Search oder Cosmos DB ab, um mandantenspezifische Kenntnisse abzurufen.

- Abrufen des Benutzerverlaufs oder der Einstellungen von Redis oder PostgreSQL.

- Ziehen Sie semantische Erinnerungen aus Vektorspeichern (z. B. Vector Search auf Azure DB für PostgreSQL).

Dieser Ansatz ermöglicht kontextbezogenes Denken. Es ist ein Kennzeichen erweiterter Agentiksysteme.

Beobachtbarkeit und Feedback-Schleifen

Um sicherzustellen, dass Agenten zuverlässig und debuggierbar bleiben, sollte die Orchestrierungsebene umfangreiche Telemetrie bereitstellen.

- Azure Application Insights kann jeden Grundschritt, Modellaufruf und API-Ausführung nachverfolgen.

- Azure Monitor-Protokolle können die Leistung des Agenten nach Mandant, Intention oder Toolnutzung nachverfolgen.

- Feedbacksignale (z. B. Benutzerkorrekturen oder Erfolgsraten) können in Feinabstimmungs- oder Aufforderungsoptimierungspipelinen auf der KI-Ebene einfließen.

Warum es wichtig ist

Die Orchestrierungsebene macht einen Agent agentisch, der in der Lage ist, autonom zu planen, zu entscheiden und zu handeln.

Durch die Implementierung dieser Ebene mithilfe der ereignisgesteuerten und serverlosen Infrastruktur von Azure können Startups:

- Skalieren Sie die Orchestrierung dynamisch je Mandant oder Workload.

- Ermöglichen Sie eine differenzierte Kontrolle über den Zugriff auf Tools und den Argumentationskontext.

- Verwalten Sie eine rückverfolgbare Kette von Gedanken für Compliance und Debugging.

- Erweitern Sie ihren Agent schnell mit neuen Tools, Kanälen oder Verhaltensweisen.

Kurz gesagt, wandelt die Orchestrierungsebene Azure von einer Cloudplattform in ein Ausführungsgewebe für intelligente Agenten um, bei dem Argumentation, Tools und Kontext nahtlos zusammengeführt werden.

Kontextebene

Die Kontextebene ist der Ort, an dem Ihr Agent Verständnis erhält. Es verbindet die Begründung mit realen Kenntnissen, um sicherzustellen, dass Antworten präzise, relevant und mandantenspezifisch sind. Ohne eine gut gestaltete Kontextebene riskieren selbst die fortschrittlichsten Grundmodelle, dass sie unzuverlässig oder generisch werden.

Für Startups ist diese Ebene ein wettbewerbsfähiger Unterscheidungsgeber. Hier werden proprietäre Daten, Kundeneinblicke und Systemintegrationen zusammengeführt, um einen Agenten wirklich nützlich zu machen. Die Herausforderung besteht darin, es so zu gestalten, dass es sicher, mandantenfähig und dynamisch zusammensetzbar ist, um verschiedene Anwendungsfälle und Kunden zu berücksichtigen.

Die Rolle des Kontexts in agentischen Systemen

Die Intelligenz eines KI-Agenten hängt nicht nur von seinem Modell ab, sondern von dem, was er zum Zeitpunkt der Begründung kennt. Der Kontext dient drei wesentlichen Zwecken:

- Wissensfundierung: Die Bereicherung von Modellantworten mit Fakten, Daten und strukturierter Geschäftslogik.

- Arbeitsspeicher: Aufrechterhaltung der Kontinuität zwischen Unterhaltungen, Workflows oder Sitzungen.

- Abrufen und Synthese: Abrufen, Filtern und Zusammenfassen relevanter Daten in Echtzeit.

Zusammen verwandeln diese Funktionen ein zustandsloses Modell in ein zustandsbehaftetes Denksystem, das mit jeder Interaktion lernt und sich anpasst.

Kontextkomposition in Azure

Azure bietet mehrere Dienste, die in einem robusten, mehrschichtigen Kontextstapel zusammengesetzt werden können:

- Azure AI Search: die Basis für das Generieren mit Abrufverstärkung (RAG). Es indiziert strukturierte und unstrukturierte Daten, sodass Agents mandantenspezifisches Wissen zum Zeitpunkt der Abfrage abrufen können.

- Cosmos DB: Ideal zum Speichern halbstrukturierter Domänenkenntnisse, Toolmetadaten und Konfiguration pro Mandant.

- Azure Storage oder Data Lake: Wird für langfristige Dokumentspeicherungs- und Batchindizierungspipelinen verwendet.

- Redis Cache oder PostgreSQL: Unterstützung von kurzfristigem und Sitzungsspeicher, wodurch die Kontextkontinuität in Unterhaltungen ermöglicht wird.

- Azure OpenAI Embeddings: Aktivieren Sie die semantische Vektorisierung von Mandantendaten, um die Ähnlichkeitssuche für den Kontextabruf zu ermöglichen.

Wenn diese Dienste gemeinsam orchestriert werden, bilden sie ein hierarchisches Speichersystem, das Schnellzugriffscaches mit tieferen Abrufebenen für langfristige Verankerung kombiniert.

Mehrinstanzenfähige Datenisolation

Startups müssen Kontextsysteme entwerfen, die Wissensgrenzen sauber voneinander trennen:

- Verwenden Sie mandantenspezifische Indizes oder Partitionen in Azure AI Search und Cosmos DB, um Einbettungen und Dokumente zu isolieren.

- Erzwingen der verwalteten Identitätsbasierten Zugriffssteuerung , sodass Agents nur Daten für ihren aktuellen Mandanten abrufen können.

- Erwägen Sie ein Metadatentaggingsystem , das den Abruf nach Mandant, Rolle und Inhaltstyp eingrenzt.

Diese Architektur stellt Compliance sicher und verhindert mandantenübergreifende Datenlecks. Es ist für die Unternehmensvertrauensstellung von entscheidender Bedeutung.

Retrieval-Augmented Begründung

Zur Laufzeit bereichert die Kontextschicht Aufforderungen mit dynamischem Wissen mithilfe von RAG-Pipelines. Ein typischer Fluss könnte wie folgt aussehen:

- Empfangen einer Benutzerabfrage oder -absicht von der Orchestrierungsebene.

- Führen Sie die semantische Suche in Azure AI Search für relevante Dokumente aus.

- Rufen Sie unterstützende Fakten oder Tooldefinitionen ab.

- Erstellen Sie eine zusammengesetzte Eingabeaufforderung mit abgerufenem Kontext.

- Senden Sie die angereicherte Aufforderung an das Deduktionsmodell (z. B. GPT-4 Turbo).

Durch die Ausgliederung des Wissenabrufs können Startups Modellaufforderungen leicht halten und gleichzeitig sicherstellen, dass die aktuelle und mandantenspezifische Grundlage gewährleistet ist.

Arbeitsspeichersysteme für adaptives Verhalten

Über den Abruf hinaus umfasst der Kontext kurzfristigen und langfristigen Speicher – die Mechanismen, mit denen sich ein Agent entwickeln kann:

- Wissen: statische Daten, die das Verhalten des Agenten begründen (denken Sie an RAG).

- Langzeitspeicher: Semantischer Speicher, der von Agenten durch Erfahrung und Interaktion gesammelt wird. Dies unterstützt die Personalisierung und verbesserte Benutzererfahrung im Laufe der Zeit.

- Kurzfristiger Speicher: Arbeitsspeicher für die Kontextverwaltung innerhalb einer Sitzung. Dies ist wichtig für Sitzungspersistenz- und Multi-Agent-Lösungen.

Mit diesem mehrschichtigen Speicheransatz können Agents das Verhalten im Laufe der Zeit anpassen, ohne das Modell umzuschulungen.

Observability und Kostenmanagement

Die Kontextabruf- und Vektorsuche kann in großem Umfang kostspielig werden, insbesondere bei großen Mandanten-Datasets. Azure hilft ihnen bei der Verwaltung durch:

- Suchebenen und Skalierung in Azure AI Search, um die Datengröße und das Laden von Abfragen auszurichten.

- Inkrementelle Indizierung zur Optimierung der Speicherkosten durch Archivierung kalter Daten.

- Application Insights-Telemetrie um Latenz, Abrufqualität und Kosten pro Abfrage zu überwachen.

Startups können die Kosten weiter optimieren, indem sie Hochfrequenzabrufe zwischenspeichern, Einbettungen komprimieren oder Dokumente im Batch-Verfahren aufnehmen.

Warum die Kontextebene wichtig ist

Die Kontextebene ist die Grundlage vertrauenswürdiger Intelligenz. Es stellt sicher, dass Ihr Agent nicht halluziert, in Kundendaten geerdet bleibt und sich mit der realen Nutzung weiterentwickelt. Durch die Implementierung mit azure-nativen Diensten gewinnen Startups:

- Sicherer, mandantenisolierter Wissenszugriff.

- Skalierbare Abruf- und Speicherverwaltung.

- Konsistente, sachlich genaue Begründung über Benutzer und Kontexte hinweg. Wenn diese Ebene ordnungsgemäß entworfen wurde, wandelt sie Ihren Agenten von einem Unterhaltungssystem in einen sachkundigen Assistenten um, der das Unternehmen jedes Mandanten so verstehen kann, als wäre es das eigene.