Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

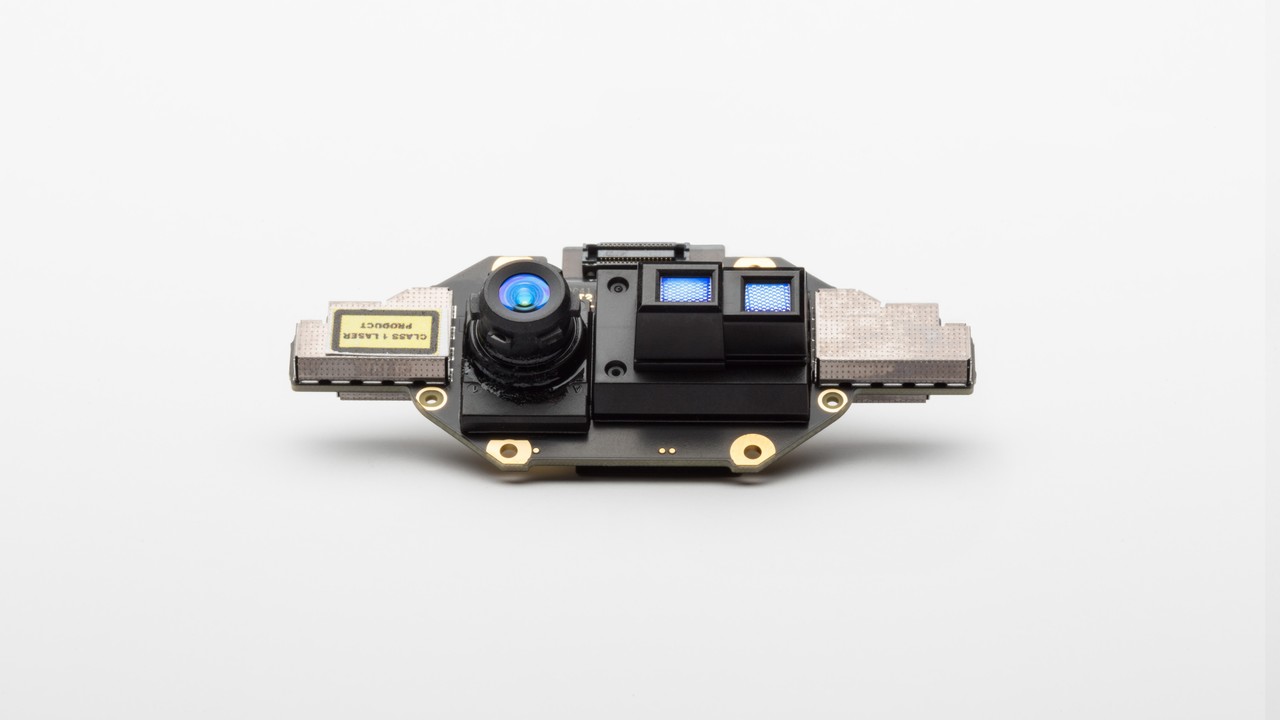

Auf dieser Seite wird erläutert, wie Sie die Tiefenkamera in Ihrem Azure Kinect DK verwenden. Die Tiefenkamera ist die zweite der beiden Kameras. Wie in vorherigen Abschnitten behandelt, ist die andere Kamera die RGB-Kamera.

Betriebsprinzipien

Die Azure Kinect DK-Tiefenkamera implementiert das AmCW-Prinzip (Amplitude Modulated Continuous Wave) Time-of-Flight (ToF). Die Kamera wirft moduliertes Licht im Nahinfrarot-Spektrum (NIR) auf die Szene. Anschließend zeichnet es eine indirekte Messung der Zeit auf, die das Licht benötigt, um von der Kamera zur Szene und zurück zu reisen.

Diese Messungen werden verarbeitet, um eine Tiefenkarte zu generieren. Eine Tiefenkarte ist ein Satz von Z-Koordinatenwerten für jedes Pixel des Bilds, gemessen in Maßeinheiten von Millimetern.

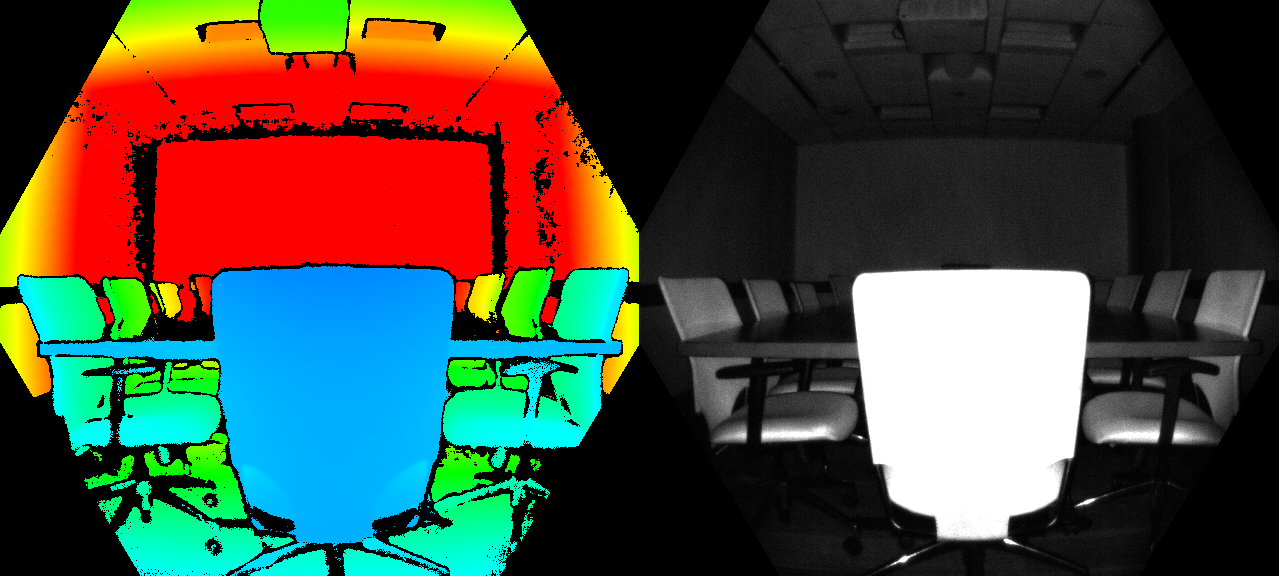

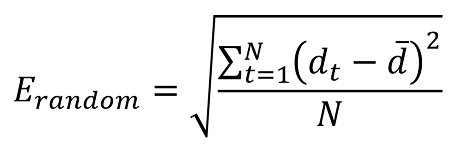

Zusammen mit einer Tiefenkarte erhalten wir auch eine sogenannte saubere IR-Messung. Der Wert von Pixeln in der sauberen IR-Ablesung ist proportional zur von der Szene zurückgegebenen Lichtmenge. Das Bild sieht ähnlich wie ein normales IR-Bild aus. Die folgende Abbildung zeigt eine Beispiel-Tiefenkarte (links) und ein entsprechendes sauberes IR-Bild (rechts).

Wichtige Features

Zu den technischen Merkmalen der Tiefenkamera gehören:

- 1-Megapixel ToF Imaging Chip mit fortschrittlicher Pixeltechnologie, die höhere Modulationsfrequenzen und Tiefengenauigkeit ermöglicht.

- Zwei NIR-Laserdioden ermöglichen nahe und breit gefächerte Tiefenmodi (Sichtfeld).

- Das kleinste ToF-Pixel der Welt, mit 3,5μm mal 3,5μm.

- Automatische Auswahl der Pixelverstärkung, die einen großen Dynamikbereich ermöglicht, sodass nahe und weit entfernte Objekte sauber erfasst werden können.

- Globaler Verschluss, der eine verbesserte Leistung im Sonnenlicht ermöglicht.

- Multi-Phasen-Tiefenberechnungsmethode, die eine robuste Genauigkeit auch im Vorhandensein von Chip-, Laser- und Stromversorgungsvariationen ermöglicht.

- Niedrige systematische und zufällige Fehler.

Die Tiefenkamera überträgt unformatierte modulierte IR-Bilder an den Host-PC. Auf dem PC konvertiert die GPU-beschleunigte Tiefenmodulsoftware das Rohsignal in Tiefenkarten. Die Tiefenkamera unterstützt mehrere Modi. Das schmale Sichtfeld (FoV) eignet sich ideal für Szenen mit kleineren Ausmaßen in X- und Y-Dimensionen, aber größere Ausmaße in der Z-Dimension. Wenn die Szene große X- und Y-Bereiche aufweist, aber kleinere Z-Bereiche, sind die breiten FoV-Modi besser geeignet.

Die Tiefenkamera unterstützt 2x2-Binningmodi, um den Z-Bereich im Vergleich zu den entsprechenden ungebinnten Modi zu erweitern. Die Binning erfolgt auf Kosten der Senkung der Bildauflösung. Alle Modi können mit bis zu 30 Frames pro Sekunde (fps) ausgeführt werden, mit Ausnahme des Mp-Modus (1 Megapixel), der mit einer maximalen Bildfrequenz von 15 fps läuft. Die Tiefenkamera bietet auch einen passiven IR-Modus. In diesem Modus sind die Leuchtmittel auf der Kamera nicht aktiv, und nur die Umgebungsbeleuchtung wird beobachtet.

Kameraleistung

Die Leistung der Kamera wird als systematische und zufällige Fehler gemessen.

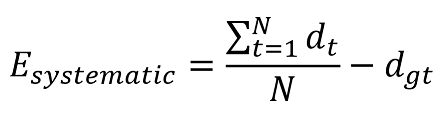

Systematischer Fehler

Systematischer Fehler wird als der Unterschied zwischen der Tiefe, die nach der Rauschentfernung gemessen wurde, und der richtigen Referenzwert-Tiefe definiert. Wir berechnen den zeitlichen Durchschnitt über viele Frames einer statischen Szene, um Tiefengeräusche so weit wie möglich zu beseitigen. Genauer gesagt wird der systematische Fehler wie folgt definiert:

Wenn dt die Messtiefe zum Zeitpunkt t angibt, ist N die Anzahl der frames, die im durchschnittlichen Verfahren verwendet werden, und dgt ist die Boden-Wahrheitstiefe.

Die systematische Fehlerspezifikation der Tiefenkamera schließt Multipfad-Interferenzen (MPI) aus. MPI ist der Zeitpunkt, an dem ein Sensorpixel Licht integriert, das von mehreren Objekten reflektiert wird. MPI wird teilweise in unserer Tiefenkamera durch die Verwendung höherer Modulationsfrequenzen abgemildert, zusammen mit der Tiefeninvaliderung, die wir später erläutern werden.

Zufälliger Fehler

Nehmen wir an, wir nehmen 100 Bilder desselben Objekts an, ohne die Kamera zu verschieben. Die Tiefe des Objekts unterscheidet sich in jedem der 100 Bilder geringfügig. Dieser Unterschied wird durch Schussgeräusche verursacht. Aufnahmegeräusche sind die Anzahl der Photonen, die den Sensor treffen, variiert je nach Zufallsfaktor im Laufe der Zeit. Wir definieren diesen zufälligen Fehler in einer statischen Szene als die Standardabweichung der Tiefe im Laufe der Zeit berechnet als:

Wenn N die Anzahl der Tiefenmessungen angibt, stellt dt die Tiefenmessung zum Zeitpunkt tdar und d zeigt den Mittelwert an, der über alle Tiefenmessungen dt berechnet wird.

Ungültigmachung

In bestimmten Situationen stellt die Tiefenkamera möglicherweise keine korrekten Werte für einige Pixel bereit. In diesen Situationen werden Tiefenpixel ungültig. Ungültige Pixel werden durch den Tiefenwert 0 angegeben. Gründe dafür, dass das Tiefenmodul keine korrekten Werte erzeugen kann, sind:

- Außerhalb der aktiven IR-Beleuchtungsmaske

- Gesättigtes IR-Signal

- Niedriges IR-Signal

- Ausreißer filtern

- Multipfad-Interferenzen

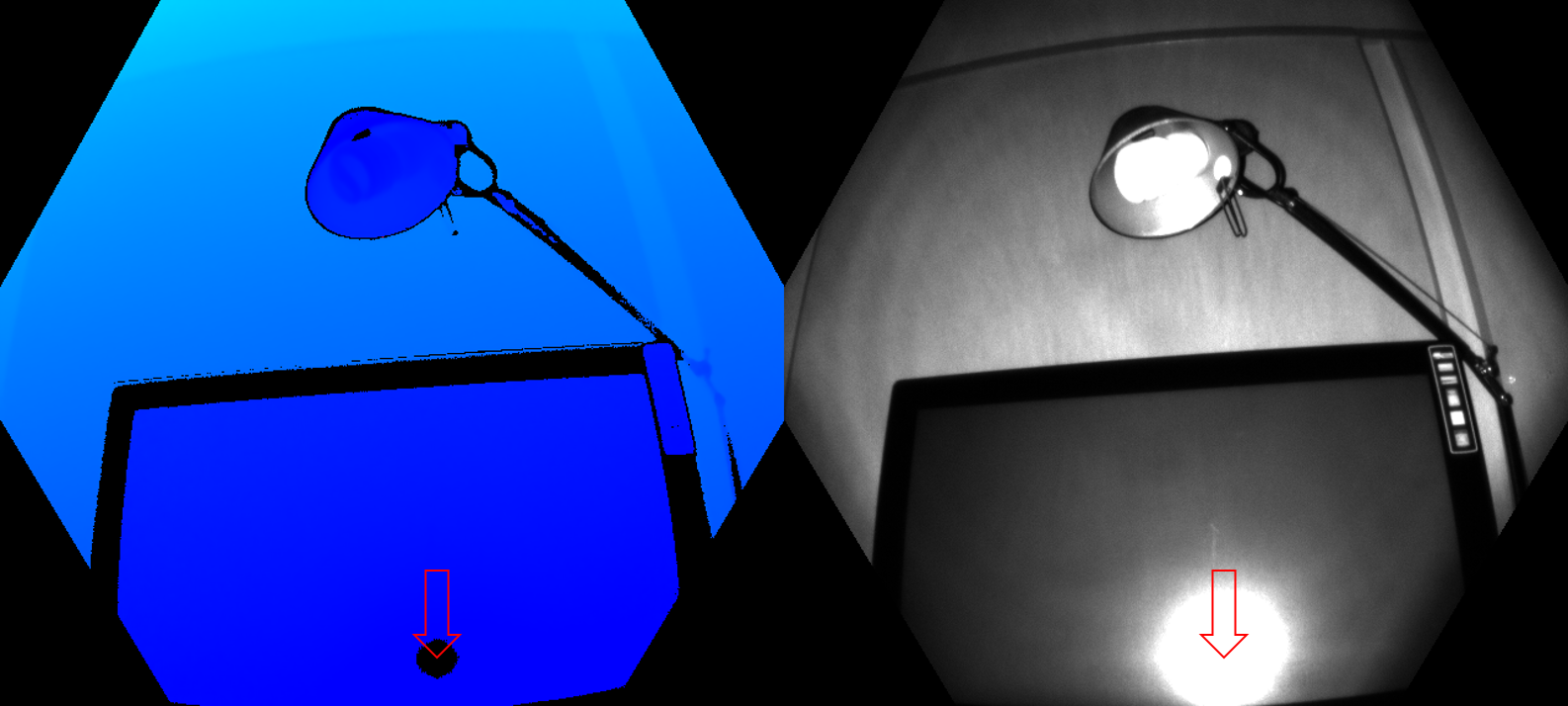

Lichtmaske

Pixel werden ungültig, wenn sie sich außerhalb der aktiven IR-Beleuchtungsmaske befinden. Es wird nicht empfohlen, das Signal solcher Pixel zur Berechnung der Tiefe zu verwenden. Die folgende Abbildung zeigt ein Beispiel für die Ungültigmachung durch eine Beleuchtungsmaske. Die ungültigen Pixel sind die schwarzfarbenen Pixel außerhalb des Kreises in den breiten FoV-Modi (links) und das Sechseck in den schmalen FoV-Modi (rechts).

Signalstärke

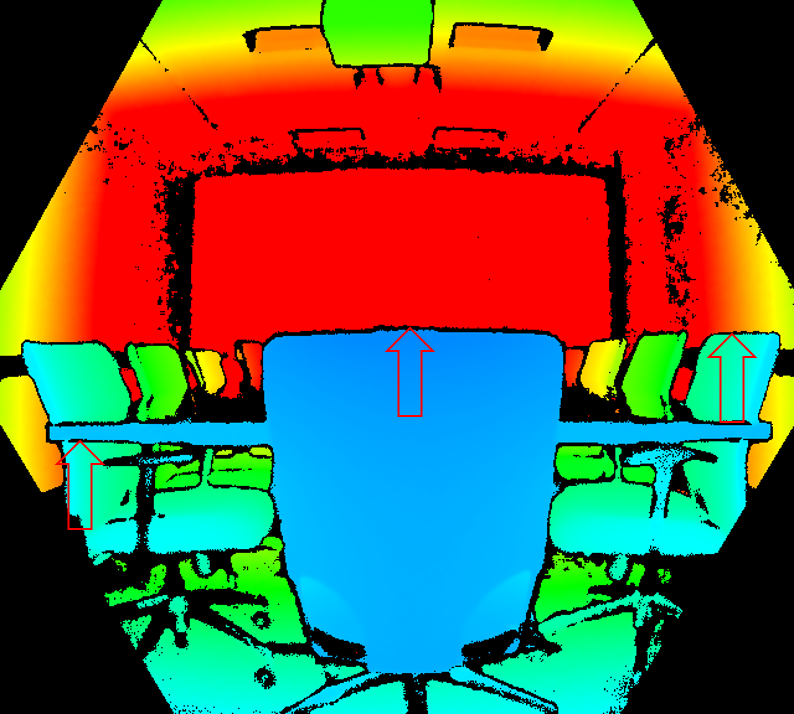

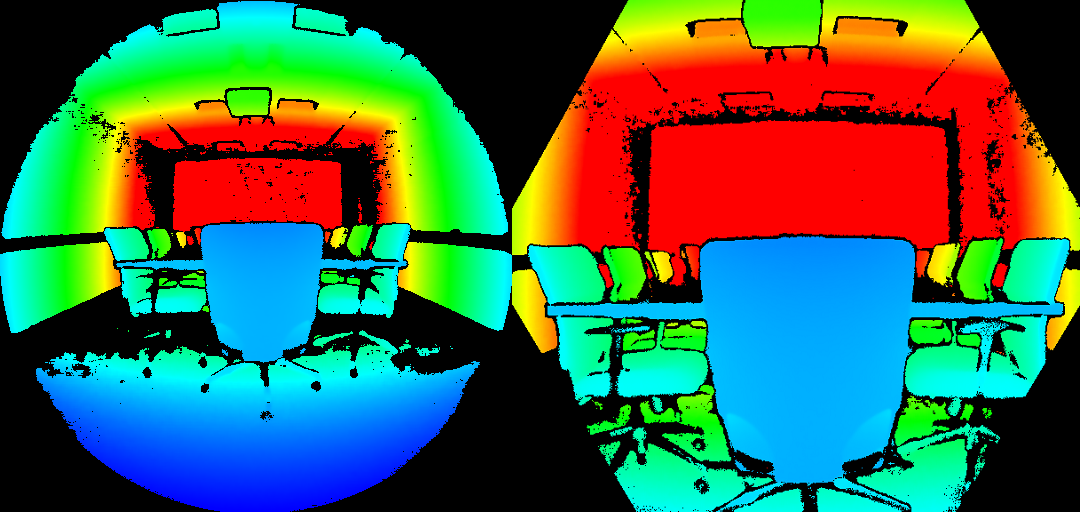

Pixel werden ungültig, wenn sie ein gesättigtes IR-Signal enthalten. Wenn Pixel gesättigt sind, gehen Phaseninformationen verloren. Die Abbildung unten zeigt das Beispiel einer Ungültigmachung durch ein gesättigtes IR-Signal. Siehe Pfeile, die auf die Beispielpixel in den Tiefen- und IR-Bildern zeigen.

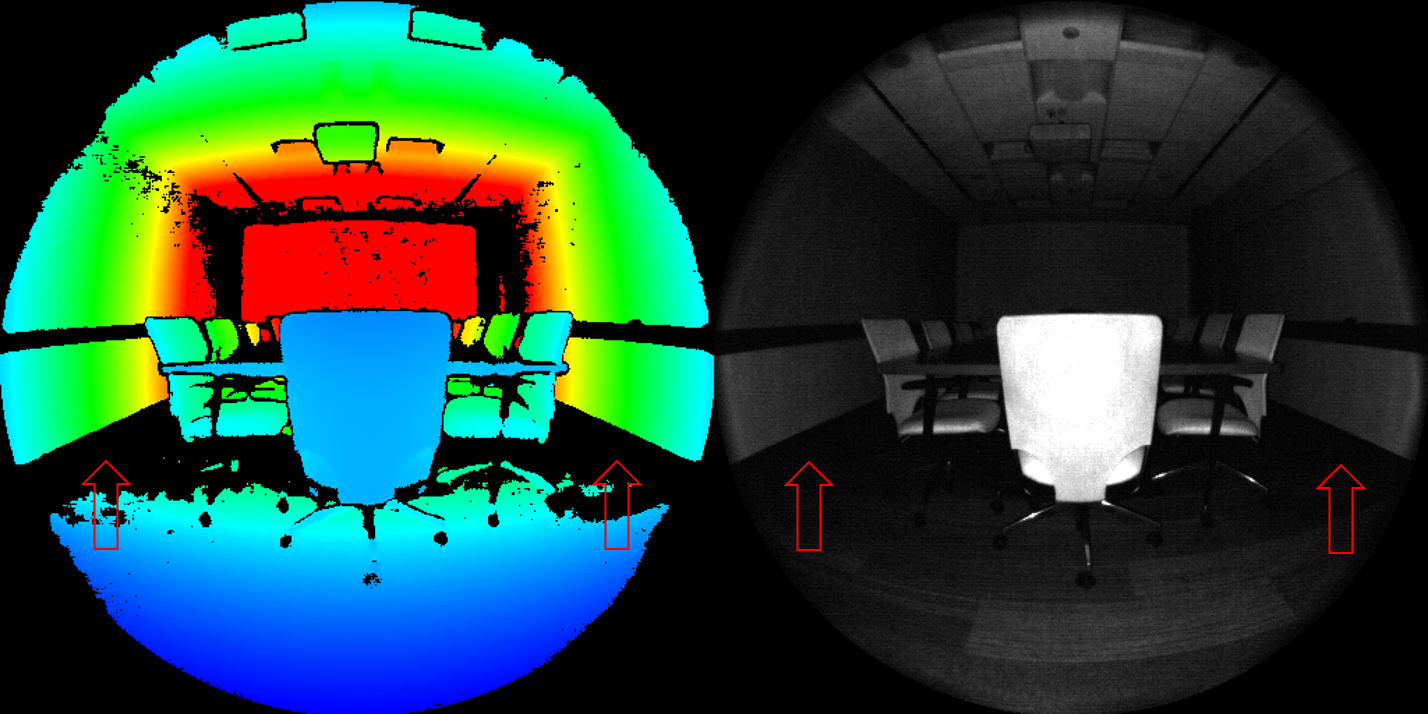

Eine Ungültigheit kann auch auftreten, wenn das IR-Signal nicht stark genug ist, um Tiefe zu generieren. Die folgende Abbildung zeigt das Beispiel einer Ungültigkeit durch ein niedriges IR-Signal. Sehen Sie sich die Pfeile an, die auf Beispielpixel in den Tiefen- und IR-Bildern zeigen.

Mehrdeutige Tiefe

Pixel können auch ungültig werden, wenn sie Signale von mehr als einem Objekt in der Szene empfangen haben. Ein gängiger Fall, in dem diese Art von Ungültigkeit vorkommen kann, ist in Ecken. Aufgrund der Szenengeometrie spiegelte sich das IR-Licht der Kamera von einer Wand auf die andere wider. Dieses reflektierte Licht verursacht Mehrdeutigkeit in der gemessenen Tiefe des Pixels. Filter im Tiefenalgorithmus erkennen diese mehrdeutigen Signale und machen die Pixel ungültig.

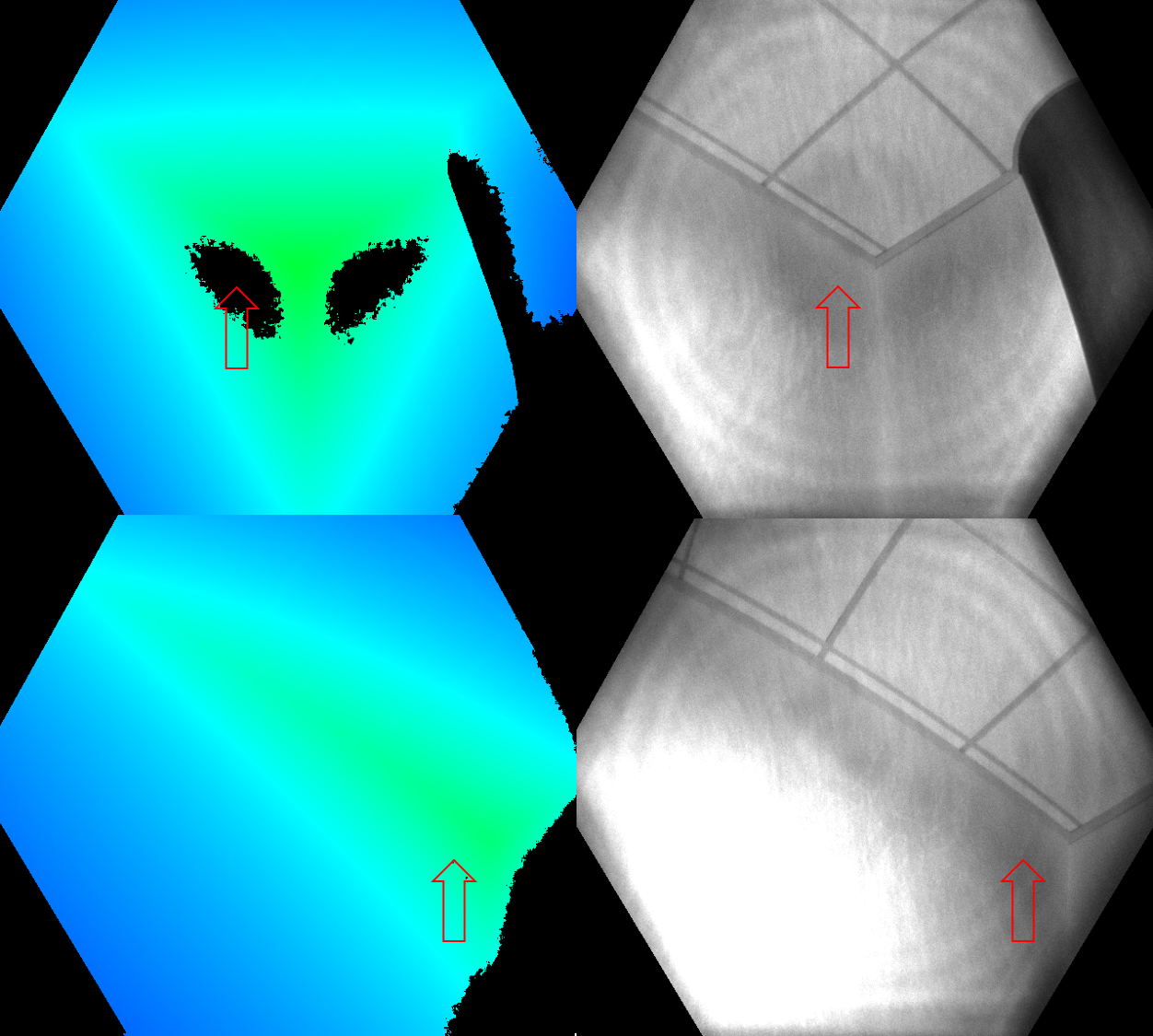

Die folgenden Abbildungen zeigen Beispiele für die Invalidierung durch die Erkennung mehrerer Pfade. Sie können auch sehen, wie derselbe Oberflächenbereich, der aus einer Kameraansicht (oberste Zeile) ungültig wurde, erneut aus einer anderen Kameraansicht (untere Zeile) angezeigt wird. Diese Abbildung zeigt, dass Oberflächen, die aus einer Perspektive ungültig sind, von einer anderen sichtbar sein können.

Ein weiterer gängiger Fall von Multipath ist Pixel, die das gemischte Signal aus Vordergrund und Hintergrund beinhalten (z. B. um Objektränder). Während der Schnellen Bewegung sehen Sie möglicherweise mehr ungültige Pixel um die Ränder. Die zusätzlichen ungültigen Pixel sind aufgrund des Belichtungsintervalls der rohen Tiefenaufnahme,