Überprüfen von KI-Open-Source-Bibliotheken

Open-Source-Software (OSS) ist ein integraler Bestandteil der modernen Softwareentwicklung, und KI-Systeme sind keine Ausnahme. KI-Projekte sind in der Regel von Open-Source-Frameworks, Modellbibliotheken, vortrainierten Modellen und Datenverarbeitungstools abhängig. Genau wie andere OSS-Komponenten führen KI-spezifische Bibliotheken Lieferkettenrisiken ein, die vor der Einführung eine umfassende Sicherheitsüberprüfung erfordern.

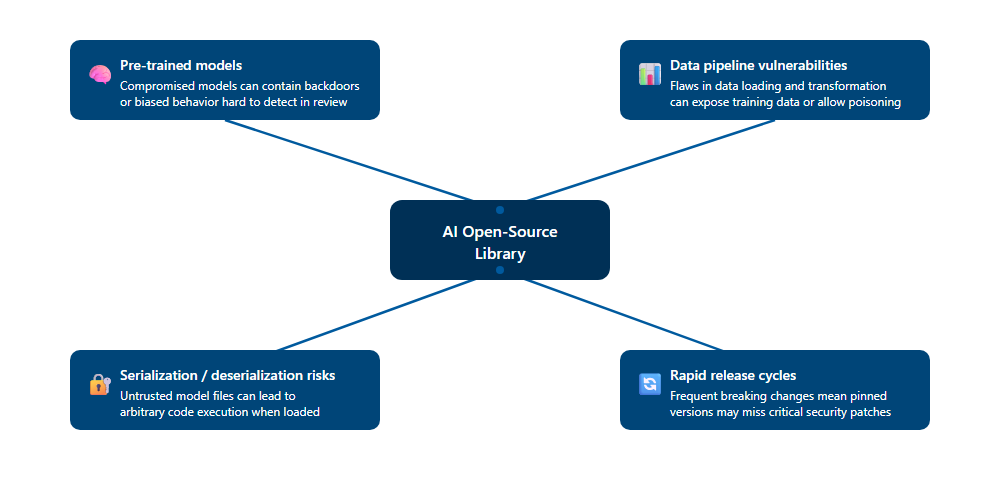

Warum KI-Open-Source-Bibliotheken besondere Aufmerksamkeit benötigen

AI OSS-Bibliotheken tragen einige Risiken, die über die herkömmlichen Softwareabhängigkeiten hinausgehen:

- Vortrainierte Modelle: Viele KI-Bibliotheken werden mit vortrainierten Modellen ausgeliefert oder heruntergeladen. Ein kompromittiertes Modell kann Hintertüren oder voreingenommenes Verhalten enthalten, das nur schwer durch die Codeüberprüfung erkannt werden kann.

- Datenpipelineabhängigkeiten: KI-Bibliotheken behandeln häufig Datenlade-, Transformations- und Featureextraktion. Sicherheitsrisiken in diesen Komponenten können Schulungsdaten offenlegen oder Datenvergiftungen zulassen.

- Serialisierungsrisiken: KI-Modelle werden häufig mithilfe von Serialisierungsformaten (z. B. Pickle in Python) gespeichert und geladen. Das Deserialisieren nicht vertrauenswürdiger Modelldateien kann zu einer beliebigen Codeausführung führen.

- Schnelle Veröffentlichungszyklen: KI-Bibliotheken entwickeln sich in einem rasanten Tempo und es kommt häufig zu bahnbrechenden Neuerungen und Änderungen. Organisationen, die ältere Versionen verwenden, verpassen möglicherweise kritische Sicherheitspatches.

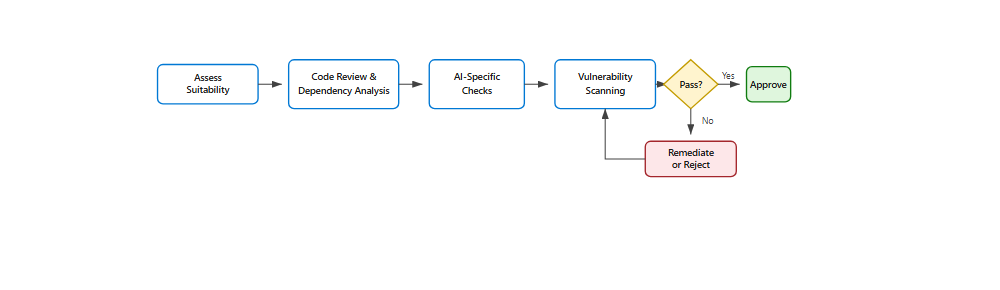

Bewerten der Eignung von OSS-Bibliotheken

Bevor Sie eine AI OSS-Bibliothek einführen, bewerten Sie sie aus funktionalen und sicherheitsrelevanten Perspektiven:

- Kontext und Zweck: Definieren Sie, warum Sie diese Bibliothek überprüfen. Integrieren Sie sie in ein Produktionssystem, verwenden sie für Experimente oder evaluieren sie gegen Alternativen? Legen Sie klare Akzeptanzkriterien für die Überprüfung fest.

- Risikobewertung: Berücksichtigen Sie die potenziellen Risiken der Verwendung der Bibliothek. Verwenden Sie die Bedrohungsmodellierung, um Angriffsvektoren zu identifizieren – wie passt diese Bibliothek in die Angriffsfläche Ihrer Anwendung? Was geschieht, wenn die Bibliothek kompromittiert wird?

- Lizenzcompliance: Überprüfen Sie, ob die Lizenz der Bibliothek mit den Richtlinien Ihrer Organisation kompatibel ist, insbesondere für kommerzielle oder staatliche Zwecke.

- Wartungsstatus: Überprüfen Sie, wie aktiv die Bibliothek verwaltet wird. Achten Sie auf die Häufigkeit der Commits, die Reaktionszeiten bei Problemen und die Anzahl der aktiven Mitwirkenden. Verlassene oder minimal verwaltete Bibliotheken sind ein höheres Risiko.

Codeüberprüfung und Abhängigkeitsanalyse

Führen Sie eine technische Überprüfung des Codes der Bibliothek und ihrer Abhängigkeitskette durch:

- Codeüberprüfung: Überprüfen Sie den Quellcode der Bibliothek auf Sicherheitsfehler wie Einfügungsrisiken, unsichere kryptografische Praktiken und unsichere Deserialisierung. Achten Sie auf Authentifizierungsmechanismen, Eingabeüberprüfung und Fehlerbehandlung.

- Abhängigkeitsbewertung: Bewerten der transitiven Abhängigkeiten der Bibliothek. Veraltete oder anfällige Komponenten in der Abhängigkeitsstruktur können Risiken mit sich bringen, auch wenn der eigene Code der Bibliothek sicher ist.

- Softwarekompositionsanalyse (SCA): Verwenden Sie automatisierte SCA-Tools, um bekannte Schwachstellen (CVEs) in der Bibliothek und deren Abhängigkeiten zu identifizieren. Viele Organisationen integrieren diese Tools in ihre CI/CD-Pipeline, um Probleme frühzeitig abzufangen.

KI-spezifische Lieferkettenkontrollen

Wenden Sie über standardmäßige OSS-Überprüfungsmethoden hinaus diese KI-spezifischen Steuerelemente an:

- Modell-Provenienzüberprüfung: Wenn eine Bibliothek vortrainierte Modelle enthält, überprüfen Sie, wo das Modell stammt, wer es trainiert hat und ob die Schulungsdaten und -prozesse dokumentiert sind. Eine KI-Materialrechnung (AI-BOM) – ein strukturiertes Inventar von Modellkomponenten, Schulungsdatenquellen und Abhängigkeiten – hilft dabei, vertrauen zu können.

- Modellüberprüfung: Scannen Sie heruntergeladene Modelldateien nach bekannten schädlichen Nutzlasten, bevor Sie sie laden. Vermeiden Sie das Deserialisieren von Modelldateien aus nicht vertrauenswürdigen Quellen.

- Reproduzierbarkeitsprüfungen: Überprüfen Sie nach Möglichkeit, ob Modelle aus dokumentierten Schulungsdaten und -konfigurationen reproduziert werden können. Dadurch wird sichergestellt, dass das Modell nicht manipuliert wurde.

- Sandbox-Evaluierung: Testen Sie neue KI-Bibliotheken in isolierten Umgebungen, bevor Sie sie in der Produktion bereitstellen, um unerwarteten Verhaltensweisen vorzubeugen.

Überprüfung und Behebung von Sicherheitsrisiken

Gehen Sie nicht davon aus, dass andere Schwachstellenüberprüfungen durchgeführt haben. Wenden Sie Ihre eigene Bewertungstoolkette an:

- Umfassende Scans: Verwenden Sie Sicherheitsrisikoscanner, um potenzielle Sicherheitsschwächen in der Bibliothek und deren Abhängigkeiten zu identifizieren.

- Priorisierte Behebung: Wenn Sicherheitsrisiken erkannt werden, bewerten Sie ihre Auswirkungen und Exploitbarkeit. Priorisieren Sie Korrekturen basierend auf Schweregrad und Exposition.

- Kontinuierliche Überwachung: OsS-Sicherheitsrisikodatenbanken werden regelmäßig aktualisiert. Richten Sie automatisierte Warnungen für neue CVEs ein, die Sich auf Bibliotheken in Ihrem KI-Stapel auswirken.