Entwerfen einer Datenintegrationslösung mit Azure Data Factory

Azure Data Factory ist ein cloudbasierter Datenintegrationsdienst, mit dem Sie datengesteuerte Workflows erstellen und planen können. Sie können Azure Data Factory verwenden, um Datenverschiebungen zu orchestrieren und Daten im großen Stil zu transformieren. Die datengesteuerten Workflows oder Pipelines erfassen Daten aus unterschiedlichen Datenspeichern. Azure Data Factory ist ein ETL-Datenintegrationsprozess, was für Extrahieren, Transformieren und Laden steht. Bei diesem Integrationsprozess werden Daten aus mehreren Datenquellen in einem einzigen Datenspeicher kombiniert.

Wissenswertes über Azure Data Factory

Es gibt vier Hauptschritte zum Erstellen und Implementieren eines datengesteuerten Workflows in der Azure Data Factory-Architektur:

- Verbinden und Sammeln. Zunächst erfassen Sie die Daten, um alle Daten aus verschiedenen Quellen an einem zentralen Ort zu sammeln.

- Transformieren und Anreichern. Als Nächstes transformieren Sie die Daten mithilfe eines Computediensts wie Azure Databricks und Azure HDInsight Hadoop.

- Bereitstellen von Continuous Integration und Continuous Delivery (CI/CD) und Veröffentlichen. Unterstützen Sie CI/CD, indem Sie GitHub und Azure Pipelines verwenden, um den ETL-Prozess schrittweise bereitzustellen, bevor Sie die Daten an die Analyse-Engine veröffentlichen.

- Monitor. Schließlich verwenden Sie das Azure-Portal, um die Pipeline auf geplante Aktivitäten sowie auf Ausfälle zu überwachen.

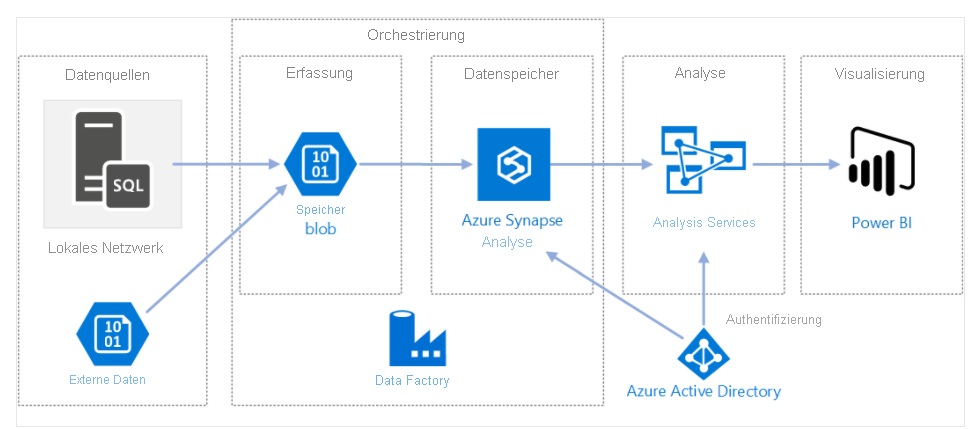

Das folgende Diagramm zeigt, wie Azure Data Factory die Erfassung von Daten aus verschiedenen Datenquellen orchestriert. Daten werden in einem Speicherblob erfasst und in Azure Synapse Analytics gespeichert. Analyse- und Visualisierungskomponenten sind ebenfalls mit Azure Data Factory verbunden. Azure Data Factory bietet eine gemeinsame Verwaltungsschnittstelle für all Ihre Datenintegrationsanforderungen.

Komponenten von Azure Data Factory

Azure Data Factory verfügt über die folgenden Komponenten, die zusammenarbeiten, um die Plattform für Datenverschiebung und Datenintegration bereitzustellen.

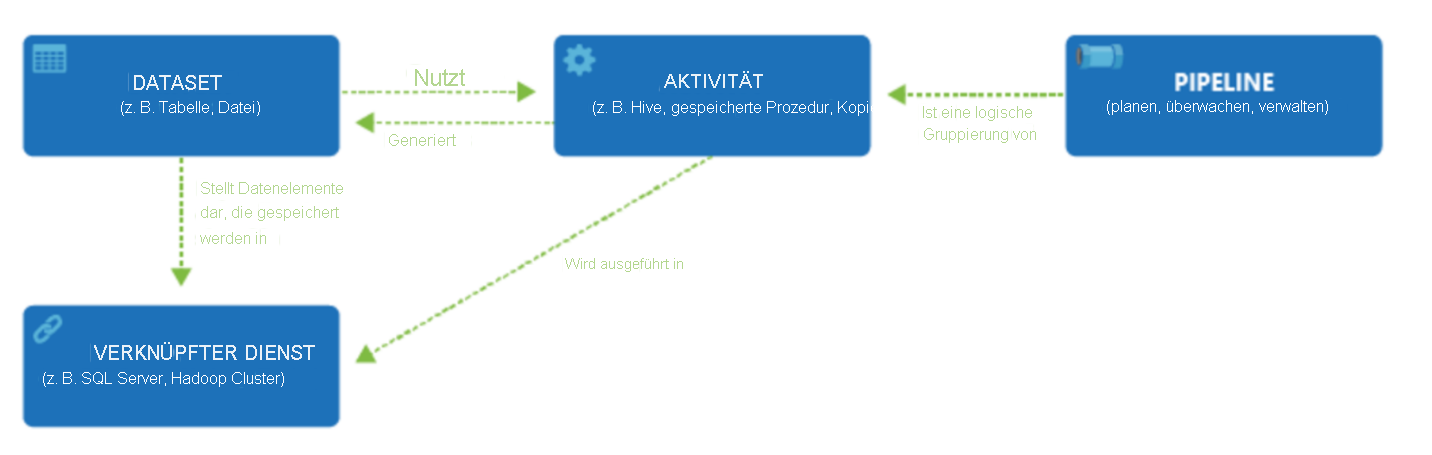

- Pipelines und Aktivitäten: Pipelines bieten eine logische Gruppierung von Aktivitäten, die eine Aufgabe erfüllen. Eine Aktivität ist einzelner Verarbeitungsschritt in einer Pipeline. Azure Data Factory unterstützt Aktivitäten zur Datenverschiebung, zur Datentransformation und zur Steuerung.

- Datasets: Datasets sind Datenstrukturen in Ihren Datenspeichern.

- Verknüpfte Dienste: Verknüpfte Dienste definieren die erforderlichen Verbindungsinformationen, die Azure Data Factory zum Herstellen einer Verbindung mit externen Ressourcen benötigt.

- Datenflüsse: Mit Datenflüssen können technische Fachkräfte für Daten Datentransformationslogik entwickeln, ohne Code schreiben zu müssen. Datenflussaktivitäten können mithilfe vorhandener Planungs-, Steuerungs-, Fluss- und Überwachungsfunktionen in Data Factory operationalisiert werden.

- Integration Runtimes: Integration Runtimes bilden die Brücke zwischen der Aktivität und verknüpften Dienstobjekten. Es gibt drei Arten der Integration Runtime: Azure, selbstgehostet und Azure-SSIS.

Geschäftsszenario

Eine große Herausforderung für einen schnell wachsenden Einzelhändler für Heimwerkerbedarf wie Tailwind Traders besteht darin, dass große Datenmengen generiert werden, die in relationalen, nicht relationalen und anderen Speichersystemen sowohl in der Cloud als auch lokal gespeichert sind. Die Geschäftsleitung möchte möglichst in Quasi-Echtzeit umsetzbare geschäftliche Erkenntnisse aus diesen Daten gewinnen. Darüber hinaus möchte das Vertriebsteam Up-Selling- und Cross-Selling-Lösungen einrichten und einführen. Wie können Sie eine groß angelegte Datenerfassungslösung in der Cloud erstellen? Welche Azure-Dienste und -Lösungen sollten Sie einsetzen, um die Verschiebung und Transformation von Daten zwischen verschiedenen Datenspeichern und Computeressourcen zu unterstützen?

Sehen wir uns an, inwiefern die Komponenten von Azure Data Factory an einem Szenario zur Datenaufbereitung und -verschiebung für Tailwind Traders beteiligt sind. Das Unternehmen verfügt über viele verschiedene Datenquellen, mit denen eine Verbindung hergestellt werden muss, und es müssen gespeicherte Prozeduren für diese Daten ausgeführt werden, um sie zu erfassen und zu transformieren. Schließlich sollen die Daten zur Analyse per Push an die Analyseplattform übertragen werden.

- In diesem Szenario ermöglicht der verknüpfte Dienst Tailwind Traders das Erfassen von Daten aus verschiedenen Quellen und speichert Verbindungszeichenfolgen, um Computedienste bei Bedarf zu starten.

- Sie können gespeicherte Prozeduren für die Datentransformation ausführen, die über den verknüpften Dienst in Azure SSIS erfolgt. Dabei handelt es sich um die Integration Runtime-Umgebung für Tailwind Traders.

- Die Datasetkomponenten werden vom Aktivitätsobjekt verwendet, und das Aktivitätsobjekt enthält die Transformationslogik.

- Sie können die Pipeline auslösen, bei der es sich um eine Gruppierung aller Aktivitäten handelt.

- Sie können mit Azure Data Factory das finale Dataset veröffentlichen, das von Technologien wie Power BI oder Machine Learning genutzt wird.

Zu beachtende Punkte beim Verwenden von Azure Data Factory

Bewerten Sie Azure Data Factory anhand der folgenden Entscheidungskriterien, und überlegen Sie, wie Ihre Datenintegrationslösung für Tailwind Traders von dem Dienst profitieren kann.

- Berücksichtigen von Anforderungen an die Datenintegration. Azure Data Factory dient zwei Communitys: der Big Data-Community und der Community für relationale Data Warehouses, die SQL Server Integration Services (SSIS) verwendet. Abhängig von den Datenanforderungen Ihrer Organisation können Sie mithilfe von Azure Data Factory Pipelines in der Cloud einrichten. Sie können auf Daten aus cloudbasierten und lokalen Datendiensten zugreifen.

- Berücksichtigen von Programmierressourcen. Wenn Sie eine grafische Benutzeroberfläche zum Einrichten von Pipelines bevorzugen, ist das Azure Data Factory-Erstellungs- und Überwachungstool die richtige Lösung für Ihre Anforderungen. Azure Data Factory erfordert wenig bis keinen Programmieraufwand bei der Arbeit mit Datenquellen.

- Berücksichtigen der Unterstützung für mehrere Datenquellen. Azure Data Factory unterstützt mehr als 90 Connectors für die Integration mit unterschiedlichen Datenquellen.

- Berücksichtigen einer serverlosen Infrastruktur. Es gibt Vorteile bei der Verwendung einer vollständig verwalteten, serverlosen Lösung für die Datenintegration. Es ist nicht erforderlich, Server zu warten, zu konfigurieren oder bereitzustellen, und Sie erhalten die Möglichkeit, bei schwankenden Workloads skalieren zu können.