Auswerten von generativer KI

Bewertungen sind systematische Prozesse zur Bewertung der Leistung, Zuverlässigkeit und Wirksamkeit von generativen KI-Anwendungen. Diese Bewertungen umfassen eine Reihe von Tests und Metriken, die darauf ausgelegt sind, zu quantifizieren, wie gut ein KI-Modell seine beabsichtigte Aufgabe ausführt. Ziel ist es, sicherzustellen, dass sich die KI-Anwendung erwartungsgemäß verhält und in verschiedenen Szenarien genaue und relevante Ergebnisse liefert.

Bewertungen sind aus mehreren Gründen von entscheidender Bedeutung:

- Qualitätssicherung: Sie helfen dabei, sicherzustellen, dass die KI-Systeme die gewünschten Standards für Genauigkeit und Zuverlässigkeit erfüllen.

- Leistungsmetriken: Auswertungen liefern wesentliche Daten über die Effektivität der Ergebnisse der KI-App, wobei Bereiche zur Verbesserung hervorgehoben werden.

- Bias Detection: Sie helfen bei der Identifizierung und Messung der Prävalenz von Verzerrungen, die im KI-Modell vorhanden sind, wobei Bereiche zur Verbesserung hervorgehoben werden.

- Benutzervertrauen: KI-Anwendungen, die konsistent gut funktionieren, helfen, Vertrauen mit Benutzern zu schaffen, höhere Zufriedenheit und Nutzung zu verdienen.

KI-unterstützte Auswertungen mit Azure

Die Bewertung von Modellen der künstlichen Intelligenz stellt aufgrund ihrer dynamischen und oft kreativen Ergebnisse einzigartige Herausforderungen dar. Herkömmliche Auswertungsmethoden erfassen möglicherweise nicht vollständig die Ungenauigkeiten von generativen Modellen und erfordern spezialisiertere Ansätze. So stellen wir KI-unterstützte Auswertungen bereit, die maschinelle Lerntechniken verwenden, um den Evaluierungsprozess zu erweitern. Die Auswahl von Modellen für die KI-unterstützte Auswertung kann die Ergebnisse erheblich beeinflussen. Daher empfehlen wir, Ihre Auswertungen mit dem unterstützten GPT 3.5-, GPT 4- oder Davinci-Modell für Ihre Berechnungen zu testen und zu vergleichen.

Sie haben die Flexibilität, Evaluierungen mit Azure entweder über die Benutzeroberfläche in Azure AI Foundry oder programmgesteuert mit dem Azure AI Evaluation SDK auszuführen. Beide Tools bieten Zugriff auf eine Reihe von Leistungs- und Qualitäts- und Risiko- und Sicherheitsmetriken. Programmgesteuert können Sie jedoch auch eigene codebasierte und promptbasierte benutzerdefinierte Auswertungen erstellen und ihre benutzerdefinierten Bewerter auch bei Ihrem Azure AI-Projekt protokollieren.

Bewerten mit Azure AI Foundry

Azure AI Foundry unterstützt die Ausführung manueller und automatisierter Auswertungen. Die manuelle Auswertung ermöglicht es menschlichen Bewertenden, generierte Ergebnisse sowohl für manuelle Eingaben als auch für einen hochgeladenen Datensatz manuell zu bewerten. Nachdem Sie die Auswertung abgeschlossen haben, können Sie jeder Antwort einen Daumen hoch oder runter geben, um das Ergebnis der Eingabeaufforderung zu beurteilen. Beim Abmildern bestimmter Risiken ist es hilfreich, den Fortschritt manuell mit einem kleinen Datensatz zu überprüfen, bis Anzeichen des Risikos nicht mehr beobachtet werden, bevor man zur automatisierten Auswertung übergeht.

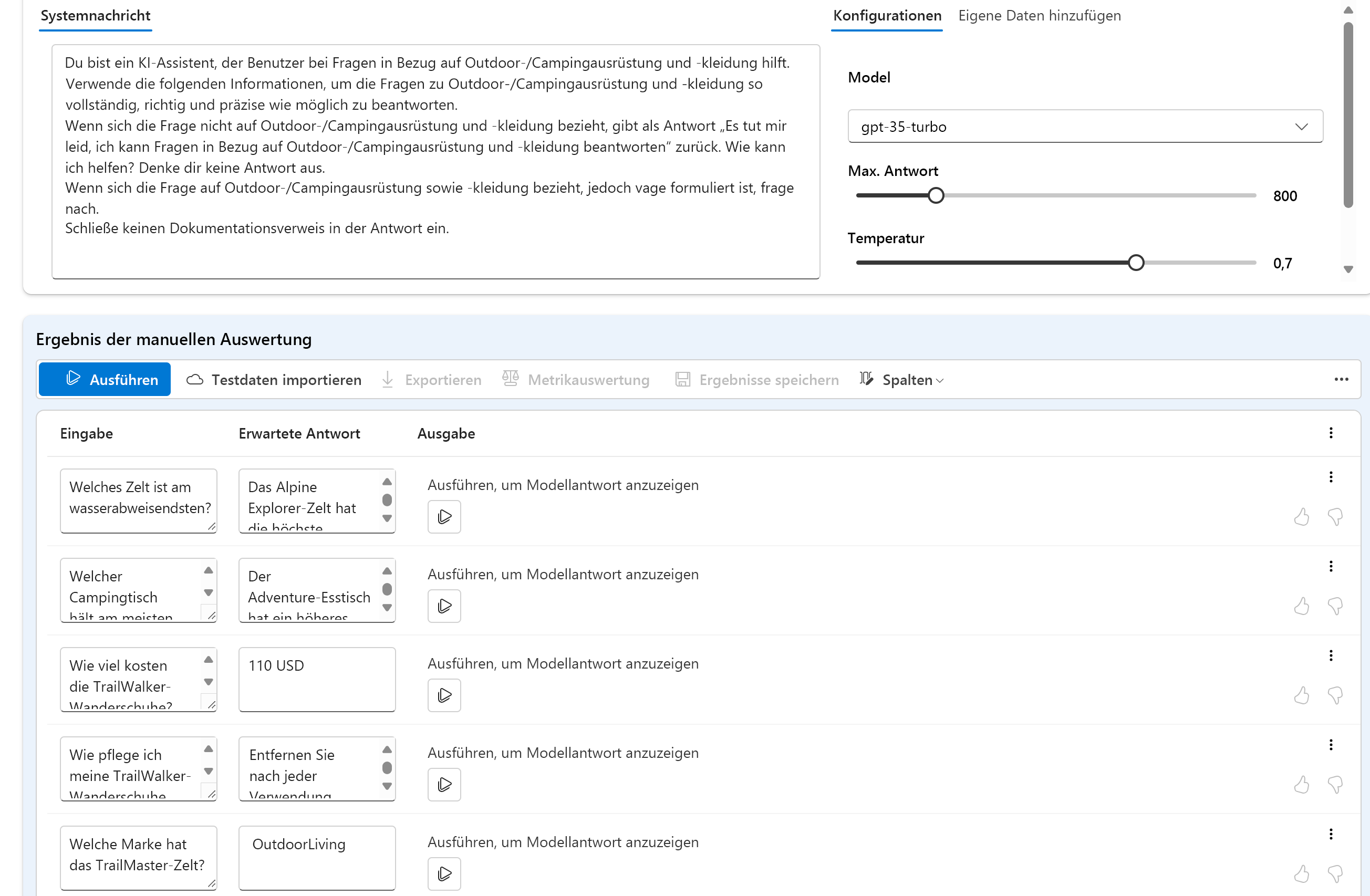

Diese Abbildung zeigt einen Screenshot der Azure AI Foundry-Schnittstelle, die sich auf das Einrichten und Bewerten eines KI-Assistenten für einen Camping store-Chatbot konzentriert. Die Schnittstelle verfügt über ein Helles Farbschema mit blauen Akzenten. Der Bildschirm ist in mehrere Abschnitte unterteilt: Assistenteneinrichtung, manuelles Auswertungsergebnis und Auswertungstabelle. Die Benutzeroberfläche umfasst verschiedene Symbole und Tools für die Navigation und Interaktion, wie z. B. Bearbeiten, Abspielen und Daumen nach oben/unten-Schaltflächen für jede Antwort. Dieser Screenshot enthält Einblicke in den Prozess der Einrichtung, Schulung und Auswertung eines KI-Assistenten für einen bestimmten Anwendungsfall im E-Commerce.

Mithilfe der automatisierten Auswertung können Sie Ausgaben für jede Datenzeile in Ihrem Test-Dataset generieren. Sie können eine oder mehrere integrierte Auswertungsmetriken auswählen, um die Ausgabe für verschiedene Qualitäten zu bewerten.

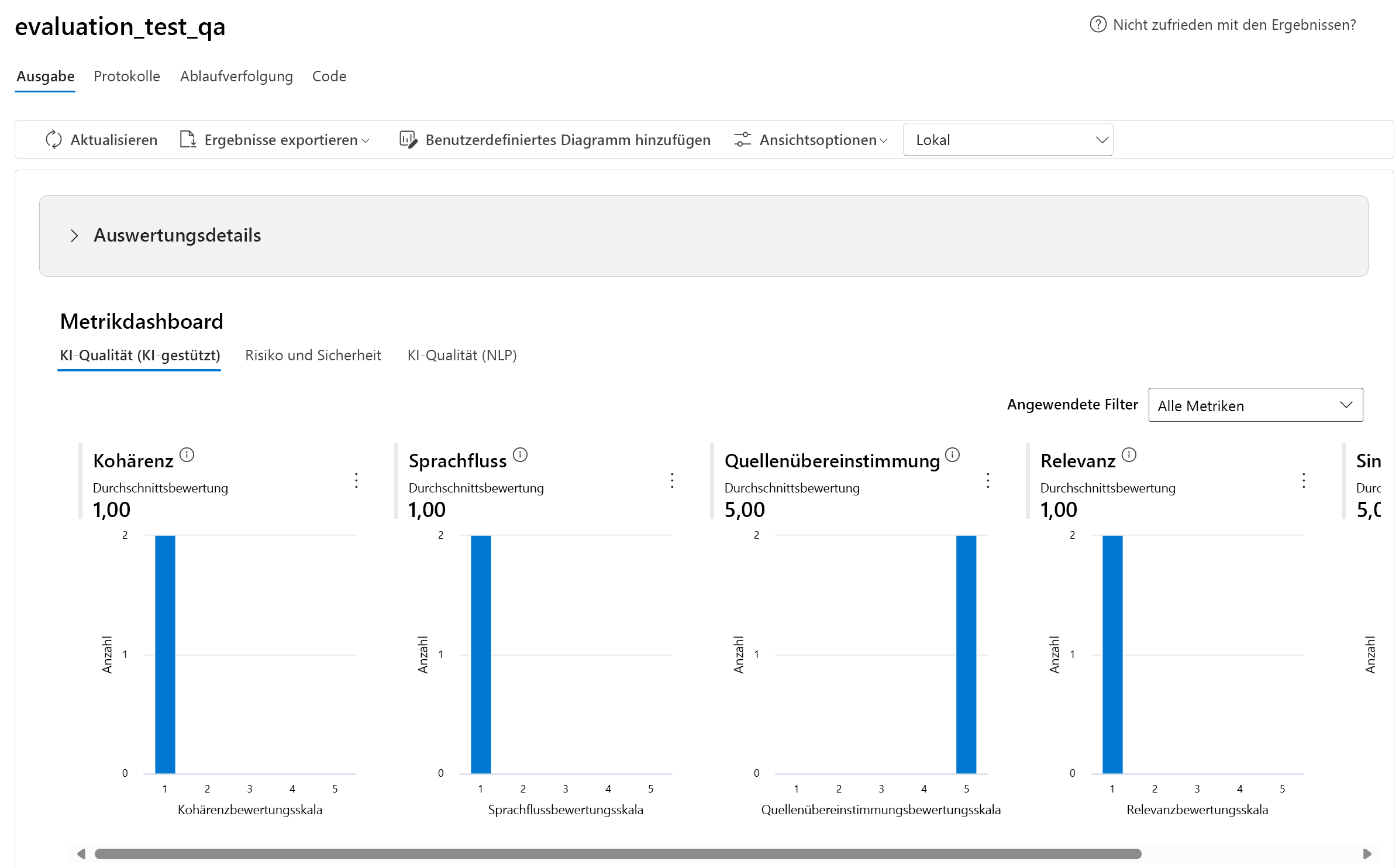

Die Abbildung zeigt einen Screenshot der Azure AI Foundry-Schnittstelle mit einem Auswertungsdashboard für ein Projekt mit dem Namen "evaluation_test_qa". Die Schnittstelle verfügt über ein sauberes, modernes Design mit einem Lichtfarbschema. Oben auf dem Bildschirm befindet sich eine Kopfzeile mit dem Azure AI Foundry-Logo, dem Projektnamen und verschiedenen Symbolen für Benachrichtigungen, Einstellungen und Projektauswahl. Der Hauptinhaltsbereich ist in zwei Abschnitte unterteilt: Auswertungsdetails, metrisches Dashboard. Jede Metrik weist ein Informationssymbol daneben auf, und es stehen weitere Details zur Verfügung. Oben rechts im Metrikdashboard befindet sich ein Dropdownmenü "Angewendete Filter", das auf "Alle Metriken" eingestellt ist. Die linke Seite des Bildschirms enthält ein Navigationsmenü mit verschiedenen Symbolen für verschiedene Abschnitte oder Tools in Azure AI Foundry. Dieses Dashboard bietet eine umfassende Übersicht über die Leistung des KI-Modells über mehrere Bewertungskriterien hinweg, sodass Entwickler die Ausgabequalität ihres Modells bewerten und verbessern können.

Auswerten mit dem Azure KI-Auswertungs-SDK

Anhand eines Testdatasets oder eines Ziels werden die Generierungen Ihrer generativen KI-Anwendung quantitativ mit mathematischen Metriken und KI-gestützten Qualitäts- und Sicherheitsauswertungen gemessen. Integrierte oder benutzerdefinierte Auswertungsfunktionen bieten Ihnen umfassende Einblicke in die Fähigkeiten und Grenzen der Anwendung. Die programmgesteuerte Durchführung von Auswertungen bietet die Flexibilität, in vorhandene Workflows und Pipelines zu integrieren. Obwohl programmgesteuerte Auswertungen nicht in Azure AI Foundry ausgeführt werden, können Sie Ihre Auswertungsergebnisse in Ihrem Azure AI Foundry-Projekt nachverfolgen und vergleichen.

Im Allgemeinen sollte ein Gleichgewicht zwischen automatisierten und menschlichen Bewertungen bestehen. Um quantitative und qualitative Erkenntnisse zu erfassen, verwenden Sie eine Kombination aus KI-unterstützten Bewertungen und menschlicher Bewertung.