Auswerten und Vergleichen von Modellen

Wenn ein automatisiertes Machine Learning (AutoML)-Experiment abgeschlossen ist, möchten Sie die Modelle überprüfen, die trainiert wurden, und entscheiden, welche am besten ausgeführt wurde.

Im Azure Machine Learning-Studio können Sie ein AutoML-Experiment auswählen, um seine Details zu erkunden.

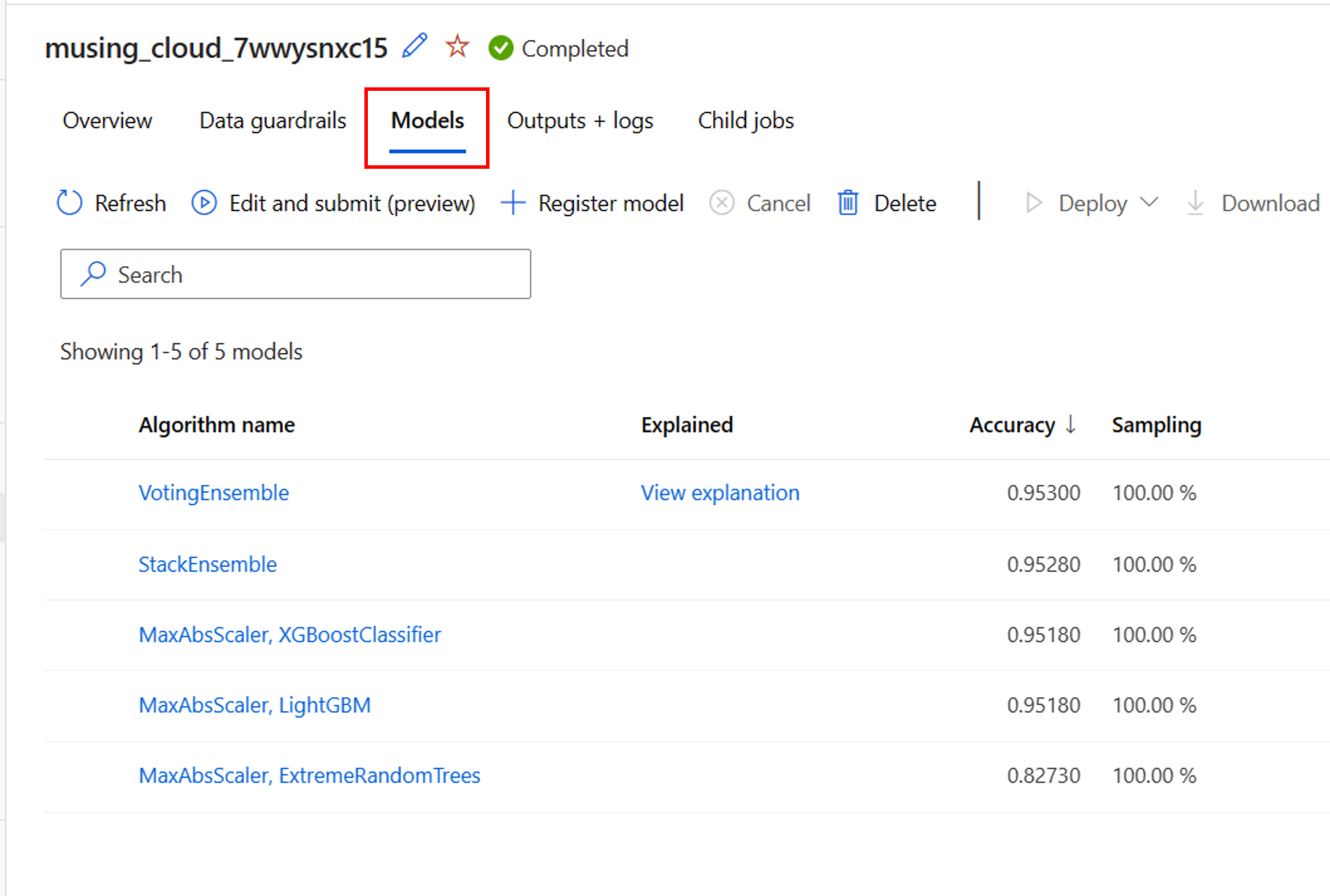

Auf der Seite "Übersicht" des AutoML-Experimentlaufs können Sie die Eingabedatenressource und die Zusammenfassung des besten Modells überprüfen. Um alle modelle zu erkunden, die trainiert wurden, können Sie die Registerkarte "Modelle " auswählen:

Erkunden von Vorverarbeitungsschritten

Wenn Sie die Featurierung für Ihr AutoML-Experiment aktiviert haben, werden auch Datenschutzschienen automatisch angewendet. Die drei Datenleitschienen, die für Klassifizierungsmodelle unterstützt werden, sind:

- Erkennung des Klassenausgleichs.

- Fehlende Merkmalswerte-Imputation.

- Erkennung von Features mit hoher Kardinalität.

Jede dieser Datenschutzleitplanken zeigt einen von drei möglichen Zuständen:

- Übergeben: Es wurden keine Probleme erkannt, und es ist keine Aktion erforderlich.

- Fertig: Änderungen wurden auf Ihre Daten angewendet. Überprüfen Sie die Änderungen, die AutoML an Ihren Daten vorgenommen hat.

- Warnung: Ein Problem wurde erkannt, konnte aber nicht behoben werden. Überprüfen Sie die Daten, um das Problem zu beheben.

Neben Data Guardrails kann AutoML Skalierungs- und Normalisierungstechniken auf jedes Modell anwenden, das trainiert wird. Sie können die in der Liste der Modelle unter "Algorithmusname" angewendete Technik überprüfen.

Beispielsweise kann der Algorithmusname eines aufgelisteten Modells sein MaxAbsScaler, LightGBM.

MaxAbsScaler bezieht sich auf eine Skalierungstechnik, bei der jedes Feature um seinen maximalen Absolutenwert skaliert wird.

LightGBM bezieht sich auf den Klassifizierungsalgorithmus, der zum Trainieren des Modells verwendet wird.

Abrufen des besten Durchlaufs und seines Modells

Wenn Sie die Modelle in AutoML überprüfen, können Sie die beste Ausführung ganz einfach anhand der von Ihnen angegebenen primären Metrik identifizieren. Im Azure Machine Learning-Studio werden die Modelle automatisch sortiert, um das leistungsstärkste Modell oben anzuzeigen.

Auf der Registerkarte "Modelle " des AutoML-Experiments können Sie die Spalten bearbeiten , wenn Sie andere Metriken in derselben Übersicht anzeigen möchten. Durch die Erstellung einer umfassenderen Übersicht, die verschiedene Metriken enthält, kann es einfacher sein, Modelle zu vergleichen.

Um ein Modell noch weiter zu erkunden, können Sie Erklärungen für jedes Modell generieren, das trainiert wurde. Beim Konfigurieren eines AutoML-Experiments können Sie angeben, dass Erklärungen für das leistungsstärkste Modell generiert werden sollen. Wenn Sie jedoch an der Interpretationsfähigkeit eines anderen Modells interessiert sind, können Sie das Modell in der Übersicht auswählen und das Erklären-Modell auswählen.

Hinweis

Die Erläuterung eines Modells ist eine Annäherung an die Interpretationsfähigkeit des Modells. Insbesondere werden Erläuterungen die relative Bedeutung von Features für das Ziel-Feature schätzen, was das Modell vorhersagen soll. Erfahren Sie mehr über die Modellinterpretierbarkeit.

Tipp

Erfahren Sie mehr darüber, wie Sie AutoML-Ausführungen auswerten.

AutoML bietet Ihnen einen starken Ausgangspunkt – es sucht allgemein und zeigt den besten Algorithmus und die Vorverarbeitungskombination für Ihre Daten an. Aber manchmal möchten Sie weiter gehen: Passen Sie Hyperparameter an, entwickeln Sie benutzerdefinierte Features, oder testen Sie einen Ansatz, der von AutoML nicht abgedeckt wird. Hier kommen Notizbücher ein.