Multimodale Modelle für die Bildanalyse

Hinweis

Weitere Details finden Sie auf der Registerkarte "Text und Bilder ".

Immer mehr neue KI-Modelle sind multimodal. Mit anderen Worten, sie unterstützen mehrere Arten von Eingabedaten, einschließlich Bildern und Text. Multimodale Modelle sind KI-Modelle , die mehrere Datentypen gleichzeitig verstehen und arbeiten können, z. B. Text, Bilder, Audio oder Video. Beispielsweise könnte das multimodale Modell ein Bild in natürlicher Sprache beschreiben oder eine Frage zu einem Foto beantworten.

Multimodale Modelle werden häufig als Teil von:

- KI-Anwendungen, bei denen das Bildverständnis Benutzerworkflows verbessert

- KI-Agents, bei denen visuelle Eingaben dem Agenten helfen, bessere Entscheidungen zu treffen

Beispiele sind:

- Ein Agent, der hochgeladene Dokumente und Screenshots überprüft

- Eine Support-App, die von Kunden übermittelte Fotos analysiert

- Ein Lernwerkzeug, das Diagramme in einfacher Sprache erläutert.

Da multimodale Modelle sowohl Text als auch Bilder akzeptieren, reduzieren sie die Notwendigkeit separater Vision-Pipelines und erleichtern die Erstellung intelligenter End-to-End-Erfahrungen.

Die Möglichkeit für Modelle, visuelles Verständnis mit natürlichen Sprachantworten zu kombinieren, wird als visionsfähige GPT-Modelle oder GPT mit Vision bezeichnet. Vision-fähige Modelle sind für flexible, allgemeine visuelle Begründungen ausgelegt. Sie können visuelle Eingaben analysieren und in natürlicher Sprache reagieren, sodass intelligente Anwendungen problemlos erstellt werden können, ohne dass eine umfassende Computervisionskompetenz erforderlich ist.

Multimodale Modelle in Microsoft Foundry

Microsoft Foundry enthält viele Modelle, die bildbasierte Eingaben akzeptieren, sodass Sie intelligente, visionbasierte Lösungen erstellen können. Multimodale Modelle in Microsoft Foundry ermöglichen Es Anwendungen und Agenten, Bilder und visuelle Inhalte zu verstehen, zu analysieren und zu begründen.

Zum Beispiel können visionsfähige GPT-Modelle in Foundry:

- Beschreiben des Inhalts eines Bilds in natürlicher Sprache

- Beantworten von Fragen zu Objekten, Text oder Szenen in einem Bild

- Extrahieren der Bedeutung aus Diagrammen, Screenshots, Dokumenten oder Fotos

- Kombinieren des Bildverständnisses mit Textanweisungen in einer einzigen Eingabeaufforderung

Der Modellkatalog von Foundry enthält viele multimodale Modelle, darunter:

GPT-4.1 / GPT-4.1-mini / GPT-4.1-nano: Diese allgemeinen multimodalen GPT-Modelle können Text und Bilder zusammen verarbeiten. Sie werden häufig für die Bildbeschreibung und visuelle Fragebeantwortung, Dokument- und Screenshotanalyse sowie Diagramm- und Schaubildinterpretation verwendet.

GPT-5-Serie (z. B. GPT-5.1, GPT-5.2): Die in Foundry verfügbare GPT-5-Familie enthält erweiterte multimodale Modelle, die für Unternehmens- und agentische Szenarien entwickelt wurden. Diese Modelle unterstützen multimodale Eingaben (einschließlich Text und Bilder), strukturierte Ausgaben und die Verwendung von Werkzeugen sowie logisches Denken im großen Kontext über verschiedene Modalitäten hinweg. Die GPT-5-Modelle werden in der Regel in produktionsreifen KI-Agenten und komplexen multimodalen Anwendungen verwendet.

Foundry hostt auch partner-bereitgestellte multimodale Modelle in seinem Modellkatalog, darunter Modelle von Anbietern wie Anthropic und andere, die Text- und Bildverständnis unterstützen.

Bildanalyse im Gießerei-Spielplatz

Hinweis

Das Foundry-Portal verfügt über eine klassische Benutzeroberfläche und eine neue Benutzeroberfläche.

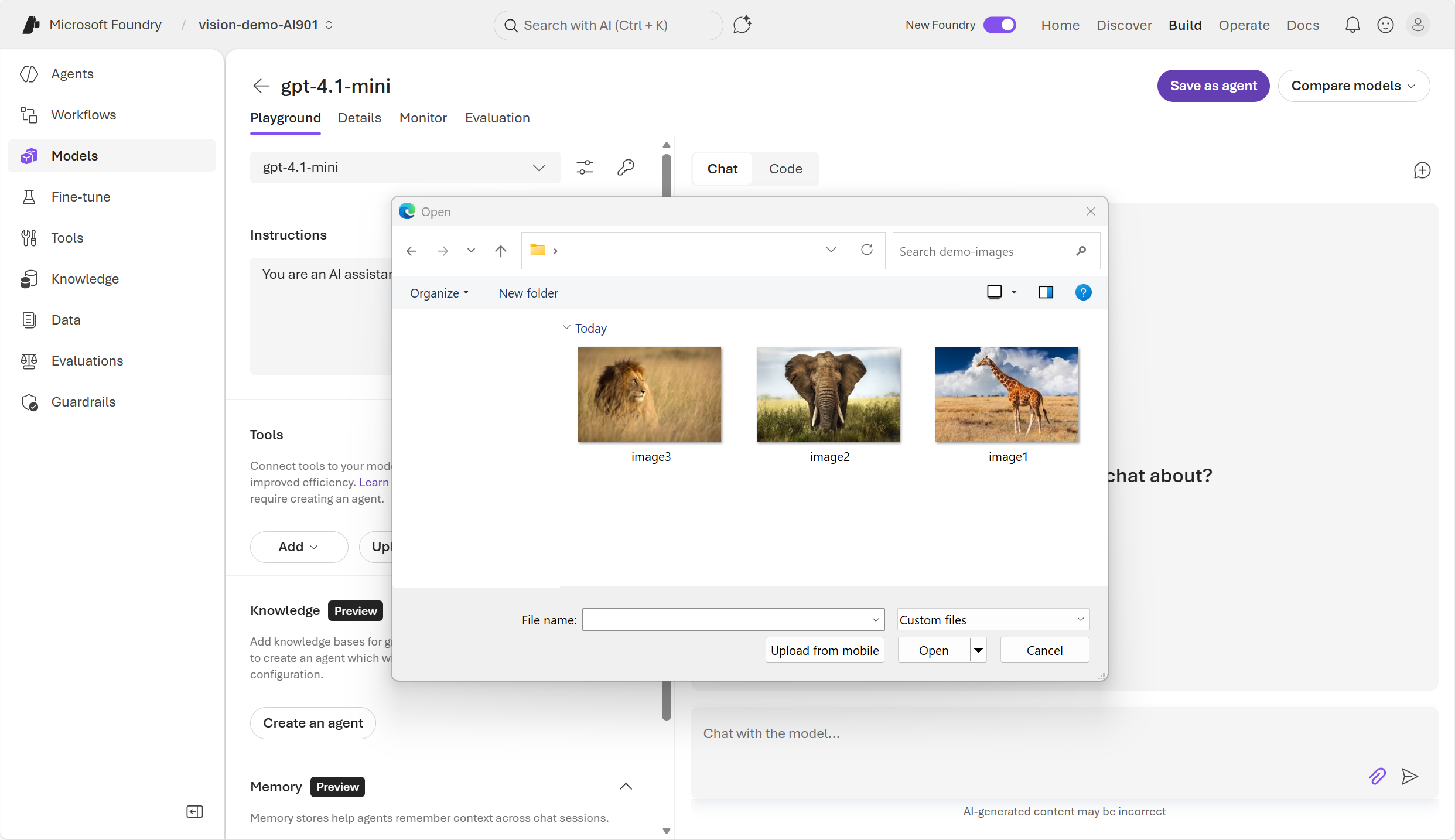

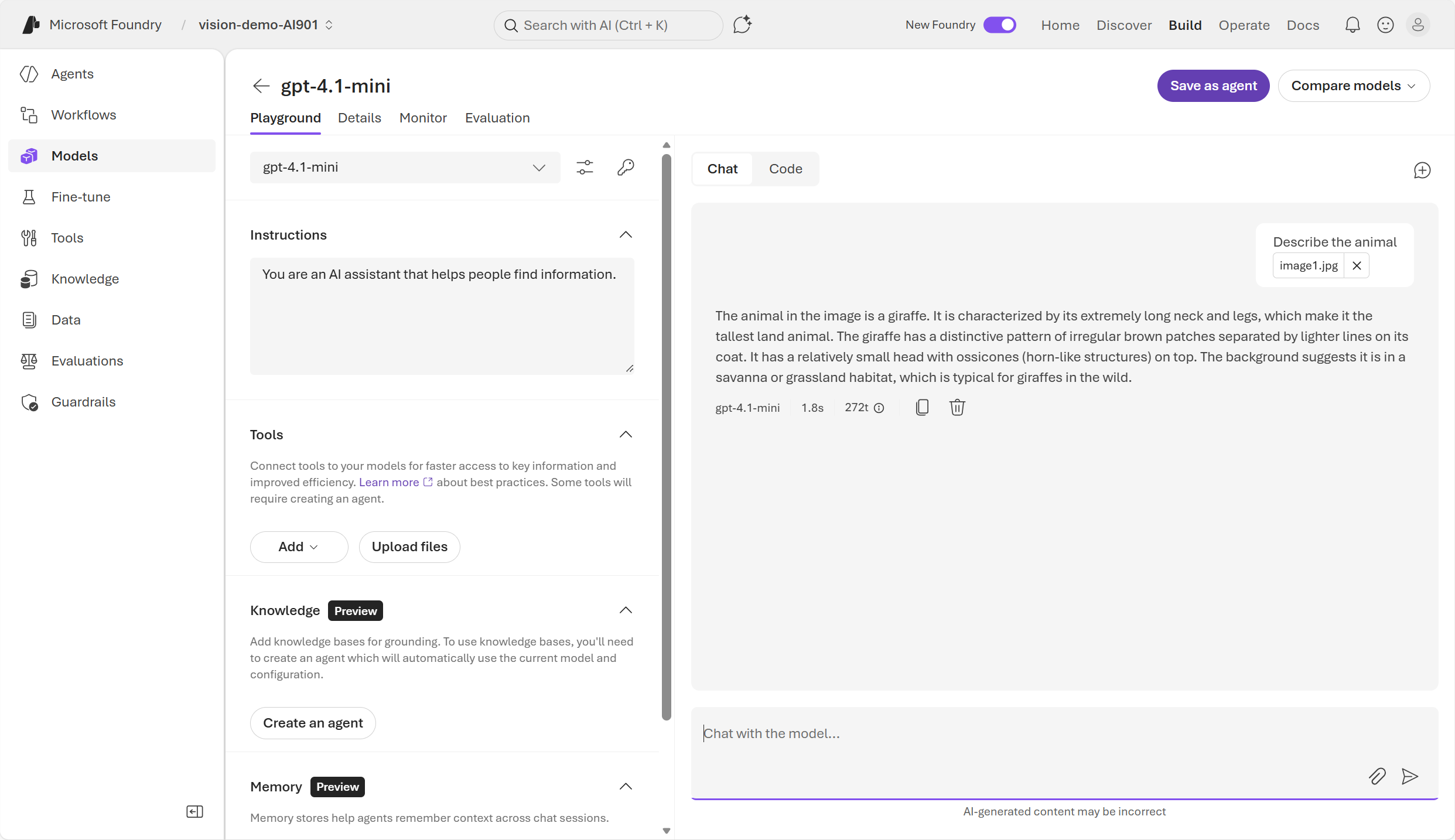

Im neuen Microsoft Foundry-Portal können Sie den Modell-Playground verwenden, um mit einem bereitgestellten Modell zu chatten. Sie können ein visionsfähiges Modell auswählen, Bilder hochladen und Testaufforderungen interaktiv testen, um zu verstehen, wie das Modell visuelle Informationen interpretiert.

Sie können beispielsweise eine Bilddatei anfügen und das multimodale Modell (z. B. gpt-4.1 mini) abrufen, um sie zu analysieren und zu beschreiben.

Nach der Überprüfung können auf dieselben Funktionen programmgesteuert mithilfe von APIs zugegriffen werden, sodass Bilder zusammen mit Textaufforderungen im Anwendungscode übermittelt werden können.

Verwenden der Azure OpenAI-API für die Bildanalyse

Um eine Anwendung zu entwickeln, müssen Sie vom Foundry-Playground zum Code wechseln. In einem Code-Editor können Sie Ihren Anwendungscode mithilfe der OpenAI-Antwort-API in Foundry schreiben. Die OpenAI-Antwort-API wurde für agentische Apps entwickelt und unterstützt native multimodale Eingaben (einschließlich Bildern).

Allgemeines:

- Eine einzelne Anforderung kann Texteingaben und Bildeingaben zusammen enthalten.

- Bilder können als URLs oder als base64-codierte Bilddaten bereitgestellt werden.

- Das Modell verarbeitet beide Eingaben gleichzeitig, um eine Antwort zu generieren.

Konzeptuell sieht die Prompt-Struktur wie folgt aus:

- Eine Textanweisung (z. B. Welche Objekte sind in diesem Bild sichtbar?)

- Eine oder mehrere Bildeingaben, die an dieselbe Anforderung angefügt sind

Mit diesem Ansatz können Entwickler Anwendungen erstellen, in denen Benutzer Bilder hochladen und Fragen zu ihnen in Echtzeit stellen.

Verwenden des Azure OpenAI Python SDK

Sie können eine Microsoft Foundry-Ressource mit der OpenAI-API verwenden, um Bildanalysen durchzuführen, einschließlich des Sendens von Bildern in Eingabeaufforderungen und abrufen von Textantworten, indem Sie die Antwort-API mit einer visionfähigen Modellbereitstellung verwenden.

Das Python-SDK kann im Visual Studio Code Terminal installiert werden, indem Sie Folgendes verwenden:

pip install openai

Im Code-Editor können wir eine Python-Datei erstellen, die Anwendungscode enthält. Wichtig ist, dass Sie den Foundry-Ressourcenschlüssel sowie den Endpunkt und den Namen Ihres bereitgestellten Modells benötigen.

Hinweis

Wenn Sie ein Modell in Foundry bereitstellen, verfügt es über einen Basis - oder ursprünglichen Namen und einen ursprünglichen Bereitstellungsnamen , den Sie ihm geben. Foundry hostet das bereitgestellte Modell (z. B. GPT-Klassen-Modelle mit Vision) und stellt Ihnen einen Endpunkt bereit.

Im Codebeispiel erstellen Sie den Client, richten ihn auf Ihren Endpunkt aus und übergeben den Modellbereitstellungsnamen (den Namen, den Sie dem Modell gegeben haben) als Parameter MODEL_NAME.

import os

from openai import OpenAI

# Environment variables you set locally or in your app service:

FOUNDRY_KEY = "... your key ..."

ENDPOINT = "https://YOUR-RESOURCE-NAME.openai.azure.com/openai/v1/"

MODEL_NAME = "your-model-deployment-name" # e.g., "gpt-4.1-mini" deployed as "my-vision-deploy"

client = OpenAI(

api_key=os.getenv("FOUNDRY_KEY"),

base_url=os.getenv("ENDPOINT"),

)

image_url = ""

response = client.responses.create(

model=os.getenv("MODEL_NAME"), # your deployment name

input=[

{

"role": "user",

"content": [

{"type": "input_text", "text": "What is in this image? Provide 3 bullet points."},

{"type": "input_image", "image_url": image_url}

],

}

],

)

print(response.output_text)

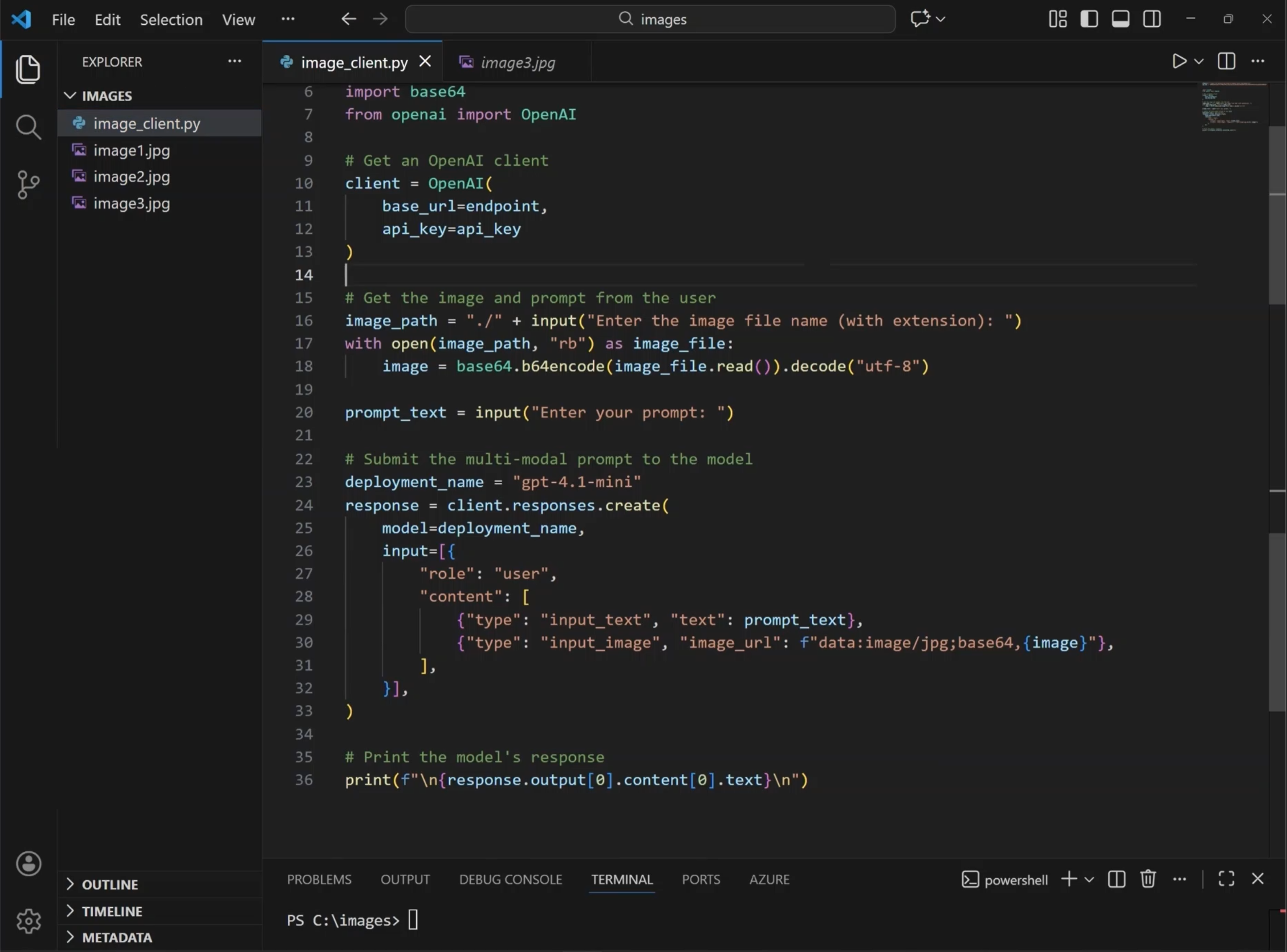

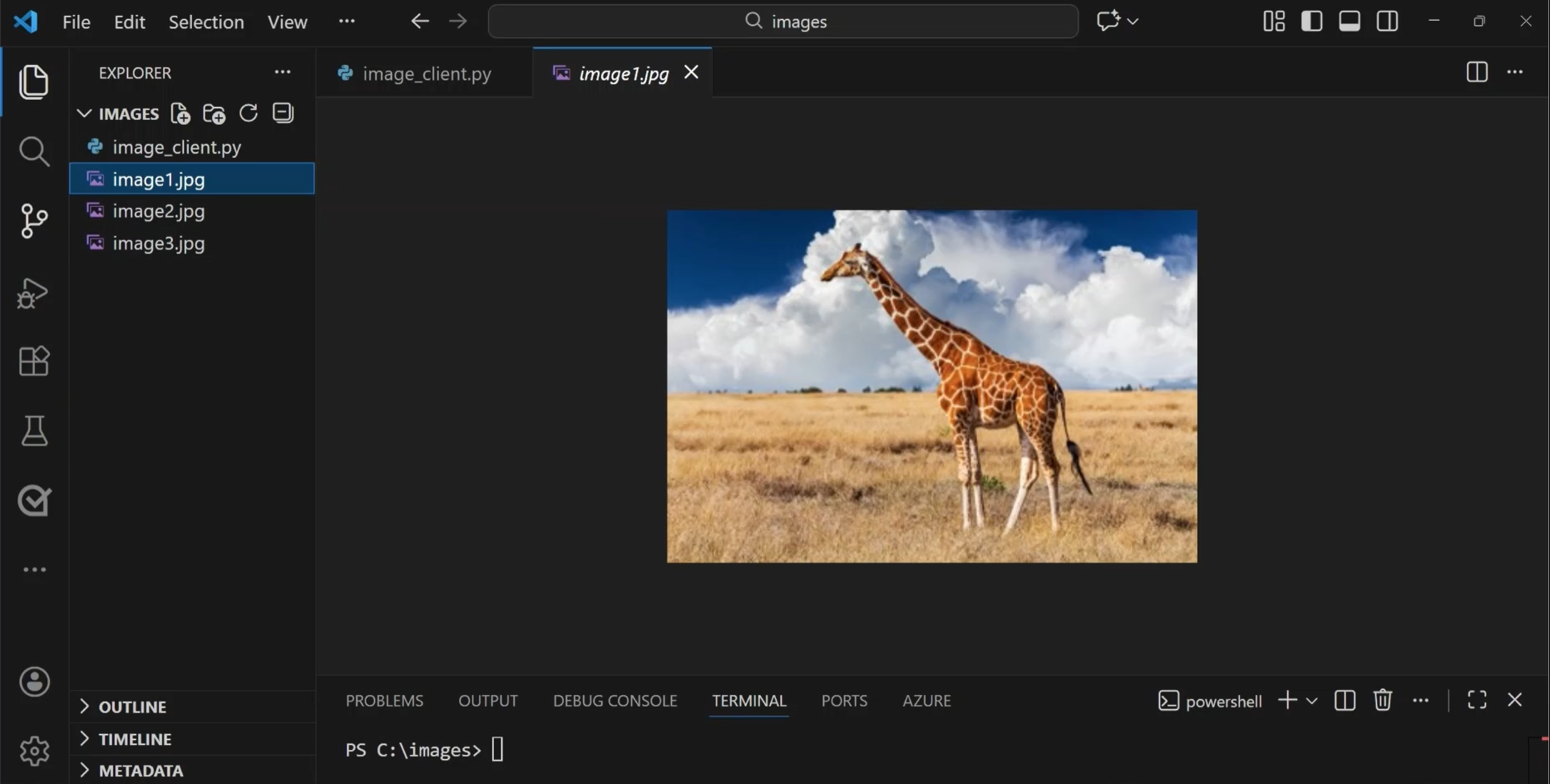

Beispiel für Client-App

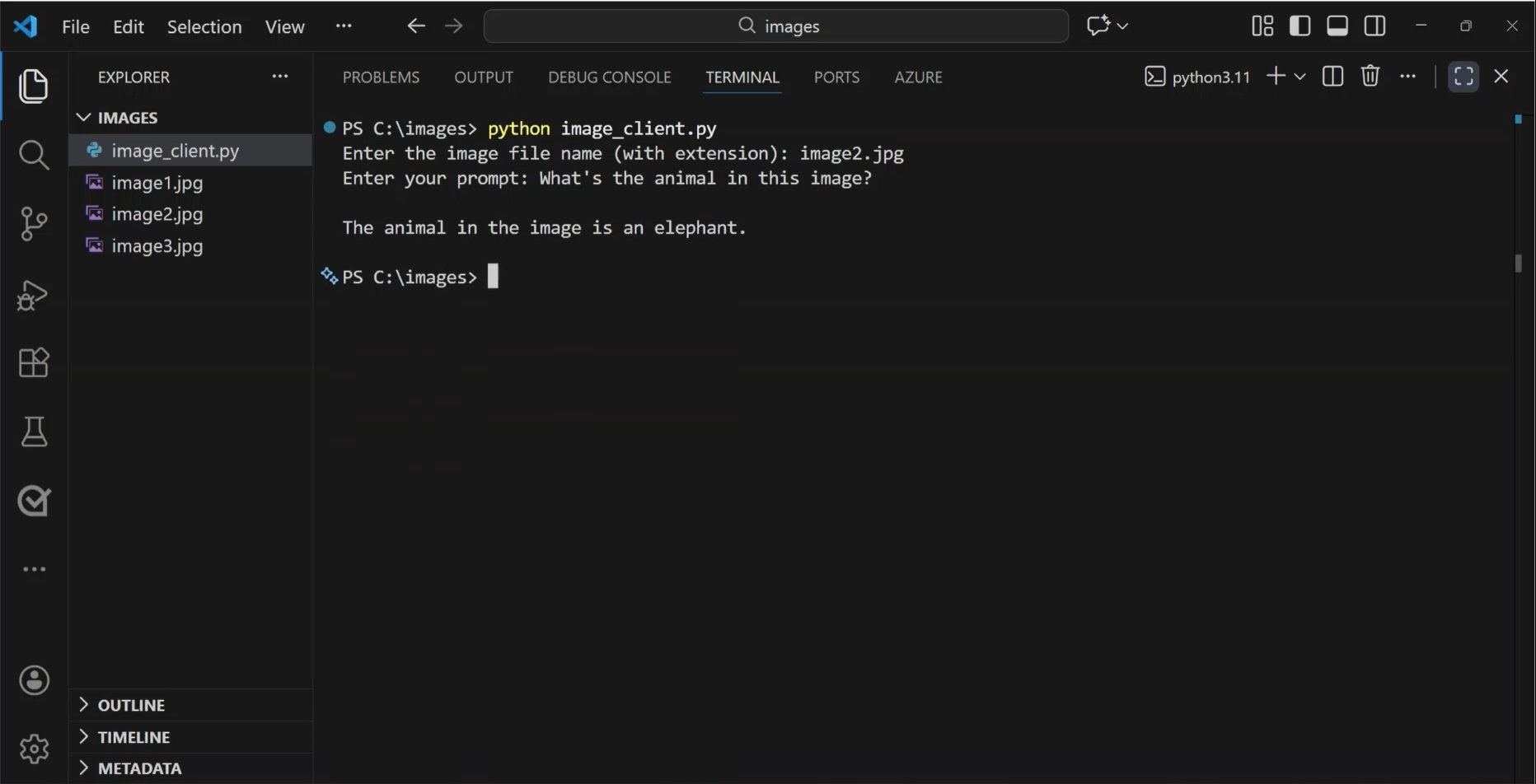

Sie können eine benutzerdefinierte Anwendung erstellen, die ein visionsfähiges Modell verwendet, um ein Image mit dem OpenAI Python SDK zu analysieren. Angenommen, Sie möchten eine App erstellen, die Tiere identifizieren kann, die auf Safari fotografiert wurden. Sie können Ihre Fotos hochladen und eine Python-Datei in Ihrem Code-Editor erstellen.

Anschließend können Sie Anwendungscode schreiben, der die OpenAI-API verwendet, um eine Verbindung mit dem Endpunkt Ihres Modells in Foundry herzustellen.

Der Anwendungscode muss die Bilddaten laden und eine Eingabeaufforderung in natürlicher Sprache von einem Benutzer abrufen. Um die Eingabe an das Modell zu übermitteln, müssen Sie eine mehrteilige Nachricht erstellen, die sowohl bild- als auch Textdaten enthält. Das Modell kann mit einer geeigneten Ausgabe reagieren, die sowohl auf dem Text als auch auf dem Bild in der Eingabeaufforderung basiert.

Erfahren Sie als Nächstes, wie Sie Foundry-Modelle und das Azure OpenAI SDK für die Bildgenerierung verwenden.