Modellleistung bewerten

Tipp

Weitere Details finden Sie auf der Registerkarte "Text und Bilder ".

Die Bewertung Ihres bereitgestellten Modells stellt sicher, dass es Qualitätsstandards erfüllt, präzise Antworten liefert und sich im Laufe der Zeit kontinuierlich verbessert. Das Microsoft Foundry-Portal bietet mehrere Ansätze zur Auswertung, von manuellen Tests bis hin zu automatisierten Metriken und umfassenden Auswertungsflüssen.

Gründe für die Auswertung von Modellen

Die Auswertung dient mehreren kritischen Zwecken bei der entwicklung von AI-Anwendungen:

Qualitätssicherung identifiziert Probleme und stellt sicher, dass Ihr Modell genaue, relevante Antworten liefert. Das Erkennen von Problemen während der Auswertung anstatt der Produktion schützt Ihre Benutzer und den Ruf Ihrer Organisation.

Die Benutzerzufriedenheit verbessert sich, wenn Modelle stets hilfreiche, geeignete Antworten liefern. Die Auswertung hilft Ihnen zu verstehen, wie Benutzer Ihre Anwendung erleben und wo Verbesserungen die größte Auswirkung haben.

Kontinuierliche Verbesserung kommt aus der Analyse von Auswertungsergebnissen, um Verbesserungsmöglichkeiten zu identifizieren. Regelmäßige Auswertung, wenn Sie Eingabeaufforderungen aktualisieren, Features hinzufügen oder Modelle neu trainieren, sorgt für gleichbleibende Qualität.

Compliance- und Sicherheitsüberprüfung bestätigt, dass Ihr Modell Richtlinien einhält, keine schädlichen Inhalte erzeugt und die Datenschutz- und Datenschutzanforderungen des Benutzers respektiert.

Manuelle Auswertungsansätze

Bei der manuellen Auswertung handelt es sich um menschliche Prüfer, die Modellantworten bewerten. Während die zeitintensive manuelle Auswertung Einblicke liefert, die automatisierte Metriken nicht erfassen können.

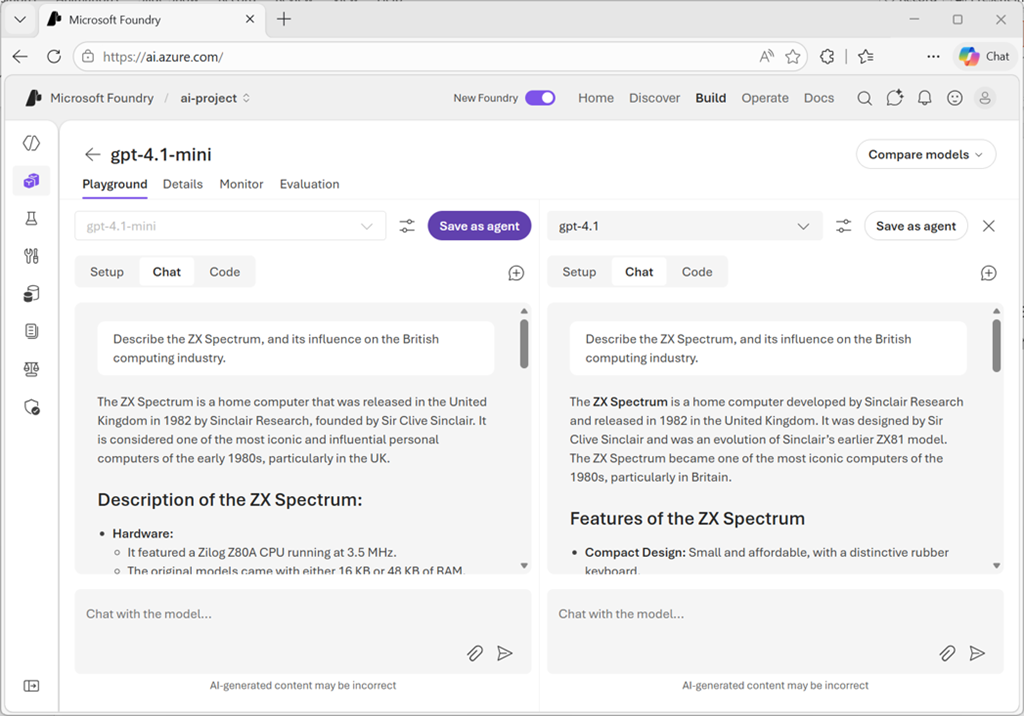

Mit interaktiven Tests im Playground können Sie das Modellverhalten qualitativ untersuchen. Sie geben verschiedene Eingabeaufforderungen ein, beobachten die Antworten und notieren Probleme wie falsche Informationen, unangemessener Ton oder Nichtbefolgung der Anweisungen. Diese explorativen Tests helfen Ihnen, die Stärken und Einschränkungen eines Modells zu verstehen.

Um Das Anwendungsdesign zu optimieren, können Sie Modelle nebeneinander im Playground testen, Systemanweisungen synchronisieren und dazu auffordern, ihre Antworten zu vergleichen.

Die strukturierte Überprüfung umfasst das Erstellen einer Reihe von Testfällen, die die Anwendungsfälle Ihrer Anwendung darstellen. Menschliche Bewerter bewerten Antworten basierend auf Kriterien wie:

- Relevanz: Adresst die Antwort die Frage oder Anforderung?

- Informativität: Bietet es ausreichende Details und nützliche Informationen?

- Engagement: Ist die Antwort interessant und angemessen konversationell?

- Genauigkeit: Sind Fakten und Aussagen richtig?

- Sicherheit: Vermeidet die Antwort schädliche, voreingenommene oder unangemessene Inhalte?

Bewerter verwenden in der Regel Bewertungsskalen (z. B. 1-5) für jedes Kriterium. Aggregierte Bewertungen über mehrere Testfälle hinweg bieten quantitative Kennzahlen der Gesamtqualität.

Benutzerstudien sammeln Feedback von tatsächlichen oder repräsentativen Benutzern, die mit Ihrer Anwendung interagieren. Benutzerfeedback zeigt reale Probleme auf, die Sie bei kontrollierten Tests verpassen können, z. B. verwirrende Ausdrücke, fehlenden Kontext oder nicht erfüllte Erwartungen.

Die manuelle Auswertung ergänzt automatisierte Ansätze, indem subjektive Qualitätsaspekte wie Benutzerzufriedenheit, kontextbezogene Angemessenheit und Markenausrichtung erfasst werden, die Metriken allein nicht messen können.

Automatisierte Auswertungsmetriken

Die automatisierte Auswertung verwendet Standardmetriken, um die Ausgaben Ihres Modells automatisch zu bewerten. Diese Auswertungen skalieren effizient und liefern konsistente, objektive Messungen.

Das Microsoft Foundry-Portal unterstützt mehrere Kategorien von Auswertungsmetriken, darunter:

Qualitätsmetriken der Generation bewerten die Gesamtantwortqualität:

- Geerdetheit: Bestimmt, ob Antworten auf bereitgestellten Kontext und nicht auf Spekulationen basieren. Groundedness Pro bietet eine binäre Bewertung (geerdet oder nicht geerdet), die für Anforderungen an die sachliche Genauigkeit nützlich ist.

- Relevanz: Misst, ob Antworten die Frage oder die Anfrage des Benutzers angemessen beantworten.

- Kohärenz: Bewertet, ob Antworten logisch fließen und konsistente Ideen beibehalten.

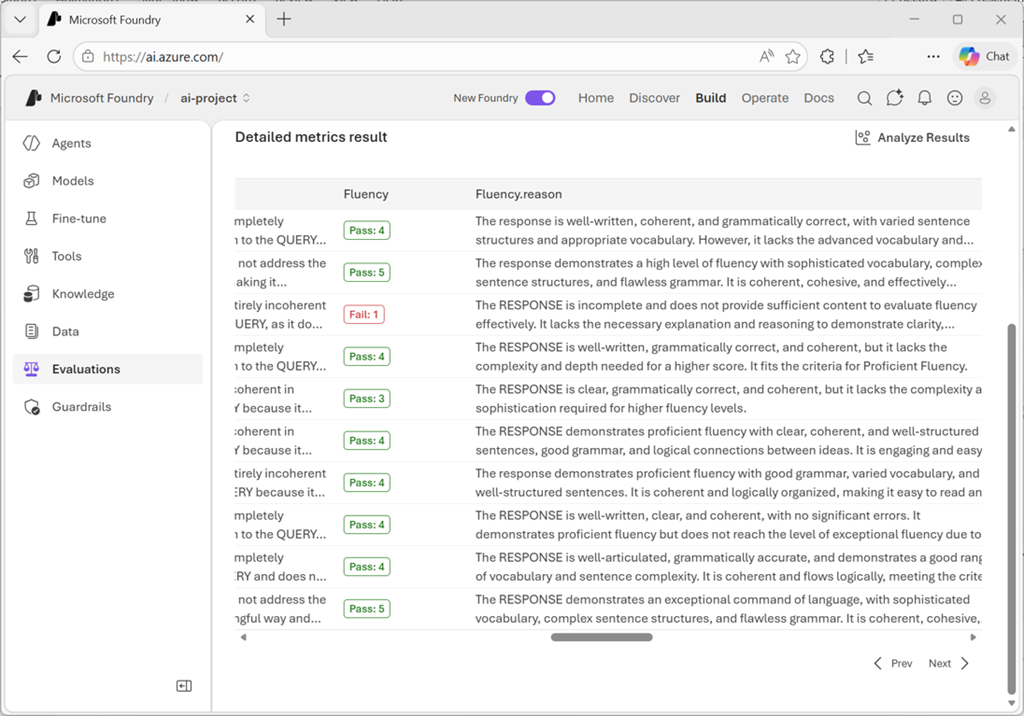

- Fluency: Wertet sprachliche Korrektheit und natürliche Sprachqualität aus.

Risiko- und Sicherheitsmetriken identifizieren potenzielle schädliche Inhalte:

- Inhalte über Selbstverletzung: Erkennt Antworten, die Selbstverletzung diskutieren oder fördern

- Hassvolle und unfaire Inhalte: Identifiziert Verzerrungen, Diskriminierungen oder hasserreiche Aussagen

- Gewaltsame Inhalte: Kennzeichnen von Antworten, die Gewalt enthalten oder fördern

- Sexuelle Inhalte: Erkennt unangemessene sexuelle Inhalte

- Geschütztes Material: Identifiziert potenzielle Urheberrechte oder proprietäre Vervielfältigung von Inhalten

- Indirekter Angriff (Jailbreak): Bewertet die Sicherheitsanfälligkeit bei Manipulationsversuchen

Bei Inhaltsschädigungsmetriken werden Ergebnisse als Fehlerrate aggregiert – der Prozentsatz der Antworten, der einen Schweregradschwellenwert überschreitet (in der Regel Mittel). Bei geschützten Materialien und indirekten Angriffen berechnet sich die Fehlerrate zu (true instances / total instances) × 100.

Wenn Sie eine KI-gestützte Bewertung verwenden, geben Sie ein GPT-Modell an, das ein Bewertung durchführt. Dieses Auswertungsmodell analysiert die Antworten Ihres bereitgestellten Modells und weist basierend auf den ausgewählten Kriterien Bewertungen zu.

Metriken für die Verarbeitung natürlicher Sprachen

NLP-Metriken bieten mathematische Auswertungen, ohne dass ein Evaluatormodell erforderlich ist. Diese Metriken benötigen häufig Boden-Wahrheitsdaten – erwartete oder richtige Antworten für den Vergleich.

F1-Score misst das Verhältnis von gemeinsamen Wörtern zwischen generierten und tatsächlichen Antworten und sorgt für ein Gleichgewicht zwischen Präzision (Vermeidung falscher Wörter) und Relevanz (Einbeziehung wichtiger Wörter). F1-Score ist für Aufgaben wie Textklassifizierung und Informationsabruf nützlich.

BLEU (Bilingual Evaluation Understudy) vergleicht n-grams (Wortsequenzen) zwischen generierten und Referenztexten und wird häufig zur Bewertung maschineller Übersetzungen verwendet.

METEOR (Metrik zur Bewertung von Übersetzungen mit expliziter Reihenfolge) erweitert BLEU durch die Berücksichtigung von Synonymen, Stammerkennung und Paraphrasierung, was einen flexibleren Vergleich ermöglicht.

ROUGE (Erinnerungsorientiertes Ersatzstudium für die Gisting-Bewertung) betont den Rückruf über die Genauigkeit, was es besonders nützlich für Zusammenfassungsaufgaben macht, bei denen das Abdecken von Schlüsselpunkten wichtiger ist als das Vermeiden zusätzlicher Wörter.

GLEU (Google-BLEU) ist eine Variante der BLEU für die Bewertung auf Satzebene.

NLP-Metriken funktionieren gut, wenn Sie endgültige richtige Antworten oder Referenztexte haben. Sie eignen sich weniger für die offene Generation, in der viele gültige Antworten vorhanden sind.

Erstellen umfassender Auswertungen

Mit dem Feature "Auswertung " des Microsoft Foundry-Portals können Sie systematische Auswertungen mit Test-Datasets und mehreren Metriken gleichzeitig ausführen.

Sie können Ihre Bewertung auf einer der folgenden Punkte basieren:

- Modell: Auswerten eines bereitgestellten Modells mit von Ihnen angegebenen Eingabeaufforderungen. Das System generiert Ergebnisse während der Auswertung.

- Agent: Wertet die Antworten eines Agents mit benutzerdefinierten Eingabeaufforderungen aus.

- Dataset: Auswertung von vorab generierten Ausgaben, die bereits in Ihrem Test-Datensatz vorhanden sind.

Beim Auswerten eines Modells oder Agents benötigen Sie ein Dataset, um Eingaben für die Bewertung bereitzustellen. Sie haben drei Möglichkeiten:

- Upload new dataset: Stellen Sie eine CSV- oder JSONL-Datei aus Ihrem lokalen Speicher bereit, die Testfälle enthält.

- Vorhandenen Datensatz verwenden: Wählen Sie aus Datensätzen, die Sie zuvor in Ihr Projekt hochgeladen haben.

- Generieren sie synthetisches Dataset: Wenn Sie keine Testdaten besitzen, kann das System Beispieldaten basierend auf einer von Ihnen bereitgestellten Themenbeschreibung generieren. Sie geben die zu generierende Ressource, die Anzahl der Zeilen und eine Eingabeaufforderung an, die die gewünschten Daten beschreibt. Sie können Dateien auch hochladen, um die Relevanz ihrer jeweiligen Aufgabe zu verbessern.

Wählen Sie für die Datasetauswertung, bei der Ausgaben vorab generiert werden, Ihr Dataset aus, das sowohl Eingaben als auch modellgenerierte Antworten enthält, oder laden Sie es hoch.

Nachdem Sie die zu berechnenden Metriken konfiguriert haben, werden die Feldzuordnungen für die Auswertungsdaten und die Systemaufforderung für das Modell angezeigt. Sie können den Auswertungsauftrag starten . Dies kann einige Zeit in Anspruch nehmen, um asynchron ausgeführt zu werden, wobei jede Zeile im Testdatensatz anhand der ausgewählten Metriken verarbeitet wird.

Überprüfen der Auswertungsergebnisse

Wenn die Auswertung abgeschlossen ist, zeigen die Ergebnisse aggregierte Ergebnisse für die metriken an, die Sie ausgewählt haben, und Details zu jeder Testaufforderung.

Erkunden der Auswertungsbibliothek

Die Evaluator-Bibliothek bietet einen zentralen Speicherort zum Anzeigen und Verwalten aller verfügbaren Bewerter. Greifen Sie auf Ihr Projekt von der Seite Bewertung aus zu, indem Sie die Registerkarte Evaluatorbibliothek auswählen.

In der Auswertungsbibliothek haben Sie folgende Möglichkeiten:

- Anzeigen von von Microsoft kuratierten Evaluatoren für Qualität, Sicherheit und Leistung

- Untersuchen von Evaluatordetails, einschließlich Name, Beschreibung, Parametern und zugehörigen Dateien

- Überprüfen Sie Anmerkungsaufforderungen für Qualitätsprüfer, um zu verstehen, wie Metriken berechnet werden.

- Definitionen und Schweregrade für Sicherheitsgutachter überprüfen

- Verwalten von benutzerdefinierten Bewertern, die Sie für bestimmte Szenarien erstellt haben

Die Bibliothek unterstützt die Versionsverwaltung, sodass Sie unterschiedliche Versionen vergleichen, frühere Versionen bei Bedarf wiederherstellen und mit anderen an benutzerdefinierten Bewertern zusammenarbeiten können.

Iterieren basierend auf der Bewertung

Auswertungsergebnisse informieren Sie über die nächsten Schritte:

Berücksichtigen Sie folgendes, wenn die Ergebnisse niedriger als erforderlich sind:

- Prompt Engineering: Verfeinern von Anweisungen und Systemmeldungen

- Verschiedene Modelle: Ausprobieren von für Ihren Anwendungsfall optimierten Modellen

- RAG-Integration: Hinzufügen von Abruffunktionen zu Bodenantworten in Ihren Daten

- Feinabstimmung: Schulung des Modells für Ihre spezifische Domäne (sofern unterstützt)

Jeder dieser Schritte kann in Komplexität (und manchmal Kosten) wachsen, sodass sie bei der Planung von Verbesserungen berücksichtigt werden.

Wenn Sicherheitsmetriken Bedenken zeigen:

- Inhaltsfilter: Implementieren von Azure KI Inhaltssicherheit Diensten

- Eingabeaufforderungshärtung: Hinzufügen von Sicherheitsanweisungen zu Systemmeldungen

- Ausgabeüberprüfung: Überprüfen von Antworten vor der Anzeige für Benutzer

Regelmäßige Auswertung, wenn Sie Änderungen vornehmen, verfolgt Verbesserungen und stellt sicher, dass die Qualität nicht zurücktritt. Richten Sie bewertungs-Benchmarks frühzeitig in der Entwicklung ein, und führen Sie dann Evaluierungen nach Änderungen erneut aus, um die Auswirkungen objektiv zu messen.

Durch die Kombination manueller Tests, automatisierter Metriken und umfassender Auswertungsflüsse schaffen Sie Vertrauen, dass Ihr Modell gut funktioniert, sicher den Benutzern dient und die Qualitätsanforderungen Ihrer Anwendung erfüllt.