Einleitung

Sprachmodelle sind leistungsstarke Tools zum Erstellen von generativen KI-Anwendungen, aber ein Eigenes Basismodell erfüllt möglicherweise nicht alle Ihre Anforderungen. Die Qualität, Genauigkeit und Konsistenz der Antworten, die ein Modell generiert, hängt davon ab, wie Sie es konfigurieren und erweitern.

Stellen Sie sich vor, Sie sind ein Entwickler oder eine Entwicklerin und arbeiten für ein Reisebüro. Sie erstellen eine Chatanwendung, um Kunden bei ihren Reisefragen zu helfen. Das Basismodell gibt anständige Antworten, aber Ihr Team hat spezifische Anforderungen: Die Antworten sollten dem Ton der Stimme des Unternehmens folgen, genaue Informationen zu Ihrem Hotelkatalog enthalten und ein konsistentes Format für alle Interaktionen beibehalten. Wie können Sie das Modell auf dieser Ebene ausführen?

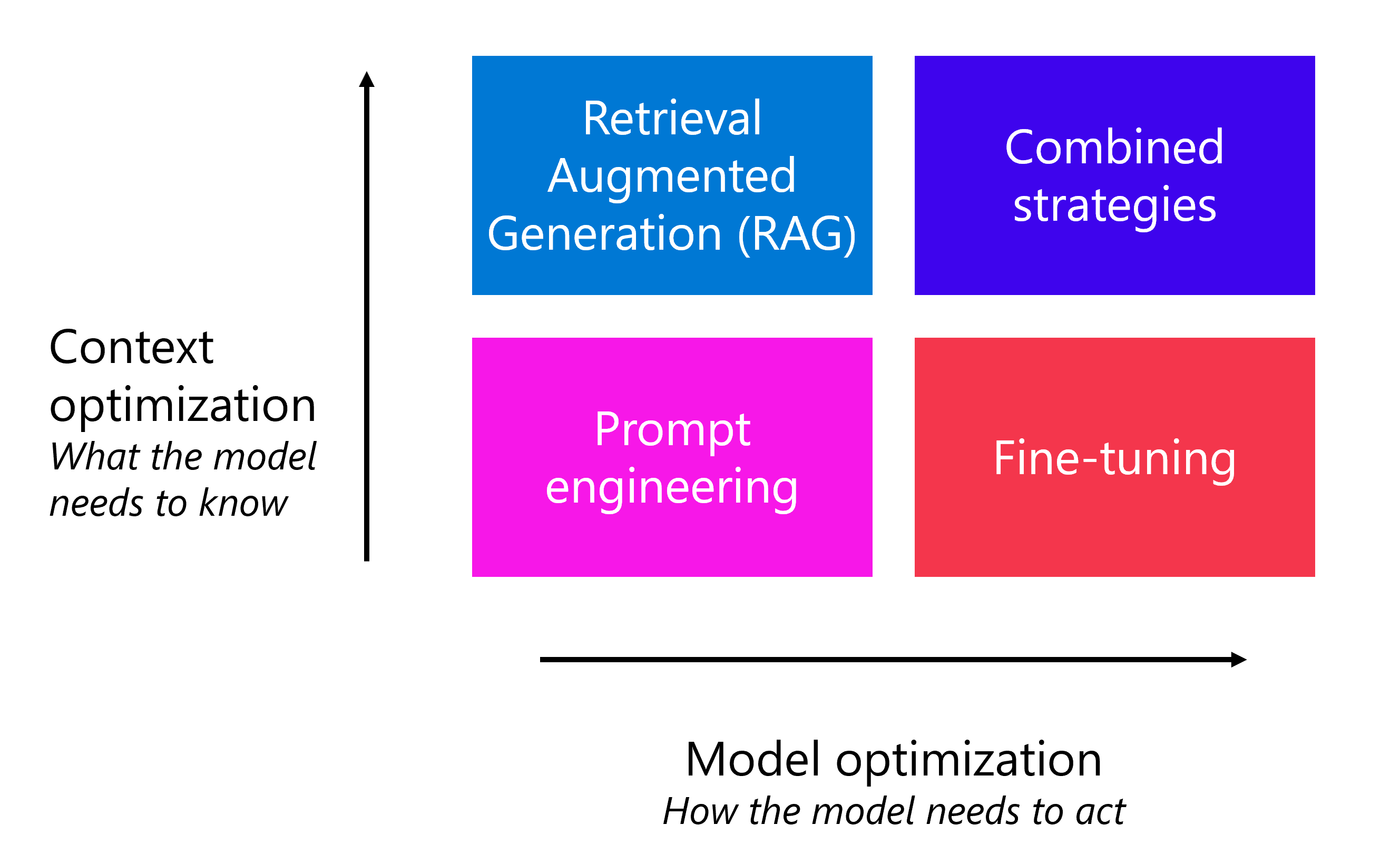

Es gibt mehrere ergänzende Strategien, mit denen Sie die Leistung eines generativen KI-Modells optimieren können. Diese Strategien reichen von schnellen, kostengünstigen Anpassungen bis hin zu komplexeren Techniken, die zusätzliche Zeit und Ressourcen erfordern.

In diesem Modul untersuchen Sie jede dieser Strategien und erfahren, wann und wie Sie sie einzeln oder in Kombination anwenden können.

In diesem Modul erfahren Sie, wie Sie:

- Wenden Sie Prompt-Engineering-Techniken wie Systemmeldungen, few-shot learning und Modellparameter an, um die Modellausgabe zu optimieren.

- Verstehen Sie, wann und wie Sie ein Sprachmodell mithilfe von Retrieval Augmented Generation (RAG) verankern können.

- Ermitteln, wann die Feinabstimmung eines Modells die Verhaltenskonsistenz verbessert.

- Vergleichen Sie Optimierungsstrategien, und bestimmen Sie, wann sie kombiniert werden sollen.

Voraussetzungen

- Vertrautheit mit grundlegenden KI-Konzepten und -Diensten in Azure.

- Grundlegendes Verständnis von generativen KI-Modellen und deren Erstellung von Antworten.