Nota:

El acceso a esta página requiere autorización. Puede intentar iniciar sesión o cambiar directorios.

El acceso a esta página requiere autorización. Puede intentar cambiar los directorios.

Nota:

Este documento hace referencia al portal de Microsoft Foundry (clásico).

🔍 Consulte la documentación de Microsoft Foundry (nuevo) para obtener información sobre el nuevo portal.

Importante

El procesamiento de prioridad está en versión preliminar y solo está disponible por invitación. Regístrese aquí para recibir una notificación cuando esté más disponible.

Esta versión preliminar se ofrece sin contrato de nivel de servicio y no es aconsejable usarla en las cargas de trabajo de producción. Es posible que algunas características no sean compatibles o que tengan sus funcionalidades limitadas. Para más información, consulte Términos de uso complementarios para las versiones preliminares de Microsoft Azure.

El procesamiento de prioridad proporciona un rendimiento de baja latencia con la flexibilidad de pago por uso. Funciona en un modelo de token de pago por uso, ofreciendo tiempos de respuesta rápidos sin compromisos de contrato a largo plazo. En este artículo, habilitará el procesamiento prioritario en una implementación de modelo, comprobará qué nivel de servicio procesó las solicitudes y supervisará los costos asociados.

Prerrequisitos

- Una suscripción de Azure: cree una gratuitamente.

- Un proyecto de Microsoft Foundry con un modelo implementado del tipo

GlobalStandardoDataZoneStandardde implementación. - Participación en la vista previa de procesamiento prioritario. Regístrese aquí para recibir notificaciones cuando el procesamiento de prioridad esté más disponible.

- Versión

2025-10-01-previewde la API o posterior.

Información general

Ventajas

- Latencia baja predecible: generación de tokens más rápida y coherente.

- Flexibilidad fácil de usar: Al igual que el procesamiento estándar de pago por uso, el acceso al procesamiento prioritario está disponible de manera flexible y bajo demanda, en lugar de requerir aprovisionamiento y reservas anticipadas.

Casos de uso clave

- Latencia coherente y baja para experiencias de usuario con capacidad de respuesta.

- Simplicidad de pago por uso sin compromisos a largo plazo.

- Tráfico de horas laborales o puntual que se beneficia del rendimiento rentable y escalable. Opcionalmente, puede combinar el procesamiento prioritario con unidades de rendimiento aprovisionadas (PTU) para la capacidad de estado estable y la optimización de costos.

Limits

Límite de rampa: Los aumentos rápidos de los tokens de procesamiento de prioridad por minuto pueden dar lugar a alcanzar los límites de velocidad de rampa. Si supera el límite de velocidad de rampa, el servicio podría enviar tráfico adicional al procesamiento estándar en su lugar.

Cuota: El procesamiento de prioridad usa la misma cuota que el procesamiento estándar. Esto significa que su despliegue con el procesamiento prioritario habilitado consume cuota de su asignación estándar existente.

Soporte para el procesamiento prioritario

Disponibilidad del modelo estándar global

| Region | gpt-4.1, 2025-04-14 |

|---|---|

| eastus 2 | ✅ |

| swedencentral | ✅ |

| westus3 | ✅ |

Nota:

La disponibilidad del modelo y la región pueden expandirse durante el período de versión preliminar. Compruebe esta página para ver las actualizaciones.

Problemas conocidos

Actualmente, el procesamiento de prioridad tiene estas limitaciones y se están realizando correcciones:

Límite de contexto largo para gpt-4.1: El servicio no admite solicitudes que superan los 128 000 tokens y devuelve un error HTTP 400.

No se admite el desbordamiento de PTU: El servicio aún no admite el desbordamiento de PTU en una implementación habilitada para el procesamiento prioritario. Si necesita un comportamiento de desbordamiento, implemente su propia lógica, como mediante Azure API Management.

Valor incorrecto de service_tier al usar streaming en la API de respuestas: Cuando se transmiten respuestas mediante la API de respuestas, el campo

service_tierpodría devolver "prioridad" incorrectamente, incluso si las restricciones de capacidad o los límites de rampa hicieron que la solicitud fuera atendida por el nivel estándar. En este caso, el valor esperado paraservice_tieres "default".

Habilitación del procesamiento de prioridad en el nivel de implementación

Puede habilitar el procesamiento de prioridad en el nivel de implementación y (opcionalmente) en el nivel de solicitud.

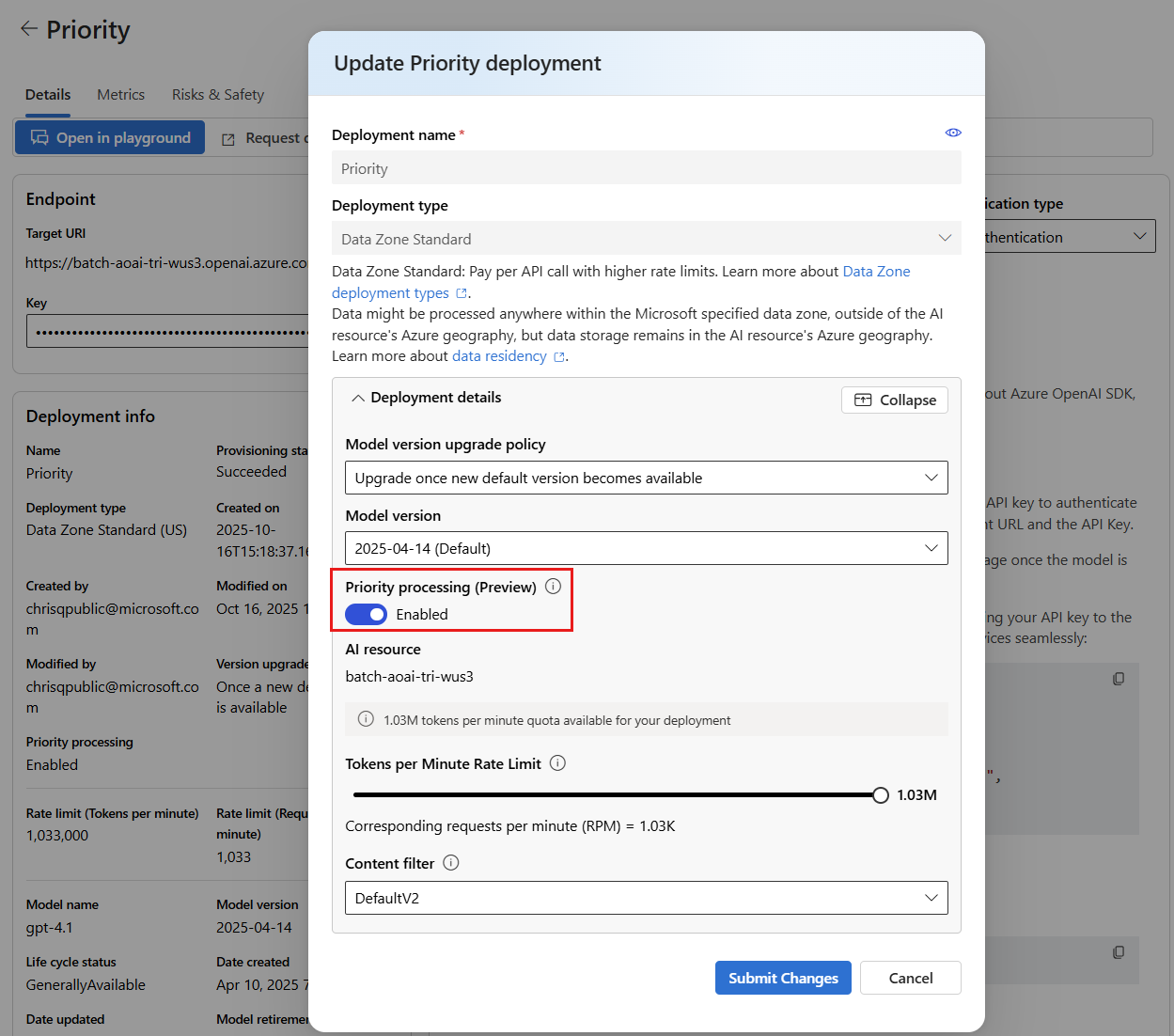

En el portal de Microsoft Foundry, puede habilitar el procesamiento de prioridad durante la configuración de la implementación. Active el botón de alternancia Procesamiento de prioridad (versión preliminar) en la página de detalles de implementación al crear la implementación o actualice la configuración editando los detalles de implementación de un modelo ya implementado.

Nota:

Si prefiere usar código para habilitar el procesamiento de prioridad en el nivel de implementación, puede hacerlo a través de la API REST para la implementación estableciendo el atributo de la service_tier siguiente manera: "properties" : {"service_tier" : "priority"}. Los valores permitidos para el service_tier atributo son default y priority.

default implica el procesamiento estándar, mientras que priority habilita el procesamiento prioritario.

Una vez configurada la implementación de un modelo para usar el procesamiento de prioridad, puede empezar a enviar solicitudes al modelo.

Visualización de métricas de uso

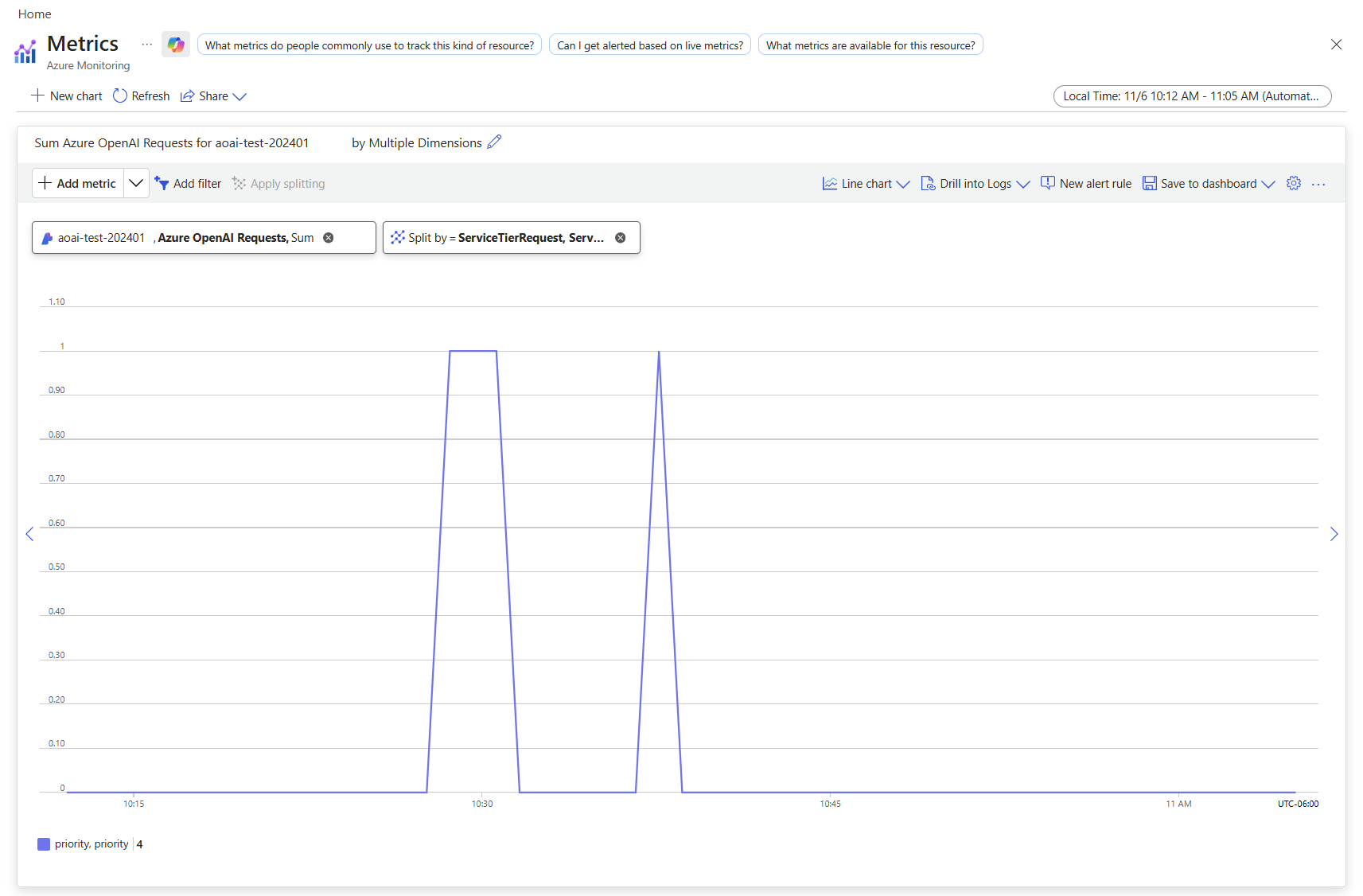

Puede ver la medida de uso del recurso en la sección Azure Monitor de Azure Portal.

Para ver el volumen de solicitudes procesadas por procesamiento estándar frente al procesamiento de prioridad, divida por el nivel de servicio (estándar o prioridad) que estaba en la solicitud original:

- Inicie sesión en https://portal.azure.com.

- Vaya al recurso de Azure OpenAI y seleccione la opción Métricas en el panel de navegación izquierdo.

- En la página de las métricas, añada la métrica solicitudes de Azure OpenAI. También puede seleccionar otras métricas, como la latencia de Azure OpenAI, el uso de Azure OpenAI y otros.

- Seleccione Agregar filtro para seleccionar la implementación estándar para la que se procesaron las solicitudes de procesamiento de prioridad.

- Seleccione Aplicar división para dividir los valores por ServiceTierRequest y ServiceTierResponse.

Para más información sobre la supervisión de las implementaciones, consulte Supervisión de Azure OpenAI.

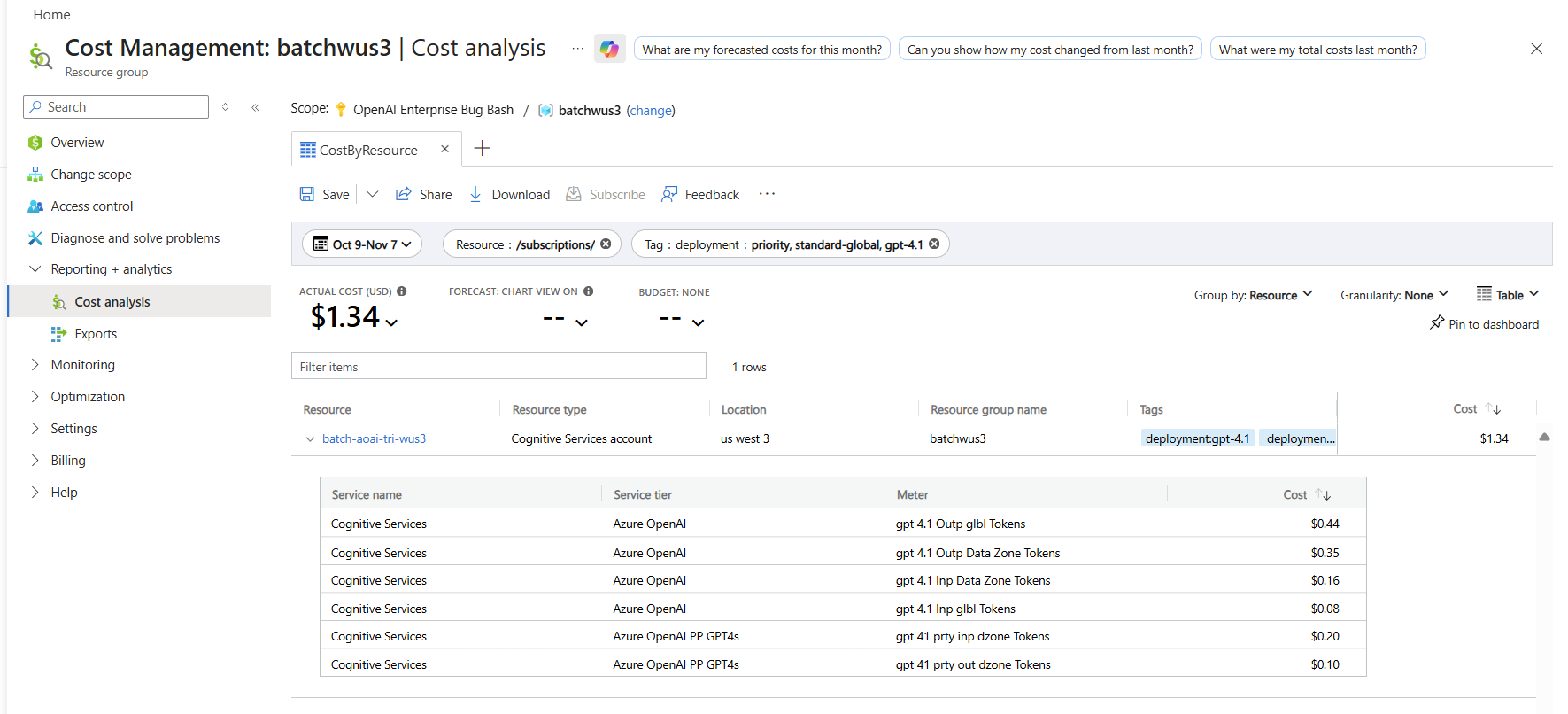

Supervisión de costos

Puede ver un desglose de los costos de las solicitudes de prioridad y estándar en la página de análisis de costos de Azure Portal filtrando el nombre de implementación y las etiquetas de facturación de la siguiente manera:

- Vaya a la página análisis de costos en Azure Portal.

- (Opcional) Filtre por recurso.

- Para filtrar por nombre de implementación: agregue un filtro para la etiqueta de facturación > seleccione la implementación como valor y, a continuación, elija el nombre de la implementación.

Para obtener información sobre los precios del procesamiento prioritario, consulte la introducción a los precios del servicio OpenAI de Azure.

Habilitación del procesamiento de prioridad en el nivel de solicitud

La habilitación del procesamiento de prioridad en el nivel de solicitud es opcional. Tanto la API de finalizaciones de chat como la API de respuestas tienen un atributo service_tier opcional que especifica el tipo de procesamiento que se va a usar al atender una solicitud. En el ejemplo siguiente se muestra cómo establecer service_tier a priority en una solicitud de respuesta.

curl -X POST https://YOUR-RESOURCE-NAME.openai.azure.com/openai/v1/responses \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $AZURE_OPENAI_AUTH_TOKEN" \

-d '{

"model": "gpt-4.1",

"input": "This is a test",

"service_tier": "priority"

}'

Use el service_tier atributo para invalidar la configuración de nivel de implementación.

service_tier puede tomar los valores auto, defaulty priority.

Si no establece el atributo , el valor predeterminado es

auto.service_tier = autosignifica que la solicitud usa el nivel de servicio configurado en la implementación.service_tier = defaultsignifica que la solicitud usa los precios y el rendimiento estándar para el modelo seleccionado.service_tier = prioritysignifica que la solicitud usa el nivel de servicio de procesamiento de prioridad.

En la tabla siguiente se resumen los niveles de servicio que procesan las solicitudes en función de la configuración de nivel de implementación y de nivel de solicitud para service_tier.

| Configuración de nivel de implementación | Configuración de nivel de solicitud | Solicitud procesada por nivel de servicio |

|---|---|---|

| predeterminado | automático, predeterminado | Estándar |

| predeterminado | prioridad | Procesamiento prioritario |

| prioridad | auto, prioridad | Procesamiento prioritario |

| prioridad | predeterminado | Estándar |

Objetivo de latencia

| Tema | gpt-4.1, 2025-04-14 |

|---|---|

| Valor de destino de latencia | 99 % > 80 tokens por segundo* |

* Calculado como la latencia p50 de las solicitudes en intervalos de 5 minutos.

Límites de velocidad de rampa

Para garantizar un alto rendimiento coherente para todos los clientes, a la vez que proporciona precios flexibles y a petición, el procesamiento de prioridades aplica los límites de velocidad de rampa. Actualmente, el límite de velocidad de rampa se define como un aumento del tráfico en más de 50% tokens por minuto en menos de 15 minutos.

Condiciones de degradación

Si el rendimiento del procesamiento de prioridad se degrada y el tráfico de un cliente aumenta demasiado rápidamente, el servicio podría degradar algunas solicitudes de prioridad al procesamiento estándar. El servicio factura las solicitudes procesadas por el nivel de servicio estándar a tarifas estándar. Estas solicitudes no son aptas para el objetivo de latencia de procesamiento prioritario. Las solicitudes procesadas por el nivel de servicio estándar incluyen service_tier = default en la respuesta.

Sugerencia

Si rutinariamente encuentra límites de velocidad de rampa, considere la posibilidad de comprar PTU en lugar de o además del procesamiento prioritario.

Solución de problemas

| Cuestión | Causa | Resolución |

|---|---|---|

| Error HTTP 400 en solicitudes largas | gpt-4.1 no admite solicitudes que superen los 128 000 tokens en el procesamiento prioritario. | Mantenga el total de tokens de solicitud inferiores a 128 000. Divida solicitudes largas en solicitudes más pequeñas. |

| Solicitudes degradadas al nivel estándar | El tráfico se incrementó más de 50 tokens por minuto en menos de 15 minutos, alcanzando el límite de incremento. | Aumente el tráfico gradualmente. Considere la posibilidad de comprar PTU para la capacidad de estado estable. |

| El desbordamiento de PTU no funciona | El procesamiento de prioridad aún no admite el desbordamiento de PTU en una implementación habilitada para el procesamiento de prioridad. | Implemente lógica de desbordamiento personalizada, como mediante Azure API Management. |

service_tier devuelve un valor incorrecto durante el streaming. |

**

Cuando se hace streaming a través del Responses API, service_tier puede indicar "priority" incluso cuando la solicitud fue atendida por el nivel estándar. |

Compruebe los registros de facturación para confirmar qué nivel ha procesado realmente la solicitud. |

Compatibilidad con API

| Versión de la API | |

|---|---|

| Versión más reciente de la API en versión preliminar admitida: | 2025-10-01-preview |