Nota:

El acceso a esta página requiere autorización. Puede intentar iniciar sesión o cambiar directorios.

El acceso a esta página requiere autorización. Puede intentar cambiar los directorios.

El centro en tiempo real se usa para detectar y administrar los datos de streaming en Fabric. La ingesta de datos de streaming con el centro en tiempo real es el primer paso para integrar sin problemas los datos en Fabric, lo que, a su vez, permite a los analistas extraer información en tiempo real de los datos. El amplio conjunto de conectores disponibles garantiza que, independientemente del origen de streaming, puede importar datos sin esfuerzo en Fabric.

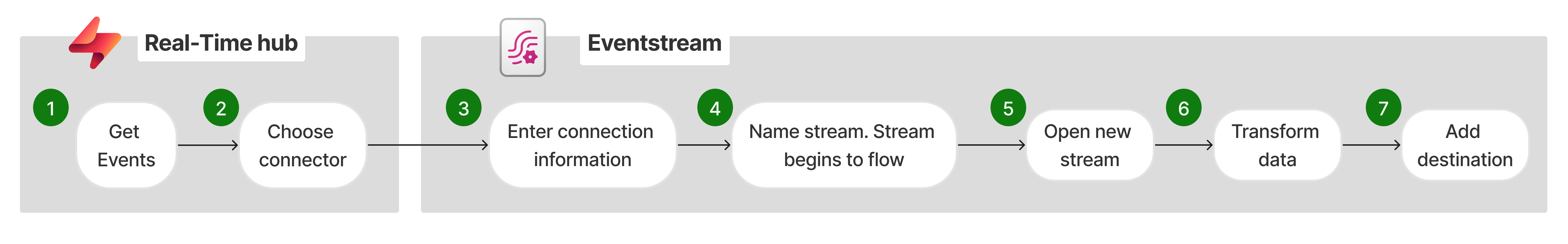

Este flujo de usuario muestra cómo un ingeniero de datos puede cargar y transformar eventos de una amplia variedad de orígenes de streaming en el centro en tiempo real.

Pasos

Vaya al centro en tiempo real y selecciona Obtener eventos.

Se muestran los conectores admitidos. Elige un conector en función de dónde se encuentre el origen de streaming.

Proporciona conexiones al origen, incluidas las credenciales.

Nombra el flujo. Se crea una nueva secuencia de eventos y los datos comienzan a fluir.

Para obtener información detallada y los pasos, consulte Obtención de eventos de orígenesadmitidos.

Abre la secuencia de eventos recién creada.

Define las operaciones de procesamiento de datos que transforman los datos de streaming.

Agregue un destino a la secuencia.

Para obtener información detallada y los pasos, consulta Operaciones de transformación y Agregar y administrar el destino.

Conectores compatibles

Orígenes de Microsoft

| Fuente | Descripción | Aprende más |

|---|---|---|

| Azure Event Hubs | Un servicio de ingesta de datos en tiempo real totalmente administrado. | Aprende más |

| Azure Service Bus (versión preliminar) | Un servicio de mensajería para una comunicación confiable. | Aprende más |

| Azure IoT Hub | Plataforma para administrar datos y dispositivos IoT. | Aprende más |

| CDC de base de datos Azure SQL | Captura y transmisión de cambios en la base de datos en tiempo real. | Aprende más |

| Azure Database for PostgreSQL CDC | Transmita los cambios de las bases de datos postgreSQL. | Aprende más |

| Azure Database for MySQL CDC | Transmisión de cambios de bases de datos MySQL. | Aprende más |

| CDC de Azure Cosmos DB | Transmisión de cambios desde Cosmos DB. | Aprende más |

| CDC de Azure SQL Managed Instance | Captura los cambios de instancias administradas de SQL. | Aprende más |

| CDC de base de datos de SQL Server en VM DB | Transmisión de cambios de SQL Server en máquinas virtuales. | Aprende más |

| Explorador de Datos de Azure | Analice grandes volúmenes de datos en tiempo real. | Aprende más |

Origen externo

| Origen externo | Descripción | Aprende más |

|---|---|---|

| Google Cloud Pub/Sub | Un servicio de mensajería para streaming de eventos en tiempo real. | Aprende más |

| Flujos de datos de Amazon Kinesis | Una plataforma para el procesamiento de datos en tiempo real. | Aprende más |

| Confluent Cloud Kafka | Un servicio kafka nativo de la nube para el streaming de eventos. | Aprende más |

| Apache Kafka (versión preliminar) | Una plataforma de streaming de eventos distribuido. | Aprende más |

| Amazon Managed Streaming para Apache Kafka | Un servicio Kafka administrado para streaming. | Aprende más |

| protocolo MQTT | Un protocolo de mensajería ligero para IoT. | Aprende más |

| Solace PubSub+ | Intermediario de eventos avanzado para la comunicación en tiempo real. | Aprende más |

| Información meteorológica en tiempo real | Origen de datos meteorológicos en tiempo real. | Aprende más |

Eventos discretos

| Origen del evento | Descripción |

|---|---|

| Eventos de Azure Blob Storage | Aprenda a capturar y procesar eventos de Azure Blob Storage. |

| Eventos de elemento del área de trabajo de Fabric | Obtenga información sobre cómo trabajar con eventos de elementos del área de trabajo de Fabric. |

| Eventos de Fabric OneLake | Explore el control de eventos para Fabric OneLake. |

| Eventos de trabajo de Fabric | Administre y procese eventos de trabajo de Fabric de forma eficaz. |

Posibles casos de uso

El origen de datos de streaming está en un clúster de Kafka de Confluent y quieres traerlo a Fabric. La experiencia "GetEvents" en el hub de tiempo real te permite integrarte fácilmente datos desde el clúster de Kafka de Confluent en Fabric.