Comprensión de los conceptos del aprendizaje profundo

En el cerebro, tiene células nerviosas llamadas neuronas, que están conectadas entre sí por extensiones nerviosas que pasan señales electroquímicas a través de la red.

Cuando se estimula la primera neurona de la red, se procesa la señal de entrada y, si supera un umbral determinado, la neurona se activa y pasa la señal a las neuronas a las que está conectada. Estas neuronas a su vez se pueden activar y pasar la señal a través del resto de la red. Con el tiempo, las conexiones entre las neuronas se refuerzan mediante un uso frecuente a medida que aprende a responder de forma eficaz. Por ejemplo, si se muestra una imagen de un pingüino, las conexiones de neurona le permiten procesar la información en la imagen y su conocimiento de las características de un pingüino para identificarla como tal. Con el tiempo, si se muestran varias imágenes de varios animales, la red de neuronas implicadas en la identificación de animales en función de su característica crece más fuerte. En otras palabras, es mejor identificar con precisión diferentes animales.

El aprendizaje profundo emula este proceso biológico mediante redes neuronales artificiales que procesan entradas numéricas en lugar de estímulos electroquímicos.

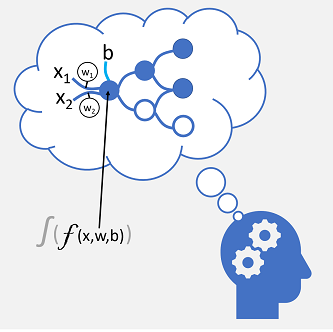

Las conexiones nerviosas entrantes se reemplazan por entradas numéricas que normalmente se identifican como x. Cuando hay más de un valor de entrada, x se considera un vector con elementos denominados x1, x2, etc.

Asociado a cada valor x es un peso (w), que se usa para fortalecer o debilitar el efecto del valor x para simular el aprendizaje. Además, se agrega una entrada de sesgo (b) para habilitar el control detallado sobre la red. Durante el proceso de entrenamiento, los valores w y b se ajustan para ajustar la red para que "aprenda" para generar salidas correctas.

La neurona encapsula una función que calcula una suma ponderada de x, w y b. Esta función se incluye a su vez en una función de activación que restringe el resultado (a menudo a un valor entre 0 y 1) para determinar si la neurona pasa o no una salida a la siguiente capa de neuronas de la red.

Entrenamiento de un modelo de aprendizaje profundo

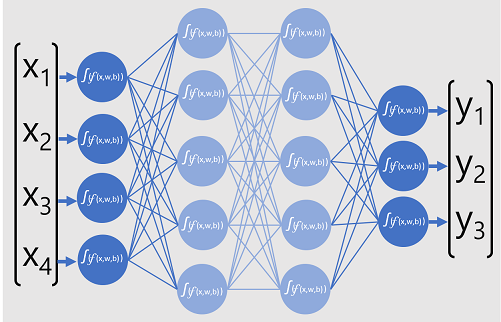

Los modelos de aprendizaje profundo son redes neuronales que constan de varias capas de neuronas artificiales. Cada capa representa un conjunto de funciones que se realizan en los valores x con ponderaciones w y sesgos b asociados, y la capa final resulta en una salida de la etiqueta y que predice el modelo. En el caso de un modelo de clasificación (que predice la categoría o clase más probables para los datos de entrada), la salida es un vector que contiene la probabilidad de cada clase posible.

El diagrama siguiente representa un modelo de aprendizaje profundo que predice la clase de una entidad de datos basada en cuatro características (los valores x ). La salida del modelo (los valores y ) es la probabilidad de cada una de las tres etiquetas de clase posibles.

Para entrenar el modelo, un marco de aprendizaje profundo alimenta varios lotes de datos de entrada (para los que se conocen los valores de etiqueta reales), aplica las funciones en todas las capas de red y mide la diferencia entre las probabilidades de salida y las etiquetas de clase conocidas reales de los datos de entrenamiento. La diferencia agregada entre las salidas de predicción y las etiquetas reales se conoce como pérdida.

Después de calcular la pérdida agregada de todos los lotes de datos, el marco de aprendizaje profundo usa un optimizador para determinar cómo se deben ajustar los pesos y sesgos del modelo para reducir la pérdida general. Estos ajustes se vuelven a propagar a las capas del modelo de red neuronal y, después, se vuelven a pasar los datos a través de la red y se vuelve a calcular la pérdida. Este proceso se repite varias veces (cada iteración se conoce como una época) hasta que se minimiza la pérdida y el modelo ha "aprendido" los pesos y sesgos adecuados para poder predecir con precisión.

Durante cada época, los pesos y sesgos se ajustan para minimizar la pérdida. La cantidad por la que se ajustan se rige por la velocidad de aprendizaje que especifique para el optimizador. Si la velocidad de aprendizaje es demasiado baja, el proceso de entrenamiento puede tardar mucho tiempo en determinar los valores óptimos; pero si es demasiado alto, es posible que el optimizador nunca encuentre los valores óptimos.