Evaluación y comparación de modelos

Cuando finaliza un experimento de aprendizaje automático automatizado (AutoML), quiere revisar los modelos entrenados y decidir cuál ha realizado mejor.

En Azure Machine Learning Studio, puede seleccionar un experimento de AutoML para explorar sus detalles.

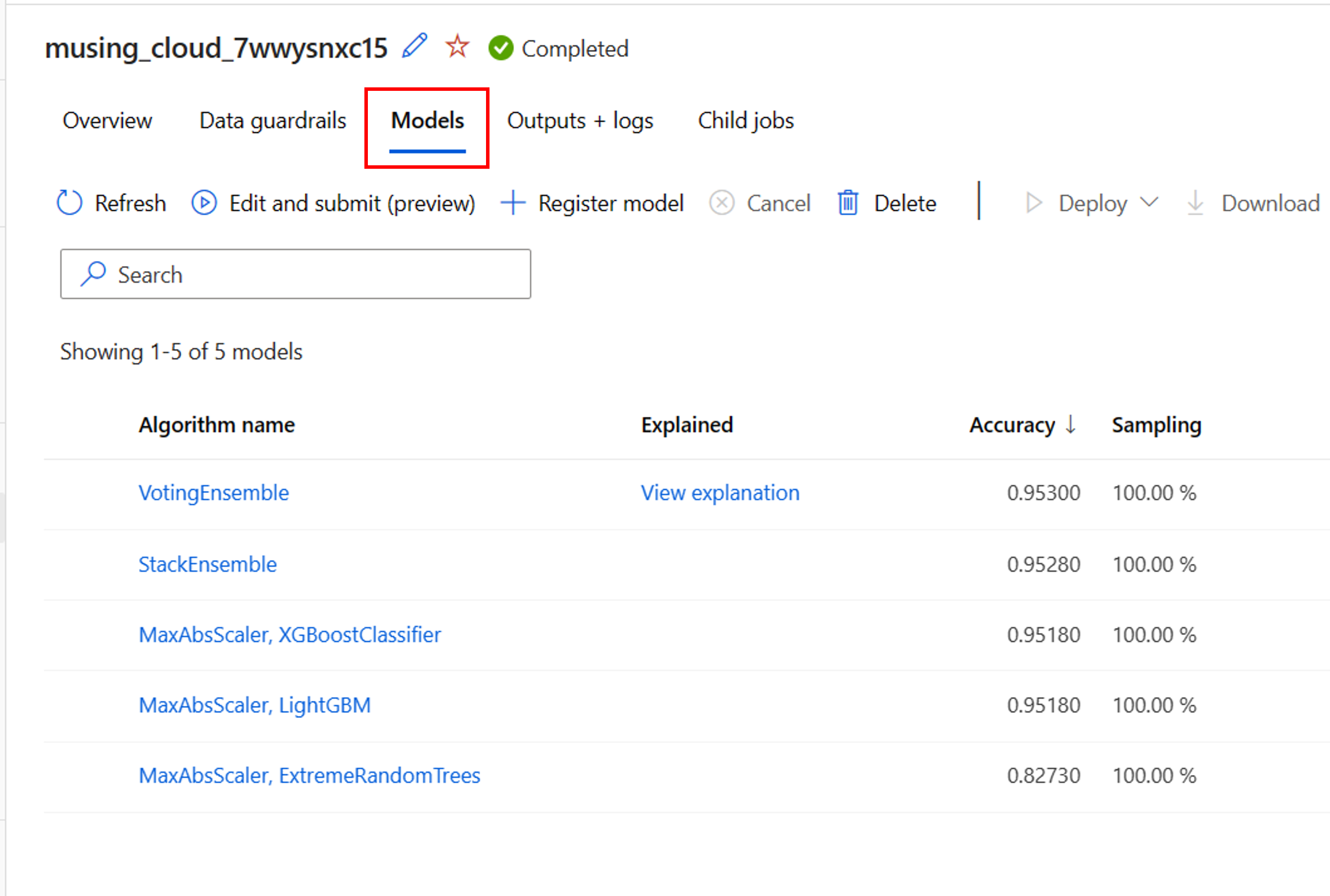

En la página Información general de la ejecución del experimento AutoML, puede revisar el recurso de datos de entrada y el resumen del mejor modelo. Para explorar todos los modelos entrenados, puede seleccionar la pestaña Modelos :

Explorar los pasos de preprocesamiento

Al habilitar la caracterización para el experimento de AutoML, los límites de protección de datos también se aplican automáticamente. Los tres límites de protección de datos que se admiten para los modelos de clasificación son:

- Detección del equilibrio de clases.

- Imputación de valores de características que faltan.

- Detección de características de alta cardinalidad.

Cada uno de estos límites de protección de datos muestra uno de los tres estados posibles:

- Pasado: no se detectaron problemas y no se requiere ninguna acción.

- Listo: los cambios se aplicaron a tus datos. Debe revisar los cambios que AutoML hizo en sus datos.

- Alertado: se detectó un problema, pero no se pudo corregir. Debe revisar los datos para corregir el problema.

Junto a los límites de protección de datos, AutoML puede aplicar técnicas de escalado y normalización a cada modelo entrenado. Puede revisar la técnica aplicada en la lista de modelos en Nombre del algoritmo.

Por ejemplo, el nombre del algoritmo de un modelo enumerado puede ser MaxAbsScaler, LightGBM.

MaxAbsScaler hace referencia a una técnica de escalado en la que cada característica se escala según su valor absoluto máximo.

LightGBM hace referencia al algoritmo de clasificación usado para entrenar el modelo.

Recuperar la mejor ejecución y su modelo

Al revisar los modelos en AutoML, puede identificar fácilmente la mejor ejecución en función de la métrica principal especificada. En Azure Machine Learning Studio, los modelos se ordenan automáticamente para mostrar el modelo de mejor rendimiento en la parte superior.

En la pestaña Modelos del experimento de AutoML, puede editar las columnas si desea mostrar otras métricas en la misma información general. Al crear una introducción más completa que incluya varias métricas, puede ser más fácil comparar modelos.

Para explorar un modelo aún más, puede generar explicaciones para cada modelo entrenado. Al configurar un experimento de AutoML, puede especificar que se deben generar explicaciones para el modelo de mejor rendimiento. Sin embargo, si está interesado en la interpretabilidad de otro modelo, puede seleccionar el modelo en la información general y seleccionar Explicar modelo.

Nota:

Explicar un modelo es una aproximación a la interpretabilidad del modelo. En concreto, las explicaciones calcularán la importancia relativa de las características de la característica de destino (lo que el modelo está entrenado para predecir). Obtenga más información sobre la interpretabilidad del modelo.

Sugerencia

Obtenga más información sobre cómo evaluar las ejecuciones de AutoML.

AutoML proporciona un punto de partida seguro: busca ampliamente y expone la mejor combinación de algoritmos y preprocesamiento para los datos. Pero a veces quieres ir más allá: ajustar los hiperparámetros, crear características personalizadas o probar un enfoque que no cubre AutoML. Aquí es donde entran cuadernos.