Modelos multimodales para el análisis de imágenes

Nota:

Consulte la pestaña Texto e imágenes para obtener más detalles.

Cada vez más, los nuevos modelos de inteligencia artificial son multimodales. En otras palabras, admiten varios tipos de datos de entrada, incluidas imágenes y texto. Los modelos ferroviarios son modelos de inteligencia artificial que pueden comprender y trabajar con más de un tipo de datos al mismo tiempo, como texto, imágenes, audio o vídeo. Por ejemplo, el modelo multimodal podría describir una imagen en lenguaje natural o responder a una pregunta sobre una foto.

Los modelos multimodales se usan comúnmente como parte de:

- Aplicaciones de inteligencia artificial, donde la comprensión de imágenes mejora los flujos de trabajo de usuario

- Agentes de IA, donde la entrada visual ayuda al agente a tomar mejores decisiones

Algunos ejemplos son:

- Agente que revisa los documentos cargados y capturas de pantalla

- Una aplicación de soporte técnico que analiza las fotos enviadas por los clientes

- Herramienta de aprendizaje que explica diagramas o gráficos en lenguaje sencillo

Dado que los modelos bidireccionales aceptan texto e imágenes, reducen la necesidad de canalizaciones de visión independientes y facilitan la creación de experiencias inteligentes de un extremo a otro.

La capacidad de los modelos para combinar la comprensión visual con respuestas de lenguaje natural se conoce como modelos GPT habilitados para visión o GPT con visión. Los modelos con capacidades visuales están diseñados para el razonamiento visual flexible y de propósito general. Pueden analizar la entrada visual y responder en lenguaje natural, lo que facilita la creación de aplicaciones inteligentes sin necesidad de conocimientos profundos de Computer Vision.

Modelos multimodales en Microsoft Foundry

Microsoft Foundry incluye muchos modelos que aceptan entradas basadas en imágenes, lo que le permite crear soluciones inteligentes basadas en la visión. Los modelos multimodales de Microsoft Foundry permiten a las aplicaciones y agentes comprender, analizar y razonar sobre imágenes y contenido visual.

Por ejemplo, los modelos GPT con capacidad de visión en Foundry pueden:

- Describir el contenido de una imagen en lenguaje natural

- Responder a preguntas sobre objetos, texto o escenas de una imagen

- Extraer significado de gráficos, capturas de pantalla, documentos o fotos

- Combine la comprensión de imágenes con instrucciones de texto en una sola indicación

El catálogo de modelos de Foundry contiene muchos modelos multimodales, entre los que se incluyen:

GPT-4.1 / GPT-4.1-mini / GPT-4.1-nano: estos modelos GPT de uso general pueden procesar texto e imágenes juntos. Normalmente se usan para la descripción de imágenes y la respuesta a preguntas visuales, el análisis de documentos y capturas de pantalla, así como la interpretación de diagramas y gráficos.

Serie GPT-5 (por ejemplo, GPT-5.1, GPT-5.2): la familia GPT-5 disponible en Foundry incluye modelos multimodales avanzados diseñados para escenarios empresariales y de agentes. Estos modelos admiten entradas bidireccionales (incluidos texto e imágenes), salidas estructuradas y uso de herramientas, razonamiento de contexto grande entre modalidades. Los modelos de la serie GPT-5 se usan normalmente en agentes de inteligencia artificial de nivel de producción y aplicaciones multiplataforma complejas.

Foundry también hospeda modelos bidireccionales proporcionados por asociados en su catálogo de modelos, incluidos modelos de proveedores como Anthropic y otros que admiten la comprensión de texto e imágenes.

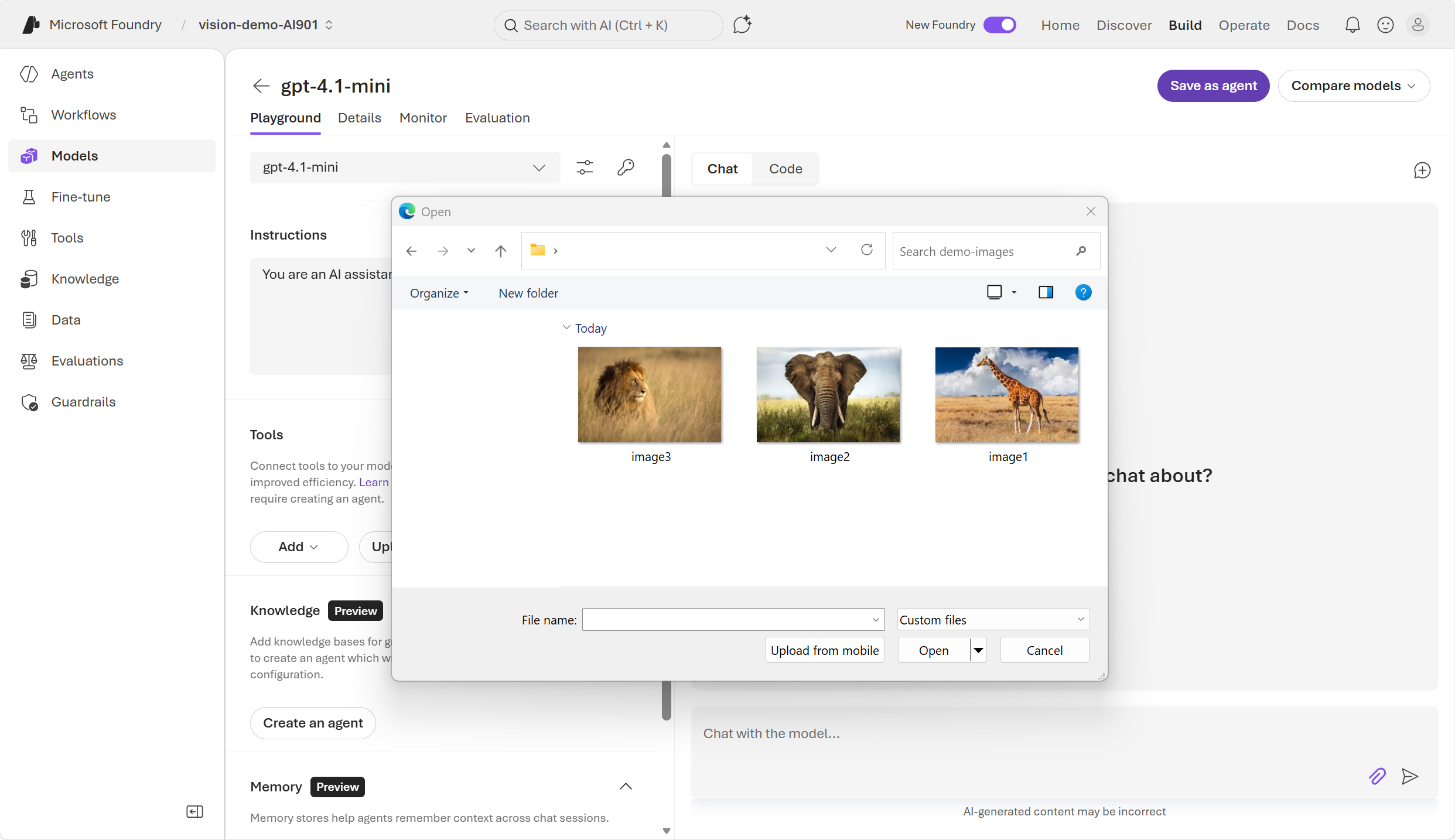

Análisis de imágenes en el área de juegos de Foundry

Nota:

El portal de Foundry tiene una interfaz de usuario (UI) clásica y una nueva interfaz de usuario.

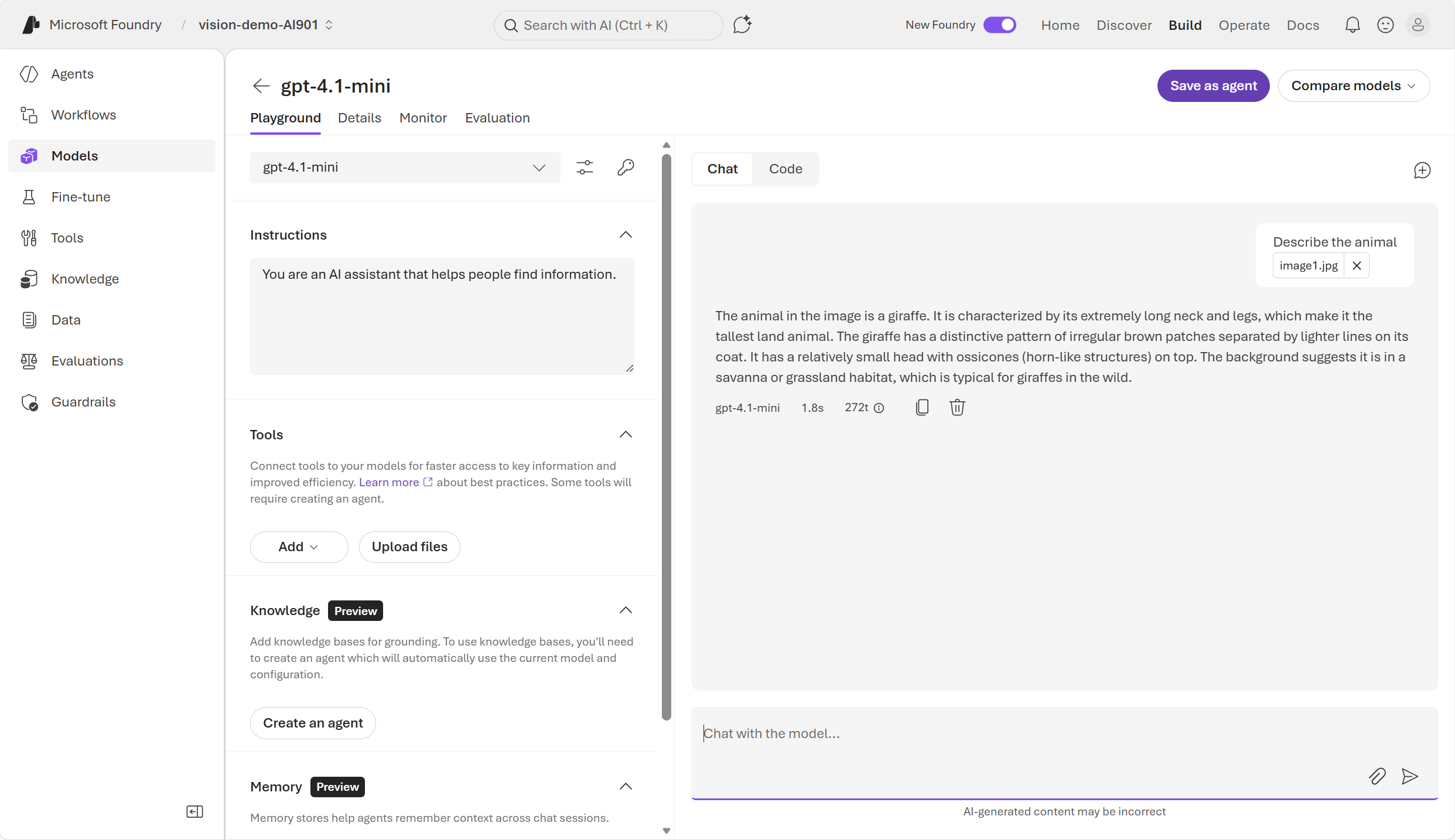

En el nuevo portal de Microsoft Foundry, puede usar el área de juegos de modelos para chatear con un modelo implementado. Puede seleccionar un modelo habilitado para la visión, cargar imágenes y probar mensajes de forma interactiva para comprender cómo interpreta el modelo la información visual.

Por ejemplo, puede adjuntar un archivo de imagen y obtener el modelo multiplataforma (como gpt-4.1 mini) para analizarlo y describirlo.

Una vez validado, se puede acceder a las mismas funcionalidades mediante programación mediante API, lo que permite enviar imágenes junto con mensajes de texto en el código de la aplicación.

Uso de la API de Azure OpenAI para el análisis de imágenes

Para desarrollar una aplicación, debe pasar del área de juegos de Foundry al código. En un editor de código, puede escribir el código de la aplicación mediante la API de respuestas de OpenAI en Foundry. La API de Respuestas de OpenAI está diseñada para aplicaciones agenticas y admite entradas multimodales nativas (incluidas las imágenes).

En un alto nivel:

- Una sola solicitud puede incluir la entrada de texto y la entrada de imagen juntas

- Las imágenes se pueden proporcionar como direcciones URL o como datos de imagen codificados en base64

- El modelo procesa ambas entradas simultáneamente para generar una respuesta.

Conceptualmente, la estructura del prompt tiene el siguiente aspecto:

- Una instrucción de texto (por ejemplo, ¿Qué objetos están visibles en esta imagen?)

- Una o varias entradas de imagen adjuntas a la misma solicitud

Este enfoque permite a los desarrolladores crear aplicaciones en las que los usuarios carguen imágenes y hagan preguntas sobre ellas en tiempo real.

Uso del SDK de Python de Azure OpenAI

Puede usar un recurso de Microsoft Foundry con la API de OpenAI para realizar análisis de imágenes( incluido el envío de imágenes en mensajes y la obtención de respuestas de texto) mediante la API de respuestas con una implementación de modelo compatible con la visión.

El SDK de Python se puede instalar en el terminal de Visual Studio Code mediante:

pip install openai

En el editor de código, podemos crear un archivo de Python, que contiene código de aplicación. Es importante que recuerde que necesita la clave y el punto de conexión del recurso de Foundry, junto con el nombre del modelo implementado.

Nota:

Al implementar un modelo en Foundry, tiene un nombre base o original y un nombre de implementación original que se le asigna. Foundry hospeda el modelo implementado (por ejemplo, modelos de clase GPT con visión) y proporciona un punto de conexión.

En el ejemplo de código, creas el cliente, lo diriges al punto de conexión y pasas el nombre de implementación del modelo (el nombre que asignaste al modelo) como MODEL_NAME.

import os

from openai import OpenAI

# Environment variables you set locally or in your app service:

FOUNDRY_KEY = "... your key ..."

ENDPOINT = "https://YOUR-RESOURCE-NAME.openai.azure.com/openai/v1/"

MODEL_NAME = "your-model-deployment-name" # e.g., "gpt-4.1-mini" deployed as "my-vision-deploy"

client = OpenAI(

api_key=os.getenv("FOUNDRY_KEY"),

base_url=os.getenv("ENDPOINT"),

)

image_url = ""

response = client.responses.create(

model=os.getenv("MODEL_NAME"), # your deployment name

input=[

{

"role": "user",

"content": [

{"type": "input_text", "text": "What is in this image? Provide 3 bullet points."},

{"type": "input_image", "image_url": image_url}

],

}

],

)

print(response.output_text)

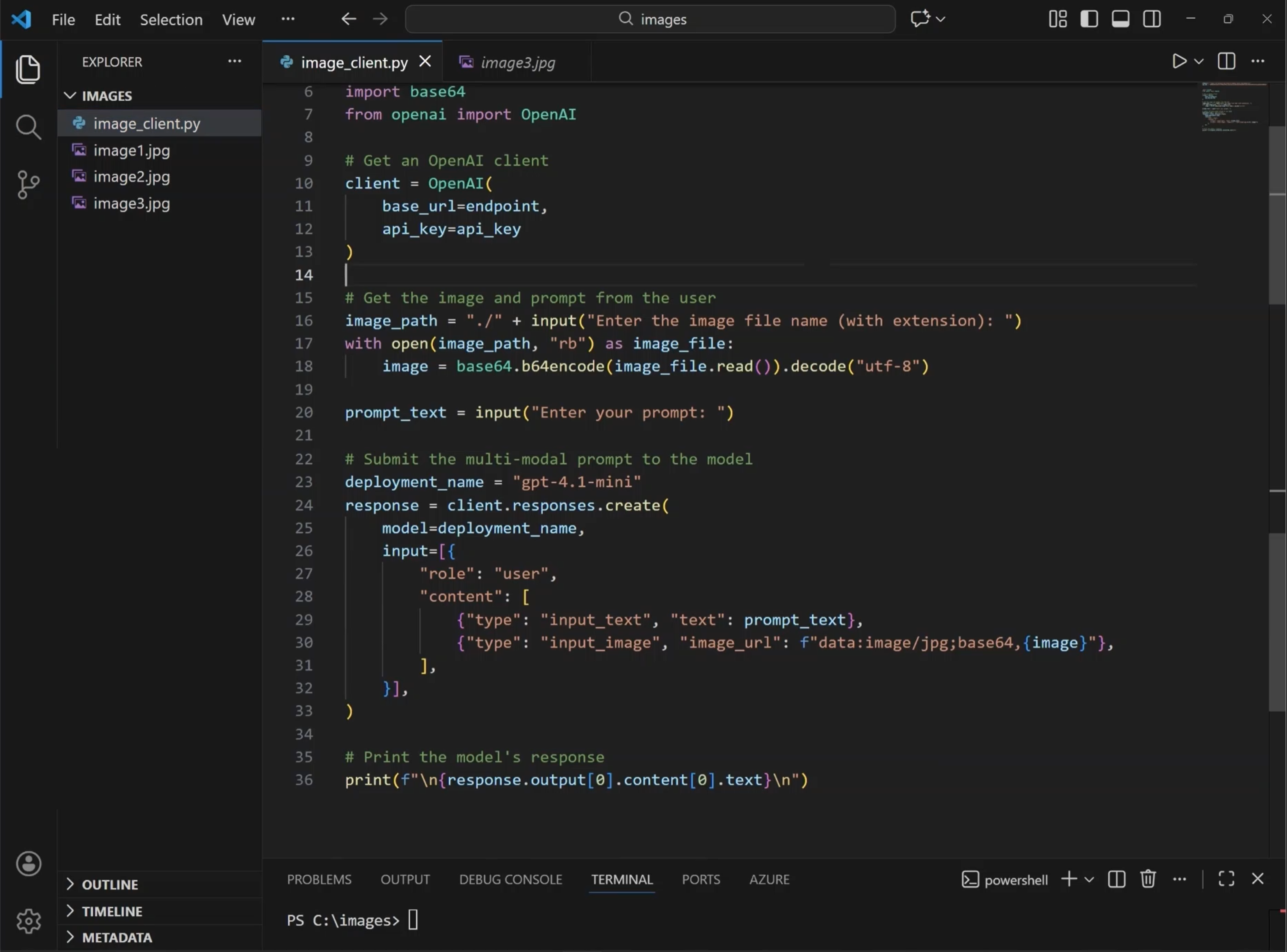

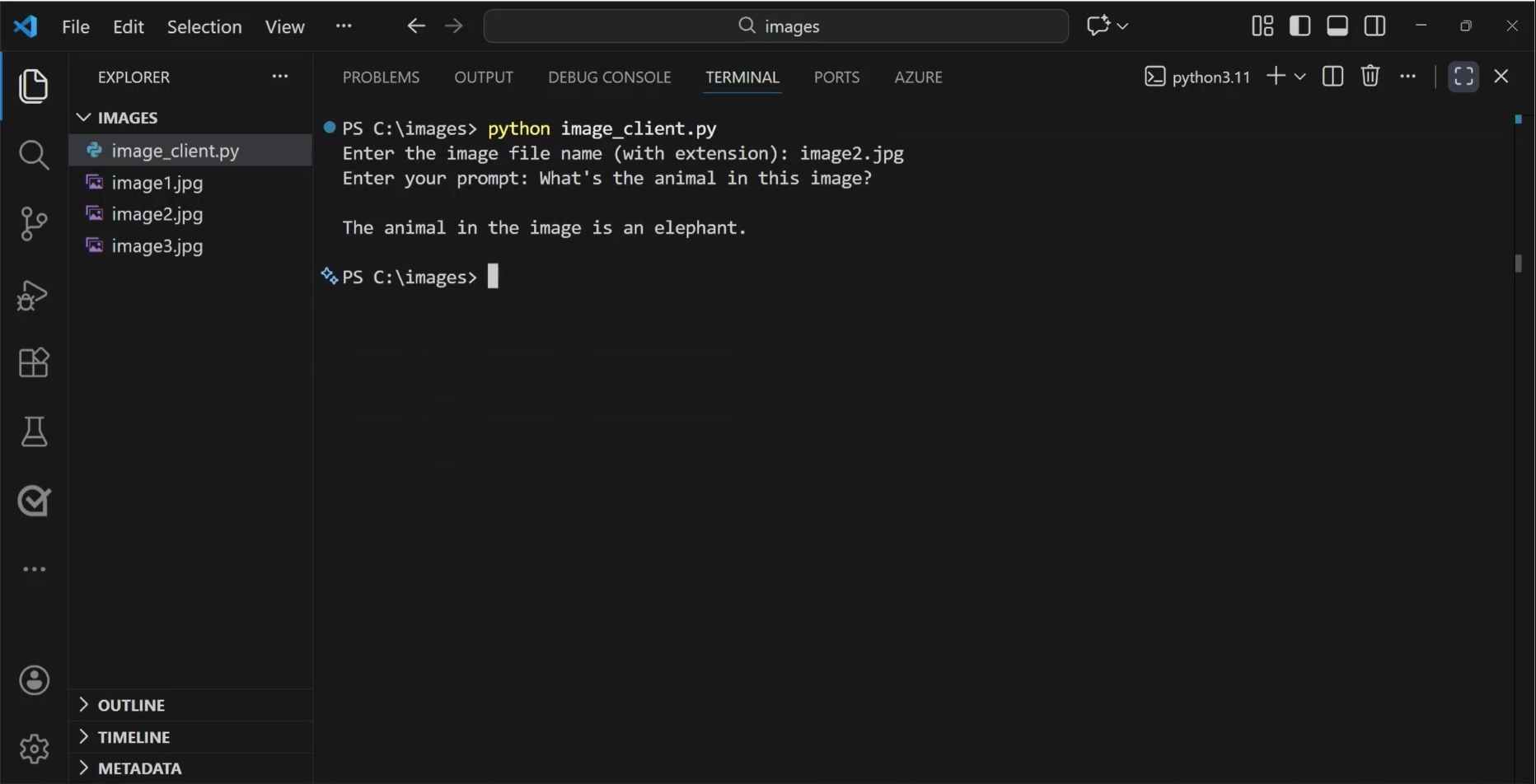

Ejemplo de aplicación cliente

Puede crear una aplicación personalizada que use un modelo habilitado para visión para analizar una imagen con el SDK de Python de OpenAI. Por ejemplo, supongamos que desea crear una aplicación que pueda identificar animales fotografíados en Safari. Puede cargar las fotos y crear un archivo de Python en el editor de código.

A continuación, puede escribir código de aplicación que use la API de OpenAI para conectarse al punto de conexión del modelo en Foundry.

El código de la aplicación debe cargar los datos de la imagen y obtener un mensaje de lenguaje natural de un usuario. Para enviar la entrada al modelo, debe crear un mensaje de varias partes que incluya los datos de imagen y texto. El modelo puede responder con una salida adecuada basada en el texto y la imagen de la solicitud.

A continuación, aprenda a usar los modelos Foundry y el SDK de Azure OpenAI para la generación de imágenes.