Revisión de las pruebas

Al usar Optuna para probar varias combinaciones de hiperparámetros, puede revisar los detalles de cada prueba. Puede revisar estos detalles de dos maneras:

- Vea la ejecución de MLflow para cada prueba.

- Use las clases Study y Trial para capturar los detalles de ejecución.

Visualización de la ejecución de MLflow para cada prueba

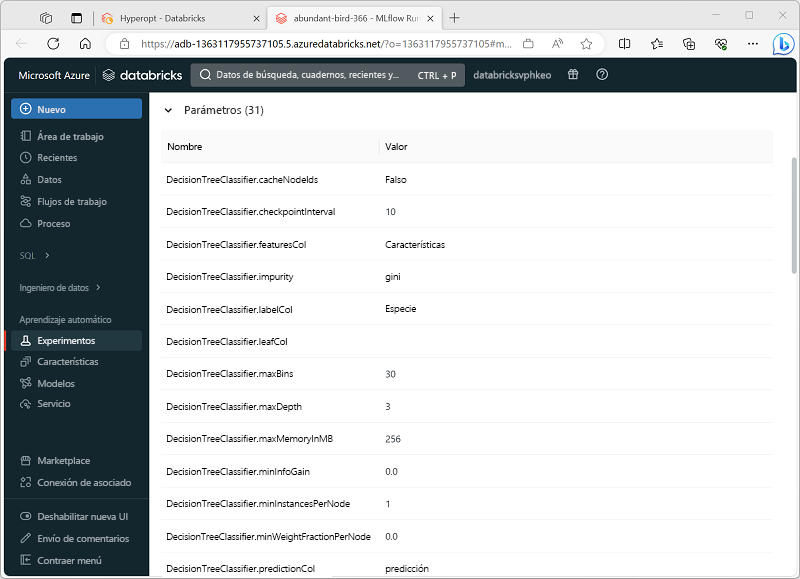

En Azure Databricks, puede integrar Optuna con MLflow para generar automáticamente ejecuciones de experimentos de MLflow para cada prueba. Esto proporciona una manera sencilla de ver el conjunto completo de hiperparámetros y métricas para cada prueba en el portal de Azure Databricks, como se muestra aquí:

Uso de las clases De estudio y prueba

Optuna administra los detalles de prueba mediante las clases Estudio y Prueba .

Estudiar: Un estudio representa una sesión de optimización. Administra el proceso general de encontrar los mejores hiperparámetros. Puede considerarlo como un contenedor que almacena todas las pruebas, sus resultados y los mejores parámetros encontrados hasta ahora.

Juicio: Una prueba representa una sola ejecución del proceso de optimización con un conjunto específico de hiperparámetros. Cada prueba registra los valores de parámetro usados, el valor objetivo resultante (como la precisión o pérdida) y otros metadatos (como duración, estado, etc.).

En el ejemplo de código siguiente se muestra cómo usar Optuna para revisar los detalles de cada prueba.

import optuna

def objective(trial):

# Define your hyperparameters using trial.suggest_* methods

x = trial.suggest_float("x", -10, 10)

# ... your model training and evaluation ...

return (x - 2) ** 2 # Example objective

study = optuna.create_study(direction="minimize")

study.optimize(objective, n_trials=100)

print("Best param values: ", study.best_params)

# Get details from each trial run

print("trials:")

for trial in study.trials:

print("\n", trial)

Sugerencia

Para obtener más información sobre los detalles registrados por las clases de prueba , consulte la documentación de Optuna.