Selección de modelos mediante pruebas comparativas

Antes de implementar un modelo, desea comprender su desempeño en diferentes dimensiones. Las pruebas comparativas de modelos proporcionan datos objetivos y medibles para ayudarle a comparar modelos y tomar decisiones de selección informadas. El portal de Microsoft Foundry ofrece herramientas de pruebas comparativas completas organizadas en métricas de calidad, seguridad, costo y rendimiento.

pruebas comparativas de modelos de Access

Puede explorar pruebas comparativas de dos maneras en el portal de Microsoft Foundry:

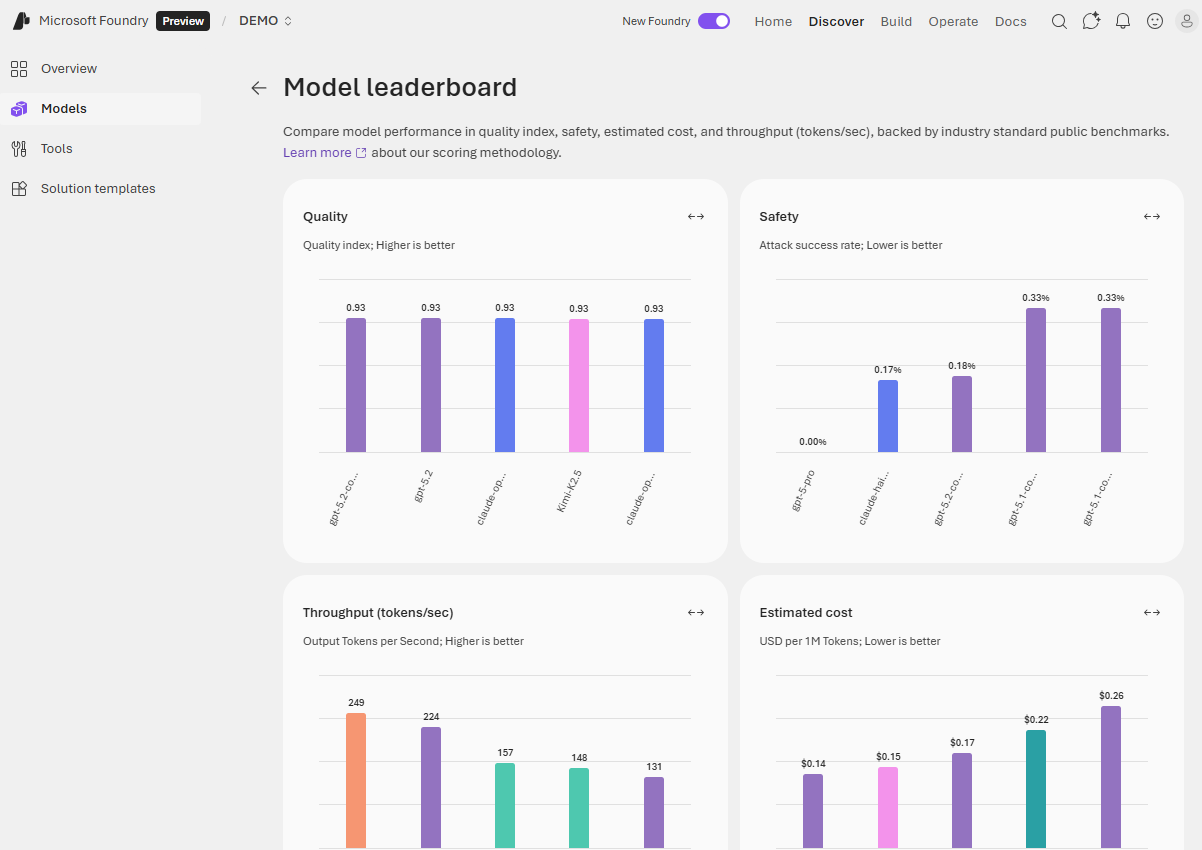

En el catálogo de modelos, seleccione Ir a la tabla de clasificación para ver clasificaciones comparativas en todos los modelos disponibles. Esta vista le ayuda a identificar modelos de alto rendimiento para métricas o escenarios específicos. La tabla de clasificación muestra los modelos principales clasificados por calidad, seguridad, costo estimado y rendimiento.

Para obtener pruebas comparativas detalladas en un modelo específico, abra su tarjeta de modelo y seleccione la pestaña Pruebas comparativas . En esta vista se muestra cómo funciona el modelo individual en varias métricas y conjuntos de datos, con gráficos de comparación que lo colocan en relación con modelos similares.

Pruebas comparativas de calidad

Las pruebas comparativas de calidad evalúan el grado en que un modelo genera respuestas precisas, coherentes y contextualmente adecuadas. Estas métricas usan conjuntos de datos públicos y métodos de evaluación estandarizados para garantizar la coherencia.

El índice de calidad proporciona información general de alto nivel mediante la media de las puntuaciones de precisión en varios conjuntos de datos de pruebas comparativas que miden el razonamiento, el conocimiento, la respuesta a preguntas, las funcionalidades matemáticas y las aptitudes de codificación. Los valores de índice de mayor calidad indican un rendimiento general más sólido en las tareas de lenguaje de uso general.

Las pruebas comparativas de calidad usan conjuntos de datos como:

- Arena-Hard - respuesta a preguntas adversariales

- BIG-Bench Hard - capacidades de razonamiento

- GPQA : preguntas de varias disciplinas de nivel de graduado

- HumanEval+ y MBPP+: tareas de generación de código

- MATH : razonamiento matemático

- MMLU-Pro : evaluación general de conocimientos

- IFEval : instrucciones siguientes

Las puntuaciones comparativas son índices normalizados que van de cero a uno, donde los valores más altos indican un mejor rendimiento.

Pruebas comparativas de seguridad y riesgo

Las métricas de seguridad garantizan que los modelos no generen contenido dañino, sesgado o inadecuado. Estos puntos de referencia son cruciales para las aplicaciones expuestas a los usuarios finales, especialmente en sectores regulados o escenarios orientados al cliente.

Microsoft Foundry evalúa los modelos en varias dimensiones de seguridad:

La detección de comportamientos perjudiciales usa la prueba comparativa HarmBench para medir la resistencia de los modelos a la generación de contenido no seguro. La evaluación calcula la tasa de éxito de ataques (ASR), donde los valores más bajos indican modelos más seguros y sólidos. HarmBench prueba tres áreas funcionales:

- Comportamientos dañinos estándar : ciberdelincuencia, actividades ilegales, daño general

- Comportamientos contextualmente dañinos: información errónea, hostigamiento, acoso

- Infracciones de derechos de autor : reproducción del material protegido por derechos de autor

La detección de contenido tóxico utiliza el conjunto de datos ToxiGen para medir qué tan bien los modelos identifican el discurso de odio implícito y adversarial. Las puntuaciones de F1 más altas indican un mejor rendimiento de detección en las referencias a grupos minoritarios.

El conocimiento de dominios sensibles usa el punto de referencia WMDP (proxy de armas de destrucción masiva) para medir el conocimiento del modelo en bioseguridad, ciberseguridad y seguridad química. Las puntuaciones más altas de WMDP indican más conocimiento de las funcionalidades potencialmente peligrosas.

Las puntuaciones de seguridad le ayudan a comprender la solidez del modelo, especialmente importante para las aplicaciones orientadas al cliente en las que la salida perjudicial plantea problemas importantes.

Referencias de costos

Comprender el impacto financiero del uso del modelo le ayuda a equilibrar los requisitos de calidad con restricciones presupuestarias. Las pruebas comparativas de costos de Microsoft Foundry muestran los precios de las implementaciones de API sin servidor y Azure modelos de OpenAI.

El costo por tokens de entrada muestra el precio del procesamiento de 1 millón de tokens de entrada (el texto que envía al modelo).

El costo por tokens de salida indica el precio de generar 1 millón de tokens de salida (el texto que genera el modelo).

El costo estimado combina los costos de entrada y salida mediante una relación típica de 3:1 (tres tokens de entrada para cada token de salida), lo que proporciona un único número para la comparación. Los valores inferiores indican modelos más rentables.

Las pruebas comparativas de costos le ayudan a identificar modelos que proporcionan la calidad que necesita a un precio que se ajuste a los patrones de uso y el presupuesto de la aplicación.

Pruebas comparativas de rendimiento

Las métricas de rendimiento miden la rapidez y eficacia de los modelos que responden a las solicitudes. Estos puntos de referencia son importantes para las aplicaciones en tiempo real en las que la experiencia del usuario depende de la capacidad de respuesta.

Las medidas de latencia incluyen:

- Media de latencia : promedio de tiempo en segundos para procesar una solicitud

- Latencia P50 (mediana): 50% de solicitudes se completan más rápido que esta vez

- Latencia P90 : 90% de solicitudes se completan más rápido que esta vez

- Latencia P95 : el 95% de las solicitudes se completan más rápido que este tiempo

- Latencia P99 - el 99% de las solicitudes se completan más rápido que este tiempo

- Tiempo hasta el primer token (TTFT) - tiempo hasta que llega el primer token al usar streaming

Las medidas de rendimiento incluyen:

- Tokens generados por segundo (GTPS): tokens de salida generados por segundo

- Total de tokens por segundo (TTPS): tokens de entrada y salida combinados procesados por segundo

- Tiempo entre tokens: intervalo entre la recepción de tokens consecutivos

La tabla de clasificación resume el rendimiento mediante el tiempo medio para el primer token (menor es mejor) y los tokens generados por segundo (más alto es mejor). Los modelos de alto rendimiento y baja latencia proporcionan mejores experiencias de usuario en aplicaciones interactivas. Para los trabajos de procesamiento por lotes en los que la velocidad es menor que el costo, puede priorizar otros factores.

Uso de tablas de clasificación y características de comparación

La tabla de clasificación del modelo permite ver los modelos principales para métricas específicas. Puede ordenar por calidad, seguridad, costo estimado y rendimiento para identificar los modelos que mejor se adapten a sus requisitos.

Las tablas de clasificación de escenarios le ayudan a encontrar modelos optimizados para casos de uso específicos, como razonamiento, codificación, matemáticas, respuesta a preguntas o base. Si la aplicación se asigna a un escenario determinado, comience con la tabla de clasificación del escenario pertinente en lugar de confiar únicamente en el índice de calidad general.

Los gráficos de equilibrio muestran dos métricas simultáneamente, como la calidad frente al costo o la calidad frente al rendimiento. Estas visualizaciones le ayudan a encontrar el equilibrio óptimo para sus requisitos. Use la lista desplegable para comparar la calidad con el costo, el rendimiento o la seguridad. Los modelos más cerca de la esquina superior derecha del gráfico funcionan bien en ambas métricas. Un modelo que sea ligeramente menos preciso, pero significativamente más rápido o más barato podría satisfacer mejor sus necesidades.

La comparación en paralelo le permite seleccionar dos o tres modelos en la tabla de clasificación y compararlos entre varias dimensiones:

- Pruebas comparativas de rendimiento (calidad, seguridad, rendimiento)

- Detalles del modelo (ventana de contexto, datos de entrenamiento, idiomas admitidos)

- Puntos de conexión admitidos (opciones de implementación)

- Soporte de funciones (llamada a funciones, salida estructurada, visión)

Seleccione modelos activando casillas junto a sus nombres y, a continuación, elija Comparar para abrir la vista de comparación detallada.

Evalúe con sus propios datos

Aunque los resultados de pruebas comparativas públicas proporcionan una guía valiosa, también puede evaluar modelos con sus propios datos de prueba. En la pestaña Pruebas comparativas de un modelo, seleccione Probar con sus propios datos para ejecutar evaluaciones en escenarios específicos de la aplicación.

Esta evaluación personalizada usa sus propios mensajes, respuestas esperadas y criterios de evaluación. Los resultados muestran cómo funciona el modelo en el caso de uso real, complementando los datos de pruebas comparativas públicas con información específica de la aplicación.

Al combinar pruebas comparativas públicas con pruebas personalizadas, se recopilan las pruebas necesarias para seleccionar un modelo con confianza. No solo comprende cómo funciona un modelo por lo general, sino también cómo se solucionan específicamente los requisitos únicos de calidad, seguridad, costo y rendimiento.