Evaluación del rendimiento del modelo

Evaluar el modelo implementado garantiza que cumple los estándares de calidad, proporciona respuestas precisas y mejora continuamente con el tiempo. El portal de Microsoft Foundry ofrece varios enfoques para la evaluación, desde pruebas manuales hasta métricas automatizadas y flujos de evaluación completos.

¿Por qué evaluar modelos?

La evaluación sirve para varios propósitos críticos para el desarrollo de aplicaciones de IA generativas:

El control de calidad identifica los problemas y garantiza que el modelo proporciona respuestas precisas y relevantes. Detectar problemas durante la evaluación en lugar de producción protege a los usuarios y la reputación de su organización.

La satisfacción del usuario mejora cuando los modelos proporcionan respuestas útiles y adecuadas de forma coherente. La evaluación le ayuda a comprender cómo los usuarios experimentan la aplicación y dónde las mejoras hacen el mayor impacto.

La mejora continua procede del análisis de los resultados de evaluación para identificar las oportunidades de mejora. La evaluación regular a medida que actualizas las indicaciones, agregas funcionalidades o vuelves a entrenar modelos garantiza la calidad continua.

La comprobación de cumplimiento y seguridad confirma que el modelo cumple las directivas, evita generar contenido dañino y respeta los requisitos de protección de datos y privacidad del usuario.

Enfoques de evaluación manual

La evaluación manual implica a los revisores humanos que evalúan las respuestas del modelo. Aunque la evaluación manual consume mucho tiempo, proporciona perspectivas que las métricas automatizadas no pueden capturar.

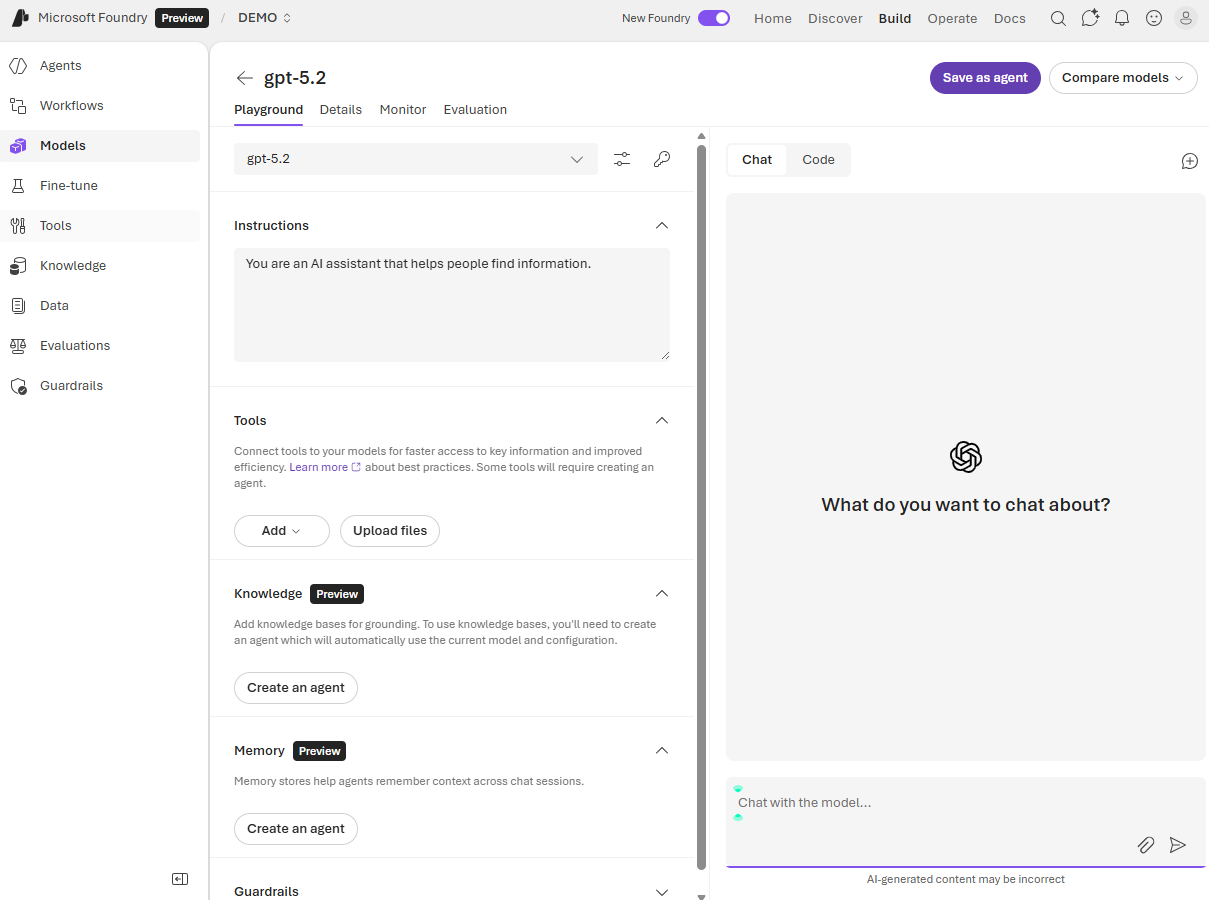

Las pruebas interactivas en el área de juegos le permiten explorar el comportamiento del modelo cualitativamente. Usted introduce diversas solicitudes, observa las respuestas y toma nota de problemas como información incorrecta, tono inadecuado o incumplimiento de las instrucciones. Esta prueba exploratoria le ayuda a comprender los puntos fuertes y las limitaciones del modelo.

La revisión estructurada implica la creación de un conjunto de casos de prueba que representan los casos de uso de la aplicación. Los evaluadores humanos evalúan las respuestas en función de criterios como:

- Relevancia: ¿La respuesta aborda la pregunta o solicitud?

- Información: ¿Proporciona información útil y detalles suficientes?

- Engagement: ¿La respuesta es interesante y adecuadamente conversacional?

- Precisión: ¿Son correctos los hechos y las declaraciones?

- Seguridad: ¿La respuesta evita contenido dañino, sesgado o inapropiado?

Los evaluadores suelen usar escalas de clasificación (como 1-5) para cada criterio. Las clasificaciones agregadas en varios casos de prueba proporcionan medidas cuantitativas de calidad general.

Los estudios de usuario recopilan comentarios de usuarios reales o representativos que interactúan con la aplicación. Los comentarios del usuario revelan problemas reales que podrían perderse en las pruebas controladas, como expresiones confusas, contexto que faltan o expectativas no deseadas.

La evaluación manual complementa los enfoques automatizados mediante la captura de aspectos de calidad subjetivas, como la satisfacción del usuario, la idoneidad contextual y la alineación de marca que las métricas por sí solas no pueden medir.

Métricas de evaluación asistida por IA

La evaluación asistida por IA usa modelos avanzados de inteligencia artificial para evaluar automáticamente las salidas del modelo. Estas evaluaciones se escalan de forma eficaz y proporcionan medidas objetivas coherentes.

El portal de Microsoft Foundry admite varias categorías de métricas asistidas por IA, entre las que se incluyen:

Las métricas de calidad de generación evalúan la calidad general de la respuesta:

- Base: determina si las respuestas están basadas en el contexto proporcionado en lugar de basarse en la especulación. Groundedness Pro ofrece una evaluación binaria (fundamentada o no fundamentada) útil para los requisitos de precisión fáctica.

- Relevancia: mide si las respuestas abordan la pregunta o solicitud del usuario de forma adecuada.

- Coherencia: evalúa si las respuestas fluyen lógicamente y mantienen ideas coherentes.

- Fluidez: evalúa la exactitud lingüística y la calidad del lenguaje natural.

Las métricas de riesgo y seguridad identifican el contenido potencialmente perjudicial:

- Contenido de autolesión: Detecta respuestas que analizan o fomentan la autolesión

- Contenido odioso e injusto: identifica sesgos, discriminación o declaraciones odiosas

- Contenido violento: marca las respuestas que contienen o promueven la violencia

- Contenido sexual: detecta contenido sexual inadecuado

- Material protegido: identifica posibles derechos de autor o reproducción de contenido propietario.

- Ataque indirecto (jailbreak): evalúa la vulnerabilidad a los intentos de manipulación.

En el caso de las métricas de daño de contenido, los resultados se agregan como tasa de defectos: el porcentaje de respuestas que superan un umbral de gravedad (normalmente medio). Para el material protegido y el ataque indirecto, la tasa de defectos se calcula como (true instances / total instances) × 100.

Al usar la evaluación asistida por IA, se especifica un modelo GPT para realizar la evaluación. Este modelo de evaluador analiza las respuestas del modelo implementado y asigna puntuaciones según los criterios seleccionados.

Métricas de procesamiento de lenguaje natural

Las métricas de NLP proporcionan una evaluación basada en matemáticas sin necesidad de un modelo de evaluador. Estas métricas a menudo necesitan datos de la verdad básica: respuestas esperadas o correctas para la comparación.

La puntuación F1 mide la proporción de palabras compartidas entre las respuestas generadas y las de referencia, equilibrando la precisión (evitando palabras incorrectas) y el recuerdo (incluir palabras importantes). La puntuación F1 es valiosa para tareas como la clasificación de texto y la recuperación de información.

BLEU (suplente de evaluación bilingüe) compara n-gramas (secuencias de palabras) entre textos generados y textos de referencia, y se usa habitualmente para evaluar la traducción automática.

METEOR (Métrica para evaluación de traducción con ordenación explícita) amplía BLEU teniendo en cuenta sinónimos, lematización y parafraseo, lo que proporciona una comparación más flexible.

ROUGE (subestudio orientado a la recuperación para la evaluación de Gisting) da prioridad a la memorización sobre la precisión, lo que lo hace especialmente útil para tareas de resumen en las que es más importante cubrir los puntos clave que evitar palabras innecesarias.

GLEU (Google-BLEU) es una variante de BLEU diseñada para la evaluación de nivel de oración.

Las métricas de NLP funcionan bien cuando tiene respuestas correctas definitivas o textos de referencia. Son menos adecuados para la generación abierta en la que existen muchas respuestas válidas.

Creación de evaluaciones completas

La característica evaluación del portal de Microsoft Foundry permite ejecutar evaluaciones sistemáticas mediante conjuntos de datos de prueba y varias métricas simultáneamente.

Configurar una evaluación

Para crear una evaluación:

Vaya a Evaluación en el panel izquierdo y seleccione Crear. También puede iniciar evaluaciones desde la pestaña Pruebas comparativas de un modelo seleccionando Probar con sus propios datos, o bien en las páginas del área de juegos de modelos y agentes seleccionando Evaluación>crear oEjecutar evaluación completa de >.

Elija el destino de evaluación:

- Modelo: evalúe un modelo implementado con las indicaciones que especifique. El sistema genera salidas durante la evaluación.

- Agente: evalúe las respuestas de un agente con avisos definidos por el usuario.

- Conjunto de datos: evalúe las salidas generadas previamente que ya están presentes en el conjunto de datos de prueba.

Configurar datos de prueba:

Al evaluar un modelo o agente, necesita un conjunto de datos para proporcionar entradas para la evaluación. Tiene tres opciones:

- Upload new dataset: Proporcione un archivo CSV o JSONL que contenga casos de prueba de su almacenamiento local.

- Usar el conjunto de datos existente: Seleccione entre los conjuntos de datos que ha cargado anteriormente en el proyecto.

- Generar conjunto de datos sintéticos: si carece de datos de prueba, el sistema puede generar datos de ejemplo en función de una descripción del tema que proporcione. Especifique el recurso para generar datos, el número de filas y un mensaje que describa los datos deseados. También puede cargar archivos para mejorar la relevancia de su tarea específica.

En el caso de la evaluación del conjunto de datos en el que las salidas se generan previamente, basta con seleccionar o cargar el conjunto de datos que contiene las entradas y las respuestas generadas por el modelo.

Seleccione métricas de evaluación:

Elija entre tres categorías:

- Calidad de la inteligencia artificial (asistida por IA): solidez, relevancia, coherencia, fluencia, similitud de GPT

- Calidad de IA (NLP): puntuación F1, ROUGE, BLEU, GLEU, METEOR

- Riesgo y seguridad: daño al contenido, material protegido, ataque indirecto

Para las métricas asistidas por IA, especifique el modelo GPT que se usará como evaluador. Debe ser un modelo capaz como GPT-4, aunque puede usar diferentes modelos en función de sus necesidades y presupuesto.

Mapear columnas del conjunto de datos: El sistema asigna automáticamente las columnas del conjunto de datos a los campos requeridos por cada métrica (consulta, respuesta, contexto, verdad de referencia). Revise estas asignaciones para garantizar la precisión y reasignar campos si es necesario. Por ejemplo, la evaluación de fundamentación requiere columnas para la pregunta, el contexto y la respuesta generada.

Después de la configuración, revise la configuración, proporcione opcionalmente un nombre para la evaluación y seleccione Enviar. La evaluación se ejecuta de forma asincrónica, procesando cada fila del conjunto de datos de prueba con las métricas seleccionadas.

Revisión de los resultados de la evaluación

Cuando se complete la evaluación, acceda a los resultados de la página Evaluation. El panel muestra lo siguiente:

Agregación de puntuaciones para cada métrica, que muestra el rendimiento general en el conjunto de datos de prueba. Las métricas de calidad de ia muestran puntuaciones medias (escala de 1 a 5 normalmente), mientras que las métricas de riesgo y seguridad muestran tasas de defectos (porcentaje de respuestas problemáticas).

Los paneles de métricas visualizan el rendimiento con tablas y gráficos. Estas visualizaciones le ayudan a identificar rápidamente áreas de fuerza y preocupación.

Los detalles por muestra le permiten profundizar en cada caso de prueba individual para ver puntuaciones específicas y comprender por qué ciertas respuestas obtuvieron puntajes altos o bajos. Esta vista granular le ayuda a identificar patrones en errores o éxitos.

Las vistas de comparación cuando se ejecutan varias evaluaciones le permiten comparar el rendimiento entre versiones del modelo, preguntar variaciones o cambios de configuración. Seleccione dos o más ejecuciones de evaluación y elija Comparar para generar vistas de comparación en paralelo. La comparación usa pruebas t estadísticas para proporcionar resultados confidenciales y confiables. Puede establecer una línea de base y ver la significación estadística con celdas codificadas por colores que indican mejoras, degradaciones o cambios inconclusos. El seguimiento de mejoras o regresiones guía tus decisiones de desarrollo.

Los comentarios humanos están disponibles en la tabla de resultados detallados, donde puede seleccionar iconos de pulgar hacia arriba o hacia abajo mientras revisa los resultados. Esta característica permite registrar las instancias aprobadas o marcadas como incorrectas por los revisores humanos, especialmente útiles cuando las etiquetas de gravedad automatizadas podrían no alinearse con los estándares de su organización.

Seleccione Más información sobre las métricas en el panel para obtener definiciones, fórmulas e instrucciones de interpretación detalladas para cada métrica.

Exploración de la biblioteca del evaluador

La biblioteca evaluador proporciona una ubicación centralizada para ver y administrar todos los evaluadores disponibles. Accede a él desde la página de Evaluation de tu proyecto seleccionando la pestaña Evaluator library.

En la biblioteca del evaluador, puede hacer lo siguiente:

- Ver evaluadores seleccionados por Microsoft para la calidad, la seguridad y el rendimiento

- Examine los detalles del evaluador, incluidos el nombre, la descripción, los parámetros y los archivos asociados.

- Revise las solicitudes de anotación para que los evaluadores de calidad comprendan cómo se calculan las métricas.

- Comprobación de definiciones y niveles de gravedad para evaluadores de seguridad

- Administrar evaluadores personalizados que ha creado para escenarios específicos

La biblioteca admite la administración de versiones, lo que le permite comparar versiones diferentes, restaurar versiones anteriores si es necesario y colaborar con otros en evaluadores personalizados.

Iteración basada en la evaluación

Los resultados de la evaluación informan los pasos a seguir.

Cuando las puntuaciones sean inferiores a las necesarias, tenga en cuenta lo siguiente:

- Ingeniería de mensajes: Refinación de instrucciones y mensajes del sistema

- Diferentes modelos: Probar modelos optimizados para su caso de uso

- Integración de RAG: adición de funcionalidades de recuperación a respuestas básicas en los datos

- Ajuste preciso: Entrenamiento del modelo en su dominio específico (si se admite)

Cada uno de estos pasos aumenta en complejidad (y a veces cuesta), por lo que debe tener en cuenta al planear mejoras.

Cuando las métricas de seguridad muestran preocupaciones:

- Filtros de contenido Content: Implementación de los servicios Azure AI Content Safety

- Endurecimiento de solicitud: añadir instrucciones de seguridad a los mensajes del sistema

- Validación de salida: comprobación de las respuestas antes de mostrar a los usuarios

La evaluación regular a medida que realiza cambios realiza un seguimiento de las mejoras y garantiza que la calidad no retroceda. Establezca pruebas comparativas de evaluación al principio del desarrollo y vuelva a ejecutar evaluaciones después de modificaciones para medir el impacto objetivamente.

Al combinar pruebas manuales, métricas automatizadas y flujos de evaluación completos, se crea confianza en que el modelo funciona bien, atiende a los usuarios de forma segura y cumple los requisitos de calidad de la aplicación.