Déploiement de requêtes pour les prédictions d’intention

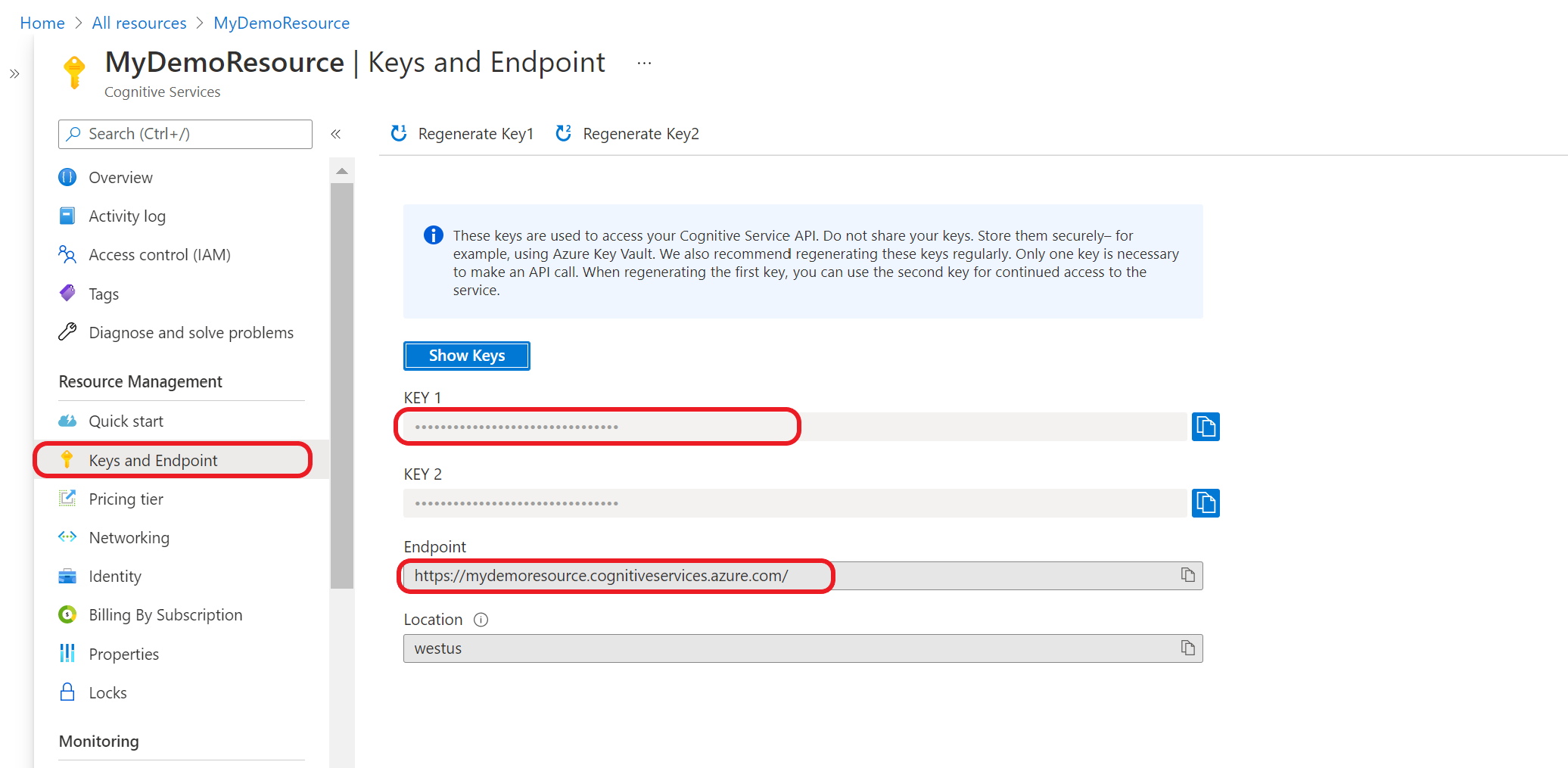

Une fois le déploiement ajouté, vous pouvez l’interroger afin de déterminer les prédictions de l’intention et des entités à partir de votre énoncé en fonction du modèle que vous avez affecté au déploiement. Vous pouvez interroger le déploiement par programmation à l’aide de l’API de prédiction ou via les bibliothèques clientes (SDK Azure).

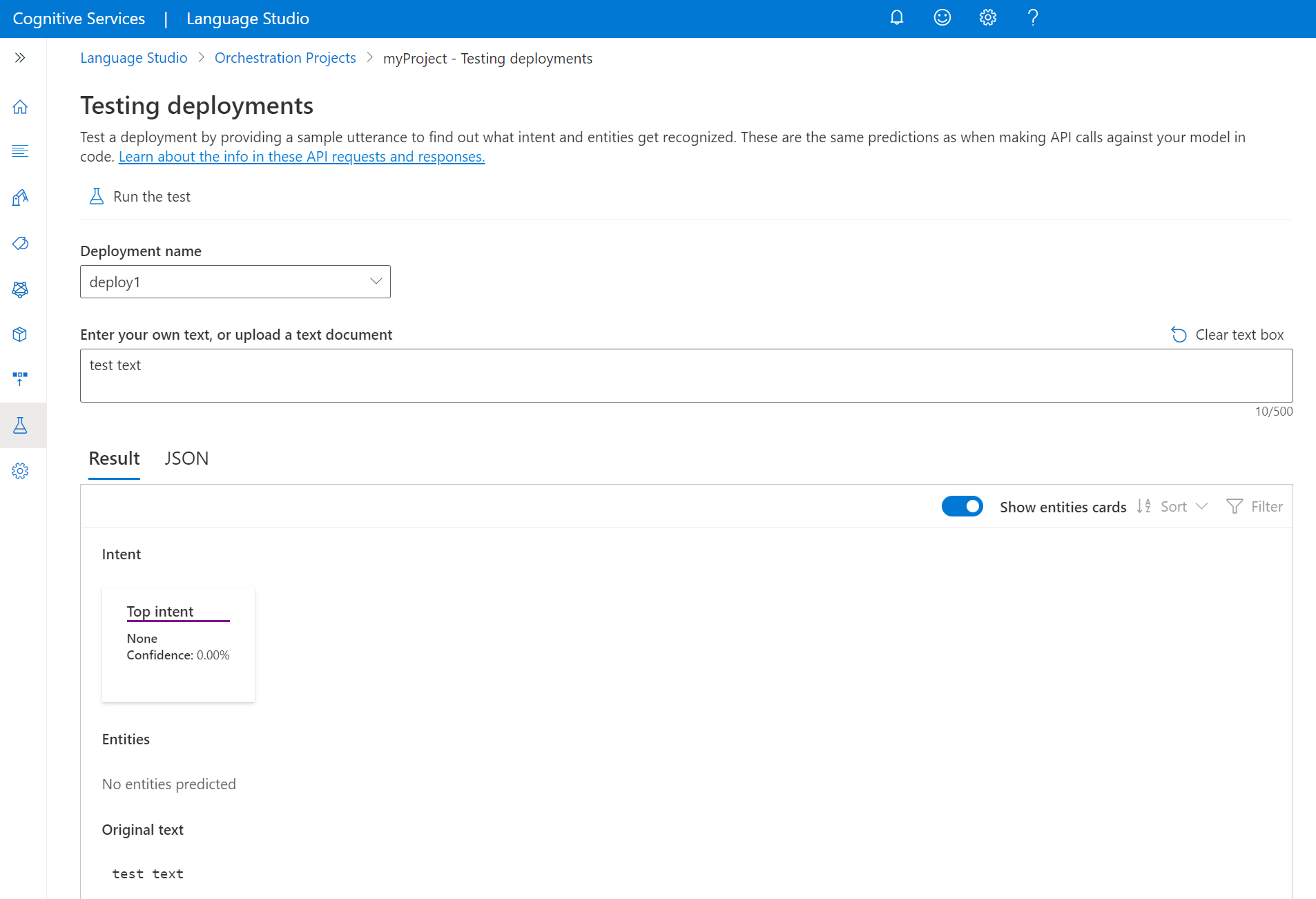

Tester un modèle déployé

Vous pouvez utiliser Language Studio pour envoyer un énoncé, obtenir des prédictions et visualiser les résultats.

Pour tester votre modèle à partir de Language Studio

Sélectionnez Test des déploiements dans le menu de gauche.

Sélectionnez le modèle à tester. Vous pouvez uniquement tester les modèles qui sont attribués aux déploiements.

Dans la liste déroulante nom du déploiement, sélectionnez le nom de votre déploiement.

Dans la zone de texte, entrez un énoncé à tester.

Dans le menu supérieur, sélectionnez Exécuter le test.

Après avoir exécuté le test, vous devriez voir la réponse du modèle dans le résultat. Vous pouvez afficher les résultats en mode cartes d’entités ou au format JSON.

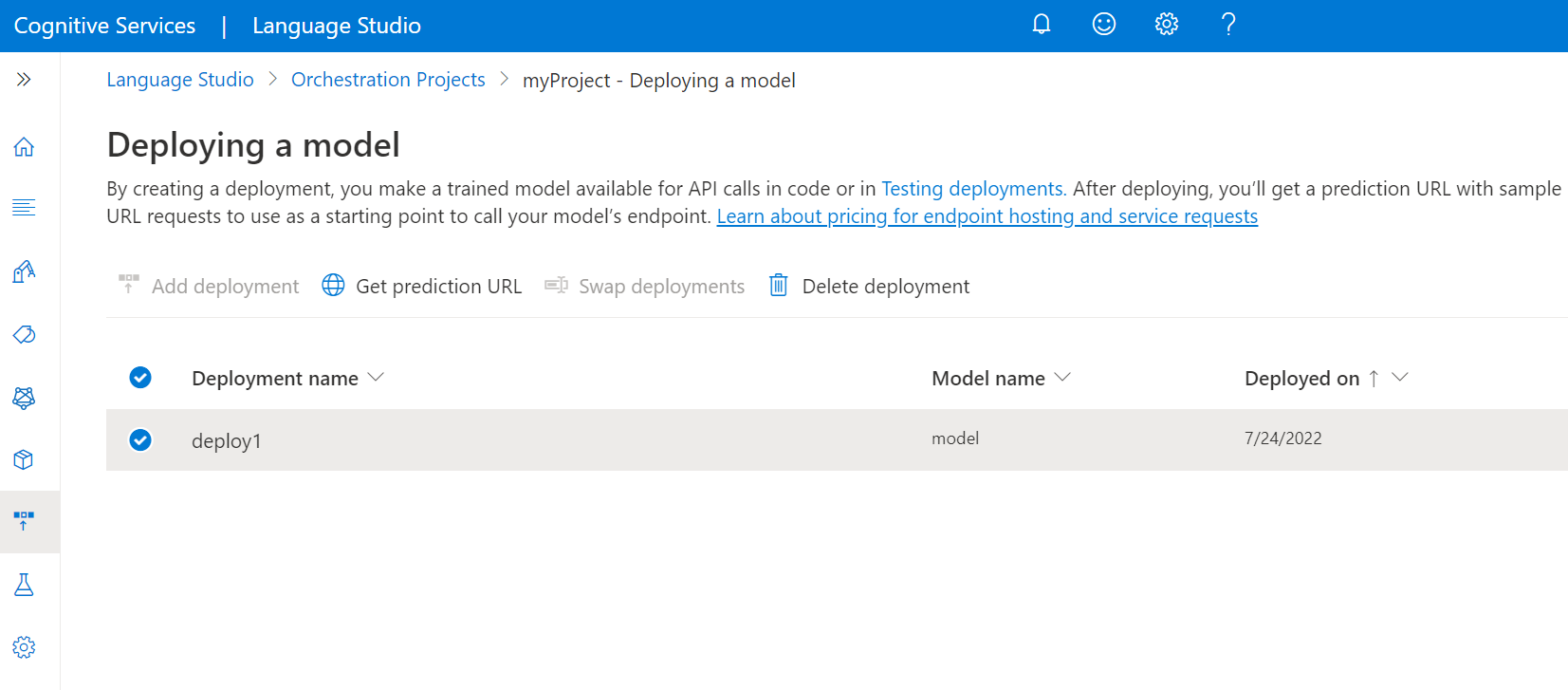

Envoyer une demande de flux de travail d’orchestration

Une fois la tâche de déploiement correctement effectuée, sélectionnez le déploiement à utiliser et, dans le menu supérieur, sélectionnez l’URL de prédiction Get.

Dans la fenêtre qui s’affiche, collez l’exemple d’URL de requête et de corps sur votre ligne de commande. Remplacez

<YOUR_QUERY_HERE>par le texte duquel vous souhaitez envoyer et extraire des intentions et des entités.Envoyez la demande

POSTcURL dans votre terminal ou invite de commandes. Si la demande a réussi, vous recevez une réponse 202 avec les résultats de l’API.

Étapes suivantes

Commentaires

Bientôt disponible : Tout au long de l’année 2024, nous abandonnerons progressivement le mécanisme de retour d’information GitHub Issues pour le remplacer par un nouveau système de commentaires. Pour plus d’informations, consultez : https://aka.ms/ContentUserFeedback.

Soumettre et afficher des commentaires pour