Notes

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de vous connecter ou de modifier des répertoires.

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de modifier des répertoires.

La voix personnalisée est une fonctionnalité de synthèse vocale qui vous permet de créer une voix de type unique, personnalisée et synthétique pour vos applications. Avec la voix personnalisée, vous pouvez créer une voix très naturelle pour votre marque ou vos personnages en fournissant des exemples vocaux humains comme données de réglage précis.

Important

L’accès vocal personnalisé est limité en fonction des critères d’éligibilité et d’utilisation. Demandez un accès à l’aide du formulaire d’admission.

Par défaut, la synthèse vocale peut être utilisée avec des voix standard pour chaque langue prise en charge. Les voix standard fonctionnent bien dans la plupart des scénarios de synthèse vocale si une voix unique n’est pas nécessaire.

La voix personnalisée est basée sur la technologie de synthèse vocale neuronale et le modèle multilingue, multi-parleur et universel. Vous pouvez créer des voix de synthèse riches en styles d’élocution, ou des voix adaptables multilingues. La voix réaliste et naturelle de la voix personnalisée peut représenter des marques, personnifier des machines et permettre aux utilisateurs d’interagir avec les applications de manière conversationnelle. Consultez les langues prises en charge pour la voix personnalisée.

Comment cela fonctionne-t-il ?

Pour créer une voix personnalisée, utilisez Speech Studio pour charger l’audio enregistré et les scripts correspondants, entraîner le modèle et déployer la voix sur un point de terminaison personnalisé.

La création d’une voix personnalisée idéale nécessite un contrôle de qualité minutieux à chaque étape, de la conception vocale et de la préparation des données, au déploiement du modèle vocal sur votre système.

Avant de commencer à utiliser Speech Studio, voici quelques points à prendre en compte :

- Concevez un personnage de la voix qui incarne l’identité de votre marque à l’aide d’un bref document définissant ce personnage. Ce document définit des éléments tels que les caractéristiques de la voix et son caractère inhérent. Cela permet de guider le processus de création d’un modèle vocal personnalisé, notamment la définition des scripts, la sélection de vos talents vocaux, la formation et le réglage de la voix.

- Sélectionnez le script d’enregistrement pour représenter les scénarios utilisateur de votre voix. Par exemple, vous pouvez utiliser les expressions issues des conversations de bot comme script d’enregistrement si vous créez un bot de service client. Incluez différents types de phrases dans vos scripts, notamment des affirmations, des questions et des exclamations.

Voici une vue d’ensemble des étapes permettant de créer une voix personnalisée dans Speech Studio :

- Créez un projet qui contiendra vos données, vos modèles vocaux, vos tests et vos points de terminaison. Chaque projet est spécifique à un pays/une région et une langue. Si vous voulez créer plusieurs voix, nous vous recommandons de créer un projet pour chaque voix.

- Configurer un artiste vocal. Avant de pouvoir affiner une voix professionnelle, vous devez soumettre un enregistrement de la déclaration de consentement du talent vocal. L'énoncé du comédien vocal est un enregistrement dans lequel le comédien vocal lit une déclaration par laquelle il consent à l'utilisation de ses données vocales pour l'amélioration fine de la voix professionnelle.

- Préparez les données de réglage précis au format approprié. Il est judicieux de capturer les enregistrements audio dans un studio d’enregistrement de qualité professionnelle pour obtenir un rapport signal/bruit élevé. La qualité du modèle vocal dépend fortement de vos données de réglage précis. Il est nécessaire de faire attention à l’homogénéité du volume, au débit de parole, à la tonalité et à la cohérence dans la manière de s’exprimer.

- Entraînez votre modèle vocal. Sélectionnez au moins 300 énoncés pour créer une voix personnalisée. Une série de vérifications de la qualité des données s’effectue automatiquement quand vous les chargez. Pour générer des modèles vocaux de haute qualité, vous devez corriger toutes les erreurs et soumettre à nouveau les données.

- Testez votre voix. Préparez des scripts de test pour votre modèle vocal qui couvrent les différents cas d’usage de vos applications. Il est judicieux d’utiliser des scripts au sein et en dehors du jeu de données d’apprentissage afin de tester la qualité plus largement pour différents contenus.

- Déployez et utilisez votre modèle vocal dans vos applications.

Vous pouvez régler, ajuster et utiliser votre voix personnalisée de la même façon que vous utiliseriez une voix standard. Convertissez un texte en message en temps réel, ou générez du contenu audio hors connexion avec une entrée de texte. Vous utilisez l’API REST, le kit de développement logiciel (SDK) Speech ou Speech Studio.

Conseil

Consultez les exemples de code dans le référentiel du Kit de développement logiciel (SDK) Speech sur GitHub pour voir comment utiliser la voix personnalisée dans votre application.

Le style et les caractéristiques du modèle vocal entraîné dépendent du style et de la qualité des enregistrements de l’artiste vocal utilisé pour l’apprentissage. Néanmoins, vous pouvez effectuer plusieurs ajustements à l’aide de SSML (Speech Synthesis Markup Language) quand vous effectuez les appels d’API à votre modèle vocal pour générer une voix de synthèse. SSML correspond au langage de balisage utilisé pour communiquer avec le service de synthèse vocale pour convertir du texte en audio. Les ajustements que vous pouvez effectuer incluent la modification de la tonalité, le débit, l’intonation et la correction de la prononciation. Si le modèle vocal est généré avec plusieurs styles, vous pouvez également utiliser SSML pour passer de l’un à l’autre.

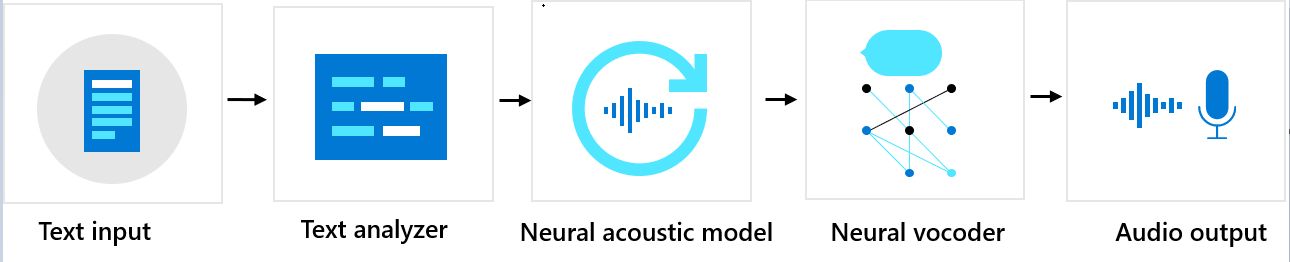

Séquence de composants

La voix personnalisée se compose de trois composants principaux : l’analyseur de texte, le modèle acoustique neuronal et le vocodeur neuronal. Pour générer une voix de synthèse naturelle à partir d’un texte, ce dernier est d’abord entré dans l’analyseur de texte, qui fournit une sortie sous la forme d’une séquence de phonèmes. Un phonème est une unité sonore de base qui distingue un mot d’un autre dans une langue particulière. Une séquence de phonèmes définit les prononciations des mots fournis dans le texte.

Ensuite, la séquence de phonèmes entre dans le modèle acoustique neuronal pour prédire les caractéristiques acoustiques qui définissent les signaux de parole. Les fonctionnalités acoustiques incluent le timbre, le type de diction, la vitesse d’élocution, les intonations et les modèles d’accent tonique. Enfin, le vocodeur neural convertit les caractéristiques acoustiques en ondes audibles pour générer une voix de synthèse.

Les modèles neuraux de synthèse vocale sont entraînés à l’aide de réseaux neuraux profonds basés sur des échantillons d’enregistrement de voix humaines. Pour plus d’informations, consultez ce billet de blog Microsoft. Pour en savoir plus sur la façon dont un vocodeur neural est entraîné, consultez ce billet de blog Microsoft.

Intelligence artificielle responsable

Un système d’IA englobe non seulement la technologie, mais aussi ses utilisateurs, les personnes concernées et l’environnement dans lequel il est déployé. Lisez les notes de transparence pour en savoir plus sur l’utilisation et le déploiement d’une IA responsable dans vos systèmes.

- Note de transparence et cas d’usage pour la voix personnalisée

- Caractéristiques et limitations pour l’utilisation de la voix personnalisée

- Accès limité à la voix personnalisée

- Instructions pour un déploiement responsable de la technologie des voix de synthèse

- Divulgation d’un artiste vocal

- Instructions de conception de divulgation

- Modèles de conception de divulgation

- Code de conduite des intégrations de synthèse vocale

- Données, confidentialité et sécurité pour la voix personnalisée