Remarque

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de vous connecter ou de modifier des répertoires.

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de modifier des répertoires.

S'APPLIQUE À : Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Conseil

Data Factory dans Microsoft Fabric est la prochaine génération de Azure Data Factory, avec une architecture plus simple, une IA intégrée et de nouvelles fonctionnalités. Si vous débutez avec l'intégration des données, commencez par Fabric Data Factory. Les charges de travail ADF existantes peuvent être mises à niveau vers Fabric pour accéder à de nouvelles fonctionnalités dans la science des données, l’analytique en temps réel et la création de rapports.

Azure Data Factory est aimée et approuvée par les entreprises du monde entier. En tant que service ETL natif du cloud Azure pour l'intégration et la transformation des données en mode sans serveur et évolutif, il est largement utilisé pour implémenter des chaînes de traitement de données visant à préparer, traiter et charger les données dans un entrepôt de données d'entreprise ou un lac de données.

Une fois les pipelines de données publiés, via l’intégration et la livraison continues (CI/CD) en mode Git ou directement en mode réel, ils s’exécutent généralement sur Autopilot. Ils peuvent s’exécuter selon un calendrier prédéfini, avec un déclencheur de planification ou un déclencheur de fenêtre bascule, ou ils peuvent s’exécuter dans une architecture pilotée par les événements, avec un déclencheur d’événements de stockage ou un déclencheur d’événements personnalisé. Ils se voient confier des charges de travail stratégiques, afin de préparer les données pour des rapports métier, l’analytique données et les projets de Machine Learning.

Avertissements préemptifs pour les travaux de longue durée

La livraison de contrats de niveau de service (SLA) pour ces pipelines de données doit relever deux défis majeurs :

- L’environnement de calcul pour les activités, par exemple SQL pour une activité de procédure stockée, peut présenter une limitation, ralentissant l’ensemble du pipeline de données et compromettant le contrat SLA du pipeline.

- Les développeurs de pipeline ne supervisent pas toujours activement la fabrique, ni ne recherchent de manière proactive les pipelines de longue durée pour lesquels des contrats SLA font défaut.

Pour résoudre ces problèmes, quand elles sont configurées correctement, les exécutions de pipeline émettent des métriques Exécution de pipeline - Temps écoulé dans le cas d’un contrat SLA manquant. En association avec les alertes Data Factory, nous permettons aux développeurs de pipelines de données de mieux respecter les accords de niveaux de service (SLA) envers leurs clients : vous nous indiquez la durée d’exécution d’un pipeline et nous vous informons, de manière proactive, lorsque le pipeline s’exécute plus longtemps que prévu.

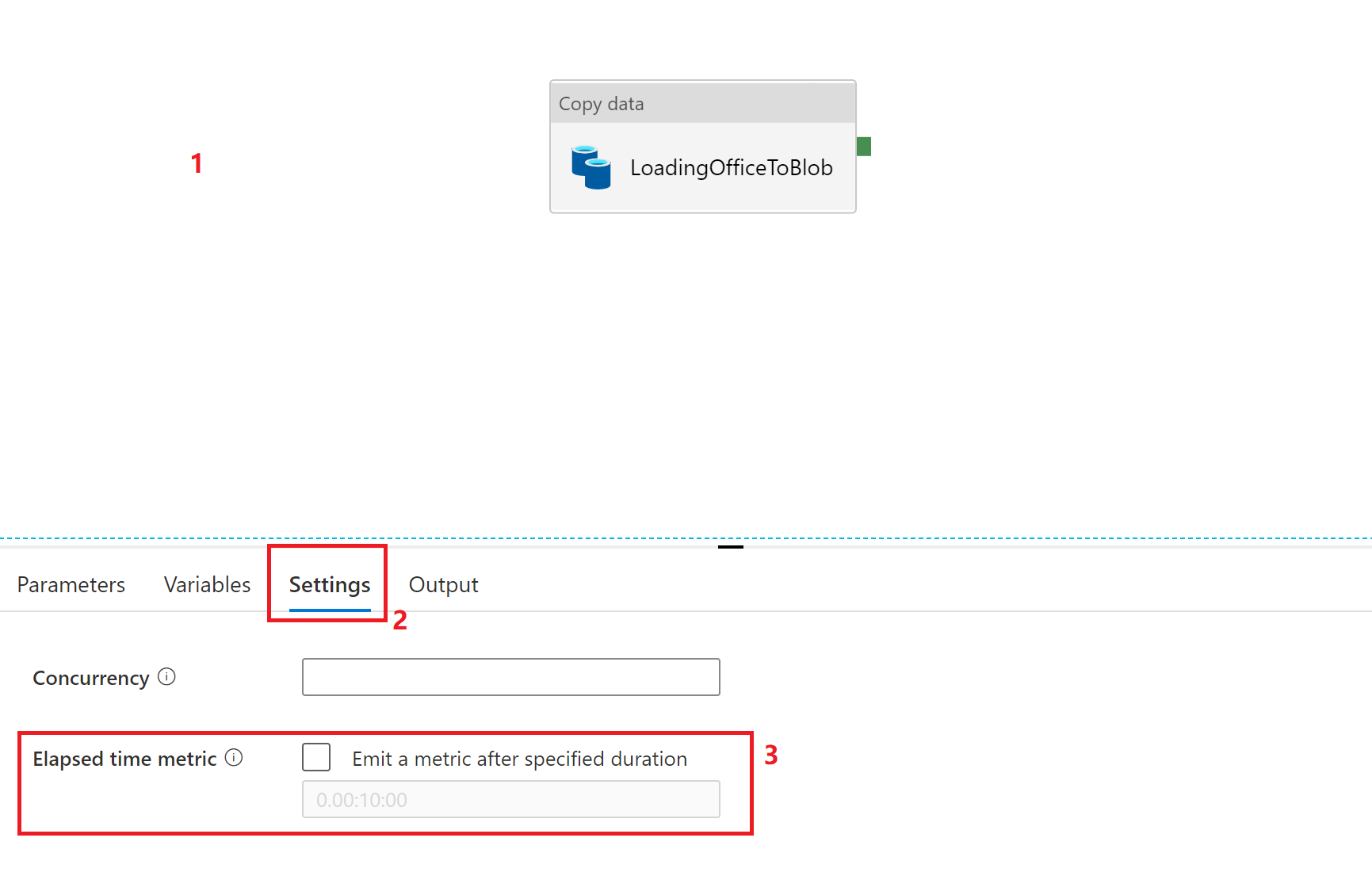

Pour chaque pipeline sur lequel vous souhaitez créer des alertes, au cours de la phase de création, accédez aux paramètres du pipeline en cliquant sur l’espace vide dans son canevas.

Sous l’onglet Paramètres, cochez la case Métrique de temps écoulé et spécifiez la durée d’exécution du pipeline attendue, au format D.HH:MM:SS. Nous vous recommandons vivement de définir dans votre contrat SLA métier le temps que le pipeline peut prendre pour répondre à vos besoins métier. Dès qu’une durée de pipeline dépasse ce paramètre, Data Factory enregistre une métrique Exécution de pipeline - Temps écoulé (ID de métrique : PipelineElapsedTimeRuns) dans Azure Monitor. En d’autres termes, vous êtes informé des pipelines de longue durée de manière préventive, avant la fin de l’exécution des pipelines.

Nous comprenons que certains pipelines prennent naturellement plus de temps que d’autres, car ils ont plus d’étapes ou déplacent plus de données. Il n’existe aucune définition unique pour les pipelines de longue durée. Nous vous demandons de bien vouloir définir le seuil pour chaque pipeline pour lequel vous avez besoin d’un contrat SLA. Quand la métrique est journalisée pour un pipeline particulier, nous la comparons à son paramètre défini par l’utilisateur pour la durée d’exécution attendue.

Note

Il s’agit d’une fonctionnalité qu’il faut activer pour chaque pipeline. Aucune métrique n’est jamais journalisée pour un pipeline si aucune durée d’exécution attendue n’est spécifiée pour ce pipeline.

Suivez les étapes permettant de configurer des alertes Data Factory sur la métrique. Vos ingénieurs recevront une notification pour intervenir et prendre des mesures afin de respecter les accords de niveau de service (SLA) via e-mail ou SMS.