Remarque

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de vous connecter ou de modifier des répertoires.

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de modifier des répertoires.

Important

Le traitement de priorité est disponible en préversion et disponible uniquement par invitation. Inscrivez-vous ici pour être averti lorsqu’il devient plus largement disponible.

Cette préversion est fournie sans contrat de niveau de service et n’est pas recommandée pour les charges de travail de production. Certaines fonctionnalités peuvent être limitées ou non prises en charge. Pour plus d’informations, consultez Conditions d’utilisation supplémentaires pour les préversions de Microsoft Azure.

Le traitement prioritaire offre des performances à faible latence avec la flexibilité du paiement à l’utilisation. Il fonctionne sur un modèle de jeton de paiement à l’utilisation, offrant des temps de réponse rapides sans engagements de contrat à long terme. Dans cet article, vous activez le traitement prioritaire sur un déploiement de modèle, vérifiez le niveau de service qui a traité vos demandes et surveillez les coûts associés.

Prerequisites

- Un abonnement Azure : créez-en un gratuitement.

- Projet Microsoft Foundry avec un modèle du type de déploiement

GlobalStandardouDataZoneStandarddéployé. - Acceptation dans l’aperçu du traitement prioritaire. Inscrivez-vous ici pour être averti lorsque le traitement de priorité devient plus largement disponible.

- Version

2025-10-01-previewde l’API ou ultérieure.

Vue d’ensemble

Avantages

- Latence faible prévisible : génération de jeton plus rapide et plus cohérente.

- Flexibilité facile à utiliser : comme pour le traitement standard à la demande, accédez à un traitement prioritaire sur une base flexible et à la demande, sans nécessiter de provisionnement ni de réservations à l’avance.

Cas d’usage clés

- Latence cohérente et faible pour les expériences utilisateur réactives.

- Simplicité de paiement à l’utilisation sans engagement à long terme.

- Trafic aux heures de bureau ou de pointe qui tire parti des performances évolutives et rentables. Si vous le souhaitez, vous pouvez combiner le traitement prioritaire avec des unités de débit approvisionnées (PTU) pour une capacité à état stable et une optimisation des coûts.

Limites

Limite de rampe : Les augmentations rapides de vos jetons de traitement prioritaires par minute peuvent entraîner des limites de débit de rampe. Si vous dépassez la limite de taux de rampe, le service peut au lieu de cela envoyer un trafic supplémentaire vers le traitement standard.

Quota: Le traitement de priorité utilise le même quota que le traitement standard. Cela signifie que votre déploiement avec traitement prioritaire activé consomme le quota de votre allocation standard existante.

Prise en charge du traitement prioritaire

Disponibilité globale du modèle standard

| Région | gpt-4.1, 2025-04-14 |

|---|---|

| eastus 2 | ✅ |

| swedencentral | ✅ |

| westus3 | ✅ |

Note

La disponibilité du modèle et de la région peut se développer pendant la période d’évaluation. Consultez cette page pour connaître les mises à jour.

Problèmes connus

Le traitement de priorité présente actuellement ces limitations et les correctifs sont en cours :

Limite de contexte longue pour gpt-4.1 : Le service ne prend pas en charge les demandes qui dépassent 128 000 jetons et retourne une erreur HTTP 400.

Pas de prise en charge du débordement PTU : le service ne prend pas encore en charge le débordement PTU vers un déploiement avec traitement prioritaire activé. Si vous avez besoin d’un comportement de basculement, implémentez votre propre logique, par exemple à l’aide de Gestion des API Azure.

Valeur service_tier incorrecte lors de l’utilisation de la diffusion en continu dans l’API Réponses : Lorsque vous diffusez des réponses via l’API Réponses, le

service_tierchamp peut retourner incorrectement « priorité », même si les contraintes de capacité ou les limites de rampe ont provoqué le service de la demande par le niveau standard. Dans ce cas, la valeur attendue estservice_tier« default ».

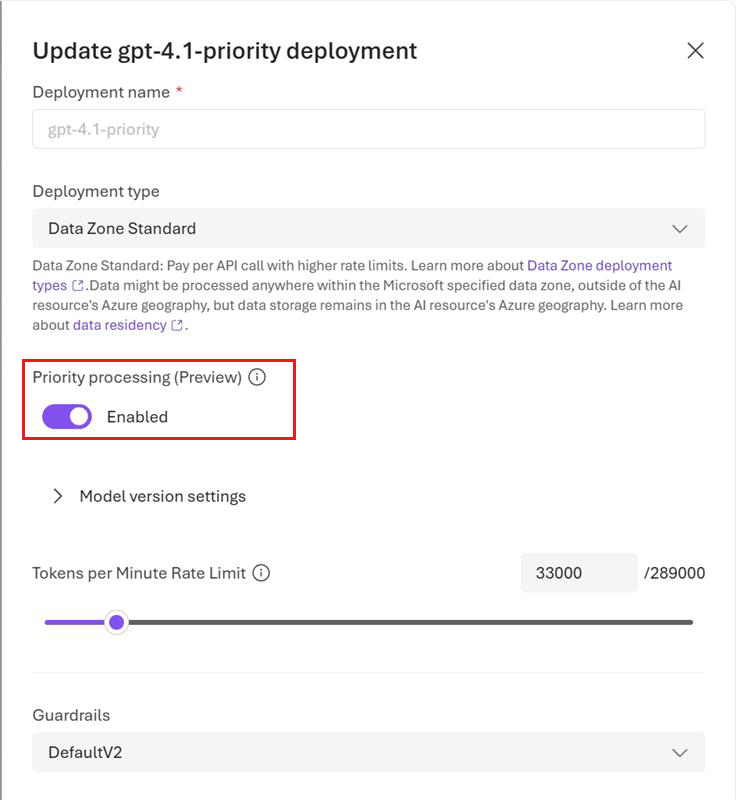

Activer le traitement de priorité au niveau du déploiement

Vous pouvez activer le traitement de priorité au niveau du déploiement et (éventuellement) au niveau de la requête.

Dans le portail Microsoft Foundry , vous pouvez activer le traitement prioritaire pendant la configuration du déploiement. ** Activez le bouton bascule du traitement prioritaire (préversion) sur la page des détails du déploiement lors de la création du déploiement, ou mettez à jour le paramètre d’un modèle déployé en éditant les détails du déploiement.

Note

Si vous préférez utiliser du code pour activer le traitement de priorité au niveau du déploiement, vous pouvez le faire via l’API REST pour le déploiement en définissant l’attribut service_tier comme suit : "properties" : {"service_tier" : "priority"} Les valeurs autorisées pour l’attribut service_tier sont default et priority.

default implique un traitement standard, tandis qu’il priority active le traitement prioritaire.

Une fois qu’un déploiement de modèle est configuré pour utiliser le traitement de priorité, vous pouvez commencer à envoyer des demandes au modèle.

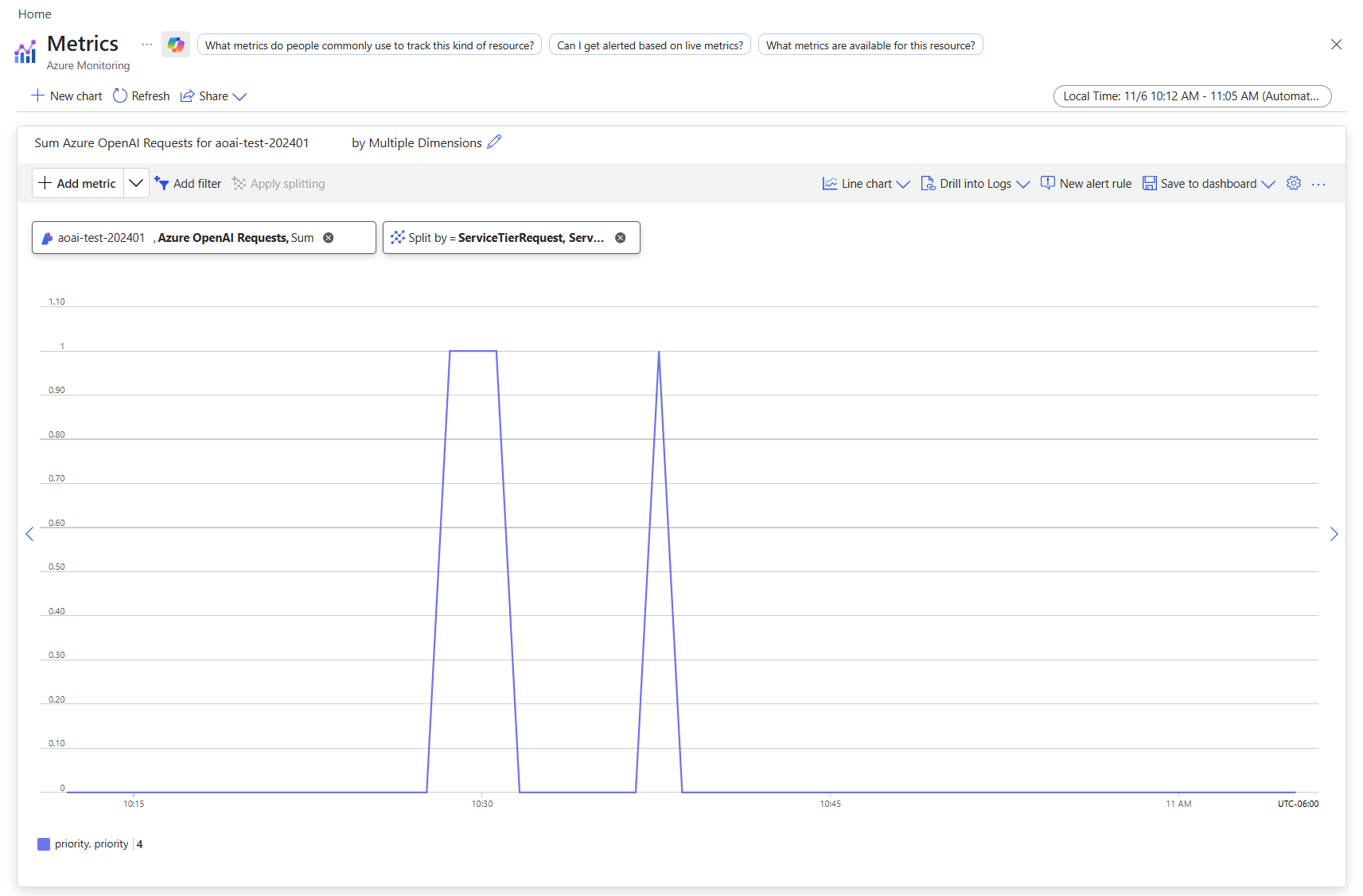

Afficher les métriques d’utilisation

Vous pouvez afficher la mesure d’utilisation de votre ressource dans la section Azure Monitor du portail Azure.

Pour afficher le volume de demandes traitées par le traitement standard contre par le traitement prioritaire, réparti par le niveau de service (standard ou priorité) présent dans la requête d’origine :

- Connectez-vous à https://portal.azure.com.

- Accédez à votre ressource Azure OpenAI et sélectionnez l’option Métriques dans le volet de navigation gauche.

- Dans la page des métriques, ajoutez la métrique requêtes Azure OpenAI. Vous pouvez également sélectionner d’autres métriques telles que la latence Azure OpenAI, l’utilisation d’Azure OpenAI et d’autres.

- Sélectionnez Ajouter un filtre pour sélectionner le déploiement standard pour lequel les demandes de traitement prioritaire ont été traitées.

- Sélectionnez Appliquer le fractionnement pour fractionner les valeurs par ServiceTierRequest et ServiceTierResponse.

Pour plus d’informations sur la surveillance de vos déploiements, consultez Surveiller Azure OpenAI.

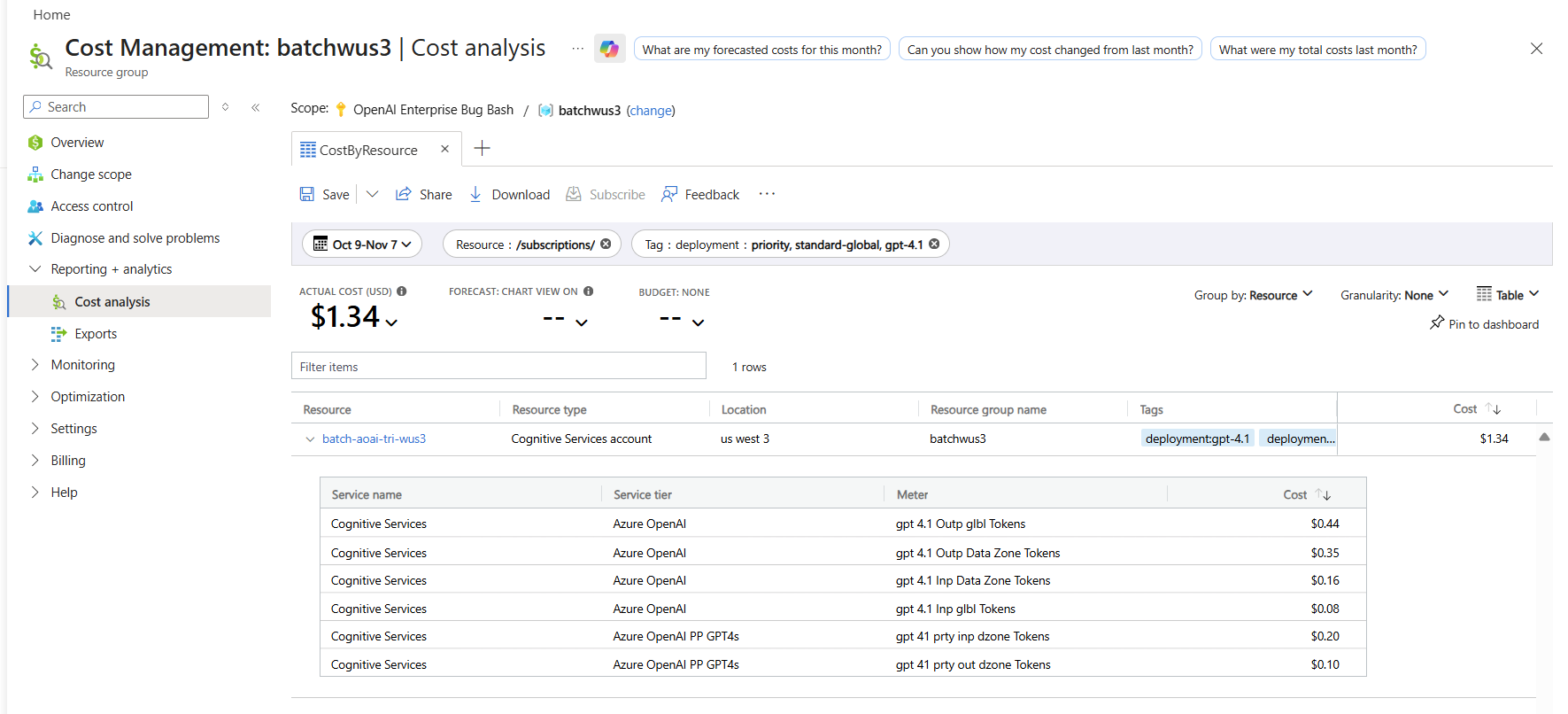

Superviser les coûts

Vous pouvez voir une répartition des coûts pour les demandes prioritaires et standard dans la page d’analyse des coûts du portail Azure en filtrant les balises de nom de déploiement et de facturation comme suit :

- Accédez à la page Analyse des coûts dans le portail Azure.

- (Facultatif) Filtrez par ressource.

- Pour filtrer par nom de déploiement : ajoutez un filtre pour la balise> de facturation, sélectionnez "déploiement" comme valeur, puis choisissez le nom de votre déploiement.

Pour plus d’informations sur la tarification du traitement prioritaire, consultez la vue d’ensemble des tarifs d’Azure OpenAI Service.

Activer le traitement de priorité au niveau de la demande

L’activation du traitement de priorité au niveau de la requête est facultative. L’API de saisie semi-automatique de conversation et l’API réponses ont un attribut service_tier facultatif qui spécifie le type de traitement à utiliser lors du traitement d’une demande. L’exemple suivant montre comment paramétrer service_tier sur priority dans une requête de réponses.

curl -X POST https://YOUR-RESOURCE-NAME.openai.azure.com/openai/v1/responses \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $AZURE_OPENAI_AUTH_TOKEN" \

-d '{

"model": "gpt-4.1",

"input": "This is a test",

"service_tier": "priority"

}'

Utilisez l’attribut service_tier pour remplacer le paramètre au niveau du déploiement.

service_tier peut prendre les valeurs auto, defaultet priority.

Si vous ne définissez pas l’attribut, il est défini par défaut sur

auto.service_tier = autosignifie que la requête utilise le niveau de service configuré dans le déploiement.service_tier = defaultsignifie que la requête utilise la tarification et les performances standard pour le modèle sélectionné.service_tier = prioritysignifie que la requête utilise le niveau de service de traitement prioritaire.

Le tableau suivant récapitule le niveau de service qui traite vos demandes en fonction des paramètres au niveau du déploiement et des requêtes pour service_tier.

| Paramètre au niveau du déploiement | Paramètre au niveau de la demande | Demande traitée par le niveau de service |

|---|---|---|

| par défaut | auto, par défaut | Norme |

| par défaut | priority | Traitement prioritaire |

| priority | auto, priorité | Traitement prioritaire |

| priority | par défaut | Norme |

Cible de latence

| Sujet | gpt-4.1, 2025-04-14 |

|---|---|

| Valeur cible de latence | 99% > 80 jetons par seconde* |

* Calculé en tant que latence de requête p50 sur une base de 5 minutes.

Limites de débit de rampe

Pour garantir des performances élevées de façon cohérente pour tous les clients, tout en fournissant des tarifs flexibles et à la demande, le traitement prioritaire applique des limites de débit. Actuellement, la limite de taux de montée est définie comme augmentant le trafic de plus de 50% de jetons par minute dans un délai inférieur à 15 minutes.

Conditions de rétrogradation

Si les performances de traitement prioritaires se dégradent et que le trafic d’un client s’accélère trop rapidement, le service peut rétrograder certaines demandes prioritaires au traitement standard. Le service facture les demandes traitées par le niveau de service standard aux tarifs standard. Ces demandes ne sont pas éligibles pour la cible de latence de traitement prioritaire. Les demandes traitées par le niveau de service standard incluent service_tier = default dans la réponse.

Conseil / Astuce

Si vous rencontrez régulièrement des limites de débit, envisagez d’acheter des PTU au lieu ou en plus du traitement prioritaire.

Résolution des problèmes

| Problème | La cause | Résolution |

|---|---|---|

| Erreur HTTP 400 sur les invites longues | gpt-4.1 ne prend pas en charge les demandes dépassant 128 000 jetons en traitement prioritaire. | Conservez le nombre total de jetons de requête inférieurs à 128 000. Fractionner les invites longues en demandes plus petites. |

| Demandes rétrogradées au niveau standard | Le trafic a augmenté de plus de 50 jetons par minute en moins de 15 minutes, atteignant la limite du débit d'augmentation. | Augmentez progressivement le trafic. Envisagez d’acheter des PTU pour une capacité à état stable. |

| Débordement du PTU qui ne fonctionne pas | Le traitement de priorité ne prend pas encore en charge le débordement PTU vers un déploiement doté de la capacité de traitement de priorité. | Implémentez une logique de basculement personnalisée, par exemple à l’aide de Gestion des API Azure. |

service_tier retourne une valeur incorrecte pendant la diffusion en continu |

Lors de la diffusion en continu via l’API Réponses, service_tier peut signaler "priority" même lorsque la demande a été traitée par le niveau standard. |

Vérifiez les enregistrements de facturation pour confirmer le niveau qui a réellement traité la demande. |

Prise en charge des API

| Version de l’API | |

|---|---|

| Dernière version de l’API en préversion prise en charge : | 2025-10-01-preview |