Remarque

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de vous connecter ou de modifier des répertoires.

L’accès à cette page nécessite une autorisation. Vous pouvez essayer de modifier des répertoires.

Data Wrangler, un outil basé sur un notebook pour l’analyse exploratoire de données, prend désormais en charge les DataFrames Spark et les DataFrames Pandas. Il génère du code PySpark, en plus du code Python. Pour obtenir une vue d’ensemble générale de Data Wrangler, qui explique comment explorer et transformer des DataFrames pandas, consultez le didacticiel principal. Ce tutoriel suivant montre comment utiliser Data Wrangler pour explorer et transformer des DataFrames Spark.

Prérequis

Obtenir un abonnement Microsoft Fabric. Ou, inscrivez-vous pour un essai gratuit de Microsoft Fabric.

Connectez-vous à Microsoft Fabric.

Basculez vers Fabric à l’aide du sélecteur d’expérience situé en bas à gauche de votre page d’accueil.

Limites

- Les opérations de code personnalisées sont actuellement prises en charge uniquement pour les DataFrames Pandas.

- L’affichage Data Wrangler fonctionne le mieux sur les grands moniteurs, bien que vous puissiez réduire ou masquer différentes parties de l’interface pour prendre en charge des écrans plus petits.

Lancement de Data Wrangler avec un DataFrame Spark

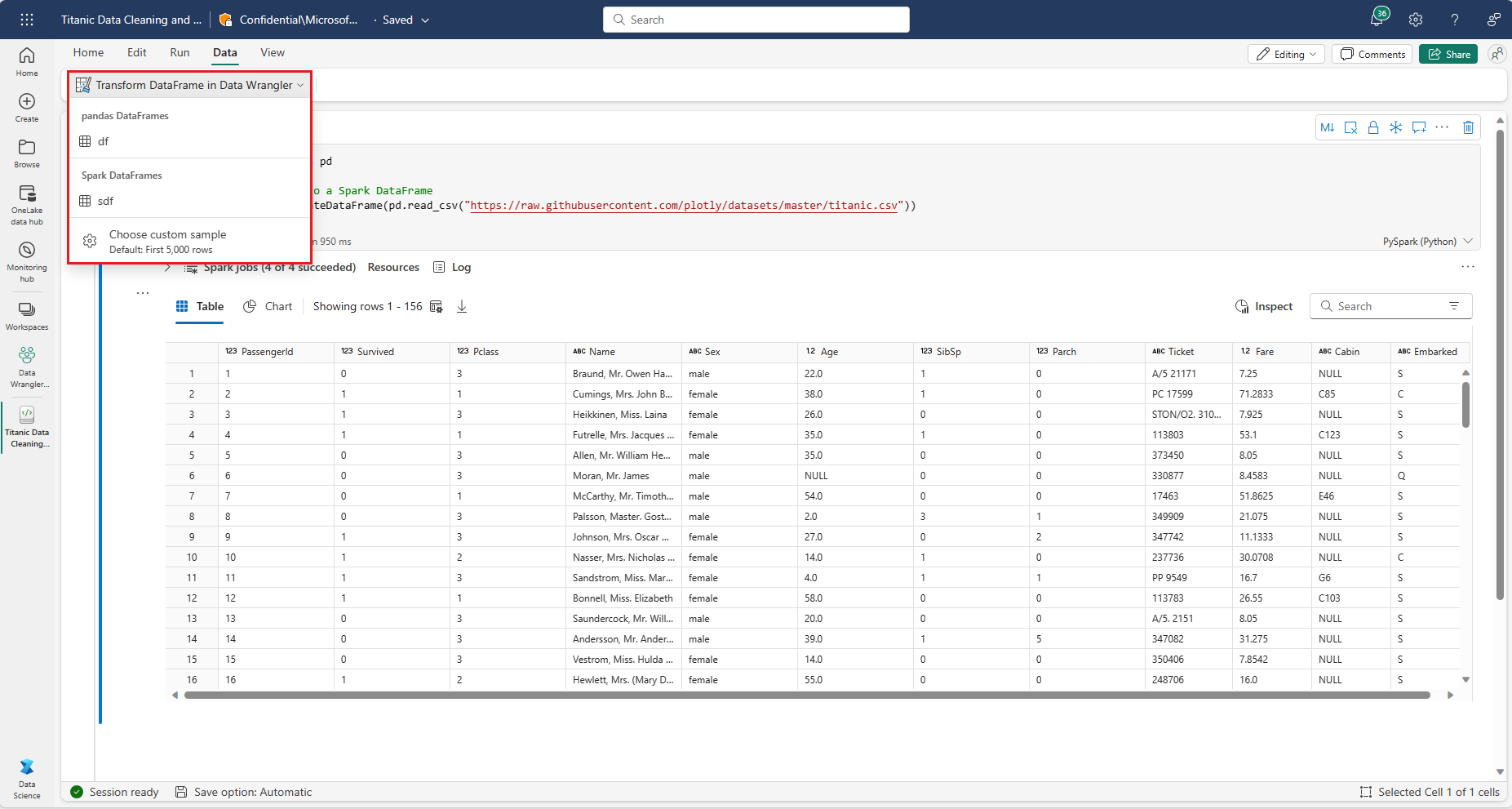

Vous pouvez ouvrir des DataFrames Spark dans Data Wrangler directement depuis un bloc-notes Microsoft Fabric en accédant à la même liste déroulante où les DataFrames pandas sont affichés. Une liste des DataFrames Spark actifs apparaît dans la liste déroulante sous la liste des variables Pandas actives.

Cet extrait de code crée un DataFrame Spark avec les mêmes échantillons de données utilisés dans le tutorial Data Wrangler Pandas :

import pandas as pd

# Read a CSV into a Spark DataFrame

sdf = spark.createDataFrame(pd.read_csv("https://raw.githubusercontent.com/plotly/datasets/master/titanic.csv"))

display(sdf)

Dans l’onglet « Accueil » du ruban de notebook, utilisez l’invite déroulante Data Wrangler pour parcourir les DataFrames actifs disponibles pour modification. Sélectionnez celui que vous souhaitez ouvrir dans Data Wrangler.

Conseil

Data Wrangler ne peut pas être ouvert si le noyau du notebook est occupé. Une cellule en cours d’exécution doit terminer son exécution avant que Data Wrangler puisse se lancer, comme indiqué dans cette capture d’écran :

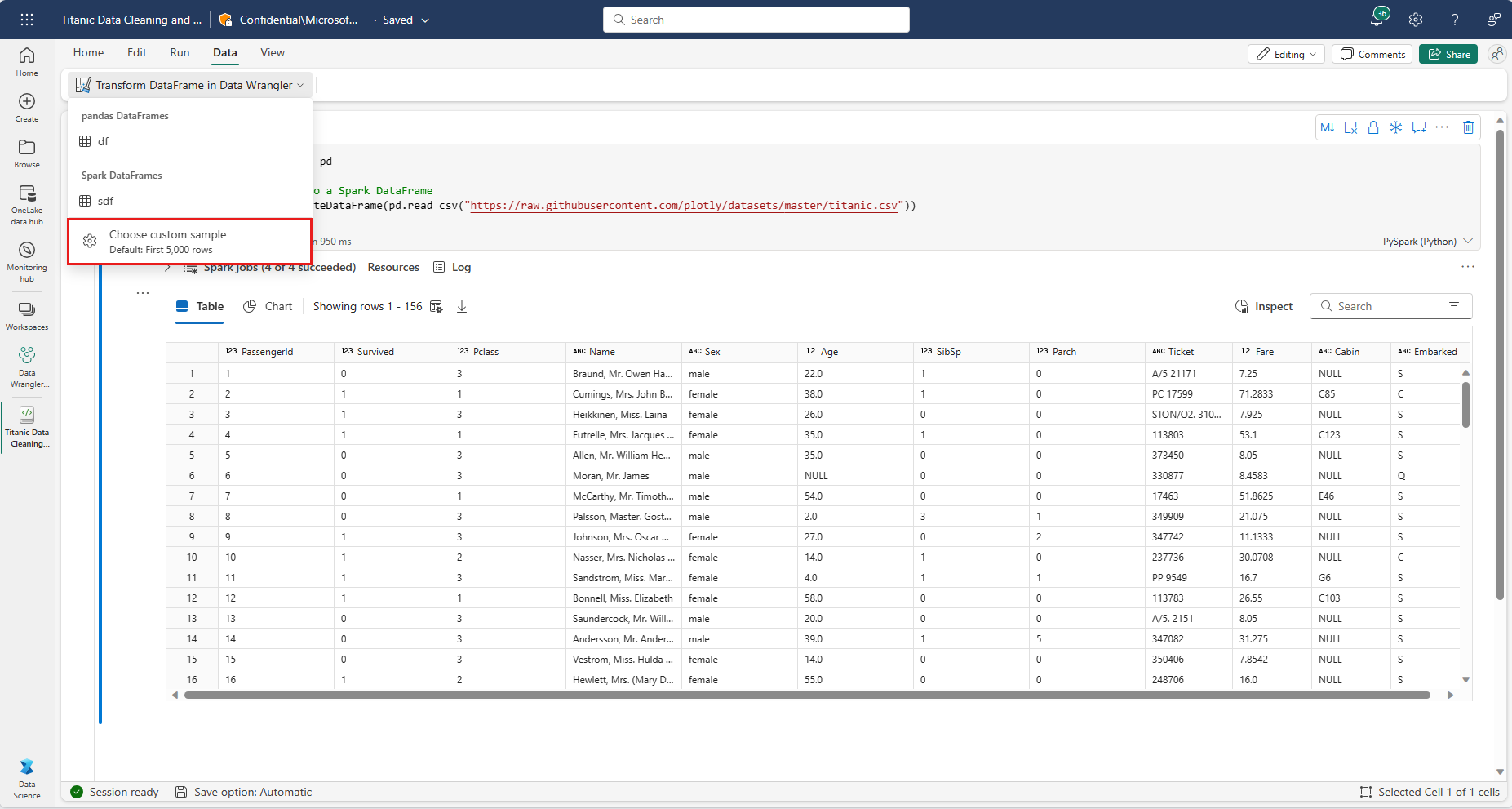

Choix d’échantillons personnalisés

Data Wrangler convertit automatiquement les DataFrames Spark en échantillons Pandas pour des raisons de performances. Toutefois, tout le code que l’outil génère est finalement traduit en PySpark lorsqu’il est réexporté dans le notebook. Comme pour n’importe quel DataFrame pandas, vous pouvez personnaliser l’échantillon par défaut. Pour ouvrir un échantillon personnalisé de n’importe quel DataFrame actif avec Data Wrangler, sélectionnez « Choisir un échantillon personnalisé » dans la liste déroulante, comme indiqué dans cette capture d’écran :

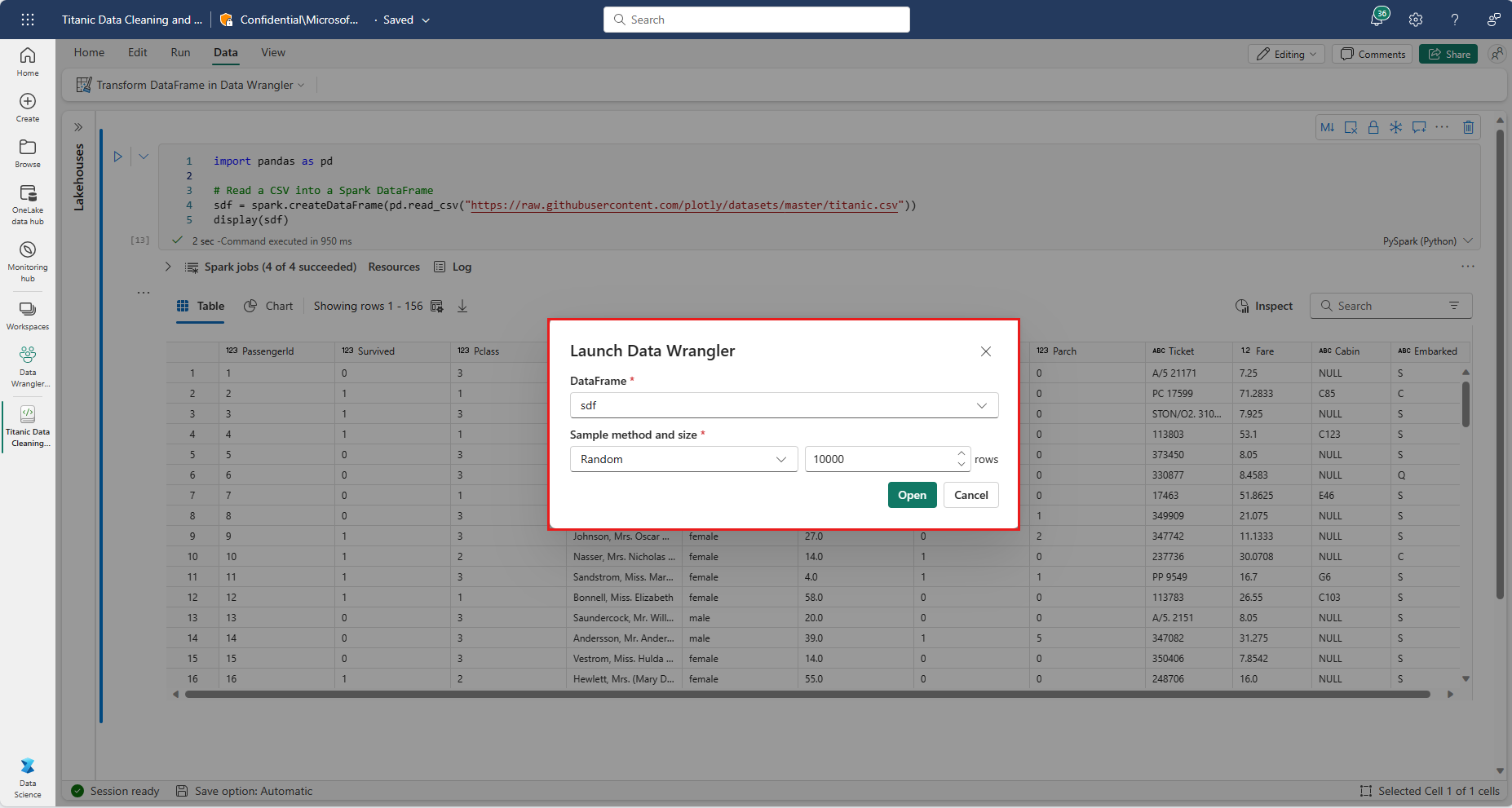

Cela lance une fenêtre contextuelle avec des options permettant de spécifier la taille de l’échantillon souhaité (nombre de lignes) et la méthode d’échantillonnage (premiers enregistrements, derniers enregistrements ou ensemble aléatoire), comme indiqué dans cette capture d’écran :

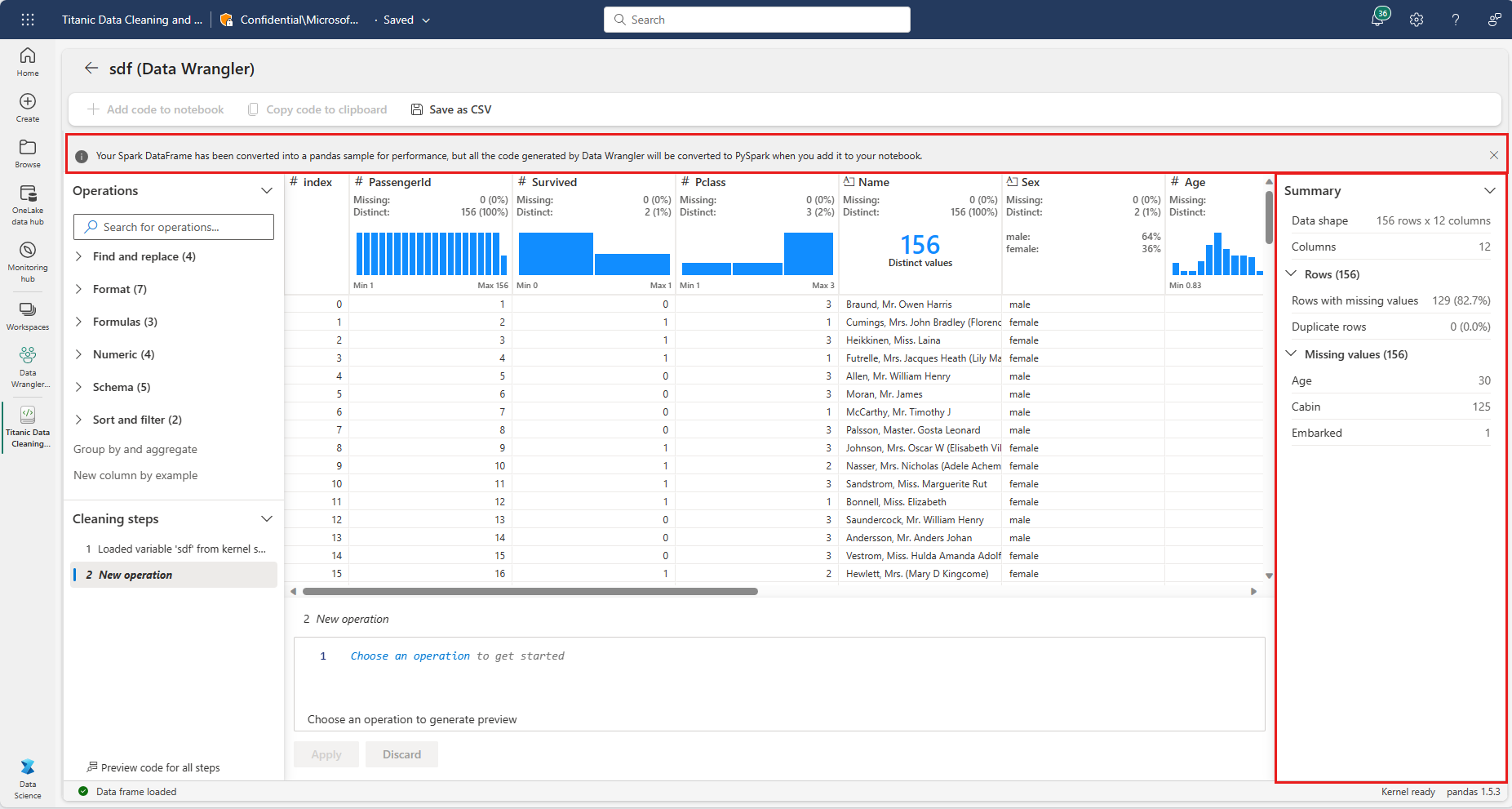

Affichage des statistiques récapitulatives

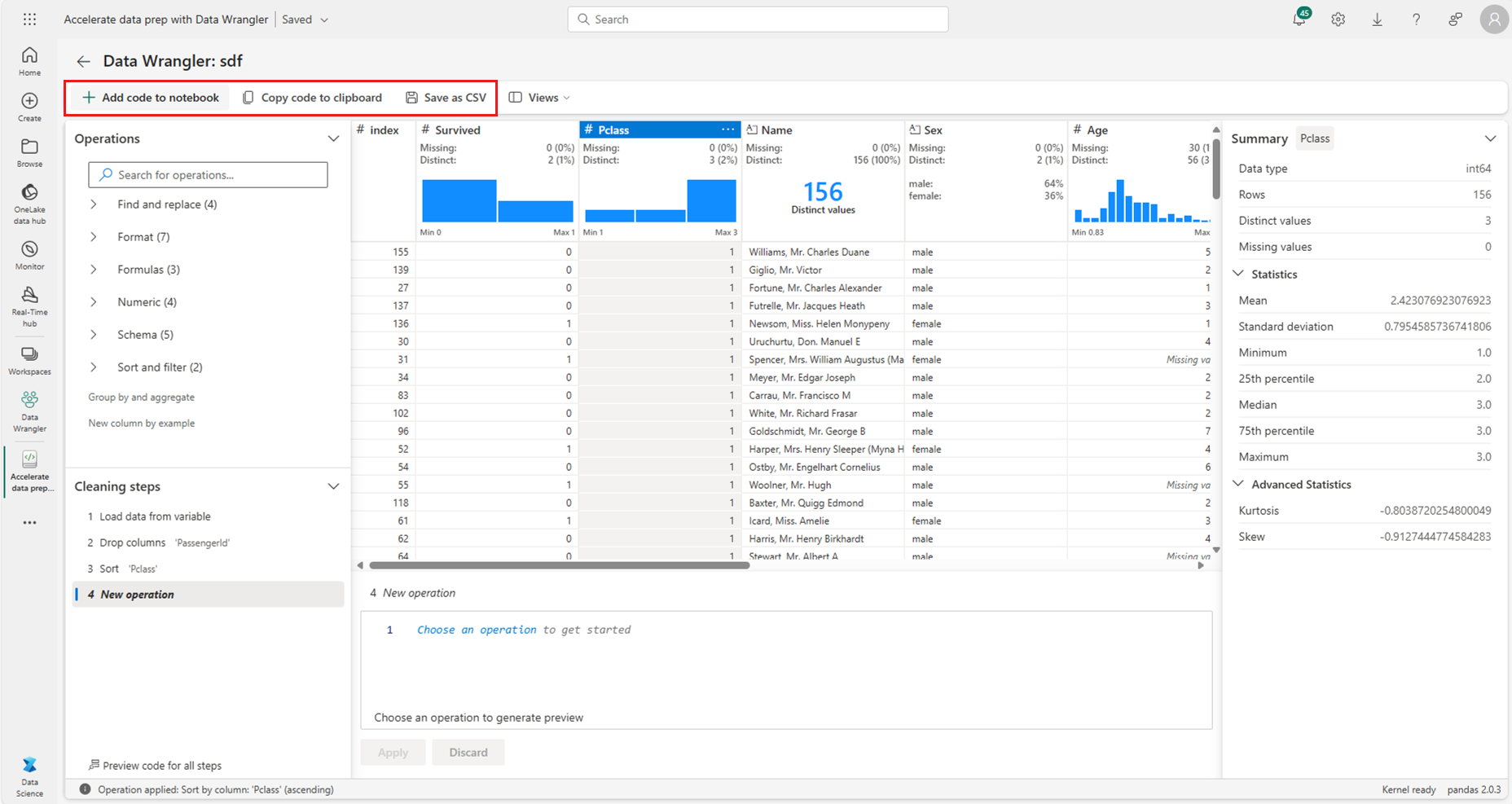

Lorsque Data Wrangler se charge, il affiche une bannière d’informations au-dessus de la grille d’aperçu. Cette bannière explique que les DataFrames Spark sont temporairement convertis en exemples pandas, mais que tout le code généré est finalement converti en PySpark. Après cela, l’utilisation de Data Wrangler sur des DataFrames Spark n’est pas différente de celle sur les DataFrames pandas. Une vue d’ensemble descriptive du panneau « Résumé » affiche des informations sur les dimensions de l’échantillon, les valeurs manquantes, etc. La sélection d’une colonne dans la grille Data Wrangler invite le panneau « Résumé » à mettre à jour et à afficher des statistiques descriptives sur cette colonne spécifique. Des informations rapides sur chaque colonne sont également disponibles dans son en-tête.

Conseil

Les statistiques et les visuels spécifiques aux colonnes (à la fois dans le panneau « Résumé » et dans les en-têtes de colonne) dépendent du type de données de colonne. Par exemple, un histogramme placé dans un compartiment d’une colonne numérique apparaît dans l’en-tête de colonne uniquement si la colonne est castée en type numérique, comme indiqué dans cette capture d’écran :

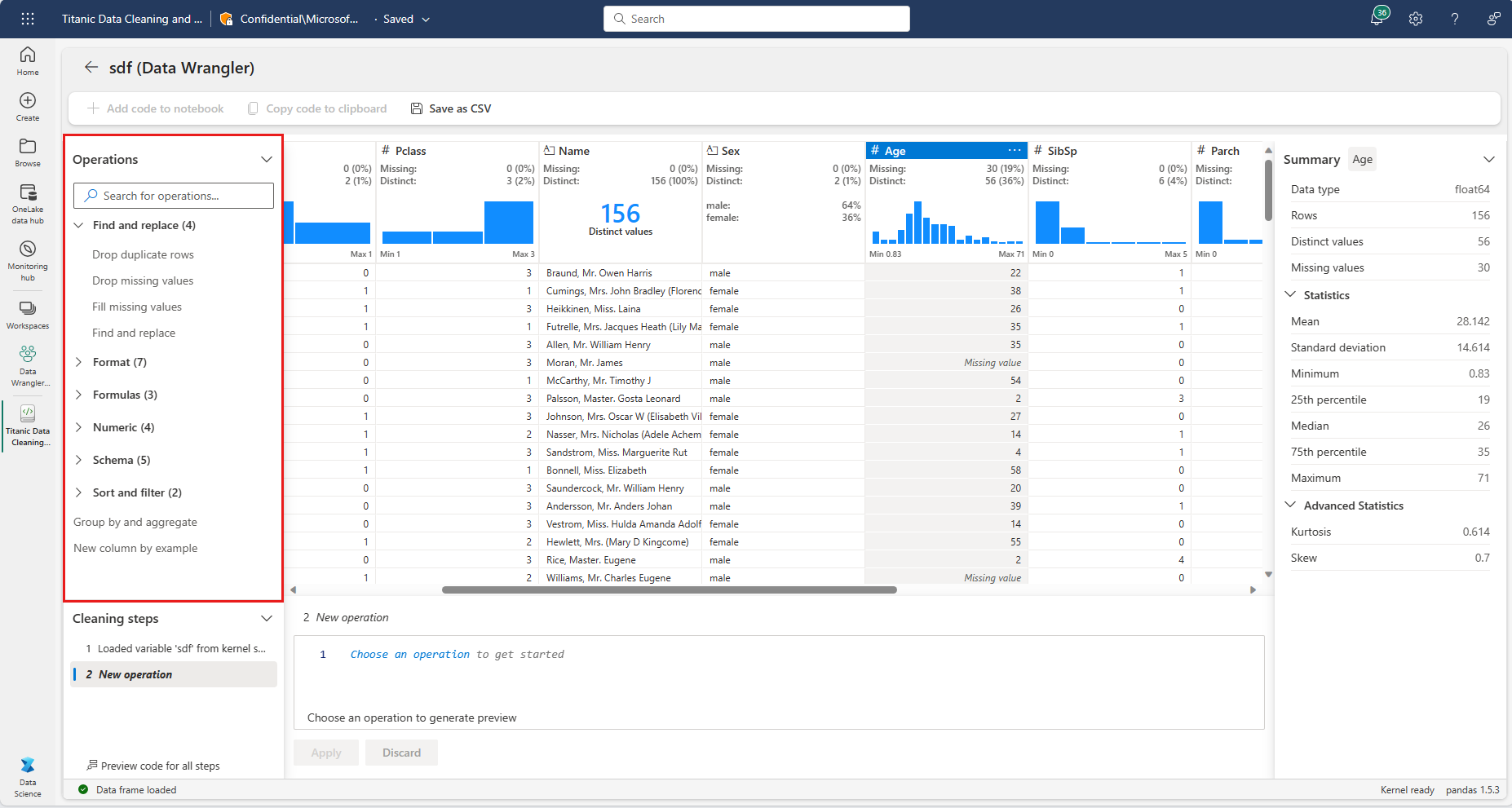

Parcourir les opérations de nettoyage des données

Vous trouverez la liste des étapes de nettoyage des données pouvant faire l’objet d’une recherche dans le panneau « Opérations ». Dans le panneau « Opérations », la sélection d’une étape de nettoyage des données vous invite à fournir une colonne ou des colonnes cibles, ainsi que les paramètres nécessaires pour effectuer l’étape. Par exemple, l’invite permettant de mettre à l’échelle numériquement une colonne nécessite une nouvelle plage de valeurs, comme indiqué dans cette capture d’écran :

Conseil

Vous pouvez appliquer une plus petite sélection d’opérations à partir du menu de chaque en-tête de colonne, comme indiqué dans cette capture d’écran :

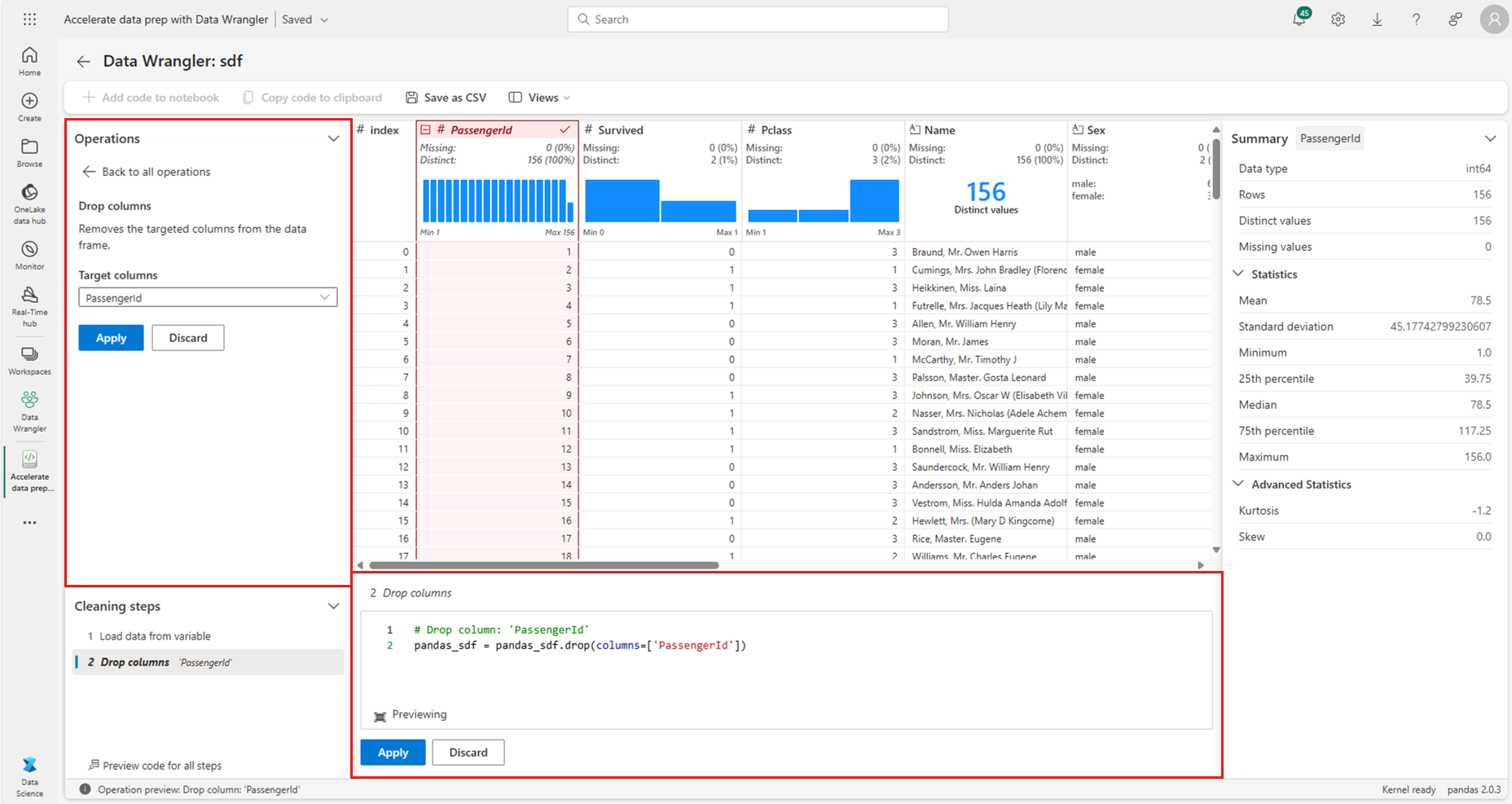

Aperçu et application d’opérations

La grille d’affichage de Data Wrangler prévisualise automatiquement les résultats d’une opération sélectionnée et le code correspondant apparaît automatiquement dans le panneau situé sous la grille. Pour valider le code en aperçu, sélectionnez «Appliquer» à l’un ou l’autre endroit. Pour supprimer le code préversion et essayer une nouvelle opération, sélectionnez « Ignorer », comme illustré dans cette capture d’écran :

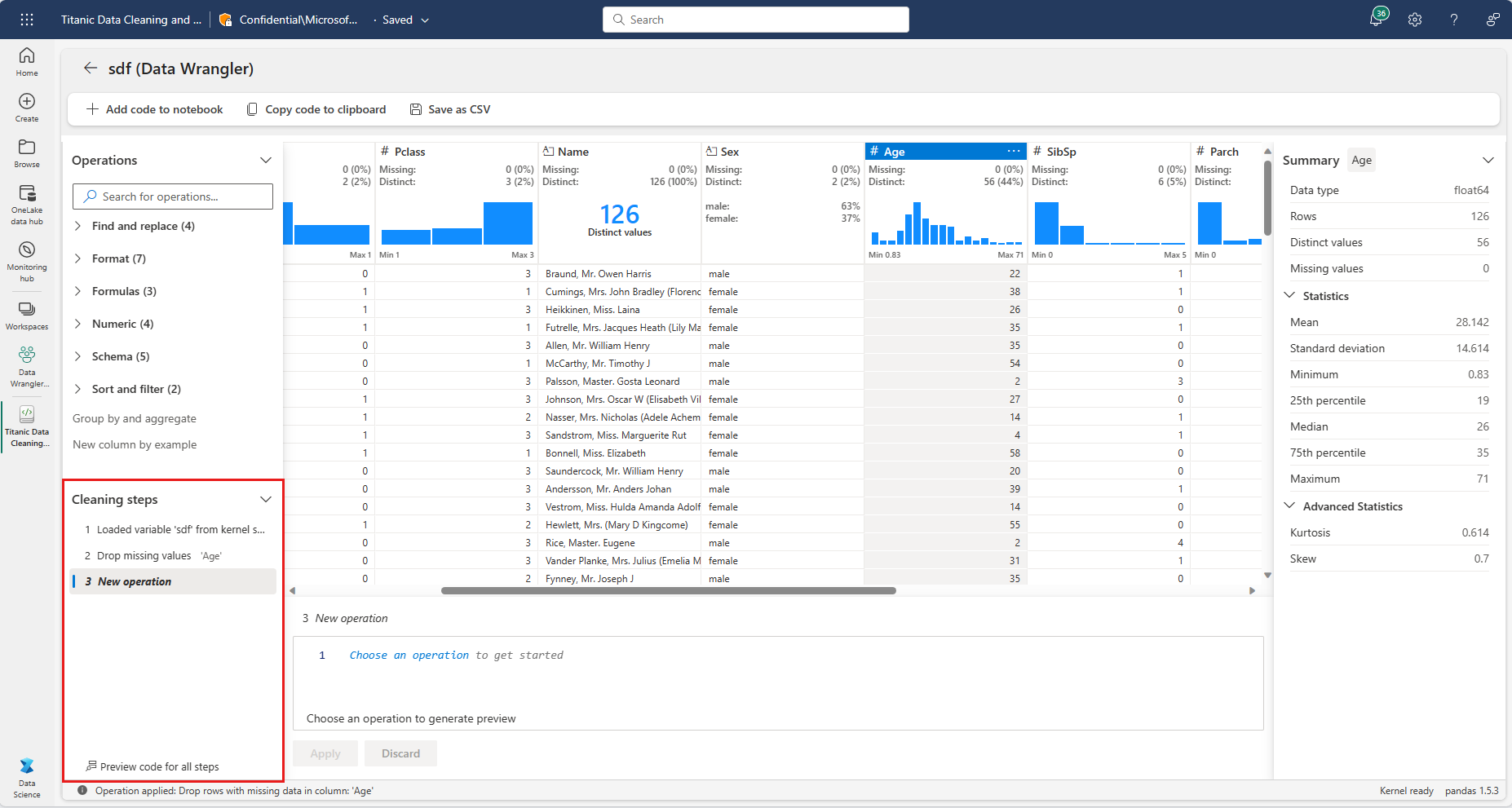

Une fois qu’une opération est appliquée, la grille d’affichage Data Wrangler et les statistiques récapitulatives sont mises à jour pour refléter les résultats. Le code apparaît dans la liste ouverte des opérations validées, située dans le panneau « Étapes de nettoyage », comme indiqué dans cette capture d’écran :

Conseil

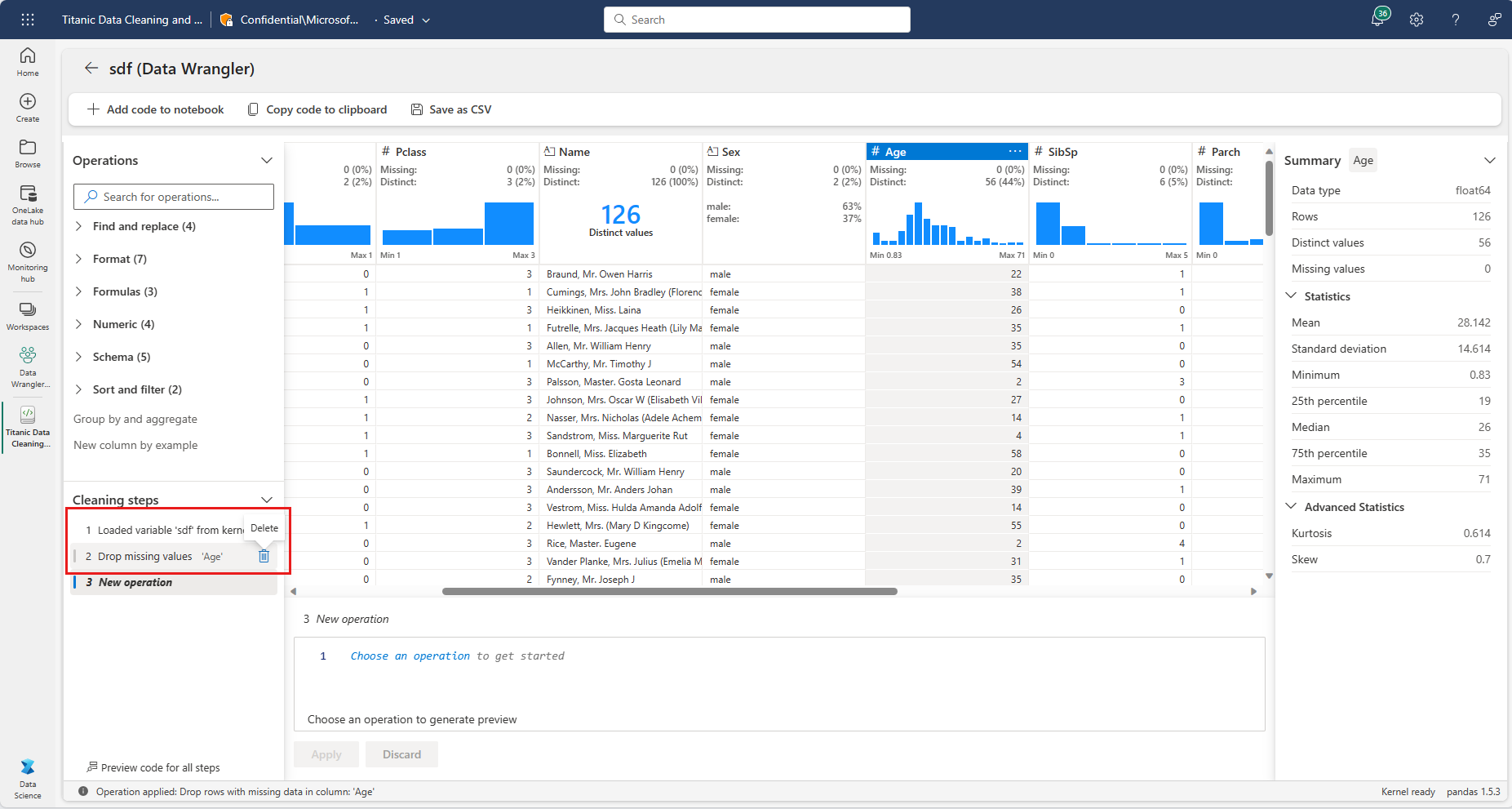

Vous pouvez toujours annuler l’étape la plus récente appliquée. Dans le panneau « Étapes de nettoyage », une icône de corbeille s’affiche si vous pointez votre curseur sur l’étape la plus récente appliquée, comme illustré dans cette capture d’écran :

Ce tableau récapitule les opérations actuellement prises en charge par Data Wrangler :

| Opération | Description |

|---|---|

| Sort | Trier une colonne par ordre croissant ou décroissant |

| Filter | Filtrer les lignes en fonction d’une ou plusieurs conditions |

| Codage à chaud | Créer des colonnes pour chaque valeur unique dans une colonne existante, indiquant la présence ou l’absence de ces valeurs par ligne |

| Codage à chaud avec délimiteur | Fractionner et coder des données catégorielles à chaud à l’aide d’un délimiteur |

| Modifier le type de colonne | Modifier le type de données d’une colonne |

| Supprimer la colonne | Supprimer une ou plusieurs colonnes |

| Sélectionner une colonne | Choisir une ou plusieurs colonnes à conserver, puis supprimer le reste |

| Renommer la colonne | Renommer une colonne |

| Supprimer les valeurs manquantes | Supprimer les lignes avec des valeurs manquantes |

| Supprimer les valeurs dupliquées | Supprimer toutes les lignes qui ont des valeurs en double dans une ou plusieurs colonnes |

| Remplir les valeurs manquantes | Remplacer les cellules avec des valeurs manquantes par une nouvelle valeur |

| Rechercher et remplacer | Remplacer les cellules par un modèle de correspondance exacte |

| Regrouper par colonne et agréger | Regrouper les valeurs par colonne et agréger les résultats |

| Éliminer les espaces blancs | Supprimer l’espace blanc du début et de la fin du texte |

| Fractionner un texte | Fractionner une colonne en plusieurs colonnes en fonction d’un délimiteur défini par l’utilisateur |

| Convertir du texte en minuscules | Convertir du texte en minuscules |

| Convertir du texte en majuscules | Convertir du texte en majuscules |

| Mettre à l’échelle les valeurs min/max | Mettre à l’échelle une colonne numérique entre une valeur minimale et une valeur maximale |

| Remplissage de Flash | Créer automatiquement une colonne basée sur des exemples dérivés d’une colonne existante |

Modifier votre affichage

À tout moment, vous pouvez personnaliser l’interface avec l’onglet « Vues » dans la barre d’outils située au-dessus de la grille d’affichage Data Wrangler. Cela peut masquer ou afficher différents volets en fonction de vos préférences et de votre taille d’écran, comme illustré dans cette capture d’écran :

Enregistrement et exportation de code

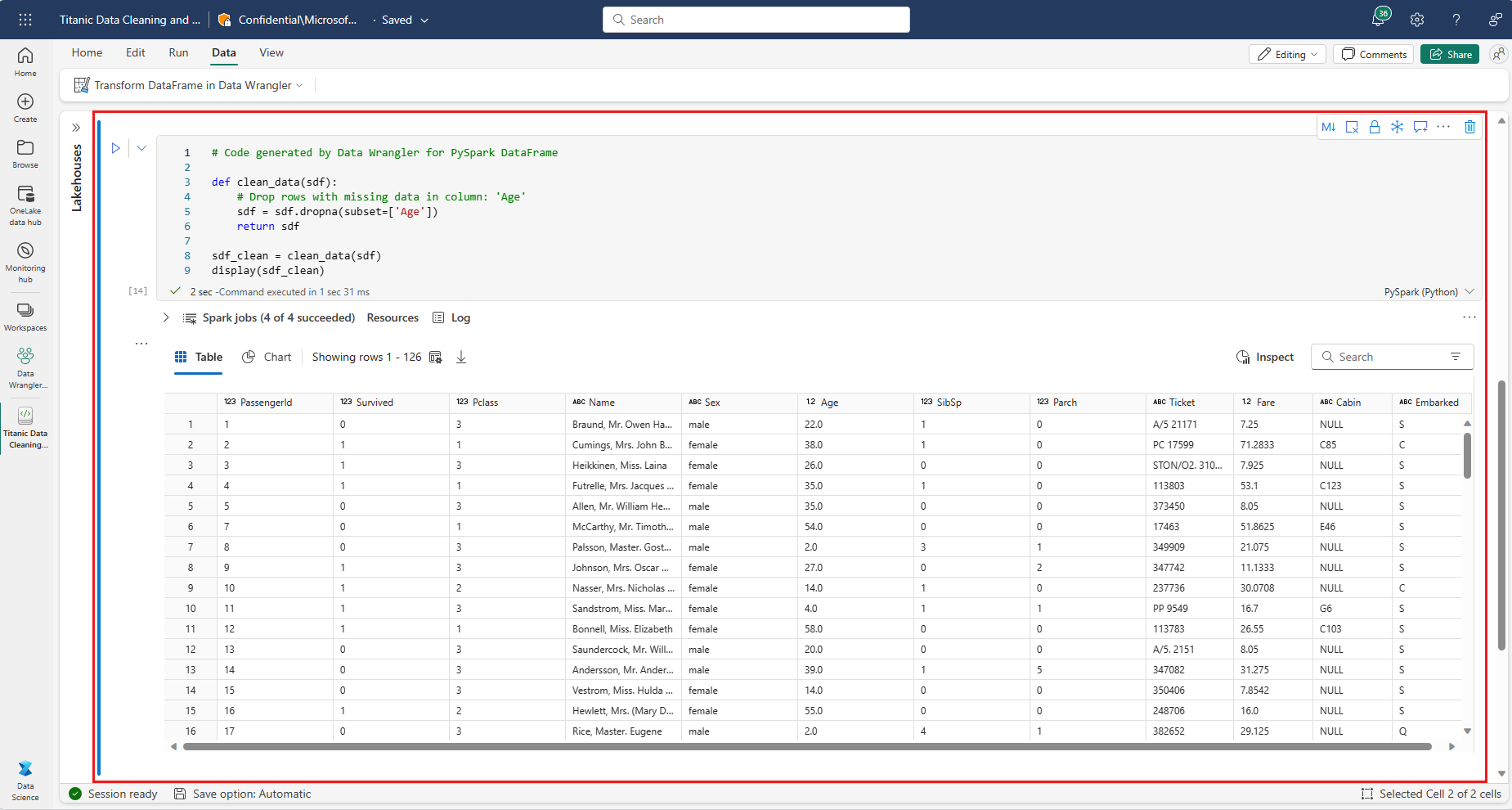

La barre d’outils située au-dessus de la grille d’affichage Data Wrangler fournit des options permettant d’enregistrer le code généré. Vous pouvez copier le code dans le Presse-papiers ou l’exporter vers le notebook en tant que fonction. Pour les DataFrames Spark, tout le code généré sur l’exemple pandas est traduit en PySpark avant de revenir au notebook. Avant la fermeture de Data Wrangler, l’outil affiche un aperçu du code PySpark traduit et fournit également une option permettant d’exporter le code pandas intermédiaire.

Conseil

Data Wrangler génère du code appliqué uniquement lorsque vous exécutez manuellement la nouvelle cellule et qu’elle ne remplace pas votre DataFrame d’origine, comme illustré dans cette capture d’écran :

Le code est converti en PySpark, comme illustré dans cette capture d’écran :

Vous pouvez ensuite exécuter ce code exporté, comme illustré dans cette capture d’écran :

Contenu connexe

- Pour un aperçu de Data Wrangler, consultez cet article complémentaire

- Pour essayer Data Wrangler dans Visual Studio Code, consultez Data Wrangler dans VS Code

- Avons-nous oublié une fonctionnalité dont vous avez besoin ? N’hésitez pas à nous en faire part. Suggérez-le dans le forum Fabric Ideas