Créer un Assistant vocal sans code dans Azure Percept Studio

Important

Mise hors service d’Azure Percept DK :

Mise à jour du 22 février 2023 : Une mise à jour du microprogramme pour les composants Percept DK Vision et Audio accessoires (également appelés Vision et Audio SOM) est désormais disponible ici et permettra aux composants accessoires de continuer à fonctionner au-delà de la date de mise hors service.

La préversion publique d’Azure Percept évoluera pour prendre en charge de nouvelles plateformes d’appareils périphériques et de nouvelles expériences de développement. Dans le cadre de cette évolution, Azure Percept DK et Audio Accessory et les services Azure de prise en charge associés pour Percept DK seront mis hors service le 30 mars 2023.

À compter du 30 mars 2023, Azure Percept DK et Audio Accessory ne seront plus pris en charge par aucun des services Azure, notamment Azure Percept Studio, les mises à jour du système d’exploitation, les mises à jour de conteneurs, l’affichage de flux web et l’intégration de Custom Vision. Microsoft ne fournira plus de support client ni aucun des services de support associés. Pour plus d’informations, consultez le Billet de blog d’avis de mise hors service.

Dans ce tutoriel, vous allez créer un Assistant vocal à partir d’un modèle en vue de l’utiliser avec votre DK Azure Percept et Azure Percept Audio. La démonstration de l’Assistant vocal s’exécute dans Azure Percept Studio et contient une sélection d’objets virtuels contrôlés par la voix. Pour contrôler un objet, prononcez votre mot clé (qui est le mot ou la phrase courte qui sort de veille votre appareil), suivi d’une commande. Chaque modèle répond à un ensemble de commandes spécifiques.

Ce guide explique comment configurer vos appareils, créer un Assistant vocal et les ressources Speech Services nécessaires, tester votre Assistant vocal, configurer votre mot clé et créer des mots clés personnalisés.

Prérequis

- DK (devkit) Azure Percept

- Azure Percept Audio

- Haut-parleur ou casque qui peut être branché à une prise audio de 3,5 mm (facultatif)

- Abonnement Azure

- Expérience d’installation du DK Azure Percept : vous avez connecté votre devkit à un réseau Wi-Fi, créé un hub IoT et connecté votre devkit au hub IoT

- Installation d’Azure Percept Audio

Créer un Assistant vocal à l’aide d’un modèle

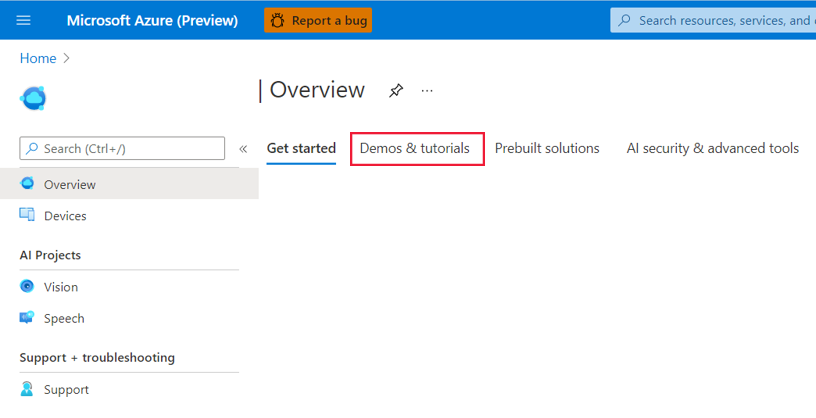

Accédez à Azure Percept Studio.

Ouvrez l’onglet Tutoriels et démonstrations.

Cliquez sur Tester les modèles de l’Assistant vocal sous Tutoriels et démonstrations - Reconnaissance vocale. Une fenêtre s’ouvre alors sur le côté droit de l’écran.

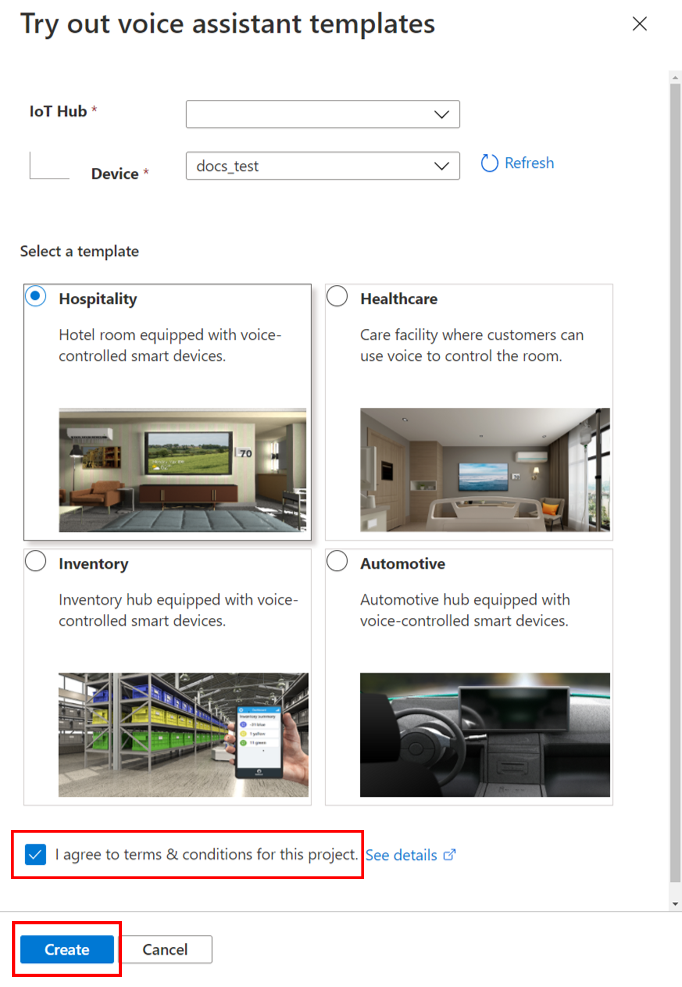

Effectuez les étapes suivantes dans la fenêtre :

Dans le menu déroulant IoT Hub, sélectionnez le hub IoT auquel votre devkit est connecté.

Dans le menu déroulant Appareil, sélectionnez votre devkit.

Sélectionnez l’un des modèles disponibles de l’Assistant vocal.

Cochez la case J’accepte les conditions générales pour ce projet.

Cliquez sur Créer.

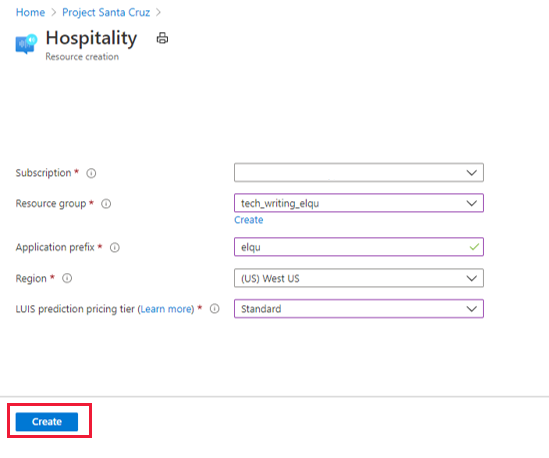

Une fois que vous avez cliqué sur Créer, le portail ouvre une autre fenêtre pour créer votre ressource de reconnaissance vocale. Effectuez les étapes suivantes dans la fenêtre :

Sélectionnez votre abonnement Azure dans la zone Abonnement.

Sélectionnez le groupe de ressources de votre choix dans le menu déroulant Groupe de ressources. Si vous souhaitez créer un groupe de ressources à utiliser avec votre Assistant vocal, cliquez sur Créer sous le menu déroulant, puis suivez les invites.

Pour Préfixe de l’application, entrez un nom. Il s’agit du préfixe de votre projet et du nom de votre commande personnalisée.

Sous Région, sélectionnez la région dans laquelle déployer les ressources.

Sous Niveau tarifaire de prédiction LUIS, sélectionnez Standard (le niveau gratuit ne prend pas en charge les demandes vocales).

Cliquez sur le bouton Créer. Les ressources de l’application Assistant vocal seront déployées dans votre abonnement.

Avertissement

Ne fermez pas la fenêtre tant que le portail n’a pas terminé le déploiement de la ressource. La fermeture prématurée de la fenêtre peut entraîner un comportement inattendu de l’Assistant vocal. Une fois que votre ressource a été déployée, la démonstration s’affiche.

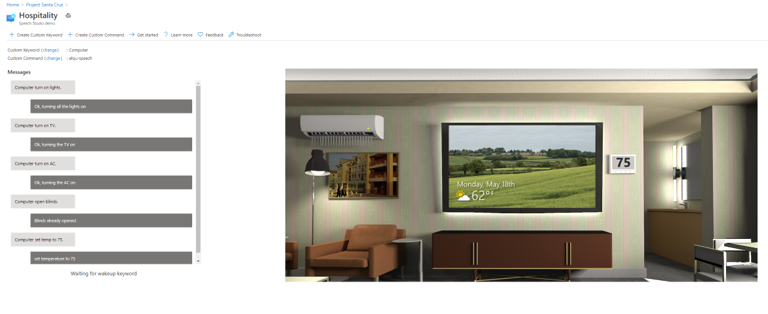

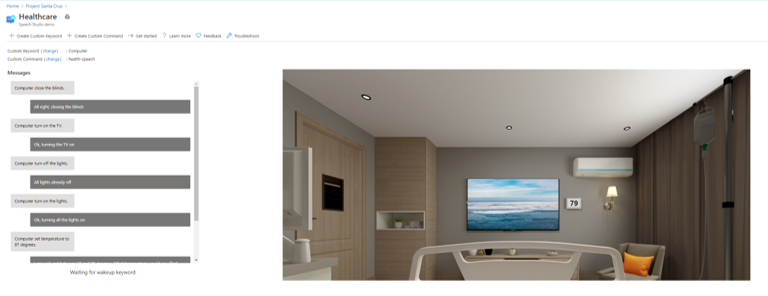

Essayer l’Assistant vocal

Pour interagir avec votre Assistant vocal, prononcez le mot clé suivi d’une commande. Lorsque le SoM d’écoute reconnaît votre mot clé, l’appareil émet une sonnerie (que vous pouvez entendre si un haut-parleur ou un casque est connecté) et les voyants clignotent en bleu. Les voyants passent au bleu vif pendant le traitement de votre commande. La réponse de l’Assistant vocal à votre commande s’affiche sous forme de texte dans la fenêtre de démonstration, et elle est émise de façon audible par le biais de votre haut-parleur ou de votre casque. Le mot clé par défaut (listé en regard de Mot clé personnalisé) est défini sur « Ordinateur ». En outre, chaque modèle est associé à un ensemble de commandes compatibles qui vous permettent d’interagir avec des objets virtuels dans la fenêtre de démonstration. Par exemple, si vous utilisez la démonstration Hôtellerie ou Santé, dites « Ordinateur, allume la télévision » pour allumer la télévision virtuelle.

Commandes des démonstrations Hôtellerie et Santé

Les démonstrations Hôtellerie et Santé incluent des téléviseurs virtuels, des lumières, des volets et des thermostats avec lesquels vous pouvez interagir. Les commandes suivantes (et autres variantes) sont prises en charge :

- « Allume/Éteins la lumière »

- « Allume/Éteins la télévision »

- « Allume/Éteins la climatisation »

- « Ouvre/Ferme les volets ».

- « Régler la température sur X degrés. » (X correspondant à la température souhaitée, par exemple 24.)

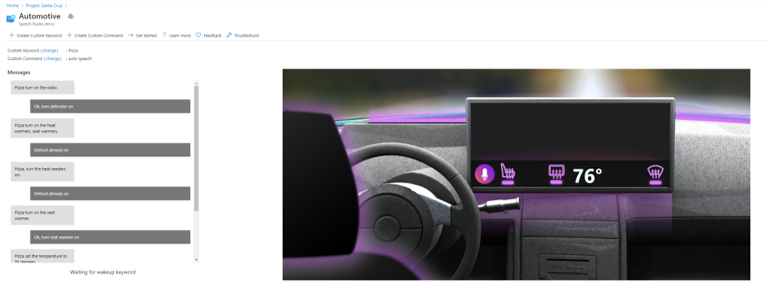

Commandes de la démonstration Automobile

La démonstration Automobile inclut un chauffage de siège virtuel, un dégivreur et un thermostat avec lequel vous pouvez interagir. Les commandes suivantes (et autres variantes) sont prises en charge :

- « Active/Désactive le dégivreur »

- « Active/Désactive le chauffage de siège »

- « Régler la température sur X degrés. » (X correspondant à la température souhaitée, par exemple 24.)

- « Augmente/Diminue la température de Y degrés »

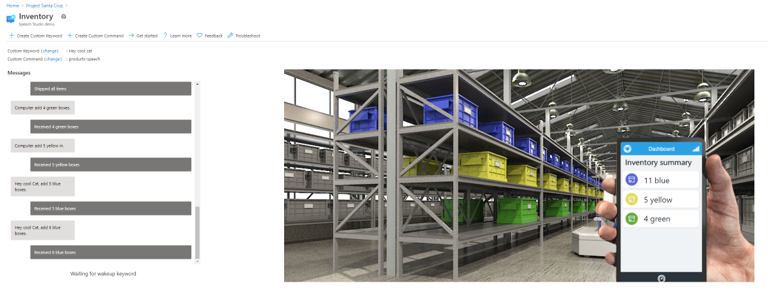

Commandes de la démonstration Inventaire

La démonstration Inventaire propose une sélection de boîtes virtuelles bleues, jaunes et vertes permettant d’interagir avec une application d’inventaire virtuel. Les commandes suivantes (et autres variantes) sont prises en charge :

- « Ajouter/supprimer X boîtes » (X représente le nombre de boîtes, par exemple 4.)

- « Commande/Expédie X boîtes »

- « Combien de boîtes sont en stock ? »

- « Nombre de boîtes Y » (Y représente la couleur des boîtes, par exemple jaune.)

- « Expédie tout le stock »

Configurer votre mot clé

Vous pouvez personnaliser le mot clé pour votre application Assistant vocal.

Cliquez sur Modifier à côté de Mot clé personnalisé dans la fenêtre de démonstration.

Sélectionnez l’un des mots clés disponibles. Vous pouvez choisir parmi une sélection d’exemples de mots clés, ainsi que parmi tous les mots clés personnalisés que vous avez créés.

Cliquez sur Enregistrer.

Créer un mot clé personnalisé

Vous pouvez créer votre propre mot clé pour votre application vocale. L’entraînement de votre mot clé personnalisé peut ne prendre que quelques minutes.

Cliquez sur + Créer un mot clé personnalisé en haut de la fenêtre de démonstration.

Entrez le mot clé de votre choix. Il peut s’agir d’un mot unique ou d’une expression courte.

Sélectionnez votre ressource Speech (dont la liste figure à côté de Commande personnalisée dans la fenêtre de démonstration et qui comprend le préfixe de votre application).

Cliquez sur Enregistrer.

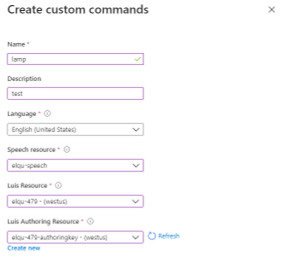

Créer une commande personnalisée

Le portail fournit également des fonctionnalités permettant de créer des commandes personnalisées avec des ressources vocales existantes. Le terme « commande personnalisée » fait référence à l’application Assistant vocal, et non à une commande spécifique de l’application existante. En créant une commande personnalisée, vous créez un projet de reconnaissance vocale, que vous devez développer dans Speech Studio.

Pour créer une commande personnalisée à partir de la fenêtre de démonstration, cliquez sur + Créer une commande personnalisée en haut de la page, puis effectuez les étapes suivantes :

Entrez un nom pour votre commande personnalisée.

Entrez la description de votre projet (facultatif).

Sélectionnez votre langue par défaut.

Sélectionnez votre ressource Speech.

Sélectionnez votre ressource LUIS.

Sélectionnez votre ressource de création LUIS ou créez-en une.

Cliquez sur Créer.

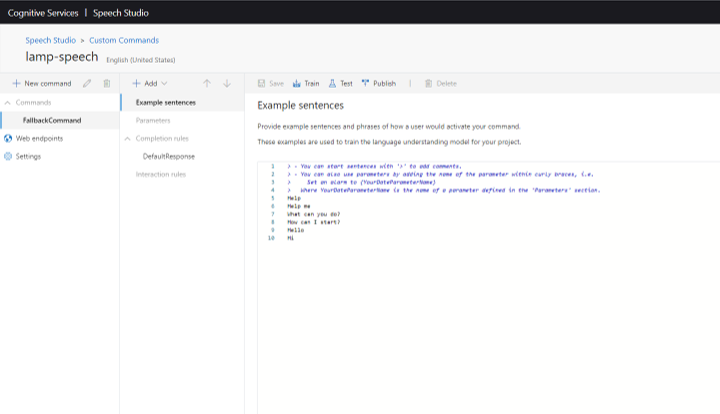

Une fois que vous avez créé votre commande personnalisée, vous devez accéder à Speech Studio pour poursuivre le développement. Si vous ouvrez Speech Studio et ne voyez pas votre commande personnalisée dans la liste, effectuez les étapes suivantes :

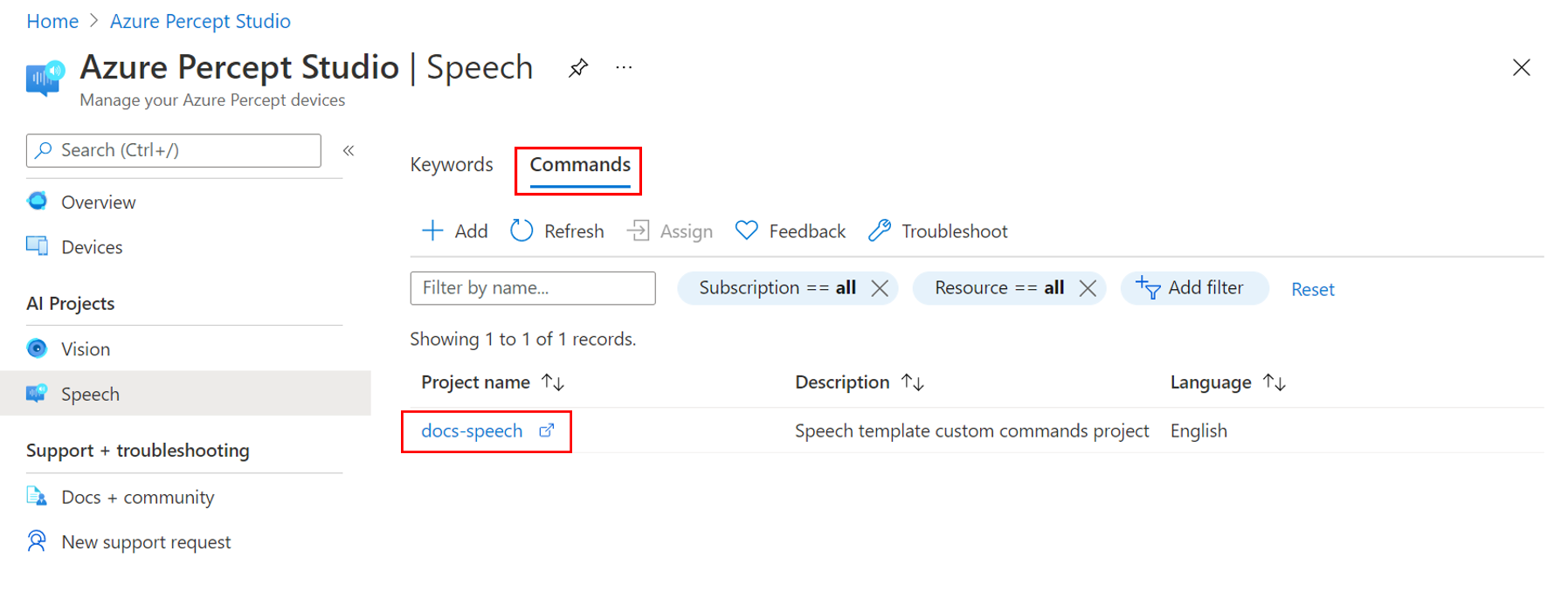

Dans le volet de gauche d’Azure Percept Studio, cliquez sur Speech dans Projets d’IA.

Sélectionnez l’onglet Commandes.

Sélectionnez la commande personnalisée que vous souhaitez développer. Cette sélection ouvre le projet dans Speech Studio.

Pour plus d’informations sur le développement de commandes personnalisées, consultez la documentation Speech Service.

Résolution des problèmes

L’Assistant vocal a été créé mais ne répond pas aux commandes

Vérifiez les voyants LED sur la carte d’interposeur :

- Trois voyants bleus fixes indiquent que l’Assistant vocal est prêt et qu’il attend le mot clé.

- Si le voyant central (L02) est blanc, cela signifie que l’initialisation du devkit est terminée et que celui-ci doit être configuré avec un mot clé.

- Si la LED centrale (L02) clignote en blanc, cela signifie que le SoM Audio n’a pas encore terminé l’initialisation. L’initialisation peut prendre quelques minutes.

Pour plus d’informations sur les voyants LED, consultez l’article LED.

L’Assistant vocal ne répond pas à un mot clé personnalisé créé dans Speech Studio

Cela peut se produire si le module de reconnaissance vocale est obsolète. Effectuez les étapes suivantes pour mettre à jour le module Speech vers la dernière version :

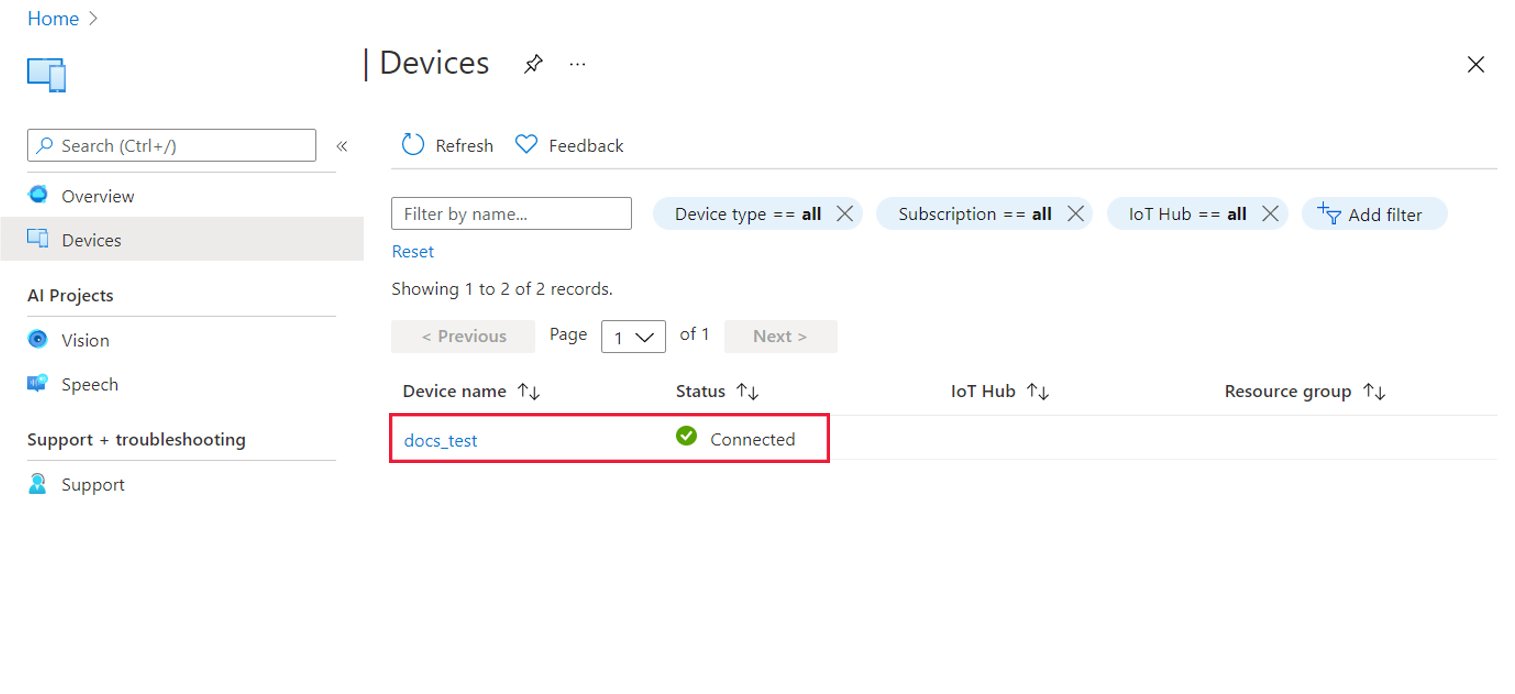

Dans le menu de gauche de la page d’accueil Azure Percept Studio, cliquez sur Appareils.

Recherchez puis sélectionnez votre appareil.

Dans la fenêtre Appareils, sélectionnez l’onglet Speech.

Vérifiez la version du module Speech. Si une mise à jour est disponible, le bouton Mettre à jour s’affiche à côté du numéro de version.

Cliquez sur Mettre à jour pour déployer la mise à jour du module Speech. Le processus de mise à jour prend généralement de 2 à 3 minutes.

Nettoyer les ressources

Une fois que vous avez fini d’utiliser l’application Assistant vocal, effectuez les étapes suivantes pour nettoyer les ressources Speech que vous avez déployées dans ce tutoriel :

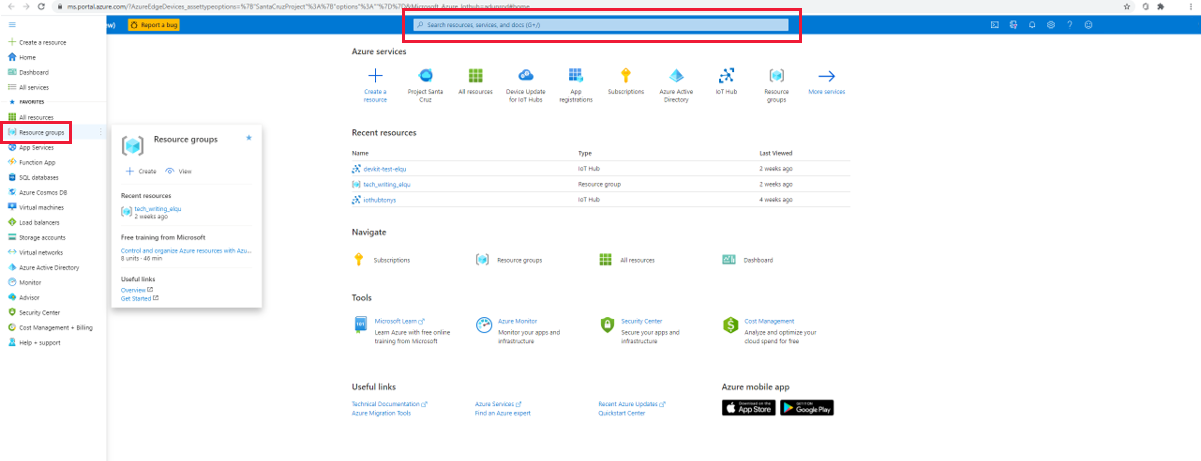

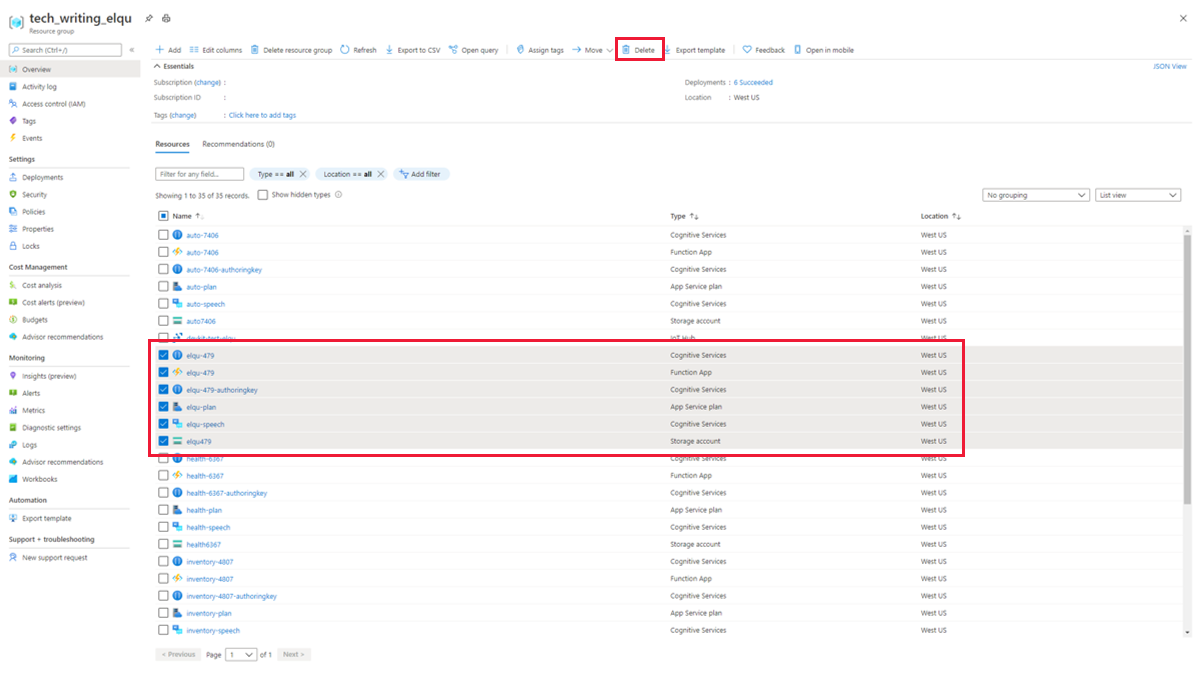

Sur le portail Azure, sélectionnez Groupes de ressources dans le menu de gauche ou tapez « groupes de ressources » dans la barre de recherche.

Sélectionnez votre groupe de ressources.

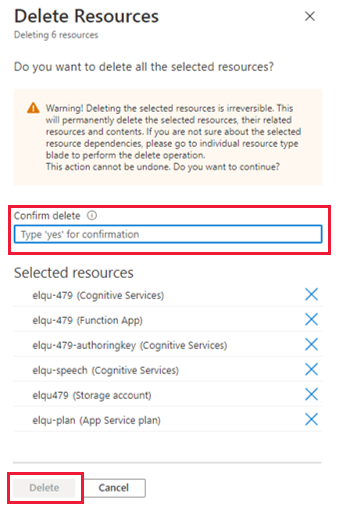

Sélectionnez les six ressources dont le nom comprend le préfixe de votre application, puis cliquez sur l’icône Supprimer dans le menu du haut.

Pour confirmer la suppression, tapez oui dans la zone de confirmation, vérifiez que vous avez sélectionné les bonnes ressources, puis cliquez sur Supprimer.

Avertissement

Cette opération supprimera tous les mots clés personnalisés qui ont été créés avec les ressources Speech que vous supprimez, et la démonstration de l’Assistant vocal ne fonctionnera plus.

Étapes suivantes

Maintenant que vous avez créé une solution de reconnaissance vocale sans code, essayez de créer une solution de vision sans code pour votre DK Azure Percept.