Sélectionner des modèles à l’aide de benchmarks

Avant de déployer un modèle, vous souhaitez comprendre comment il s’exécute sur différentes dimensions. Les benchmarks de modèle fournissent des données objectives et mesurables pour vous aider à comparer des modèles et à prendre des décisions de sélection éclairées. Le portail Microsoft Foundry propose des outils d’évaluation complets organisés en métriques de qualité, de sécurité, de coût et de performances.

Accéder aux modèles de référence

Vous pouvez explorer les benchmarks de deux manières dans le portail Microsoft Foundry :

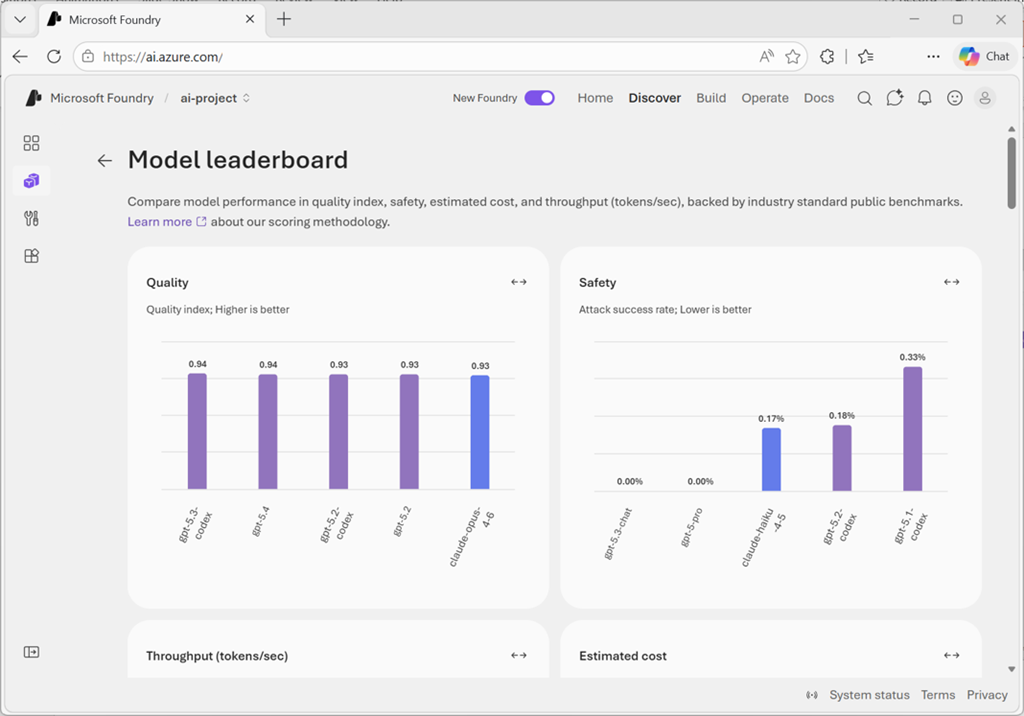

Dans le catalogue de modèles, consultez le tableau de classement des modèles pour voir les classements comparatifs de tous les modèles disponibles. Cette vue vous aide à identifier les modèles les plus performants pour des métriques ou des scénarios spécifiques. Le classement affiche les principaux modèles classés par qualité, sécurité, coût estimé et débit.

Pour obtenir des benchmarks détaillés sur un modèle spécifique, ouvrez sa carte de modèle et sélectionnez l’onglet Benchmarks . Cette vue montre comment le modèle individuel s’exécute sur différentes métriques et jeux de données, avec des graphiques de comparaison le plaçant par rapport à des modèles similaires.

Benchmarks de qualité

Les benchmarks de qualité évaluent la façon dont un modèle génère des réponses précises, cohérentes et contextuellement appropriées. Ces métriques utilisent des jeux de données publics et des méthodes d’évaluation standardisées pour garantir la cohérence.

L’index Qualité fournit une vue d’ensemble en faisant la moyenne des scores de précision sur plusieurs jeux de données de référence qui mesurent le raisonnement, les connaissances, la capacité à répondre aux questions, les capacités mathématiques et les compétences de codage. Les valeurs d’index de qualité supérieure indiquent des performances globales plus fortes dans les tâches linguistiques à usage général.

Les benchmarks de qualité utilisent des jeux de données tels que :

- Arena-Hard - réponse à des questions contradictoires

- BIG-Bench Dur - Capacités de raisonnement

- GPQA - Questions multi-disciplines de niveau supérieur

- HumanEval+ et MBPP+ - Tâches de génération de code

- MATH - Raisonnement mathématique

- MMLU-Pro - Évaluation générale des connaissances

- IFEval - instruction suivante

Les scores de test sont des index normalisés allant de zéro à un, où les valeurs supérieures indiquent de meilleures performances.

Benchmarks de sécurité

Les métriques de sécurité garantissent que les modèles ne génèrent pas de contenu dangereux, biaisés ou inappropriés. Ces benchmarks sont essentiels pour les applications exposées aux utilisateurs finaux, en particulier dans les secteurs réglementés ou les scénarios orientés client.

Microsoft Foundry évalue les modèles sur plusieurs dimensions de sécurité :

La détection de comportement nuisible utilise le benchmark HarmBench pour mesurer la façon dont les modèles résistent à la génération de contenu non sécurisé. L’évaluation calcule le taux de réussite des attaques (ASR), où les valeurs inférieures indiquent des modèles plus sûrs et plus robustes. HarmBench teste trois domaines fonctionnels :

- Comportements dangereux standard - cybercriminalité, activités illégales, préjudice général

- Comportements nocifs contextuels - mauvaise information, harcèlement, intimidation

- Violations de droits d’auteur - reproduction de documents protégés par le droit d’auteur

La détection de contenu toxique utilise le jeu de données ToxiGen pour mesurer la façon dont les modèles identifient les discours haineux contradictoires et implicites. Les scores F1 plus élevés indiquent de meilleures performances de détection dans les mentions des groupes minoritaires.

Les connaissances de domaine sensibles utilisent le benchmark WMDP (Armes de destruction de masse proxy) pour mesurer les connaissances du modèle en matière de biosecurity, de cybersécurité et de sécurité chimique. Les scores WMDP plus élevés indiquent plus de connaissances sur les capacités potentiellement dangereuses.

Les scores de sécurité vous aident à comprendre la robustesse du modèle, particulièrement important pour les applications orientées client, où la sortie dangereuse pose des préoccupations importantes.

Référentiels de coût

Comprendre l’impact financier de l’utilisation du modèle vous aide à équilibrer les exigences de qualité avec les contraintes budgétaires. Les références de coût dans Microsoft Foundry affichent la tarification des déploiements d’API serverless et des modèles OpenAI d’Azure.

Le coût par jeton d’entrée indique le prix du traitement de 1 million de jetons d’entrée (le texte que vous envoyez au modèle).

Le coût par jetons de sortie indique le prix de génération de 1 million de jetons de sortie (le texte produit par le modèle).

Le coût estimé combine les coûts d’entrée et de sortie à l’aide d’un ratio 3:1 classique (trois jetons d’entrée pour chaque jeton de sortie), ce qui vous donne un seul nombre pour la comparaison. Les valeurs inférieures indiquent des modèles plus rentables.

Les benchmarks de coût vous aident à identifier les modèles qui fournissent la qualité dont vous avez besoin à un prix adapté aux modèles d’utilisation et au budget de votre application.

Normes de performance

Les métriques de performances mesurent la rapidité et l’efficacité des modèles répondent aux demandes. Ces benchmarks concernent les applications en temps réel où l’expérience utilisateur dépend de la réactivité.

Les mesures de latence sont les suivantes :

- Moyenne de latence : temps moyen en secondes pour traiter une requête

- Latence P50 (médiane) - 50% de requêtes se terminent plus rapidement que cette fois

- Latence P90 - 90 % des requêtes s'achèvent plus rapidement que ce délai

- Latence P95 - 95% des requêtes se terminent plus rapidement que ce délai

- Latence P99 - 99% des requêtes se terminent plus rapidement que cette fois

- Temps jusqu’au premier jeton (TTFT) – délai précédant l’arrivée du premier jeton lors de l’utilisation du flux

Les mesures de débit sont les suivantes :

- Jetons générés par seconde (GTPS) : jetons de sortie générés par seconde

- Nombre total de jetons par seconde (TTPS) : jetons d’entrée et de sortie combinés traités par seconde

- Temps entre les jetons - intervalle entre la réception de jetons consécutifs

Le classement récapitule les performances en utilisant le temps moyen pour le premier jeton (inférieur est meilleur) et les jetons générés moyennement par seconde (plus élevé est meilleur). Les modèles à débit élevé et à faible latence offrent de meilleures expériences utilisateur dans les applications interactives. Pour les travaux de traitement par lots où la vitesse est inférieure au coût, vous pouvez hiérarchiser d’autres facteurs.

Utiliser des classements et des fonctionnalités de comparaison

Le classement des modèles vous permet d’afficher les principaux modèles pour des métriques spécifiques. Vous pouvez trier par qualité, sécurité, coût estimé et débit pour identifier les modèles qui correspondent le mieux à vos besoins.

Les classements de scénarios vous aident à trouver des modèles optimisés pour des cas d’usage spécifiques tels que le raisonnement, le codage, les mathématiques, les réponses aux questions ou l’exactitude des questions. Si votre application est mappée à un scénario particulier, commencez par le classement du scénario approprié plutôt que de vous appuyer uniquement sur l’index de qualité global.

Les graphiques de compromis affichent deux métriques simultanément, telles que la qualité par rapport au coût ou la qualité par rapport au débit. Ces visualisations vous aident à trouver l’équilibre optimal pour vos besoins. Utilisez la liste déroulante pour comparer la qualité par rapport aux coûts, au débit ou à la sécurité. Les modèles plus proches du coin supérieur droit du graphique fonctionnent correctement sur les deux métriques. Un modèle légèrement moins précis, mais beaucoup plus rapide ou moins cher peut mieux répondre à vos besoins.

La comparaison côte à côte vous permet de sélectionner deux ou trois modèles dans le classement et de les comparer entre plusieurs dimensions :

- Benchmarks de performances (qualité, sécurité, débit)

- Détails du modèle (fenêtre de contexte, données d’apprentissage, langues prises en charge)

- Points de terminaison pris en charge (options de déploiement)

- Prise en charge des fonctionnalités (appel de fonction, sortie structurée, vision)

Sélectionnez des modèles en cochant les cases en regard de leurs noms, puis choisissez Comparer pour ouvrir la vue de comparaison détaillée.