Évaluer les performances du modèle

L’évaluation de votre modèle déployé garantit qu’il répond aux normes de qualité, fournit des réponses précises et s’améliore en permanence au fil du temps. Le portail Microsoft Foundry propose plusieurs approches d’évaluation, du test manuel aux métriques automatisées et des flux d’évaluation complets.

Pourquoi évaluer des modèles

L’évaluation répond à plusieurs objectifs critiques dans le développement d’applications IA génératives :

L’assurance qualité identifie les problèmes et garantit que votre modèle fournit des réponses précises et pertinentes. La découverte de problèmes lors de l’évaluation plutôt que de la production protège vos utilisateurs et la réputation de votre organisation.

La satisfaction des utilisateurs s’améliore lorsque les modèles fournissent constamment des réponses utiles et appropriées. L’évaluation vous aide à comprendre comment les utilisateurs connaissent votre application et où les améliorations rendent l’impact le plus important.

L’amélioration continue provient de l’analyse des résultats de l’évaluation pour identifier les opportunités d’amélioration. Une évaluation menée de façon régulière lors de l’actualisation des requêtes, de l’ajout de nouvelles fonctionnalités ou du réentraînement des modèles permet de maintenir un niveau de qualité constant.

La vérification de la conformité et de la sécurité confirme que votre modèle respecte les stratégies, évite de générer du contenu dangereux et respecte les exigences de confidentialité et de protection des données des utilisateurs.

Approches manuelles d’évaluation

L’évaluation manuelle implique des réviseurs humains qui évaluent les réponses du modèle. Même si l’évaluation manuelle nécessite beaucoup de temps, elle fournit des informations que les métriques automatisées ne peuvent pas capturer.

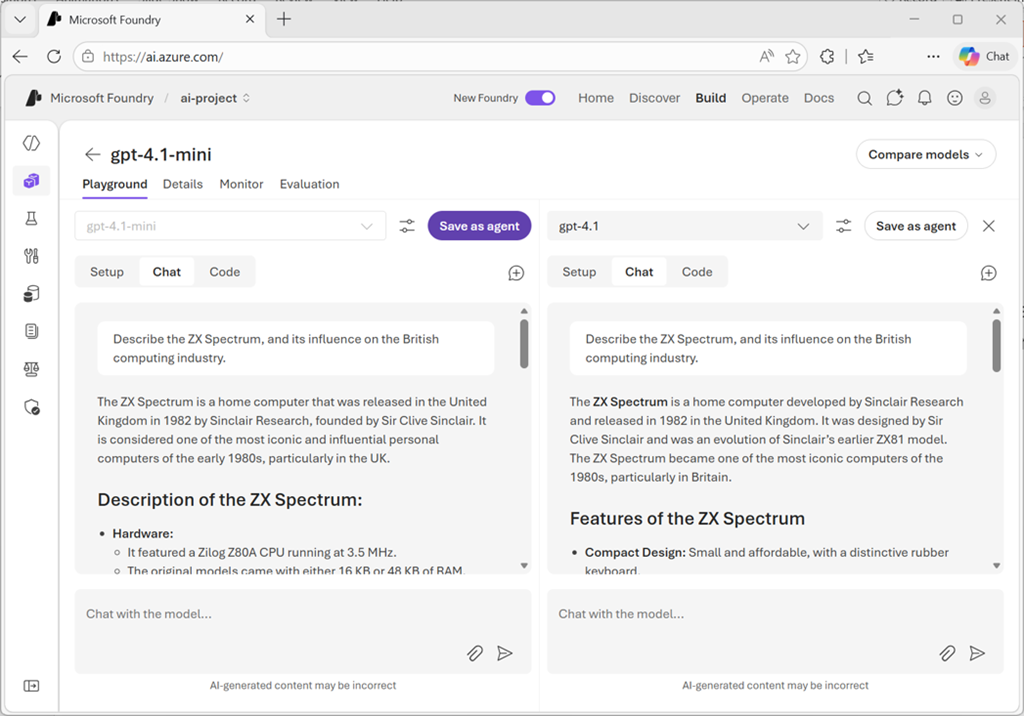

Les tests interactifs dans le terrain de jeu vous permettent d’explorer qualitativement le comportement du modèle. Vous saisissez diverses incitations, observez les réponses et notez des problèmes tels que des informations incorrectes, un ton inapproprié ou l'incapacité à suivre les instructions. Ce test exploratoire vous aide à comprendre les forces et limitations d’un modèle.

Pour optimiser la conception de votre application, vous pouvez tester des modèles côte à côte dans le terrain de jeu, synchroniser les instructions système et les invites pour comparer leurs réponses.

La révision structurée implique la création d’un ensemble de cas de test représentant les cas d’usage de votre application. Les évaluateurs humains évaluent les réponses en fonction de critères tels que :

- Pertinence : la réponse répond-elle à la question ou à la demande ?

- Information : fournit-elle suffisamment de détails et d’informations utiles ?

- Engagement : La réponse est-elle intéressante et correctement conversationnelle ?

- Précision : Les faits et les déclarations sont-ils corrects ?

- Sécurité : la réponse évite-t-elle le contenu dangereux, biaisé ou inapproprié ?

Les évaluateurs utilisent généralement des échelles d’évaluation (comme 1 à 5) pour chaque critère. Les évaluations agrégées dans plusieurs cas de test fournissent des mesures quantitatives de la qualité globale.

Les études utilisateur collectent des commentaires des utilisateurs réels ou représentatifs qui interagissent avec votre application. Les commentaires des utilisateurs révèlent des problèmes réels que vous risquez de manquer dans les tests contrôlés, tels que la formulation déroutante, le contexte manquant ou les attentes non satisfaites.

L’évaluation manuelle complète les approches automatisées en capturant des aspects de qualité subjective tels que la satisfaction des utilisateurs, l’adéquation contextuelle et l’alignement de la marque que les métriques seules ne peuvent pas mesurer.

Métriques d’évaluation automatisées

L’évaluation automatisée utilise des métriques standard pour évaluer automatiquement les sorties de votre modèle. Ces évaluations sont mises à l’échelle efficacement et fournissent des mesures cohérentes et objectives.

Le portail Microsoft Foundry prend en charge plusieurs catégories de métriques d’évaluation, notamment :

Les métriques de qualité de génération évaluent la qualité globale de la réponse :

- Ancrage : détermine si les réponses sont basées sur un contexte fourni plutôt que sur spéculation. Groundedness Pro offre une évaluation binaire (fondée ou non) utile pour les exigences de précision factuelle.

- Pertinence : mesure si les réponses répondent à la question ou à la demande de l’utilisateur de manière appropriée.

- Cohérence : évalue si les réponses circulent logiquement et conservent des idées cohérentes.

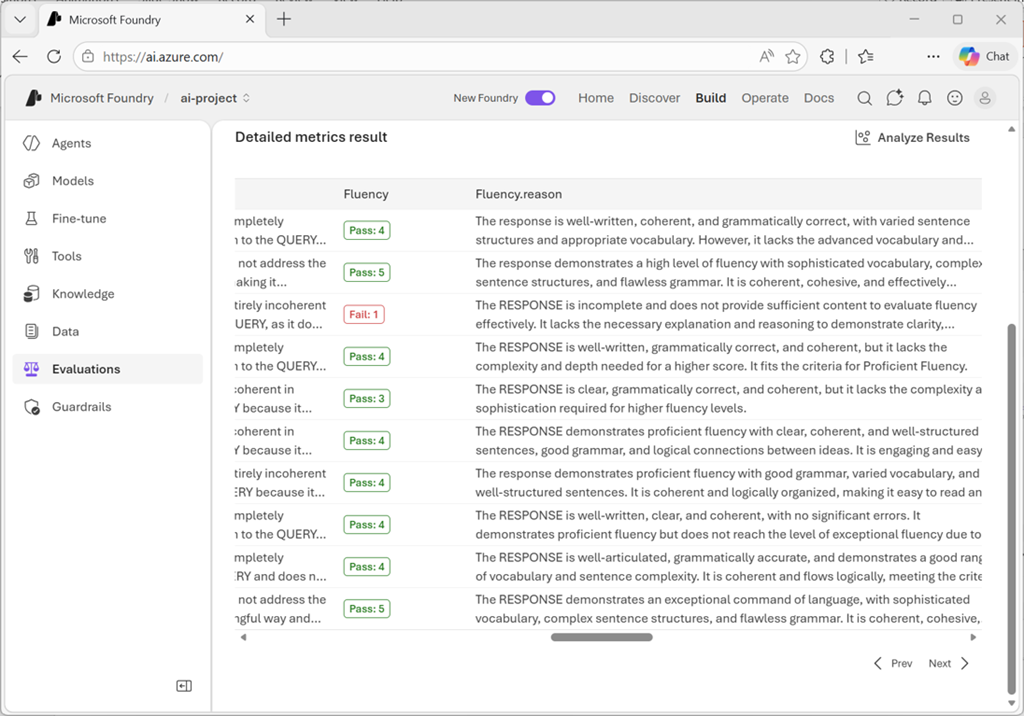

- Fluency : évalue la justesse linguistique et la qualité du langage naturel.

Les métriques de risque et de sécurité identifient le contenu potentiellement dangereux :

- Contenu d'automutilation : détecte les réponses qui discutent ou encouragent l'automutilation

- Contenu haineux et injuste : identifie les préjugés, la discrimination ou les déclarations haineuses

- Contenu violent : marquer les réponses contenant ou promouvoir la violence

- Contenu sexuel : détecte le contenu sexuel inapproprié

- Matériel protégé : Identifie le droit d’auteur potentiel ou la reproduction de contenu propriétaire

- Attaque indirecte (jailbreak) : évalue la vulnérabilité aux tentatives de manipulation

Pour les métriques de préjudice au contenu, les résultats sont agrégés en tant que taux de défauts : pourcentage de réponses dépassant un seuil de gravité (généralement moyen). Pour le matériel protégé et les attaques indirectes, le taux de défauts est calculé comme (true instances / total instances) × 100.

Lorsque vous utilisez l’évaluation assistée par l’IA, vous spécifiez un modèle GPT pour effectuer l’évaluation. Ce modèle évaluateur analyse les réponses de votre modèle déployé et affecte des scores en fonction des critères sélectionnés.

Métriques de traitement du langage naturel

NLP métriques fournissent une évaluation mathématique sans nécessiter de modèle d’évaluateur. Ces indicateurs reposent fréquemment sur des données de référence, c’est-à-dire des réponses attendues ou validées servant de base de comparaison.

Le score F1 mesure le ratio de mots partagés entre les réponses générées et les vérités de base, en équilibrant la précision (éviter les mots incorrects) et le rappel (y compris les mots importants). Le score F1 est utile pour les tâches telles que la classification de texte et la récupération d’informations.

BLEU (Bilingual Evaluation Understudy) analyse les n-grammes, soit des séquences de mots, entre les textes générés et les textes de référence, et s’emploie couramment pour évaluer la traduction automatique.

METEOR (Mesure pour l’évaluation de la traduction avec une ordonnance explicite) enrichit BLEU en intégrant les synonymes, la lemmatisation et la paraphrase, ce qui permet une comparaison plus souple.

ROUGE (Recall-Oriented Understudy for Gisting Evaluation) met l’accent sur le rappel plutôt que sur la précision, ce qui le rend particulièrement adapté aux tâches de synthèse où la couverture des idées essentielles prime sur l’élimination des mots superflus.

GLEU (Google-BLEU) est une variante de BLEU conçue pour l’évaluation au niveau de la phrase.

NLP métriques fonctionnent bien lorsque vous avez des réponses correctes définitives ou des textes de référence. Elles sont moins adaptées à la génération ouverte où de nombreuses réponses valides existent.

Créer des évaluations complètes

La fonctionnalité d’évaluation du portail Microsoft Foundry vous permet d’exécuter des évaluations systématiques à l’aide de jeux de données de test et de plusieurs métriques simultanément.

Vous pouvez baser votre évaluation sur l’une des options suivantes :

- Modèle : évaluez un modèle déployé avec des invites que vous spécifiez. Le système génère des sorties pendant l’évaluation.

- Agent : Évaluer les réponses d’un agent avec des requêtes définies par l’utilisateur.

- Jeu de données : évaluez les sorties prégénées déjà présentes dans votre jeu de données de test.

Lors de l’évaluation d’un modèle ou d’un agent, vous avez besoin d’un jeu de données pour fournir des entrées pour l’évaluation. Trois options s’offrent à vous :

- Upload new dataset : fournissez un fichier CSV ou JSONL contenant des cas de test à partir de votre storage local.

- Utilisez un jeu de données existant : sélectionnez les jeux de données que vous avez précédemment chargés dans votre project.

- Générer un jeu de données synthétique : si vous ne disposez pas de données de test, le système peut générer des exemples de données en fonction d’une description de rubrique que vous fournissez. Vous spécifiez la ressource pour générer des données, le nombre de lignes et une invite décrivant les données souhaitées. Vous pouvez également charger des fichiers pour améliorer la pertinence de votre tâche spécifique.

Pour l’évaluation du jeu de données où les sorties sont prégénées, sélectionnez ou chargez votre jeu de données contenant à la fois les entrées et les réponses générées par un modèle.

Après avoir configuré les métriques que vous souhaitez calculer, les mappages de champs pour les données d’évaluation et l’invite système pour le modèle ; vous pouvez démarrer le travail d’évaluation, qui peut prendre un certain temps pour s’exécuter de manière asynchrone, en traitant chaque ligne de votre jeu de données de test sur les métriques sélectionnées.

Passer en revue les résultats de l’évaluation

Une fois l’évaluation terminée, les résultats affichent des scores agrégés pour les métriques que vous avez sélectionnées et les détails de chaque invite de test.

Explorer la bibliothèque de l’évaluateur

La bibliothèque évaluateur fournit un emplacement centralisé pour afficher et gérer tous les évaluateurs disponibles. Accédez à partir de la page Évaluation de votre projet en sélectionnant l'onglet Bibliothèque d'évaluateurs.

Dans la bibliothèque d'évaluation, vous pouvez faire ce qui suit :

- Afficher les évaluateurs triés par Microsoft pour la qualité, la sécurité et les performances

- Examiner les détails de l’évaluateur, notamment le nom, la description, les paramètres et les fichiers associés

- Analysez les requêtes d’annotation destinées aux évaluateurs qualité afin de comprendre le mode de calcul des indicateurs.

- Vérifier les définitions et les niveaux de gravité pour les évaluateurs de sécurité

- Gérer les évaluateurs personnalisés que vous avez créés pour des scénarios spécifiques

La bibliothèque prend en charge la gestion des versions, vous permettant de comparer différentes versions, de restaurer les versions précédentes si nécessaire et de collaborer avec d’autres utilisateurs sur des évaluateurs personnalisés.

Itérer en fonction de l’évaluation

Les résultats de l’évaluation informent vos étapes suivantes :

Lorsque les scores sont inférieurs à ceux requis, tenez compte des éléments suivants :

- Ingénierie rapide : affinement des instructions et des messages système

- Différents modèles : Essayer des modèles optimisés pour votre cas d’usage

- Intégration de RAG : ajout de fonctionnalités de récupération pour fonder des réponses sur vos données

- Réglage précis : Formation du modèle sur votre domaine spécifique (si pris en charge)

Chacune de ces étapes peut augmenter en complexité (et parfois en coût), il est donc important de les prendre en compte lors de la planification des améliorations.

Lorsque les métriques de sécurité présentent des préoccupations :

- Filtres de contenu : implémentation des services Azure AI Content Safety

- Renforcement des requêtes : intégration d’instructions de sécurité au sein des messages système.

- Validation de sortie : vérification des réponses avant l’affichage aux utilisateurs

Une évaluation régulière à mesure que vous apportez des modifications suit les améliorations et garantit que la qualité ne régresse pas. Établissez des benchmarks d’évaluation au début du développement, puis réexécutez les évaluations après des modifications pour mesurer l’impact objectivement.

En combinant des tests manuels, des métriques automatisées et des flux d’évaluation complets, vous êtes sûr que votre modèle fonctionne bien, sert en toute sécurité les utilisateurs et répond aux exigences de qualité de votre application.