Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Importante

Questa pagina illustra il nuovo gateway di intelligenza artificiale (visibile nel riquadro di spostamento sinistro dell'interfaccia utente), attualmente in versione beta. Gli amministratori dell'account possono abilitare l'accesso a questa funzionalità nella pagina Anteprime della console dell'account. Consultare Gestisci anteprime Azure Databricks.

Per informazioni dettagliate sulla versione precedente di Unity AI Gateway, vedere Unity AI Gateway per la gestione degli endpoint.

Annotazioni

Unity AI Gateway non è supportato in AWS GovCloud o Azure per enti pubblici.

Che cos'è Unity AI Gateway?

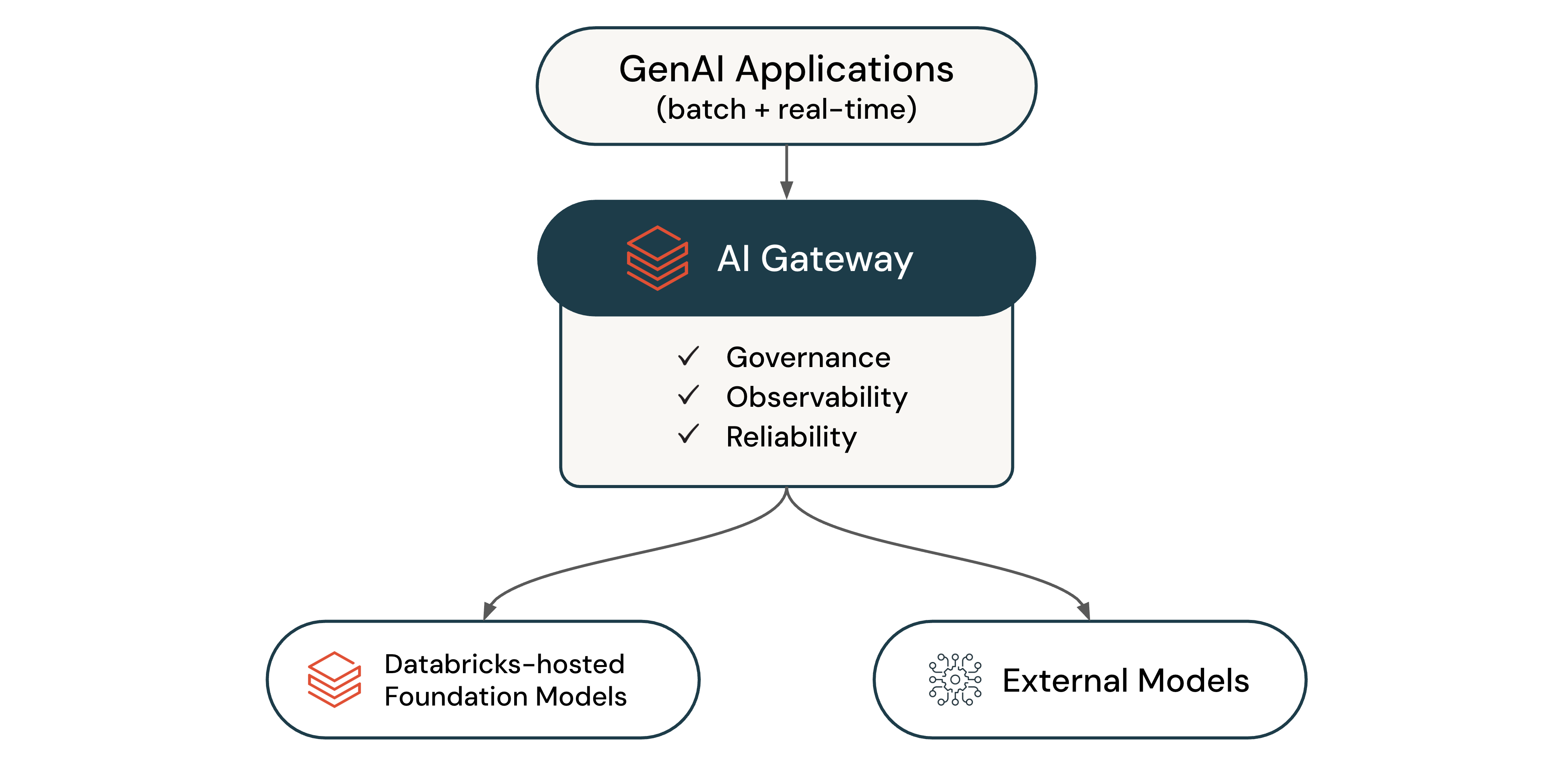

Unity AI Gateway è il piano di controllo aziendale per la governance di endpoint, agenti e strumenti di codifica LLM. Usarlo per analizzare l'utilizzo, configurare le autorizzazioni e gestire la capacità tra i provider.

Con Unity AI Gateway è possibile:

- Analizzare il modo in cui i modelli di linguaggio di grandi dimensioni, gli agenti e gli strumenti di codifica vengono usati nella tua organizzazione

- Governa l'accesso ai modelli ospitati su Azure Databricks ed esterni

- Accedi il traffico LLM tra tutti gli endpoint su Unity Catalog

- Monitorare l'integrità degli endpoint e la disponibilità del fornitore

- Applicare limiti di velocità e protezioni

- Attribuire i costi a endpoint, utenti e team specifici

- Instradare il traffico in modo intelligente tra provider per l'affidabilità e il bilanciamento del carico

- Suddividere il traffico tra più back-end del modello per la scalabilità

- Cambiare provider e modelli senza modifiche al codice

Funzionalità supportate

La tabella seguente definisce le funzionalità disponibili del Unity AI Gateway:

| Caratteristica / Funzionalità | Descrzione |

|---|---|

| Permissions | Controllare chi può accedere agli endpoint. |

| Rilevamento dell'utilizzo | Monitorare l'utilizzo e i costi usando le tabelle di sistema. |

| tabelle di inferenza | Monitorare e controllare le richieste e le risposte nelle tabelle Delta del catalogo Unity. |

| Metriche operative | Monitorare l'utilizzo in tempo reale. |

| Limiti di frequenza | Applicare limiti di consumo a livello di endpoint, utente o gruppo. |

| Guardrail | Applicare il filtro del contenuto, la protezione dei dati sensibili e i criteri personalizzati. |

| Attribuzione dei costi | Tenere traccia dei costi a un livello granulare per endpoint, utente e team usando i tag endpoint e request. |

| Fallbacks | Aumentare l'affidabilità eseguendo il routing a più provider in caso di errori. |

| Suddivisione del traffico | Distribuire il traffico tra più back-end del modello per una migliore scalabilità e bilanciamento del carico. |

| API personalizzate | Gestire API personalizzate ed esterne con gli stessi controlli di accesso, limiti di frequenza e registrazione degli endpoint LLM. |

Annotazioni

Le funzionalità di Unity AI Gateway non comportano addebiti durante il Beta.

Usare Unity AI Gateway

Azure Databricks fornisce endpoint del gateway di intelligenza artificiale Unity per i sistemi LLM più diffusi. È possibile creare nuovi endpoint per gestire agenti, strumenti di codifica e altre applicazioni.

Per iniziare, vedere Configurare gli endpoint del gateway di intelligenza artificiale unity. Per eseguire query sugli endpoint, vedere Eseguire query sugli endpoint del gateway di intelligenza artificiale unity. Per integrare agenti di codifica come Cursor, Gemini CLI, Codex CLI e Claude Code, vedere Integrazione con agenti di codifica. Per instradare le chiamate LLM dagli agenti creati e distribuiti in Databricks Apps tramite Unity AI Gateway, vedere Passaggio 4. Gestire l'utilizzo LLM dagli agenti in Databricks Apps con Unity AI Gateway.

Avvio rapido delle query

L'esempio seguente illustra come eseguire query su un endpoint del gateway di intelligenza artificiale Unity usando Python e il client OpenAI:

from openai import OpenAI

import os

# To get a Databricks token, see https://docs.databricks.com/dev-tools/auth/pat

DATABRICKS_TOKEN = os.environ.get('DATABRICKS_TOKEN')

client = OpenAI(

api_key=DATABRICKS_TOKEN,

base_url="https://<workspace-url>/ai-gateway/mlflow/v1"

)

chat_completion = client.chat.completions.create(

messages=[

{"role": "user", "content": "Hello!"},

{"role": "assistant", "content": "Hello! How can I assist you today?"},

{"role": "user", "content": "What is Databricks?"},

],

model="databricks-gpt-5-2",

max_tokens=256

)

print(chat_completion.choices[0].message.content)

Sostituire <workspace-url> con l'URL dell'area di lavoro Azure Databricks.

Passaggi successivi

- Configurare gli endpoint del gateway di intelligenza artificiale Unity

- Eseguire query sugli endpoint del Gateway di Intelligenza Artificiale Unity

- Integrazione con agenti di codifica

- Gestire gli agenti nelle app Databricks

- Monitorare l'utilizzo per gli endpoint del Gateway AI di Unity

- Monitorare i modelli usando le tabelle di inferenza

- Configurare i limiti di frequenza per gli endpoint del Gateway AI di Unity