Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Importante

Gli elementi contrassegnati (anteprima) in questo articolo sono attualmente in anteprima pubblica. Questa anteprima viene fornita senza un contratto di servizio e non è consigliabile per i carichi di lavoro di produzione. Alcune funzionalità potrebbero non essere supportate o potrebbero avere funzionalità limitate. Per altre informazioni, vedere Condizioni supplementari per l'utilizzo delle anteprime di Microsoft Azure.

Questa GitHub Action abilita la valutazione offline di Microsoft Foundry Agents all'interno delle pipeline CI/CD. Semplifica il processo di valutazione offline, in modo da poter identificare potenziali problemi e apportare miglioramenti prima di rilasciare un aggiornamento all'ambiente di produzione.

Per usare questa azione, fornire un set di dati con query di test e un elenco di analizzatori. Questa azione richiama gli agenti con le query, esegue le valutazioni e genera un report di riepilogo.

Caratteristiche

- Agent Evaluation: Automatizza la valutazione pre-produzione degli agenti della Microsoft Foundry nel flusso di lavoro CI/CD.

- Valutatori: usare qualsiasi valutatore del catalogo dei valutatori di Foundry.

- Analisi statistica: i risultati della valutazione includono intervalli di confidenza e test di significatività statistica per determinare se le modifiche sono significative e non a causa di variazioni casuali.

Categorie di analizzatori

- Valutatori di agenti: Valutatori di processo e a livello di sistema per i flussi di lavoro degli agenti.

- Analizzatori RAG: valutare i processi end-to-end e di recupero nei sistemi RAG.

- Analizzatori di rischi e sicurezza: valutare i rischi e i problemi di sicurezza nelle risposte.

- Analizzatori per utilizzo generico: valutazione della qualità, ad esempio coerenza e fluenza.

- Classificatori basati su OpenAI: usare i classificatori OpenAI, tra cui controllo delle stringhe, somiglianza del testo, modello score/label.

- Analizzatori personalizzati: definire gli analizzatori personalizzati usando Python codice o modelli LLM-as-a-judge.

Prerequisiti

- Un progetto. Per altre informazioni, vedere Creare un progetto.

- Agente Foundry.

Suggerimento

Il modo consigliato per eseguire l'autenticazione consiste nell'usare Microsoft Entra ID, che è possibile usare per connettersi in modo sicuro alle risorse Azure. È possibile automatizzare il processo di autenticazione usando l'azione Azure Login GitHub. Per altre informazioni, vedere Azure Azione di accesso con OpenID Connect.

Come configurare le valutazioni degli agenti di intelligenza artificiale

Input delle valutazioni dell'agente IA

Parametri

| Nome | Obbligatorio? | Descrizione |

|---|---|---|

| azure-ai-project-endpoint | Sì | Endpoint del progetto Microsoft Foundry Project. Per trovare questo valore, apri il progetto nel portale Foundry e copia l'endpoint dalla pagina Panoramica. |

| deployment-name | Sì | Nome di una distribuzione del modello di intelligenza artificiale Azure da usare per la valutazione. Trovare le distribuzioni esistenti in Modelli + endpoint nel portale Foundry. |

| percorso dati | Sì | Percorso del file di dati contenente gli analizzatori e le query di input per le valutazioni. |

| agent-ids | Sì | ID di uno o più agenti da valutare in formato agent-name:version (ad esempio, my-agent:1 o my-agent:1,my-agent:2). Più agenti sono separati da virgole e confrontati con i risultati dei test statistici. |

| baseline-agent-id | No | ID dell'agente di base da confrontare durante la valutazione di più agenti. Se non specificato, viene usato il primo agente. |

Nota

Per trovare l'ID agente e la versione, aprire il progetto nel portale foundry, passare ad Agenti, selezionare l'agente e copiare l'ID agente dal riquadro dei dettagli. La versione è il numero di versione della distribuzione , ad esempio my-agent:1.

File di dati

Il file di dati di input deve essere un file JSON con la struttura seguente:

| Campo | Digitare | Obbligatorio? | Descrizione |

|---|---|---|---|

| Nome | Stringa | Sì | Nome del set di dati di valutazione. |

| Valutatori | string[] | Sì | Elenco dei nomi dei valutatori da usare. Consultare l'elenco dei valutatori disponibili nel catalogo dei valutatori del progetto nel portale Foundry: Compilazione >Valutazioni >Catalogo dei valutatori. |

| Dati | oggetto[] | Sì | Matrice di oggetti di input con query e campi valutatore facoltativi come ground_truth, context. Mapping automatico ai valutatori; usare data_mapping per eseguire l'override. |

| openai_graders | Oggetto | No | Configurazione per analizzatori basati su OpenAI (label_model, score_model, string_check e così via). |

| parametri_valutatore | Oggetto | No | Parametri di inizializzazione specifici dell'analizzatore (ad esempio, soglie, impostazioni personalizzate). |

| mappatura dei dati | Oggetto | No | Mapping dei campi di dati personalizzati (generati automaticamente dai dati, se non forniti). |

File di dati di esempio di base

{

"name": "test-data",

"evaluators": [

"builtin.fluency",

"builtin.task_adherence",

"builtin.violence"

],

"data": [

{

"query": "Tell me about Tokyo disneyland"

},

{

"query": "How do I install Python?"

}

]

}

File di dati di esempio aggiuntivi

| Nome del file | Descrizione |

|---|---|

| dataset-tiny.json | Set di dati con un numero ridotto di query e valutatori di test. |

| dataset.json | Set di dati con tutti i tipi di analizzatori supportati e query sufficienti per il calcolo dell'intervallo di confidenza e il test statistico. |

| dataset-builtin-evaluators.json | Esempio di valutatori Foundry predefiniti (ad esempio coerenza, scorrevolezza, pertinenza, fondatezza, metriche). |

| dataset-openai-graders.json | Esempio di classificatori basati su OpenAI (modelli di etichetta, modelli di punteggio, somiglianza del testo, controlli stringa). |

| dataset-custom-evaluators.json | Esempio di analizzatori personalizzati con parametri dell'analizzatore. |

| dataset-data-mapping.json | Esempio di mapping dei dati che illustra come sostituire i mapping automatici dei campi con nomi di colonna di dati personalizzati. |

Flusso di lavoro di valutazione dell'agente di intelligenza artificiale

Per usare l'azione GitHub, aggiungere l'azione GitHub ai flussi di lavoro CI/CD. Specificare i criteri di trigger, ad esempio al commit, e i percorsi dei file per attivare i flussi di lavoro automatizzati.

Suggerimento

Per ridurre al minimo i costi, non eseguire la valutazione per ogni commit.

Questo esempio illustra come eseguire la valutazione dell'agente di intelligenza artificiale quando si confrontano agenti diversi usando gli ID agente.

name: "AI Agent Evaluation"

on:

workflow_dispatch:

push:

branches:

- main

permissions:

id-token: write

contents: read

jobs:

run-action:

runs-on: ubuntu-latest

steps:

- name: Checkout

uses: actions/checkout@v4

- name: Azure login using Federated Credentials

uses: azure/login@v2

with:

client-id: ${{ vars.AZURE_CLIENT_ID }}

tenant-id: ${{ vars.AZURE_TENANT_ID }}

subscription-id: ${{ vars.AZURE_SUBSCRIPTION_ID }}

- name: Run Evaluation

uses: microsoft/ai-agent-evals@v3-beta

with:

# Replace placeholders with values for your Foundry Project

azure-ai-project-endpoint: "<your-ai-project-endpoint>"

deployment-name: "<your-deployment-name>"

agent-ids: "<your-ai-agent-ids>"

data-path: ${{ github.workspace }}/path/to/your/data-file

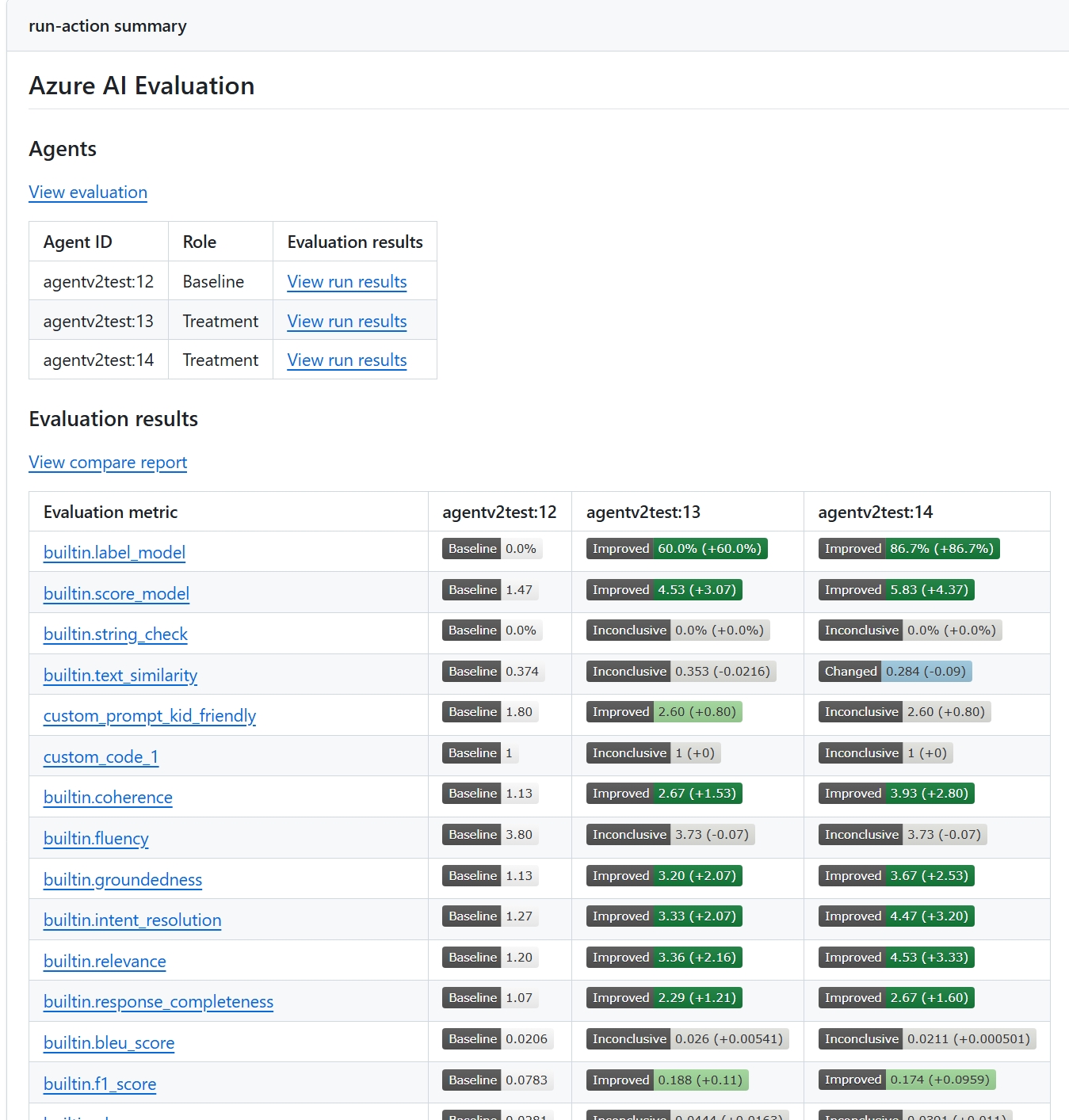

Output delle valutazioni dell'agente di intelligenza artificiale

I risultati di valutazione vengono pubblicati nella sezione riepilogo per ogni esecuzione di GitHub Action relativa alla valutazione dell'IA in Actions in GitHub. Il report mostra i punteggi di valutazione per ogni metrica, intervalli di confidenza e, quando si valutano più agenti, un confronto statistico a coppie che indica se le differenze sono significative o all'interno di variazioni casuali.

Lo screenshot seguente mostra un report di esempio che confronta due agenti.