Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

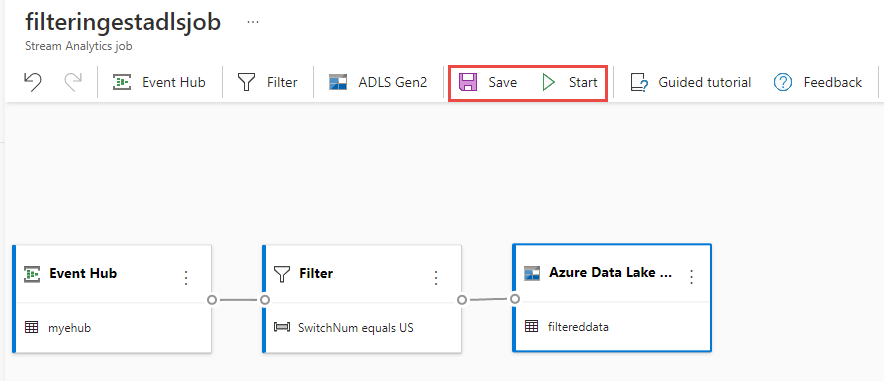

Questo articolo descrive come usare l'editor senza codice per creare con facilità un processo di Stream Analytics. Legge continuamente da Hub eventi, filtra i dati in ingresso e quindi scrive i risultati in modo continuo in Azure Data Lake Storage Gen2.

Prerequisiti

- Le risorse Hub eventi di Azure devono essere accessibili pubblicamente e non essere protette da un firewall o situate in una rete virtuale di Azure.

- I dati negli hub eventi devono essere serializzati in formato JSON, CSV o Avro.

Sviluppare un processo di Analisi di flusso per filtrare e inserire dati in tempo reale

Nel portale di Azure, individuare e selezionare l'istanza di Hub eventi di Azure.

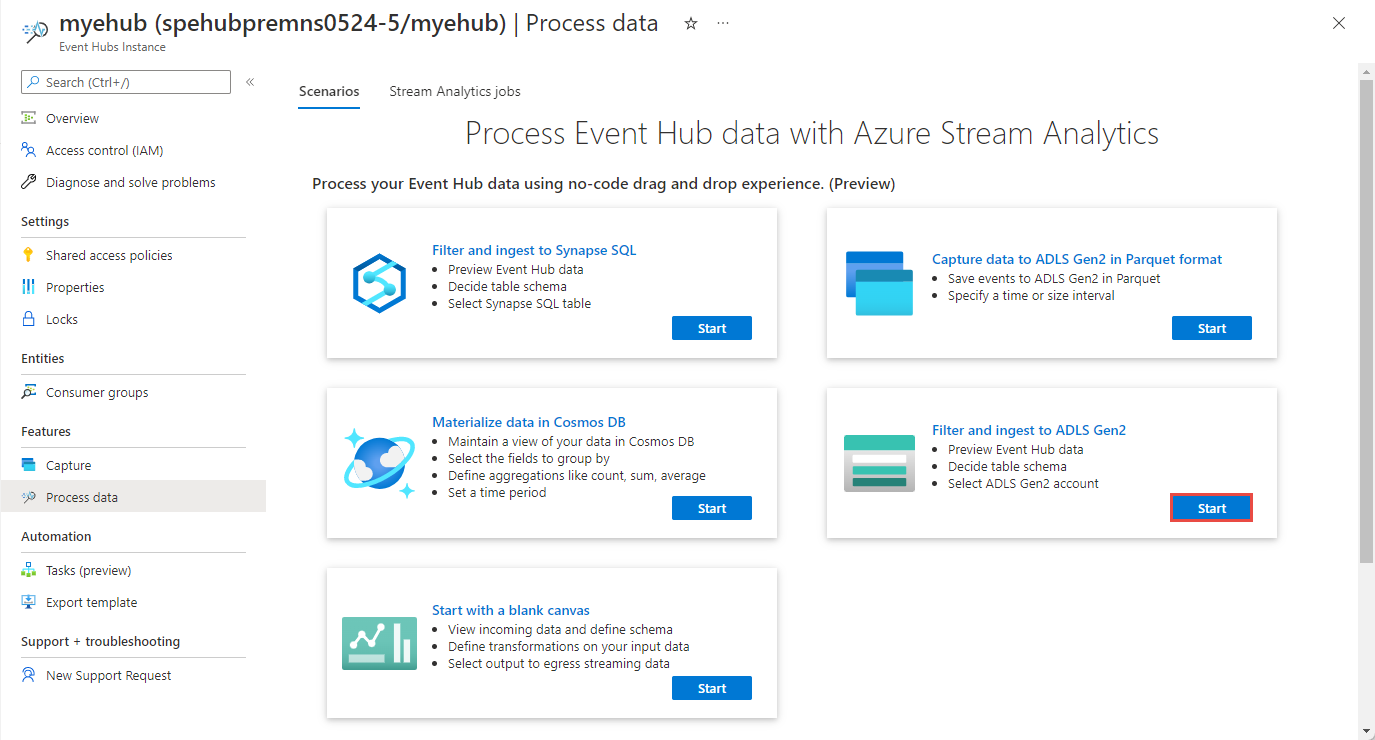

Selezionare Funzionalità>, Dati di Processo e quindi selezionare Avvia sulla scheda Filtro e inserimento in ADLS Gen2.

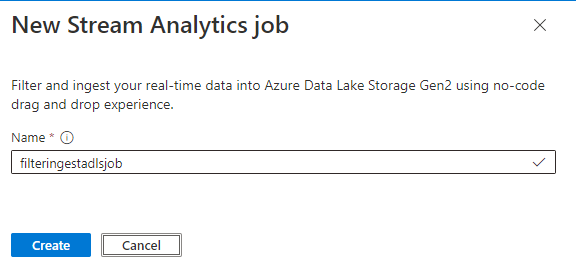

Immettere un nome per il processo di Analisi di flusso e quindi selezionare Crea.

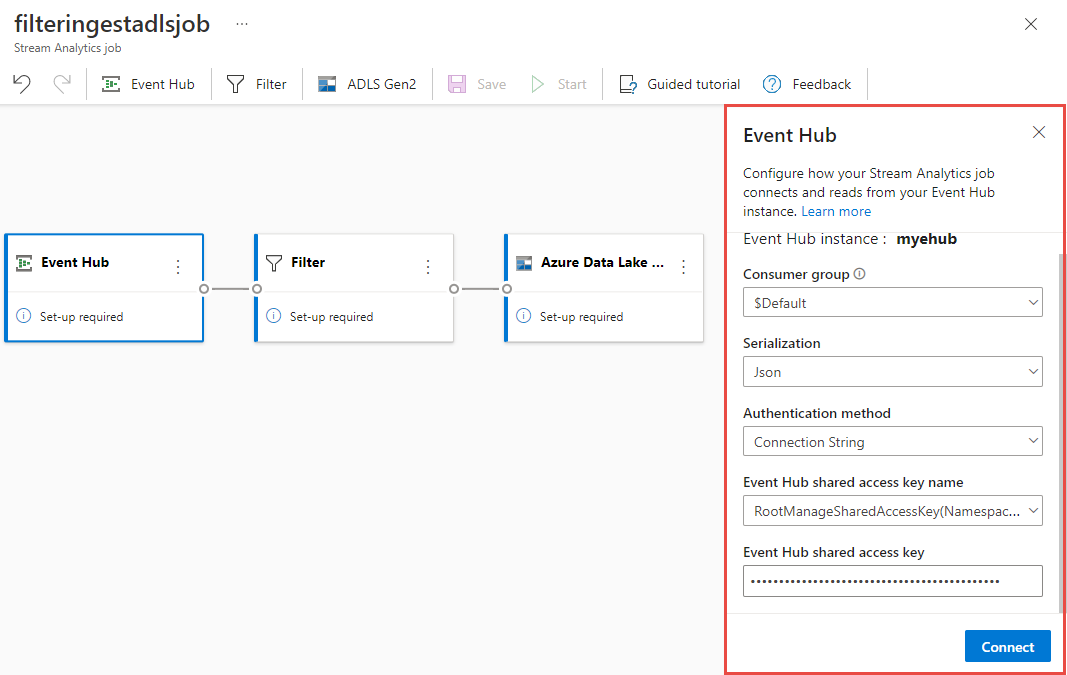

Specificare il tipo di serializzazione dei dati nella finestra hub eventi e il metodo di autenticazione che verrà usato dal processo per connettersi a Hub eventi. Selezionare Connetti.

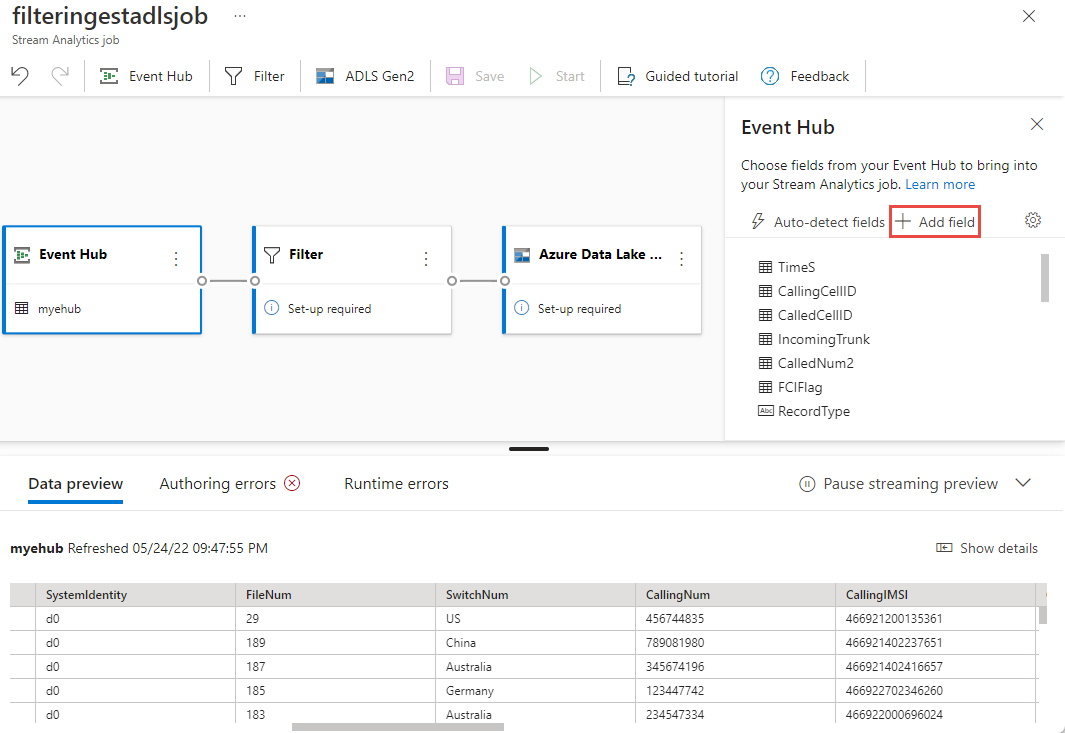

Se la connessione viene stabilita correttamente e si dispone di flussi di dati che passano all'istanza di Hub eventi, verranno immediatamente visualizzati due elementi:

- Campi presenti nei dati di input. È possibile scegliere Aggiungi campo o selezionare il simbolo a tre punti accanto a ogni campo per rimuovere, rinominare o modificarne il tipo.

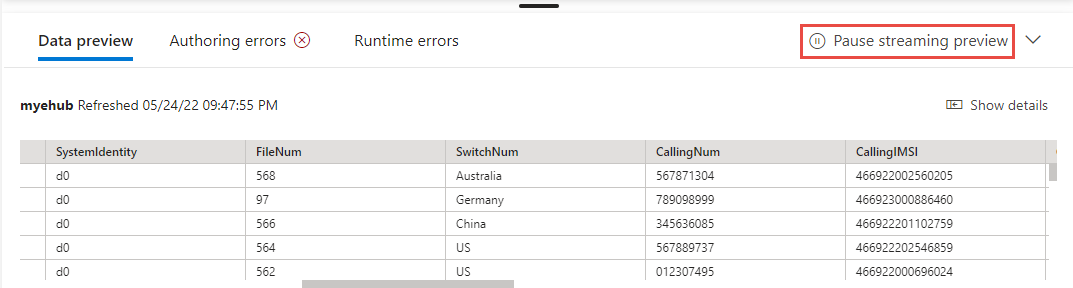

- Esempio in tempo reale di dati in ingresso nella visualizzazione a diagramma nella Anteprima dei dati. Viene aggiornato automaticamente periodicamente. È possibile selezionare Sospendi anteprima streaming per visualizzare una visualizzazione statica dei dati di input di esempio.

- Campi presenti nei dati di input. È possibile scegliere Aggiungi campo o selezionare il simbolo a tre punti accanto a ogni campo per rimuovere, rinominare o modificarne il tipo.

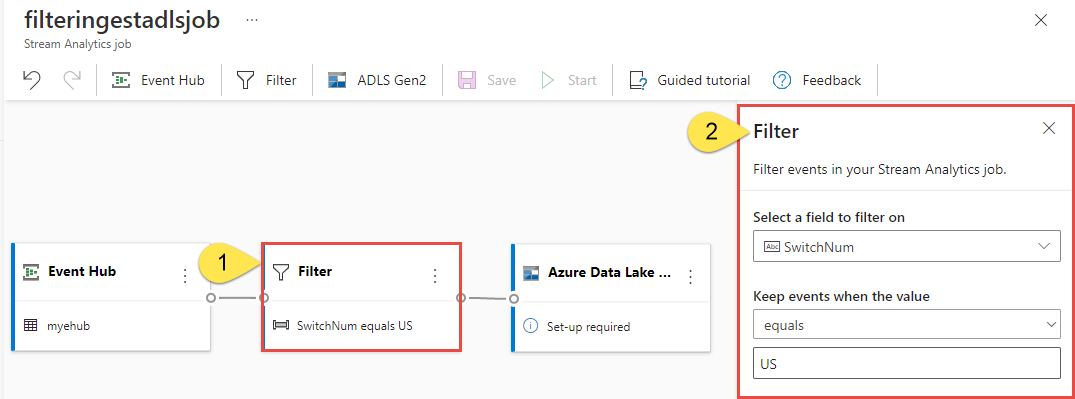

Selezionare il riquadro Filtro . Nell'area Filtro selezionare un campo per filtrare i dati in ingresso con una condizione.

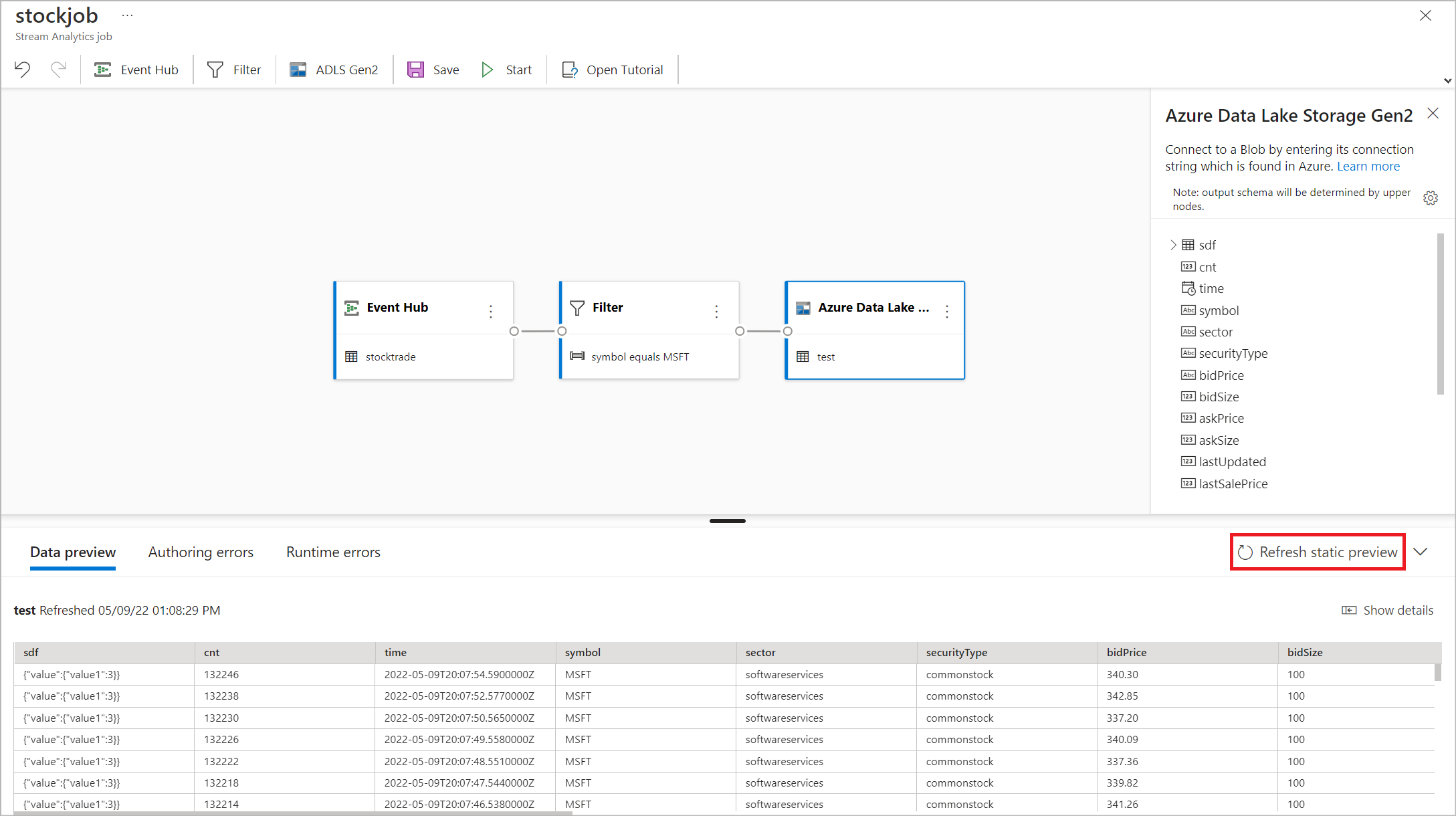

Seleziona il riquadro Azure Data Lake Storage Gen2. Selezionare l'account Azure Data Lake Gen2 per inviare i dati filtrati:

- Selezionare la sottoscrizione, il nome dell'account di archiviazione e il contenitore dal menu a discesa.

- Dopo aver selezionato la sottoscrizione, il metodo di autenticazione e la chiave dell'account di archiviazione devono essere compilati automaticamente. Selezionare Connetti.

Per ulteriori informazioni sui campi e per visualizzare esempi di pattern del percorso, vedere Archiviazione BLOB e output di Azure Data Lake Gen2 da Analisi di flusso di Azure.

Facoltativamente, selezionare Recupera anteprima statica/Aggiorna anteprima statica per visualizzare l'anteprima dei dati che verrà inserita da Azure Data Lake Storage Gen2.

Selezionare Salva e quindi avviareil processo di Analisi di flusso.

Per avviare l'operazione, specifica il numero di unità di streaming (SUs) con cui viene eseguita l'operazione. Le unità di streaming rappresentano la quantità di calcolo e memoria allocata al processo. È consigliabile iniziare con tre e quindi regolare in base alle esigenze.

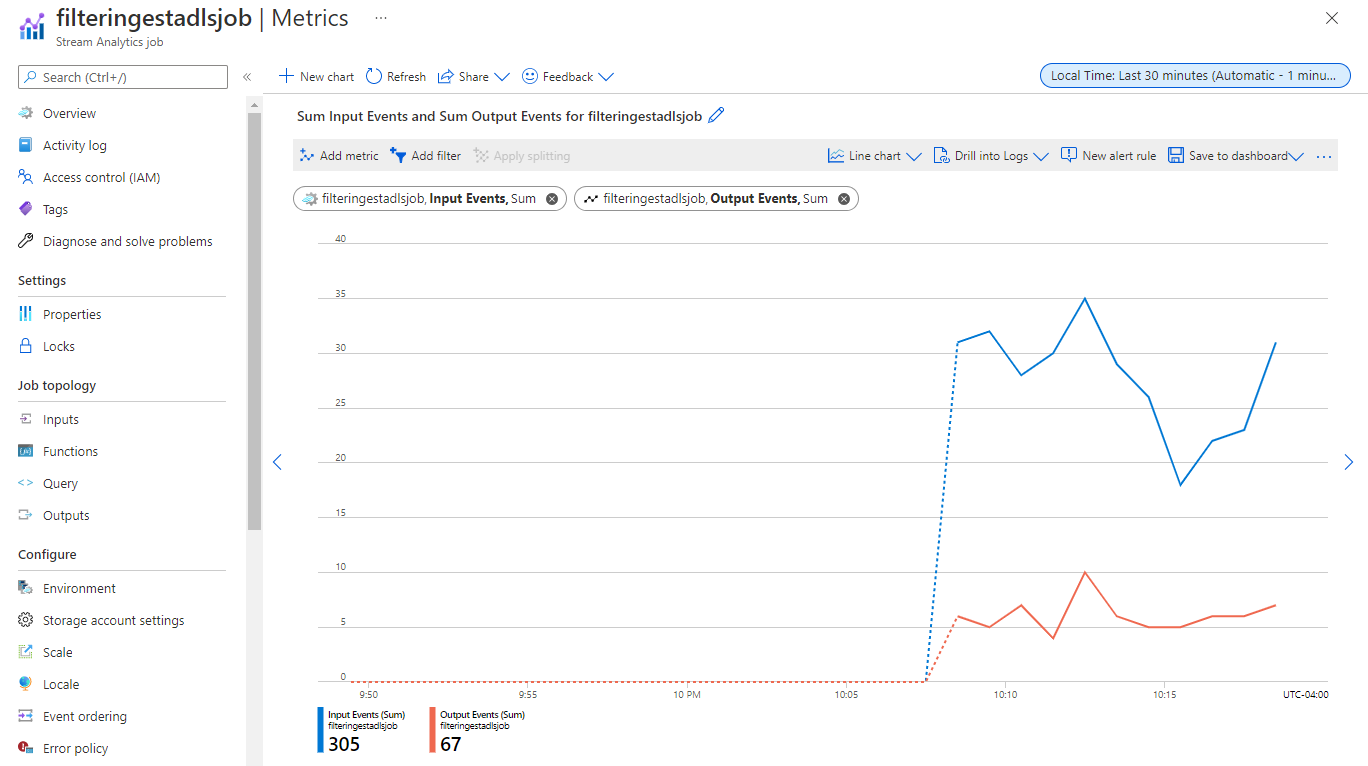

Dopo aver selezionato Avvia, il processo viene avviato entro due minuti e le metriche verranno aperte nella sezione della scheda seguente.

È possibile visualizzare il processo nella sezione Dati di processo nella scheda Processi di analisi del flusso. Selezionare Aggiorna finché non si vede lo stato del processo come In esecuzione. Selezionare Apri metriche per monitorarlo o arrestarlo e riavviarlo in base alle esigenze.

Ecco una pagina delle metriche di esempio:

Verificare i dati nel Data Lake Storage

Verranno visualizzati i file creati nel contenitore specificato.

Scaricare e aprire il file per confermare che vengono visualizzati solo i dati filtrati. Nell'esempio seguente i dati con SwitchNum sono impostati su US.

{"RecordType":"MO","SystemIdentity":"d0","FileNum":"548","SwitchNum":"US","CallingNum":"345697969","CallingIMSI":"466921402416657","CalledNum":"012332886","CalledIMSI":"466923101048691","DateS":"20220524","TimeType":0,"CallPeriod":0,"ServiceType":"S","Transfer":0,"OutgoingTrunk":"419","MSRN":"1416960750071","callrecTime":"2022-05-25T02:07:10Z","EventProcessedUtcTime":"2022-05-25T02:07:50.5478116Z","PartitionId":0,"EventEnqueuedUtcTime":"2022-05-25T02:07:09.5140000Z", "TimeS":null,"CallingCellID":null,"CalledCellID":null,"IncomingTrunk":null,"CalledNum2":null,"FCIFlag":null} {"RecordType":"MO","SystemIdentity":"d0","FileNum":"552","SwitchNum":"US","CallingNum":"012351287","CallingIMSI":"262021390056324","CalledNum":"012301973","CalledIMSI":"466922202613463","DateS":"20220524","TimeType":3,"CallPeriod":0,"ServiceType":"V","Transfer":0,"OutgoingTrunk":"442","MSRN":"886932428242","callrecTime":"2022-05-25T02:07:13Z","EventProcessedUtcTime":"2022-05-25T02:07:50.5478116Z","PartitionId":0,"EventEnqueuedUtcTime":"2022-05-25T02:07:12.7350000Z", "TimeS":null,"CallingCellID":null,"CalledCellID":null,"IncomingTrunk":null,"CalledNum2":null,"FCIFlag":null} {"RecordType":"MO","SystemIdentity":"d0","FileNum":"559","SwitchNum":"US","CallingNum":"456757102","CallingIMSI":"466920401237309","CalledNum":"345617823","CalledIMSI":"466923000886460","DateS":"20220524","TimeType":1,"CallPeriod":696,"ServiceType":"V","Transfer":1,"OutgoingTrunk":"419","MSRN":"886932429155","callrecTime":"2022-05-25T02:07:22Z","EventProcessedUtcTime":"2022-05-25T02:07:50.5478116Z","PartitionId":0,"EventEnqueuedUtcTime":"2022-05-25T02:07:21.9190000Z", "TimeS":null,"CallingCellID":null,"CalledCellID":null,"IncomingTrunk":null,"CalledNum2":null,"FCIFlag":null}

Considerazioni sull'uso della funzionalità di replica geografica di Hub eventi

Gli hub eventi di Azure hanno recentemente lanciato la funzionalità di replica geografica in anteprima pubblica. Questa funzionalità è diversa dalla funzionalità ripristino di emergenza geografico di Hub eventi di Azure.

Quando il tipo di failover è Forzato e la coerenza della replica è asincrona, il processo Stream Analytics non garantisce l'output esattamente una volta su un output Hub eventi di Azure.

Analisi di flusso di Azure, come producer con un output di un hub eventi, potrebbe osservare un ritardo limite nel processo durante la durata del failover e durante la limitazione da parte di Hub eventi nel caso in cui il ritardo di replica tra primario e secondario raggiunga il ritardo massimo configurato.

Analisi di flusso di Azure, come consumer con Hub eventi come input, potrebbe osservare un ritardo del watermark nel processo durante il failover e potrebbe saltare alcuni dati o trovare dati duplicati al termine del failover.

A causa di queste avvertenze, riavviare il processo di Analisi di flusso con l'ora di inizio appropriata subito dopo il completamento del failover di Hub eventi. Inoltre, poiché la funzionalità di replica geografica di Hub eventi è in anteprima pubblica, non usare questo modello per i processi di Analisi di flusso di produzione a questo punto. Il comportamento corrente di Stream Analytics migliorerà prima che la funzionalità di replica geografica di Event Hubs diventi generalmente disponibile e possa essere usata nei processi di produzione di Stream Analytics.

Passaggi successivi

Ulteriori informazioni su Analisi di flusso di Azure e su come monitorare il processo che hai creato.