Valutare e confrontare i modelli

Al termine di un esperimento di Machine Learning automatizzato (AutoML), si vogliono esaminare i modelli sottoposti a training e decidere quale è stato eseguito meglio.

In Azure Machine Learning Studio è possibile selezionare un esperimento AutoML per esplorarne i dettagli.

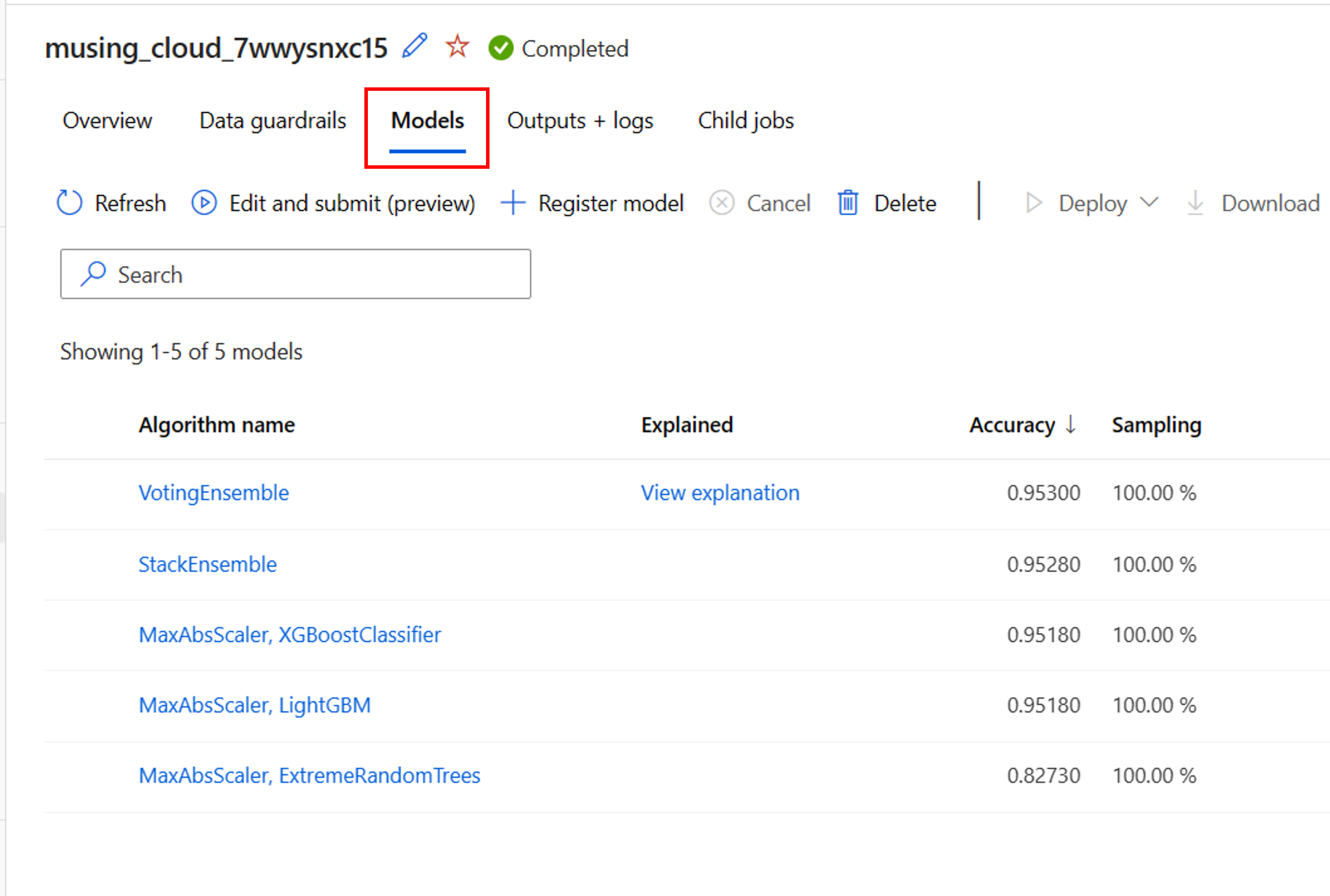

Nella pagina Panoramica dell'esecuzione dell'esperimento AutoML è possibile esaminare l'asset di dati di input e il riepilogo del modello migliore. Per esplorare tutti i modelli sottoposti a training, è possibile selezionare la scheda Modelli :

Esplorare i passaggi di pre-elaborazione

Quando è stata abilitata la definizione delle funzionalità per l'esperimento AutoML, anche le protezioni dei dati vengono applicate automaticamente. I tre tipi di protezione dati supportati per i modelli di classificazione sono:

- Rilevamento bilanciamento classi.

- Imputazione dei valori delle funzionalità mancanti.

- Rilevamento delle caratteristiche a cardinalità elevata.

Ognuna di queste barriere di protezione dati mostra uno dei tre stati possibili.

- Superato: non sono stati rilevati problemi e non è necessaria alcuna azione.

- Operazione completata: le modifiche sono state applicate ai dati. È consigliabile esaminare le modifiche apportate da AutoML ai dati.

- Avviso: è stato rilevato un problema ma non è stato possibile risolverlo. È consigliabile esaminare i dati per risolvere il problema.

Accanto alle protezioni dei dati, AutoML può applicare tecniche di ridimensionamento e normalizzazione a ogni modello sottoposto a training. È possibile esaminare la tecnica applicata nell'elenco dei modelli in Nome algoritmo.

Ad esempio, il nome dell'algoritmo di un modello elencato può essere MaxAbsScaler, LightGBM.

MaxAbsScaler fa riferimento a una tecnica di ridimensionamento in cui ogni funzionalità viene ridimensionata in base al valore assoluto massimo.

LightGBM fa riferimento all'algoritmo di classificazione usato per eseguire il training del modello.

Recuperare l'esecuzione migliore e il relativo modello

Quando si esaminano i modelli in AutoML, è possibile identificare facilmente l'esecuzione migliore in base alla metrica primaria specificata. In Azure Machine Learning Studio i modelli vengono ordinati automaticamente per mostrare il modello con prestazioni migliori nella parte superiore.

Nella scheda Modelli dell'esperimento AutoML è possibile modificare le colonne se si desidera visualizzare altre metriche nella stessa panoramica. Creando una panoramica più completa che include varie metriche, può essere più semplice confrontare i modelli.

Per esplorare ulteriormente un modello, è possibile generare spiegazioni per ogni modello sottoposto a training. Quando si configura un esperimento AutoML, è possibile specificare che le spiegazioni devono essere generate per il modello con prestazioni migliori. Se tuttavia si è interessati all'interpretazione di un altro modello, è possibile selezionare il modello nella panoramica e selezionare Spiega modello.

Annotazioni

La spiegazione di un modello è un'approssimazione dell'interpretabilità del modello. In particolare, le spiegazioni stimano l'importanza relativa delle funzionalità nella funzionalità di destinazione (ciò che il modello sottoposto a training deve stimare). Altre informazioni sull'interpretazione del modello.

Suggerimento

Altre informazioni su come valutare le esecuzioni di AutoML.

AutoML offre un punto di partenza efficace: esegue ricerche su larga scala e presenta la migliore combinazione di algoritmi e pre-elaborazione per i dati. Ma a volte si vuole andare oltre: regolare gli iperparametri, progettare funzionalità personalizzate o testare un approccio che AutoML non copre. Ecco dove arrivano i notebook.