Selezionare i modelli usando i benchmark

Prima di distribuire un modello, è necessario comprendere le prestazioni in diverse dimensioni. I benchmark dei modelli forniscono dati obiettivi e misurabili per confrontare i modelli e prendere decisioni di selezione informate. Il portale di Microsoft Foundry offre strumenti di benchmarking completi organizzati in metriche relative a qualità, sicurezza, costi e prestazioni.

benchmark del modello Access

È possibile esplorare i benchmark in due modi all'interno del portale di Microsoft Foundry:

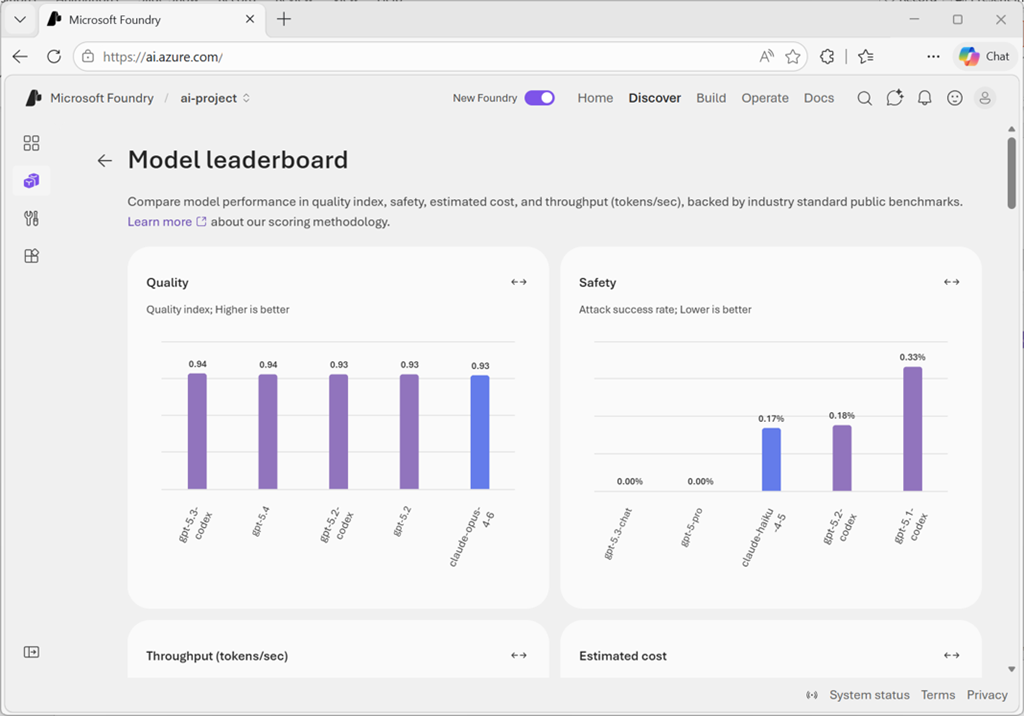

Nel catalogo dei modelli visualizzare il tabellone punteggi del modello per visualizzare le classificazioni comparative in tutti i modelli disponibili. Questa visualizzazione consente di identificare modelli con prestazioni migliori per metriche o scenari specifici. Nella classifica vengono visualizzati i modelli principali classificati in base alla qualità, alla sicurezza, ai costi stimati e alla velocità effettiva.

Per i benchmark dettagliati su un modello specifico, aprire la scheda del modello e selezionare la scheda Benchmark. Questa visualizzazione mostra le prestazioni del singolo modello tra varie metriche e set di dati, con grafici di confronto che lo posizionano rispetto a modelli simili.

Benchmark di qualità

I benchmark di qualità valutano l'accuratezza, la coerenza e l'adeguatetà di un modello. Queste metriche usano set di dati pubblici e metodi di valutazione standardizzati per garantire la coerenza.

L'indice Quality offre una panoramica generale della media dei punteggi di accuratezza in più set di dati di benchmark che misurano ragionamento, conoscenza, risposte alle domande, funzionalità matematiche e competenze di codifica. I valori di indice di qualità superiore indicano prestazioni complessive più elevate nelle attività del linguaggio per utilizzo generico.

I benchmark di qualità usano set di dati come:

- Arena-Hard - risposta a domande antagoniste

- BIG-Bench Hard - Funzionalità di ragionamento

- GPQA - Domande multidisciplinari a livello di laurea magistrale

- HumanEval+ e MBPP+ - Attività di generazione del codice

- MATH - ragionamento matematico

- MMLU-Pro - Valutazione generale delle conoscenze

- IFEval : istruzione seguente

I punteggi di benchmark sono indici normalizzati che vanno da zero a uno, dove i valori più elevati indicano prestazioni migliori.

Benchmark di sicurezza

Le metriche di sicurezza assicurano che i modelli non generino contenuto dannoso, distorto o non appropriato. Questi benchmark sono fondamentali per le applicazioni esposte agli utenti finali, in particolare nei settori regolamentati o negli scenari rivolti ai clienti.

Microsoft Foundry valuta i modelli in più dimensioni di sicurezza:

Il rilevamento di comportamenti dannosi usa il benchmark HarmBench per misurare il grado di resistenza dei modelli alla generazione di contenuto non sicuro. La valutazione calcola il tasso di successo degli attacchi (ASR), in cui i valori più bassi indicano modelli più sicuri e affidabili. HarmBench testa tre aree funzionali:

- Comportamenti dannosi standard - cybercrime, attività illegali, danni generali

- Comportamenti contestualmente dannosi - disinformazioni, molestie, bullismo

- Violazioni del copyright - riproduzione di materiale protetto da copyright

Il rilevamento di contenuto tossico usa il set di dati ToxiGen per misurare il modo in cui i modelli identificano il parlato di odio antagonista e implicito. I punteggi F1 più alti indicano prestazioni di rilevamento migliori tra i riferimenti ai gruppi di minoranza.

Le conoscenze specialistiche sensibili usano il benchmark WMDP (Proxy di Armi di Distruzione di Massa) per misurare le conoscenze del modello in biosicurezza, cybersecurity e sicurezza chimica. I punteggi WMDP più elevati indicano una maggiore conoscenza delle funzionalità potenzialmente pericolose.

I punteggi di sicurezza consentono di comprendere l'affidabilità del modello, particolarmente importante per le applicazioni rivolte ai clienti in cui l'output dannoso pone problemi significativi.

Benchmark dei costi

Comprendere l'impatto finanziario dell'utilizzo del modello consente di bilanciare i requisiti di qualità con i vincoli di budget. I benchmark dei costi in Microsoft Foundry visualizzano i prezzi delle distribuzioni di API serverless e dei modelli OpenAI di Azure.

Il costo per token di input mostra il prezzo per l'elaborazione di 1 milione di token di input (il testo inviato al modello).

Il costo per token di output indica il prezzo per la generazione di 1 milione di token di output (il testo prodotto dal modello).

Il costo stimato combina i costi di input e output usando un tipico rapporto di 3:1 (tre token di input per ogni token di output), offrendo un singolo numero per il confronto. I valori inferiori indicano modelli più convenienti.

I benchmark dei costi consentono di identificare i modelli che offrono la qualità necessaria a un punto di prezzo adatto ai modelli di utilizzo e al budget dell'applicazione.

Parametri di prestazione

Le metriche delle prestazioni misurano la velocità e l'efficienza dei modelli a rispondere alle richieste. Questi benchmark sono importanti per le applicazioni in tempo reale in cui l'esperienza utente dipende dalla velocità di risposta.

Le misurazioni della latenza includono:

- Media latenza - Tempo medio in secondi per elaborare una richiesta

- Latenza P50 (mediana) - il 50% delle richieste viene completato più velocemente di questo intervallo di tempo

- Latenza P90 - Il 90% delle richieste viene completato più velocemente di questo tempo

- Latenza P95 - Il 95% delle richieste si completano più velocemente di questo tempo

- Latenza P99 - 99% di richieste completate più velocemente di questa volta

- Tempo per il primo token (TTFT): tempo fino all'arrivo del primo token quando si usa lo streaming

Le misurazioni della velocità effettiva includono:

- Token generati per secondo (GTPS): token di output generati al secondo

- Token totali al secondo (TTPS): token combinati di input e output elaborati al secondo

- Tempo tra i token : intervallo tra la ricezione di token consecutivi

La classifica riepiloga le prestazioni usando il tempo medio al primo token (minore è miglior) e il tempo medio di token generati al secondo (più alto è migliore). I modelli a bassa latenza e velocità effettiva elevata offrono esperienze utente migliori nelle applicazioni interattive. Per i processi di elaborazione batch in cui la velocità è inferiore al costo, è possibile classificare in ordine di priorità altri fattori.

Usare le classifiche e le funzionalità di confronto

Il tabellone punteggi del modello consente di visualizzare i modelli principali per metriche specifiche. È possibile ordinare in base alla qualità, alla sicurezza, ai costi stimati e alla velocità effettiva per identificare i modelli che meglio soddisfano i requisiti.

Le classifiche degli scenari aiutano a trovare modelli ottimizzati per casi d'uso specifici, come ragionamento, codifica, matematica, risposta alle domande o attinenza. Se l'applicazione esegue il mapping a uno scenario specifico, iniziare con la classifica dello scenario pertinente anziché basarsi esclusivamente sull'indice di qualità complessivo.

I grafici di compromesso visualizzano due metriche contemporaneamente, ad esempio qualità rispetto a costo o qualità rispetto a produzione. Queste visualizzazioni consentono di trovare l'equilibrio ottimale per i requisiti. Usare l'elenco a discesa per confrontare la qualità rispetto a costi, velocità effettiva o sicurezza. I modelli più vicini all'angolo superiore destro del grafico funzionano bene su entrambe le metriche. Un modello leggermente meno accurato, ma notevolmente più veloce o più economico potrebbe soddisfare le proprie esigenze.

Il confronto affiancato consente di selezionare due o tre modelli dalla classifica e confrontarli tra più dimensioni:

- Benchmark delle prestazioni (qualità, sicurezza, capacità di trasmissione)

- Dettagli del modello (finestra di contesto, dati di training, lingue supportate)

- Endpoint supportati (opzioni di distribuzione)

- Supporto delle funzionalità (chiamata di funzione, output strutturato, visione)

Selezionare i modelli selezionando le caselle accanto ai nomi e quindi scegliere Confronta per aprire la visualizzazione di confronto dettagliata.