Che cos'è la regressione?

La regressione è una tecnica semplice, comune e estremamente utile per l'analisi dei dati, spesso definita "adattamento di una linea". Nella forma più semplice, la regressione si adatta a una linea retta tra una variabile (caratteristica) e un'altra (etichetta). In forme più complesse, la regressione può trovare relazioni non lineari tra una singola etichetta e più caratteristiche.

Regressione lineare semplice

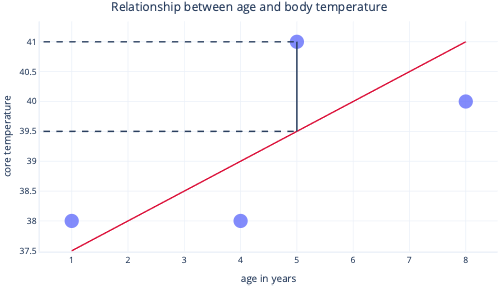

La regressione lineare semplice modella una relazione lineare tra una singola caratteristica e un'etichetta, consentendo alla caratteristica di stimare l'etichetta. Visivamente, potrebbe avere un aspetto simile a quello illustrato di seguito:

La regressione lineare semplice ha due parametri: un'intercetta (c) che indica il valore dell'etichetta quando la caratteristica è impostata su zero e una pendenza (m) che indica l'aumento dell'etichetta per ogni incremento di 1 punto nella caratteristica.

In matematica questo concetto viene semplicemente espresso come:

y=mx+c

Dove y è l'etichetta e x è la tua funzionalità.

Ad esempio, in questo scenario, se si tentasse di stimare quali pazienti avranno una febbre, con una temperatura corporea elevata, in base all'età, si avrà il modello:

temperatura=m*età+c

E devono trovare i valori di m e c durante la procedura di montaggio. Se i valori fossero m = 0,5 e c = 37, tale concetto potrebbe essere visualizzato nel modo seguente:

Ciò significa che ogni anno di età è associato all'aumento della temperatura corporea di 0,5°C, con un punto di partenza di 37°C.

Adattamento della regressione lineare

In genere vengono usate librerie esistenti per adattare i modelli di regressione. La regressione in genere mira a trovare la linea che produce la quantità minima di errore, dove per errore qui si intende la differenza tra il valore effettivo del punto dati e il valore previsto. Nell'immagine seguente, ad esempio, la linea nera indica l'errore tra la stima (la linea rossa) e un valore effettivo (il punto).

Osservando questi due punti sull'asse y, è possibile vedere che la previsione era 39,5, ma il valore effettivo era 41.

Pertanto, il modello non era corretto per 1,5 per questo punto dati.

In genere, viene adattato un modello riducendo al minimo la somma residua dei quadrati. Ciò significa che la funzione di costo viene calcolata nel modo seguente:

- Calcolare la differenza tra i valori effettivi e quelli previsti (come prima) per ogni punto dati.

- Elevare al quadrato questi valori.

- Sommare (o calcolare la media) di questi valori al quadrato.

Questo passaggio di elevazione al quadrato significa che non tutti i punti contribuiscono in modo uniforme alla linea: gli outlier, che sono punti che non rientrano nel modello previsto, hanno un errore sproporzionatamente più grande, che può influenzare la posizione della linea.

Punti di forza della regressione

Le tecniche di regressione hanno molti punti di forza che i modelli più complessi non hanno.

Prevedibile e facile da interpretare

Le regressioni sono facili da interpretare perché descrivono semplici equazioni matematiche, che spesso è possibile rappresentare graficamente. I modelli più complessi vengono spesso definiti soluzioni black box , perché è difficile comprendere come eseguono stime o come si comportano con determinati input.

Facile da estrapolare

Le regressioni semplificano l'estrapolazione, effettuare previsioni per valori non compresi nell'intervallo del set di dati. Ad esempio, è semplice stimare nell'esempio precedente che un cane di nove anni avrà una temperatura di 40,5°C. Bisogna sempre prestare attenzione all'estrapolazione: questo modello prevede che un cane di 90 anni avrebbe una temperatura abbastanza calda da far bollire l'acqua.

L'adattamento ottimale è in genere garantito

La maggior parte dei modelli di apprendimento automatico usa l'algoritmo di discesa del gradiente per adattare i modelli, il che implica la regolazione dell'algoritmo stesso e non garantisce che venga trovata una soluzione ottimale. Al contrario, la regressione lineare che usa la somma dei quadrati come funzione di costo non necessita effettivamente di una procedura iterativa di discesa del gradiente. Invece, possiamo usare matematica intelligente per calcolare la posizione ottimale per la linea da posizionare. La matematica non rientra nell'ambito di questo modulo, ma è utile sapere che, finché le dimensioni del campione non sono troppo grandi, la regressione lineare non richiede particolare attenzione per il processo di adattamento e la soluzione ottimale è garantita.