このチュートリアルの前のパートでは、ONNX 形式でモデルを構築およびエクスポートする方法について説明しました。 これでそのモデルが作成されたので、Windows アプリケーションに埋め込み、WinML API を呼び出してデバイス上でローカルに実行できます。

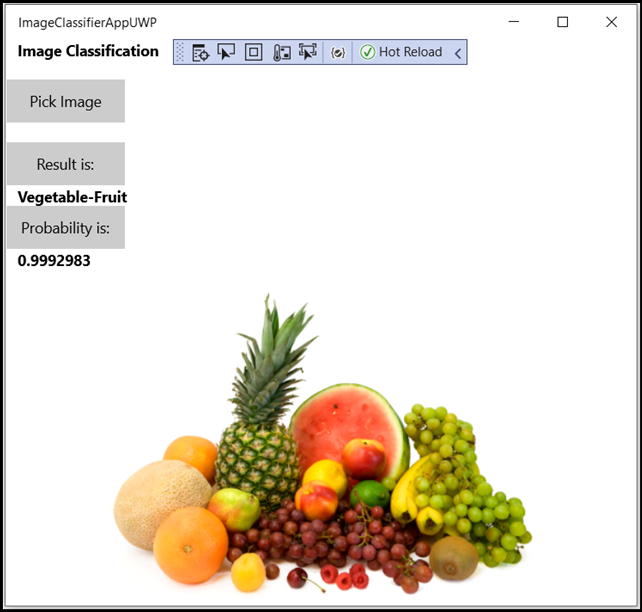

完了すると、動作する画像分類子 WinML UWP アプリ (C#) が作成されます。

サンプル アプリについて

このモデルを使用して、食品の画像を分類できるアプリを作成します。 これにより、ローカル デバイスからイメージを選択し、 前のパートで作成およびトレーニングしたローカルに保存された分類 ONNX モデルで処理できます。 返されるタグは、画像の横に表示され、分類の信頼度も表示されます。

ここまでこのチュートリアルに従っている場合は、アプリ開発に必要な前提条件が既に満たされている必要があります。 更新プログラムが必要な場合は、 このチュートリアルの最初の部分を参照してください。

注

完全なサンプル コードをダウンロードする場合は、 ソリューション ファイルを複製できます。 リポジトリを複製し、このサンプルに移動し、Visual Studio で ImageClassifierAppUWP.sln ファイルを開きます。 次に、[アプリケーションの起動](アプリケーションの #Launch)の手順に進むことができます。

WinML UWP を作成する (C#)

以下では、アプリと WinML コードを最初から作成する方法について説明します。 次の方法について学習します。

- 機械学習モデルを読み込みます。

- 必要な形式でイメージを読み込みます。

- モデルの入力と出力をバインドします。

- モデルを評価し、意味のある結果を表示します。

また、基本的な XAML を使用して単純な GUI を作成し、画像分類子をテストすることもできます。

アプリを作成する

- Visual Studio を開き、[

create a new project] を選択します。

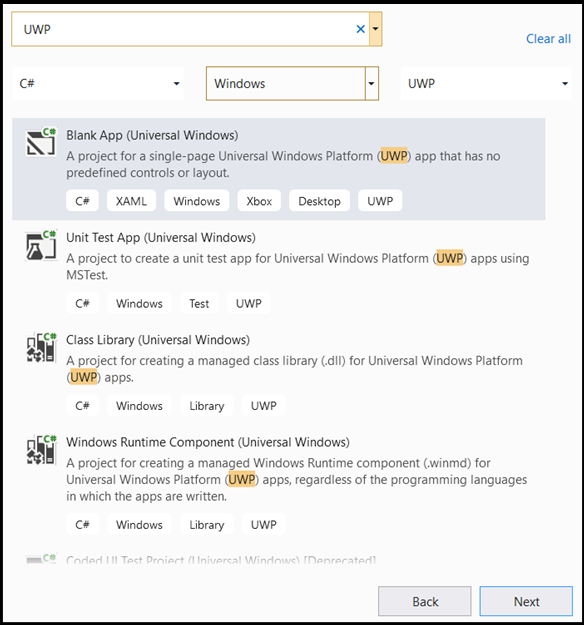

- 検索バーに「

UWP」と入力し、Blank APP (Universal Windows) を選択します。 これにより、定義済みのコントロールやレイアウトがない単一ページのユニバーサル Windows プラットフォーム (UWP) アプリ用の新しい C# プロジェクトが開きます。Nextを選択して、プロジェクトの構成ウィンドウを開きます。

- 構成ウィンドウで、次の手順を実行します。

- プロジェクトの名前を選択します。 ここでは、 ImageClassifierAppUWP を使用します。

- プロジェクトの場所を選択します。

- VS 2019 を使用している場合は、

Place solution and project in the same directoryがオフになっていることを確認します。 - VS 2017 を使用している場合は、

Create directory for solutionがオンになっていることを確認します。

createキーを押してプロジェクトを作成します。 最小ターゲット バージョン ウィンドウがポップアップ表示される場合があります。 最小バージョンが Windows 10 ビルド 17763 以降に設定されていることを確認します。

アプリを作成し、WinML アプリを使用してモデルをデプロイするには、次のものが必要です。

プロジェクトが作成されたら、プロジェクト フォルダーに移動し、assets フォルダー [....\ImageClassifierAppUWP\Assets] を開き、モデルをこの場所にコピーします。

モデル名を

model.onnxからclassifier.onnxに変更します。 これにより、内容が少し明確になり、チュートリアルの形式に合わせて調整されます。

モデルを探索する

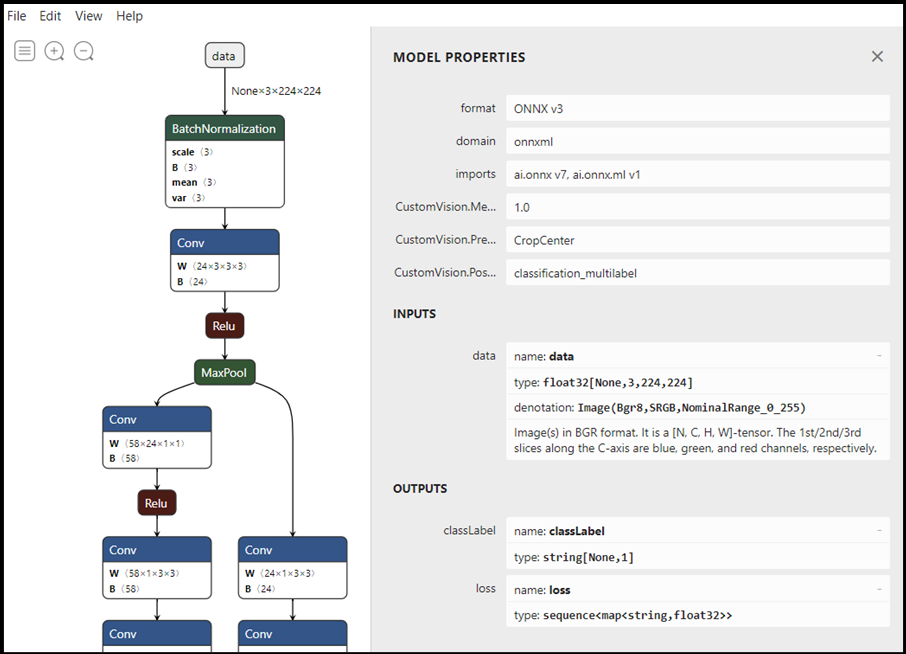

モデル ファイルの構造を理解しましょう。

ご覧のように、モデルでは入力として 32 ビット Tensor (多次元配列) float オブジェクトが必要であり、2 つの出力が返されます。1 つ目の名前付き classLabel は文字列のテンソルであり、2 番目の名前付き loss は、ラベル付けされた各分類の確率を表す文字列対浮動小数点マップのシーケンスです。 この情報は、Windows アプリでモデルの出力を正常に表示するために必要です。

プロジェクト ソリューションを探索する

プロジェクト ソリューションを調べてみましょう。

Visual Studio は、ソリューション エクスプローラー内に複数の cs コード ファイルを自動的に作成しました。

MainPage.xaml には GUI の XAML コードが含まれており、 MainPage.xaml.cs にはアプリケーション コードが含まれています。 以前に UWP アプリを作成したことがある場合、これらのファイルは非常に使い慣れているはずです。

アプリケーション GUI を作成する

まず、アプリ用の単純な GUI を作成しましょう。

MainPage.xamlファイルをダブルクリックします。 空のアプリでは、アプリの GUI の XAML テンプレートが空であるため、いくつかの UI 機能を追加する必要があります。MainPage.xamlの本体に次のコードを追加します。

<Grid Background="{ThemeResource ApplicationPageBackgroundThemeBrush}">

<StackPanel Margin="1,0,-1,0">

<TextBlock x:Name="Menu"

FontWeight="Bold"

TextWrapping="Wrap"

Margin="10,0,0,0"

Text="Image Classification"/>

<TextBlock Name="space" />

<Button Name="recognizeButton"

Content="Pick Image"

Click="OpenFileButton_Click"

Width="110"

Height="40"

IsEnabled="True"

HorizontalAlignment="Left"/>

<TextBlock Name="space3" />

<Button Name="Output"

Content="Result is:"

Width="110"

Height="40"

IsEnabled="True"

HorizontalAlignment="Left"

VerticalAlignment="Top">

</Button>

<!--Display the Result-->

<TextBlock Name="displayOutput"

FontWeight="Bold"

TextWrapping="Wrap"

Margin="30,0,0,0"

Text="" Width="1471" />

<Button Name="ProbabilityResult"

Content="Probability is:"

Width="110"

Height="40"

IsEnabled="True"

HorizontalAlignment="Left"/>

<!--Display the Result-->

<TextBlock Name="displayProbability"

FontWeight="Bold"

TextWrapping="Wrap"

Margin="30,0,0,0"

Text="" Width="1471" />

<TextBlock Name="space2" />

<!--Image preview -->

<Image Name="UIPreviewImage" Stretch="Uniform" MaxWidth="300" MaxHeight="300"/>

</StackPanel>

</Grid>

Windows Machine Learning コード ジェネレーター

Windows Machine Learning Code Generator ( mlgen) は、UWP アプリでの WinML API の使用を開始するのに役立つ Visual Studio 拡張機能です。 トレーニング済みの ONNX ファイルを UWP プロジェクトに追加すると、テンプレート コードが生成されます。

Windows Machine Learning のコード ジェネレーター mlgen は、Windows ML API を呼び出すラッパー クラスを含むインターフェイス (C#、C++/WinRT、C++/CX 用) を作成します。 これにより、プロジェクト内のモデルを簡単に読み込み、バインド、評価できます。 このチュートリアルでは、これらの関数の多くを処理するために使用します。

コード ジェネレーターは、Visual Studio 2017 以降で使用できます。 Windows 10 バージョン 1903 以降では、mlgen は Windows 10 SDK に含まれていないため、拡張機能をダウンロードしてインストールする必要があることに注意してください。 紹介からこのチュートリアルに従っている場合は、既にこれを処理していますが、処理していない場合は、 VS 2019 または VS 2017 用にダウンロードする必要があります。

注

mlgen の詳細については、mlgen のドキュメントを参照してください

まだインストールしていない場合は、mlgen をインストールします。

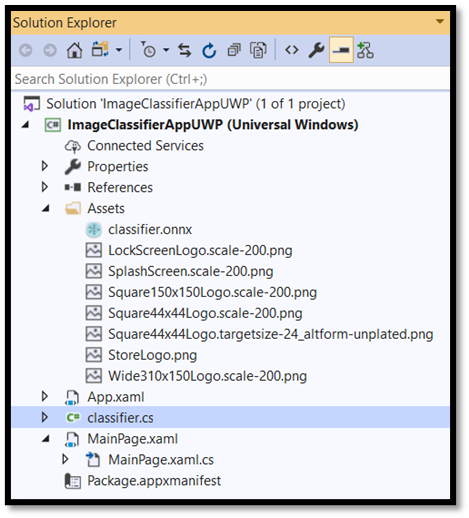

Visual Studio のソリューション エクスプローラーで

Assetsフォルダーを右クリックし、Add > Existing Itemを選択します。ImageClassifierAppUWP [….\ImageClassifierAppUWP\Assets]内の assets フォルダーに移動し、先にコピーした ONNX モデルを見つけて、add選択します。VS のソリューション エクスプローラーの assets フォルダーに ONNX モデル (名前: "classifier") を追加した後、プロジェクトには次の 2 つの新しいファイルが必要になります。

-

classifier.onnx- これは ONNX 形式のモデルです。 -

classifier.cs– 自動的に生成された WinML コード ファイル。

- アプリケーションのコンパイル時にモデルがビルドされるようにするには、

classifier.onnxファイルを選択し、Propertiesを選択します。Build Actionの場合は、[Content] を選択します。

次に、classifier.cs ファイルで新しく生成されたコードを調べてみましょう。

生成されたコードには、次の 3 つのクラスが含まれています。

-

classifierModel: このクラスには、モデルのインスタンス化とモデル評価のための 2 つのメソッドが含まれています。 機械学習モデル表現を作成し、システムの既定のデバイスでセッションを作成し、特定の入力と出力をモデルにバインドし、モデルを非同期的に評価するのに役立ちます。 -

classifierInput: このクラスは、モデルが期待する入力型を初期化します。 モデル入力は、入力データのモデル要件によって異なります。 この場合、入力には ImageFeatureValue が必要です。これは、モデルへの渡しに使用されるイメージのプロパティを記述するクラスです。 -

classifierOutput: このクラスは、モデルが出力する型を初期化します。 モデルの出力は、モデルによって定義される方法によって異なります。 この例では、出力は String 型と TensorFloat (Float32) 型のマップ (ディクショナリ) のシーケンスであり、loss と呼ばれます。

次に、これらのクラスを使用して、プロジェクト内のモデルの読み込み、バインド、評価を行います。

モデルと入力を読み込む

モデルを読み込む

MainPage.xaml.csコード ファイルをダブルクリックして、アプリケーション コードを開きます。必要なすべての API にアクセスするには、"using" ステートメントを次のステートメントに置き換えます。

// Specify all the using statements which give us the access to all the APIs that you'll need

using System;

using System.Threading.Tasks;

using Windows.AI.MachineLearning;

using Windows.Graphics.Imaging;

using Windows.Media;

using Windows.Storage;

using Windows.Storage.Pickers;

using Windows.Storage.Streams;

using Windows.UI.Xaml;

using Windows.UI.Xaml.Controls;

using Windows.UI.Xaml.Media.Imaging;

-

MainPageクラス内の using ステートメントの後に、名前空間ImageClassifierAppUWPの下に、次の変数宣言を追加します。

// All the required variable declaration

private classifierModel modelGen;

private classifierInput input = new classifierModelInput();

private classifierOutput output;

private StorageFile selectedStorageFile;

private string result = "";

private float resultProbability = 0;

結果は次のようになります。

// Specify all the using statements which give us the access to all the APIs that we'll need

using System;

using System.Threading.Tasks;

using Windows.AI.MachineLearning;

using Windows.Graphics.Imaging;

using Windows.Media;

using Windows.Storage;

using Windows.Storage.Pickers;

using Windows.Storage.Streams;

using Windows.UI.Xaml;

using Windows.UI.Xaml.Controls;

using Windows.UI.Xaml.Media.Imaging;

namespace ImageClassifierAppUWP

{

public sealed partial class MainPage : Page

{

// All the required fields declaration

private classifierModel modelGen;

private classifierInput input = new classifierInput();

private classifierOutput output;

private StorageFile selectedStorageFile;

private string result = "";

private float resultProbability = 0;

次に、 LoadModel メソッドを実装します。 メソッドは ONNX モデルにアクセスし、メモリに格納します。 次に、 CreateFromStreamAsync メソッドを使用して、 LearningModel オブジェクトとしてモデルをインスタンス化します。

LearningModel クラスは、トレーニング済みの機械学習モデルを表します。 インスタンス化された LearningModel は、Windows ML との対話に使用する初期オブジェクトです。

モデルを読み込むには、 LearningModel クラスで複数の静的メソッドを使用できます。 この場合は、 CreateFromStreamAsync メソッドを使用します。

CreateFromStreamAsync メソッドは mlgen で自動的に作成されたため、このメソッドを実装する必要はありません。 この方法は、mlgen によって生成された classifier.cs ファイルをダブルクリックして確認できます。

LearningModelクラスの詳細については、LearningModel クラスのドキュメントを参照してください。

モデルを読み込むその他の方法の詳細については、モデルの読み込みのドキュメントを参照してください

-

loadModelクラス内のMainPage.xaml.csコード ファイルにMainPageメソッドを追加します。

private async Task loadModel()

{

// Get an access the ONNX model and save it in memory.

StorageFile modelFile = await StorageFile.GetFileFromApplicationUriAsync(new Uri($"ms-appx:///Assets/classifier.onnx"));

// Instantiate the model.

modelGen = await classifierModel.CreateFromStreamAsync(modelFile);

}

- 次に、クラスのコンストラクターに新しいメソッドの呼び出しを追加します。

// The main page to initialize and execute the model.

public MainPage()

{

this.InitializeComponent();

loadModel();

}

結果は次のようになります。

// The main page to initialize and execute the model.

public MainPage()

{

this.InitializeComponent();

loadModel();

}

// A method to load a machine learning model.

private async Task loadModel()

{

// Get an access the ONNX model and save it in memory.

StorageFile modelFile = await StorageFile.GetFileFromApplicationUriAsync(new Uri($"ms-appx:///Assets/classifier.onnx"));

// Instantiate the model.

modelGen = await classifierModel.CreateFromStreamAsync(modelFile);

}

イメージを読み込む

- クリック イベントを定義して、モデル実行のための 4 つのメソッド呼び出しのシーケンス (変換、バインドと評価、出力抽出、結果の表示) を開始する必要があります。

MainPage.xaml.csクラス内のMainPageコード ファイルに次のメソッドを追加します。

// Waiting for a click event to select a file

private async void OpenFileButton_Click(object sender, RoutedEventArgs e)

{

if (!await getImage())

{

return;

}

// After the click event happened and an input selected, begin the model execution.

// Bind the model input

await imageBind();

// Model evaluation

await evaluate();

// Extract the results

extractResult();

// Display the results

await displayResult();

}

- 次に、

getImage()メソッドを実装します。 このメソッドは、入力イメージ ファイルを選択し、メモリに保存します。MainPage.xaml.csクラス内のMainPageコード ファイルに次のメソッドを追加します。

// A method to select an input image file

private async Task<bool> getImage()

{

try

{

// Trigger file picker to select an image file

FileOpenPicker fileOpenPicker = new FileOpenPicker();

fileOpenPicker.SuggestedStartLocation = PickerLocationId.PicturesLibrary;

fileOpenPicker.FileTypeFilter.Add(".jpg");

fileOpenPicker.FileTypeFilter.Add(".png");

fileOpenPicker.ViewMode = PickerViewMode.Thumbnail;

selectedStorageFile = await fileOpenPicker.PickSingleFileAsync();

if (selectedStorageFile == null)

{

return false;

}

}

catch (Exception)

{

return false;

}

return true;

}

次に、ビットマップ BGRA8 形式でファイルの表現を取得するイメージ Bind() メソッドを実装します。

- MainPage クラス内の

convert()コード ファイルに、MainPage.xaml.csメソッドの実装を追加します。 convert メソッドは、BGRA8 形式の入力ファイルの表現を取得します。

// A method to convert and bind the input image.

private async Task imageBind()

{

UIPreviewImage.Source = null;

try

{

SoftwareBitmap softwareBitmap;

using (IRandomAccessStream stream = await selectedStorageFile.OpenAsync(FileAccessMode.Read))

{

// Create the decoder from the stream

BitmapDecoder decoder = await BitmapDecoder.CreateAsync(stream);

// Get the SoftwareBitmap representation of the file in BGRA8 format

softwareBitmap = await decoder.GetSoftwareBitmapAsync();

softwareBitmap = SoftwareBitmap.Convert(softwareBitmap, BitmapPixelFormat.Bgra8, BitmapAlphaMode.Premultiplied);

}

// Display the image

SoftwareBitmapSource imageSource = new SoftwareBitmapSource();

await imageSource.SetBitmapAsync(softwareBitmap);

UIPreviewImage.Source = imageSource;

// Encapsulate the image within a VideoFrame to be bound and evaluated

VideoFrame inputImage = VideoFrame.CreateWithSoftwareBitmap(softwareBitmap);

// bind the input image

ImageFeatureValue imageTensor = ImageFeatureValue.CreateFromVideoFrame(inputImage);

input.data = imageTensor;

}

catch (Exception e)

{

}

}

このセクションで行った作業の結果は次のようになります。

// Waiting for a click event to select a file

private async void OpenFileButton_Click(object sender, RoutedEventArgs e)

{

if (!await getImage())

{

return;

}

// After the click event happened and an input selected, we begin the model execution.

// Bind the model input

await imageBind();

// Model evaluation

await evaluate();

// Extract the results

extractResult();

// Display the results

await displayResult();

}

// A method to select an input image file

private async Task<bool> getImage()

{

try

{

// Trigger file picker to select an image file

FileOpenPicker fileOpenPicker = new FileOpenPicker();

fileOpenPicker.SuggestedStartLocation = PickerLocationId.PicturesLibrary;

fileOpenPicker.FileTypeFilter.Add(".jpg");

fileOpenPicker.FileTypeFilter.Add(".png");

fileOpenPicker.ViewMode = PickerViewMode.Thumbnail;

selectedStorageFile = await fileOpenPicker.PickSingleFileAsync();

if (selectedStorageFile == null)

{

return false;

}

}

catch (Exception)

{

return false;

}

return true;

}

// A method to convert and bind the input image.

private async Task imageBind()

{

UIPreviewImage.Source = null;

try

{

SoftwareBitmap softwareBitmap;

using (IRandomAccessStream stream = await selectedStorageFile.OpenAsync(FileAccessMode.Read))

{

// Create the decoder from the stream

BitmapDecoder decoder = await BitmapDecoder.CreateAsync(stream);

// Get the SoftwareBitmap representation of the file in BGRA8 format

softwareBitmap = await decoder.GetSoftwareBitmapAsync();

softwareBitmap = SoftwareBitmap.Convert(softwareBitmap, BitmapPixelFormat.Bgra8, BitmapAlphaMode.Premultiplied);

}

// Display the image

SoftwareBitmapSource imageSource = new SoftwareBitmapSource();

await imageSource.SetBitmapAsync(softwareBitmap);

UIPreviewImage.Source = imageSource;

// Encapsulate the image within a VideoFrame to be bound and evaluated

VideoFrame inputImage = VideoFrame.CreateWithSoftwareBitmap(softwareBitmap);

// bind the input image

ImageFeatureValue imageTensor = ImageFeatureValue.CreateFromVideoFrame(inputImage);

input.data = imageTensor;

}

catch (Exception e)

{

}

}

モデルのバインドおよび評価

次に、モデルに基づいてセッションを作成し、セッションからの入力と出力をバインドして、モデルを評価します。

モデルをバインドするセッションを作成します。

セッションを作成するには、 LearningModelSession クラスを使用します。 このクラスは、機械学習モデルを評価するために使用され、モデルを実行して評価するデバイスにモデルをバインドします。 マシンの特定のデバイスでモデルを実行するセッションを作成するときに、デバイスを選択できます。 既定のデバイスは CPU です。

注

デバイスを選択する方法の詳細については、 セッションの作成 に関するドキュメントを参照してください。

モデルの入力と出力をバインドします。

入力と出力をバインドするには、 LearningModelBinding クラスを使用します。 機械学習モデルには、モデルとの間で情報を渡す入力機能と出力機能があります。 必要な機能は、Window ML API でサポートされている必要があることに注意してください。

LearningModelBinding クラスは、名前付きの入力および出力機能に値をバインドするために、LearningModelSessionに適用されます。

バインドの実装は mlgen によって自動的に生成されるため、その処理を行う必要はありません。 バインディングは、 LearningModelBinding クラスの定義済みメソッドを呼び出すことによって実装されます。 ここでは、 Bind メソッドを使用して、名前付き特徴の種類に値をバインドします。

現在、Windows ML では、Tensors (多次元配列)、シーケンス (値のベクトル)、マップ (情報の値のペア)、画像 (特定の形式) など、すべての ONNX 機能の種類がサポートされています。 すべてのイメージは、テンソル形式で Windows ML で表されます。 テンソル化は、イメージをテンソルに変換するプロセスであり、バインド中に発生します。

幸いなことに、テンソル化変換を行う必要はありません。 前のパートで使用した ImageFeatureValue メソッドは変換とテンソル化の両方を処理するため、イメージはモデルの必要なイメージ形式と一致します。

注

LearningModelをバインドする方法と、WinML でサポートされる機能の種類の詳細については、モデルのバインドに関するドキュメントを参照してください。

モデルを評価します。

モデルと境界値をモデルの入力と出力にバインドするセッションを作成した後、モデルの入力を評価し、その予測を取得できます。 モデルの実行を実行するには、LearningModelSession で定義済みの評価メソッドのいずれかを呼び出す必要があります。 ここでは、 EvaluateAsync メソッドを使用します。

CreateFromStreamAsyncと同様に、EvaluateAsync メソッドも WinML Code Generator によって自動的に生成されたため、このメソッドを実装する必要はありません。 この方法は、 classifier.cs ファイルで確認できます。

EvaluateAsync メソッドは、バインドに既にバインドされている機能値を使用して、機械学習モデルを非同期的に評価します。

LearningModelSessionとのセッションを作成し、入力と出力をLearningModelBindingにバインドし、モデル評価を実行し、LearningModelEvaluationResult クラスを使用してモデルの出力機能を取得します。

注

モデルを実行するその他の評価方法については、LearningModelSession クラスのドキュメントを参照して、 LearningModelSession に実装できるメソッドを確認してください。

- MainPage クラス内の

MainPage.xaml.csコード ファイルに次のメソッドを追加して、セッションを作成し、モデルをバインドして評価します。

// A method to evaluate the model

private async Task evaluate()

{

output = await modelGen.EvaluateAsync(input);

}

結果を抽出して表示する

次に、モデルの出力を抽出し、適切な結果を表示する必要があります。 これを行うには、 extractResult メソッドと displayResult メソッドを実装します。

前に説明したように、モデルは 2 つの出力を返します。1 つ目の名前付き classLabel は文字列のテンソルであり、2 番目の名前付き損失は、ラベル付けされた分類ごとの確率を表す文字列対 float マップのシーケンスです。 したがって、結果と確率を正常に表示するには、損失出力から出力を抽出するだけです。 正しい結果を返すには、最も高い確率を見つける必要があります。

-

extractResultクラス内のMainPage.xaml.csコード ファイルにMainPageメソッドを追加します。

private void extractResult()

{

// A method to extract output (result and a probability) from the "loss" output of the model

var collection = output.loss;

float maxProbability = 0;

string keyOfMax = "";

foreach (var dictionary in collection)

{

foreach (var key in dictionary.Keys)

{

if (dictionary[key] > maxProbability)

{

maxProbability = dictionary[key];

keyOfMax = key;

}

}

}

result = keyOfMax;

resultProbability = maxProbability;

}

-

displayResultクラス内のMainPage.xaml.csコード ファイルにMainPageメソッドを追加します。

// A method to display the results

private async Task displayResult()

{

displayOutput.Text = result.ToString();

displayProbability.Text = resultProbability.ToString();

}

バインドと評価の結果と、アプリの WinML コードの結果部分を抽出して表示すると、次のようになります。

// A method to evaluate the model

private async Task evaluate()

{

output = await modelGen.EvaluateAsync(input);

}

// A method to extract output (string and a probability) from the "loss" output of the model

private void extractResult()

{

var collection = output.loss;

float maxProbability = 0;

string keyOfMax = "";

foreach (var dictionary in collection)

{

foreach (var key in dictionary.Keys)

{

if (dictionary[key] > maxProbability)

{

maxProbability = dictionary[key];

keyOfMax = key;

}

}

}

result = keyOfMax;

resultProbability = maxProbability;

}

// A method to display the results

private async Task displayResult()

{

displayOutput.Text = result.ToString();

displayProbability.Text = resultProbability.ToString();

}

これで終了です。 これで、分類モデルをテストするための基本的な GUI を使用して Windows 機械学習アプリが正常に作成されました。 次の手順では、アプリケーションを起動し、Windows デバイスでローカルに実行します。

アプリケーションを起動する

アプリケーション インターフェイスを完了し、モデルを追加し、WinML コードを生成したら、アプリケーションをテストできます。 上部のツール バーのドロップダウン メニューが Debugに設定されていることを確認します。

Solution Platformをx64に変更して、デバイスが 64 ビットの場合はローカル コンピューターでプロジェクトを実行するか、32 ビットの場合はx86します。

アプリをテストするには、果物の次の画像を使用します。 アプリで画像のコンテンツがどのように分類されるかを見てみましょう。

このイメージをローカル デバイスに保存して、アプリをテストします。 必要に応じて、イメージ形式を jpg に変更します。 また、.jpg、.png、.bmp、または .gif 形式の適切な形式で、ローカル デバイスから他の関連する画像を追加することもできます。

プロジェクトを実行するには、ツール バーの

Start Debuggingボタンを押すか、F5を押します。アプリケーションが起動したら、

Pick Imageキーを押し、ローカル デバイスからイメージを選択します。

![[イメージの選択] ダイアログ](../../images/tutorials/pick-image.png)

結果はすぐに画面に表示されます。 ご覧のように、WinML アプリは、99.9% 信頼度の評価で、画像を果物または野菜として正常に分類しました。

概要

モデルの作成から正常な実行まで、初めての Windows Machine Learning アプリを作成しました。

その他のリソース

このチュートリアルで説明されているトピックの詳細については、次のリソースを参照してください。

- Windows ML ツール: Windows ML ダッシュボード、 WinMLRunner、 mglen Windows ML コード ジェネレーターなどのその他のツールについて説明します。

- ONNX モデル: ONNX 形式の詳細を確認します。

- Windows ML のパフォーマンスとメモリ: Windows ML を使用してアプリのパフォーマンスを管理する方法について説明します。

- Windows Machine Learning API リファレンス: Windows ML API の 3 つの領域の詳細について説明します。