빠른 시작: Azure AI 콘텐츠 안전 스튜디오

이 문서에서는 브라우저에서 Content Safety Studio를 사용하여 Azure AI Content Safety 서비스를 시작하는 방법을 설명합니다.

주의

Content Safety Studio에서 제공하는 샘플 콘텐츠 중 일부는 불쾌할 수 있습니다. 샘플 이미지는 기본적으로 흐리게 표시됩니다. 사용자의 재량에 따라 결정하는 것이 좋습니다.

필수 조건

- Azure 계정. GitHub 계정이 없는 경우 무료로 만들 수 있습니다.

- 콘텐츠 안전 Azure 리소스입니다.

- Cognitive Services 사용자 역할을 계정에 할당합니다. Azure Portal로 이동하여 콘텐츠 안전 리소스 또는 Azure AI Services 리소스로 이동하고, 왼쪽 탐색 모음에서 Access Control을 선택한 다음, + 역할 할당 추가, Cognitive Services 사용자 역할을 선택하고, 이 역할을 할당해야 하는 계정의 멤버를 선택한 다음 검토 및 할당합니다. 할당이 적용되는 데 몇 분 정도 걸릴 수 있습니다.

- Azure 구독 및 콘텐츠 안전 리소스를 사용하여 콘텐츠 안전 스튜디오에 로그인합니다.

Important

스튜디오 환경을 사용하려면 Cognitive Services 사용자 역할을 Azure 계정에 할당해야 합니다. Azure Portal로 이동하여 콘텐츠 안전 리소스 또는 Azure AI Services 리소스로 이동하고, 왼쪽 탐색 모음에서 Access Control을 선택한 다음, + 역할 할당 추가, Cognitive Services 사용자 역할을 선택하고, 이 역할을 할당해야 하는 계정의 멤버를 선택한 다음 검토 및 할당합니다. 할당이 적용되는 데 몇 분 정도 걸릴 수 있습니다.

텍스트 콘텐츠 분석

보통 텍스트 콘텐츠 페이지는 텍스트 조정을 빠르게 시도할 수 있는 기능을 제공합니다.

- 텍스트 콘텐츠 조정 패널을 선택합니다.

- 입력 필드에 텍스트를 추가하거나 페이지 패널에서 샘플 텍스트를 선택합니다.

- 테스트 실행을 선택합니다.

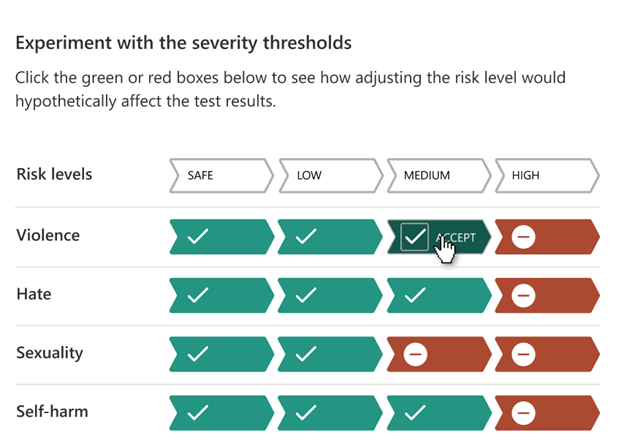

서비스는 검색된 모든 범주를 각각에 대한 심각도 수준(0-Safe, 2-Low, 4-Medium, 6-High)으로 반환합니다. 또한 구성한 필터에 따라 이진 수락됨/거부됨 결과를 반환합니다. 필터 구성 탭의 행렬을 사용하여 각 범주에 대해 허용/금지된 심각도 수준을 설정합니다. 그런 다음 텍스트를 다시 실행하여 필터가 어떻게 작동하는지 확인할 수 있습니다.

차단 목록 사용 탭을 사용하면 차단 목록을 만들고, 편집하고, 조정 워크플로에 추가할 수 있습니다. 테스트를 실행할 때 차단 목록을 활성화한 경우 결과 아래에 차단 목록 감지 패널이 표시됩니다. 차단 목록과 일치하는 항목이 있으면 보고합니다.

사용자 입력 공격 검색

프롬프트 쉴드 패널에서 사용자 입력 위험을 검색해볼 수 있습니다. 시스템 메시지에 설정된 규칙을 피하거나 위반하도록 학습된 동작을 나타내도록 생성 AI 모델을 유도하는 방식으로 설계된 사용자 프롬프트를 검색합니다. 이러한 공격은 복잡한 역할극부터 안전 목표를 교묘하게 전복하는 것까지 다양합니다.

- 프롬프트 쉴드 패널을 선택합니다.

- 페이지에서 샘플 텍스트를 선택하거나 테스트를 위해 사용자 고유의 콘텐츠를 입력합니다. CSV 파일을 업로드하여 일괄 테스트를 수행할 수도 있습니다.

- 테스트 실행을 선택합니다.

서비스는 각 샘플에 대한 위험 플래그 및 유형을 반환합니다.

자세한 내용은 프롬프트 쉴드 개념 가이드를 참조하세요.

이미지 콘텐츠 분석

이미지 콘텐츠 조정 페이지에서는 이미지 조정을 빠르게 시도할 수 있는 기능을 제공합니다.

- 이미지 콘텐츠 조정 패널을 선택합니다.

- 페이지 패널에서 샘플 이미지를 선택하거나 고유한 이미지를 업로드하세요. 이미지 제출의 최대 크기는 4MB이며, 이미지 크기는 50 x 50픽셀에서 2,048 x 2,048픽셀 사이여야 합니다. 이미지는 JPEG, PNG, GIF, BMP, TIFF 또는 WEBP 형식일 수 있습니다.

- 테스트 실행을 선택합니다.

서비스는 검색된 모든 범주를 각각에 대한 심각도 수준(0-Safe, 2-Low, 4-Medium, 6-High)으로 반환합니다. 또한 구성한 필터에 따라 이진 수락됨/거부됨 결과를 반환합니다. 오른쪽에 있는 필터 구성 탭의 매트릭스를 사용하여 각 범주에 대한 허용/금지 심각도 수준을 설정하세요. 그런 다음 텍스트를 다시 실행하여 필터가 어떻게 작동하는지 확인할 수 있습니다.

코드 보기 및 내보내기

텍스트 콘텐츠 분석 또는 이미지 콘텐츠 분석 페이지에서 코드 보기 기능을 사용하여 심각도 필터링, 차단 목록 및 조정 함수에 대한 구성을 포함하는 샘플 코드를 보고 복사할 수 있습니다. 그런 다음 사용자 측에 코드를 배포할 수 있습니다.

온라인 활동 모니터링

모니터 온라인 활동 패널을 사용하면 API 사용량 및 추세를 볼 수 있습니다.

모니터링할 미디어 유형을 선택할 수 있습니다. 마지막 __에 대한 데이터 표시를 선택하여 확인하려는 시간 범위를 지정할 수도 있습니다.

범주별 거부율 차트에서 각 범주의 심각도 임계값을 조정할 수도 있습니다.

일부 용어를 변경하려는 경우 차단된 상위 10개 용어 차트를 기반으로 차단 목록을 편집할 수도 있습니다.

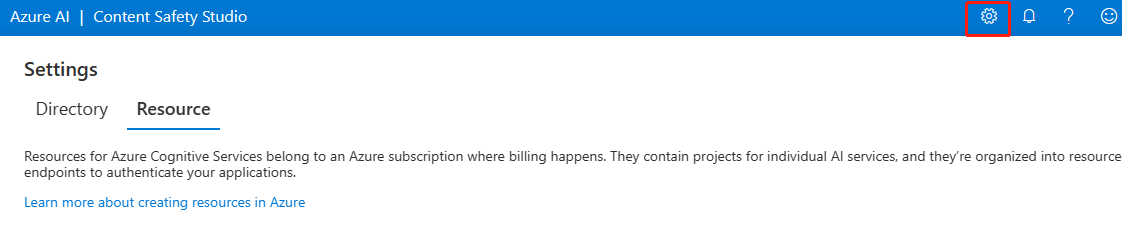

리소스 관리

이름, 가격 등급 등 리소스 세부 정보를 보려면 Content Safety Studio 홈페이지 오른쪽 상단에 있는 설정 아이콘을 선택하고 리소스 탭을 선택하세요. 다른 리소스가 있는 경우 여기에서도 리소스를 전환할 수 있습니다.

리소스 정리

Azure AI 서비스 리소스를 정리하고 제거하려면 리소스 또는 리소스 그룹을 삭제할 수 있습니다. 리소스 그룹을 삭제하면 해당 리소스 그룹에 연결된 다른 모든 리소스가 함께 삭제됩니다.

다음 단계

다음으로 REST API 또는 클라이언트 SDK를 통해 Azure AI 콘텐츠 안전 사용을 시작하면 서비스를 애플리케이션에 원활하게 통합할 수 있습니다.