적용 대상: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

팁

Microsoft Fabric의 데이터 팩토리는 더 간단한 아키텍처, 기본 제공 AI 및 새로운 기능을 갖춘 차세대 Azure 데이터 팩토리입니다. 데이터 통합을 접하는 경우 Fabric Data Factory부터 시작합니다. 기존 ADF 워크로드는 Fabric 업그레이드하여 데이터 과학, 실시간 분석 및 보고 전반에 걸쳐 새로운 기능에 액세스할 수 있습니다.

- Fabric 무료 평가판을 시작합니다.

Microsoft Fabric의 Data Factory로 Azure Data Factory를 업그레이드합니다

이 자습서에서는 Azure 포털을 사용하여 데이터 팩터리를 만듭니다. 그런 다음 데이터 복사 도구를 사용하여 Azure Blob Storage에서 Azure Blob Storage에 이르기까지 새 파일과 변경된 파일만 증분 방식으로 복사하는 파이프라인을 만듭니다. 이 파이프라인은 LastModifiedDate를 사용하여 복사할 파일을 결정합니다.

여기서 단계를 완료하면 Azure Data Factory 원본 저장소의 모든 파일을 검색하고, 파일 필터를 LastModifiedDate 적용하고, 마지막으로 새로 추가되었거나 마지막으로 업데이트된 파일만 대상 저장소에 복사합니다. Data Factory에서 많은 수의 파일을 검색하는 경우에는 오랜 시간이 소요됩니다. 파일 검색은 복사되는 데이터의 양이 적더라도 시간이 많이 소요됩니다.

참고

Data Factory가 처음인 경우 Azure Data Factory 소개를 참조하세요.

이 자습서에서는 다음 작업을 수행합니다.

- 데이터 팩터리를 만듭니다.

- 데이터 복사 도구를 사용하여 파이프라인 만들기

- 파이프라인 및 작업 실행을 모니터링합니다.

필수 조건

- Azure 구독: Azure 구독이 없는 경우 시작하기 전에 free 계정 만듭니다.

- Azure Storage 계정: 원본 및 싱크 데이터 저장소에 Blob Storage를 사용합니다. Azure Storage 계정이 없는 경우 스토리지 계정 만들기 지침을 따릅니다.

Blob Storage에 두 개의 컨테이너를 만듭니다.

자습서에 대비해 다음 단계를 완료하여 Blob Storage를 준비합니다.

원본이라는 컨테이너를 만듭니다. Azure Storage Explorer 같은 다양한 도구를 사용하여 이 작업을 수행할 수 있습니다.

대상이라는 컨테이너를 만듭니다.

데이터 팩터리 만들기

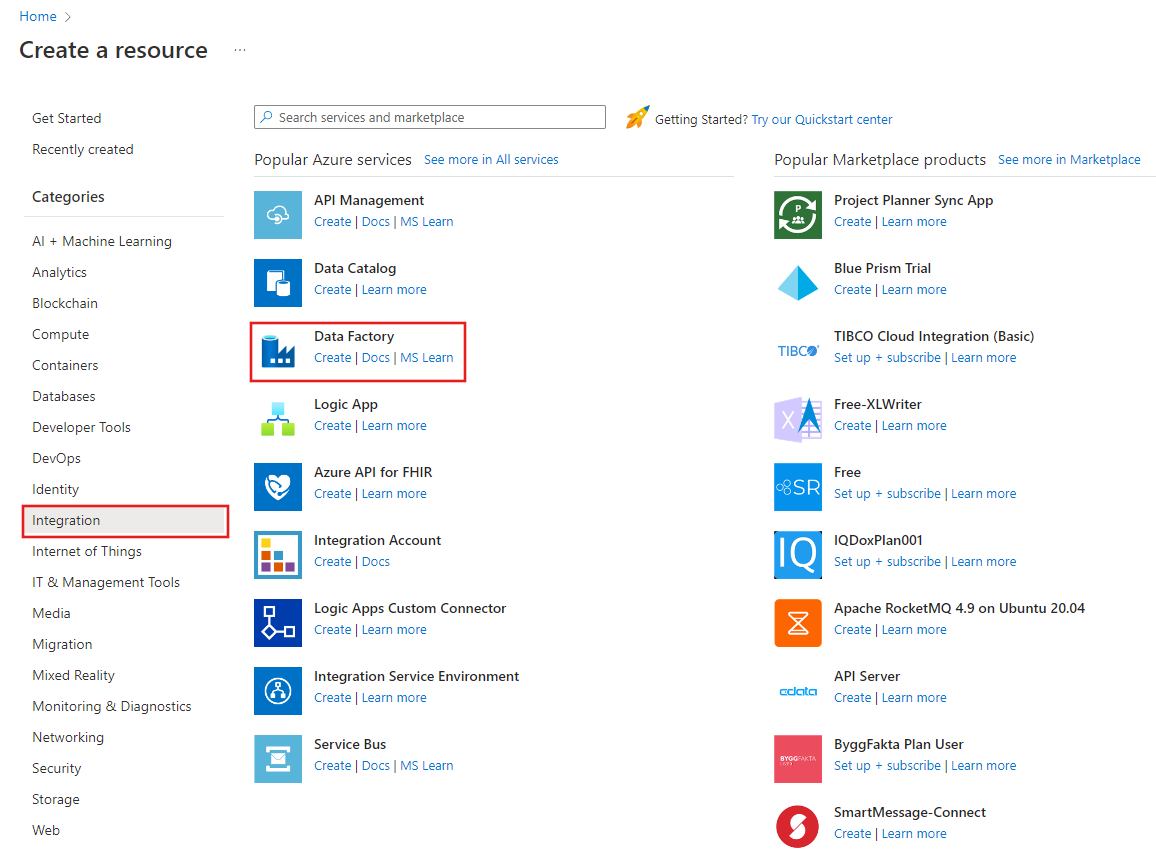

위쪽 메뉴에서 리소스 만들기>분석>데이터 팩터를 선택합니다.

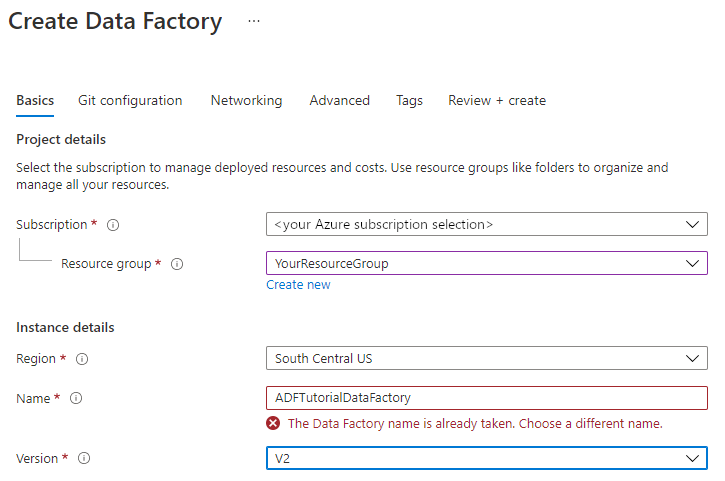

새 데이터 팩터리 페이지의 이름 아래에서 ADFTutorialDataFactory를 입력합니다.

데이터 팩터리 이름은 *전역으로 고유해야 합니다. 다음 오류 메시지가 표시될 수 있습니다.

이름 값에 대한 오류 메시지가 표시되면 데이터 팩터리에 대한 다른 이름을 입력합니다. 예를 들어 yournameADFTutorialDataFactory를 사용합니다. 데이터 팩터리 아티팩트에 대한 명명 규칙은 데이터 팩터리 명명 규칙을 참조하세요.

구독 아래에서 새 데이터 팩터리를 만들 Azure 구독을 선택합니다.

리소스 그룹에서 다음 단계 중 하나를 수행합니다.

기존 항목 사용을 선택한 다음 목록에서 기존 리소스 그룹을 선택합니다.

새로 만들기를 선택한 다음 리소스 그룹 이름을 입력합니다.

리소스 그룹에 대한 자세한 내용은 리소스 그룹을 사용하여 Azure 리소스 관리 참조하세요.

버전에서 V2를 선택합니다.

위치 아래에서 데이터 팩터리에 대한 위치를 선택합니다. 목록에는 지원되는 위치만 표시됩니다. 데이터 팩터리에서 사용하는 데이터 저장소(예: Azure Storage 및 Azure SQL Database) 및 컴퓨팅(예: Azure HDInsight)은 다른 위치와 지역에 있을 수 있습니다.

만들기를 선택합니다.

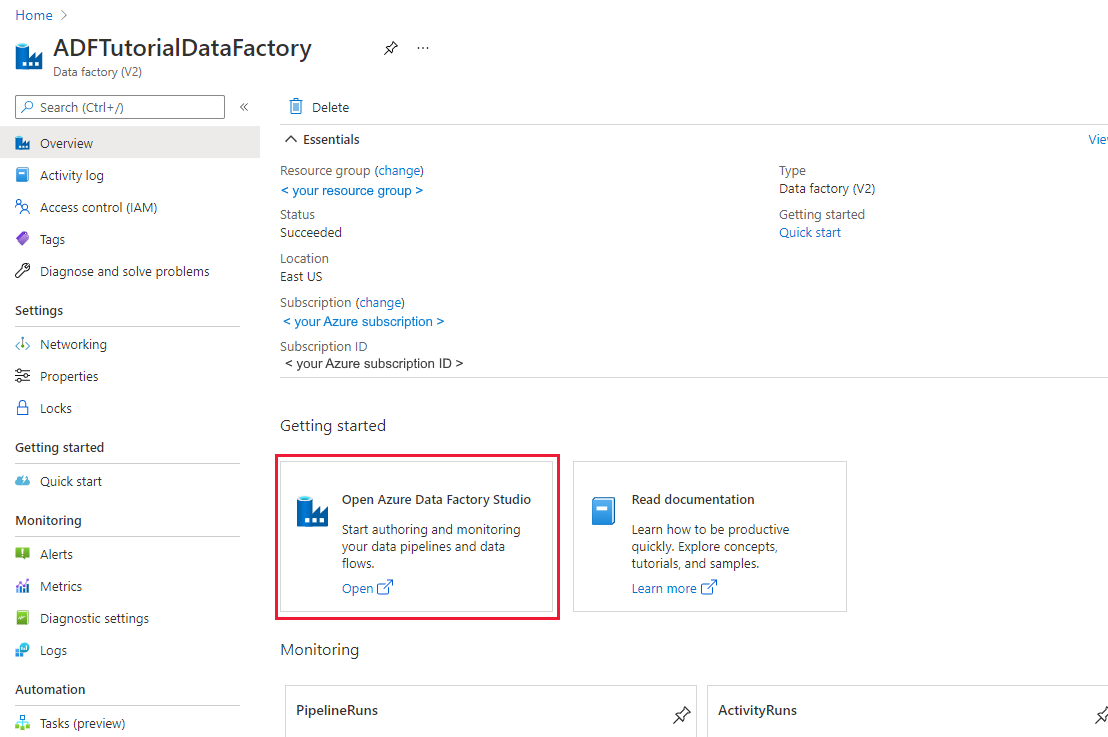

데이터 팩터리를 만든 후에는 데이터 팩터리 홈페이지가 나타납니다.

별도의 탭에서 Azure Data Factory UI(사용자 인터페이스)를 열려면 오펜 Azure Data Factory Studio> 타일에서 Open을 선택합니다.

데이터 복사 도구를 사용하여 파이프라인 만들기

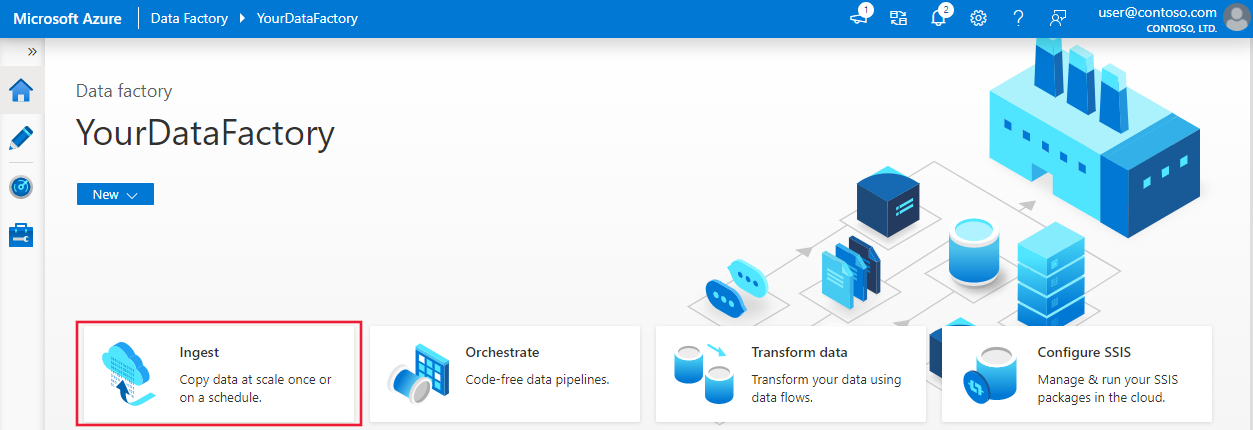

Azure Data Factory 홈페이지에서 수집 타일을 선택하여 데이터 복사 도구를 엽니다.

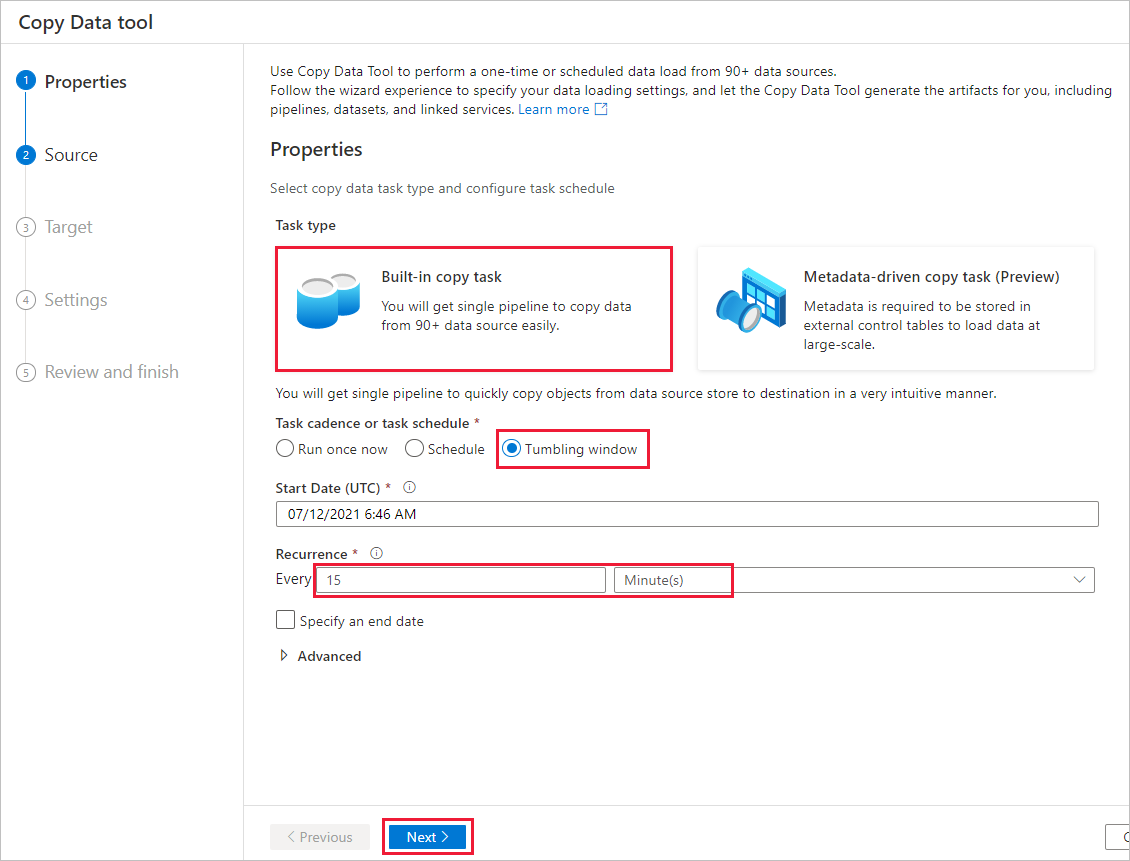

속성 페이지에서 다음 단계를 수행합니다.

작업 유형에서 기본 제공 복사 작업을 선택합니다.

작업 주기 또는 작업 일정에서 텀블링 윈도우를 선택합니다.

되풀이에서 15분을 입력합니다.

다음을 선택합니다.

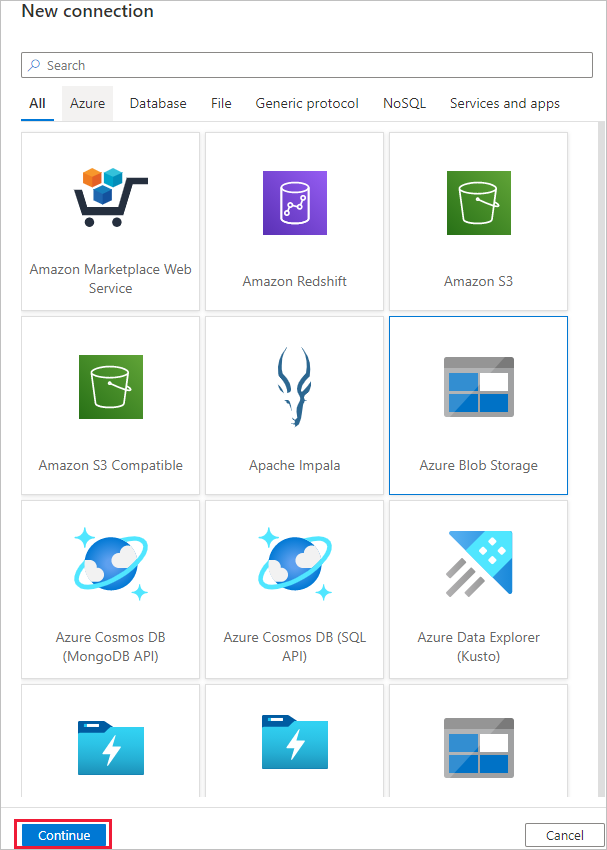

원본 데이터 저장소 페이지에서 다음 단계를 완료합니다.

+ 새 연결을 선택하여 연결을 추가합니다.

갤러리에서 Azure Blob Storage 선택한 다음, Continue 선택합니다.

새 연결(Azure Blob Storage) 페이지의 Azure 구독 목록에서 Azure 구독을 선택하고 저장소 계정 이름 목록에서 스토리지 계정을 선택합니다. 연결을 테스트한 다음 만들기를 선택합니다.

연결 블록에서 새로 만든 연결을 선택합니다.

파일 또는 폴더 섹션에서 찾아보기를 선택한 후 원본 폴더와 확인을 차례로 선택합니다.

파일 로드 동작에서 증분 로드: LastModifiedDate와 이진 복사를 차례로 선택합니다.

다음을 선택합니다.

대상 데이터 저장소 페이지에서 다음 단계를 완료합니다.

만든 AzureBlobStorage 연결을 선택합니다. 원본 데이터 저장소와 동일한 스토리지 계정입니다.

대상 경로 섹션에서 대상폴더를 찾아 선택한 다음 확인을 선택합니다.

다음을 선택합니다.

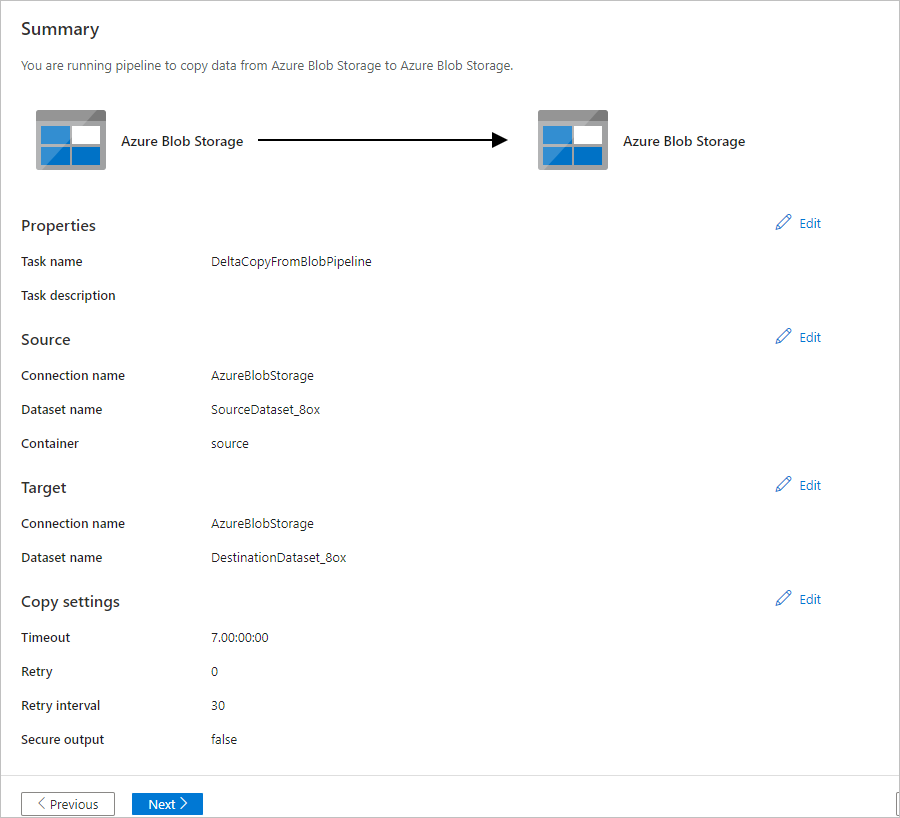

설정 페이지의 작업 이름에서 DeltaCopyFromBlobPipeline을 입력하고 다음을 선택합니다. Data Factory에서 지정한 작업 이름이 있는 파이프라인을 만듭니다.

요약 페이지에서 설정을 검토하고 다음을 선택합니다.

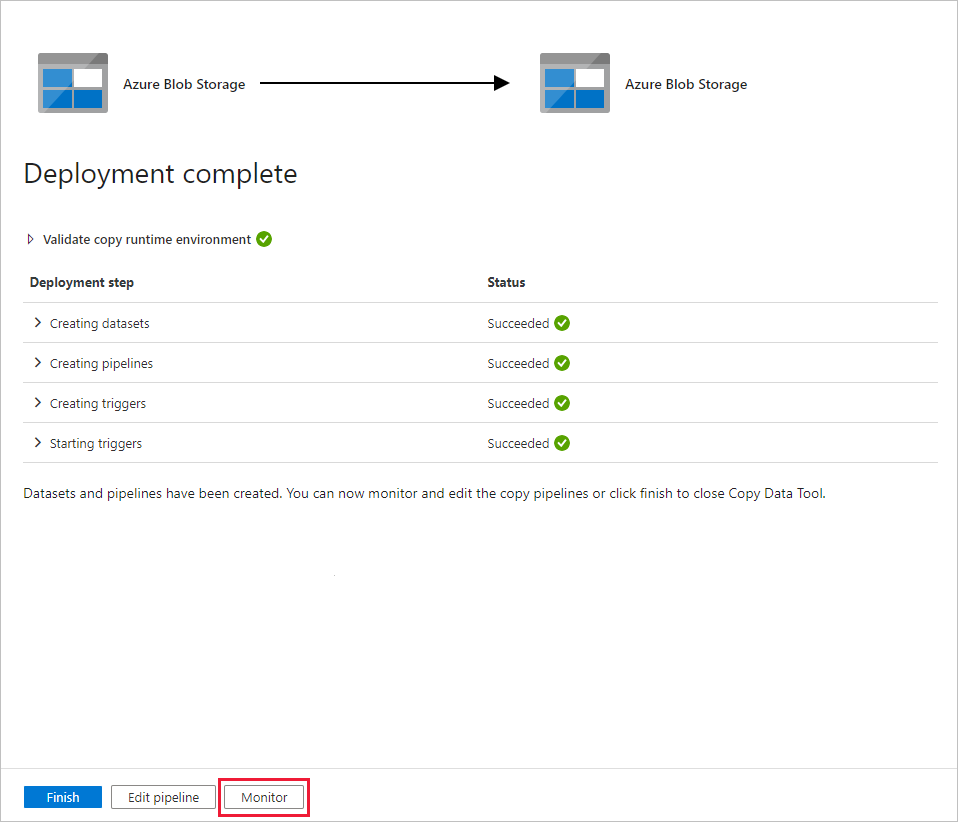

배포 페이지에서 모니터링을 선택하여 파이프라인(작업)을 모니터링합니다.

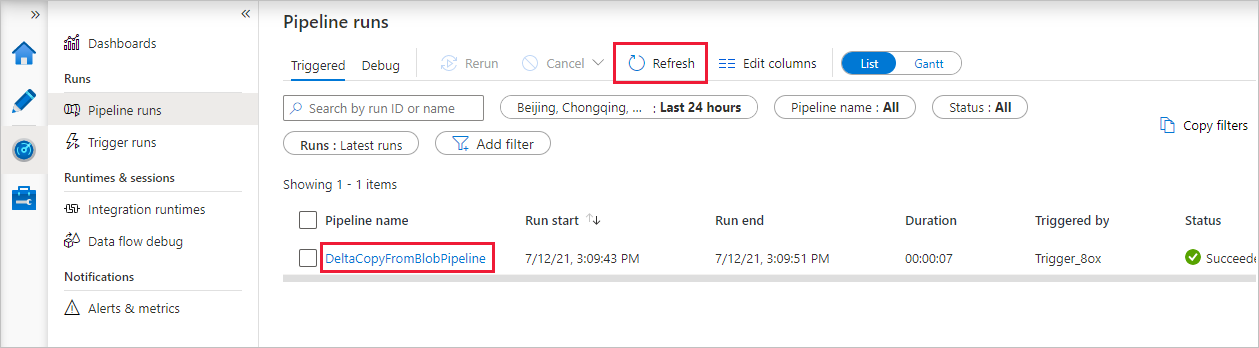

왼쪽의 모니터 탭이 자동으로 선택됩니다. 애플리케이션이 모니터 탭으로 전환됩니다. 파이프라인의 상태가 표시됩니다. 새로 고침을 선택하여 목록을 새로 고칩니다. 파이프라인 이름에서 링크를 선택하여 활동 실행 세부 정보를 보거나 파이프라인을 다시 실행합니다.

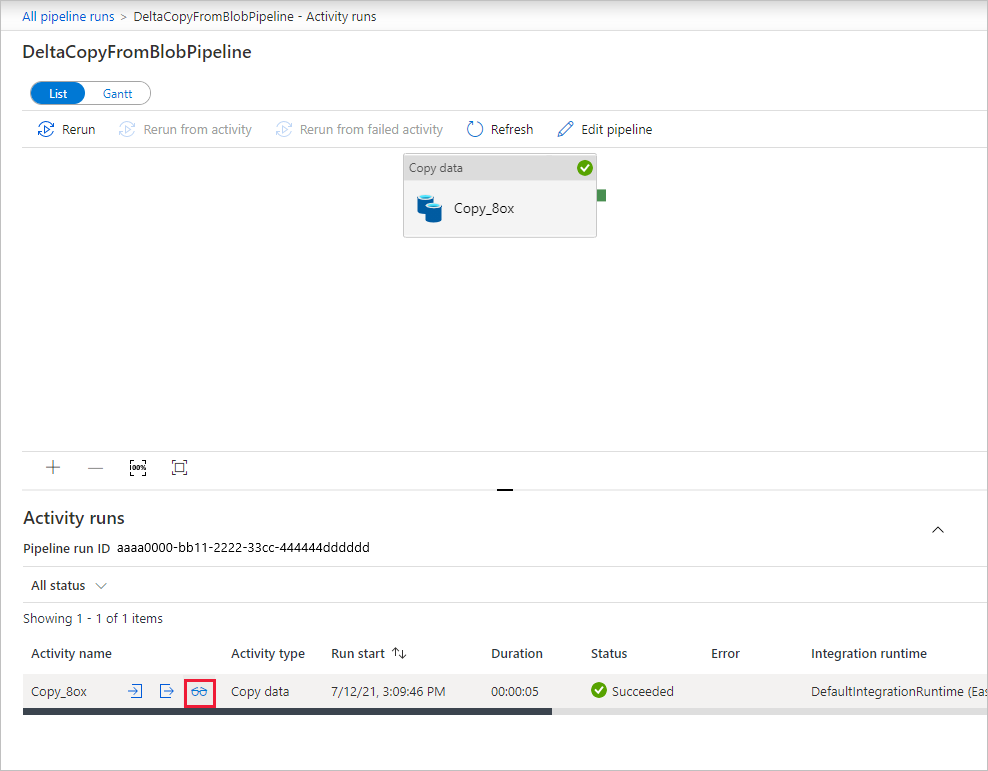

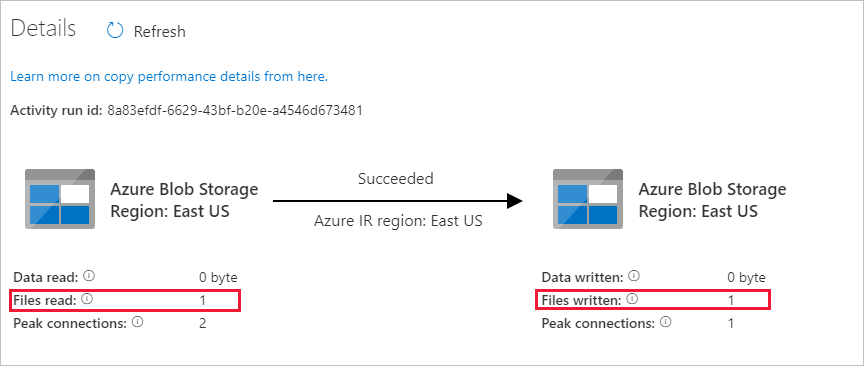

파이프라인에는 하나의 작업(복사 작업)만 있으므로 하나의 항목만 표시됩니다. 복사 작업에 대한 자세한 내용을 보려면 활동 실행 페이지에서 활동 이름 열에 있는 세부 정보 링크(안경 아이콘)를 선택합니다. 속성에 대한 자세한 내용은 Copy activity 개요 참조하세요.

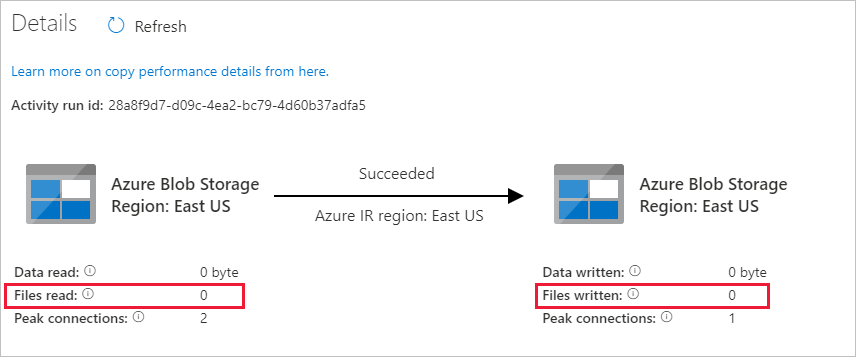

파이프라인의

Blob Storage 계정의 원본 컨테이너에 파일이 없기 때문에 계정에서 대상 컨테이너로 복사된 파일이 표시되지 않습니다.

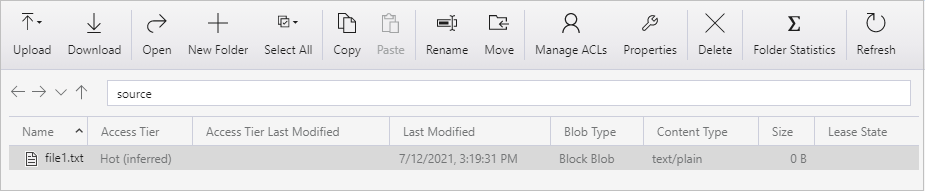

빈 텍스트 파일을 만들고 이름을 file1.txt로 합니다. 스토리지 계정의 원본 컨테이너에 이 텍스트 파일을 업로드합니다. Azure Storage Explorer 같은 다양한 도구를 사용하여 이러한 작업을 수행할 수 있습니다.

파이프라인 실행 보기로 돌아가려면 활동 실행 페이지의 이동 경로 메뉴에서 모든 파이프라인 실행 링크를 선택하고 동일한 파이프라인이 자동으로 다시 트리거될 때까지 기다립니다.

두 번째 파이프라인 실행이 완료되면 앞에서 설명한 것과 동일한 단계를 수행하여 작업 실행 세부 정보를 검토합니다.

원본 컨테이너에서 Blob Storage 계정의 대상 컨테이너로 하나의 파일(file1.txt)이 복사된 것을 볼 수 있습니다.

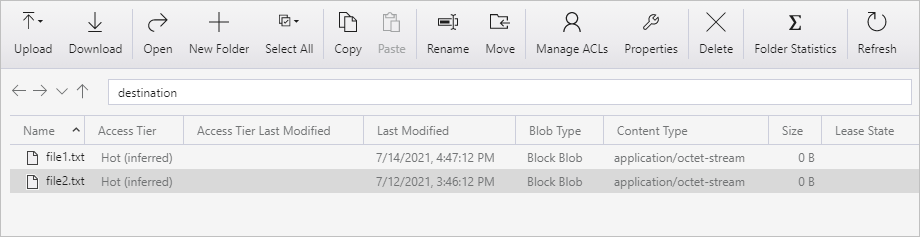

다른 빈 텍스트 파일을 만들고 이름을 file2.txt로 합니다. Blob Storage 계정의 원본 컨테이너에 이 텍스트 파일을 업로드합니다.

두 번째 텍스트 파일에서 11단계와 12단계를 반복합니다. 이 파이프라인을 실행하는 동안 새 파일(file2.txt)만 원본 컨테이너에서 스토리지 계정의 대상 컨테이너로 복사된 것을 볼 수 있습니다.

또한 Azure Storage Explorer 사용하여 파일을 검사하여 하나의 파일만 복사되었는지 확인할 수 있습니다.

를 사용하여 파일을 스캔합니다.

를 사용하여 파일을 스캔합니다.

관련 콘텐츠

다음 자습서로 이동하여 Azure Apache Spark 클러스터를 사용하여 데이터를 변환하는 방법을 알아봅니다.