우선 순위 처리는 종량제의 유연성과 함께 짧은 대기 시간 성능을 제공합니다. 이 문서에서는 모델 배포에서 우선 순위 처리를 사용하도록 설정하고, 요청을 처리한 서비스 계층을 확인하고, 관련 비용을 모니터링합니다.

필수 구성 요소

- Azure 구독 - 무료로 구독 만들기.

- Microsoft Foundry 프로젝트에서 배포 유형

GlobalStandard또는DataZoneStandard의 모델이 배포되었습니다. - 모델 버전

2025-12-01이상.

주요 사용 사례

- 응답성이 뛰어난 사용자 환경에 대한 일관되고 짧은 대기 시간.

- 장기 약정 없이 종량제를 간편하게.

- 비즈니스 운영 시간 또는 버스트 트래픽이 확장 가능하고 비용 효율적인 성능의 이점을 누릴 수 있습니다. 필요에 따라 안정적인 상태 용량 및 비용 최적화를 위해 우선 순위 처리를 PTU(프로비전된 처리량 단위)와 결합할 수 있습니다.

대기 시간 대상

| 모델 | 대기 시간 대상 값2 |

|---|---|

| gpt-5.5, 2026-04-24 | 99% > 초당 100토큰 |

| gpt-5.4, 2026-03-051 | 99% > 초당 50개의 토큰 |

| gpt-5.2, 2025-12-11 | 99% > 초당 50개의 토큰 |

| gpt-5.1, 2025-11-13 | 99% > 초당 50개의 토큰 |

| gpt-4.1, 2025-04-141 | 99% > 초당 80 토큰 |

1 긴 컨텍스트 요청(즉, 128k 프롬프트 토큰보다 큰 것으로 추정되는 요청)은 표준 처리로 다운그레이드되며 표준 계층 속도로 요금이 청구됩니다.

2 5분 단위로 p50 요청 대기 시간으로 계산됩니다.

배포 유형별 우선 순위 처리 가용성

우선 순위 처리는 글로벌 표준 배포 또는 미국(데이터 영역 표준) 배포에서 사용할 수 있습니다. 가격 책정 정보는 Azure OpenAI 가격 책정 페이지 참조하세요.

글로벌 표준 모델 가용성

| 지역 | gpt-5.5, 2026-04-24 | gpt-5.4-mini, 2026-03-17 | gpt-5.4, 2026-03-05 | gpt-5.2, 2025-12-11 | gpt-5.1, 2025-11-13 | gpt-4.1, 2025-04-14 |

|---|---|---|---|---|---|---|

| australiaeast | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| brazilsouth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| canadacentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| 캐나다이스트 | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| centralus | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| eastus | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| eastus2 | ✅ | ✅ | ✅ | ✅ | ✅ | - |

| francecentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| 독일웨스트센트럴 | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| italynorth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| japaneast | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| koreacentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| northcentralus | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| 노르웨이 동부 | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| polandcentral | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| southafricanorth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| southcentralus | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| 동남 아시아 | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| 남인도 | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| spaincentral | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| swedencentral | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ |

| switzerlandnorth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| 스위스웨스트 | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| uaenorth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| uksouth | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| westeurope | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| westus | - | ✅ | ✅ | ✅ | ✅ | ✅ |

| westus3 | - | ✅ | ✅ | ✅ | ✅ | ✅ |

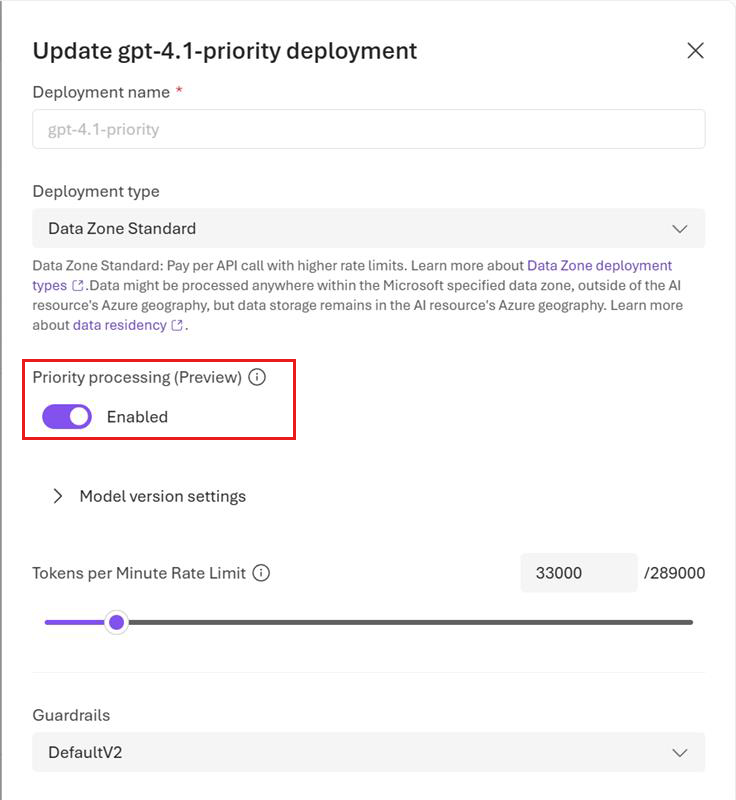

배포 수준에서 우선 순위 처리 사용

배포 수준 및 요청 수준에서(선택 사항) 우선 순위 처리를 사용하도록 설정할 수 있습니다.

참고

우선 순위 처리는 글로벌 표준 또는 미국(데이터 영역 표준) 배포에서 사용할 수 있습니다. 우선 순위 처리는 표준 처리와 동일한 할당량을 사용합니다.

Microsoft Foundry 포털에서 배포를 만들 때 배포 세부 정보 페이지에서 Priority 처리 토글을 켜거나 배포 세부 정보를 편집하여 배포된 모델의 설정을 업데이트합니다.

참고

코드를 사용하여 배포 수준에서 우선 순위 처리를 사용하도록 설정하려는 경우 다음과 같이 특성을 설정 service_tier 하여 배포용 REST API를 통해 수행할 수 있습니다 "properties" : {"service_tier" : "priority"}. 특성에 허용되는 값은 service_tier 다음과 같습니다 defaultpriority.

default 는 표준 처리를 의미하지만 priority 우선 순위 처리를 사용하도록 설정합니다.

우선 순위 처리를 사용하도록 모델 배포가 구성되면 모델에 요청을 보내기 시작할 수 있습니다.

사용 현황 메트릭 보기

Azure 포털의 Azure Monitor 섹션에서 리소스의 사용률 측정값을 볼 수 있습니다.

표준 처리 및 우선 순위 처리로 처리되는 요청의 볼륨을 보려면 원래 요청에 있던 서비스 계층(표준 또는 우선 순위)으로 분할합니다.

- 에 로그인합니다 https://portal.azure.com.

- Azure OpenAI 리소스로 이동하고 왼쪽 탐색 창에서 Metrics 옵션을 선택합니다.

- 메트릭 페이지에서 Azure OpenAI 요청 메트릭을 추가합니다. Azure OpenAI 대기 시간Azure OpenAI 사용량 등의 다른 메트릭을 선택할 수도 있습니다.

- 필터 추가를 선택하여 우선 순위 처리 요청이 처리된 표준 배포를 선택합니다.

- 분할 적용을 선택하여 ServiceTierRequest 및 ServiceTierResponse로 값을 분할합니다.

배포 모니터링에 대한 자세한 내용은 모니터 Azure OpenAI 참조하세요.

비용 모니터링

다음과 같이 배포 이름 및 청구 태그를 필터링하여 Azure Portal의 비용 분석 페이지에서 우선 순위 및 표준 요청에 대한 비용 분석을 확인할 수 있습니다.

- Azure 포털 비용 분석 페이지로 이동합니다.

- (선택 사항) 리소스별로 필터링합니다.

- 배포 이름으로 필터링하려면: 청구 태그> 에 대한 필터를 추가하고 배포 를 값으로 선택한 다음 배포 이름을 선택합니다.

우선 순위 처리에 대한 가격 책정에 대한 자세한 내용은 Azure OpenAI Service 가격 책정 개요 참조하세요.

요청 수준에서 우선 순위 처리 사용

요청 수준에서 우선 순위 처리를 사용하도록 설정하는 것은 선택 사항입니다. 채팅 완료 API와 응답 API에는 모두 요청을 처리할 때 사용할 처리 유형을 지정하는 선택적 특성 service_tier 이 있습니다. 다음 예제에서는 응답 요청에서 설정하는 service_tierpriority 방법을 보여 줍니다.

curl -X POST https://YOUR-RESOURCE-NAME.openai.azure.com/openai/v1/responses \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $AZURE_OPENAI_AUTH_TOKEN" \

-d '{

"model": "gpt-4.1",

"input": "This is a test",

"service_tier": "priority"

}'

service_tier 특성을 사용하여 배포 수준 설정을 재정의합니다.

service_tier는 값을 autodefault사용할 수 있습니다priority.

특성을 설정하지 않으면 기본값은 .입니다

auto.service_tier = auto는 요청이 배포에 구성된 서비스 계층을 사용한다는 것을 의미합니다.service_tier = default는 요청이 선택한 모델에 대한 표준 가격 책정 및 성능을 사용한다는 것을 의미합니다.service_tier = priority는 요청이 우선 순위 처리 서비스 계층을 사용한다는 것을 의미합니다.

다음 표에는 배포 수준 및 요청 수준 설정에 따라 요청을 처리하는 서비스 계층이 요약되어 있습니다 service_tier.

| 배포 수준 설정 | 요청 수준 설정 | 서비스 계층에서 처리된 요청 |

|---|---|---|

| 기본 | 자동(auto), 기본값(default) | 표준 |

| 기본 | 우선 순위 | 우선 순위 처리 |

| 우선 순위 | 자동, 우선순위 | 우선 순위 처리 |

| 우선 순위 | 기본 | 표준 |

제한

이 서비스는 현재 지역 표준 배포 및 EU 데이터 영역 표준 배포를 지원하지 않습니다.

서비스는 이러한 시나리오 중에 일부 우선 순위 요청을 표준 처리*로 다시 라우팅할 수 있습니다.

- 분당 우선 순위 처리 토큰이 급격히 증가하면 램프 속도 제한에 도달합니다. 현재 램프 속도 제한은 15분 이내에 분당 50% 이상의 토큰에 의해 트래픽이 증가하는 것으로 정의됩니다.

- 우선 순위 처리에 대한 최대 요청 기간 동안.

- 대기 시간 대상 테이블에 나열된 특정 모델로 전송되는 긴 컨텍스트 요청입니다.

팁

램프 속도 제한이 일상적으로 발생하는 경우 우선 순위 처리 대신 또는 PTU를 구매하는 것이 좋습니다.

표준 서비스 계층에서 처리된 요청은 표준 요금으로 청구됩니다. 표준 서비스 계층에서 처리된 요청은 응답에

service_tier = default이 포함되고, 우선 순위 처리 계층에서 처리된 요청은 응답에service_tier = priority이 포함됩니다.

문제 해결

| 문제 | 원인 | 해상도 |

|---|---|---|

| 표준 계층으로 다운그레이드된 요청 | 다음 상황 중 하나: - 트래픽이 15분 안에 분당 토큰 수가 50% 이상 증가하여 상승 비율 제한에 도달했습니다. - 우선 순위 처리에 대한 최대 요청 기간 동안 전송된 요청입니다. - 대기 시간 대상 테이블에 나열된 특정 모델로 전송되는 긴 컨텍스트 요청입니다. |

- 램프 속도 제한에 도달한 경우 트래픽을 점진적으로 늘입니다. - 안정적인 상태 용량을 위해 PTU를 구매하는 것이 좋습니다. |