이미지 처리를 위해 미리 학습된 TensorFlow 모델을 사용하여 이미지를 분류하도록 분류 모델을 학습하는 방법을 알아봅니다.

TensorFlow 모델은 이미지를 천 개의 범주로 분류하도록 학습되었습니다. TensorFlow 모델은 이미지의 패턴을 인식하는 방법을 알고 있으므로 ML.NET 모델은 파이프라인의 일부를 사용하여 원시 이미지를 기능 또는 입력으로 변환하여 분류 모델을 학습시킬 수 있습니다.

이 튜토리얼에서는 다음을 배우게 됩니다:

- 문제 이해

- 미리 학습된 TensorFlow 모델을 ML.NET 파이프라인에 통합

- ML.NET 모델 학습 및 평가

- 테스트 이미지 분류

이 자습서의 소스 코드는 dotnet/samples 리포지토리에서 찾을 수 있습니다. 기본적으로 이 자습서의 .NET 프로젝트 구성은 .NET Core 2.2를 대상으로 합니다.

필수 조건

올바른 기계 학습 작업 선택

딥 러닝

딥 러닝 은 컴퓨터 비전 및 음성 인식과 같은 영역에 혁명을 일으키고 있는 Machine Learning의 하위 집합입니다.

딥 러닝 모델은 여러 학습 계층을 포함하는 레이블이 지정된 큰 데이터 및 신경망 집합을 사용하여 학습됩니다. 딥 러닝:

- 컴퓨터 비전과 같은 일부 작업에서 더 나은 성능을 발휘합니다.

- 엄청난 양의 학습 데이터가 필요합니다.

이미지 분류는 이미지를 다음과 같은 범주로 자동으로 분류할 수 있는 특정 분류 작업입니다.

- 이미지에서 사람의 얼굴 감지 여부

- 고양이와 개 검색

또는 다음 이미지에서와 같이 이미지가 음식, 토이 또는 어플라이언스인지 확인합니다.

비고

위의 이미지는 Wikimedia Commons에 속하며 다음과 같이 특성이 지정됩니다.

- "220px-Pepperoni_pizza.jpg" Public Domain, https://commons.wikimedia.org/w/index.php?curid=79505,

- "119px-Nalle_-_a_small_brown_teddy_bear.jpg" Jonik 에 의해 - 자기 사진, CC BY-SA 2.0, https://commons.wikimedia.org/w/index.php?curid=48166.

- "193px-Broodrooster.jpg" 작성자 M.Minderhoud - 자신의 작품, CC BY-SA 3.0, https://commons.wikimedia.org/w/index.php?curid=27403

이미지 분류 모델을 처음부터 학습하려면 수백만 개의 매개 변수, 수많은 레이블이 지정된 학습 데이터 및 방대한 양의 컴퓨팅 리소스(수백 시간)를 설정해야 합니다. 사용자 지정 모델을 처음부터 학습하는 것만큼 효과적이지는 않지만 미리 학습된 모델을 사용하면 수천 개의 이미지와 수백만 개의 레이블이 지정된 이미지로 작업하여 이 프로세스를 바로 가기로 하고 GPU가 없는 컴퓨터에서 1시간 이내에 상당히 빠르게 사용자 지정된 모델을 빌드할 수 있습니다. 이 자습서에서는 12개의 학습 이미지만 사용하여 해당 프로세스를 더욱 축소합니다.

이미지를 Inception model 천 개의 범주로 분류하도록 학습되지만 이 자습서에서는 더 작은 범주 집합 및 해당 범주에서만 이미지를 분류해야 합니다. 이미지를 인식하고 사용자 지정 이미지 분류자의 제한된 새 범주로 분류하는 기능을 사용할 Inception model수 있습니다.

- 음식

- 장난감

- 가전제품

이 자습서에서는 데이터 세트에서 학습된 인기 있는 이미지 인식 모델인 TensorFlow ImageNet 딥 러닝 모델을 사용합니다. TensorFlow 모델은 전체 이미지를 "Umbrella", "Jersey" 및 "Dishwasher"와 같은 천 개의 클래스로 분류합니다.

Inception model 이미 수천 개의 다른 이미지에 미리 학습되었으므로 내부적으로 이미지 식별에 필요한 이미지 기능이 포함되어 있습니다. 모델에서 이러한 내부 이미지 기능을 사용하여 클래스 수가 훨씬 적은 새 모델을 학습시킬 수 있습니다.

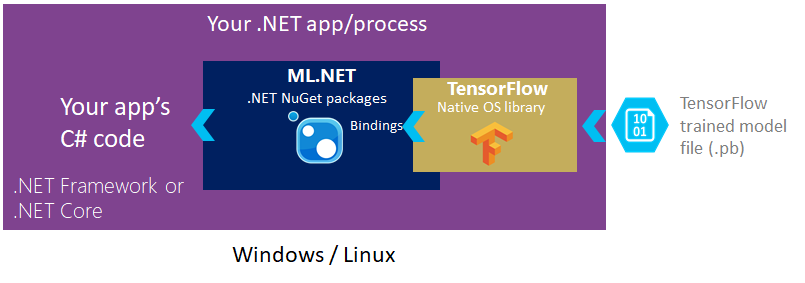

다음 다이어그램과 같이 .NET 또는 .NET Framework 애플리케이션의 ML.NET NuGet 패키지에 대한 참조를 추가합니다. ML.NET 기존 학습된 TensorFlow 모델 파일을 로드하는 코드를 작성할 수 있는 네이티브 TensorFlow 라이브러리를 포함하고 참조합니다.

다중 클래스 분류

TensorFlow 시작 모델을 사용하여 클래식 기계 학습 알고리즘에 대한 입력으로 적합한 기능을 추출한 후 ML.NET 다중 클래스 분류자를 추가합니다.

이 경우에 사용되는 특정 트레이너는 다항 로지스틱 회귀 알고리즘입니다.

이 트레이너가 구현한 알고리즘은 이미지 데이터에서 작동하는 딥 러닝 모델의 경우 많은 기능의 문제에 대해 잘 수행됩니다.

자세한 내용은 딥 러닝과 기계 학습을 참조하세요.

데이터

파일과 이미지 파일의 .tsv 두 가지 데이터 원본이 있습니다. 파일에는 tags.tsv 두 개의 열이 포함됩니다. 첫 번째 열은 ImagePath로 정의된 것이고, 두 번째 열은 이미지를 Label로 나타냅니다. 다음 예제 파일에는 머리글 행이 없으며 다음과 같습니다.

broccoli.jpg food

pizza.jpg food

pizza2.jpg food

teddy2.jpg toy

teddy3.jpg toy

teddy4.jpg toy

toaster.jpg appliance

toaster2.png appliance

학습 및 테스트 이미지는 zip 파일에서 다운로드할 자산 폴더에 있습니다. 이러한 이미지는 위키미디어 공용에 속합니다.

무료 미디어 리포지토리인 위키미디어 공용. 2018년 10월 17일 10:48에 검색된 내용: https://commons.wikimedia.org/wiki/Pizzahttps://commons.wikimedia.org/wiki/Toasterhttps://commons.wikimedia.org/wiki/Teddy_bear

설치 프로그램

프로젝트 만들기

"TransferLearningTF"라는 C# 콘솔 애플리케이션 을 만듭니다. 다음 단추를 클릭합니다.

사용할 프레임워크로 .NET 8을 선택합니다. 만들기 버튼을 클릭합니다.

Microsoft.ML NuGet 패키지를 설치합니다.

비고

이 샘플에서는 달리 명시되지 않는 한 언급된 안정적인 최신 버전의 NuGet 패키지를 사용합니다.

- 솔루션 탐색기에서 프로젝트를 마우스 오른쪽 단추로 클릭하고 NuGet 패키지 관리를 선택합니다.

- 패키지 원본으로 "nuget.org"을 선택하고 찾아보기 탭을 선택하고 Microsoft.ML 검색합니다.

- 설치 단추를 선택합니다.

- 변경 내용 미리 보기 대화 상자에서 확인 단추를 선택합니다.

- 나열된 패키지의 사용 조건에 동의하는 경우 라이선스 승인 대화 상자에서 동의 단추를 선택합니다.

- Microsoft.ML.ImageAnalytics, SciSharp.TensorFlow.Redist 및 Microsoft.ML.TensorFlow에 대해 이러한 단계를 반복합니다.

자산 다운로드

프로젝트 자산 디렉터리 zip 파일을 다운로드하고 압축을 풉니다.

assets디렉터리를 TransferLearningTF 프로젝트 디렉터리에 복사합니다. 이 디렉터리와 해당 하위 디렉터리에는 이 자습서에 필요한 데이터 및 지원 파일(다음 단계에서 다운로드하여 추가할 Inception 모델 제외)이 포함됩니다.Inception 모델을 다운로드하고 압축을 풉

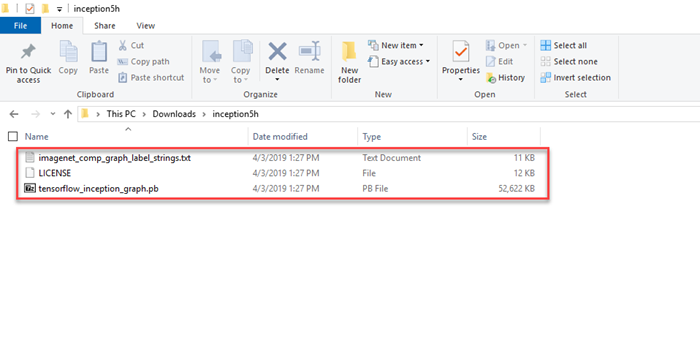

압축을 푼

inception5h디렉터리의 내용을 TransferLearningTF 프로젝트assets/inception디렉터리에 복사합니다. 이 디렉터리에는 다음 이미지와 같이 이 자습서에 필요한 모델 및 추가 지원 파일이 포함되어 있습니다.

솔루션 탐색기에서 자산 디렉터리 및 하위 디렉터리의 각 파일을 마우스 오른쪽 단추로 클릭하고 속성을 선택합니다. 고급 탭에서 출력 디렉터리에 복사 설정을 새 버전인 경우에만 복사로 변경합니다.

클래스 만들기 및 경로 정의

using파일의 맨 위에 다음 추가 지시문을 추가합니다.using Microsoft.ML; using Microsoft.ML.Data;지시문 바로 아래

using줄에 다음 코드를 추가하여 자산 경로를 지정합니다.string _assetsPath = Path.Combine(Environment.CurrentDirectory, "assets"); string _imagesFolder = Path.Combine(_assetsPath, "images"); string _trainTagsTsv = Path.Combine(_imagesFolder, "tags.tsv"); string _testTagsTsv = Path.Combine(_imagesFolder, "test-tags.tsv"); string _predictSingleImage = Path.Combine(_imagesFolder, "toaster3.jpg"); string _inceptionTensorFlowModel = Path.Combine(_assetsPath, "inception", "tensorflow_inception_graph.pb");입력 데이터 및 예측에 대한 클래스를 만듭니다.

public class ImageData { [LoadColumn(0)] public string? ImagePath; [LoadColumn(1)] public string? Label; }ImageData는 입력 이미지 데이터 클래스이며 다음 String 필드가 있습니다.-

ImagePath에는 이미지 파일 이름이 포함됩니다. -

Label에는 이미지 레이블의 값이 포함됩니다.

-

다음을 위해 프로젝트에 새 클래스를

ImagePrediction추가합니다.public class ImagePrediction : ImageData { public float[]? Score; public string? PredictedLabelValue; }ImagePrediction는 이미지 예측 클래스이며 다음 필드가 있습니다.-

Score에는 지정된 이미지 분류에 대한 신뢰도 백분율이 포함됩니다. -

PredictedLabelValue에는 예측된 이미지 분류 레이블의 값이 포함됩니다.

ImagePrediction는 모델을 학습한 후 예측에 사용되는 클래스입니다. 이미지 경로에string(ImagePath)이 있습니다. 모델을Label다시 사용하고 학습하는 데 사용됩니다. 예측PredictedLabelValue및 평가 중에 사용됩니다. 평가를 위해 학습 데이터, 예측 값 및 모델이 있는 입력이 사용됩니다.-

변수 초기화

새 인스턴스를 사용하여

mlContext변수를 초기화합니다MLContext.Console.WriteLine("Hello World!")줄을 다음 코드로 바꿉다.MLContext mlContext = new MLContext();클래스는 MLContext 모든 ML.NET 작업의 시작점이며 초기화

mlContext하면 모델 생성 워크플로 개체 간에 공유할 수 있는 새 ML.NET 환경이 만들어집니다. 개념적으로DBContextEntity Framework와 유사합니다.

Inception 모델 매개 변수에 대한 구조체 만들기

Inception 모델에는 전달해야 하는 몇 가지 매개 변수가 있습니다. 변수를 초기화한 직후 다음 코드를 사용하여 매개 변수 값을 친숙한 이름에 매핑하는 구조체를

mlContext만듭니다.struct InceptionSettings { public const int ImageHeight = 224; public const int ImageWidth = 224; public const float Mean = 117; public const float Scale = 1; public const bool ChannelsLast = true; }

디스플레이 유틸리티 메서드 만들기

이미지 데이터와 관련 예측을 두 번 이상 표시하므로 이미지 및 예측 결과 표시를 처리하는 디스플레이 유틸리티 메서드를 만듭니다.

DisplayResults()다음 코드를 사용하여 구조체 바로 다음에InceptionSettings메서드를 만듭니다.void DisplayResults(IEnumerable<ImagePrediction> imagePredictionData) { }메서드의 본문을 채웁니다.

DisplayResultsforeach (ImagePrediction prediction in imagePredictionData) { Console.WriteLine($"Image: {Path.GetFileName(prediction.ImagePath)} predicted as: {prediction.PredictedLabelValue} with score: {prediction.Score?.Max()} "); }

예측을 만드는 메서드 만들기

ClassifySingleImage()다음 코드를 사용하여 메서드 바로 앞에DisplayResults()메서드를 만듭니다.void ClassifySingleImage(MLContext mlContext, ITransformer model) { }단일

ImagePath에 대한 전체 경로 및 이미지 파일 이름을 포함하는ImageData객체를 생성합니다. 메서드의 다음 줄ClassifySingleImage()로 다음 코드를 추가합니다.var imageData = new ImageData() { ImagePath = _predictSingleImage };다음 코드를 메서드의 다음 줄

ClassifySingleImage로 추가하여 단일 예측을 수행합니다.// Make prediction function (input = ImageData, output = ImagePrediction) var predictor = mlContext.Model.CreatePredictionEngine<ImageData, ImagePrediction>(model); var prediction = predictor.Predict(imageData);예측을 얻으려면 Predict() 메서드를 사용합니다. PredictionEngine은 단일 데이터 인스턴스에서 예측을 수행할 수 있는 편리한 API입니다.

PredictionEngine가 스레드로부터 안전하지 않습니다. 단일 스레드 또는 프로토타입 환경에서 사용할 수 있습니다. 프로덕션 환경에서 성능 및 스레드 안전성 향상을PredictionEnginePool위해 애플리케이션 전체에서 사용할 개체를ObjectPool만드는PredictionEngine서비스를 사용합니다. ASP.NET Core Web API에서 사용하는PredictionEnginePool방법에 대한 이 가이드를 참조하세요.비고

PredictionEnginePool서비스 확장은 현재 미리 보기로 제공됩니다.예측 결과를 메서드의 다음 코드

ClassifySingleImage()줄로 표시합니다.Console.WriteLine($"Image: {Path.GetFileName(imageData.ImagePath)} predicted as: {prediction.PredictedLabelValue} with score: {prediction.Score?.Max()} ");

ML.NET 모델 파이프라인 생성

ML.NET 모델 파이프라인은 예측 도구 체인입니다. 파이프라인 생성 중에 실행이 발생하지 않습니다. 추정기 개체는 만들어지지만 실행되지는 않습니다.

모델을 생성하는 메서드 추가

이 방법은 자습서의 핵심입니다. 모델에 대한 파이프라인을 만들고 파이프라인을 학습하여 ML.NET 모델을 생성합니다. 또한 이전에 볼 수 없었던 일부 테스트 데이터에 대해 모델을 평가합니다.

GenerateModel()메서드를 생성합니다.InceptionSettings구조체 바로 뒤에, 그리고DisplayResults()메서드 바로 앞에 다음 코드를 사용하십시오.ITransformer GenerateModel(MLContext mlContext) { }추정기를 추가하여 이미지 데이터에서 픽셀을 로드, 크기 조정 및 추출합니다.

IEstimator<ITransformer> pipeline = mlContext.Transforms.LoadImages(outputColumnName: "input", imageFolder: _imagesFolder, inputColumnName: nameof(ImageData.ImagePath)) // The image transforms transform the images into the model's expected format. .Append(mlContext.Transforms.ResizeImages(outputColumnName: "input", imageWidth: InceptionSettings.ImageWidth, imageHeight: InceptionSettings.ImageHeight, inputColumnName: "input")) .Append(mlContext.Transforms.ExtractPixels(outputColumnName: "input", interleavePixelColors: InceptionSettings.ChannelsLast, offsetImage: InceptionSettings.Mean))이미지 데이터는 TensorFlow 모델에서 예상하는 형식으로 처리되어야 합니다. 이 경우 이미지는 메모리에 로드되고 일관된 크기로 크기가 조정되며 픽셀은 숫자 벡터로 추출됩니다.

추정기를 추가하여 TensorFlow 모델을 로드하고 점수를 매깁니다.

.Append(mlContext.Model.LoadTensorFlowModel(_inceptionTensorFlowModel). ScoreTensorFlowModel(outputColumnNames: new[] { "softmax2_pre_activation" }, inputColumnNames: new[] { "input" }, addBatchDimensionInput: true))파이프라인의 이 단계에서는 TensorFlow 모델을 메모리에 로드한 다음 TensorFlow 모델 네트워크를 통해 픽셀 값의 벡터를 처리합니다. 딥 러닝 모델에 입력을 적용하고 모델을 사용하여 출력을 생성하는 것을 점수 매기기라고 합니다. 모델을 전체적으로 사용하는 경우 점수 매기기에서 유추 또는 예측을 만듭니다.

이 경우 유추를 만드는 계층인 마지막 계층을 제외한 모든 TensorFlow 모델을 사용합니다. 끝에서 두 번째 계층의 출력은

softmax_2_preactivation로 레이블이 지정됩니다. 이 계층의 출력은 원래 입력 이미지의 특징을 지정하는 기능의 벡터입니다.TensorFlow 모델에서 생성된 이 기능 벡터는 ML.NET 학습 알고리즘에 대한 입력으로 사용됩니다.

계산기를 추가하여 학습 데이터의 문자열 레이블을 정수 키 값에 매핑합니다.

.Append(mlContext.Transforms.Conversion.MapValueToKey(outputColumnName: "LabelKey", inputColumnName: "Label"))다음에 추가되는 ML.NET 트레이너는 레이블이 임의의 문자열이 아닌 형식이어야

key합니다. 키는 문자열 값에 대한 일대일 매핑이 있는 숫자입니다.ML.NET 학습 알고리즘을 추가합니다.

.Append(mlContext.MulticlassClassification.Trainers.LbfgsMaximumEntropy(labelColumnName: "LabelKey", featureColumnName: "softmax2_pre_activation"))예측 키 값을 문자열에 다시 매핑하는 추정기를 추가합니다.

.Append(mlContext.Transforms.Conversion.MapKeyToValue("PredictedLabelValue", "PredictedLabel")) .AppendCacheCheckpoint(mlContext);

모델을 훈련시키다

LoadFromTextFile 래퍼를 사용하여 학습 데이터를 로드합니다. 메서드의 다음 줄

GenerateModel()로 다음 코드를 추가합니다.IDataView trainingData = mlContext.Data.LoadFromTextFile<ImageData>(path: _trainTagsTsv, hasHeader: false);ML.NET 데이터는 IDataView 인터페이스로 표시됩니다.

IDataView는 테이블 형식 데이터(숫자 및 텍스트)를 유연하고 효율적으로 설명하는 방법입니다. 데이터는 텍스트 파일에서 로드되거나 실시간으로(예: SQL 데이터베이스 또는 로그 파일)IDataView개체로 로드됩니다.위에 로드된 데이터를 사용하여 모델을 학습합니다.

ITransformer model = pipeline.Fit(trainingData);이 메서드는

Fit()학습 데이터 세트를 파이프라인에 적용하여 모델을 학습시킵니다.

모델의 정확도 평가

다음 코드를 메서드의 다음 줄에 추가하여 테스트 데이터를 로드하고 변환합니다

GenerateModel.IDataView testData = mlContext.Data.LoadFromTextFile<ImageData>(path: _testTagsTsv, hasHeader: false); IDataView predictions = model.Transform(testData); // Create an IEnumerable for the predictions for displaying results IEnumerable<ImagePrediction> imagePredictionData = mlContext.Data.CreateEnumerable<ImagePrediction>(predictions, true); DisplayResults(imagePredictionData);모델을 평가하는 데 사용할 수 있는 몇 가지 샘플 이미지가 있습니다. 학습 데이터와 마찬가지로 모델에 의해 변환될 수 있도록 이러한 데이터를 로드

IDataView해야 합니다.모델을 평가하기 위해 메서드에

GenerateModel()다음 코드를 추가합니다.MulticlassClassificationMetrics metrics = mlContext.MulticlassClassification.Evaluate(predictions, labelColumnName: "LabelKey", predictedLabelColumnName: "PredictedLabel");예측 집합이 있으면 Evaluate() 메서드:

- 모델을 평가합니다(예측 값과 테스트 데이터 세트

labels비교). - 모델 성능 메트릭을 반환합니다.

- 모델을 평가합니다(예측 값과 테스트 데이터 세트

모델 정확도 메트릭 표시

다음 코드를 사용하여 메트릭을 표시하고, 결과를 공유한 다음, 메트릭에 대해 작업합니다.

Console.WriteLine($"LogLoss is: {metrics.LogLoss}"); Console.WriteLine($"PerClassLogLoss is: {String.Join(" , ", metrics.PerClassLogLoss.Select(c => c.ToString()))}");다음 메트릭은 이미지 분류에 대해 평가됩니다.

-

Log-loss- 로그 손실을 참조하세요. 로그 손실은 가능한 한 0에 가까울 수 있습니다. -

Per class Log-loss; 클래스당 로그 손실은 가능한 한 0에 가까울 수 있습니다.

-

다음 코드를 추가하여 학습된 모델을 다음 줄로 반환합니다.

return model;

애플리케이션 실행

클래스를 만든 후 호출

GenerateModel을 추가합니다.MLContextITransformer model = GenerateModel(mlContext);메서드를 호출한

ClassifySingleImage()후 메서드에 대한 호출을 추가합니다GenerateModel().ClassifySingleImage(mlContext, model);콘솔 앱을 실행합니다(Ctrl + F5). 결과는 다음 출력과 유사해야 합니다. (경고 또는 처리 메시지가 표시될 수 있지만 명확성을 위해 다음 결과에서 이러한 메시지가 제거되었습니다.)

=============== Training classification model =============== Image: broccoli2.jpg predicted as: food with score: 0.8955513 Image: pizza3.jpg predicted as: food with score: 0.9667718 Image: teddy6.jpg predicted as: toy with score: 0.9797683 =============== Classification metrics =============== LogLoss is: 0.0653774699265059 PerClassLogLoss is: 0.110315812569315 , 0.0204391272836966 , 0 =============== Making single image classification =============== Image: toaster3.jpg predicted as: appliance with score: 0.9646884

축하합니다! 이제 이미지 처리를 위해 미리 학습된 TensorFlow를 사용하여 이미지를 분류하는 ML.NET 분류 모델을 성공적으로 빌드했습니다.

이 자습서의 소스 코드는 dotnet/samples 리포지토리에서 찾을 수 있습니다.

이 자습서에서는 다음 방법을 알아보았습니다.

- 문제 이해

- 미리 학습된 TensorFlow 모델을 ML.NET 파이프라인에 통합

- ML.NET 모델 학습 및 평가

- 테스트 이미지 분류

Machine Learning 샘플 GitHub 리포지토리를 확인하여 확장된 이미지 분류 샘플을 탐색합니다.

.NET