벤치마크를 사용하여 모델 선택

모델을 배포하기 전에 다양한 차원에서 모델을 수행하는 방법을 이해하려고 합니다. 모델 벤치마크는 모델을 비교하고 정보에 입각한 선택 결정을 내리는 데 도움이 되는 객관적이고 측정 가능한 데이터를 제공합니다. Microsoft Foundry 포털은 품질, 안전성, 비용 및 성능 메트릭으로 구성된 포괄적인 벤치마킹 도구를 제공합니다.

Access 모델 벤치마크

Microsoft Foundry 포털 내에서 다음 두 가지 방법으로 벤치마크를 탐색할 수 있습니다.

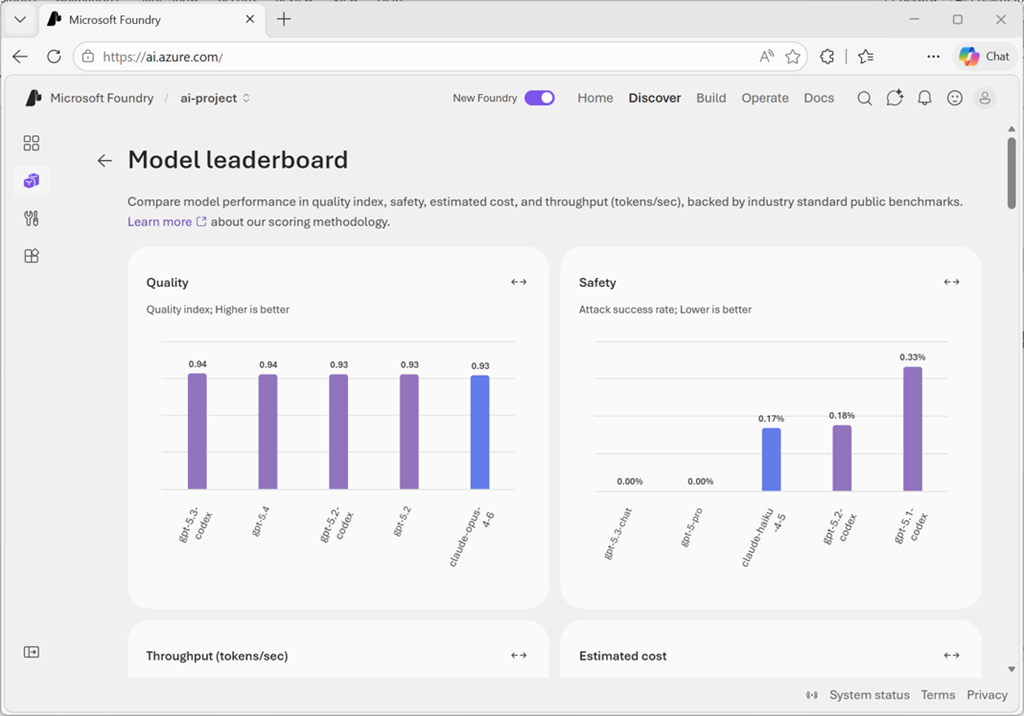

모델 카탈로그에서 모델 순위표를 확인하여 사용 가능한 모든 모델의 비교 순위를 확인합니다. 이 보기를 사용하면 특정 메트릭 또는 시나리오에 대한 성능이 뛰어난 모델을 식별할 수 있습니다. 순위표에는 품질, 안전성, 예상 비용 및 처리량에 따라 순위가 매겨진 상위 모델이 표시됩니다.

특정 모델에 대한 자세한 벤치마크를 보려면 모델 카드를 열고 벤치마크 탭을 선택합니다. 이 보기에서는 개별 모델이 다양한 메트릭 및 데이터 세트에 대해 수행하는 방식을 보여 줍니다. 비교 차트는 유사한 모델을 기준으로 배치합니다.

품질 벤치마크

품질 벤치마크는 모델이 정확하고 일관적이며 상황에 맞는 응답을 얼마나 잘 생성하는지 평가합니다. 이러한 메트릭은 공용 데이터 세트 및 표준화된 평가 방법을 사용하여 일관성을 보장합니다.

품질 인덱스는 추론, 지식, 질문 답변, 수학 기능 및 코딩 기술을 측정하는 여러 벤치마크 데이터 세트의 평균 정확도 점수를 통해 대략적인 개요를 제공합니다. 품질 인덱스 값이 높을수록 범용 언어 작업에서 전반적인 성능이 향상됩니다.

품질 벤치마크는 다음과 같은 데이터 세트를 사용합니다.

- 아레나-하드 - 대립적 질의 응답

- BIG-Bench 하드 - 추론 기능

- GPQA - 대학원 수준의 다 분야 질문

- HumanEval+ 및 MBPP+ - 코드 생성 작업

- MATH - 수학 추론

- MMLU-Pro - 일반 지식 평가

- IFEval - 다음 명령

벤치마크 점수는 0에서 1까지의 정규화된 인덱스로, 값이 높을수록 성능이 향상됩니다.

안전 벤치마크

안전 메트릭은 모델이 유해하거나 편향되거나 부적절한 콘텐츠를 생성하지 않도록 합니다. 이러한 벤치마크는 특히 규제 산업 또는 고객 관련 시나리오에서 최종 사용자에게 노출되는 애플리케이션에 매우 중요합니다.

Microsoft Foundry는 여러 안전 차원에서 모델을 평가합니다.

유해한 동작 감지 는 HarmBench 벤치마크를 사용하여 모델이 안전하지 않은 콘텐츠를 생성하는 데 얼마나 잘 저항하는지 측정합니다. 평가는 ASR(공격 성공률)을 계산합니다. 이 값이 낮을수록 더 안전하고 강력한 모델을 나타냅니다. HarmBench는 다음 세 가지 기능 영역을 테스트합니다.

- 표준 유해한 행동 - 사이버 범죄, 불법 활동, 일반적인 피해

- 상황에 맞는 유해한 행동 - 잘못된 정보, 괴롭힘, 괴롭힘

- 저작권 위반 - 저작권이 있는 자료 복제

독성 콘텐츠 감지 는 ToxiGen 데이터 세트를 사용하여 모델이 적대적이고 암시적인 증오 발언을 얼마나 잘 식별하는지 측정합니다. F1 점수가 높을수록 소수 그룹에 대한 참조에서 검색 성능이 향상됩니다.

중요한 도메인 지식 은 WMDP(대량 파괴 무기 프록시) 벤치마크를 사용하여 생물 보안, 사이버 보안 및 화학 보안에 대한 모델 지식을 측정합니다. WMDP 점수가 높을수록 잠재적으로 위험한 기능에 대한 더 많은 지식이 있음을 나타냅니다.

안전 점수는 모델 견고성을 이해하는 데 도움이 되며, 특히 유해한 출력이 중요한 문제를 야기하는 고객 관련 애플리케이션에 중요합니다.

비용 벤치마크

모델 사용의 재정적 영향을 이해하면 품질 요구 사항과 예산 제약 조건의 균형을 맞추는 데 도움이 됩니다. Microsoft Foundry의 비용 벤치마크는 서버리스 API 배포 및 Azure OpenAI 모델에 대한 가격 책정을 표시합니다.

입력 토큰당 비용은 1백만 개의 입력 토큰(모델에 보내는 텍스트)을 처리하는 가격을 보여 줍니다.

출력 토큰당 비용은 1백만 개의 출력 토큰(모델이 생성하는 텍스트)을 생성하는 가격을 나타냅니다.

예상 비용은 일반적인 3:1 비율(모든 출력 토큰에 대해 3개의 입력 토큰)을 사용하여 입력 및 출력 비용을 결합하여 비교를 위해 단일 숫자를 제공합니다. 값이 낮을수록 더 비용 효율적인 모델을 나타냅니다.

비용 벤치마크는 애플리케이션의 사용 패턴 및 예산에 맞는 가격대에서 필요한 품질을 제공하는 모델을 식별하는 데 도움이 됩니다.

성능 벤치마크

성능 메트릭은 모델이 요청에 응답하는 횟수를 빠르고 효율적으로 측정합니다. 이러한 벤치마크는 사용자 환경이 응답성에 따라 달라지는 실시간 애플리케이션에 중요합니다.

대기 시간 측정은 다음과 같습니다.

- 대기 시간 평균 - 요청을 처리하는 평균 시간(초)

- 대기 시간 P50 (중앙값) - 50% 요청이 이 시간보다 빠르게 완료됨

- 대기 시간 P90 - 90% 요청이 이 시간보다 빠르게 완료됨

- 대기 시간 P95 - 95% 요청이 이 시간보다 빠르게 완료됨

- 대기 시간 P99 - 99% 요청이 이 시간보다 빠르게 완료됨

- TTFT(Time to First 토큰) - 스트리밍을 사용할 때 첫 번째 토큰이 도착할 때까지의 시간입니다.

처리량 측정은 다음과 같습니다.

- GTPS(초당 생성된 토큰) - 초당 생성된 출력 토큰

- TTPS(초당 총 토큰 수) - 초당 처리되는 결합된 입력 및 출력 토큰

- 토큰 간 시간 - 연속 토큰 수신 사이의 간격

순위표는 첫 번째 토큰까지의 평균 시간을 사용하여 성능을 요약하며, 낮을수록 더 좋습니다. 초당 생성된 토큰의 평균을 사용하여 성능을 측정하며, 높을수록 더 좋습니다. 처리량이 높고 대기 시간이 짧은 모델은 대화형 애플리케이션에서 더 나은 사용자 환경을 제공합니다. 속도가 비용보다 덜 중요한 일괄 처리 작업의 경우 다른 요소의 우선 순위를 지정할 수 있습니다.

순위표 및 비교 기능 사용

모델 순위표를 사용하면 특정 메트릭에 대한 상위 모델을 볼 수 있습니다. 품질, 안전성, 예상 비용 및 처리량을 기준으로 정렬하여 요구 사항에 가장 적합한 모델을 식별할 수 있습니다.

시나리오 순위표는 추론, 코딩, 수학, 질문 답변 또는 근거와 같은 특정 사용 사례에 최적화된 모델을 찾는 데 도움이 됩니다. 애플리케이션이 특정 시나리오에 매핑되는 경우 전체 품질 인덱스만 사용하는 대신 관련 시나리오 순위표로 시작합니다.

장차 차트 는 품질과 비용, 품질 및 처리량과 같은 두 메트릭을 동시에 표시합니다. 이러한 시각화는 요구 사항에 대한 최적의 균형을 찾는 데 도움이 됩니다. 드롭다운을 사용하여 품질과 비용, 처리량 또는 안전을 비교합니다. 차트의 오른쪽 위 모서리에 가까운 모델은 두 메트릭 모두에서 잘 수행됩니다. 정확도가 약간 낮지만 훨씬 빠르거나 저렴한 모델은 요구 사항에 더 잘 부합할 수 있습니다.

나란히 비교 하면 순위표에서 두 개 또는 세 개의 모델을 선택하고 여러 차원에서 비교할 수 있습니다.

- 성능 벤치마크(품질, 안전성, 처리량)

- 모델 세부 정보(컨텍스트 창, 학습 데이터, 지원되는 언어)

- 지원되는 엔드포인트(배포 옵션)

- 기능 지원(함수 호출, 구조적 출력, 비전)

이름 옆에 있는 확인란을 선택하여 모델을 선택한 다음 비교를 선택하여 자세한 비교 보기를 엽니다.