Notitie

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen u aan te melden of mappen te wijzigen.

Voor toegang tot deze pagina is autorisatie vereist. U kunt proberen om mappen te wijzigen.

Microsoft Foundry Models is uw eenmalige bestemming voor het detecteren, evalueren en implementeren van krachtige AI-modellen, ongeacht of u een aangepaste copilot bouwt, een agent, een bestaande toepassing verbetert of nieuwe AI-mogelijkheden verkent.

Met Foundry-modellen kunt u het volgende doen:

- Verken een uitgebreide catalogus met geavanceerde modellen van Microsoft, OpenAI, DeepSeek, Hugging Face, Meta en meer.

- Vergelijk en evalueer modellen naast elkaar met behulp van echte taken en uw eigen gegevens.

- Implementeer met vertrouwen dankzij ingebouwde hulpprogramma's voor het afstemmen, waarneembaarheid en verantwoorde AI.

- Kies uw pad: gebruik uw eigen model, gebruik een gehost model of integreer naadloos met Azure services.

Of u nu een ontwikkelaar, data scientist of enterprise architect bent, Foundry Models biedt u de flexibiliteit en controle om AI-oplossingen te bouwen die veilig, verantwoord en snel kunnen worden geschaald.

Foundry biedt een uitgebreide catalogus met AI-modellen. Er zijn meer dan 1900 modellen die variëren van basismodellen, redeneringsmodellen, kleine taalmodellen, multimodale modellen, domeinspecifieke modellen en branchemodellen.

De modelcatalogus is ingedeeld in twee hoofdcategorieën:

Als u het onderscheid tussen deze categorieën begrijpt, kunt u de juiste modellen kiezen voor uw specifieke vereisten en strategische doelen.

Opmerking

Voor alle modellen blijven klanten verantwoordelijk voor:

- Voldoen aan de wet in hun gebruik van elk model of systeem

- Modelbeschrijvingen bekijken in de modelcatalogus, modelkaarten beschikbaar gemaakt door de modelprovider en andere relevante documentatie

- Een geschikt model selecteren voor hun use-case

- Het implementeren van passende maatregelen (inclusief het gebruik van Azure AI Content Safety) om ervoor te zorgen dat het gebruik van de Foundry Tools voldoet aan het beleid voor acceptabel gebruik in de productvoorwaarden van Microsoft en de Gedragscode voor Microsoft Enterprise AI Services.

Modellen die rechtstreeks door Azure worden verkocht

Ook wel Azure Directe modellen of Direct van Azure modellen genoemd, worden deze modellen gehost en verkocht door Microsoft onder productvoorwaarden van Microsoft. Microsoft heeft deze modellen geëvalueerd en ze zijn diep geïntegreerd in het AI-ecosysteem van Azure. De modellen zijn afkomstig van verschillende providers en bieden verbeterde integratie, geoptimaliseerde prestaties en directe Microsoft support, waaronder sla's (Service Level Agreements) op ondernemingsniveau.

Kenmerken van modellen die rechtstreeks door Azure worden verkocht:

- Ondersteuning beschikbaar van Microsoft.

- Hoog integratieniveau met Azure services en infrastructuur.

- Onderhevig aan interne beoordeling op basis van de verantwoordelijke AI-standaarden van Microsoft.

- Modeldocumentatie en transparantierapporten bieden inzicht in klantrisico's, risicobeperking en beperkingen.

- Schaalbaarheid, betrouwbaarheid en beveiliging op bedrijfsniveau.

Sommige van deze modellen bieden ook flexibele geconfigureerde doorvoer, wat betekent dat u uw quota en reserveringen flexibel kunt gebruiken voor elk van deze modellen. Zie Data, privacy en beveiliging voor Azure Directe modellen in Microsoft Foundry voor meer informatie over hoe Foundry de gegevens verwerkt die u rechtstreeks aan Foundry-modellen levert die rechtstreeks door Azure worden verkocht.

Modellen van partners en gemeenschap

Deze modellen vormen de overgrote meerderheid van de Foundry-modellen en worden geleverd door vertrouwde organisaties, partners, onderzoekslabs en communitybijdragers van derden. Deze modellen bieden gespecialiseerde en diverse AI-mogelijkheden, met een breed scala aan scenario's, branches en innovaties. Voorbeelden van modellen van Partners en community zijn de familie van grote taalmodellen die zijn ontwikkeld door antropische en Open-modellen van de Hugging Face-hub.

Anthropic omvat de Claude-familie van state-of-the-art grote-taalmodellen die ondersteuning bieden voor tekst- en afbeeldingsinvoer, tekstuitvoer, meertalige mogelijkheden en visie. Gebruik Microsoft Support voor hulp bij antropische modellen. Zie Gegevens, privacy en beveiliging voor Claude-modellen in Microsoft Foundry (preview) en antropisch privacybeleid voor meer informatie over privacy. Zie de Commerciële Servicevoorwaarden voor de servicevoorwaarden. Zie Claude-modellen implementeren en gebruiken in Microsoft Foundry voor meer informatie over het werken met antropische modellen.

Hugging Face hub bevat honderden modellen voor real-time inferentie met beheerde rekenkracht. Hugging Face creëert en onderhoudt de modellen die in deze verzameling zijn opgenomen. Voor hulp bij de hugging Face-modellen gebruikt u het hugging Face-forum of hugging Face-ondersteuning. Meer informatie over het implementeren van Hugging Face-modellen in Het implementeren en afleiden van een beheerde rekenimplementatie (klassiek).

Belangrijk

Als u wilt werken met modellen die kunnen worden geïmplementeerd op beheerde berekeningen, zoals Hugging Face-modellen, gebruikt u een hub-project in de Foundry-portal (klassiek). Zie Wat is Microsoft Foundry?voor meer informatie over de beschikbare Foundry-portals.

Kenmerken van modellen van partners en community:

- Ontwikkeld en ondersteund door externe partners en community-inzenders

- Diverse reeks gespecialiseerde modellen die geschikt zijn voor niche of brede gebruiksvoorbeelden

- Doorgaans gevalideerd door providers zelf, met integratierichtlijnen van Azure

- Communitygestuurde innovatie en snelle beschikbaarheid van geavanceerde modellen

- Standaard-Azure AI-integratie, met ondersteuning en onderhoud die worden beheerd door de respectieve providers

Modellen van partners en community's kunnen worden geïmplementeerd met beheerde reken- of serverloze implementatieopties . De modelprovider selecteert hoe de modellen kunnen worden geïmplementeerd. Zie Implementatietypen voor Microsoft Foundry-modellen voor meer informatie over de implementatietypen die beschikbaar zijn onder de optie voor serverloze implementatie.

Een model aanvragen dat moet worden opgenomen in de modelcatalogus

Vraag of we een model rechtstreeks vanuit de modelcataloguspagina in de Foundry-portal aan de modelcatalogus kunnen toevoegen.

- Ga naar de modelcatalogus pagina.

- Zoek in de zoekbalk naar een model dat niet bestaat in de catalogus, zoals mymodel.

- Selecteer Een model aanvragen om details te delen over het model dat u wilt aanvragen.

Kiezen tussen modellen die rechtstreeks worden verkocht door Azure en modellen van partners en community

Houd rekening met het volgende wanneer u selecteert welke Foundry-modellen u wilt gebruiken:

- Gebruik case en vereisten: modellen die rechtstreeks door Azure worden verkocht, zijn ideaal voor scenario's waarvoor uitgebreide Azure integratie, gegarandeerde ondersteuning en enterprise SLA's zijn vereist. Modellen van partners en community excel in gespecialiseerde use cases en door innovatie geleide scenario's.

- Ondersteuningsverwachtingen: Modellen die rechtstreeks door Azure worden verkocht, worden geleverd met robuuste ondersteuning en onderhoud van Microsoft. Partner- en communitymodellen worden ondersteund door hun providers, met verschillende niveaus van SLA en ondersteuningsstructuren.

- Innovation en specialisatie: Modellen van partners en community bieden snelle access tot gespecialiseerde innovaties en nichemogelijkheden, vaak ontwikkeld door toonaangevende onderzoekslabs en opkomende AI-providers.

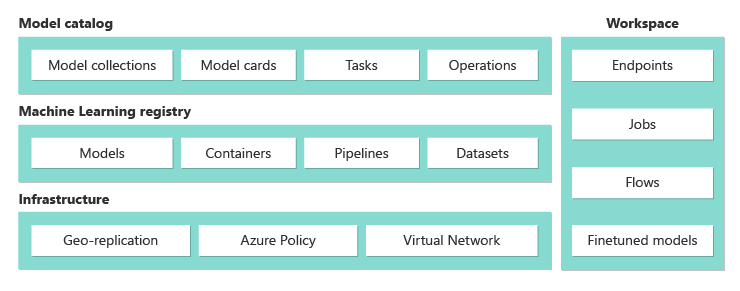

Overzicht van de mogelijkheden van de modelcatalogus

De modelcatalogus in Foundry Portal is de hub voor het detecteren en gebruiken van een breed scala aan modellen om generatieve AI-toepassingen te bouwen. De modelcatalogus bevat honderden modellen voor modelproviders zoals Azure OpenAI, Mistral, Meta, Cohere, NVIDIA en Hugging Face, inclusief modellen die Door Microsoft zijn getraind. Modellen van andere providers dan Microsoft zijn niet-Microsoft-producten zoals gedefinieerd in de Microsoft-productvoorwaarden en zijn onderhevig aan de voorwaarden die bij de modellen worden geleverd.

Zoek en ontdek modellen die voldoen aan uw behoeften via trefwoorden zoeken en filters. De modelcatalogus biedt ook het scorebord voor modelprestaties en benchmarkgegevens voor bepaalde modellen. Toegang ze door Bekijk leaderboard en Vergelijk modellen te selecteren. Benchmarkgegevens zijn ook beschikbaar op het tabblad Benchmarks van de modelkaart.

Enkele van de filters die beschikbaar zijn in de modelcatalogus zijn:

- Verzameling: Filter modellen op basis van de collectie van de modelprovider.

- Branche: Filter op de modellen die zijn getraind op branchespecifieke gegevensset.

- Mogelijkheden: Filter op unieke modelfuncties, zoals redenering en aanroepen van hulpprogramma's.

- Deductietaken: Filter modellen op basis van het type deductietaak.

Enkele van de details die beschikbaar zijn in de modelkaart zijn:

- Snelle feiten: Belangrijke informatie over het model in een oogopslag

- Tabblad Details : Gedetailleerde informatie over het model, zoals beschrijving, versiegegevens en ondersteund gegevenstype

- Tabblad Benchmarks : Metrische prestatiebenchmarks voor geselecteerde modellen

- Tabblad Implementaties : een lijst met bestaande implementaties voor het model

- Tabblad Licentie : Juridische informatie met betrekking tot modellicenties

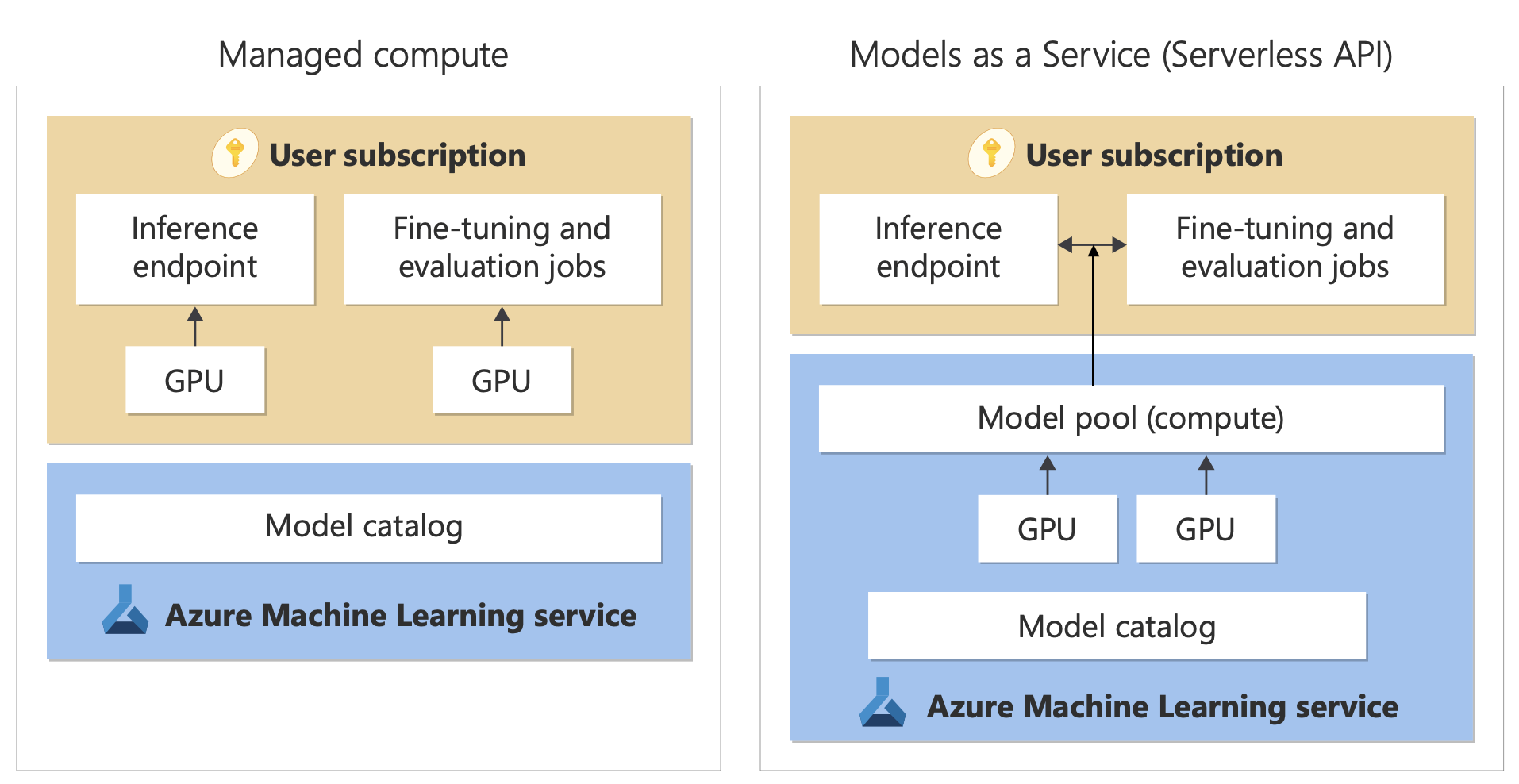

Opties voor modelimplementatie: beheerde berekeningen en serverloze implementaties

De modelcatalogus biedt twee verschillende opties voor het implementeren van modellen voor uw gebruik: beheerde berekeningen en serverloze implementaties. Zie Gegevens, privacy en beveiliging voor gebruik van modellen via de modelcatalogus in de Microsoft Foundry-portal (klassiek) voor meer informatie over gegevensverwerking met de implementatieopties. Zie Data, privacy en beveiliging voor Azure Directe modellen in Microsoft Foundry voor meer informatie over hoe Foundry de gegevens verwerkt die u rechtstreeks aan Foundry-modellen levert die rechtstreeks door Azure worden verkocht.

Mogelijkheden van modelimplementatieopties

De implementatieopties en -functies die beschikbaar zijn voor elk model variëren, zoals beschreven in de volgende tabel:

| Features | Volledig beheerde rekenprocessen | Serverloze implementatie |

|---|---|---|

| Implementatie-ervaring en -facturering | Modelgewichten worden geplaatst op toegewezen virtual machines met beheerde compute-capaciteit. Een beheerde berekening, die een of meer implementaties kan hebben, maakt een REST API beschikbaar voor deductie. U wordt gefactureerd voor de kernuren van de virtuele machine die door de implementaties worden gebruikt. | Toegang krijgen tot modellen via een uitrol die een API implementeert. De API biedt toegang tot het model dat door Microsoft wordt gehost en beheerd voor inference. U wordt gefactureerd voor invoer en uitvoer voor de API's, meestal in tokens. Prijsinformatie wordt verstrekt voordat u implementeert. |

| API-verificatie | Sleutels en Microsoft Entra-authenticatie. | Sleutels en Microsoft Entra-authenticatie. |

| Inhoudsveiligheid | Gebruik Azure AI Content Safety service-API's. | Azure AI Content Safety filters zijn geïntegreerd met deductie-API's. Azure AI Content Safety filters worden afzonderlijk gefactureerd. |

| Netwerkisolatie | Configureer een beheerd netwerk voor Microsoft Foundry-hubs (klassiek). | Beheerde netwerken volgen de openbare netwerktoegang (PNA) vlaginstelling voor uw Foundry-resource. Zie de sectie Netwerkisolatie voor modellen die zijn geïmplementeerd via serverloze implementaties verderop in dit artikel voor meer informatie. |

Volledig beheerde rekenprocessen

De mogelijkheid om modellen als beheerde berekening te implementeren, bouwt voort op platformmogelijkheden van Azure Machine Learning om naadloze integratie mogelijk te maken van de brede verzameling modellen in de modelcatalogus gedurende de hele levenscyclus van LLM-bewerkingen (Large Language Model).

Belangrijk

Als u wilt werken met modellen die kunnen worden geïmplementeerd op beheerde berekeningen, gebruikt u een hub-project in de Foundry-portal (klassiek). Zie Wat is Microsoft Foundry?voor meer informatie over de beschikbare Foundry-portals.

Beschikbaarheid van modellen voor implementatie als beheerde rekenkracht

De modellen worden beschikbaar gesteld via Azure Machine Learning registers. Deze registers maken een machine learning-first-benadering mogelijk om hosting en distributie van Azure Machine Learning assets mogelijk te maken. Deze assets omvatten modelgewichten, containerruntimes voor het uitvoeren van de modellen, pipelines voor het evalueren en verfijnen van de modellen en gegevenssets voor benchmarks en voorbeelden.

De registers bouwen voort op een zeer schaalbare en bedrijfsklare infrastructuur die:

Biedt toegang met lage latentie tot modelartefacten in alle Azure-regio's met ingebouwde geo-replicatie.

Ondersteunt bedrijfsbeveiligingsvereisten, zoals het beperken van access tot modellen met behulp van Azure Policy en veilige implementatie met behulp van beheerde virtuele netwerken.

Implementatie van modellen voor deductie met beheerde rekenkracht

Modellen die beschikbaar zijn voor uitvoering naar beheerde berekeningen, kunnen op Azure Machine Learning beheerde berekeningen worden ingezet voor real-time voorspelling. Als u wilt implementeren op beheerde berekeningen, hebt u een quotum voor virtuele machines in uw Azure-abonnement nodig voor de specifieke producten om het model optimaal uit te voeren. Met sommige modellen kunt u een tijdelijk gedeeld quotum implementeren voor modeltests.

Meer informatie over het implementeren van modellen:

- Als u open modellen wilt implementeren voor beheerde berekeningen, raadpleegt u Hoe u een beheerde rekenimplementatie (klassiek) implementeert en afleiden.

- Als u beveiligde Foundry-modellen wilt implementeren voor beheerde berekeningen met betalen per gebruik-facturering, raadpleegt u Microsoft Foundry-modellen implementeren voor beheerde berekeningen met facturering per gebruik (klassiek).

Generatieve AI-apps bouwen met beheerde rekenkracht

De functie prompt flow in Azure Machine Learning biedt een geweldige ervaring voor het maken van prototypen. Gebruik modellen die zijn geïmplementeerd met beheerde rekenkracht in de prompt-flow met het hulpprogramma Open Model LLM. U kunt ook de REST API gebruiken die beschikbaar wordt gesteld door beheerde compute in populaire LLM-hulpprogramma's zoals LangChain met de Azure Machine Learning-extensie.

Inhoudsveiligheid voor modellen die zijn geïmplementeerd als beheerde rekenkracht

De service Azure AI Content Safety is beschikbaar voor gebruik met beheerde berekeningen voor verschillende categorieën schadelijke inhoud, zoals seksuele inhoud, geweld, haat en zelfschade. U kunt de service ook gebruiken om te screenen op geavanceerde bedreigingen, zoals jailbreak-risicodetectie en detectie van beveiligde materiaalteksten.

Zie this notebook voor referentieintegratie met Azure AI Content Safety voor Llama 2. Of gebruik de Content Safety (Text) tool in de prompt flow om de reacties van het model door te geven aan Azure AI Content Safety voor screening. U wordt afzonderlijk gefactureerd voor dergelijk gebruik, zoals beschreven in Azure AI Content Safety prijzen.

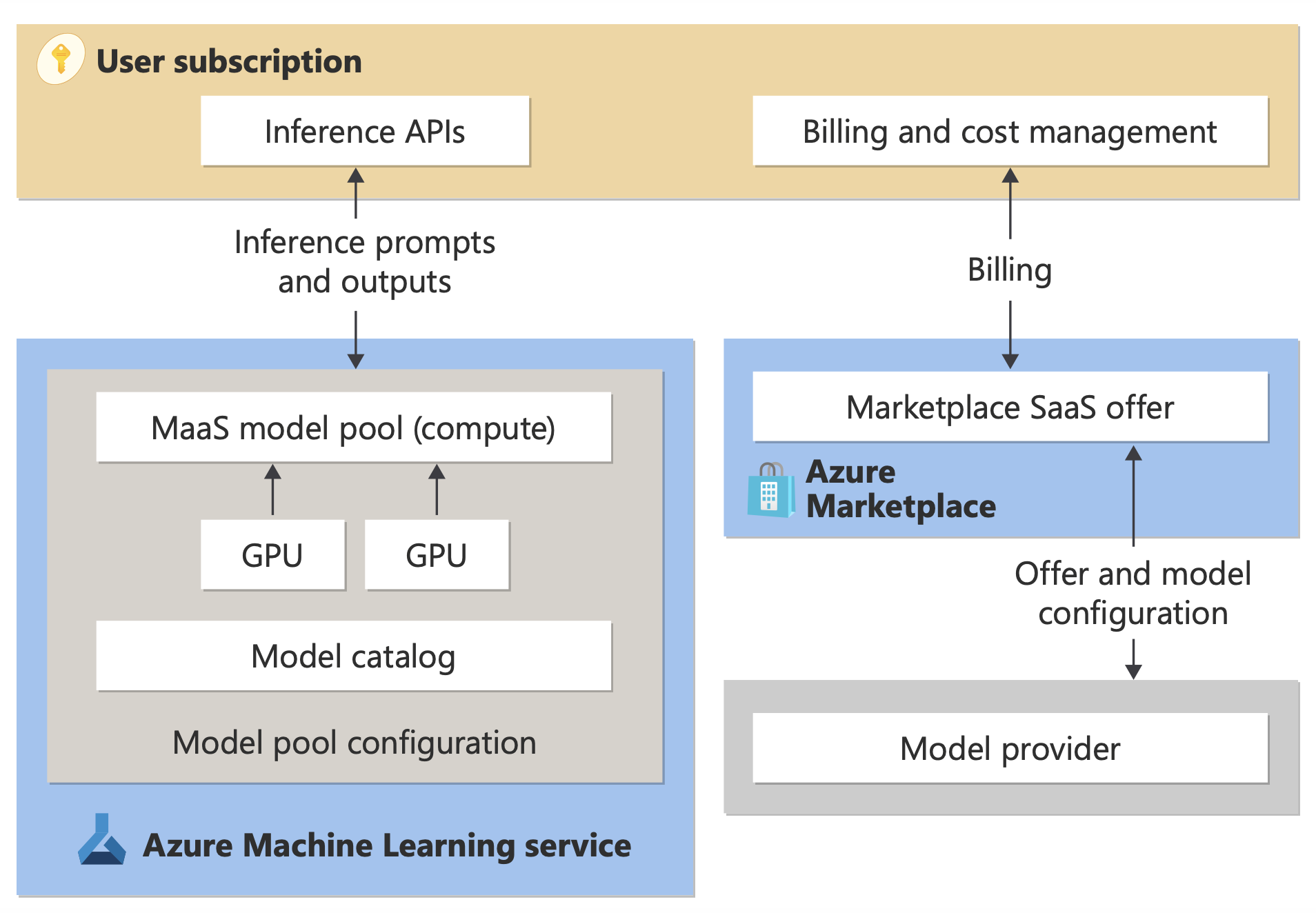

Serverloze implementaties

Serverloze implementaties bieden een manier om Foundry-modellen als API's te gebruiken zonder ze op uw abonnement te hosten. Modellen worden gehost in een door Microsoft beheerde infrastructuur, waarmee API-toegang tot het model van de modelprovider kan worden geboden. Op API gebaseerde access kan de kosten voor het openen van een model aanzienlijk verlagen en de installatie-ervaring vereenvoudigen.

Modellen die beschikbaar zijn voor serverloze implementaties worden aangeboden door de modelprovider, maar ze worden gehost in een door Microsoft beheerde Azure-infrastructuur en toegankelijk via API. Modelproviders definiëren de licentievoorwaarden en stellen de prijs in voor het gebruik van hun modellen. De Azure Machine Learning-service:

- Beheert de hostinginfrastructuur.

- Maakt de deductie-API's beschikbaar.

- Fungeert als de gegevensverwerker voor prompts die worden verzonden en inhoudsuitvoer voor serverloze implementaties.

Serverloze implementatietypen

De serverloze implementatieoptie voor Foundry Models biedt twee hoofdimplementatiecategorieën: standaard (betalen per token) en ingericht (gereserveerde capaciteit). Binnen elke categorie kunt u globale, gegevenszone of regionale verwerking kiezen op basis van uw nalevingsvereisten.

Beschikbare serverloze implementatietypen zijn: Global Standard, Global Provisioned, Global Batch, Data Zone Standard, Data Zone Provisioned, Data Zone Batch, Standard, Regional Provisioned en Developer. Zie Implementatietypen voor Microsoft Foundry-modellen voor meer informatie over deze implementatietypen en het kiezen van de juiste implementatietypen voor uw gebruik.

Facturering voor serverloze implementaties

De detectie-, abonnements- en verbruikservaring voor modellen die zijn geïmplementeerd als serverloze implementaties, vindt u in de Foundry-portal en Azure Machine Learning studio. Gebruikers accepteren licentievoorwaarden voor het gebruik van de modellen. Prijsinformatie voor verbruik is beschikbaar tijdens de implementatie.

Foundry Models van partners en community's worden gefactureerd via Azure Marketplace, in overeenstemming met de gebruiksvoorwaarden van Microsoft Commercial Marketplace.

Foundry Models die rechtstreeks door Azure worden verkocht, worden gefactureerd via Azure meters als First Party Consumption Services. Zoals beschreven in de Productvoorwaarden, koopt u First Party Consumption Services met behulp van Azure meters, maar zijn ze niet onderworpen aan Azure servicevoorwaarden. Het gebruik van deze modellen is onderhevig aan de opgegeven licentievoorwaarden.

Modellen verfijnen

Bepaalde modellen maken ook fijnafstelling mogelijk. Voor deze modellen kunt u beheerde berekeningen of serverloze implementaties gebruiken om de modellen af te stemmen met behulp van gegevens die u opgeeft. Zie Modellen verfijnen met Microsoft Foundry (klassiek) voor meer informatie.

RAG met modellen die zijn geïmplementeerd als serverloze implementaties

Gebruik in de Foundry-portal vectorindexen en retrieval-augmented generation (RAG) met modellen die zijn ingezet via serverloze deployments om embedden en inferentie te genereren op basis van aangepaste gegevens. Deze insluitingen en deductie kunnen vervolgens antwoorden genereren die specifiek zijn voor uw use-case. Zie Vectorindexen bouwen en gebruiken in de Microsoft Foundry-portal (klassiek) voor meer informatie.

Regionale beschikbaarheid van aanbiedingen en modellen

Facturering per token is alleen beschikbaar voor gebruikers van wie Azure abonnement behoort tot een factureringsrekening in een land of regio waar de modelprovider de aanbieding beschikbaar heeft gesteld. Als de aanbieding beschikbaar is in de relevante regio, moet de gebruiker een project resource hebben in de Azure regio waar het model beschikbaar is voor implementatie of afstemming, indien van toepassing. Zie Beschikbaarheid van regio's voor modellen in serverloze implementaties (klassiek) voor gedetailleerde informatie.

Inhoudsveiligheid voor modellen die zijn geïmplementeerd via serverloze implementaties

Voor taalmodellen die zijn geïmplementeerd via serverloze API, implementeert Azure AI een standaardconfiguratie van Azure AI Content Safety filters voor tekstbeheer die schadelijke inhoud detecteren, zoals haat, zelfschadig, seksueel en gewelddadig inhoud. Zie Guardrails en besturingselementen voor modellen die rechtstreeks door Azure worden verkocht voor meer informatie over inhoudsfiltering.

Aanbeveling

Inhoudsfiltering is niet beschikbaar voor bepaalde modeltypen die worden geïmplementeerd via serverloze API. Deze modeltypen omvatten het insluiten van modellen en tijdreeksmodellen.

Inhoudsfiltering wordt synchroon uitgevoerd wanneer de service vraagt om inhoud te genereren. Mogelijk wordt u afzonderlijk gefactureerd volgens Azure AI Content Safety prijzen voor dergelijk gebruik. U kunt het filteren van inhoud uitschakelen voor afzonderlijke serverloze eindpunten:

- Op het moment dat u voor het eerst een taalmodel implementeert

- Later selecteert u de wisselknop voor het filteren van inhoud op de pagina met implementatiedetails

Stel dat u besluit een andere API te gebruiken dan de ModelDeductie-API om te werken met een model dat is geïmplementeerd via een serverloze API. In een dergelijke situatie wordt inhoudsfiltering niet ingeschakeld, tenzij u deze afzonderlijk implementeert met behulp van Azure AI Content Safety.

Zie Quickstart: Tekstinhoud analyseren om aan de slag te gaan met Azure AI Content Safety. Als u geen inhoudsfilters gebruikt bij het werken met modellen die zijn geïmplementeerd via serverloze API, loopt u een hoger risico om gebruikers bloot te stellen aan schadelijke inhoud.

Netwerkisolatie voor modellen die zijn geïmplementeerd via serverloze implementaties

Eindpunten voor modellen die als serverloze implementaties zijn geïmplementeerd, volgen de openbare netwerktoegangsinstelling van vlag van de Foundry-hub met het project waarin de implementatie is opgenomen. Als u uw serverloze implementatie wilt beveiligen, schakelt u de openbare netwerktoegangsflag uit op uw Foundry-hub. U kunt binnenkomende communicatie van een client naar uw eindpunt beveiligen met behulp van een privé-eindpunt voor de hub.

De netwerktoegangsvlag voor openbare toegang instellen voor de Foundry-hub:

- Ga naar de Azure portal.

- Zoek naar de resourcegroep waartoe de hub behoort en selecteer uw Foundry-hub in de resources die voor deze resourcegroep worden vermeld.

- Ga op de overzichtspagina van de hub in het linkerdeelvenster naar Instellingennetwerken>.

- Configureer op het tabblad Public access de instellingen voor de toegangsvlag voor het openbare netwerk.

- Sla uw wijzigingen op. Het kan vijf minuten duren voordat wijzigingen zijn doorgevoerd.

Beperkingen

Als u een Foundry-hub hebt met een privé-eindpunt dat vóór 11 juli 2024 is gemaakt, worden serverloze implementaties toegevoegd aan projecten in deze hub niet de netwerkconfiguratie van de hub gevolgd. Maak in plaats daarvan een nieuw privé-eindpunt voor de hub en een nieuwe serverloze implementatie in de project, zodat de nieuwe implementaties de netwerkconfiguratie van de hub kunnen volgen.

Als u een Foundry-hub hebt met serverloze implementaties die vóór 11 juli 2024 zijn gemaakt en u een privé-eindpunt op deze hub inschakelt, volgen de bestaande serverloze implementaties de netwerkconfiguratie van de hub niet. Voor serverloze implementaties in de hub om de netwerkconfiguratie van de hub te volgen, maakt u de implementaties opnieuw.

Momenteel is Azure OpenAI On Your Data niet beschikbaar voor serverloze implementaties in private hubs, omdat private hubs de toegangsvlag voor openbare netwerken hebben uitgeschakeld.

Het kan tot vijf minuten duren voordat een wijziging in de netwerkconfiguratie, zoals het in- of uitschakelen van de vlag voor openbare netwerkkoppeling, is verwerkt.

Modellevenscyclus: veroudering en uitfasering

AI-modellen ontwikkelen zich snel en wanneer een nieuwe versie of een nieuw model met bijgewerkte mogelijkheden in dezelfde modelfamilie beschikbaar wordt, worden oudere modellen mogelijk buiten gebruik gesteld in de foundry-modelcatalogus. Om een soepele overgang naar een nieuwere modelversie mogelijk te maken, kunnen sommige modellen gebruikers automatische updates inschakelen. Zie voor meer informatie over de levenscyclus van verschillende modellen, toekomstige buitengebruikstellingsdatums van modellen en voorgestelde vervangingsmodellen en versies:

- Azure OpenAI in Microsoft Foundry-modelafschaffen en buitengebruikstelling

- Afschaffing en buitengebruikstelling van Microsoft Foundry-modellen