Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

APLICA-SE A: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Dica

Data Factory no Microsoft Fabric é a próxima geração de Azure Data Factory, com uma arquitetura mais simples, IA interna e novos recursos. Se você não estiver familiarizado com a integração de dados, comece com Fabric Data Factory. As cargas de trabalho existentes do ADF podem ser atualizadas para Fabric para acessar novos recursos em ciência de dados, análise em tempo real e relatórios.

No mundo de Big Data, os dados brutos e não organizados são, muitas vezes, armazenados em sistemas relacionais, não relacionais e outros sistemas de armazenamento. No entanto, os dados brutos em si não possuem o contexto ou significado apropriados para fornecer uma visão adequada para os analistas, cientistas de dados ou responsáveis por decisões de negócio.

O Big Data requer um serviço que possa orquestrar e operacionalizar processos para refinar esses enormes repositórios de dados brutos em insights de negócio acionáveis. O Azure Data Factory é um serviço de nuvem gerenciado que foi criado para esses projetos híbridos e complexos de ETL (extração, transformação e carregamento), ELT (extração, carregamento e transformação) e integração de dados.

Recursos do Azure Data Factory

Compactação de dados: durante a atividade Cópia de Dados, é possível compactar os dados e gravar os dados compactados na fonte de dados de destino. Esse recurso ajuda a otimizar o uso de largura de banda na cópia de dados.

Suporte extensivo de conectividade para diferentes fontes de dados: Azure Data Factory fornece amplo suporte de conectividade para se conectar a diferentes fontes de dados. Isso é útil quando você quer efetuar pull ou gravação de dados de diferentes fontes de dados.

Gatilhos de eventos personalizados: Azure Data Factory permite automatizar o processamento de dados usando gatilhos de evento personalizados. Esse recurso permite que você execute automaticamente determinada ação quando determinado evento ocorrer.

Visualização e validação de dados: durante a atividade de cópia de dados, ferramentas são disponibilizadas para a visualização e validação de dados. Esse recurso o ajuda a garantir que os dados sejam copiados corretamente e gravados na fonte de dados de destino corretamente.

Fluxos de dados personalizáveis: Azure Data Factory permite criar fluxos de dados personalizáveis. Esse recurso permite que você adicione ações personalizadas ou etapas no processamento de dados.

Segurança Integrada: Azure Data Factory oferece recursos de segurança integrados, como integração Entra ID e controle de acesso baseado em função para controlar o acesso a fluxos de dados. Esse recurso aumenta a segurança no processamento de dados e protege seus dados.

Cenários de uso

Por exemplo, imagine uma empresa de jogos que coleta petabytes de logs de jogos que são gerados por jogos na nuvem. A empresa deseja analisar esses logs para saber as preferências dos clientes, a faixa demográfica e o comportamento de uso. Ela também deseja identificar as oportunidades de venda adicional e venda cruzada, desenvolver recursos novos e cativantes para estimular o crescimento do negócio, e fornecer uma melhor experiência para os clientes.

Para analisar esses logs, a empresa precisa usar os dados de referência, como as informações sobre o cliente, sobre o jogo e sobre a campanha de marketing, que estão em um repositório de dados local. A empresa deseja usar esses dados provenientes do repositório de dados local, combinando-os com os dados de log adicionais que ela possui no repositório de dados na nuvem.

Para extrair insights, ele espera processar os dados unidos usando um cluster Spark na nuvem (Azure HDInsight) e publicar os dados transformados em um data warehouse de nuvem, como Azure Synapse Analytics para criar facilmente um relatório sobre ele. A empresa deseja automatizar esse fluxo de trabalho, e monitorá-lo e gerenciá-lo diariamente. Eles também querem executá-lo quando os arquivos chegam em um contêiner de armazenamento de blobs.

Azure Data Factory é a plataforma que resolve esses cenários de dados. É o serviço de integração de dados e ETL baseado em nuvem que lhe permite criar fluxos de trabalho orientados a dados para orquestrar a movimentação e a transformação de dados em escala. Usando Azure Data Factory, você pode criar e agendar fluxos de trabalho controlados por dados (chamados de pipelines) que podem ingerir dados de armazenamentos de dados diferentes. Você pode criar processos ETL complexos que transformam dados visualmente com fluxos de dados ou usando serviços de computação, como Azure HDInsight Hadoop, Azure Databricks e Azure SQL Database.

Além disso, você pode publicar seus dados transformados em armazenamentos de dados, como o Azure Synapse Analytics, para que possam ser consumidos por aplicativos de inteligência de negócios (BI). Por fim, por meio do Azure Data Factory, os dados brutos podem ser organizados em repositórios de dados significativos e data lakes para aprimorar decisões de negócios.

Como ele funciona?

O Data Factory contém uma série de sistemas interconectados que fornecem uma plataforma de ponta a ponta para os engenheiros de dados.

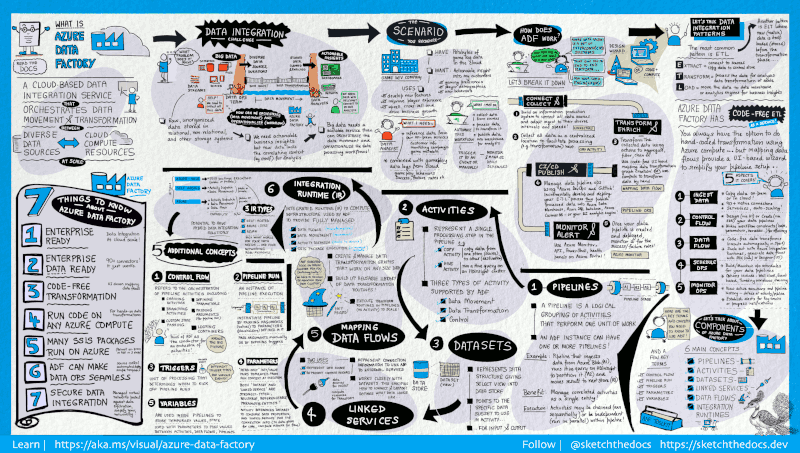

Este guia visual fornece uma visão geral detalhada da arquitetura completa do Data Factory:

Para ver mais detalhes, selecione a imagem anterior para ampliar ou navegue até a imagem de alta resolução. Saiba mais sobre o desenvolvimento deste guia visual e o esboço do projeto de documentos aqui.

Conectar e coletar

As empresas possuem dados de vários tipos que estão localizados em diferentes fontes locais, na nuvem, estruturadas, não estruturadas e semiestruturadas, todos chegando em diferentes intervalos e velocidades.

A primeira etapa ao criar um sistema de geração de informações é conectar todas as diferentes fontes de dados e processamento necessárias, como os serviços de software como serviço (SaaS), bancos de dados, compartilhamentos de arquivos e serviços Web FTP. A etapa seguinte é mover os dados conforme necessário para um local central para que estes sejam processados posteriormente.

Sem o Data Factory, as empresas devem criar componentes de movimentação de dados personalizados ou gravar serviços personalizados para integrar essas fontes de dados e processamento. É caro e difícil integrar e manter esses sistemas. Além disso, eles também, muitas vezes, não possuem o monitoramento, os alertas e os controles de nível empresarial oferecidos por um serviço totalmente gerenciado.

Com o Data Factory, você pode usar a atividade Copy em um pipeline de dados para mover os dados que estão em armazenamentos de dados de origem locais e na nuvem para um armazenamento de dados centralizado na nuvem para análise posterior. Por exemplo, você pode coletar dados em Azure Data Lake Storage e transformar os dados posteriormente usando um serviço de computação Azure Data Lake Analytics. Você também pode coletar dados no armazenamento de Blob do Azure e transformá-los posteriormente usando um cluster Azure HDInsight Hadoop.

Transformar e enriquecer

Depois que os dados estiverem presentes em um armazenamento de dados centralizado na nuvem, processe ou transforme os dados coletados usando fluxos de dados de mapeamento do ADF. Os fluxos de dados permitem que os engenheiros de dados criem e mantenham gráficos de transformação de dados que são executados no Spark sem a necessidade de entender os clusters ou a programação Spark.

Se você preferir codificar transformações manualmente, o ADF oferecerá suporte a atividades externas para executar suas transformações em serviços de computação, como HDInsight Hadoop, Spark, Data Lake Analytics e Machine Learning.

CI/CD e publicação

Data Factory oferece suporte completo para CI/CD de seus pipelines de dados usando Azure DevOps e GitHub. Isso permite que você desenvolva e entregue incrementalmente seus processos de ETL antes de publicar o produto acabado. Depois que os dados brutos tiverem sido refinados em uma forma consumível adequada para negócios, carregue os dados no Azure Data Warehouse, no Azure SQL Database, no Azure Cosmos DB ou em qualquer mecanismo de análise que seus usuários empresariais possam apontar de suas ferramentas de inteligência empresarial.

Monitoramento

Após criar e implantar com sucesso o pipeline de integração de dados, fornecendo valor empresarial a partir dos dados refinados, verifique as atividades e pipelines agendados observando as taxas de sucesso e falha. Azure Data Factory tem suporte interno para monitoramento de pipeline por meio de Azure Monitor, API, PowerShell, logs de Azure Monitor e painéis de integridade no portal do Azure.

Conceitos de nível superior

Uma assinatura do Azure pode ter uma ou mais instâncias do Azure Data Factory (ou fábricas de dados). Azure Data Factory é composta pelos seguintes componentes principais:

- Pipelines

- Atividades

- Conjunto de dados

- Serviços vinculados

- Fluxos de dados

- Runtimes de integração

Esses componentes trabalham juntos para oferecer a plataforma na qual você pode compor fluxos de trabalho orientados a dados com etapas para mover e transformar dados.

Pipeline

Uma fábrica de dados pode ter um ou mais pipelines. Um pipeline é um agrupamento lógico de atividades que realiza uma unidade de trabalho. Conjuntamente, as atividades dentro de um pipeline executam uma tarefa. Por exemplo, um pipeline pode conter um grupo de atividades que ingerem dados de um blob de Azure e, em seguida, executa uma consulta hive em um cluster HDInsight para particionar os dados.

A vantagem disso é que o pipeline permite que você gerencie atividades como um conjunto, em vez de gerenciar cada uma individualmente. As atividades em um pipeline podem ser encadeadas para operarem de modo sequencial ou elas podem operar de forma independente em paralelo.

Mapeamento de fluxos de dados

Crie e gerencie grafos de lógica de transformação de dados que você pode usar para transformar dados de qualquer tamanho. Você pode criar uma biblioteca reutilizável de rotinas de transformação de dados e executar esses processos de maneira expandida em seus pipelines do ADF. O Data Factory executará sua lógica em um cluster Spark que será ativado e desativado quando você precisar. Você jamais precisará gerenciar ou manter os clusters.

Atividade

As atividades representam uma etapa de processamento em um pipeline. Por exemplo, você pode usar uma atividade de cópia para copiar dados de um repositório de dados para outro. Da mesma forma, você pode usar uma atividade do Hive, que executa uma consulta hive em um cluster Azure HDInsight, para transformar ou analisar seus dados. O Data Factory dá suporte a três tipos de atividades: atividades de movimentação de dados, atividades de transformação de dados e atividades de controle.

Conjunto de dados

Os conjuntos de dados representam as estruturas de dados nos repositórios de dados, que simplesmente apontam para ou fazem referência aos dados que você deseja usar em suas atividades como entradas ou saídas.

Serviços vinculados

Os serviços vinculados são como cadeias de conexão, que definem as informações de conexão necessárias para que o Data Factory se conecte aos recursos externos. Pense dessa maneira: um serviço vinculado define a conexão à fonte de dados e um conjunto de dados representa a estrutura dos dados. Por exemplo, um serviço vinculado ao Azure Storage especifica uma cadeia de conexão para se conectar à conta do Azure Storage. Além disso, um conjunto de dados do Azure Blob especifica o contêiner de blob e a pasta que contém os dados.

Serviços vinculados são usados para duas finalidades no Data Factory:

Para representar um repositório data que inclui, mas não se limita a, um banco de dados SQL Server, um banco de dados Oracle, um compartilhamento de arquivos ou uma conta de armazenamento de blobs Azure. Para obter uma lista dos armazenamentos de dados com suporte, consulte o artigo Copy activity (Atividade de cópia).

Para representar um recurso de computação que pode hospedar a execução de uma atividade. Por exemplo, a atividade HDInsightHive é executada em um cluster Hadoop do HDInsight. Para obter uma lista das atividades de transformação e dos ambientes de computação com suporte, confira o artigo transformar dados.

Integration Runtime

No Data Factory, uma atividade define a ação a ser realizada. Um serviço vinculado define um armazenamento de dados de destino ou um serviço de computação. Um Integration Runtime fornece a ponte entre a atividade e os serviços vinculados. Ele é referenciado pelo serviço vinculado ou pela atividade e fornece o ambiente de computação no qual a atividade é executada ou de onde é expedida. Desse modo, a atividade pode ser executada na região mais próxima possível do serviço de computação ou armazenamento de dados de destino, da maneira que proporciona o mais alto desempenho e atendendo às necessidades de segurança e de conformidade.

Gatilhos

Os gatilhos representam a unidade de processamento que determina quando uma execução de pipeline precisa ser inicializada. Existem diferentes tipos de gatilhos para diferentes tipos de eventos.

Execuções de pipeline

Uma execução de pipeline é uma instância da execução do pipeline. A criação de instâncias das execuções de pipeline normalmente é feita por meio da transmissão de argumentos para os parâmetros que são definidos em pipelines. Os argumentos podem ser passados manualmente ou na definição do gatilho.

Parâmetros

Os parâmetros são pares chave-valor da configuração somente leitura. Os parâmetros são definidos no pipeline. Os argumentos para os parâmetros definidos são passados durante a execução por um contexto de execução criado por um gatilho ou por um pipeline executado manualmente. As atividades no pipeline consomem os valores de parâmetro.

Um conjunto de dados é um parâmetro fortemente tipado e uma entidade reutilizável/referenciável. Uma atividade pode referenciar conjuntos de dados e consumir as propriedades que são estabelecidas na definição do conjunto de dados.

Um serviço vinculado também é um parâmetro fortemente tipado que contém as informações de conexão para um armazenamento de dados ou para um ambiente de computação. Ele também é uma entidade reutilizável/referenciável.

Fluxo de controle

O fluxo de controle é uma orquestração de atividades do pipeline que inclui o encadeamento de atividades em uma sequência, ramificação, definindo parâmetros no nível do pipeline, e passando argumentos durante a invocação do pipeline sob demanda ou por meio de um gatilho. Também inclui a passagem de estado personalizada e contêineres de loop, ou seja, iteradores Foreach.

Variáveis

As variáveis podem ser usadas dentro dos pipelines para armazenar valores temporários e também podem ser usadas em conjunto com parâmetros para habilitar a passagem de valores entre pipelines, fluxos de dados e outras atividades.

Conteúdo relacionado

Aqui estão os documentos importantes das próximas etapas a serem explorados: