Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

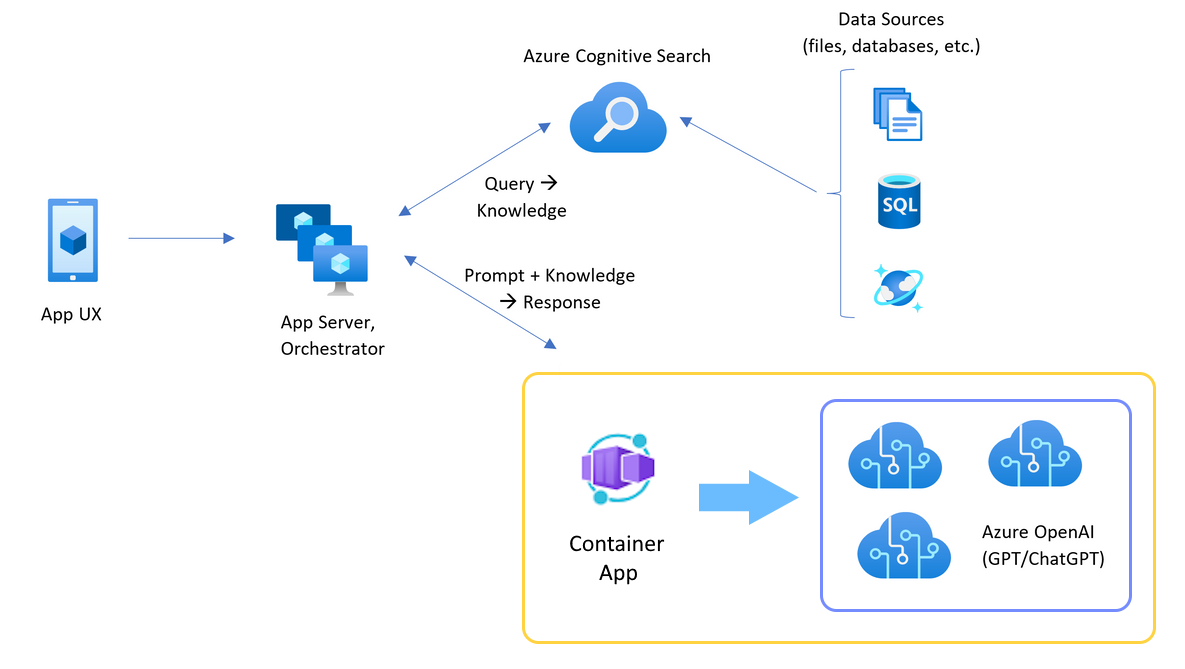

Saiba como adicionar balanceamento de carga ao seu aplicativo para estender o aplicativo de chat além dos limites de cota de modelo e token do Serviço OpenAI do Azure. Esta abordagem usa os Aplicativos de Contêiner do Azure para criar três pontos de extremidade do OpenAI do Azure e um contêiner primário para direcionar o tráfego de entrada para um dos três pontos de extremidade.

Este artigo requer que você implante duas amostras separadas:

Aplicativo de chat

Se você ainda não implantou o aplicativo de chat, aguarde até que o exemplo do balanceador de carga seja implantado.

Se você já implantou o aplicativo de chat uma vez, altere a variável de ambiente para oferecer suporte a um ponto de extremidade personalizado para o balanceador de carga e reimplante-o novamente.

O aplicativo de chat está disponível nos seguintes idiomas:

Aplicativo balanceador de carga

Observação

Este artigo usa um ou mais modelos de aplicativo de IA como base para os exemplos e as diretrizes no artigo. Os modelos de aplicativos de IA fornecem implementações de referência bem mantidas e fáceis de implantar. Eles ajudam a garantir um ponto de partida de alta qualidade para aplicativos de IA.

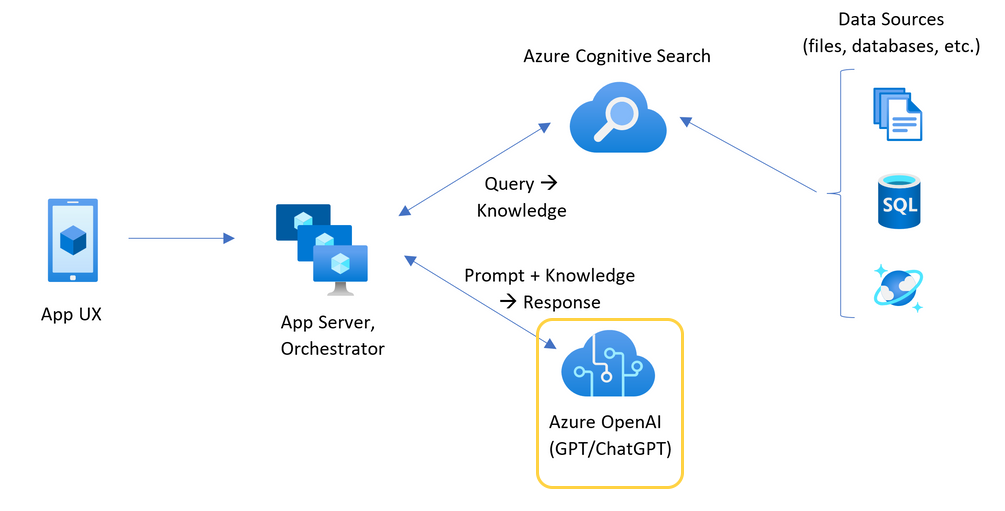

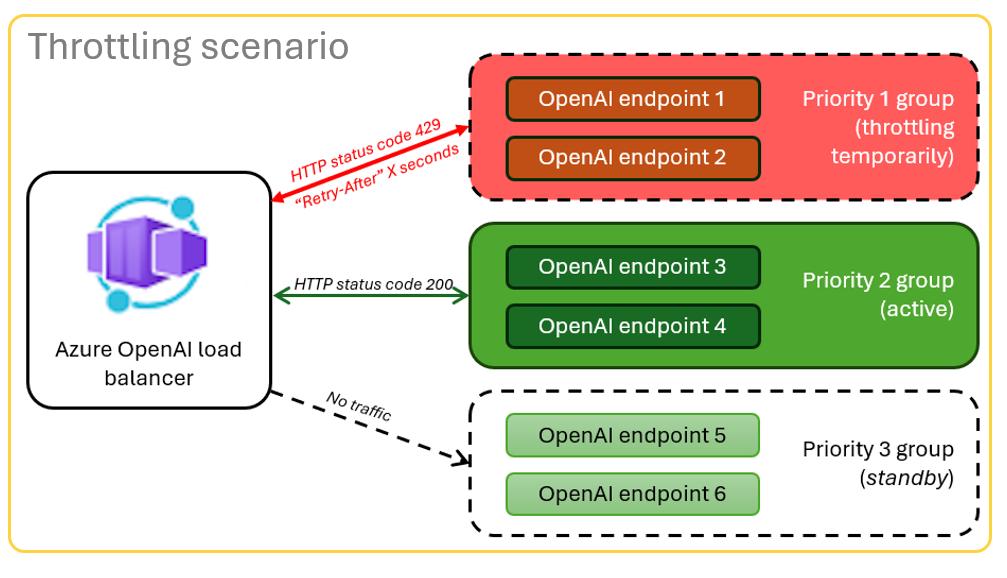

Arquitetura para balanceamento de carga do OpenAI do Azure com Aplicativos de Contêiner do Azure

Como o recurso OpenAI do Azure tem limites específicos de cota de token e modelo, um aplicativo de chat que usa um único recurso do OpenAI do Azure está propenso a ter falhas de conversa devido a esses limites.

Para usar o aplicativo de chat sem atingir esses limites, use uma solução com balanceamento de carga com os Aplicativos de Contêiner. Esta solução expõe perfeitamente um único ponto de extremidade dos Aplicativos de Contêiner para o servidor de aplicativo de chat.

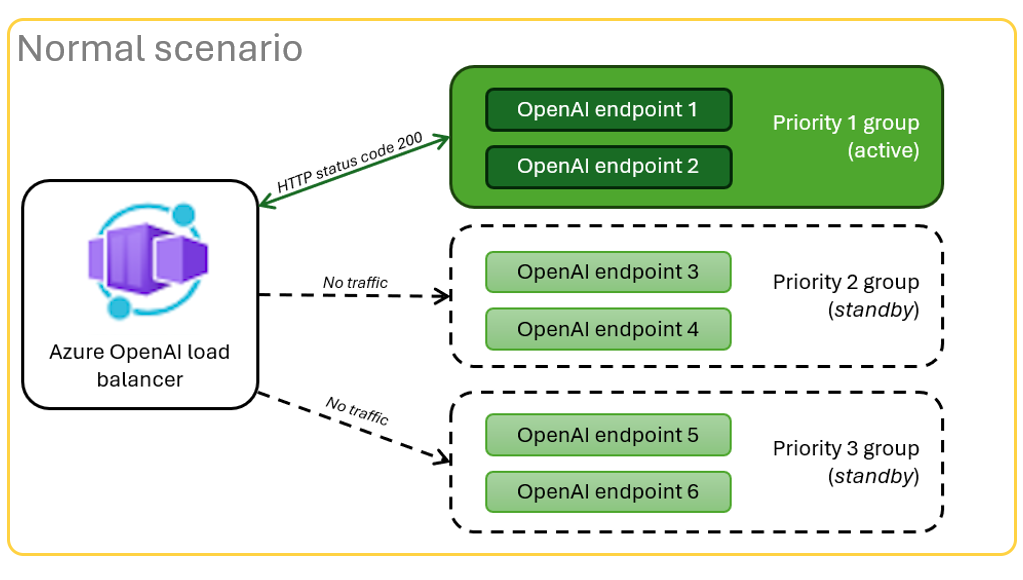

O aplicativo de contêiner fica na frente de um conjunto de recursos do OpenAI do Azure. O Aplicativo de Contêiner resolve dois cenários: normal e limitado. Durante um cenário normal em que a cota de token e modelo estão disponíveis, o recurso do OpenAI do Azure retorna um 200 de volta por meio do aplicativo de contêiner e do servidor de aplicativos.

Quando um recurso está em um cenário limitado, como devido a limites de cota, o aplicativo de contêiner pode tentar novamente um recurso do OpenAI do Azure diferente imediatamente para realizar a solicitação de aplicativo de chat original.

Pré-requisitos

Uma assinatura do Azure. Crie um gratuitamente

Os contêineres de desenvolvimento estão disponíveis para ambos os exemplos, com todas as dependências necessárias para concluir este artigo. Você pode executar os contêineres de desenvolvimento em codespaces do GitHub em um navegador ou localmente usando o Visual Studio Code.

- Uma conta do GitHub.

Abrir o aplicativo de exemplo de load balancer de Aplicativos de Contêiner

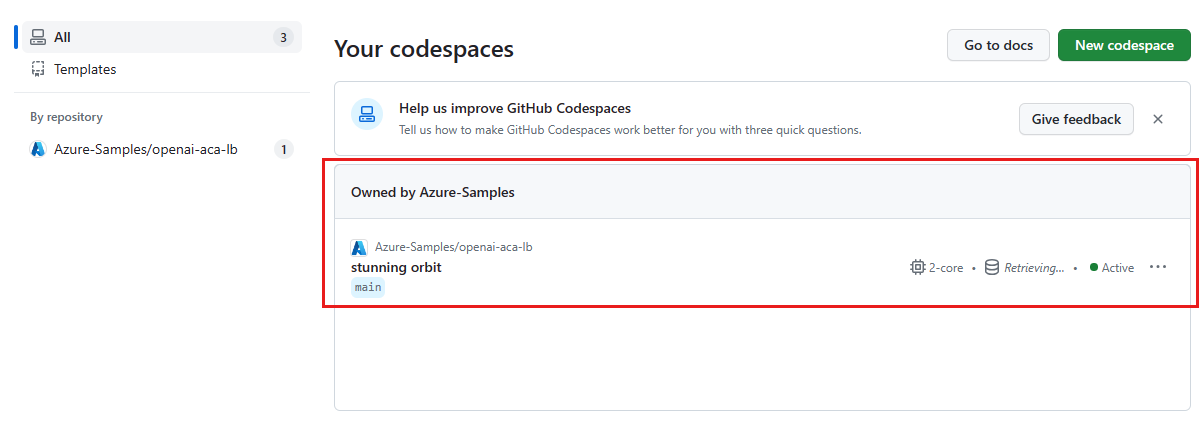

O GitHub Codespaces executa um contêiner de desenvolvimento gerenciado pelo GitHub com o Visual Studio Code para Web como interface do usuário. Para o ambiente de desenvolvimento mais simples, use os Codespaces do GitHub para que você tenha as ferramentas e dependências de desenvolvedor corretas pré-instaladas para concluir este artigo.

Importante

Todas as contas do GitHub podem usar Codespaces do GitHub por até 60 horas grátis por mês com duas instâncias principais. Para saber mais, confira Armazenamento e horas por núcleo incluídos mensalmente no GitHub Codespaces.

Implantar o balanceador de carga dos Aplicativos de Contêiner do Azure

Entre na CLI do desenvolvedor do Azure para fornecer autenticação às etapas de provisionamento e implantação:

azd auth login --use-device-codeDefina uma variável de ambiente para usar a autenticação da CLI do Azure para a etapa de pós-provisionamento:

azd config set auth.useAzCliAuth "true"Implante o aplicativo do balanceador de carga:

azd upSelecione uma assinatura e uma região para a implantação. Não precisam ser a mesma assinatura e região que o aplicativo de chat.

Aguarde a conclusão da implantação antes de continuar.

Obter o ponto de extremidade de implantação

Use o seguinte comando para exibir o endpoint implantado para o aplicativo em contêiner:

azd env get-valuesCopie o valor

CONTAINER_APP_URL. Você o usará na próxima seção.

Reimplantar o aplicativo de chat com o ponto de extremidade do load balancer

Esses exemplos são concluídos no exemplo do aplicativo de chat.

Abra o contêiner de desenvolvimento do aplicativo de chat usando uma das opções a seguir.

Linguagem GitHub Codespaces Visual Studio Code .NET JavaScript Python Fazer login na CLI do Desenvolvedor do Azure (

AZD):azd auth loginConclua as instruções de entrada.

Crie um ambiente

AZDcom um nome comochat-app.azd env new <name>Adicione a variável de ambiente a seguir, que informa ao back-end do aplicativo de chat para usar uma URL personalizada para as solicitações do OpenAI do Azure.

azd env set OPENAI_HOST azure_customAdicione a variável de ambiente a seguir. Substitua

<CONTAINER_APP_URL>pela URL da seção anterior. Esta ação informa ao back-end do aplicativo de chat qual é o valor da URL personalizada para a solicitação do OpenAI do Azure.azd env set AZURE_OPENAI_CUSTOM_URL <CONTAINER_APP_URL>Implante o aplicativo de chat:

azd up

Use o aplicativo de chat com a confiança de que ele consegue suportar muitos usuários sem esgotar a cota.

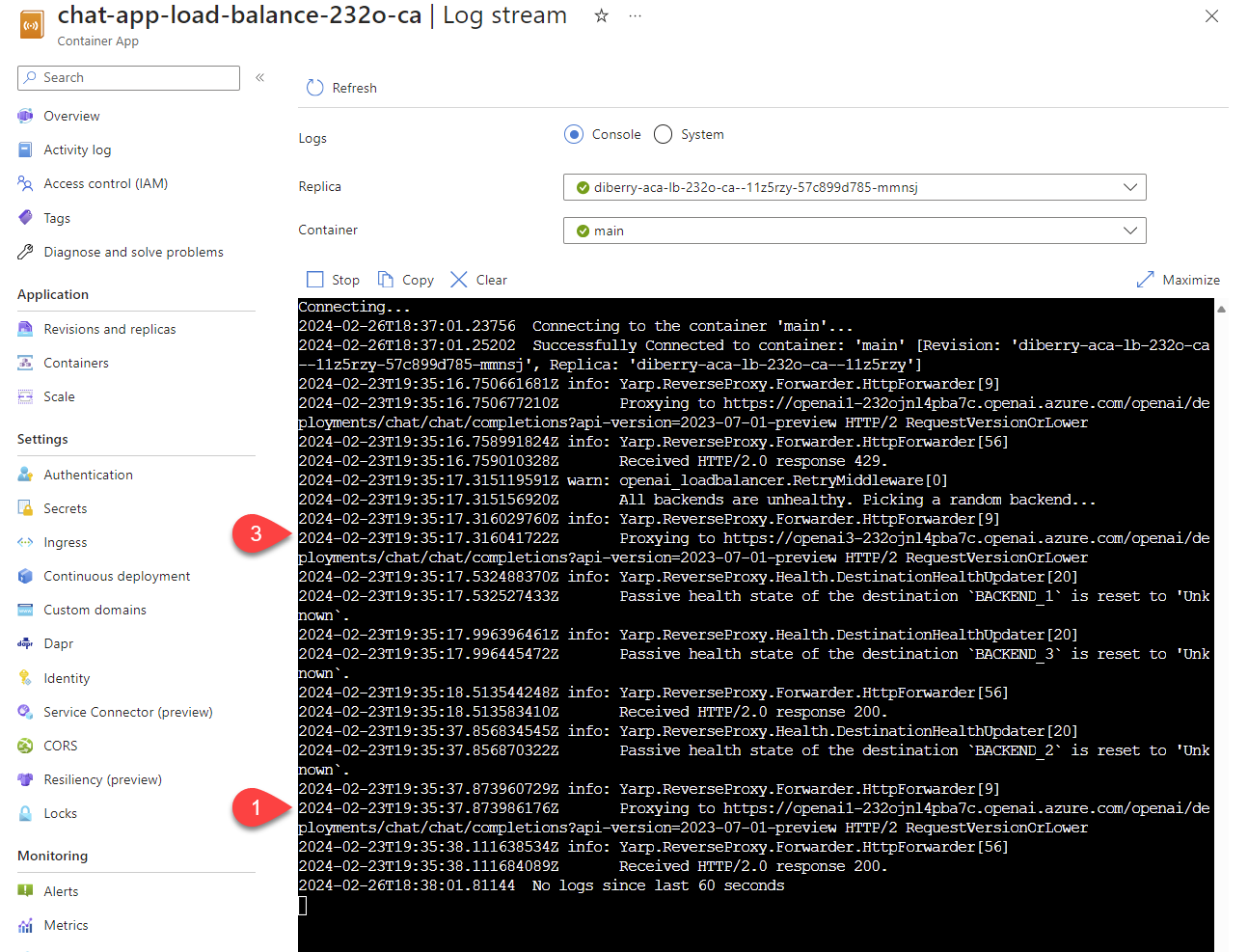

Transmitir logs para ver os resultados do balanceador de carga

No portal do Azure, pesquise seu grupo de recursos.

Na lista de recursos no grupo, selecione o recurso Aplicativos de Contêiner do Azure.

Selecione Monitoramento>Fluxo de log para exibir o log.

Use o aplicativo de chat para gerar tráfego no log.

Busque os logs que fazem referência aos recursos do Azure OpenAI. Cada um dos três recursos tem sua identidade numérica no comentário de log que começa com

Proxying to https://openai3, onde3indica o terceiro recurso do OpenAI do Azure.

Quando o balanceador de carga recebe o status de que a solicitação excede a cota, ele alterna automaticamente para outro recurso.

Configurar a cota do TPM

Por padrão, cada uma das instâncias do OpenAI do Azure no load balancer é implantada com capacidade de 30.000 tokens por minuto (TPM). Você pode usar o aplicativo de chat com a confiança de que ele é escalável para muitos usuários sem esgotar a cota. Altere esse valor quando:

- Se ocorrerem erros de capacidade de implantação: reduza o valor.

- Você precisa de maior capacidade: aumente o valor.

Use o seguinte comando para alterar o valor:

azd env set OPENAI_CAPACITY 50Reimplante o balanceador de carga:

azd up

Limpar os recursos

Após terminar de usar o aplicativo de chat e o balanceador de carga, limpe os recursos. Os recursos do Azure criados neste artigo são cobrados para sua assinatura do Azure. Se você não espera precisar desses recursos no futuro, exclua-os para evitar incorrer em mais encargos.

Limpar recursos do aplicativo de chat

Retorne ao artigo sobre o aplicativo de chat para limpar os recursos:

Limpar recursos do balanceador de upload

Exclua os recursos do Azure e remova o código-fonte:

azd down --purge --force

Os interruptores fornecem:

-

purge: Os recursos excluídos são eliminados imediatamente para que você possa reutilizar os tokens do Serviço OpenAI do Azure a cada minuto. -

force: a exclusão ocorre silenciosamente, sem exigir o consentimento do usuário.

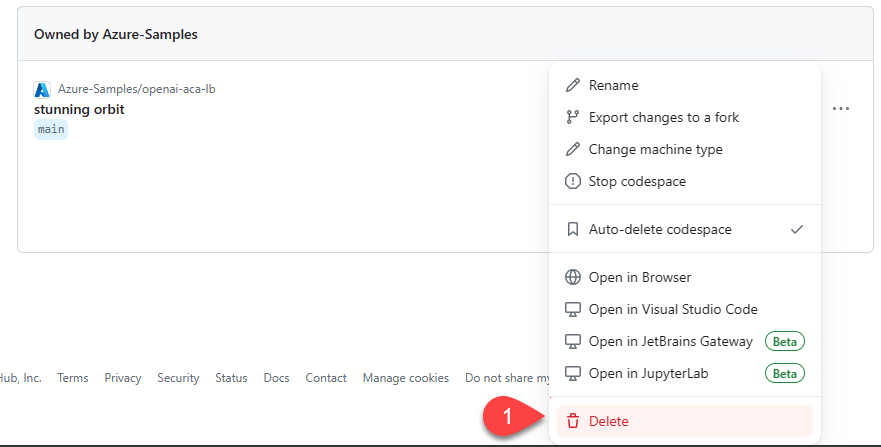

Limpar os codespaces do GitHub e o Visual Studio Code

A exclusão do ambiente GitHub Codespaces garante que você possa maximizar a quantidade de horas gratuitas por núcleo que você tem direito na sua conta.

Importante

Para saber mais sobre os direitos da sua conta do GitHub, confira O GitHub Codespaces inclui mensalmente armazenamento e horas de núcleo.

Faça login no painel de controle do GitHub Codespaces.

Localize seus codespaces em execução que são originados no repositório do GitHub azure-samples/openai-aca-lb.

Abra o menu de contexto do codespace e selecione Excluir.

Obter ajuda

Se você tiver problemas para implantar o balanceador de carga dos Aplicativos de Contêiner do Azure, adicione seu problema à página da Web Problemas do repositório.

Código de exemplo

Os exemplos a seguir são usados neste artigo: